基于Darknet網絡和YOLOv3算法的船舶跟蹤識別

劉博 王勝正 趙建森 李明峰

摘 要:針對我國沿海與內陸水域區域視頻監控處理存在實際利用率低、誤差率大、無識別能力、需人工參與等問題,提出基于Darknet網絡模型結合YOLOv3算法的船舶跟蹤識別方法實現船舶的跟蹤并實時檢測識別船舶類型,解決了重要監測水域船舶跟蹤與識別問題。該方法提出的Darknet網絡引入了殘差網絡的思想,采用跨層跳躍連接方式以增加網絡深度,構建船舶深度特征矩陣提取高級船舶特征進行組合學習,得到船舶特征圖。在此基礎上,引入YOLOv3算法實現基于圖像的全局信息進行目標預測,將目標區域預測和目標類別預測整合于單個神經網絡模型中。加入懲罰機制來提高幀序列間的船舶特征差異。通過邏輯回歸層作二分類預測,實現在準確率較高的情況下快速進行目標跟蹤與識別。實驗結果表明,提出的算法在30frame/s的情況下,平均識別精度達到89.5%,與傳統以及深度學習算法相比,不僅具有更好的實時性、準確性,對各種環境變化具有較好的魯棒性,而且可以識別多種船舶的類型及其重要部位。

關鍵詞:海上交通;船舶監測;船舶跟蹤;船舶類型識別;Darknet網絡;YOLOv3算法

中圖分類號: TP391.41圖像識別及其裝置

文獻標志碼:A

Abstract: Aiming at the problems of low utilization rate, high error rate, no recognition ability and manual participation in video surveillance processing in coastal and inland waters of China, a new ship tracking and recognition method based on Darknet network model and YOLOv3 algorithm was proposed to realize ship tracking and real-time detection and recognition of ship types, solving the problem of ship tracking and recognition in important monitored waters. In the Darknet network of the proposed method, the idea of residual network was introduced, the cross-layer jump connection was used to increase the depth of the network, and the ship depth feature matrix was constructed to extract advanced ship features for combination learning and obtaining the ship feature map. On the above basis, YOLOv3 algorithm was introduced to realize target prediction based on image global information, and target region prediction and target class prediction were integrated into a single neural network model. Punishment mechanism was added to improve the ship feature difference between frames. By using logistic regression layer for binary classification prediction, target tracking and recognition was able to be realized quickly with high accuracy. The experimental results show that, the proposed algorithm achieves an average recognition accuracy of 89.5% with the speed of 30frame/s; compared with traditional and deep learning algorithms, it not only has better real-time performance and accuracy, but also has better robustness to various environmental changes, and can recognize the types and important parts of various ships.

Key words: sea traffic; ship surveillance; ship tracking; ship type recognition; Darknet network; YOLOv3 algorithm

0 引言

近年來各類涉海、用海活動數量越來越多,規模越來越大,海上的各種安全事故、違章、違法行為相應也越來越多,海上船舶監測工作日益繁重。目前主要的監測手段是船舶自動識別系統(Automatic Identification System, AIS)與岸基雷達,但是由于AIS信息中存在主觀錯誤信息,而雷達目標存在信息缺失等原因,因此在港口、沿海,以及江河沿岸都布置了大量視頻攝像頭,對現有AIS與雷達信息進行補充,輔助船舶監控,但是現有視頻監控利用率普遍比較低,主要原因是需要依靠人工進行觀察。為了解決該問題,黃于欣[1]利用OpenCV結合智能算法實現船舶軌跡的監控和跟蹤,該方法通過提取船舶航行軌跡,挖掘潛在特征進行分析。滕飛等[2]利用先跟蹤再學習的檢測(Tracking-Learning-Detection, TLD)框架實現船舶識別和跟蹤,通過構建特征約束方程來校驗特征像素的運動狀態,求解像素與特征方法相關的系數,獲得了短時間的船舶跟蹤結果。為了提高船舶跟蹤的精度,朱廣華[3]結合BP(Back Propagation)神經網絡和卡爾曼濾波算法,構建了一種船舶動態跟蹤模型,該跟蹤模型通過估計船舶運動參數來自適應獲得船舶位置。蔣少峰等[4]還提出了一種基于結構特征分析的船舶類型識別方法,該方法能夠有效提取高分辨率的圖像特征,并利用支持向量機進行分類。但是由于海上視頻攝像頭安裝位置、距離、方位的限制等,導致視頻質量低下,嚴重影響了船舶跟蹤識別率。因此快速、有效、穩定的船舶目標跟蹤與識別是江海沿岸船舶智能監測亟需解決的問題,對于保障海事交通安全,提高海上交通通行效率,實施海事執法等海上任務具有重要意義。

當前,基于計算機視覺的深度學習算法[5]在目標跟蹤識別領域取得了較好的效果, Krizhevsky等[6]提出基于深度學習理論的深度卷積神經網絡(Deep Convolutional Neural Network, DCNN)的圖像分類算法,使圖像分類的準確率大幅提升,同時也帶動了目標檢測準確率的提升。Szegedy等[7]將目標檢測問題看作目標的回歸問題,使用深度卷積神經網絡作為回歸器預測輸入圖像中目標。Erhan等[8]使用深度卷積神經網絡對目標的包圍盒進行回歸預測,并給出每個包圍盒包含類別無關對象的置信度。Sermanet等[9]提出一種基于深度卷積神經網絡(DCNN)框架OverFeat,集成了識別、定位和檢測任務。與OverFeat不同,區域卷積神經網絡(Region-CNN, R-CNN)[10]采用選擇性搜索策略來提高檢測效率,對每個包圍盒利用卷積神經網絡(CNN)提取特征,輸入到為每個類訓練好的支持向量機(Support Vector Machine, SVM)分類器,得到包圍盒屬于每個類的分數。Simonyan等[11]和Szegedy等[12]設計了層數22層的深度卷積神經網絡,采用的檢測框架都類似區域卷積神經網絡(R-CNN)。He等[13]提出了一個可以看作單層的網絡層,叫作感興趣區域(Region of Interest, ROI) Pooling,這個網絡層可以把不同大小的輸入映射到一個固定尺度的特征向量,提高了檢測速率。為了避免候選區域提取耗時比實際對象檢測還多的場景,于是Girshick[14]提出了快速區域卷積神經網絡,出現了一個端到端的對象檢測模型,檢測階段非常方便快捷。Liu等[15]提出的單點多盒探測器(Single Shot multibox Detector, SSD)的檢測方法,使用小型卷積濾波器來預測邊界框位置中的對象類別和偏移量,對不同的寬高比檢測使用不同的預測器(濾波器),并將這些濾波器應用于網絡后期的多個特征映射中,以執行多個尺度的檢測。而面向海上交通視覺感知任務中,考慮到水上交通中船舶成像尺寸的變化,光照變化、船舶成像視角變化和交叉會遇局面中的船舶成像重疊以及人工參與等問題,嚴重影響了船舶跟蹤識別率。

針對以上問題,本文提出了基于深度學習框架的Darknet網絡模型結合YOLOv3算法[16]的船舶跟蹤識別方法。該方法改進了傳統深度學習中的基礎分類網絡結構和目標的二分類預測方法,實現了船舶的跟蹤并實時檢測識別船舶類型。首先,對輸入的船舶圖像樣本數據,使用殘差連接方式構建的深層網絡模型通過構建的船舶特征矩陣進行卷積操作,提取相應特征,進行組合學習,訓練得到物體的特征圖模型;并在此基礎上添加特征交互層,分為三個尺度,每個尺度內通過卷積核的方式實現特征圖局部的特征交互,根據數據標準化處理以及維度聚類、細粒度特征操作,直接預測出船舶目標物體的中心坐標;同時,引入懲罰機制來提高模型的泛化能力,更好地匹配定位跟蹤船舶,在此基礎上添加多標簽多分類的邏輯回歸層,對每個類別作二分類從而實現對目標船舶進行分類識別。所提出的跨層連接方式,解決了傳統的深度學習中因卷積神經網絡的層數增加而出現的梯度消失和梯度爆炸情況,避開了過擬合操作,有很好的收斂性和魯棒性。最后,通過大量實驗對比經典算法和深度學習算法在復雜的海況下的跟蹤識別率和魯棒性差異,驗證了該算法的有效性。

1 船舶跟蹤識別原理

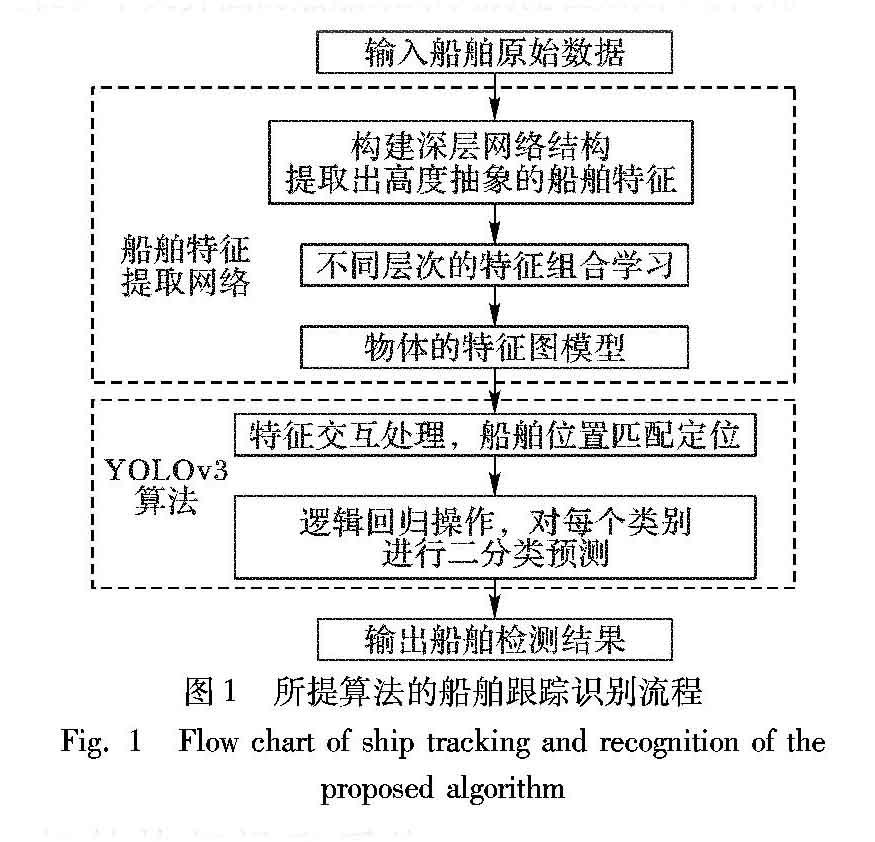

在海上智能交通監測中,基于視頻的船舶跟蹤識別是非常重要的任務之一。高效的船舶跟蹤算法和識別算法不僅能夠在不同應用場景下有效地跟蹤感興趣區域(ROI)的船舶,還要識別出多種船舶的類型。傳統處理方法都是基于AIS系統和雷達結合,通過對基于 Multi-view 學習和稀疏學習機制的船舶跟蹤算子(Ship Tracker based on Multi-view learning and Sparse representation, STMS)、卡爾曼濾波、粒子濾波、mean-shift等算法[17-19]的改進,取得了一定的效果;但是對于跟蹤和識別沒有很好的結合,尚不能很好地應用于海上智能交通管理中。本文以Darknet網絡為基礎和YOLOv3算法構建了一種實時的船舶跟蹤識別算法,達到速度和精度的均衡化。所提出的船舶跟蹤識別模型中,船舶特征提取網絡(Darknet網絡)及YOLOv3算法的分類識別是實現船舶跟蹤識別的關鍵環節,因此這里著重介紹特征提取網絡和YOLOv3算法學習過程。本文算法的船舶跟蹤識別流程如圖1所示。

2 船舶特征提取網絡

特征提取網絡對船舶特征提取、學習的能力是船舶跟蹤以及類型識別的關鍵。深度學習框架的Darknet網絡結構采用殘差網絡的連接思想,引入了Residual結構,在保證網絡結構很深的情況下,仍能收斂。但針對于船舶特征提取過程中,由于船舶所屬空間屬于動態變化的高海況復雜區域,其原有的基礎網絡結構提取到的船舶類型特征有一部分是低級船舶特征,而這部分低級船舶特征之間不僅沒有顯著差別,還會直接影響計算速度、不同類型的船舶識別精度。為了可以提取到不同的船舶深度特征表達,產生更多特征組合學習得到物體的特征圖,在原有的基礎網絡結構中構建船舶深度特征矩陣,以提取船舶的高級特征,同時加入最大池化層,以及引入局部神經元的活動創建競爭機制。基于Darknet網絡結構為面向船舶特征提取的網絡框架如圖2所示。

通過網絡結構的卷積層獲取上一個深度網絡層輸出的底層船舶特征進行特征學習,提取出高度抽象的船舶特征[20]。以集裝箱船為例,通過構建的網絡結構對低層油輪特征圖進行提取得到的高層油輪特征圖如圖3所示。卷積層中的船舶深度特征提取對應的矩陣如下:

3 船舶跟蹤與識別

YOLOv3算法通過特征提取網絡對輸入圖像采用回歸思想直接提取特征,得到一定尺寸的特征圖,然后將輸入圖像分成相應大小的網格,通過網格預測出的包圍盒與真實邊框中目標物體的中心坐標直接進行匹配定位,在此基礎上對目標物體進行分類識別。

3.1 船舶跟蹤

對于船舶所在的空間環境具有背景相似性以及船舶移動出現的重疊性,直接采用邊框回歸進行船舶目標的坐標預測從而匹配定位進行跟蹤船舶,會出現船舶邊界框丟失的結果。為了有效抑制背景相似物體防止跟蹤框漂移,同時實現對目標本身的移動更加魯棒的效果,構建懲罰機制對模型特征進行處理,并對這些特征進行表示和學習,以實現視頻序列中船舶跟蹤的目的。為了獲得較好的跟蹤效果,引入坐標預測框作為代價函數,該懲罰機制如下:

其中:對于該模型中每一個特征k,用DK來表示船舶圖像跟蹤序列,VK為船舶特征圖的特征矩陣,UK為序列DK的矩陣表現形式; fL是代價函數,用來評估船舶目標和船舶特征圖矩陣在第i個特征的差異程度。較小的代價值說明該模型獲得了較好的跟蹤效果。將矩陣UK分解為系數矩陣PK和QK(如式(5)所示)。PK為第k個特征的矩陣表現形式,通過水平填充PK獲取全局表征矩陣P,類似可求全局系數矩陣Q。參數‖P‖1,2表示該模型各個特征的獨立性,即全局系數矩陣P行稀疏程度越高,越能體現不同特征之間的耦合程度。‖QT‖1,2表示模型跟蹤的異常結果。式(4)中的參數λ1表征了全局系數矩陣P的懲罰度,參數λ2是全局系數矩陣Q對應的懲罰系數。

3.2 船舶類型識別

對于海上船舶類型的識別,船舶的空間分布具有交疊現象,會出現同一個框檢測對應兩個不同的船舶,這樣只能識別出一種船舶類型,造成了識別率下降。本文采用多標簽分類進行目標類別預測,在網絡結構上添加了多標簽多分類的邏輯回歸層。以sigmoid函數[21]為邏輯回歸單元來對每個類別作二分類。表達式如下:

4 實驗與結果分析

4.1 船舶監控視頻數據源

上海港已成為世界上最重要的港口之一,其集裝箱吞吐量在2016年已經超過3600萬TEU(Twenty-foot Equivalent Unit)。上海港巨大的集裝箱吞吐量導致上海港腹地內的航道是國內內河運輸最為繁忙的航道之一。因此,利用提出的船舶跟蹤識別模型檢測上海港監控視頻中的船舶具有一定的實際意義。將采集到的海事監控視頻被分為兩組,以評價船舶檢測算法的性能。第一組船舶監控視頻基于通航環境良好的情況下,用于評估船舶檢測模型不同交通狀態下的檢測性能。第二組船舶監控視頻是基于霧天航行的環境下,用于測試在能見度很低情況下,船舶檢測模型的魯棒性和準確性。本研究的實驗平臺是 Windows 10操作系統,16GB RAM,CPU處理器的主頻是 3.2GHz,GPU為GTX 1050Ti, 實驗平臺是PyCharm(2018版)。

4.2 實驗結果分析

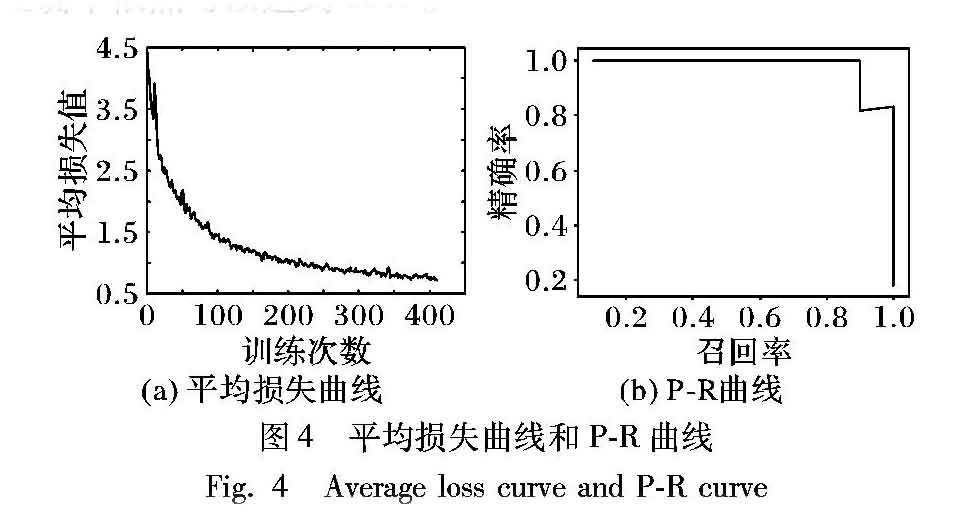

為了驗證檢測的有效性和可靠性,根據圖3(a)顯示的訓練過程迭代次數的平均損失曲線發現,訓練迭代400次后,隨著迭代次數增加,平均損失函數值基本保持不變,并趨于穩定,表明該算法在訓練過程中具有很快的收斂性。通過準確率召回率(Precision-Recall)曲線來衡量分類器的性能指標,以集裝箱船為例,測試圖像數據有A個集裝箱船,通過訓練好的模型檢測到集裝箱船有B個,而其中被正確檢測到的集裝箱船有C個,則準確率召回率定義如下:召回率(Recall)為C/A;準確率(Precision)為C/B。

根據圖4(b)召回率準確率(P-R)曲線可知,在不損失精度的條件下能達到85%召回率;而當召回率達到80%時,準確率依然可以達到80%。

4.3 效果對比

分別提取不同環境和不同交通流量下的船舶監控視頻中關鍵幀來評價算法的檢測性能。用本文提出的YOLOv3算法對視頻序列的船舶進行檢測;此外,使用基于傳統算法的卡爾曼(Kalman)算法和Meanshift 跟蹤算法,以及基于 Multi-view 學習和稀疏學習機制的船舶跟蹤算子(STMS)模型也分別檢測該視頻序列的船舶,以比較不同場景下不同算法的檢測性能[22]。從圖5中可以看出,基于傳統算法在早期的船舶跟蹤過程中均顯示了較好的跟蹤效果;然而,在第168幀和372幀出現跟蹤邊框距離真實的目標船舶較遠,甚至在第450幀時,沒有正確跟蹤到目標船舶。而且,以上算法只能標記一類船舶目標,無法進行多目標的跟蹤且沒有識別功能。根據圖6可以看出,本文提出的YOLOv3算法幾乎能跟蹤識別該幀中所有的船舶,做到了實時檢測船舶。在海上交通流量較大的情況下,該算法的檢測性能基本保持不變, 而傳統算法則存在一定的誤檢率。

4.4 不同方法對比實驗

為了驗證本文方法的有效性,用當前常用的深度學習目標識別方法來進一步對比驗證該模型的識別性能。采用K-近鄰算法(K-Nearest Neighbors, KNN)、人工神經網絡(Artificial Neural Network, ANN)、傳統神經網絡(CNN)和深度卷積神經網絡(DCNN)方法對不同船舶類型作實驗對比。在本實驗的條件下,統一約定IoU(Intersection-over-Union)值大于0.75為目標檢測正確,結果如表1所示。

5 結語

本文提出的基于Darknet網絡和YOLOv3算法的船舶跟蹤識別方法在面向智能航行視覺感知任務的船舶跟蹤識別問題中,有效克服了不同的光照、不同天氣和風浪等各種海況條件下以及人工參與的缺陷。與傳統算法的對比實驗表明,該算法能夠在快速實時檢測船舶的情況下,又有很好的準確性和魯棒性。本研究是基于可視條件較好的船舶跟蹤和船舶類型識別研究,并未開展可視條件不佳的船舶檢測、跟蹤與船舶類型識別相關研究,例如基于夜視條件下的船舶檢測、船舶跟蹤和船舶類型識別研究。后續工作將融合雷達、紅外和 AIS 等海上交通數據,對可視條件不佳的船舶跟蹤識別等問題展開深入研究。

參考文獻 (References)

[1] 黃于欣.基于openCV的視頻路徑船舶檢測與跟蹤[J].艦船科學技術,2017,39(8A):28-30.(HUANG Y X. Ship detection and tracking based on openCV video path [J]. Ship Science and Technology, 2017, 39(8A): 28-30.

[2] 滕飛,劉清,郭建明,等.TLD框架下的內河船舶跟蹤[J].應用科學學報,2014,32(1):105-110.(TENG F, LIU Q, GUO J M, et al. Inland waterway ship tracking using a TLD framework [J]. Journal of Applied Sciences, 2014, 32(1):105-110.)

[3] 朱廣華.BP神經網絡和卡爾曼濾波相結合的船舶運動跟蹤[J].艦船科學技術,2016,38(10A):82-84.(ZHU G H. Ship motion tracking based on combination of BP neural network and Kalman filter [J]. Ship Science and Technology, 2016, 38(10A): 82-84.)

[4] 蔣少峰,王超,吳樊,等.基于結構特征分析的COSMO-SkyMed圖像商用船舶分類算法[J].遙感技術與應用,2014,29(4):607-615.(JIANG S F, WANG C, WU F, et al. Algorithm for merchant ship classification in COSMO-SkyMed images based on structural feature analysis [J]. Remote Sensing Technology and Application, 2014, 29(4): 607-615.)

[5] 胡侯立,魏維,胡蒙娜.深度學習算法的原理及應用[J].信息技術,2015(2):175-177.(HU H L, WEI W, HU M N. Principles and practices of deep learning [J]. Information Technology, 2015(2): 175-177.)

[6] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks [C]// NIPS 2012: Proceedings of the 25th International Conference on Neural Information Processing Systems. North Miami Beach, FL: Curran Associates Inc., 2012: 1097-1105.

[7] SZEGEDY C, TOSHEV A, ERHAN D. Deep neural networks for object detection [C]// Proceedings of the 2013 International Conference on Neural Information Processing Systems. Cambridge, MA: MIT Press, 2013: 2553-2561.

[8] ERHAN D , SZEGEDY C , TOSHEV A , et al. Scalable object detection using deep neural networks [C]// CVPR 2014: Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2014: 2155-2162.

[9] SERMANET P, EIGEN D, ZHANG X, et al. Overfeat: Integrated recognition, localization and detection using convolutional networks [EB/OL]. [2018-08-25]. https://www.nvidia.co.kr/content/tesla/pdf/machine-learning/overfeat-recognition-localication-detection.pdf.

[10] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation [C]// CVPR 2014: Proceedings of the 2014 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2014: 580-587.

[11] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition [EB/OL]. [2018-08-25]. https://arxiv.org/abs/1409.1556.

[12] SZEGEDY C, LIU W, JIA Y Q, et al. Going deeper with convolutions [C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2015:1-9.

[13] HE K M, ZHANG X Y, REN S Q, et al. Spatial pyramid pooling in deep convolutional networks for visual recognition [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(9): 1904-1916.

[14] GIRSHICK R. Fast R-CNN [EB/OL]. [2018-08-24]. http://cn.arxiv.org/pdf/1504.08083.pdf.

[15] LIU W, ANGUELOV D, ERHAN D, et al. SSD: single shot multibox detector [C]// ECCV 2016: Proceedings of the 2016 European Conference on Computer Vision, LNCS 9905. Cham: Springer, 2016: 21-37.

[16] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection [C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC: IEEE Computer Society, 2015: 779-788.

[17] CHAUHAN A K, KRISHAN P. Moving object tracking using gaussian mixture model and optical flow [J]. International Journal of Advanced Research in Computer Science and Software Engineering, 2013, 3(4): 243-246.

[18] TRIPATHI R P, GHOSH S, CHANDLE J O. Tracking of object using optimal adaptive Kalman filter [C]//Proceedings of the 2016 IEEE International Conference on Engineering and Technology. Piscataway, NJ: IEEE, 2016: 17-18.

[19] 翟衛欣,程承旗.基于Kalman濾波的Camshift運動跟蹤算法[J].北京大學學報(自然科學版),2015,51(5):799-804.(ZHAI W X, CHENG C Q. A Camshift motion tracking algorithm based on Kalman filter [J]. Acta Scientiarum Naturalium Universitatis Pekinensis, 2015, 51(5): 799-804.)

[20] FANG J, ZHOU Y, YU Y, et al. Fine-grained vehicle model recognition using a coarse-to-fine convolutional neural network architecture [J]. IEEE Transactions on Intelligent Transportation Systems, 2017, 18(7): 1782-1792.

[21] 張舞杰,李迪,葉峰.基于Sigmoid函數擬合的亞像素邊緣檢測方法[J].華南理工大學學報(自然科學版),2009,37(10):39-43.(ZHANG W J, LI D, YE F. Sub-pixel edge detection method based on Sigmoid function fitting [J].Journal of South China University of Technology (Natural Science Edition), 2009, 37(10): 39-43.)

[22] CHEN X Q, WANG S Z, SHI C J, et al. Robust ship tracking via multi-view learning and sparse representation [J]. Journal of Navigation, 2019, 72(1): 176-192.