基于YCbCr顏色空間和BP神經(jīng)網(wǎng)絡(luò)的火焰圖像檢測

曲 娜, 王建輝, 陳琦華

(1. 東北大學(xué) 信息科學(xué)與工程學(xué)院, 遼寧 沈陽 110819; 2. 沈陽航空航天大學(xué) 安全工程學(xué)院, 遼寧 沈陽 110136)

隨著社會經(jīng)濟(jì)的不斷發(fā)展, 高層和超高層建筑的不斷增多, 火災(zāi)探測的難度越來越大, 火災(zāi)造成的損失也日趨嚴(yán)重. 根據(jù)《中國消防年鑒》, 2013年中國共統(tǒng)計火災(zāi)38.8萬起, 死亡2 113人, 受傷1 637人, 直接財產(chǎn)損失48.5億元. 如果能盡早地發(fā)現(xiàn)火災(zāi), 及時地控制住火災(zāi)的發(fā)展和蔓延, 對于進(jìn)一步預(yù)防火災(zāi)事故的發(fā)生至關(guān)重要, 火災(zāi)死傷人數(shù)和財產(chǎn)損失將會有大幅度地下降.

傳統(tǒng)的火災(zāi)探測設(shè)備比較適合相對封閉的地方或空間狹小的區(qū)域,對于開闊區(qū)域和高大空間建筑,可能會因為探測器和火源的距離較遠(yuǎn)導(dǎo)致煙霧顆粒濃度、溫度等參數(shù)值難以達(dá)到報警閾值而延誤報警時間. 傳統(tǒng)的火災(zāi)探測設(shè)備也有一些基于紅外線和紫外線的探測方法,可以探測高大空間建筑火災(zāi), 但此類探測設(shè)備價格相對較貴而且容易受到干擾而產(chǎn)生誤報.隨著視頻監(jiān)控的普及, 人工智能和模式識別技術(shù)的不斷發(fā)展,基于視頻的火災(zāi)探測方法越來越受到重視. 針對火焰圖像的火災(zāi)檢測主要依據(jù)火焰顏色、火焰形狀和動態(tài)特征等特點, 利用神經(jīng)網(wǎng)絡(luò)、支持向量機(jī)、馬爾科夫模型、專家系統(tǒng)等方法檢測火災(zāi). 文獻(xiàn)[1]通過火災(zāi)出現(xiàn)時著火的面積不斷擴(kuò)大、火焰的邊緣部分不斷閃爍等特點, 提出一種通過BP神經(jīng)網(wǎng)絡(luò)檢測火災(zāi)的系統(tǒng). 文獻(xiàn)[2]提出一種使用隱馬爾科夫模型探測火焰的算法和基于計算機(jī)視覺的實時火焰探測算法. 文獻(xiàn)[3]提出一種多特征融合的火焰探測算法. 算法融合了火焰的動態(tài)和靜態(tài)特征, 使用可信度理論探測火焰. 文獻(xiàn)[4]提出一種使用統(tǒng)計顏色模型探測火焰的算法. 文獻(xiàn)[5]提出基于視覺傳感器和支持向量機(jī)的視頻火災(zāi)探測系統(tǒng). 文獻(xiàn)[6]提出一種基于視覺特征概率密度函數(shù)的模糊火焰檢測方法. 文獻(xiàn)[7]使用火焰的顏色和時空信息特點, 利用協(xié)方差矩陣和支持向量機(jī)來識別火焰. 文獻(xiàn)[8]提出使用圖像處理和PIR傳感器探測火災(zāi)火焰的方法. 文獻(xiàn)[9]提出一種探測汽車停車場等大空間的火焰和煙氣方法. 文獻(xiàn)[10]使用運動評估器區(qū)分火的運動特征和其它運動類型. 提出2個新的光流估計OMT和NSD. 文獻(xiàn)[11]提出了新穎的室內(nèi)火災(zāi)探測和室外火災(zāi)探測方法. 室內(nèi)探測器是基于深度和振幅的圖像, 室外探測器采用了視覺火焰探測器, 而不是快速變化的深度檢測. 文獻(xiàn)[12]通過視頻采集火災(zāi)圖像,分析火焰顏色、形狀變化和運動等, 形成多專家系統(tǒng)探測火災(zāi). 文獻(xiàn)[13]采用火災(zāi)的各種時空特征,如顏色、閃爍和時空能源等建立火災(zāi)行為模型, 從而探測火災(zāi).文獻(xiàn)[14]提出了檢測煙霧多重特征分析的方法, 由3個階段組成. 在第1階段, 基于YUV顏色空間進(jìn)行分割候選煙霧區(qū)域. 本文利用YCbCr顏色空間與BP神經(jīng)網(wǎng)絡(luò)相結(jié)合的方法來實現(xiàn)可對火災(zāi)圖像進(jìn)行識別的目的.

1 YCbCr顏色空間

YCbCr顏色空間中的Y指亮度信息,Cb、Cr都指色彩信息,其中Cb是藍(lán)色分量,Cr是紅色分量.采用YCbCr顏色空間的步驟如下[15-16].

1) 格式轉(zhuǎn)化.進(jìn)行神經(jīng)網(wǎng)絡(luò)訓(xùn)練之前,所輸入的原始火焰圖像都是RGB顏色空間的圖像.需要將其轉(zhuǎn)化為以YCbCr顏色空間為圖像.利用式(1)將RGB圖像轉(zhuǎn)化為YCbCr圖像,各分量取值范圍為0~255.

2) 閾值分割.圖像中亮度分量取值為16~235,2個色差分量的取值為16~240.

3) 濾波.在攝像機(jī)所拍攝的圖像中,椒鹽噪聲通常對其破壞較大.中值濾波對椒鹽噪聲的處理效果較好,通過對數(shù)據(jù)排序的方法更能保持圖像的清晰度.

4) 特征區(qū)域提取.利用MATLAB的bwlabel函數(shù)來實現(xiàn).

5) 二值特征提取.利用MATLAB的regionprops函數(shù)提取火焰圖像的二值特征.

2 BP神經(jīng)網(wǎng)絡(luò)

2.1 BP神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)

BP神經(jīng)網(wǎng)絡(luò)是一種按誤差逆?zhèn)鞑ニ惴ㄓ?xùn)練的多層前饋網(wǎng)絡(luò),主要是由輸入層、隱含層和輸出層3個部分組成.文中將Y、Cb、Cr3個分量做為神經(jīng)網(wǎng)絡(luò)的輸入,即輸入節(jié)點數(shù)為3,輸出節(jié)點數(shù)為1,隱含層為1層,如圖1所示.

利用式(2)計算隱層的節(jié)點數(shù).

(2)

式中:n為輸入的節(jié)點數(shù);m為輸出節(jié)的點數(shù);c為1~10的常數(shù).通過反復(fù)實驗,當(dāng)c取8時,即隱層節(jié)點數(shù)為10時,正確率最高且速度較快.

圖1 BP神經(jīng)網(wǎng)絡(luò)模型Fig.1 BP neural network model

2.2 BP神經(jīng)網(wǎng)絡(luò)構(gòu)建

BP神經(jīng)網(wǎng)絡(luò)的構(gòu)建第一步要對神經(jīng)網(wǎng)絡(luò)進(jìn)行初始化. 設(shè)n是輸入層的節(jié)點個數(shù),l是隱含層的節(jié)點個數(shù),m是輸出層的節(jié)點個數(shù),ωij是輸入層到隱含層的權(quán)重,ωjk是隱含層到輸出層的權(quán)重,aj是輸入層到隱含層的偏置,bk是隱含層到輸出層的偏置,δ是學(xué)習(xí)速率,g(x)是激勵函數(shù). 其中激勵函數(shù)為g(x)取Sigmoid函數(shù).i=1,…,n;j=1,…,l;k=1,…,m.

第二步是計算隱含層的輸出,設(shè)Hj是隱含層的輸出值,則

(3)

計算輸出層的輸出,設(shè)Ok是輸出層的輸出,則

(4)

計算誤差,求誤差的公式為

(5)

Yk是期望輸出.令Yk-Ok=ek,那么E可轉(zhuǎn)化為

(6)

利用式(7)來更新權(quán)值,

(7)

利用式(8)更新閾值,

(8)

3 火焰圖像識別

3.1 火災(zāi)圖像的訓(xùn)練

利用100張樣本圖像對BP神經(jīng)網(wǎng)絡(luò)模型進(jìn)行訓(xùn)練,訓(xùn)練時各分量如表1和表2所示.

表1 輸入層到隱層的權(quán)值和閾值

表2 隱含層到輸出層的權(quán)值和閾值

3.2 樣本識別結(jié)果

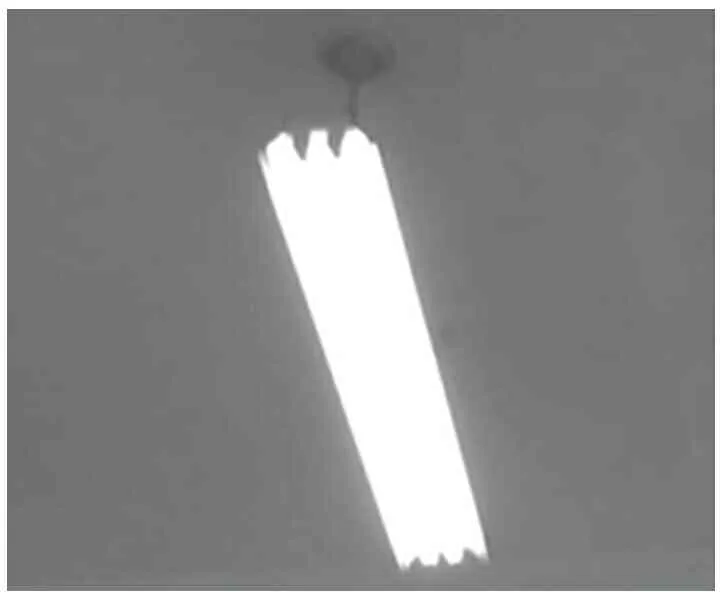

利用10組火災(zāi)樣本圖像和10組干擾樣本圖像驗證模型的有效性.輸入火災(zāi)樣本圖像如圖2所示,運行結(jié)果如圖3所示,說明識別結(jié)果正確.輸入干擾樣本圖像如圖4所示,運行結(jié)果如圖5所示,說明識別結(jié)果正確.

圖2 火災(zāi)樣本圖像Fig. 2 Image of the fire sample ?TestFireDetectionSmall Fire

圖4干擾樣本圖像

Fig.4Theinterferencesampleimage

?TestFireDetection No Fire

?

圖5干擾樣本運行結(jié)果

Fig.5Runningresultoftheinterferencesample

4 結(jié) 論

利用YCbCr顏色空間提取發(fā)生火災(zāi)時火焰的亮度分量和紅、藍(lán)2個顏色分量作為火災(zāi)探測參量,利用BP神經(jīng)網(wǎng)絡(luò)建立火災(zāi)探測模型,輸入節(jié)點數(shù)為3,隱層節(jié)點數(shù)為10,輸出層節(jié)點數(shù)為1.通過MATLAB仿真驗證了該方法檢測火災(zāi)的有效性.與傳統(tǒng)檢測煙霧、溫度等火災(zāi)參量的方法相比,該方法的準(zhǔn)確率更高,適合更多場合的應(yīng)用.