基于深度神經網絡和LSTM的文本情感分析

王子牛,吳建華,高建瓴,陳婭先,王 許

?

基于深度神經網絡和LSTM的文本情感分析

王子牛1,吳建華2,高建瓴2,陳婭先2,王 許2

(1. 貴州大學計算機網絡中心,貴州 貴陽 550000;2. 貴州大學大數據與信息工程學院,貴州 貴陽 550000)

在自然語言處理任務中,詞向量的出現大幅度提高了模型的性能,因此通常直接使用詞向量初始化的深度模型。由于訓練的數據集和方法會影響詞向量的質量,為了減少這種影響,本文提出了深度神經網絡結合LSTM模型來實現情感分析。先將詞向量輸進到深度神經網絡實現對詞向量的隱藏特征再一次提取,然后輸入到LSTM網絡中進行情感分析,由此來提高情感分析的準確率。實驗表明,本文提出的模型比起單個LSTM模型,深度神經網絡結合LSTM模型在文本情感分析上具有更高的性能。

情感分析;詞向量;深度神經網絡;LSTM

0 引言

目前國內的電商發展迅猛,網上購物早已普及,隨之而來的是大量的商品評論。而對商品評論進行相應的情感分類,不僅可以了解大眾對商品喜愛還是厭惡,而且還有利于商家對客戶提出相應的購買建議及對其商品和服務的改進,從而提高商品的商業價值。因此,對中文商品評論進行相應情感傾向[1]分析是非常有必要的。

傳統的文本情感分類方法主要有兩種:1)基于詞典(Lexicon-based)的情感分類方法;2)基于機器學習的情感分類方法。前者核心模式是“詞典+規則”,即以情感詞典[2]作為判斷情感極性的主要依據,同時兼顧評論數據中的句法結構,設計相應判斷規則。本質上依賴情感詞典和判斷規則的質量,而這兩者都需要人工設計,因此這類方法優劣取決于人工設計和先驗知識,其推廣能力差;而后者基于機器學習的情感分類方法多使用經典分類模型如支持向量機[3]、樸素貝葉斯、最大熵模型等,其中多數分類模型的性能依賴于標注數據集的質量,而獲取高質量的標注數據也需要耗費大量的人工成本。

隨著深度神經網絡的興起,深度神經網絡在自然語言處理也被廣泛應用。2003年 Bengio等人[4]通過神經網絡訓練詞向量來表示文本。詞向量不僅可以有效獲取語義信息[5],而且避免了數據稀疏性問題,利用詞向量表示文本,并采用深度學習模型,如遞歸神經網絡[6-7]、卷積神經網絡(CNN)[8-9]、循環神經網絡(RNN)[10]等進行分類[11-13]可以獲得比傳統機器學習方法更優的效果。

考慮到在對商品評論進行情感分類時,文本對上下文有較強的依賴性,而傳統的神經網絡模型不能很好地解決該問題。Elman[14]在1990年提出了循環神經網絡(Recurrent Neural Network,RNN),RNN具有一定的處理長序列的能力,但存在梯度爆炸和消失的問題。為了解決這個問題,1997年,Hochreiter &Schimidhuber[15]提出了長短期記憶單元(Long Short- Term Memory,LSTM)用于改進傳統的RNN模型。LSTM通過帶細胞的記憶單元來替代RNN隱藏層中的模塊,同時使用輸入門和輸出門來讓信息選擇式通過。1999年,Gers等[16]在前面的基礎上又引入了遺忘門。這三個門和細胞狀態的設計,使得LSTM可以記憶、更新長距離的信息,從而可以實現對長距離信息的處理。因此本文將采用長短時記憶神經網絡(LSTM)進行情感分類。另外,引入深度神經網絡對詞向量隱藏特征提取。基于此,本文提出了一種基于深度神經網絡結合LSTM模型對中文商品評論進行情感分類。為了驗證模型的有效性,本文采用某電商網站的京東網站對美的熱水器評論數據集對模型進行實驗。實驗結果表明,該模型取得了較好的效果。

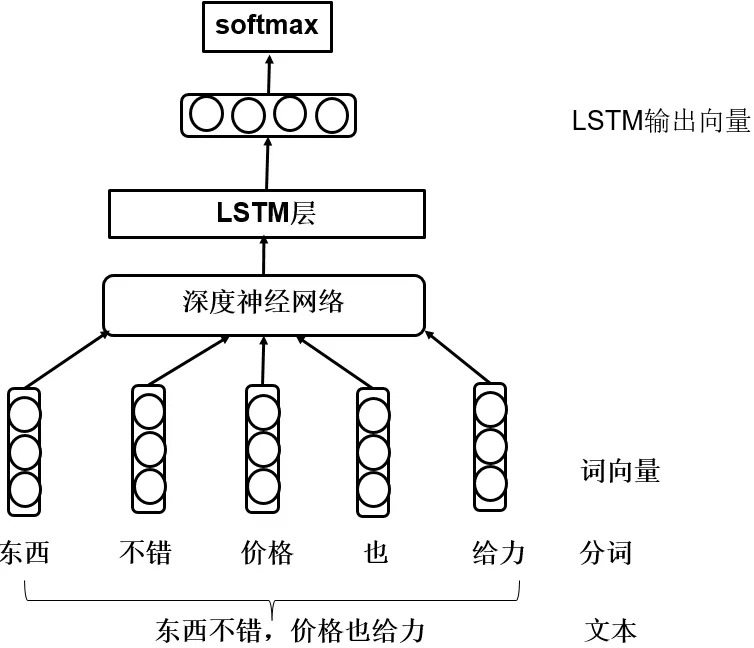

1 基于深度神經網絡和LSTM的本文模型

基于深度神經網絡和LSTM的模型如圖1所示。該模型主要有四個部分組成:

圖1 基于深度神經網絡和LSTM的模型

(1)將文本分詞后,用詞向量來表示。

(2)利用深度神經網絡對詞向量隱藏特征的提取。

(3)利用LSTM層獲取文本特征。

(4)最后利用softmax分類器進行情感分類。

◆申請課題時,無論自己的知識儲備如何,皆敢氣吞山河地聲稱其成果將有重大創新與社會影響、理論價值、國內領先、國際一流云云.

1.1 文本的詞向量表示

1.2 深度神經網絡

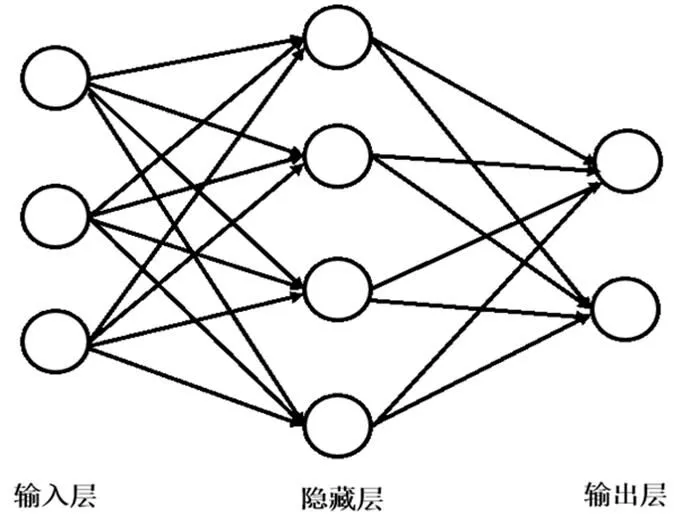

深度神經網絡其第一層為輸入,最后一層為輸出,中間層都為隱藏層,其三層結構大致如圖2所示:

圖2 簡單的三層深度神經網絡示意圖

在構建深度學習網絡層時,輸入層和輸出層只有一層,但是隱藏層則根據實際任務所需可以有很多層。其中,輸入層是輸入的數據。而隱藏層和輸出層則由神經元構成,而且每一層的神經元個數不是固定的,由具體任務實現時而定。每個神經元結構如圖3所示:

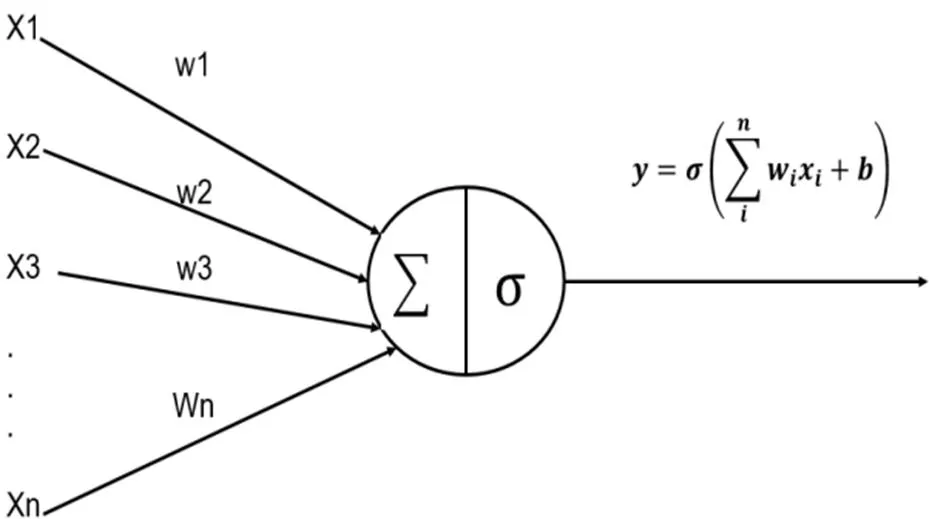

圖3 神經元

一個神經元有n個輸入,每一個輸入對應一個權值w,神經元內會對輸入與權重做乘法后求和,求和的結果與偏置做和,最終將結果放入激活函數中,由激活函數給出最后的輸出。

1.3 LSTM模型

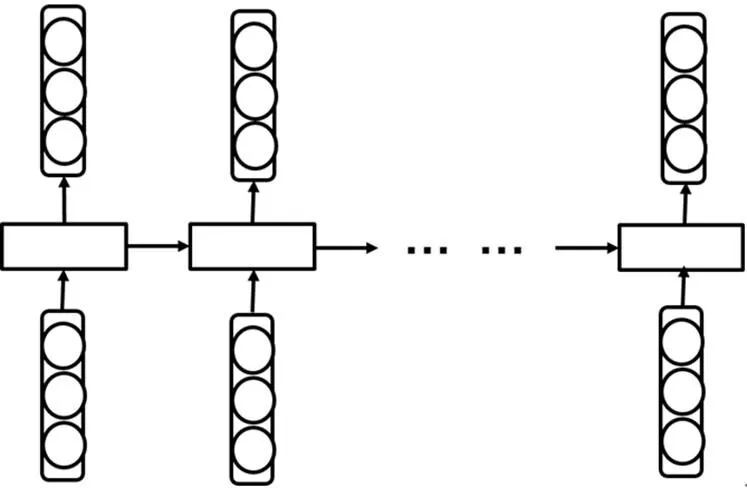

在處理時間序列問題上,無論是分類還是預測的問題,循環神經網絡(RNN)都有著很好的優勢。它能夠將循環神經網絡的神經單元輸出作為下個神經單元的輸入,這樣可以有效利用前面的信息。在情感分析的問題中循環神經網絡能夠利用上文信息,從而提高分類的準確率。然而,傳統循環神經網絡利用上文信息的有限,當文本過長時,容易造成梯度爆炸和消失的問題。之后提出的LSTM能夠避免梯度爆炸和消失的問題,而LSTM也是RNN的一種,也具有對上文信息有效利用,它的模型如圖4所示:

圖4 LSTM模型

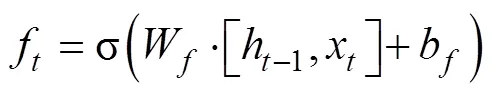

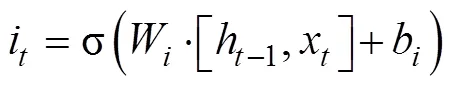

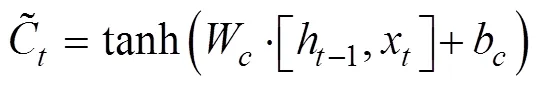

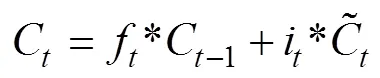

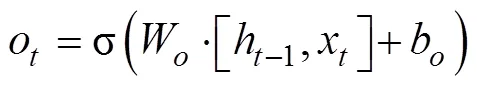

LSTM模型是一系列重復的LSTM單元構成,每個單元模塊包含三個門:遺忘門(forget gate)ft、輸入門(input gate)it、輸出門(output gate)ot和一個記憶單元(memory cell)Ct,LSTM單元的表示如下:

1)遺忘門(forget gate):遺忘門是以上一單元的輸出ht-1和本單元輸入xt為輸入的sigmoid函數,為Ct-1的每一項產生[0,1]內的值,來控制上一單元被遺忘的程度

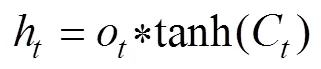

3)輸出門(output gate):輸出門用來控制當前的單元狀態有多少被過濾掉。先將單元狀態激活,輸出門為其中每一項產生一個在[0,1]內的值,控制單元狀態被過濾的程度。

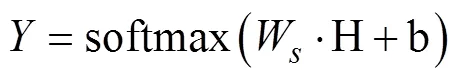

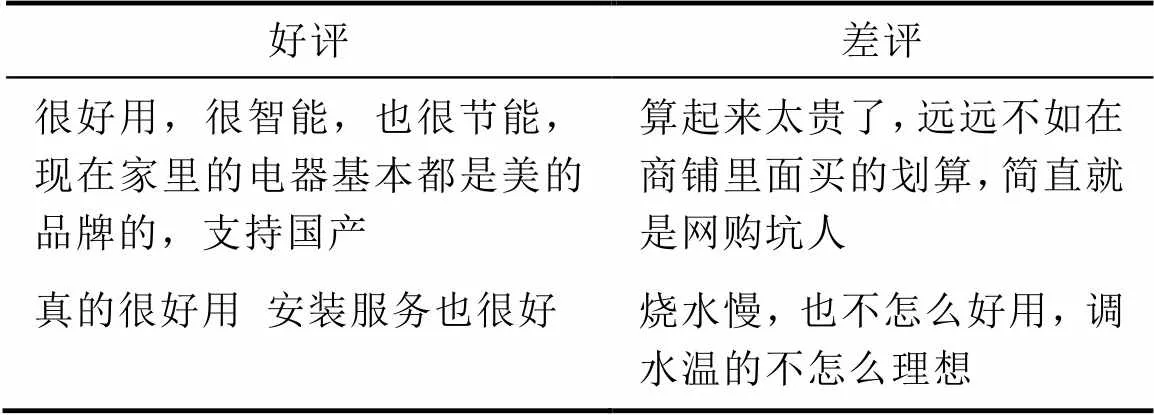

1.4 情感分類

為了進行情感分類,取出LSTM模型最后的一個輸出結果H,輸入softmax層進行結果預測,預測結果為:

將模型定義好后,采用隨機梯度下降法實現模型的訓練,且為防止過擬合,本文也將使用dropout技術,并進行對dropout的設定值進行討論。

2 實驗

2.1 數據集

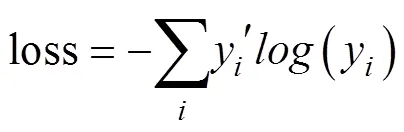

為驗證本文模型的有效性,采取了在京東網站上購買的美的熱水器評論作為數據集,且此數據集是不平衡數據集。數據集分為兩部分:(1)訓練數據集25449評論,包含積極評論21075條和消極評論4374條;(2)測試集5576評論,包含積極評論4509條和消極評論1067條。數據集樣例見表1。

表1 數據集樣例

Tab.1 Sample data set

2.2 數據預處理

本文先采用jieba分詞工具對評論進行分詞,利用停用詞文檔,刪除評論中的無用詞、無效符號和標點符號。取每條評論的前50詞,不足50詞的以空格填充,使用由word2vec訓練的模型構建文本特征向量,且詞向量的維度為60維。構建文本向量時,當有word2vec模型未出現的進行padding。

2.3 實驗參數設置

訓練神經網絡中參數設置非常關鍵,本文中主要參數設置為:深度神經網絡設為由180個神經元和以Leanky-ReLU作為激活函數的隱藏層,而輸出層由60個神經元和Leanky-ReLU激活函數構成。學習率0.01,批次處理的評論數為32。而LSTM隱藏層設為64、128和200,dropout值以1、0.8、0.7、0.6和0.5,分別進行實驗。

2.4 實驗結果

本文的實驗環境的主要參數CPU:Intel(R) Core (TM) i7-7700HQ CPU@2.80 GHz 2.81 GHz,CPU內存(RAM)為8 GB,操作系統為Windows10(基于x64處理器的64位操作系統),實驗平臺為python3.6。

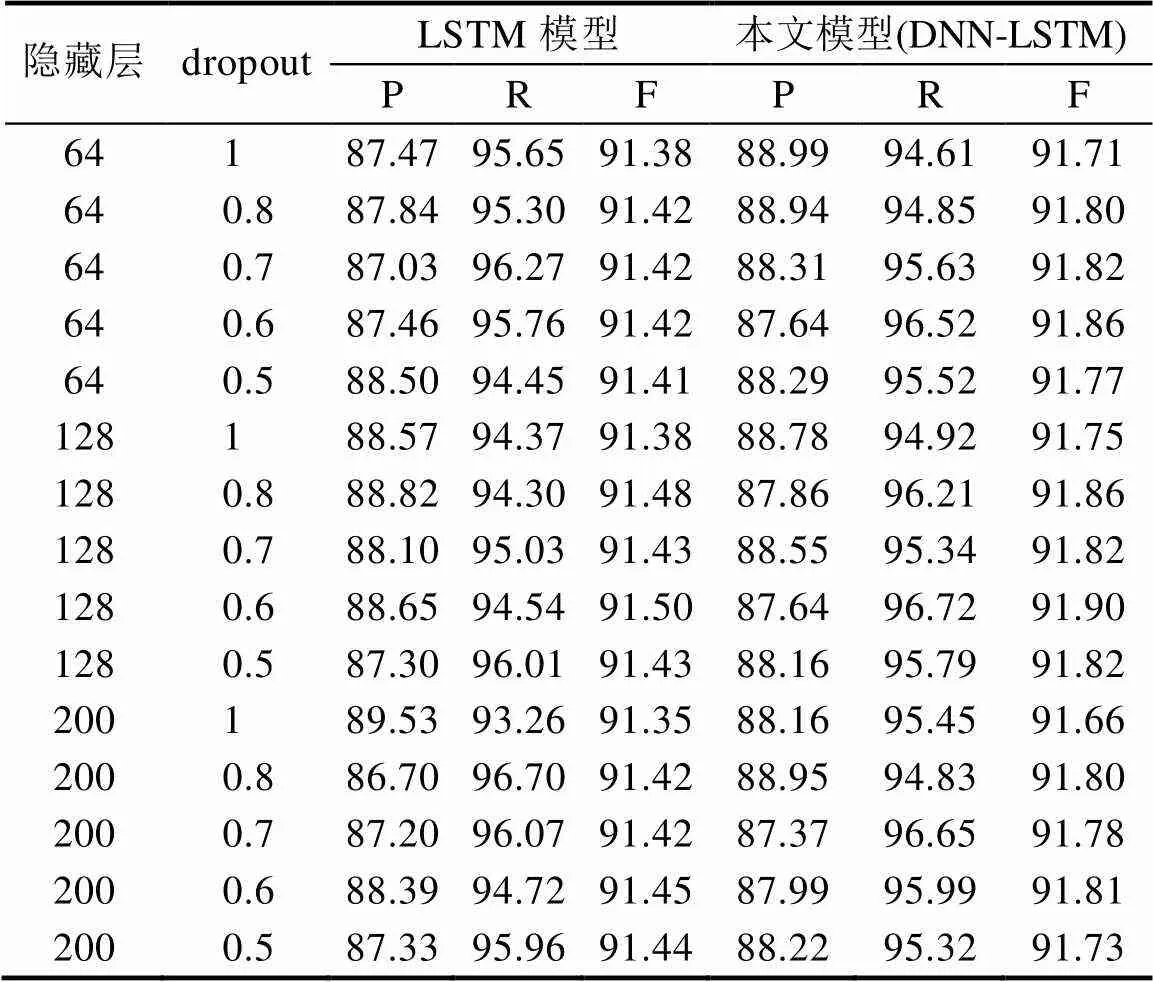

本文試驗評價標準為查全率(P)、召回率(R)和F值。試驗結果見表2。

表2 實驗結果

Tab.2 Experimental result

通過表2可以看出:

1)無論是本文模型還是LSTM模型,在隱藏層為128和dropout值為0.6時取到最大值。并且通過整個實驗可以看出dropout防止過擬合技術,能夠有效提高模型性能,在本次實驗中值dropout為0.6的效果最好。

2)在不平衡數據集中,P值和R值差距較大,且波動大,因此評判值F值得參考價值更大。而在本文實驗中,無論在什么條件下,本文模型相比較于LSTM模型,F值都是本文模型更高,能夠說明深度神經網絡對提取詞向量隱性特征是有效的,更有利于提高情感分類精度。

3 結論

本文提出了一種基于深度神經網絡和LSTM的情感分類模型。實驗表明當將以word2vec模型構成的詞向量直接輸入深度神經網絡后,是有利于提取詞向量的隱性特征的,這樣的向量輸入LSTM模型中提高模型性能。

由于用來實現情感分類的模型較多,在接下來的工作中將深度神經網絡帶入更優的模型中,研究是否同樣可以提高模型性能

[1] 王坤亮. 漢語情感傾向自動分類方法的研究[J]. 軟件, 2013, 34(11): 73-76.

[2] 王非. 基于微博的情感新詞發現研究[J]. 軟件, 2015, 36(11): 06-08.

[3] 陳海紅. 多核SVM文本分類研究[J]. 軟件, 2015, 36(5): 7-10.

[4] Yoshua Bengio, Holger Schwenk, Jean-Sébastien Senécal, et al. A Neural Probabilistic Language Model[J]. Journal of Machine Learning Research, 2003, 3: 1137-1155.

[5] Mikolov Tomas, Yih Wen-tau, Zweig Geoffrey. Linguistic regularities in continuous space word representations[C]. The Annual Conference of the North American Chapter of the Association for Computational Linguistics(NAACL-HLT), 2013: 746-751.

[6] Richard Socher, Brody Huval, Christopher D. Manning, et al. Semantic compositionality through recursive matrix vector spaces[C]. Proceedings of the 2012 Joint Conference on Empirical Methods in Natural Language Processing and Computational Natural Language Learning(EMNLPCoNLL), 2012: 1201-1211.

[7] Richard Socher, Alex Perelygin, Jean Wu, et al. Recursive deep models for semantic compositionality over a sentiment Treebank[C]. Proceedings of 2013 Conference on Empirical Methods in Natural Language Processing(EMN LP), 2013: 1631-1642.

[8] Yoon Kim. Convolutional neural networks for sentence classification[C]. Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing(EMN LP), 2014: 1746-1751.

[9] Nal Kalchbrenner, Edward Grefenstette, Phil Blunsom. A convolutional neural network for modelling sentences[C]. Proceedings of the 52nd Annual Meeting of the Association for Computational Linguistics(ACL), 2014: 655-665.

[10] Siwei Lai, Liheng Xu, Kang Liu, et al. Recurrent convolutional neural networks for text classification[C]. Proceedings of the Twenty-Ninth AAAI Conference on Artificial Intelligence, 2015: 2267-2273.

[11] 劉騰飛, 于雙元, 張洪濤, 等. 基于循環和卷積神經網絡的文本分類研究[J]. 軟件, 2018, 39(01): 64-69

[12] 張玉環, 錢江. 基于兩種 LSTM 結構的文本情感分析[J]. 軟件, 2018, 39(1): 116-120.

[13] 劉騰飛, 于雙元, 張洪濤, 等. 基于循環和卷積神經網絡的文本分類研究[J]. 軟件, 2018, 39(01): 64-69[14] Elman J L. Finding structure in time[J]. Cognitive science, 1990, 14(2): 179-211.

[14] Hochreiter S, Schmidhuber J. Long Short-Term Memory[J]. Neural Computation, 1997, 9(8): 1735-1780.

[15] Gers F A, Schmidhuber J, Cummins F. Learning to forget: Continual prediction with LSTM[J]. Neural computation, 2000, 12(10): 2451-2471.

Text Sentiment Analysis Based on Deep Neural Network and LSTM

WANG Zi-niu1, WU Jian-hua2, GAO Jian-ling2, CHEN Ya-xian2, WANG Xu2

(1. Guizhou University, Computer network center, Guiyang, 550000; 2. Guizhou University, School of Big Data and Information Engineering, Guiyang, 550000)

In natural language processing tasks, the appearance of word vectors greatly improves the performance of the model, so the depth model initialized by the word vector is usually used directly. Since the trained data sets and methods affect the quality of the word vector, in order to reduce this effect, this paper proposes a deep neural network combined with the LSTM model to achieve sentiment analysis. The word vector is first input into the deep neural network to realize the hidden feature of the word vector and then extracted, and then input into the LSTM network for sentiment analysis, thereby improving the accuracy of sentiment analysis. Experiments show that the proposed model has higher performance in text sentiment analysis than the single LSTM model, deep neural network combined with LSTM model.

Emotional analysis; Word vector; Deep neural network; LSTM

TP183

A

10.3969/j.issn.1003-6970.2018.12.005

云環境中半監督聚類算法的并行化研究、貴州省科技廳基金項目、黔科合[2015]2045號

王子牛(1961-),男,副教授,主要研究方向:自然語言處理;高建瓴(1969-),女,副教授,主要研究方向:圖像處理;吳建華(1993-),男,研究生,主要研究方向:自然語言處理;陳婭先(1995-),女,研究生,主要研究方向:自然語言處理;王許(1993-),男,研究生,主要研究方向:自然語言處理。

王子牛,吳建華,高建瓴,等. 基于深度神經網絡和LSTM的文本情感分析[J]. 軟件,2018,39(12):19-22