基于膚色檢測與卷積神經網絡的手勢識別*

楊紅玲,宣士斌,梁竣程,趙 洪,莫愿斌

(廣西民族大學 信息科學與工程學院,廣西 南寧 530006)

基于膚色檢測與卷積神經網絡的手勢識別*

楊紅玲,宣士斌,梁竣程,趙 洪,莫愿斌

(廣西民族大學 信息科學與工程學院,廣西 南寧530006)

針對光照變化、背景噪聲等復雜環境對手勢識別的影響,提出了一種基于YCbCr空間膚色分割去除背景結合卷積神經網絡進行手勢識別方法。首先根據人體膚色在YCbCr顏色空間中的聚類效果,采用基于橢圓模型的膚色檢測方法進行手勢分割;然后對分割后的手勢圖像提取骨架與邊緣相融合的手勢特征圖;再通過深層次的AlexNet卷積神經網絡結構,對經過融合的手勢特征圖進行識別。實驗結果表明,針對復雜的背景環境,該算法具有較強的魯棒性,在不同數據集下對手勢的平均識別率提升了4%,可以達到99.93%。

膚色檢測;手勢分割;特征提取;卷積神經網絡;手勢識別

0 引言

近年來深度學習在計算機視覺應用的高速發展,給新的人機交互方式帶來更多的機遇,為了讓機器人通過“看到”、“聽到”等方式去完成相應的動作,就需要讓機器人明白人的指令。手勢作為傳遞指令的一種重要交互方式之一,基于深度學習的手勢識別技術成為現在非常熱門的研究課題,得到了很多科研工作者的關注。

目前手勢識別一般分為兩步,首先從復雜的背景環境中將手勢分割出來,然后對分割的手勢進行識別,因此在復雜背景下由于背景、環境、光照等外界條件的變化會給手勢分割帶來一定的困難,而分割效果的好壞也會對識別有一定的影響。常見的手勢分割方法大多是基于膚色聚類的特性[1],應用顏色信息獲取手勢部位的所在區域,如基于HSV顏色空間的膚色檢測,但是該方法對于光照變化比較敏感;基于高斯模型的膚色檢測,該方法能在簡單的背景下能取得很好的檢測效果;基于橢圓模型的膚色檢測則能很好地適應光照的變化和復雜背景,因本文算法在手勢分割階段選取該模型進行膚色檢測。而對手勢分割后的識別方法也有很多,如基于神經網絡的識別方法具有較強的識別分類識別能力的分類能力,但是如果采用神經網絡層數一般較淺,很容易出現過擬合的現象[2-3];基于幾何特征的識別方法通過提取手勢結構、邊緣、輪廓等特征進行手勢識別,具有良好的穩定性,但是不能通過提升樣本量的同時進行識別率的提升[4-6];基于隱馬爾科夫模型的識別方法雖然具有描述手勢時空變化的能力,但是該方法的識別速度卻不盡如人意[7]。隨著深度學習在計算機視覺方面的迅速發展,基于深度學習的卷積神經網絡的方法受到越來越多研究者的關注,其獨特的局部感知、權重共享、深度層次化結果、自動特征提取過程給手勢識別[8-9]帶來新的思路,但是該方法對數據集的獲取、網絡結構的選擇卻有著一定的要求,若能獲取較為干凈的手勢圖像,選擇更加深層次的網絡結構,會使得學習的特征更加具有分類能力。

因此針對復雜環境下的靜態手勢圖像,提出了一種基于膚色分割與卷積神經網絡相結合進行手勢識別的方法。該方法首先對比人體膚色在各顏色空間中聚類效果,選取對光照環境變化不太敏感的橢圓模型在YCbCr空間進行膚色檢測實現復雜背景環境下的手勢分割,同時針對分割圖像中可能存在非手勢區域的問題,采用最大類間方法去除圖像中非手勢區域,然后獲取手勢圖像進行骨架與邊緣相融合的特征圖,再通過采用深層次的AlexNet卷積神經網絡結構,對融合的特征圖像進行訓練,獲取手勢分類模型,從而實現復雜背景環境下的手勢識別。實驗證明該方法具有良好的識別效果,在不同數據集下對手勢的平均識別率提升了4%,達到99.93%。

1 基于卷積神經網絡的手勢識別

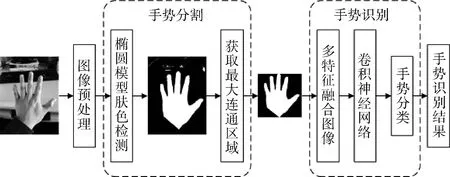

本文算法的輸入為采集得到的原始手勢圖像,將原始圖像通過濾波、去噪等預處理后進行手勢分割。手勢分割是根據人體膚色在顏色空間中具有良好的聚類效果,通過橢圓模型的膚色檢測方法,提取包含手勢區域的二值圖像,然后獲取圖像中最大連通區域作為手勢區域。手勢識別對分割提取的手勢區域進行分類識別。首先通過對分割后的手勢圖像進行骨架與邊緣特征提取,獲取這兩種特征相融合的特征圖,再采用深層次的AlexNet卷積神經網絡結構,對融合的手勢特征圖像進行學習訓練,獲取分類模型對手勢進行識別,判斷手勢所代表的含義。算法的輸出為對各類手勢進行識別的相對概率,具體的算法流程圖如圖1所示。

圖1 手勢識別算法流程圖

由于手勢識別過程輸入的采集圖像中非人手背景的存在會對手勢識別造成一定的影響,因此本文提出了一種基于膚色分割與卷積神經網絡相結合的手勢識別方法,通過膚色分割一定程度上減少背景對手勢識別的干擾;然后獲取分割圖像中的最大連通區域作為手勢圖像;最后通過卷積神經網絡對分割后手勢的骨架與邊緣相融合的特征圖像進行分類,獲取識別結果。

1.1基于膚色模型的手勢分割

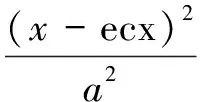

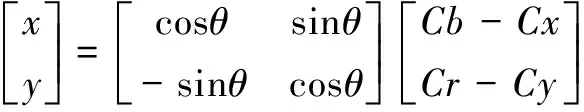

由于膚色能在顏色空間中表現出良好的聚類效果,基于膚色模型的手勢分割方法能把感興趣的手勢部分從復雜的背景中提取出來。由于圖像采集設備獲取的圖像通常為RGB形式,相互之間存在著一定的相關性,亮度稍稍地變化就會對膚色分割產生巨大變化,并不適合進行膚色分割,而經過大量的統計結果發現,在將皮膚信息映射到YCbCr空間時,膚色像素點會在CbCr二維空間中近似形成橢圓分布,因此將YCbCr作為手勢分割的顏色空間,并采用基于橢圓模型的方法進行膚色分割。通過判斷某點在YCbCr空間的坐標(Cb,Cr)是否在橢圓內來區分膚色與背景。橢圓方程具體參數如下所示:

(1)

(2)

其中,Cx=109.38,Cy=152.02,b=14.03,θ=2.53,ecx=1.60,ecy=2.41,a=25.39;橢圓模型的膚色檢測結果如圖2所示。

圖2 基于YCbCr空間的橢圓模型膚色分割效果圖

由于膚色檢測中會受到類似膚色的顏色背景的影響分割出一些非手勢區域,因此本文通過對各個連通區域進行統計,獲取圖像中的最大連通區域,排除膚色檢測結果圖像中的非人手區域,實現對手勢更加精確地分割。

1.2基于卷積神經網絡的手勢識別

隨著深度學習的快速發展,其在圖像識別領域也有了廣泛的應用。基于深度學習的圖像識別與傳統方法相比,有著更加精確的識別精度和速度,因此本文采用基于深度學習的方法來進行手勢識別,構建深度卷積神經網絡結構,通過有監督的學習方法獲取手勢分類模型,進行識別手勢。

1.2.1基于多特征融合的手勢輸入

由于手勢變化的復雜性,雖然分割后的二值圖像能夠很好地排除影響手勢識別的背景信息,但是人們在進行手勢識別時往往更加關注手勢本身所代表的含義而忽略整體手勢的信息。為了提高手勢識別的準確率,提取手勢分割后圖像中的本質信息,引入基于二值手勢圖像(如圖3(a)所示)的骨架特征與邊緣特征相融合后的特征圖像作為卷積神經網絡的輸入圖像。

骨架作為物體的一維表示,能夠保持原物體的幾何、形狀、拓撲信息,是一種優良的形狀描述符,能夠有效地描述物體。因此,骨架廣泛應用于計算機圖形圖像學、計算機幾何學等眾多領域。手勢骨架作為一種對于手勢本質信息表示方法,能夠很好地描述手勢所代表的物理含義,可以將手勢骨架信息作為一類手勢識別的特征描述,手勢骨架提取結果如圖3(b)所示。

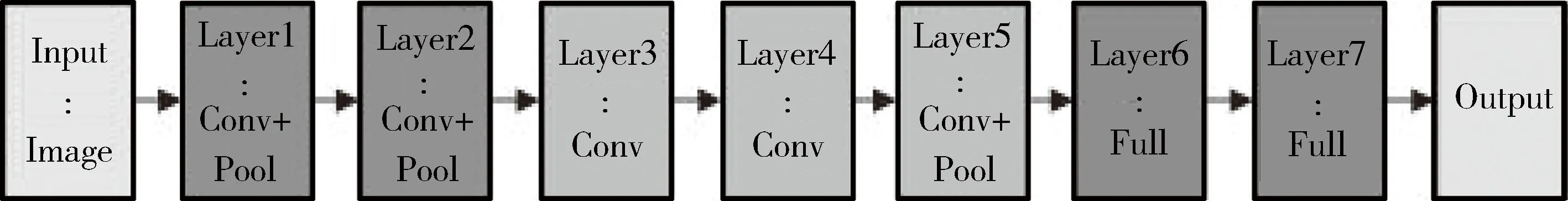

圖4 手勢識別的卷積神經網絡結構

雖然單一的手勢骨架特征能夠很好地解釋手勢所代表的含義,但是所含有的關鍵信息卻有一定的缺陷。因此,進一步利用形態學算子提取手勢二值圖像的邊緣(如圖3(c)所示),獲取具有更好解釋效果的手勢邊緣圖像,然后將其圖手勢骨架圖像相結合作為卷積神經網絡的輸入,獲取更好的識別效果,融合結果如圖3(d)所示。

圖3 多特征融合效果圖

1.2.2基于深度卷積神經網絡的手勢識別

卷積神經網絡(CNN)具有三個最基本的特征:局部連接、權值共享和下采樣,通過局部連接和權值共享減少訓練參數,同時通過下采樣來提升模型魯棒性的同時減少訓練參數,因此根據卷積神經網絡的特征,其一般包含兩個特殊的網絡神經元層:卷積層和下采樣層。本文采用AlexNet的網絡結構,Input Layer為輸入層,具體為64×64的手勢特征融合圖像,Layer1~Layer5是卷積層,Layer6~Layer8為全連接層,Output Layer為輸出層,輸出層神經元有3個,分別代表手勢類別:石頭、剪刀、布。卷積核和各偏置等參數的初始值均隨機產生,輸入樣本后通過前向傳播和反向傳播算法對網絡進行訓練來更新參數。手勢識別的卷積神經網絡結構如圖4所示。

卷積濾波實質就是用卷積核在圖像矩陣中滑動遍歷,卷積核與圖像上相對位置的元素作乘積,將所得結果相加得到一個結果值,最后通過激活函數獲得卷積結果。當卷積核滑動遍歷整張圖像后,結束特征提取,獲取一個新的圖像特征矩陣。再通過下采樣圖像特征矩陣進行降維,減少計算量,同時避免特征過多導致出現過擬合,增強網絡結構對位移的魯棒性。具體的卷積和下采樣計算如下所示:

f(x)=max(0,x)

(3)

(4)

(5)

其中ai,j表示經過卷積后第i行第j列元素;xi,j表示圖像的第i行第j列元素;wm,n表示卷積核中第m行第n列權重;wb表示卷積核的偏置項;f表示激活函數,為RELU函數;b表示p*q樣本區域經過下采樣后的特征值;P為下采樣函數,一般為MaxPoling或MeanPoling,本文中采用MaxPoling。

2 實驗結果和分析

2.1實驗結果

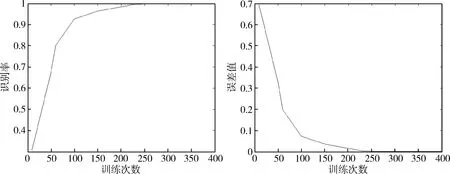

對本文提出的方法在兩個數據庫上進行驗證,第一個數據庫是在室內場景采集的手勢圖像數據庫,用來評判算法的性能,在采集的手勢數據庫中,通過普通的攝像頭拍攝不同環境、不同旋轉角度下的3種類別的手勢圖像各100張用于算法性能的測試;第二個數據庫采用Thomas Moeslund’s Gesture Recognition Database,在該數據庫中對建立的基于手勢分割與卷積神經網絡的手勢識別模型進行驗證。本文從拍攝的各類手勢圖像中選取2 000個訓練樣本和200個測試樣本。通過手勢數據集,分析不同的訓練次數與手勢識別率和誤差的關系,如圖5所示。

從圖5中可以看出訓練次數較少時,手勢的識別率較低,網絡需要訓練較多的次數才可以達到較好的識別效果。這是因為,在訓練次數較低時,由于手勢的復雜性,并不能提取出具有高效分類的網絡參數,使得訓練的誤差仍然很高,當訓練進行到一定程度時,網絡參數就不會發生太大的變化,誤差趨于穩定,網絡的識別率趨于穩定。

圖5 訓練次數與手勢識別率和誤差的關系

2.2實驗對比分析

為驗證本文算法的性能,通過本文獲取的實驗結果的識別率,與國內其他學者的手勢識別效果進行比較,表1顯示了手勢樣本在不同方法下的識別率和時間消耗對比。

表1 本文方法與其他方法識別性能的比較

通過對比可以發現,本文算法獲取的識別率相對較高的原因在于以下兩點:(1)本文中采用橢圓模型進行膚色分割獲取包含手勢區域的二值圖像,然后通過求最大連通區域的方法,獲取干凈的手勢圖像;(2)本文中采用相對文獻[5-6] 更加深層次的卷積神經網絡,同時將手勢圖像的骨架和邊緣的融合特征圖像作為網絡的輸入,能夠描述手勢所代表的物理含義,從而獲得更好的識別效果。當然本文的不足之處在于復雜的網絡結構使得識別時的耗時量會有一定的增加,但是由于其耗時量已經縮短在毫秒級,因此并不會因為耗時量對算法的實現產生更大的影響。

3 結論

本文基于不同的背景環境,提出了一種基于膚色分割與卷積神經網絡結合的方法進行手勢識別。采用膚色分割去除背景對手勢識別的干擾,同時通過獲取分割后最大連通區域的方法排除類似膚色的煩擾,得到更加干凈的手勢二值圖像,最后通過具有較高分類能力的AlexNex卷積神經網絡結構對手勢的骨架和邊緣的特征融合圖像進行學習訓練,獲取分類模型進行手勢識別,從而解決了傳統識別方法中訓練方法復雜度高、訓練參數多、識別率低等問題。下一步將通過改進網絡結構或者改進分割算法進一步降低其在手勢識別中的誤識率,從而實現復雜環境下的動態手勢識別。

[1] LICSAR A, SZIRANYI T. User-adaptive hand gesture recognition system with interactive training[J]. Image amp; Vision Computing, 2005,23(12):1102-1114.

[2] STERGIOPOULOU E, PAPAMARKOS N. Hand gesture recognition using a neural network shape fitting technique[J]. Engineering Applications of Artificial Intelligence, 2009, 22(8):1141-1158.

[3] 江立, 阮秋琦. 基于神經網絡的手勢識別技術研究[J]. 北京交通大學學報, 2006, 30(5):32-36.

[4] Liu Yun, Yin Yanmin, Zhang Shuijun. Hand gesture recognition based on HU moments in interaction of virtual reality[C]. International Conference on Intelligent Human-Machine Systems and Cybernetics. IEEE, 2012:145-148.

[5] 董立峰, 阮軍, 馬秋實,等. 基于不變矩和支持向量機的手勢識別[J]. 微型機與應用, 2012, 31(6):32-35.

[6] 隋云衡, 郭元術. 融合Hu矩與BoF-SURF支持向量機的手勢識別[J]. 計算機應用研究, 2014, 31(3):953-956.

[7] MURTHY G R S, JADON R S. Hand gesture recognition Using Neural Networks[C]. Advance computing Conference, IEEE, 2010:134-138.

[8] 王龍,劉輝,王彬,等. 結合膚色模型和卷積神經網絡的手勢識別方法[J]. 計算機工程與應用,2016,53(6):1-7.

[9] 操小文, 薄華. 基于卷積神經網絡的手勢識別研究[J]. 微型機與應用, 2016, 35(9):55-57.

[10] STERGIOPOULOU E, PAPAMARKOS N. Hand gesture recognition using a neural network shape fitting technique[J]. Engineering Applications of Artificial Intelligence, 2009, 22(8):1141-1158.

[11] 江立, 阮秋琦. 基于神經網絡的手勢識別技術研究[J]. 北京交通大學學報, 2006, 30(5):32-36.

[12] 蔡娟, 蔡堅勇, 廖曉東,等. 基于卷積神經網絡的手勢識別初探[J]. 計算機系統應用, 2015, 24(4):113-117.

2017-05-22)

楊紅玲(1991-),女,碩士研究生,主要研究方向:圖像處理與識別。

宣士斌(1964-),男,教授,主要研究方向:圖像處理,圖像處理與識別。

梁竣程(1982-),男,本科,主要研究方向:計算機網絡。

Hand gesture recognition based on feature fusion and convolutional neural network

Yang Hongling, Xuan Shibin, Liang Juncheng, Mo Yuanbin

(School of Information Science and Engineering, GuangXi University for Nationalities, Nanning 530006, China)

To reduce the influence of the complex environment such as illumination changes and background noise to hand gesture recognition, an YCbCr based space color segmentation model is used to remove background, and AlexNet convolution network is employed to achieve hand gesture classification in this paper. Based on the human skin color clustering in the YCbCr color space, the method of skin detection based on elliptical model is used to extract gesture image. Then it extracts the gesture feature map fusing the skeleton and edge features from the segmented gesture images. Based on results of the features fusion of gestures, the AlexNet convolution network with deep level structure is employed to recognize the gesture image. The experimental results show that the proposed algorithm has strong robustness against the complex background environment, and the average recognition rate is improved by 4%, reaching to 99.93%.

skin detection; gesture segmentation; feature ertraction; convolutional neural network; gesture recognition

TP183

A

10.19358/j.issn.1674- 7720.2017.22.016

楊紅玲,宣士斌,梁竣程,等.基于膚色檢測與卷積神經網絡的手勢識別J.微型機與應用,2017,36(22):58-61.

廣西自然科學基金(2015GXNSFAA13911);國家自然科學基金(21466008)