基于顏色差分直方圖的運(yùn)動(dòng)目標(biāo)提取

康登飛,劉 鋒,曾連蓀

(上海海事大學(xué) 信息工程學(xué)院,上海 201306)

基于顏色差分直方圖的運(yùn)動(dòng)目標(biāo)提取

康登飛,劉 鋒,曾連蓀

(上海海事大學(xué) 信息工程學(xué)院,上海201306)

為了降低動(dòng)態(tài)變化的背景對(duì)運(yùn)動(dòng)目標(biāo)提取的干擾,使用顏色差分直方的方法來降低由于背景不穩(wěn)定、光照強(qiáng)度變化造成的錯(cuò)誤。首先計(jì)算一個(gè)位置點(diǎn)所在的小鄰域內(nèi)像素之間的差值。其次,使用高斯隸屬度函數(shù)的模糊關(guān)系做顏色差分。最后,提出一種新的模糊顏色差分直方圖,即采用模糊C-means聚類和顏色差分結(jié)合的方法。模糊C-means聚類聚類算法在顏色差分直方圖中的使用可以降低計(jì)算的直方圖的維數(shù)較大的復(fù)雜性,也降低了背景因強(qiáng)度變化而產(chǎn)生的移動(dòng)假象或背景照明度的變化而產(chǎn)生的影響。隨機(jī)選擇兩個(gè)視頻幀集合來測(cè)試該方法。仿真結(jié)果表明,該算法在一些復(fù)雜的視頻序列場(chǎng)景中能夠表現(xiàn)出較好的性能和結(jié)果。

背景減除法;顏色差分直方圖;模糊C-均值聚類;目標(biāo)提取

0 引言

將運(yùn)動(dòng)目標(biāo)從視頻序列圖像中抽取出來[1]是圖像處理的重要研究領(lǐng)域。在操作過程中,獲取的圖像背景受天氣、光照、影子及混亂干擾帶來的動(dòng)態(tài)變化的影響,使得目標(biāo)檢測(cè)成為一項(xiàng)相當(dāng)困難的工作。目前幾種常見的方法有:背景減除法[2-3]、幀間差分法[4]、光流法[5]、基于數(shù)學(xué)形態(tài)學(xué)[6]的場(chǎng)景變化檢測(cè)等,每種方法都有自身的優(yōu)點(diǎn)和不足。

背景減除法和幀間差分法均屬于求差法,背景減除法采用的是背景圖像,原理簡(jiǎn)單,檢測(cè)速度較快,但是對(duì)光照條件的變化比較敏感,閾值的選擇不當(dāng)容易將背景判斷成運(yùn)動(dòng)目標(biāo)。幀間差分法就是利用前后兩幀或多幀圖像之間像素的差值去區(qū)分靜態(tài)背景和運(yùn)動(dòng)對(duì)象,對(duì)變化的環(huán)境不僅具有很好的適應(yīng)性,而且具有很高的執(zhí)行效率,不足之處是它對(duì)噪聲比較敏感,所以在檢測(cè)過程中動(dòng)態(tài)對(duì)象檢測(cè)有斷裂的缺點(diǎn)。光流法的優(yōu)點(diǎn)是在預(yù)先不知道場(chǎng)景任何信息的條件下,檢測(cè)出獨(dú)立運(yùn)動(dòng)的目標(biāo),但是算法復(fù)雜、用時(shí)較多。根據(jù)運(yùn)動(dòng)目標(biāo)的特征可以使用數(shù)學(xué)統(tǒng)計(jì)法,它是一種非常有效的方法,雖然能克服背景光照變化帶來的影響,但是建模過程比較繁瑣。

針對(duì)背景光照變化的影響,在提取目標(biāo)圖像時(shí)可能導(dǎo)致陰影[7]被誤認(rèn)為是運(yùn)動(dòng)目標(biāo),給目標(biāo)的提取帶來困難。本文使用背景減除法,選擇在小鄰域內(nèi)做顏色差分的方法來降低影響,使用具有魯棒性的模糊C均值聚類(Fuzzy C-Means clustering,F(xiàn)CM)進(jìn)行分割,能夠較精確地檢測(cè)運(yùn)動(dòng)目標(biāo)并且背景分割較為干凈。通過MATLAB仿真結(jié)果可以看出,背景分離得較為干凈,目標(biāo)提取也較為精確。

1 相關(guān)理論

1.1顏色空間的轉(zhuǎn)換

相較于RGB顏色空間模式,Lab顏色空間[8]模式具有如下優(yōu)勢(shì):基于人眼,顏色空間領(lǐng)域更加寬闊,轉(zhuǎn)化過程沒有顏色損失,處理效果極快,黑白顏色通道相互分離等。

將原圖像像素空間值域范圍采用均勻量化方法量化為W級(jí),即I∈{0,1,…,W-1},Imn表示量化后坐標(biāo)(m,n)像素值。假設(shè)像素鄰域半徑為R,鄰域內(nèi)任意點(diǎn)坐標(biāo)(p,q)的像素值為Ipq。對(duì)像素值做歸一化處理,即x=Imn/256,將x代入如下Γ(x)函數(shù):

(1)

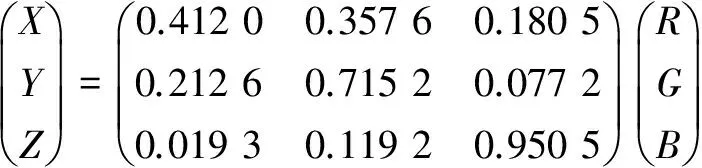

通過伽馬函數(shù)輸出的像素值是圖像三分量組成的和,分離出三個(gè)分量分別用R,G,B表示,并代入下式實(shí)現(xiàn)中間參量X,Y,Z的轉(zhuǎn)換:

(2)

最后,中間參量X,Y,Z與默認(rèn)值Xn=95.047,Yn=100,Zn=108.883相除,結(jié)果用t表示,代入下式:

(3)

(4)

最終完成顏色空間到L,a,b上的轉(zhuǎn)換。

1.2模糊C-均值聚類算法

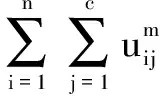

FCM[9]算法的目標(biāo)函數(shù)可以表述為帶約束的極值問題,表達(dá)式為:

(5)

其中m=2表示為隸屬度的平滑參數(shù);

uij∈[0,1] (1≤i≤c,1≤j≤n)

(6)

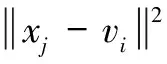

式(6)表示樣本點(diǎn)xj到聚類中心vi的歐式距離。

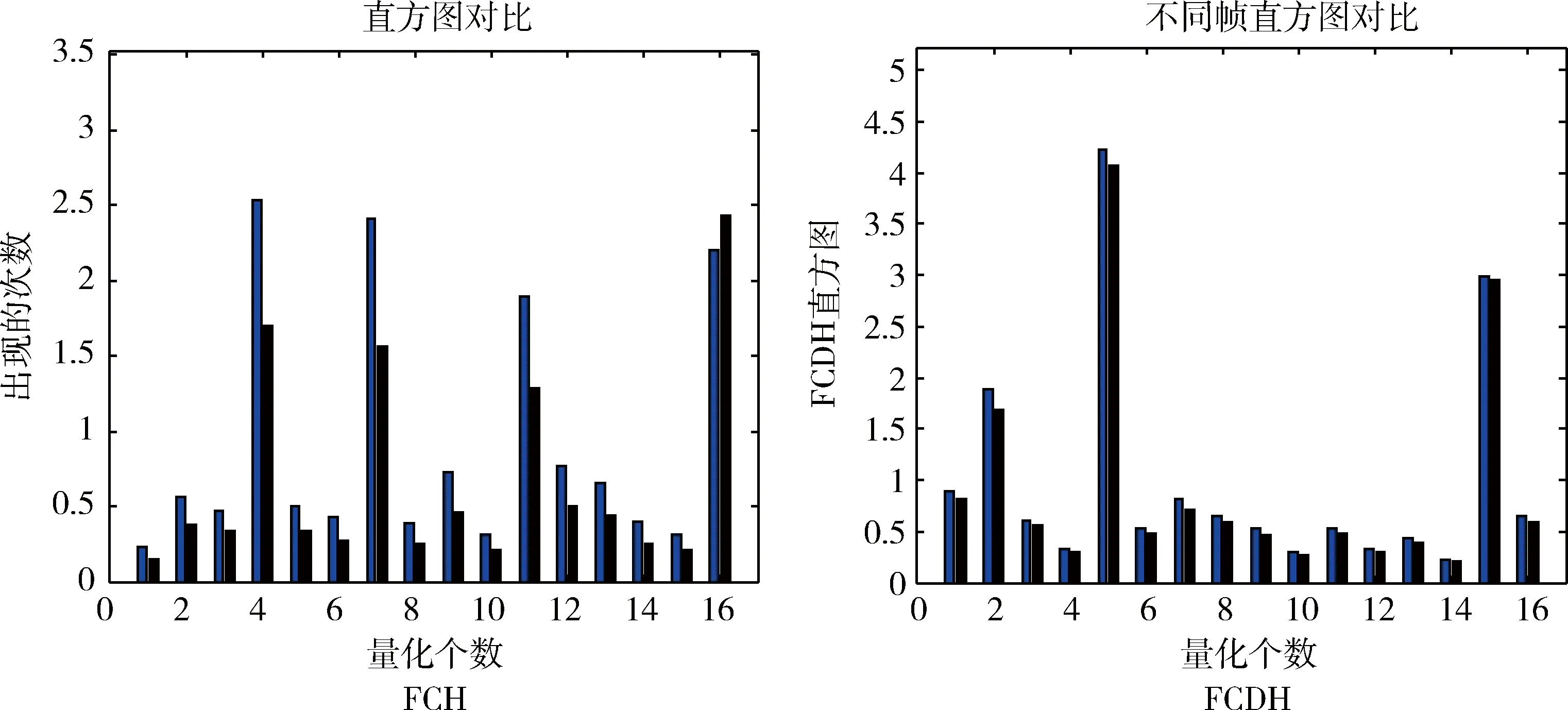

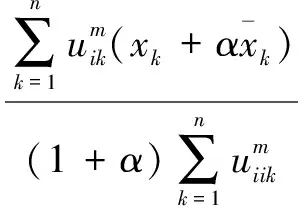

通過拉格朗日算子乘法求解以上帶約束條件的極值問題,求出FCM隸屬度Uk=[uij(k)],其中:

(7)

2 顏色差分直方圖FCDH算法

2.1求出圖像顏色直方圖

在M×M的區(qū)域內(nèi)將圖像直方圖表達(dá)出來,并進(jìn)行操作,Lab彩色空間具有L,a,b顏色分量,可以定義為:

I={Lmn,amn,bmn},

Lmn,amn,bmn∈{0,1,2,…,W-1}。

其對(duì)應(yīng)的三維直方圖可以描述為:

(8)

l1,l2,l3∈{0,1,2,…,W-1}

其中δ(x)為沖激函數(shù),Lmn,amn,bmn分別是Lab空間的L分量、a分量和b分量在相同坐標(biāo)(m,n)處顏色級(jí)組(l1,l2,l3)的總數(shù),W-1表示量化后的空間顏色級(jí)(W=16為量化后的最大顏色級(jí))。

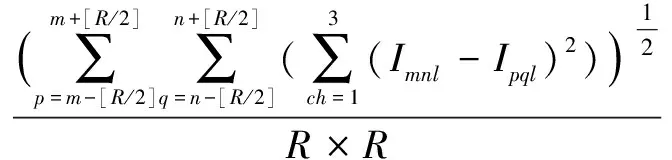

為了降低背景因光照等變化帶來的影響,坐標(biāo)(m,n)處像素Imnl的R×R鄰域內(nèi)均方差計(jì)算為:

像素的均方差值dmn高斯型模糊的隸屬函數(shù)為:

(9)

其中σ是高斯函數(shù)參數(shù)[10]。

顏色加權(quán)直方圖在是在以(m,n)點(diǎn)坐標(biāo)為中心,鄰域大小為M×M的范圍內(nèi),將式(9)高斯隸屬函數(shù)作為權(quán)值乘以式(8)所示的直方圖表達(dá)式,得到一種顏色加權(quán)直方圖矩陣,其描述如下:

(10)

其中,δ(x)為沖激函數(shù),Lmn,amn,bmn分別是Lab空間的L分量、a分量和b分量在相同坐標(biāo)(m,n)處顏色級(jí)組(l1,l2,l3)的總數(shù)。

2.2模糊顏色差分直方圖

將求出的FCM與CDH相乘得出一個(gè)新的算法,即模糊顏色差分直方圖。先將顏色加權(quán)直方圖H(l1,l2,l3)三維的顏色分量變換至一維時(shí)所對(duì)應(yīng)的顏色直方圖矩陣HN×1,將FCM所得像素隸屬度uc×N與HN×1相乘,得到圖像模糊顏色加權(quán)直方圖,即

hc×1=uc×NHN×1

(11)

其中N=W3(W是顏色像素的量化級(jí)別)表示量化后顏色的樣本數(shù)量。

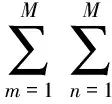

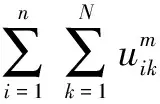

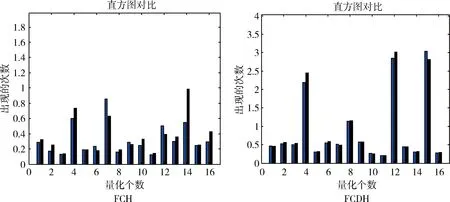

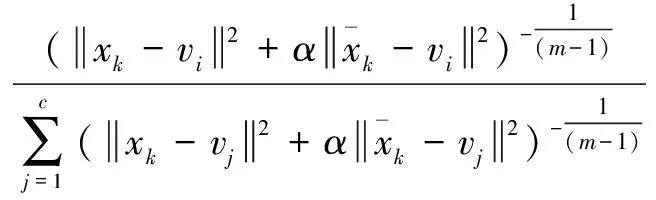

從三個(gè)視頻集中各選擇出兩幅圖片,做出圖像顏色直方圖與顏色差分直方圖,其中直方圖的橫坐標(biāo)表示量化顏色空間的級(jí)數(shù),W=16,縱坐標(biāo)表示為統(tǒng)計(jì)各級(jí)數(shù)上該點(diǎn)所在鄰域內(nèi)圖像的像素值出現(xiàn)的次數(shù)。

如圖1~6所示,圖2,圖4,圖6分別表示從圖1、圖3、圖5三組視頻中任意選擇兩幀圖像,做出對(duì)應(yīng)位置的顏色直方圖與顏色差分直方圖。從直方圖可以看出,F(xiàn)CDH算法中,各像素值出現(xiàn)得較為接近,而FCH算法,像素值在同一位置上出現(xiàn)的次數(shù)差異較大。由此可以初步推斷出在背景光照等元素的影響下,F(xiàn)CDH具有更高的穩(wěn)定性,魯棒性更好,能夠降低因?yàn)楣庹盏仍驇淼恼`差。由此可以將這種方法運(yùn)用到背景減除法對(duì)運(yùn)動(dòng)目標(biāo)提取,相比較背景分割的程度,將會(huì)有更好的效果。

圖1 Curtain 視頻中不同兩幀圖片

圖2 FCH與FCDH直方圖

圖3 WaterSurface 視頻中不同兩幀圖片

圖4 FCH與FCDH直方圖

圖5 Campus 視頻中不同兩幀圖片

3 背景減除法

3.1背景減除法原理

采用背景減除法時(shí),先設(shè)置視頻中的某一幀為初始背景,使用直方圖交叉的方法獲得圖像像素之間的相似性值,用ρ表示,在標(biāo)準(zhǔn)化尺度下,使用FCDH算法,將背景直方圖和當(dāng)前的前景直方圖進(jìn)行交叉計(jì)算,其表達(dá)式如下:

(12)

其中hb和h分別是FCDH模型的背景幀和當(dāng)前幀,c的取值是分類的類數(shù)。

通過如下公式更新背景模糊加權(quán)直方圖hb,公式如下:

(13)

其中α∈[0,1]表示權(quán)值的學(xué)習(xí)率,t是時(shí)間指數(shù),h(t)表示t時(shí)刻圖像幀的FCDH,因此可以概括這個(gè)算法的主要步驟。

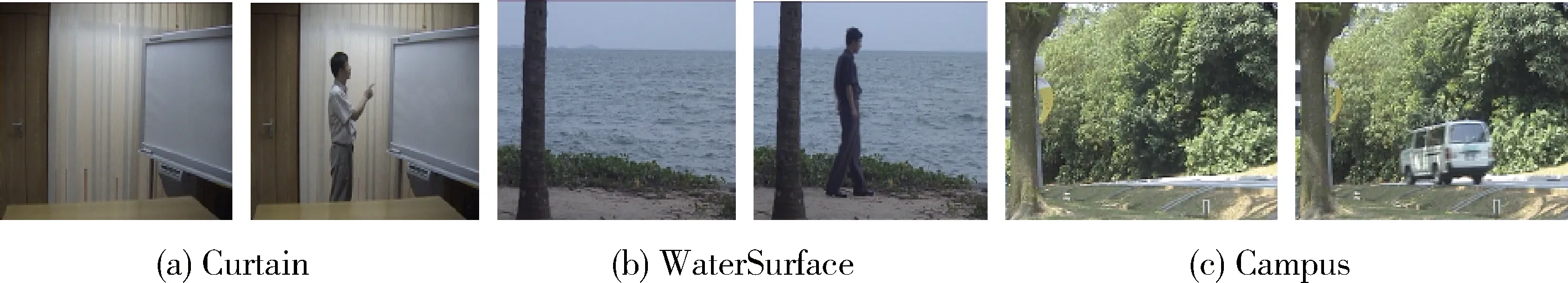

3.2二值提取

為了將代表運(yùn)動(dòng)目標(biāo)的白色區(qū)域和代表背景的黑色區(qū)域分離出來,然后對(duì)相似性函數(shù)ρ進(jìn)行二值化處理,將相似性結(jié)果ρ進(jìn)行FCM聚類,這里采用模糊C均值聚類的方法將像素值區(qū)分出來。在原始FCM上進(jìn)行改進(jìn),提出了一種提高魯棒性的方法FCM直接修正目標(biāo)函數(shù)的魯棒性,定義如下:

minJm(U,V)=

(14)

圖6 FCH與FCDH直方圖

通過拉格朗日算子乘法可以求解以上帶約束條件的極值問題,具體的迭代過程可以由以下步驟表示:

(1)初始化。首先設(shè)置FCM聚類的類別數(shù)c、迭代停止條件ξ以及最大迭代次數(shù),并初始化隸屬度矩陣U(0),令k=0。

(2)計(jì)算聚類中心:

V(k)=[vi(k)]

其中

(3)計(jì)算隸屬度矩陣:

Uk=[uij(k)]

其中

(15)

圖7 視頻中的背景及運(yùn)動(dòng)目標(biāo)原圖

對(duì)輸出每個(gè)像素的隸屬度進(jìn)行判別,從背景中分離出運(yùn)動(dòng)目標(biāo)。

3.3算法步驟

圖8 Curtain 視頻中提取運(yùn)動(dòng)目標(biāo)

圖9 WaterSurface 視頻中提取運(yùn)動(dòng)目標(biāo)

(1)輸入圖片數(shù)據(jù),X=(x1,x2,…,xN);

輸出:最終求得C-means聚類的模糊隸屬矩陣。U=[uij∈[01]],i=1,…,c,j=1,…,N。

當(dāng)t=1時(shí),執(zhí)行下面步驟。

(2)確定顏色差分直方圖。

①將圖像的顏色等級(jí)量化為W級(jí)。

②將圖像從RGB顏色空間轉(zhuǎn)換到CEI Lab顏色空間上。

③通過公式(10)計(jì)算每點(diǎn)鄰域內(nèi)的CDH的h。

(3)計(jì)算FCDH;hc×1=uc×NHN×1。

如果(t==1)設(shè)置此時(shí)的圖像為背景圖像,然后執(zhí)行下一步。

(4)背景直方圖初始化。如果hb=h,則執(zhí)行第(5)步,否則執(zhí)行第(6)步。

(5)背景減除法。

由文中給出的公式(12)用歸一化的直方圖交叉法計(jì)算相似度函數(shù)。

(6)運(yùn)用公式(13)為背景像素做更新背景模型處理。

(7)通過改進(jìn)的FCM對(duì)得到的像素隸屬度進(jìn)行二值化處理。

4 實(shí)驗(yàn)結(jié)果與仿真

選擇兩個(gè)視頻集Curtain和WaterSurface做背景減除法的運(yùn)動(dòng)目標(biāo)提取,驗(yàn)證該算法的可行性。實(shí)現(xiàn)環(huán)境為MATLAB 2013a。算法中的參數(shù)設(shè)置如下:圖片邊界計(jì)算的鄰域范圍R=3;高斯隸屬函數(shù)中,標(biāo)準(zhǔn)差δ∈(1,2);計(jì)算顏色差分直方圖選擇的鄰域范圍M=5;圖片RGB顏色空間有256級(jí),量化為W=16;FCM中參數(shù)的選擇最大迭代次數(shù)為100(c=16,r=2.0,ε=e-5);背景減除法中,背景的更新指數(shù)α∈(0.01,0.02)。

4.1仿真結(jié)果圖

視頻中的背景及運(yùn)動(dòng)圖標(biāo)原圖如圖7所示。根據(jù)經(jīng)驗(yàn)設(shè)置參數(shù),在參數(shù)選取恰當(dāng)?shù)臈l件下,實(shí)驗(yàn)結(jié)果如圖8~圖10所示。

從仿真結(jié)果圖可以看出,GMM算法提取出來的目標(biāo)與背景沒有分離干凈,LBP算法背景分離較干凈,但外觀輪廓上人物特征失真較嚴(yán)重。接著比較FCH和FCDH算法,可以看出這兩種算法提取出來的人物目標(biāo)中,F(xiàn)CDH算法在分離背景和人物不失真程度上都優(yōu)于FCH算法,但是FCDH算法的背景提取得不干凈。最后比較本文改進(jìn)算法,本文算法提取的目標(biāo)較為清楚,目標(biāo)較符合原目標(biāo),不失真,效果較好,背景分割比較干凈,說明在閾值上使用具有魯棒性的FCM進(jìn)行分割是有效的。

圖10 Campus 視頻中提取運(yùn)動(dòng)目標(biāo)

4.2仿真結(jié)果時(shí)間分析

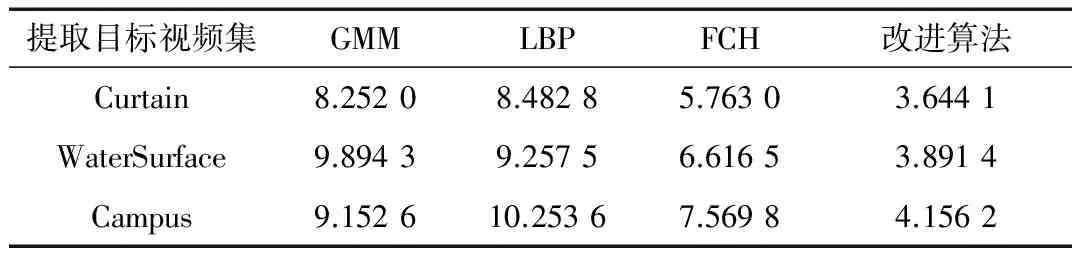

從表1中4種算法的時(shí)間消耗對(duì)比可以看出,F(xiàn)CH算法和FCDH算法在時(shí)間消耗上比GMM算法和LBP算法更具有優(yōu)勢(shì)。比較FCH和FCDH算法時(shí)可以發(fā)現(xiàn),F(xiàn)CDH算法與FCH算法所用時(shí)間相差不大,本文算法使用的時(shí)間相較于前三種算法最短,說明本文算法在時(shí)間上的改進(jìn)是有效的。

表1 運(yùn)動(dòng)目標(biāo)提取時(shí)間消耗對(duì)比/秒

5 結(jié)論

CDH在背景減除法中使用,降低了背景不穩(wěn)定性以及背景像素與前景像素特征相似帶來的錯(cuò)誤,雖然在背景初始化過程受初始背景的影響,但從仿真結(jié)果可以看出,利用顏色差分直方圖的方法,本文算法對(duì)運(yùn)動(dòng)目標(biāo)提取有很大的改進(jìn),能夠較為清楚地將運(yùn)動(dòng)目標(biāo)從復(fù)雜背景中提取出來,效果也非常明顯。通過對(duì)閾值的改進(jìn),提取出的目標(biāo)更為理想。目前運(yùn)動(dòng)目標(biāo)提取技術(shù)可以應(yīng)用到很多領(lǐng)域中,比如工業(yè)自動(dòng)化、交通檢測(cè)等。

[1] 王長(zhǎng)軍.基于視頻的目標(biāo)檢測(cè)與跟蹤技術(shù)研究[D].杭州:浙江大學(xué), 2006.

[2] LIPTON A J,FUJIYOSHI H,RATIL R S.Movingtarget classification and tracking from real time video[C].IEEE Workshop on Applications of Computer Vision. Princeton,1998: 8-14.

[3] CHAN A B,MAHADEVAN V,VASCONCELOS N.Generalized stauffer-grimson background subtraction for dynamic scenes[J].Machine Vision and Applica-tions, 2011,22(5):751-766.

[4] Chen Baisheng,Lei Yunqi,Li Wangwei.A novel background model for real time vehicle detection[J].Signal Processing, 2004, 2(7): 1276- 1279.

[5] 戴斌,方宇強(qiáng),孫振平,等.基于光流技術(shù)的運(yùn)動(dòng)目標(biāo)檢測(cè)和跟蹤方法研究[J].科技導(dǎo)報(bào),2009,27(12):55-60.

[6] 王延年,張鵬.基于數(shù)學(xué)形態(tài)學(xué)的運(yùn)動(dòng)目標(biāo)檢測(cè)算法[J].電子測(cè)量技術(shù),2010,33(7):69-72.

[7] 閆愛云,李海朋,李晶皎.視頻運(yùn)動(dòng)目標(biāo)提取的實(shí)現(xiàn)[J].東北大學(xué)校報(bào),2011,32(11):1558-1561.

[8] 許莉,王敏,溫月.基于Lab顏色空間的運(yùn)動(dòng)目標(biāo)檢測(cè)[J].華中科技大學(xué)學(xué)報(bào),2013,41(S1):219-222.

[9] 蘭蓉,馬姣婷.基于直覺模糊C-均值聚類算法的圖像分割[J].西安郵電大學(xué)學(xué)報(bào),2016,21(4):53-56.

[10] CHANG C J,HU W F,HSIEH J W,et al.Shadow eliminatin for effective moving object detection with Gaussian modls[C].Proceedings of 16th International Conference on Pattern Recognition,New York:IEEE,2002:540-543.

2017-04-28)

康登飛(1991-),男,碩士研究生,主要研究方向:圖像運(yùn)動(dòng)目標(biāo)提取。

劉鋒(1976-),男,博士,講師,主要研究方向:圖像通信處理。

曾連蓀(1962-),男,博士,教授,主要研究方向:計(jì)算機(jī)視覺系統(tǒng)。

Moving object extraction based on color difference histogram

Kang Dengfei, Liu Feng, Zeng Liansun

(Department of Information Engineering, Shanghai Maritime University, Shanghai 201306, China)

In order to reduce the background of dynamic changes on the moving target extraction, this paper uses color difference histogram (CDH) method to reduce the error, which is caused by the instability background, and changes in light intensity. Firstly, it calculates the difference between apixel and its neighbors in a small neighborhood of a location point. Secondly, the color difference is done fuizzified with a Gaussian membership function. Finally, a new method named fuzzy color difference histogram is proposed, which is based on the combination of fuzzy C-means clustering and color difference. The use of FCM clustering algorithm can reduce the complexity of the computation of the dimension of the histogram, and also reduce the impact of changes in the intensity of the background caused by changes in the intensity of the moving artifacts or changes in the background lighting. Two video frame sets are selected randomly to test the method. Simulation results show that this algorithm can show better performance and results in some complex video sequences.

subtraction method; color difference histogram; fuzzy C- means clustering; target extraction

TN911.4

A

10.19358/j.issn.1674- 7720.2017.22.015

康登飛,劉鋒,曾連蓀.基于顏色差分直方圖的運(yùn)動(dòng)目標(biāo)提取J.微型機(jī)與應(yīng)用,2017,36(22):53-57.