基于點云密度的結構化道路邊界增強檢測方法*

蘇致遠,徐友春,彭永勝,王任棟

(1.軍事交通學院研究生管理大隊,天津 300161; 2.軍事交通學院軍用車輛系,天津 300161)

?

基于點云密度的結構化道路邊界增強檢測方法*

蘇致遠1,徐友春2,彭永勝2,王任棟1

(1.軍事交通學院研究生管理大隊,天津 300161; 2.軍事交通學院軍用車輛系,天津 300161)

為快速魯棒地檢測結構化道路邊界,提出一種基于HDL-64E激光雷達點云密度的道路邊界增強檢測方法。通過建立虛擬雷達模型,利用點云密度特征,實現(xiàn)前景與背景分離,并利用隨機采樣一致性算法得到20m內(nèi)的道路邊界。為解決20~100m內(nèi)道路邊界點云稀疏、檢測準確性下降的問題,提出利用光線切割模型對道路邊界進行增強檢測。在校園道路和城市快速路進行實驗,道路邊界檢測率達到95%以上,有效檢測距離可達70m以上,檢測周期小于32ms。

道路邊界檢測;虛擬掃描模型;點云密度;光線切割模型

前言

在智能車的環(huán)境感知中,道路邊界檢測用于確定行駛區(qū)域,縮小注意力分布范圍,為智能車的路徑規(guī)劃、定位和導航提供約束條件和信息。在復雜的城市道路和高速公路環(huán)境中,確定道路邊界顯得尤為重要。

當前,結構化道路邊界檢測主要有兩種方法:一種是基于道路幾何特征的方法,另一種是基于圖像分割的方法[1]。基于圖像分割的方法可獲取豐富的環(huán)境信息,并利用顏色、紋理等特征進行區(qū)域的生長和分割,但該方法對環(huán)境敏感,受光照等因素影響大。基于道路幾何特征的方法能夠克服外界環(huán)境的大部分干擾,檢測精度高,是高級別智能駕駛應用中的主要檢測方法。因此,本文中利用三維激光雷達的點云數(shù)據(jù),依據(jù)道路幾何特征檢測道路邊界。

文獻[1]中根據(jù)多幀連續(xù)二維雷達數(shù)據(jù)建立數(shù)字高程圖(digital elevation map),根據(jù)車輛運行方向提取道路邊界候選點,然后利用霍夫變換(Hough transform)和多模型隨機采樣一致性(RANSAC)算法求解道路邊界。文獻[2]中在三維點云中分別提取每條掃描線的特征點,通過霍夫變換和距離約束選擇道路邊界候選點,最后通過迭代的高斯過程回歸將候選點作為種子點表示道路邊界,檢測距離達50m。文獻[3]中通過將雷達掃描線分段,構建馬爾科夫隨機場,通過圖割算法求最優(yōu)解來分割路面。文獻[4]中使用局部凹凸性分割不同物體。文獻[5]中采用Mesh方式構造圖,通過計算梯度分離地面。以上方法中,基于圖的方法計算量大,實時性差,而基于柵格的方法,檢測效果受柵格尺度影響大,對閾值選取的要求較高。此外,很多方法要用到雷達或車輛坐標系下的高度或高度差信息,并以此作為區(qū)分道路和道路邊界的條件,但在車輛行進過程中,尤其是車輛發(fā)生較大俯仰、側傾時,魯棒性降低。

為解決以上問題,本文中基于HDL-64E三維激光雷達數(shù)據(jù),提出一種新的道路邊界增強檢測方法。首先建立了虛擬雷達模型,根據(jù)虛擬掃描線上點云的分布特征實現(xiàn)前景與背景分離,該過程去除了路面,同時保留了障礙物和部分道路邊界,然后建立光線切割模型,結合前景近景分離結果對道路邊界進行遠距離擴展。本文中方法具有以下特點:一是基本不受路面傾斜和起伏影響;二是對較低的道路邊界或較高的護欄同時有效;三是在部分遮擋的動態(tài)環(huán)境下,依然可以得到穩(wěn)定的檢測結果。

1 數(shù)據(jù)預處理

本文中研究采用HDL-64E三維激光雷達,其垂向掃描范圍(VFOV)為-24.8°~2°,其間按照一定的規(guī)律分布著64個激光發(fā)射器,雷達通過旋轉掃描得到360°范圍內(nèi)的環(huán)境信息。在600r/min的轉速下,每幀采集約13萬個點。針對大量點云的分割通常采用非模型投影方法,按投影方向可分為基于地面投影和基于虛擬像平面投影兩大類[6]。

1.1 點云投影

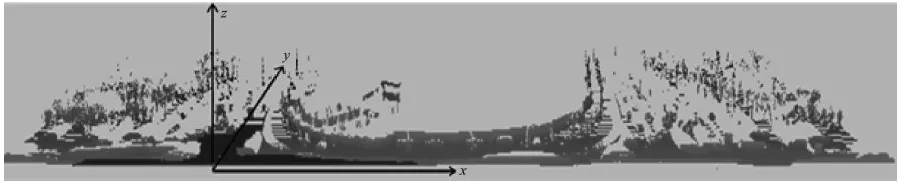

本文中提出了一種基于地面的全景投影方法(見圖1),與全景深度圖(panoramic range image)[4]相比,該方法基于地面投影,投影結果為三維點云而不是深度圖像。由于所用雷達在不同距離有相同的掃描點數(shù),所以可將其按照雷達旋轉方向依次展開成一個三維場景,x軸為旋轉角度(-π/2~3π/2),y軸為掃描點到雷達旋轉軸的距離(0~120m),z軸為掃描點的高度。在路面區(qū)域,同一條掃描線的點近似在一條水平直線上,在同一個掃描角度上障礙物導致點云密度差異。

圖1 全景投影圖

1.2 點云校正

HDL-64E三維激光雷達通過旋轉獲取環(huán)境數(shù)據(jù),數(shù)據(jù)本身具有一定的組織結構。但由于激光雷達的安裝、標定等原因,同一掃描角度上的點在地面的投影并不嚴格地落在一條通過旋轉中心的直線上。本文中基于極坐標柵格下的虛擬掃描(virtual scan)模型[7],或叫虛擬雷達模型,建立基于原始點云的虛擬雷達模型,雷達每個角度的虛擬掃描線在x-y平面的投影都是一條延伸線通過雷達旋轉中心,由掃描距離最近的點指向掃描距離最遠點的線段,每個線段都包含64個子節(jié)點(子節(jié)點可能為空)。如圖1所示,每條虛擬掃描線在x-y平面的投影都是與y軸平行的線段。

由以上模型,每幀的掃描數(shù)據(jù)可表示成三維矩陣Iv,滿足:

(1)

其中P(b,j)=[xyzi]

(2)

式中:Iv的每一列表示某個旋轉角度的64組數(shù)據(jù),對應64個激光發(fā)射角度,每一行表示旋轉360°單個激光采集到的所有數(shù)據(jù);n為每幀的采樣次數(shù);b為光線編號,根據(jù)俯視角度由負到正從0至63取值;j為從起始位置開始的采集次數(shù);P(b,j)為點的屬性,包含點的坐標及強度信息;i為點的強度。

1.3 點云分割

根據(jù)HDL-64E的檢測特性,即在平坦區(qū)域點云密度低,有障礙物處點云密度高,可將障礙物從環(huán)境中分離出來。通常的做法是劃分柵格,并統(tǒng)計各個柵格的點云密度,由于密度的閾值難以確定,本文中將虛擬雷達模型中同一虛擬掃描線上相鄰掃描點的距離差作為判斷點云密度的依據(jù)。在理想水平面上,雷達每個掃描點至雷達旋轉軸的距離是確定的,若遇到凸障礙,激光無法穿過障礙物,導致掃描點到雷達旋轉軸的距離小于其理論距離;若遇到凹障礙,實際掃描距離將大于理論距離。

根據(jù)激光的發(fā)射角度,第j線激光的掃描距離yj小于第j+1線的掃描距離yj+1(此處僅考慮射向地面的光束,所以取0≤j<54),如遇障礙物且有兩條掃描線同時掃描到該障礙物,則有

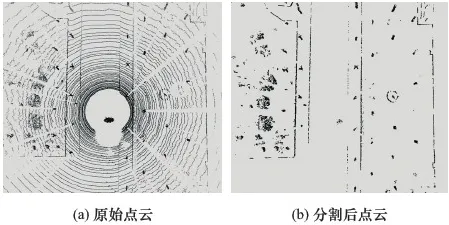

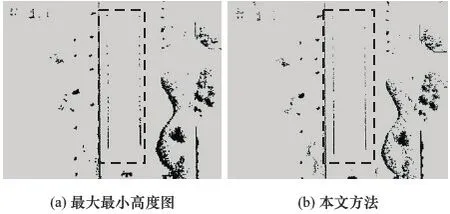

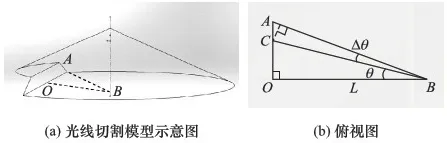

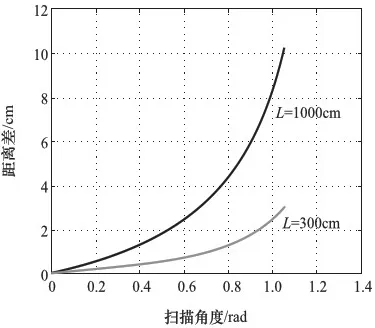

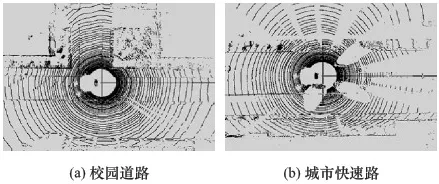

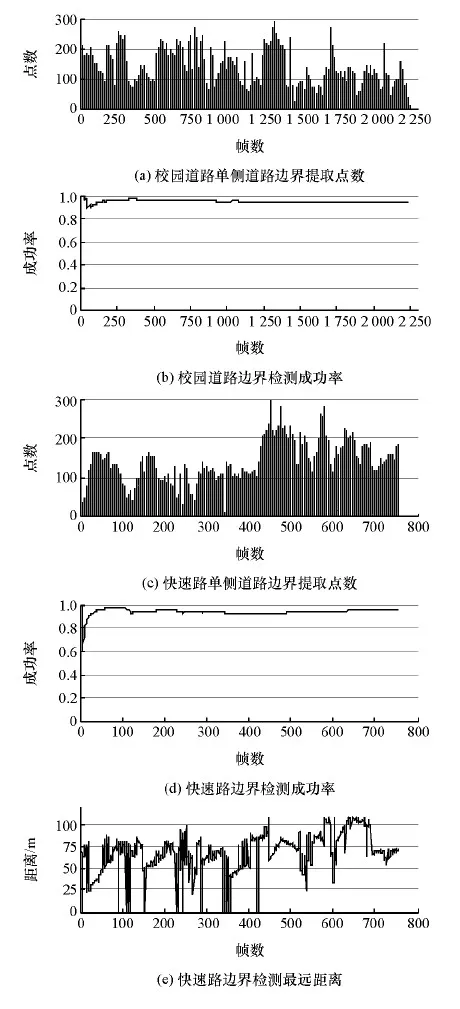

yj+1-yj (3) 設掃描線在平面上的理論掃描距離為Yj(0≤j<54),掃描距離超過一定范圍及掃描角度為正(即水平面以上)的線束不包含在內(nèi),則相鄰兩線的理論掃描間隔為 Dj=Yj+1-Yj (4) 將dj取值為Dj的某一比例,即令 dj=ηjDj=ηj(Yj+1-Yj) (5) 由以上推導編寫算法,對原始點云進行分割,結果如圖2所示。圖中表示路面和平坦地面的點都被分離出來,僅保留了地面上的障礙物和部分道路邊界。 圖2 原始點云和分割后點云對比 為比較點云分割效果,將最大最小高度圖[8](maximum and minimum height map)與本文方法作比較,結果如圖3所示,圖3(a)為最大最小高度圖保留下來的原始點(柵格大小為20cm×20cm,高度差為10cm),圖3(b)為本文方法保留的原始點(ηi=1/3)。對比發(fā)現(xiàn):(1)最大最小高度圖中保留下來的特征無關點數(shù)量比本文方法多,這與柵格本身特點有關,柵格過大導致與特征無關的點增多,柵格過小某些特征點可能會消失;(2)道路邊界(矩形框內(nèi))的連續(xù)性不如本文方法,最大最小高度圖的分割結果取決于柵格大小,相鄰柵格的屬性不能同時滿足閾值要求,造成特征丟失,而本文方法能很好解決這種問題。 圖3 兩種分割方法對比 根據(jù)道路形態(tài),通常建立中間為平面或曲線、兩側有一定高度突變的道路模型[9-10],這種模型能表現(xiàn)道路邊界的突變特征,但不能很好地表現(xiàn)道路形態(tài)。本文方法無須研究路面的具體形狀,只須假設道路邊界存在。 2.1 光線切割模型 HDL-64E激光雷達隨掃描距離增加點云密度降低,導致路面濾除時遠距離的道路邊界特征不明顯。為增加道路邊界檢測距離,本文中提出一種光線切割模型。 假設三維激光雷達安裝在豎直平面內(nèi),各條掃描線的掃描覆蓋范圍就構成頂角不同的圓錐體,如果有垂直平面切割圓錐,理論上就會形成雙曲線的一支。由于道路邊界高度相對于雷達安裝高度很小,所以通常還需要一次水平切割,見圖4。圖4(a)中雷達旋轉軸與垂直切割平面的距離為BO,雷達此時的旋轉角度為θ,角度分辨率為Δθ。 圖4 光線切割模型 首先研究角度對道路邊界檢測的影響,如圖4(b)(圖4(b)為圖4(a)的俯視圖)所示,設旋轉中心B與道路邊界CO距離為L,前后掃描獲得的點分別為C點和A點,掃描距離為LBC和LBA。由幾何關系可知: LBC=LBO/cosθ (6) LBA=LBO/cos(θ+Δθ) (7) LBA-LBC=LBO/cos(θ+Δθ)-LBO/cosθ (8) 當雷達轉速為600r/min時,Δθ≈0.17°,若已知雷達旋轉中心到道路邊界的距離LBO=L,則道路邊界上前后兩次掃描點的距離差僅與掃描角度相關。圖5為當L=300cm和L=1000cm時,相鄰兩個掃描點的距離差與掃描角度的關系。 圖5 相鄰掃描點距離差與掃描角度的關系 由圖5可見:掃描角度一定時,若雷達旋轉軸到道路邊界的距離增加,相鄰兩個掃描點的距離差增加;旋轉軸到道路邊界的距離一定時,隨掃描角度的增加,相鄰掃描點的距離差近似呈指數(shù)增加。依照此規(guī)律即可根據(jù)掃描角度計算該角度上相鄰兩點間的理論距離差,再以理論值為依據(jù)從原始數(shù)據(jù)篩選出符合條件的點,即為道路邊界候選點。 2.2 道路邊界檢測與增強 地面濾除后,車輛兩側的道路邊界信息被很好地保留下來。為得到雷達旋轉中心距道路邊界的距離,本文中使用一種條件采樣的方法,將車輛兩側滿足道路邊界約束的點確定為道路邊界候選點,對其濾波后擬合直線,根據(jù)擬合結果計算雷達旋轉軸到道路邊界的距離,以此為依據(jù)搜索地面濾除過程丟失的道路邊界,同時根據(jù)搜索結果驗證采樣的正確性,并對下一幀的檢測提供參考。 在篩選道路邊界候選點時不可避免會摻雜一些錯誤點,本文中采用RANSAC算法擬合道路邊界,可有效減小錯誤點的干擾,擬合出正確的道路邊界。 算法的流程圖如圖6所示。 圖6 算法流程圖 為檢驗本文算法,分別在校園道路和城市快速路進行實驗。實驗平臺配置為intel酷睿i5雙核2.5GHz處理器,4G內(nèi)存。圖7為兩種典型的測試場景,圖7(a)為校園道路,車輛正處于丁字路口,圖7(b)為城市快速路,空白處是因為車輛遮擋沒有數(shù)據(jù)。校園道路寬度窄,道路邊界清晰,但道路節(jié)點多,拓撲結構復雜,同時車流較少,交通環(huán)境簡單;城市快速路寬闊,道路節(jié)點少,拓撲結構簡單,但車流量大,交通環(huán)境復雜,道路邊界遮擋嚴重。 圖7 校園和城市快速路實驗場景 本文中使用檢測成功率、單側道路邊界提取點數(shù)、道路邊界候選點正確率和運行時間等指標來評價算法。檢測成功率指本算法求解出道路邊界的幀數(shù)與測試幀數(shù)的比值。單側道路邊界提取點數(shù)是從原始數(shù)據(jù)篩選出的單側道路邊界候選點數(shù)量。候選點正確率為候選點中真實道路邊界點數(shù)量與候選點總數(shù)的比值,由于采用RANSAC算法擬合道路邊界,故對迭代1次與10次的結果進行比較說明候選點的正確率,結果見表1。 表1 實驗結果 由表1可見:在城市快速路的檢測成功率稍高,原因是快速路雖然車輛較多,但道路節(jié)點少,拓撲結構簡單;校園道路節(jié)點多,道路零散,拓撲結構復雜,導致單側平均點數(shù)較少。RANSAC算法通過隨機選擇原始數(shù)據(jù)擬合目標方程,可反映原始數(shù)據(jù)的質(zhì)量,在誤差范圍內(nèi)迭代1次得到的擬合方程包含了95%的候選點,且將迭代次數(shù)增至10次后結果僅有2%以內(nèi)的提升,表明原始數(shù)據(jù)的質(zhì)量,即道路邊界候選點的正確率很高,平均正確率在95%以上。 圖8為兩種場景下的實驗結果,分別顯示在校園和城市快速路環(huán)境下的邊界采樣點數(shù)和檢測成功率,以及在城市快速路上的最遠檢測距離。 圖8 實驗結果 由圖8可見:校園道路邊界的候選點數(shù)量變化較大,主要受校園道路零散的因素影響;檢測成功率在實驗次數(shù)較少時由于比例計算會呈現(xiàn)急速下滑的趨勢,隨實驗次數(shù)增加趨于穩(wěn)定,表明算法效果穩(wěn)定。 在城市快速路環(huán)境下,本文方法提取道路邊界候選點的最遠距離達到了100m以上。根據(jù)HDL-64E雷達的技術指標,距離越遠掃描點越稀疏,超過60m后兩條掃描線間的理論間隔達到10m以上,但算法提取的點仍可有效地判斷道路趨勢。在采樣點數(shù)為0或者最遠距離為0的場景下,算法沒有找到道路邊界,可能的原因是多車遮擋等原因?qū)е碌缆愤吔缦А?/p> 在實時性上,基于高度圖的霍夫變換算法平均運行時間[2]約為27.8ms,本文算法的平均運行時間約為24ms,可以滿足智能車實時性要求。 本文中提出一種道路邊界增強檢測算法,首先建立虛擬雷達模型對雷達數(shù)據(jù)進行預處理,基于點云密度分離前景和背景,然后通過兩次篩選得到道路邊界候選點,最后通過隨機采樣一致性算法對道路邊界進行擬合。實驗結果表明:該算法道路邊界檢測率達到95%以上,運行時間滿足智能車實時性要求,檢測距離優(yōu)于其他算法。此外,本文方法不依賴于路面形態(tài),對低矮的道路邊界和較高的護欄都有效,在部分遮擋的情況下依然可以得到穩(wěn)定的結果。 [1] LIU Z, WANG J L, LIU D X. A new curb detection method for unmanned ground vehicles using 2D sequential laser data[J]. Sensors,2013,13(1):1102-1120. [2] CHEN T T, DAI B, LIU D X, et, al. Velodyne-based curb detection up to 50 meters[C]. Intelligent Vehicles Symposium(IV). Seoul, Korea: IEEE,2015:241-248. [3] 朱株,劉濟林.基于馬爾科夫隨機場的三維激光雷達路面實時分割[J].浙江大學學報(工學版),2015,49(3):464-469. [4] MOOSMANN F, PINK O, STILLER C. Segmentation of 3D lidar data in non-flat urban environment using a local convexity criterion[C]. Intelligent Vehicles Symposium(IV). Xi’an: IEEE,2009:215-220. [5] DOUILLARD B, UNDERWOOD J, KUNTZ N, et, al. On the segmentation of 3D LIDAR point clouds[C]. International Conference on Robotics and Automation(ICRA). Shanghai: IEEE,2011:2798-2805. [6] 王肖,王建強,李克強,等.智能車輛3-D點云快速分割方法[J].清華大學學報(自然科學版),2014,54(11):1440-1446. [7] PETROVSKAYA A, THRUN S. Model based vehicle detection and tracking for autonomous urban driving[J]. Autonomous Robots,2009,26:123-139. [8] 辛煜,梁華為,梅濤,等.基于激光傳感器的無人駕駛汽車動態(tài)障礙物檢測及表示方法[J].機器人,2014,36(6):654-661. [9] 俞先國,劉大學,戴斌.基于非閉合Snakes和單線激光雷達的路邊檢測與濾波[J].機器人,2013,35(4):425-431. [10] HAN J, KIM D, LEE M, et, al. Road boundary detection and tracking for structured and unstructured roads using a 2D lidar sensor[J]. International Journal of Automotive Technology,2014,15(4):611-623. Enhanced Detection Method for Structured RoadEdge Based on Point Clouds Density Su Zhiyuan1, Xu Youchun2, Peng Yongsheng2& Wang Rendong1 1.PostgraduateTrainingBrigade,MilitaryTransportationUniversity,Tianjin300161;2.DepartmentofMilitaryVehicle,MilitaryTransportationUniversity,Tianjin300161 For the fast and robust detection of structured road edge, an enhanced road edge detection method is proposed based on the density of point clouds from HDL-64E lidar. By setting up virtual scan model and utiliazing the density features of point clouds, foreground is separated from background, and 20 meters of road edge is obtained by using random sample consensus algorithm. To solve the problem of poor detection accuracy of road edge within a distance of 20 and 100 meters due to sparse point clouds, a sheme is proposed to use ray cut model to conduct an enhanced detection on road edge. The results of experiments on both campus road and city express show that the effective detection rate of road edge reaches over 95% with a detectable distance longer than 70m within a duration less than 32ms. road edge detection; virtual scan model; point clouds density; ray cut model 10.19562/j.chinasae.qcgc.2017.07.017 *國家自然科學基金(91220301)和國家重點基礎研發(fā)計劃項目(2016YFB0100903)資助。 蘇致遠,博士研究生,E-mail:13672089813@163.com。 原稿收到日期為2016年6月3日,修改稿收到日期為2016年9月2日。

2 道路邊界檢測與增強

3 實驗結果

4 結論