基于DCNN的人臉多屬性識(shí)別

廣長(zhǎng)彪

(1.四川大學(xué)視覺(jué)合成圖形圖像國(guó)家重點(diǎn)實(shí)驗(yàn)室,成都 610065;2.四川川大智勝軟件公司,成都 610065)

基于DCNN的人臉多屬性識(shí)別

廣長(zhǎng)彪

(1.四川大學(xué)視覺(jué)合成圖形圖像國(guó)家重點(diǎn)實(shí)驗(yàn)室,成都 610065;2.四川川大智勝軟件公司,成都 610065)

在人臉屬性的識(shí)別過(guò)程中,目前常見(jiàn)的方法有以下幾種,基于Gabor小波變換的人臉屬性識(shí)別,基于SIFT的人臉屬性識(shí)別和基于差分紋理的人臉屬性識(shí)別。傳統(tǒng)方法存在很多問(wèn)題,例如特征的選取需要人為的干預(yù),而且特征的選擇也不一定能夠符合預(yù)期。采用有監(jiān)督的基于深度卷積神經(jīng)網(wǎng)絡(luò)(DCNN)的方法,構(gòu)建一個(gè)多層卷積神經(jīng)網(wǎng)絡(luò),通過(guò)卷積神經(jīng)網(wǎng)絡(luò)獲得深度卷積激活特征,該方法采用CelebA庫(kù)訓(xùn)練,之后用JAFFE人臉庫(kù)進(jìn)行檢測(cè),取得很好的實(shí)驗(yàn)結(jié)果。

屬性識(shí)別;SIFT;監(jiān)督;深度卷積神經(jīng)網(wǎng)絡(luò)

0 引言

隨著現(xiàn)代社會(huì)的發(fā)展和科技的日益革新,人們對(duì)于信息的獲取和信息的處理的需求也日益增加,其中對(duì)于人臉屬性的識(shí)別也是當(dāng)前人工智能領(lǐng)域的一個(gè)重要的課題,因?yàn)槿四槍傩园撕芏嘈畔ⅲ瑢?duì)于人臉屬性的識(shí)別也將應(yīng)用于諸多領(lǐng)域。例如人機(jī)交互[1]、智能機(jī)器人、醫(yī)療、遠(yuǎn)程教育、火車站、公安系統(tǒng)、圖書(shū)館管理系統(tǒng)、心理學(xué)研究,等等,前景非常的廣闊。而人臉屬性包含人臉的各種特征,例如胡須、微笑、性別等,人臉屬性識(shí)別技術(shù)是指對(duì)一副人臉圖像或者是攝像頭捕獲到的人臉進(jìn)行分析,返回人臉的性別、年齡、表情等各種信息。

對(duì)于目前人臉屬性的一些主流方法,如以Gabor小波作為圖像工具的人臉屬性識(shí)別技術(shù),被廣泛的應(yīng)用于人臉圖像分析,但Gabor特征存在計(jì)算量大,維數(shù)高和信息冗余等缺點(diǎn),還有基于SIFT的人臉屬性識(shí)別以及基于差分紋理的人臉屬性識(shí)別,等等,以上的特征值都是基于人工的提取特征值,而本文提出使用深度卷積網(wǎng)絡(luò)自動(dòng)學(xué)習(xí)有效特征并進(jìn)行分類的人臉識(shí)別方法。首先利用DCNN非線性映射和自動(dòng)提取圖像結(jié)構(gòu)信息的能力,設(shè)計(jì)一個(gè)DCNN網(wǎng)絡(luò)實(shí)現(xiàn)對(duì)姿態(tài)魯棒性的人臉識(shí)別方法。在JAFFE數(shù)據(jù)庫(kù)以及LFW數(shù)據(jù)庫(kù)上的測(cè)試結(jié)構(gòu)表明,與現(xiàn)有的如上述的幾種人工設(shè)計(jì)特征方法相比,深度卷積神經(jīng)網(wǎng)絡(luò)方法能有效地進(jìn)行特征學(xué)習(xí),避免了人工選取特征的不穩(wěn)定以及選取的特征不好等缺陷,也避免了人工巨大的工作量,在人臉屬性識(shí)別上具有很好的效果。

1 DCNN介紹

1981年的諾貝爾醫(yī)學(xué)獎(jiǎng)得主是美國(guó)神經(jīng)生物學(xué)家David Hubel和Torsten Wiesel以及Roger Sperry,而David Hubel和Torsten Wiesel的主要貢獻(xiàn),是發(fā)現(xiàn)了視覺(jué)系統(tǒng)的信息處理,可視皮層是分級(jí)的,以此提出了“感受野[2]”的概念。到了八十年代中期,F(xiàn)ukushima等在感受野概念的基礎(chǔ)上又提出了神經(jīng)認(rèn)知機(jī)[3],這便是卷積神經(jīng)網(wǎng)絡(luò)(Convolution neural networks,CNNs)的第一次實(shí)現(xiàn),也是第一次基于神經(jīng)元之間的局部連接性和層次結(jié)構(gòu)組織的人工神經(jīng)網(wǎng)絡(luò)。卷積網(wǎng)絡(luò)是為識(shí)別二維形狀而特殊設(shè)計(jì)的一個(gè)多層感知器,這種網(wǎng)絡(luò)結(jié)構(gòu)對(duì)平移、比例縮放、傾斜或者共他形式的變形具有高度不變性。這些良好的性能是網(wǎng)絡(luò)在有監(jiān)督方式下學(xué)會(huì)的,卷積神經(jīng)網(wǎng)絡(luò)有三個(gè)顯著的特點(diǎn),即共享權(quán)值[4](shared weights),時(shí)間或空間子采樣(temporal or spatial sub-sampling),局部感受野(local receptive fields),卷積神經(jīng)網(wǎng)絡(luò)(CNN)局部連接權(quán)值共享和池化的方法能夠很大程度上降低網(wǎng)絡(luò)的計(jì)算復(fù)雜度,同時(shí)CNN的這些特點(diǎn),即對(duì)平移,比例縮放和傾斜等形變具有很好的魯棒性。局部感受野是一種將隱層中的每個(gè)神經(jīng)元和輸入圖像中的局部區(qū)域相連接的一種思想。由于隱層中的每個(gè)神經(jīng)元不需要和整個(gè)圖像進(jìn)行全連接,而只是和圖像進(jìn)行局部連接,所以通過(guò)這種局部感知的感受野思想,可以大大地減少連接的數(shù)目,同時(shí)也極大程度地降低卷積神經(jīng)網(wǎng)絡(luò)中需要訓(xùn)練的權(quán)值參數(shù)數(shù)目。

卷積神經(jīng)網(wǎng)絡(luò)(CNN)的基本結(jié)構(gòu)是卷積層和池化層。對(duì)于卷積層而言,每一個(gè)神經(jīng)元的結(jié)構(gòu)與上一層結(jié)構(gòu)局部想連,上一層的特征層則與卷積核做卷積運(yùn)算,從而得出下一層的的卷積層,運(yùn)算則是提取特征的過(guò)程。池化層則是由上一層的下采樣變化而來(lái),一般情況下是一個(gè)二次特征提取的特征層,它用來(lái)求局部敏感性[5]。

卷積是分析數(shù)學(xué)中的一種運(yùn)算,設(shè)f(x)和g(x)是R上的兩個(gè)可積函數(shù),做積分運(yùn)算如下:

公式(1)定義了f(x)和g(x)的卷積。一個(gè)完整的卷積層通常情況下由多個(gè)特征映射平面組成,使用多種卷積核(也可稱為濾波器)對(duì)圖像進(jìn)行卷積,于是我們便可以得到輸入圖像的每個(gè)位置上的多種特征。

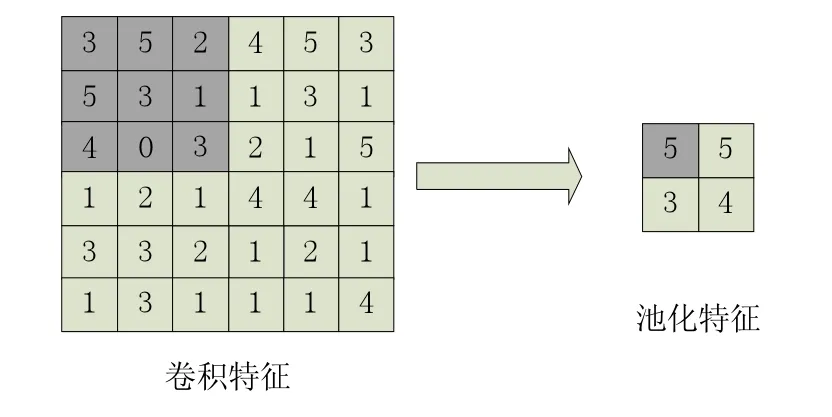

接下來(lái)便是池化操作,如前所述,在我們用卷積獲得特征(features)之后,下一步我們希望利用這些特征去做分類過(guò)程。理論上講,我們可以把所有提取得到的特征去訓(xùn)練分類器,但是這樣做卻面臨海量數(shù)據(jù)的計(jì)算。例如:對(duì)于一個(gè)192×192像素的圖像,假設(shè)我們已經(jīng)學(xué)習(xí)得到了100個(gè)定義在8×8輸入上的特征,每一個(gè)特征和圖像卷積都會(huì)得到一個(gè)(192-8+1)×(192-8+ 1)=34225維的卷積特征,由于有100個(gè)特征,所以每個(gè)樣例(example)都會(huì)得到一個(gè)185×185×400=33,422,500維的卷積特征向量。卷積過(guò)程如圖1所示:

圖1 二維卷積操作示意圖

學(xué)習(xí)一個(gè)擁有幾百萬(wàn)個(gè)特征輸入的分類器十分的繁瑣,并且容易出現(xiàn)過(guò)擬合(over-fitting)。

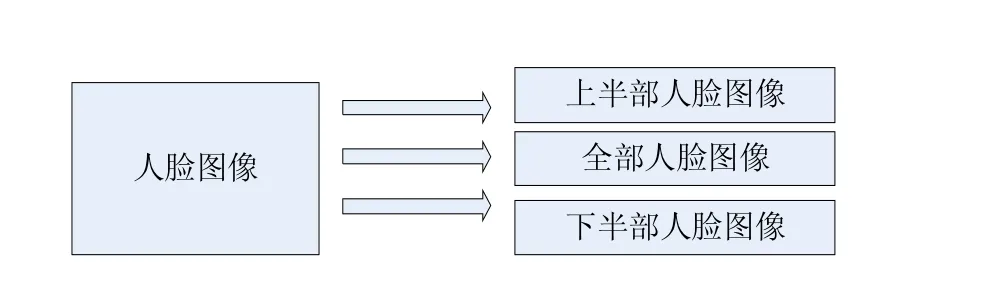

所以我們需要解決上述問(wèn)題,我們可以利用卷積后的特征是因?yàn)閳D像具有一種“靜態(tài)性”的屬性,也就是指在一個(gè)圖像區(qū)域有用的特征極有可能在另一個(gè)區(qū)域同樣適用。所以,為了描述比較大的圖像,我們可以利用上述特性,對(duì)不同位置的特性進(jìn)行聚類統(tǒng)計(jì),人們可以計(jì)算圖像一個(gè)區(qū)域上某個(gè)特定特征的平均值或者是最大值。這些概要特征的維度與原維度相比也有了幾何倍數(shù)的降低,大大的減少了計(jì)算量。這種聚合的操作就叫做池化(pooling),根據(jù)池化的方法不同主要分為平均池化法和最大池化法兩類。最大池化示意圖如圖2所示。

圖2 最大池化操作示意圖

然而特征又是如何選取的呢,傳統(tǒng)的特征選取過(guò)程是通過(guò)人工來(lái)選取,不僅特征選取過(guò)程工作量巨大,需要人工干預(yù),而且選取特征的好壞很大程度上受到人為因素的影響,幸運(yùn)的是,深度學(xué)習(xí)的出現(xiàn)解決了如何自動(dòng)學(xué)習(xí)“優(yōu)質(zhì)特征”的問(wèn)題[6],它通過(guò)模仿人類大腦分析學(xué)習(xí)的機(jī)制,將分級(jí)信息處理過(guò)程引入到特征表達(dá)上,通過(guò)逐層特征變換,將樣本在原空間的特征表達(dá)變換到新的特征空間上,從而使分類變得更加容易,也減少了人工干預(yù),卷積神經(jīng)網(wǎng)絡(luò)作為深度學(xué)習(xí)的模型,也是當(dāng)前的熱點(diǎn)。這便是我們的深度卷積神經(jīng)網(wǎng)絡(luò)(DCNN)。

2 傳統(tǒng)方法

傳統(tǒng)的人臉屬性方法大概有以下幾種,即基于Gabor小波變換的人臉屬性識(shí)別,基于SIFT的人臉屬性識(shí)別和基于差分紋理的人臉屬性識(shí)別。以下將介紹這幾種傳統(tǒng)方法的基本原理和優(yōu)缺點(diǎn),基于Gabor小波變換的人臉屬性識(shí)別利用Gabor函數(shù)是唯一能達(dá)到測(cè)不準(zhǔn)原理下界的函數(shù),能夠同時(shí)在空域和頻域中取得最優(yōu)分辨率的特征,獲得Gabor特征,將表情特征向量進(jìn)行k近鄰分類,得到實(shí)驗(yàn)結(jié)果。基于SIFT的人臉屬性識(shí)別利用SIFT算法尋找圖像的不同尺度空間的特征點(diǎn),并獲得和特征點(diǎn)相關(guān)的尺度和方向等信息,得到特征點(diǎn)的描述子,得到特征向量,利用支持向量機(jī)對(duì)特征進(jìn)行選擇和分類。基于差分紋理的人臉屬性識(shí)別一定程度上能夠屏蔽掉個(gè)體人臉的差異同時(shí)保留人臉屬性特征,首先選定人臉標(biāo)準(zhǔn)模型,該模型合理分布人臉的一些基準(zhǔn)點(diǎn),然后利用Delaunay三角剖分獲取這些基準(zhǔn)點(diǎn)的基準(zhǔn)信息,然后利用紋理映射技術(shù)將人臉屬性映射到標(biāo)準(zhǔn)人臉參考模型中。這些方法在一定程度上都有可取性,但是都存在一定的問(wèn)題,這些選取特征的方式都是人工的選取,避免不了巨大的工作量和特征選取不好的問(wèn)題。

3 文中DCNN方法

機(jī)器學(xué)習(xí)[7]是人工智能領(lǐng)域的一個(gè)重要學(xué)科,隨著互聯(lián)網(wǎng)的發(fā)展和人工智能的崛起,機(jī)器學(xué)習(xí)成為解決問(wèn)題的重要手段,機(jī)器學(xué)習(xí)的流程包括:對(duì)問(wèn)題建模,訓(xùn)練數(shù)據(jù)的組織,特征抽取,模型訓(xùn)練,模型優(yōu)化等重要環(huán)節(jié)。機(jī)器學(xué)習(xí)分為無(wú)監(jiān)督學(xué)習(xí)(unsupervised learning)和有監(jiān)督學(xué)習(xí)(supervised learning),在實(shí)際應(yīng)用中,有監(jiān)督學(xué)習(xí)是更加常見(jiàn)和有價(jià)值的方式。本文采用的DCNN方法即使有監(jiān)督的學(xué)習(xí)方法。

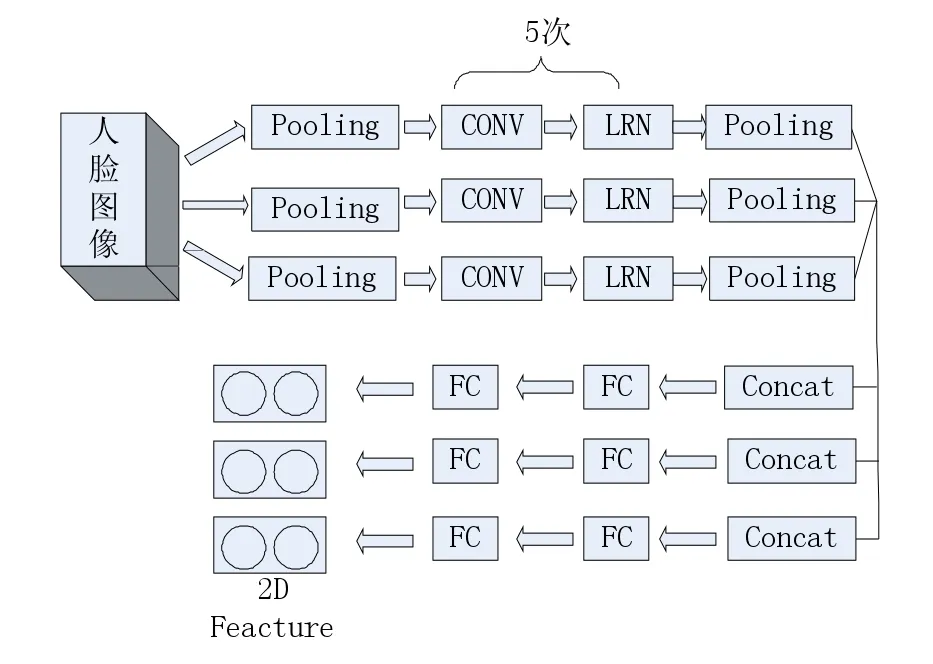

對(duì)于人臉圖像我們做如下處理,如圖3所示:

圖3 人臉圖像處理

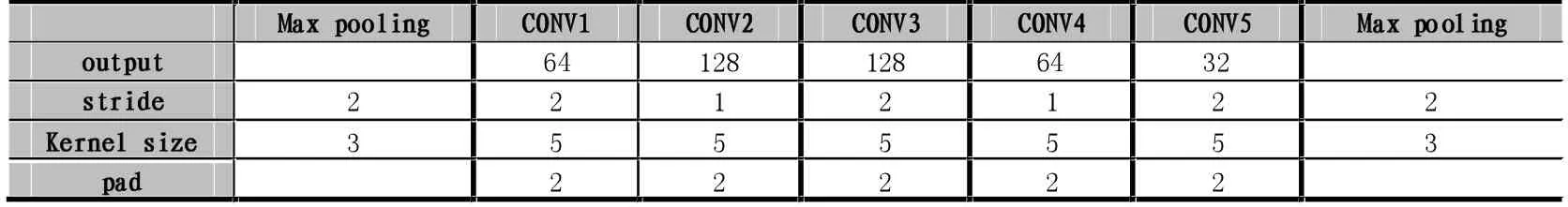

本文的網(wǎng)絡(luò)拓?fù)浣Y(jié)構(gòu)圖4所示:

圖4 人臉屬性識(shí)別網(wǎng)絡(luò)拓?fù)浣Y(jié)構(gòu)圖

本網(wǎng)絡(luò)分為兩部分,前面是卷積網(wǎng)絡(luò)部分,后面是全連接部分,卷積網(wǎng)絡(luò)分為三個(gè)子網(wǎng)絡(luò),最開(kāi)始的是pooling層,中間包含五個(gè)卷積單元,每個(gè)卷積單元包含一個(gè)卷積層和一個(gè)LRN層,之后又是一個(gè)polling層,三個(gè)子網(wǎng)絡(luò)的輸入分別是上半臉、全臉和下半臉。后面全連接部分也是三個(gè)子網(wǎng)絡(luò),每個(gè)子網(wǎng)絡(luò)完成一個(gè)屬性識(shí)別。

網(wǎng)絡(luò)的輸入均為128×128的灰度圖像,網(wǎng)絡(luò)中的所有polling層都采用max pooling,卷積網(wǎng)絡(luò)部分每個(gè)子網(wǎng)絡(luò)的參數(shù)如表1:

全連接部分的每個(gè)子網(wǎng)絡(luò)的輸入均為卷及網(wǎng)絡(luò)三個(gè)子網(wǎng)絡(luò)輸出特征的連接,全連接網(wǎng)絡(luò)部分的每個(gè)子網(wǎng)絡(luò)的參數(shù)如下:全連接1的output為128,全連接2的output為2。

整個(gè)網(wǎng)絡(luò)輸出了三個(gè)二維的向量,分別對(duì)應(yīng)微笑。三個(gè)人臉屬性的二分類特征。由于微笑屬性是研究的屬性中識(shí)別難度較大且之前對(duì)微笑的識(shí)別較多,所以本文選取微笑屬性來(lái)作為與之前方法作對(duì)比的試驗(yàn)。

表1

4 實(shí)驗(yàn)結(jié)果與分析

本實(shí)驗(yàn)是一在JAFFE庫(kù)[8]上的測(cè)試,該數(shù)據(jù)庫(kù)由10個(gè)女性的213張人臉表情組成,其中微笑的圖片共計(jì)31張,非微笑圖片182張。圖5為JAFFE人臉庫(kù)微笑圖片的示例。

圖5 JAFFE人臉庫(kù)微笑圖片示例

表2 文中方法與其他方法比較

Gabor小波和SIFT及本文采用的方法在JAFFE數(shù)據(jù)庫(kù)上的試驗(yàn)結(jié)果如表2所示。

同時(shí),以上只是在微笑的時(shí)候,能否檢測(cè)出微笑的識(shí)別率,同時(shí),也有在不是微笑的情況下,檢測(cè)出非微笑的識(shí)別率。由于在JAFFE庫(kù)上的樣本都是不戴眼鏡的女性,所以不適合我們胡須屬性和眼鏡屬性的試驗(yàn),我們從WebFace庫(kù)中抽取100張人臉圖片用于我們的試驗(yàn),同時(shí)我們得到非微笑人臉在JAFFE庫(kù)及其他的人臉屬性在WebFace庫(kù)上的識(shí)別率如表3所示。

5 結(jié)語(yǔ)

本文基于DCNN的人臉屬性識(shí)別與傳統(tǒng)方法相比,具有不用人工選取特征,選取特征較好,識(shí)別準(zhǔn)確率更高等優(yōu)點(diǎn),人臉的屬性識(shí)別也具有較大的實(shí)際意義,可用于人工交互、公安系統(tǒng)等各領(lǐng)域,若想取得更好的識(shí)別率,今后可以改進(jìn)網(wǎng)絡(luò)拓?fù)浣Y(jié)構(gòu),采用更深的網(wǎng)絡(luò),用更大的數(shù)據(jù)訓(xùn)練。

表3 各屬性識(shí)別正確率及環(huán)境

[1]薛雨麗,毛俠,郭葉,等.人機(jī)交互的人臉表情識(shí)別研究進(jìn)展[J].中國(guó)圖形圖象學(xué)報(bào),2009,14(5):764-772.

[2]Hubel D H,Wiesel T N.Receptive Fields,Binocular Interaction and Functional Architecture in the Cat's Visual Cortex[J].The Journal of Physiology,1962,160(1):106-154.

[3]Fukushima K,Miyake S.Neocognitron:A New Algorithm for Pattern Recognition Tolerant of Deformations and Shifts in Position[J]. Pattern Recognition,1982,15(6):455-469.

[4]Won Y,Gader P D,Coffield P C.Morphological Shared-Weight Networks with Applications to Automatic Target Recognition[J].Neural Networks,IEEE Transactions on,1997,vol.8,no.5,pp.1195-1203.

[5]池艷玲.基于深度學(xué)習(xí)的人臉識(shí)別方法的研究[D]:[碩士學(xué)位論文].福州:福建師范大學(xué),2015.

[6]Graves A,Mohamed A R,Hinton G.Speech Recognition with Deep Recurrent Neural Networks.In:Proceedings of the 38th IEEE International Conference on Acoustics,Speech and Signal Processing.Vancouver,BC:IEEE,2013.6645-6649

[7]王玨,周志華,周傲英.機(jī)器學(xué)習(xí)及其應(yīng)用.清華大學(xué)出版社,書(shū)號(hào):ISBN 7-302-12038-2,北京,2006.

[8]Affect Analysis Group.Cohn-Kanade-AU-Coded Expression Database[OL].[2010-12-06]http://www.pitt.edu/~emotion/ckspread.htm.

An Improved Algorithm of the Screen Space Ambient Occlusion

YANG Zhi-cheng

(College of Computer Science,Sichuan University,Chengdu 610065)

In computer graphics,the quality of global illumination directly affects the authenticity of the frames.The traditional ray tracing is complex,and difficult to online.So in real-time applications such as games generally choose the Ambient Occlusion,AO technology to simulate global illumination effect,which sacrifice some effect to reach real-time rendering.

Global Illumination;Ambient Occlusion;Screen Space;Mipmap

1007-1423(2017)08-0051-05

10.3969/j.issn.1007-1423.2017.08.011

廣長(zhǎng)彪(1990-)男,湖北孝感人,在讀碩士研究生,研究方向?yàn)閳D像處理與合成

2016-12-29

2017-03-10

科技部重大儀器專項(xiàng)(No.2013YQ49087904)