主動光立體標靶檢測及其在工業機器人位姿測量中的應用

張 旭 鄭澤龍

1.上海大學,上海,200072 2.上海市智能制造及機器人重點實驗室,上海,200072

?

主動光立體標靶檢測及其在工業機器人位姿測量中的應用

張旭1,2鄭澤龍1

1.上海大學,上海,2000722.上海市智能制造及機器人重點實驗室,上海,200072

基于工業機器人位姿視覺測量方法提出了用主動光立體標靶進行機器人末端位姿測量的方法。以主動紅外光代替反光標志點,以主動光圖案特征代替亮度特征作為表達位置信息的形式,設計了六面體主動光標靶。通過合理設置特征面圖案,使立體標靶特征面提供蘊含空間幾何約束的信息,并在此基礎上設計了特征面識別算法。在室內環境、室外環境、混合光環境等實驗條件下,該算法可實現對主動標靶健壯的識別和定位。在高精度四軸移動平臺上的測量誤差評價實驗表明:運用該標靶的立體視覺系統在0.5~3 m工作范圍內平均位置誤差為0.0857 mm,平均姿態誤差為0.1086°,滿足機器人位姿測量的要求。最后在YASKAWA的Motoman-MH80六軸機械臂上進行了機器人末端位姿的測量實驗,驗證了該方法的可行性和高效性。

機器人位姿測量;視覺測量;特征識別;主動光立體標靶

0 引言

機器人位姿測量指的是測量機器人末端(特指機器人的末端法蘭中心)相對于測量坐標系或機器人基座坐標系的位置和姿態。獲取機器人測量位姿對機器人有著重要的意義。如在用視覺伺服控制機器人進行裝配時需要視覺系統實時反饋機器人的位姿,從而控制機器人進行裝配[1];再比如對工業機器人D-H參數標定時關鍵一步就是要獲得多組機器人的測量位姿,從而進行標定工作[2-4]。現今獲取機器人測量位姿的方法很多,常用的測量方法可以簡單分為接觸式和非接觸式。

接觸式測量方式要求測量設備必須直接與測量目標接觸,如球桿儀[5]、拉線式傳感器[6]等設備,但通常情況下,這種接觸式的測量在機械臂上實施起來難度大,操作也較為復雜且測量范圍較小。非接觸式測量有激光、超聲波、紅外和視覺傳感以及多種方法融合的測量技術,激光跟蹤儀是較為常用的測量設備[7],激光跟蹤儀具有測量精度高、測量范圍大等優點,但缺點也很明顯,即不方便搬運、價格昂貴。在滿足所需精度的情況下,測量的效率和成本是機器人末端姿態測量必須考慮的問題,因此,視覺檢測成為較為常用的非接觸測量方式。視覺測量方法需要在機器人上安裝特定的視覺標靶,常用的標靶類型有平面標定板[8-9]或表面具有反光標記點的標靶[10-11]。選用平面視覺標定板作為標靶的方式不具有實時性,一般都需要先拍完圖片再通過手動選擇感興趣區域(ROI)的方式才能獲取位姿,獲取效率低,同時因為只有一個面,所以測量的范圍較為有限;而用反光標記點的標靶,雖然可以做到實時獲取位姿,但反光標記點在實際使用中反射效果受工作距離的影響較大,并且需要從復雜的環境光中提取特征圓,使得特征圓的檢測更加復雜,穩定性也較差,特別是在有較多鏡面反射或強光現場尤為明顯。

綜合考慮以上測量方法的優勢和不足,本文提出了一種用主動光立體標靶測量機器人末端位姿的方法。所用主動光立體標靶是利用紅外光提供可供識別的光源圖形,通過相應的特征識別算法識別特征圖形以獲取立體標靶在測量坐標系下的測量位姿,繼而通過位姿變換獲得機器人末端位姿。該方法只要獲取安裝在機器人末端的立體標靶的圖片便能立即獲得機器人的末端姿態,操作方便,測量效率高,同時具有較高的測量精度。

1 主動光立體標靶及其視覺檢測算法

1.1主動光立體標靶

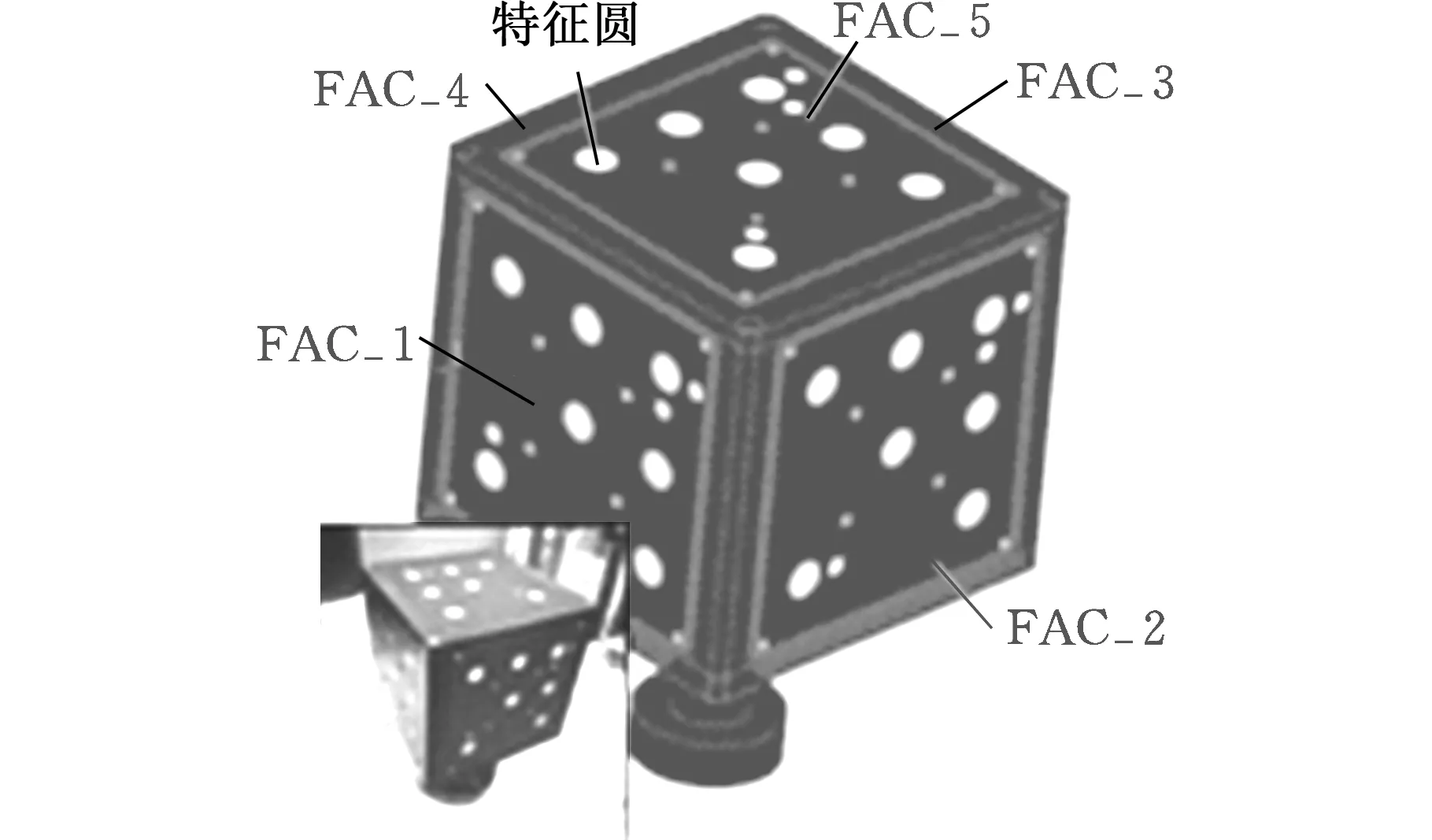

工業機器人的工作范圍較大,要求所設計的立體標靶在機器人運動范圍內各個角度都能可視,所以本文的立體標靶為六面體結構,其中標靶的多個面上都提供了可供識別的特征圓的組合圖形(立體標靶上有特征圖形的面以下簡稱特征面)。

為了提供位姿信息,特征面上的特征圖形設計成由7個大圓、3個小圓組成的組合圖形,如圖1所示。其中7個大圓作為特征圓,用來構建標靶特征面的固連坐標系,3個小圓作為輔助識別特征(圖1b)。立體標靶的每個特征面上都定義了對應的固連坐標系,這里統一說明:1號大圓的圓心為坐標系的原點,1號大圓到3號大圓的向量為X軸,1號大圓到5號大圓的向量為Y軸。

(a)整體機構

(b)特征圖形

(c)四層均勻光結構圖1 主動光立體標靶

標靶的每個特征面上都有可供識別的特征圖形,所以其上的特征圖形除了攜帶位姿信息外同時還應攜帶所在特征面的面編號信息,以區別不同的特征面,如圖1b所示,用c號小圓相對7號大圓的位置關系來提供標靶的面編號信息,圖中c號小圓的5個位置分別代表了5個特征面(為了方便表述,下文用FAC_i (i=1,2,…,5)表示立體標靶的第i號特征面)。通過這種方式,立體標靶的每個特征面便能提供位姿信息和面編號信息。

在用主動光產生特征圓的過程中,光源亮度不均將直接導致特征檢測精度下降,為此本文提出用圖1c所示的四層的結構來解決光源成像不均的問題。四層結構從下到上依次為:光源層、隔離層、擴散層和修光層。光源層用于提供紅外光源,光源選用波長為850nm、發光角度為120°的紅外LED燈珠;隔離層用于隔離燈珠,擴大燈珠的發光角度;擴散層為光擴散板,光擴散板可通過化學和物理的手段,利用光線在行進途中遇到兩個折射率相異的介質時,發生折射、反射與散射的物理現象,實現入射光充分散色,以此產生光學擴散的效果,使光源均勻;修光層為有較高加工精度的金屬薄片,在其上用激光雕刻的方法雕刻出標靶的特征圖形,然后將其覆蓋在擴散板上以獲得所需要的特征圖形。

如上所述立體標靶的最終結構如圖1a所示,其中5個面為特征面,每個特征面都是圖1c所示的四層結構,另外一個面用于連接機器人和固定LED供電電路。

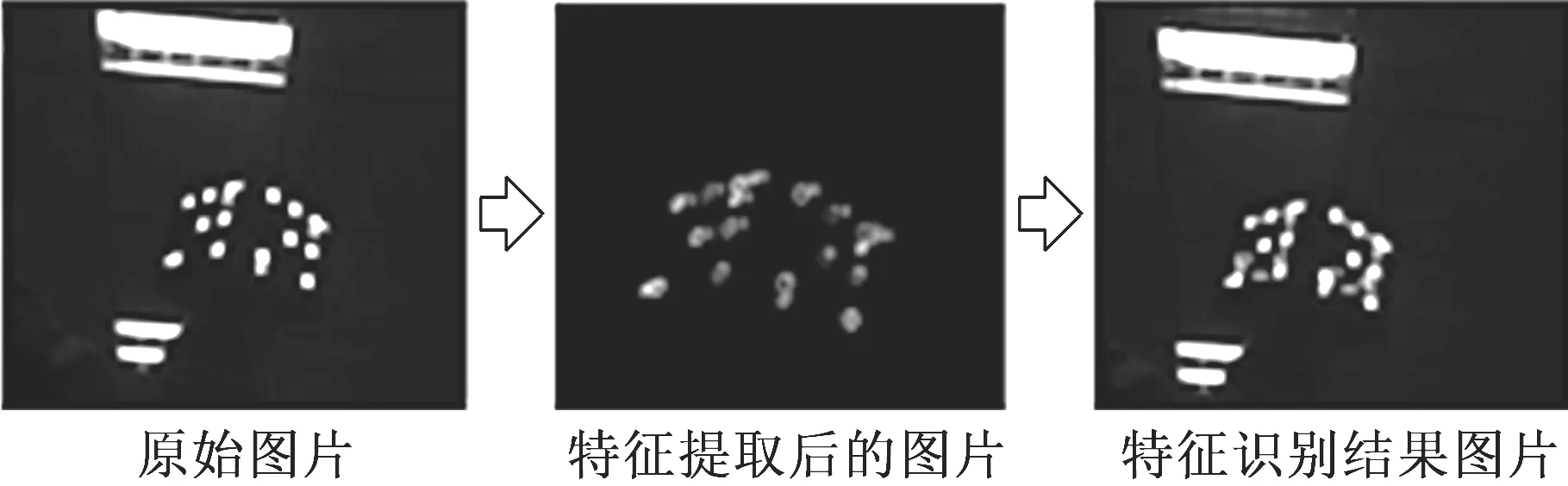

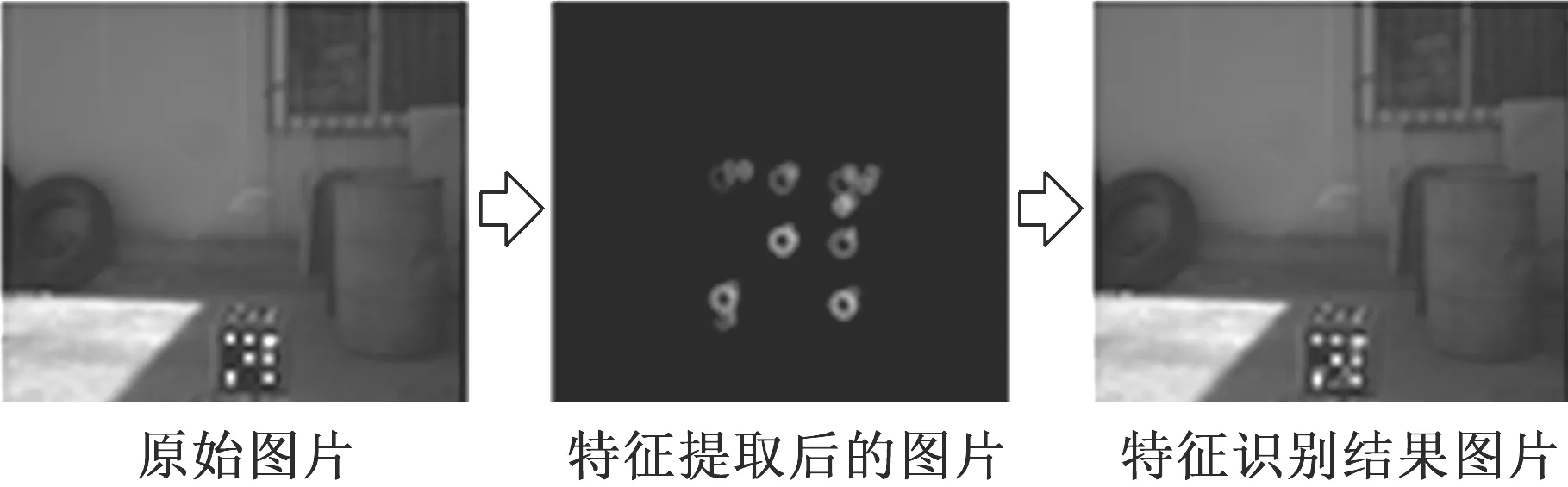

通過在相機鏡頭前加裝帶通為850nm的濾波片,在室內環境下可以將大部分環境干擾濾除,圖2所示即為標靶實物的成像效果,可以看出特征圓的亮度十分均勻且形狀規整。

圖2 立體標靶的成像效果

1.2標靶特征面檢測算法

用視覺測量的方法獲取標靶位姿時,必須對立體標靶上用于提供位姿信息的特征面進行檢測識別,檢測算法流程如下。

(1)圖像預處理。圖像預處理主要進行圖像濾波和圖像二值化,用高斯濾波的方式濾除圖像噪點。立體標靶的紅外光強大于環境中的850nm輻射光強,主動光斑相對環境具有較大的對比度,設定閾值對圖像進行二值化以分離目標和背景。

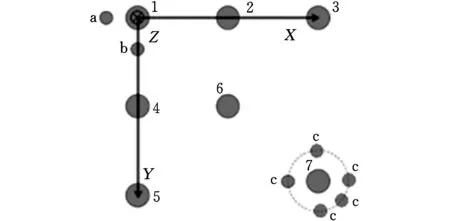

(2)特征圓提取。為了從環境中準確獲取目標特征圓,濾除環境光干擾,以提高后期進行特征圓識別的效率和準確率,就必須對圖像的輪廓特征進行過濾。這里采用三個過濾條件:①輪廓所占像素數。特征圓在測量范圍內其輪廓長度為有限值,而非巨大背景或散亂噪聲產生的輪廓。②輪廓長短軸比值。圓特征經過透視投影,在攝像機上成像為橢圓,輪廓經橢圓擬合后可獲得橢圓長軸、半軸,計算長短軸比值并同設定的閾值比較,濾除傾斜角度過大的特征圓。③橢圓面積。根據擬合后的橢圓面積和原輪廓所占像素數的差值濾除非橢圓特征的環境干擾。具體流程如圖3所示。

圖3 特征圓提取、篩選過程

(3)確定特征圓標號。①查找1號大圓。根據1號大圓和兩個環繞小圓的尺寸位置約束(圖1b),可找出1號大圓。②查找a號、b號小圓,確定參考方向向量。為了找出其他的大圓,需先定義三個參考方向:X、Y軸方向和45°方向。這里用1號大圓的兩個環繞小圓定義參考向量,所以先要辨識這兩個環繞小圓。建立1號大圓到兩小圓的矢量,分別用V1=(x1,y1,0)和V2=(x2,y2,0)表示。由圖1b可知a號小圓位于-X軸方向,b號小圓位于Y軸方向,將V1和V2叉乘,以叉乘后的向量的z值的正負來辨識a號、b號小圓。識別出a號、b號小圓后,分別求從1號大圓圓心到a號小圓圓心、從1號大圓圓心到b號小圓圓心、a號小圓圓心到b號小圓圓心的矢量作為參考方向,即X、Y軸方向和45°方向,分別用Vx、Vy、V45表示。③查找2~7號大圓,更新參考方向向量。根據上一步定義的Vx、Vy、V45分別找出在這些方向向量上的圓,并根據其同1號大圓的距離關系確定編號。這樣可識別出每個方向上各有三個大圓,用最小二乘法將三個方向上的大圓圓心分別擬合成直線,作為新的方向向量,更新Vx、Vy、V45方向參考向量。④查找c號小圓,確定面編號。根據標記號為7的大圓及其小圓特征點距離約束,識別標記號為7的大圓的環繞小圓點,并計算標記號為7的大圓到小圓點的方向Vc,將Vc分別與Vx、Vy、V45進行叉乘,然后找出叉乘所得向量的z值最小的向量,以此來判斷同Vc共線或接近共線的向量,再將兩個向量點乘,判斷兩向量是同向還是反向,從而確定該組特征點所在面。

通過以上檢測算法,立體標靶在各種環境中都能取得較高的檢測效率和穩定性,圖4所示為標靶實際檢測效果。

(a)室內環境下的檢測效果

(b)室外環境下的檢測效果圖4 標靶檢測算法的檢測效果

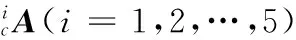

1.3機器人位姿測量方法

機器人末端的位姿信息包括了旋轉和平移。所以這里用4×4的齊次矩陣A來描述位姿信息,如下式所示:

(1)

式中,R為3×3的矩陣,表示位姿的旋轉量;T為3×1的矩陣,表示位姿的平移量。

在雙目立體視覺測量中,當已知空間中某點在左右相機圖像中的對應點時就可以確定該點在相機測量坐標系下的三維信息。通過標靶特征檢測算法識別出左右相機圖片上的特征圓后,根據特征圓標號信息確定對應性,便可得到立體標靶上的特征圓圓心的三維信息,用Pi=(xi,yi,zi)T來表示第i號特征圓圓心在雙目系統坐標系下的三維坐標,用a1、a2分別表示從1號特征圓圓心到3號特征圓圓心和從1號特征圓圓心到5號特征圓圓心的向量,則有

(2)

對a1、a2兩向量單位正交化,有

(3)

定義β1、β2分別為標靶特征面坐標系的X、Y軸,所以Z軸 β3=β1?β2。可得標靶特征面坐標系在測量位姿的旋量R=[β1β2β3],平移量T=P1,由此可得標靶特征面的測量位姿為

(4)

(5)

立體標靶有多個特征面,所以可能會出現多個特征面同時出現在相機視野中,此時,標靶識別算法會進行特征面判斷,如果能識別到FAC_1,則不對其他特征面做位姿計算;如果無FAC_1,則對出現在視野中的特征面求位姿并通過式(5)分別轉化成FAC_1的位姿,然后對獲得的多個FAC_1的位姿求平均作為FAC_1的位姿。

(6)

(a)測量中的位姿傳遞關系(b)位姿傳遞鏈簡圖圖5 位姿傳遞關系

2 立體標靶的標定和檢測算法的魯棒性分析

2.1立體標靶特征檢測算法的魯棒性分析

根據1.2節的標靶檢測方法編寫算法并進行算法魯棒性實驗。分別在室內環境、室外環境、混合光源環境(在室外環境中加入人工光源干擾)下進行實驗。將標靶放置在離相機0.5~3 m的工作距離內,每隔0.5 m拍攝100張樣張進行識別統計,以測試標靶識別算法在不同環境不同測量距離下的識別效果,得到的識別結果如圖6所示,可以看出:在室內環境中,在工作距離內識別率基本都能達到100%,平均識別率為98.1%;在室外和混合光的環境下識別率有所下降,平均識別率分別為89.33%和88.00%,這是因為室外光和混合光的實驗環境是選擇在有強太陽光直射的場地進行的,而實際的機器人測量基本都是室內進行的,室外環境下的實驗只作為算法魯棒性評價之用,在實際測量中并無實際參考價值。室內環境下在0.5~3 m的測量范圍內98.1%的識別率證明了識別算法具有較高的魯棒性,符合實際測量要求。

圖6 立體標靶識別算法在不同測量距離和不同測量環境下的識別率

2.2立體標靶的標定

如上文所述,要對標靶進行檢測需先知道標靶特征面在FAC_1坐標系下的位姿,標靶的這些參數在設計標靶時便已確定,但由于標靶在制作過程中存在加工誤差和裝配誤差,所以在使用立體標靶前需要對其進行特征面相互位姿關系的標定。隨著攝影測量技術的發展,攝影測量的精度已經基本能滿足一般的精度測量要求,所以本文采用雙目測量的方法對立體標靶的特征面相互位姿關系進行標定。

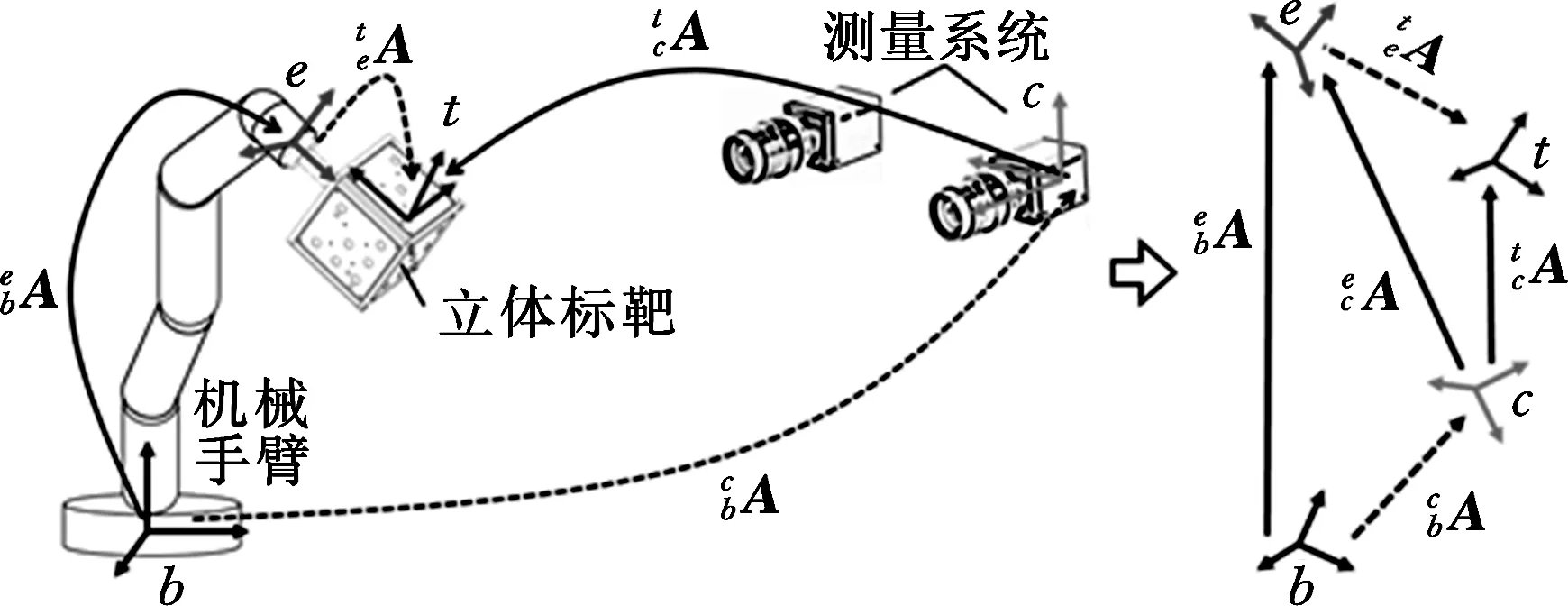

2.2.1雙目立體視覺系統的標定

用雙目視覺測量的方法對標靶的參數進行標定前,需對雙目系統進行標定。雙目測量系統的標定包括每個相機內參數的標定以及兩相機相對位姿的標定(或稱相機外參數標定)。相機標定技術已經相當成熟,主要以Tsai[13]的兩步法和張正友[14]的平面標定法為代表,本文采用張正友的標定方法進行相機標定。相機標定過程中一個關鍵步驟是選用標定板,通常的做法是將標定圖片打印出來,貼到表面光潔度和平面度較好的平板上,如圖7a所示,這種方法標靶的精度并不高。為了保證標定精度,本文采用LCD屏幕顯示的標靶(圖7b),用LCD屏幕產生標定圖片的精度能得到較好的保證[15]。

(a)打印的標定板 (b)用LCD顯示屏顯示標定圖片圖7 標定板的選用

(7)

即

(8)

根據式(8)求得的Bi可計算出特征圓之間距離,將其同標準距離比較,從而確定雙目測量系統在不同距離的測量誤差。因為LCD的制作精度已能達到0.05 μm[15],所以可以認為用屏幕顯示的標靶特征圓的相互位置就是標準值。因此用相機測量出的特征圓的相互位置與LCD屏幕顯示的特征圓的真實相互位置之差便可認為是雙目測量系統的測量誤差。圖8所示為通過這種方法得到的相機在不同距離下的測量誤差。在0.5~3 m的工作范圍內整體平均誤差為0.0728 mm,從圖8的曲線可看出標定后的測量系統具有較高的測量精度和穩定性。

圖8 雙目系統在不同測量距離下的測量精度

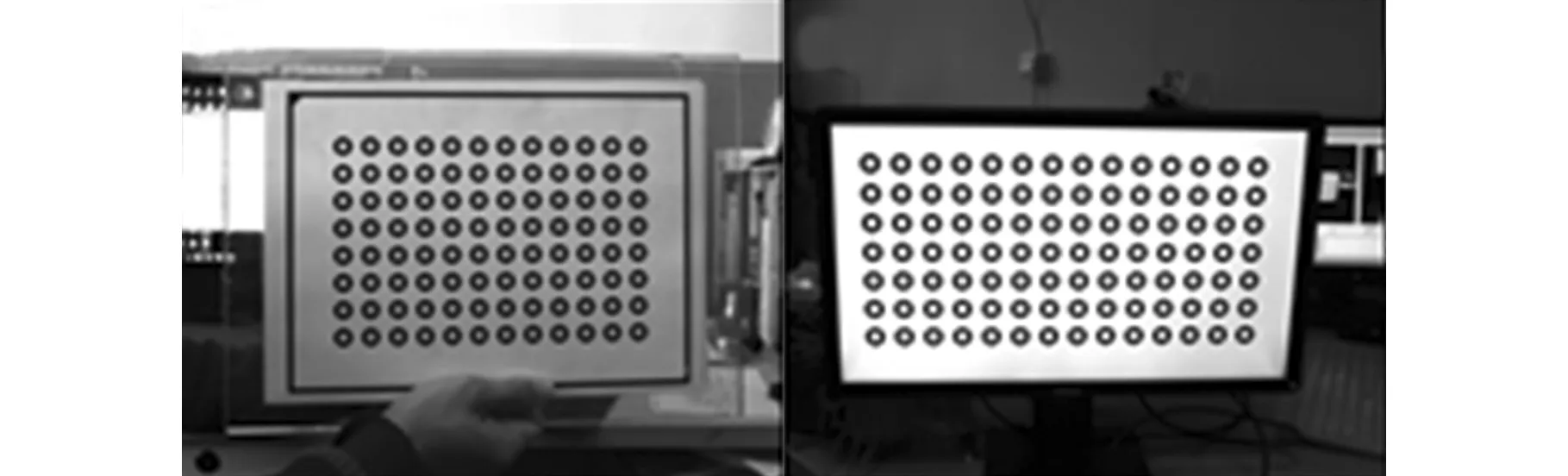

2.2.2立體標靶特征面相互位姿關系的標定

為了標定這些變換矩陣,要求左右相機的圖像中必須都能清晰地呈現兩個待標定的特征面。為了保證標定精度,畫面中特征面的法向與相機的Z向夾角不能過大(小于60°)。例如:如果要標定1號特征面和2號特征面的變換關系,必須保證在左右相機中都能同時檢測到這兩個特征面,如圖9所示。按上述要求分別獲取所要標定面的標定圖片。

(a)左相機圖片 (b)右相機圖片圖9 標定標靶特征面相對位姿關系標定圖片

通過雙目測量的方法獲得標定圖片上特征圓圓心在相機坐標系下的坐標值后,繼而獲得其所在特征面在相機坐標系下的位姿矩陣,它可表示為

(9)

(10)

將式(9)代入式(10)可計算出標靶其他特征面在FAC_1坐標系下的位姿矩陣,最終標定結果如表1所示。

表1 特征面相對位姿關系標定結果

注:矩陣中前3×3中的數值為角度,單位為rad;最后1列的前3個值為位移,單位為mm。

3 機器人位姿測量實驗

3.1立體標靶位姿測量誤差評價實驗

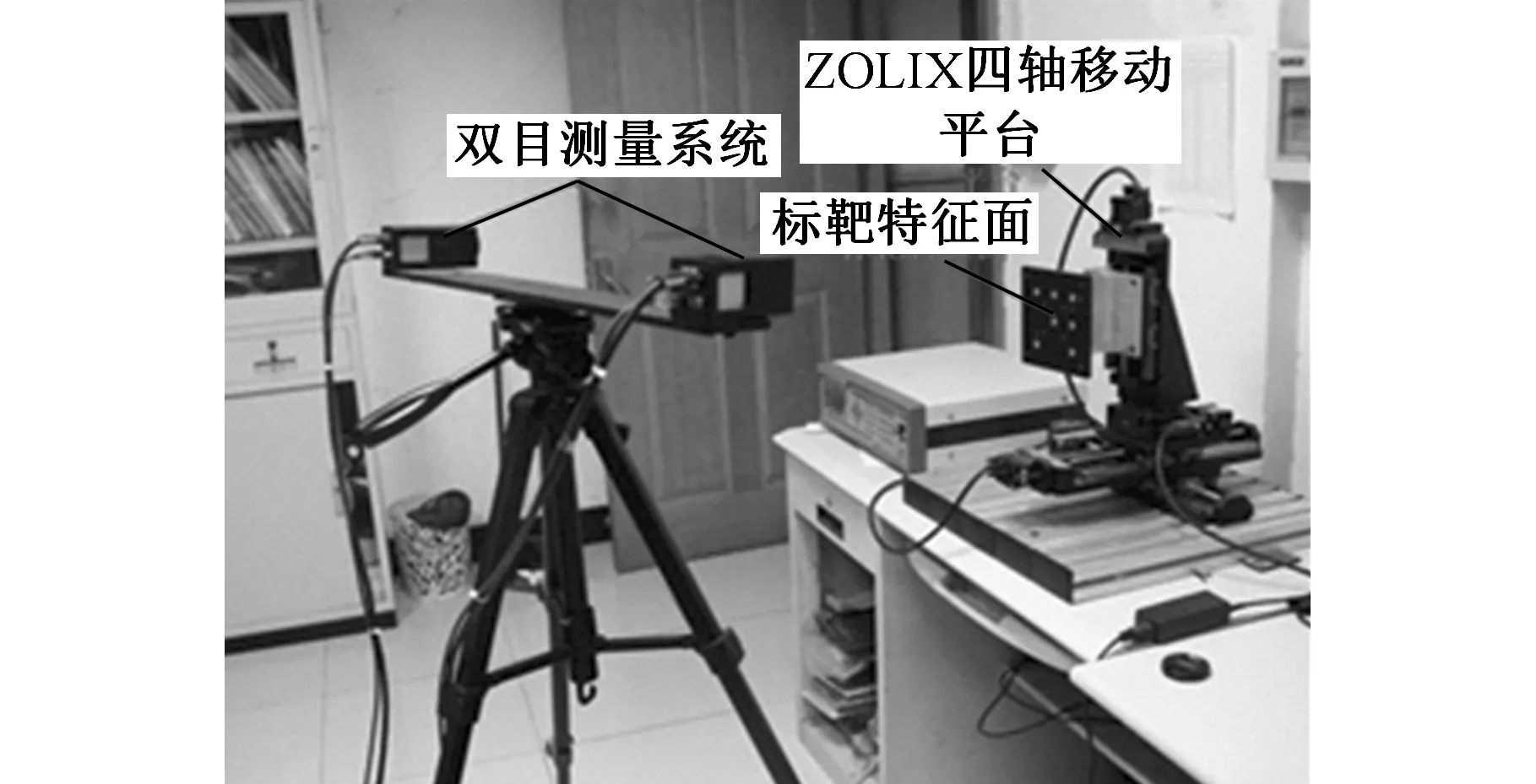

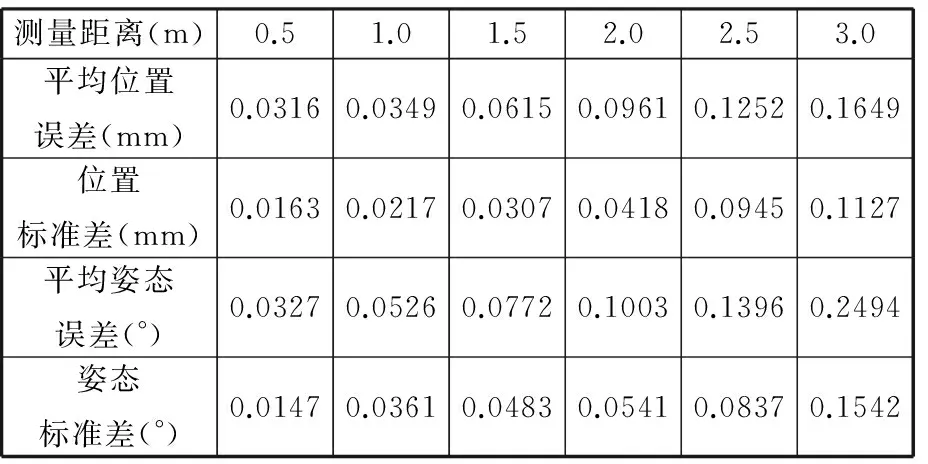

用標靶進行實際測量前,需要對標靶的位姿的測量誤差進行評價,本文在高精度的四軸移動平臺上進行立體標靶的位姿測量誤差評價實驗(圖10),所用移動平臺為ZOLIX的四軸移動平臺,位姿精度可達0.01 mm。將測量系統分別置于離移動平臺0.5 m,1 m、1.5 m、2 m、2.5 m、3 m工作距離處,將標靶特征面固定在移動平臺上,在每個測量距離處讓平臺移動50次固定值并獲取每次移動的標靶圖片,獲得標靶的位置信息,將獲得的位置同前一次的測量結果求相對位姿,便可得到相鄰兩次測量的標靶在測量坐標系下的位置的改變量(即通過測量系統獲得工作臺的每次移動的移動量),將這個值同移動臺固定的移動距離5 mm進行比較得兩個距離的差。50次的測量可以得到50個差值,對這些差值求平均值,作為評價立體視覺系統在此測量深度下的測量誤差的指標。移動雙目系統到下一個測量位置,進行同樣的操作,從而可獲得不同測量深度下的測量誤差。采用同樣的方法,讓移動平臺在每個位置處旋轉固定角度,得其測量的姿態誤差,由上述實驗可評估該方法在不同的測量距離下獲取機器人末端姿態的誤差,如表2所示。由表2中的數據可得在0.5~3 m的工作范圍內,立體標靶實際測量中的平均的位置誤差為0.0857 mm,平均姿態誤差為0.1086°,滿足機器人位姿測量的要求。

圖10 立體標靶位姿獲取精度評價實驗現場

測量距離(m)0.51.01.52.02.53.0平均位置誤差(mm)0.03160.03490.06150.09610.12520.1649位置標準差(mm)0.01630.02170.03070.04180.09450.1127平均姿態誤差(°)0.03270.05260.07720.10030.13960.2494姿態標準差(°)0.01470.03610.04830.05410.08370.1542

3.2末端位姿測量實驗

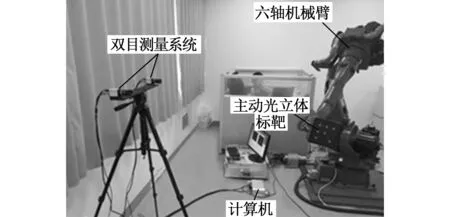

為了驗證用主動光立體標靶獲取工業機器人測量位姿方法的可行性和效率,我們在安川的Motoman_MH80六軸機械臂上進行了機器人位姿獲取實驗,將主動光立體標靶安裝在機械手臂的末端法蘭上,將測量系統置于離基座3 m處進行測量,實驗現場如圖11所示。控制機械臂繞任意軸走一個空間圓軌跡,測量系統每隔適當角度獲取標靶圖片,并進行特征檢測,獲得立體標靶的位姿,再通過手眼標定的結果進行位姿變換,繼而得到機械臂的末端執行器的測量位姿,將其與機械臂的指令位姿進行對比。本次實驗中,機械臂末端執行器的測量位姿與指令位姿的最大距離偏差為4.2721 mm,平均距離偏差為2.6905 mm。這是由于機械臂的絕對定位精度較低造成的,一般未經標定的工業機器人的絕對精度只能維持在2~3 mm水平[16]。由此可見本文測量方法能夠準確地獲取機械臂末端的測量姿態,為機器人的標定或通過視覺伺服引導機器人進行精密裝配等工作提供有力的支持。同時,實驗過程中,該方法在獲得機器人末端位姿時,獲取標靶圖片后便能馬上獲得機器人的末端位姿,具有很高的測量效率,所以該方法也可用于機器人的實時軌跡跟蹤。

圖11 六軸機械臂末端位姿測量實驗現場

4 結論

(1)提出了一種用主動光立體標靶獲取工業機器人末端的測量位姿的方法,所用主動光立體標靶通過四層均光結構可以獲得亮度均勻、特征圖形準確的光源特征的六面體視覺標靶,通過特定的檢測算法可以在多種工作環境中對立體標靶進行準確識別和定位。

(2)在室內測量環境中,在0.5~3m的工作距離內識別成功率可達到98.1%,即便在有較強環境干擾的室外環境和混合光源環境下也能達到89.33%和88.00%的識別率。

(3)為了避免立體標靶的機加工和裝配產生的誤差對姿態測量的影響,用雙目測量系統對立體標靶特征面的位姿關系進行了標定。

(4)測量精度是該方法是否切實可行的一個重要指標,本文通過實驗評價了該方法在實際的位姿測量中的測量精度,得到該方法在0.5~3m的測量范圍內測量的平均位置誤差為0.0857mm,平均姿態誤差為0.1086°,可以滿足機器人位姿測量的要求。

(5)在六軸機械臂上的位姿獲取實驗中,得到該測量方法不僅可以準確獲取機械臂的姿態,同時具有較高的測量效率的結論,因此除了用其進行機器人的標定或通過視覺伺服引導機器人進行精密裝配等工作外也可以進行機器人的實時軌跡追蹤。當然該方法有其局限性,對于視覺測量方法,測量精度會隨著測量距離的增大而變差,所以該方法用于大行程的機械臂(臂展超過2m的機械臂)的測量并不合適,同時測量精度仍有提高的空間,這取決于相機的標定精度和標靶的標定精度。后期工作中,將進一步提高該測量方法的測量精度并將其應用在機器人的標定和軌跡跟蹤中。

[1]張建中, 何永義, 李軍. 機器人裝配視覺定位應用研究[J]. 機電工程, 2011, 28(8): 934-937.

ZhangJianzhong,HeYongyi,LiJun.ApplicationResearchofVision-locationinRoboticAssemblyEquipment[J].Mechanical&ElectricalEngineer-ing, 2011, 28(8): 934-937.

[2]王東署. 工業機器人標定技術研究[D]. 沈陽:東北大學, 2006.

[3]龔星如. 六自由度工業機器人運動學標定的研究[D]. 南京:南京航空航天大學, 2012.

[4]王琨. 提高串聯機械臂運動精度的關鍵技術研究[D]. 合肥:中國科學技術大學, 2013.

[5]OtaH,ShibukawaT,TooyamaT,etal.ForwardKinematicCalibrationMethodforParallelMechani-smUsingPoseDataMeasuredbyaDoubleBallBarSystem[C]//Proc.ParallelKinematicMachines.Paris, 2000: 57-62.

[6]段廣洪,張輝,周潛,等. 剛體空間姿態測量裝置及其測量方法:中國,200410009083.7[P]. 2004-05-12.

[7]趙偉. 基于激光跟蹤測量的機器人定位精度提高技術研究[D].杭州:浙江大學, 2013.

[8]查弘文. 基于立體視覺的測量機器人的標定與測量規劃[D].南京:南京航空航天大學, 2013.

[9]郭劍鷹,呂恬生.基于主動視覺的機器人末端姿態測量[J].上海交通大學學報, 2003, 37(5): 715-719.GuoJianying,LüTiansheng.RobotEnd-effectorPoseMeasurementwithActiveVision[J].JournalofShanghaiJiaotongUniversity, 2003, 37(5): 715-719.

[10]LundbergI,Bj?rkmanM, ?grenP.IntrinsicCameraandHand-eyeCalibrationforaRobotVisionSystemUsingaPointMarker[C]//HumanoidRobots(Humanoids), 14thIEEE-RASInternationalConferenceon.Madrid,Spain,IEEE, 2014: 59-66.

[11]秦大輝, 毛婷, 劉建軍. 基于雙目立體視覺的手持式光筆三坐標測量系統[J]. 制造技術與機床, 2011 (8): 133-136.QinDahui,MaoTing,LiuJianjun.Studyon3D-coordinateMeasuremntTechnologyUsingHandholdLight-penBasedonBinocularStereo-scopicVisionSystem[J].ManufacturingTechnology&Machi-neTool, 2011 (8): 133-136.

[12]張云珠. 工業機器人手眼標定技術研究[D]. 哈爾濱: 哈爾濱工程大學, 2009.

[13]TsaiRY.AVersatileCameraCalibrationTechniq-ueforHigh-accuracy3DMachineVisionMetrol-ogyUsingOff-the-shelfTVCamerasandLenses[J].IEEEJournalofRoboticsandAutomation, 1987, 3(4): 323-344.

[14]ZhangZhengyou.AFlexibleNewTechniqueforCameraCalibration[J].PatternAnalysisandMachineIntelligence,IEEETransactionson, 2000, 22(11): 1330-1334.

[15]SongZ,ChungR.UseofLCDPanelforCalibra-tingStructured-light-basedRangeSensingSystem[J].InstrumentationandMeasurement,IEEETransactionson, 2008, 57(11): 2623-2630.

[16]趙亮. 基于旋量的SCARA工業機器人精度研究[D].杭州:浙江大學, 2011.

(編輯袁興玲)

Active Light Stereo Target Detection and Its Applications in Industrial Robot’s Pose Measurement

Zhang Xu1,2Zheng Zelong1

1.Shanghai University,Shanghai,200072 2.Shanghai Key Laboratory of Intelligent Manufacturing and Robotic,Shanghai,200072

A visual method with an active light target was proposed to obtain the positions and orientations of robots herein. First, the active light stereo target adopted active infrared light instead of reflective markers and employed shape features instead of brightness features to encode the location informations. Second, the stereo structure was designed to provide the spatial geometric constraint information. The active light target owned five feature planes to expand the visibility no mater what pose. Third, a detection method of feature planes was proposed. The proposed feature detection method was testified under different situations, such as indoor illumination environments, the direct solar radiation at outdoor square and the mixed illumination environments. The experimental results confirmed the feasibility and reliability of the proposed method. Forth, the precision of the proposed visual method was verified in a high precision platform. The experimental results show the average position error is as 0.0857 mm and the average orientation error is as 0.1086° in measuring distance ranging from 0.5~3 m. Finally, the pose measurement of a YASKAWA robot arm, Motoman-MH80, was conducted and the experimental results confirmed the feasibility and efficiency of the proposed method.

full pose measurement of industrial robot; visual measurement; feature detection; active light stereo target

2015-08-31

國家自然科學基金資助項目(51205244);機械系統與振動國家重點實驗室課題資助項目(MSV2015010);上海市教育委員會科研創新資助項目(2014Z10280034)

TP241.2

10.3969/j.issn.1004-132X.2016.19.007

張旭,男,1982年生。上海大學機電工程與自動化學院副教授、博士。主要研究方向為深度信息獲取和計算機視覺。鄭澤龍,男,1989年生。上海大學機電工程與自動化學院碩士研究生。