基于數值散射模擬與模型匹配的SAR自動目標識別研究

周 雨 王海鵬陳思喆

(復旦大學電磁波信息科學教育部重點實驗室 上海 200433)

基于數值散射模擬與模型匹配的SAR自動目標識別研究

周 雨 王海鵬*陳思喆

(復旦大學電磁波信息科學教育部重點實驗室 上海 200433)

該文提出并實現了一種基于模型的SAR自動目標識別算法,該算法用實驗室開發的BART進行離線電磁散射計算,系統參數設置和MSTAR數據庫的參數完全一致,對待測圖像和電磁散射數據所成的圖像分別進行特征提取,然后進行搜索匹配。該文通過MSTAR 3類目標3種型號的實測數據和BART仿真數據分別驗證了算法的可行性和準確性。該算法簡單易實現,運行時間短,目標分類識別的效果較好。

合成孔徑雷達;自動目標識別;SAR圖像模擬;模型匹配

Reference format: Zhou Yu,Wang Hai-peng,and Chen Si-zhe. SAR automatic target recognition based on numerical scattering simulation and model-based matching[J]. Journal of Radars,2015,4(6): 666–673. DOI: 10.12000/JR15080.

SAR自動目標識別技術目前主要分為3類:基于模型的識別、基于模板的識別和基于機器學習的識別[5]。基于機器學習的識別技術和前兩種方式的原理都不同,這里不作比較。基于模板的SAR ATR系統需要存儲海量的目標模板,由于SAR圖像不僅具有較強的斑點噪聲,而且十分敏感易變,即SAR成像參數、目標姿態、俯仰角、目標配置甚至細微的周圍環境的波動,都會使得目標圖像特征產生較大差異。模板樣本的獲取、識別系統的設計和算法效率的提高都面臨很大的困難。針對上述困難,基于模型的方法不需要存儲大量目標模板,需要的存儲空間較小,算法處理速度快,目標分辨能力高,而且在不同的工作條件下都能取得較好的識別效果,一定程度上解決了基于模板的識別方法在擴展工作條件下模板樣本無限擴大的問題[6],因此基于模型的SAR ATR成為研究的熱點。基于模型的SAR ATR系統不直接存儲目標模板,而是通過目標模型實時在線地構造特征參數連續的目標SAR圖像用于識別[7],目前使用較多的目標預測是基于3維散射中心模型的[3,8,9]。

本文實現了一種簡化的基于模型的SAR ATR算法,該算法通過雙向解析射線追蹤法計算目標CAD模型的電磁散射,仿真并存儲所得散射數據。識別時,對待測圖像和散射數據所成圖像分別提取目標區特征進行搜索匹配來完成識別。文章詳細介紹了算法的流程,并分別用實測數據和仿真數據對算法進行了驗證。文章接下來的結構如下:第2節介紹了本文所用的算法;第3節分別通過實測和仿真數據驗證了算法的準確性;第4節對文章進行了總結。

2 算法介紹

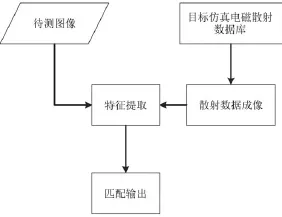

本文實現的一種簡化的基于模型的SAR自動目標識別算法整體流程如圖1所示。算法的整體思想是首先對需要識別的目標通過雙向解析射線追蹤法計算目標CAD模型的電磁散射,存儲所得散射數據。在對目標進行識別時,對待識別目標SAR圖像和散射數據成像所得的圖像分別進行特征提取,通過搜索匹配得到和待識別目標的SAR圖像最相似的仿真圖像,從而識別出目標的類型,獲取目標的方位角等信息。

圖 1 基于模型的SAR自動目標識別算法整體流程Fig. 1 Overall process of model-based SAR ATR algorithm

2.1 雙向解析射線追蹤法的數值散射模擬

本文對地面車輛目標BMP2、BTR70、T72建立目標的仿真電磁散射數據庫。本文使用一種雙向解析射線追蹤法[10](Bidirectional Analytic Ray Tracing,BART)來計算目標和粗糙面環境的復合電磁散射及其雷達散射截面(Radar Cross Section,RCS)。其主要思想是:將目標剖分成面元,對目標面元從入射和散射的逆方向兩個方向上進行幾何光學射線追蹤,記錄不同階次的射線在目標面元或者邊緣上的照射范圍。雙向解析射線追蹤法相較于單向追蹤包含了更多不同的散射機制,具體來說就是對于任意一個面元或邊緣上追蹤到的一對正反射線都構造一項多次散射項,該散射項由任意面元或邊緣上的漫反射/衍射和正反追蹤路徑上的幾何反射組成,計算其對散射場的貢獻。雙向解析射線追蹤法采用多邊形大面元或者面片剖分來處理3維電大體目標,通過多邊形交并減的幾何運算來精確地計算陰影,解析地描述射線的照射和反射;采用粗糙面元剖分來處理粗糙面背景,解析計算時同時考慮粗糙面元散射的相干分量和非相干分量,使得粗糙面的散射可以用類似平面元的方式來處理。因此,雙向解析射線追蹤法可以大大降低與目標電大尺寸相關的計算復雜度,還可以計算目標和粗糙面共存問題的復合散射。

2.2 SAR圖像預處理與特征提取

待測SAR圖像通常既包含感興趣的目標,又包含背景雜波,此外,SAR圖像往往含有較強的斑點噪聲,因此在進行目標識別時需要首先對輸入的待檢測圖像數據進行預處理,將目標從雜波背景中分割出來,增強感興趣的目標區圖像,最大限度地減弱背景雜波和斑點噪聲對識別性能的影響。

經過圖像預處理后的圖像可以進行特征提取。基于模型的SAR自動目標識別技術常用的特征包括目標區或陰影區輪廓特征、量化的目標幅值信息特征和散射特征。目標區或陰影區輪廓特征又叫做“標注特征”,這種特征不需要完整的電磁特征預測,可以有效地將圖像像素信息分為目標、陰影或者背景,提取出圖像上的很多信息;量化的目標幅值信息特征是將圖像的像素信息量化成不同等級,可以提高魯棒性,減少灰度保真的要求,降低計算相似度的數據的維度;散射特征非常敏感,它依賴于幅度圖像的拓撲分析,例如峰值特征、脊特征、邊緣特征等[11]。目標區輪廓特征簡單易提取,搜索匹配的效果也很好,基于以上分析,本文提取的是目標區特征。

本文采用的SAR圖像預處理與特征提取算法流程如圖2所示,其中目標區特征提取之前的圖像預處理算法參考文獻[4]。

圖 2 SAR圖像預處理與特征提取算法流程圖Fig. 2 Overall process of SAR image preprocessing and feature extraction algorithm

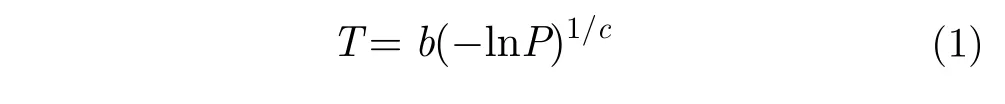

對于高分辨率雷達來說,在俯仰角較低的成像條件下,對于非均質區域的雜波分布可以采用Weibull分布來較好地描述,因此,工程上可以采用基于Weibull分布的模型來進行MSTAR圖像的分割,其目標區分割閾值為T:

式中,b為尺度因子,c為形狀因子,P為背景雜波被檢測為目標的虛警概率。

經過分割后,目標區域還存在著部分孤立的小亮點,這是分割過程產生的誤差,通常都比較小,可以通過幾何聚類的方式消除。目標在圖像中的擺放具有隨意性,目標在圖像中相對位置的不同會對后續的搜索匹配結果產生重要影響,因此必須經過質心配準將目標的位置平移到圖像的中心。質心配準分為兩步:首先找到目標圖像的質心;然后在圖像中以目標質心為中心切割出更小尺寸的正方形目標區域,這是因為目標區在整個圖像上所占的區域較小,而背景部分對目標識別是不利的。

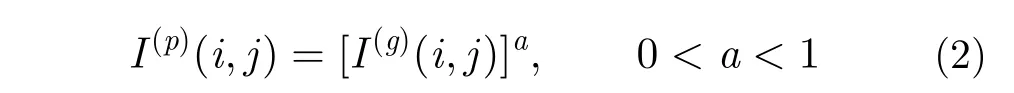

目標到雷達的距離是不同的,SAR在進行數據采集時得到的回波強度也是不同的,反映到SAR圖像上就是目標的灰度值范圍有所不同。經過質心配準后可對SAR圖像進行能量歸一化,將圖像灰度值歸一化到同一范圍內。經過能量歸一化后圖像幅度信息會減弱,可以采用冪變換來增強SAR圖像中有利于鑒別目標的信息。冪變換的過程為:

經過前面的步驟,目標區已經分割出來。本文所需要的目標區特征只是目標區的二值化圖像,因此直接將冪變換增強后的圖像目標區設為1,其余部分設為0,就可以得到目標區特征。

圖3以BMP2的一幅圖像作為實例,展示SAR圖像預處理與特征提取算法的效果,其中圖3(d)–圖3(g)為質心配準時以質心為中心切割出的更小尺寸的正方形目標區域。

2.3 搜索與匹配

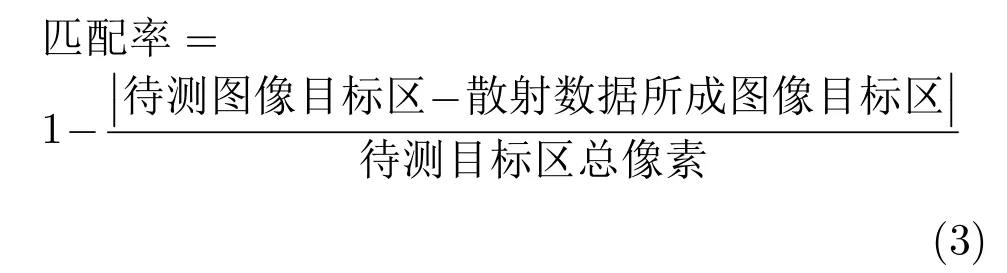

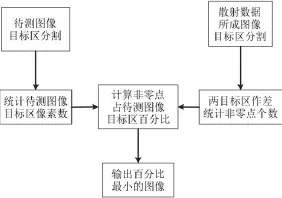

圖像經過預處理和特征提取之后就可以進行搜索匹配,本文使用的搜索匹配算法流程如圖4所示。由圖4可知本文定義的匹配率為:

待測圖像經過預處理和特征提取之后,與目標SAR散射數據所成的圖像進行匹配,搜索出匹配率最高的那幅圖像輸出,可以輸出目標的類型和目標的方位角信息。

3 實驗驗證

3.1 MSTAR數據庫簡介與預處理參數設置

當前用于研究SAR ATR的圖像是美國國防高級研究計劃署(Defense Advanced Research Project Agency,DARPA)和空軍研究室(Air Force Research Laboratory,AFRL)發起的運動與靜止目標獲取與識別(Moving and Stationary Target Acquisition and Recognition,MSTAR)計劃實測獲取的地面靜止目標SAR圖像數據。該數據集利用分辨率為0.3 m×0.3 m的聚束式SAR采集回波數據,得到的地面軍事車輛的HH極化的圖像集。每幅圖像的像素尺寸為128×128。數據庫里包含BMP2、BTR70、T72共3大類7種型號的地物目標。同一大類里面不同型號的目標之間互為變形目標,它們的區別在于軍事配置不同,如同類坦克上有無防護板、油箱,以及天線是否展開等;同類裝甲車上有無炮筒,擋泥板和聚光燈等。考慮到SAR圖像對方位因素十分敏感,故而數據庫對每類目標都采集了大量不同方位的圖像,方位范圍為0°~360°,方位間隔約1°~2°[12]。

圖 4 搜索與匹配算法流程圖Fig. 4 Overall process of search and matching algorithm

對于MSTAR數據庫中SAR圖像采用Weibull分布的雙參數CFAR SAR圖像分割[4]的依據是:

本文中背景雜波被檢測為目標的虛警概率P=0.0075;幾何聚類時,設置的面積閾值為15;質心配準時以質心為中心擴展為60×60像素,即可包含MSTAR數據中的目標;圖像冪變換時a=0.4。

3.2 實測數據驗證

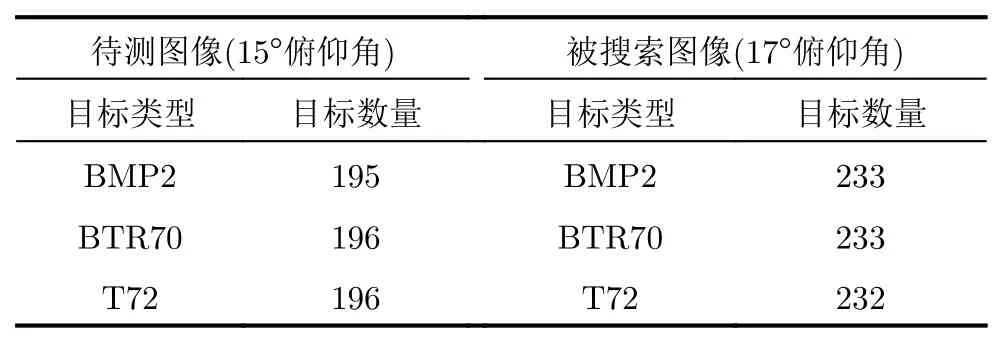

本節采用15°俯仰角時3大類目標包括BMP2、BTR70、T72在內各一種型號的數據作為待測圖像,17°俯仰角時3大類目標包括BMP2、BTR70、T72在內各一種型號的數據作為被搜索圖像。待測圖像和被搜索圖像目標類型和數量如表1所示。

表 1 待測圖像和被搜索圖像目標類型和數量Tab. 1 Target type and quantity for the test images and the images to be searched

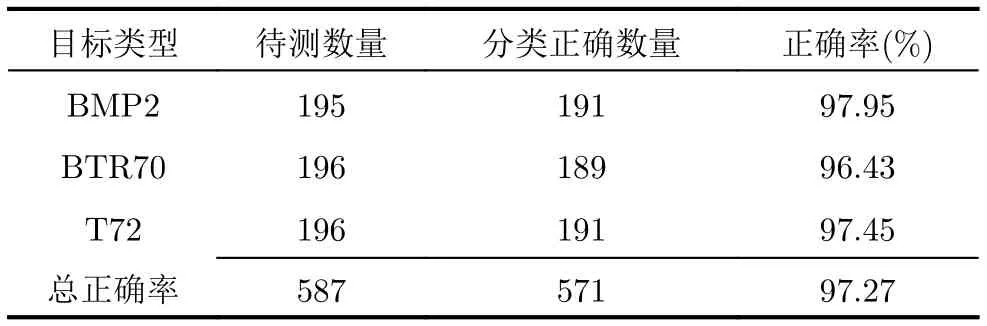

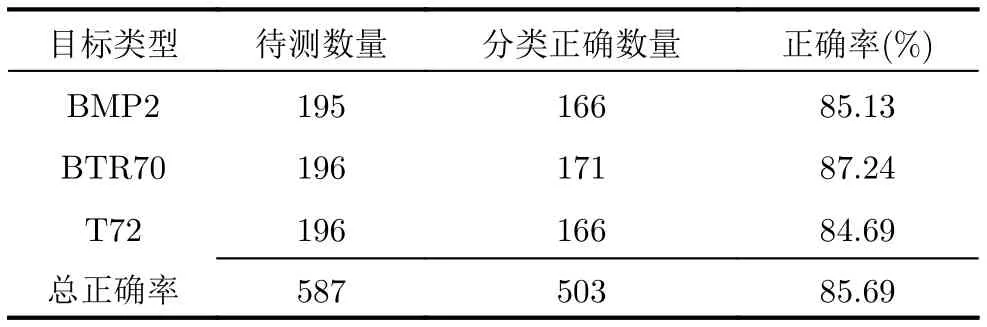

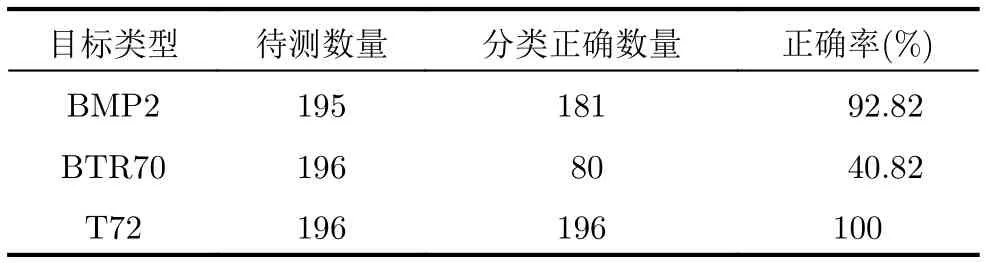

將待測圖像集中的每一幅圖像逐一與被搜索圖像進行搜索匹配,統計目標類型識別的正確率。每一類目標識別的正確率及總的正確率如表2所示。

將待測圖像集中的每一幅圖像逐一與被搜索圖像進行搜索匹配,統計同時滿足目標類型正確識別并且待測目標圖像與搜索得到的目標圖像之間方位角誤差<5°(考慮180°模糊)的比率,數據如表3所示。

表 2 目標識別正確率統計(不考慮方位角誤差)Tab. 2 Target recognition accuracy statistics (Regardless of the azimuth error)

表 3 目標識別正確率統計(考慮方位角誤差)Tab. 3 Target recognition accuracy statistics (Considering the azimuth error)

3.3 仿真數據驗證

基于模型的SAR ATR算法是要實現對于任意一幅實測SAR圖像都能在散射數據庫中找到與之最匹配的目標,獲得待測圖像目標類型、方位角等信息。本節將實測圖像作為待測圖像,與BART計算的散射數據所成圖像進行搜索匹配,驗證本文算法的可行性。

采用BART對BMP2、BTR70、T72模型進行散射模擬。BMP2長寬高為6.72 m×3.15 m×2.45 m,BTR70長寬高為7.53 m×2.80 m×2.32 m,T72長寬高為9.53 m×3.59 m×2.23 m,目標的CAD模型均為真實尺寸。為了使目標仿真環境接近真實場景,仿真時將目標的CAD模型放置在粗糙面場景上。粗糙面場景的參數為:粗糙面場景15 m×15 m,均方根高度1×λ,相關長度0.5×λ。以BTR70為例,圖5展示了BTR70在粗糙面上的CAD模型。

圖 5 BTR70在粗糙面上的CAD模型Fig. 5 The CAD model of BTR70 on rough surface

采用BART對模型進行數值散射模擬。BART計算參數來自MSTAR數據:

(1) 中心頻率9.6 GHz,帶寬0.6 GHz,采樣128個點;

(2) θ=75°(SAR俯仰角為15°);

(3) 中心角度φ=0°,10°,20°,...,140°,145°,150°,155°,160°,170°共20個中心角度,在中心角度–1.79°~1.79°范圍內采樣128個點(方位向和距離向分辨率均為0.3 m)。

計算并存儲3類目標的散射數據,散射數據成像后可以得到60幅仿真圖像。

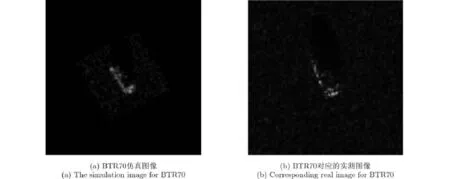

BART仿真得到的散射數據是頻域數據,對其進行逆傅里葉變換即可得到時域圖像。但是直接進行逆傅里葉變換得到的圖像效果不好。本文對散射數據的兩個維度分別進行3次樣條插值后,加Kaiser窗進行濾波,最后做逆傅里葉變換得到圖像。以BTR70為例,散射數據所成圖像如圖6所示。

圖6(a)為BTR70仿真圖像,其方位角為160°,圖6(b)是其對應的實測圖像,其方位角為157.006775°。可以看出仿真圖像和實測圖像是很相似的,可以進行搜索匹配。

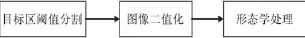

首先進行圖像預處理。需要注意的是如果對仿真圖像采用2.2節所述目標區分割方式,目標區的提取效果不好,因此對于仿真圖像的目標區分割與實測圖像的目標區分割方式略微不同,仿真圖像目標區分割流程如圖7所示。

仿真圖像有較強的旁瓣,但是圖像目標區很明顯,可以直接根據目標區和背景區像素值的分布設定一個經驗閾值令大于該閾值的區域,像素值不變,其余區域均設為某一背景像素值。令每幅圖像像素均值為Ave,經過對60幅散射數據所成圖像統計分析后,對BMP2、BTR70、T72分別設定一個自適應閾值Ttar=Ave/1.7,Ttar=Ave/1.985、 Ttar=Ave/1.4771。大于的區域,像素值不變,其余區域像素值設為–70。以圖6(a)中BTR70為例,經過這一處理之后的圖像如圖8所示。

可以看到經過閾值分割后圖像保留了目標區信息,去除了沒用的背景和旁瓣信息,但是還存在一些小的亮點,需要通過形態學運算來消除。形態學運算是針對二值化圖像的,再對上述圖像進行二值化,這里同樣采取閾值處理的方式,取像素值的最大值為tmax,每一點的像素值為xi,

圖 6 BTR70仿真和實測圖像Fig. 6 The simulation image and corresponding real image for BTR70

圖 7 仿真圖像目標區分割流程圖Fig. 7 Overall process of simulation image target area segmentation

圖 8 仿真圖像目標區閾值分割后圖像Fig. 8 Simulation image after threshold segmentation of target area

圖 9 仿真圖像目標區分割效果圖Fig. 9 Simulation image after target area segmentation

經過目標區分割后的仿真圖像采用2.2節所述的處理方式,對圖像進行質心配準、能量歸一化、圖像冪變換和特征提取,之后就可以進行搜索匹配,算法同第2.3節所述。

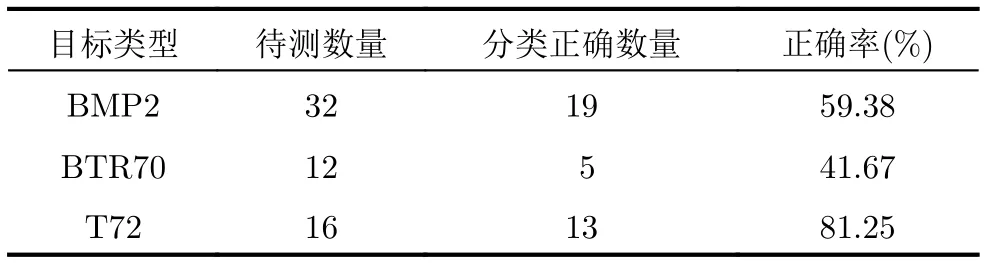

取出3.2節中15°俯仰角下MSTAR數據庫中BMP2、BTR70、T72實測數據作為待測圖像,與散射數據所成圖像進行搜索匹配,統計類型分類正確的概率。統計結果如表4所示。

表 4 目標識別正確率統計(僅考慮類型正確)Tab. 4 Target recognition accuracy statistics (Considering only the correct type)

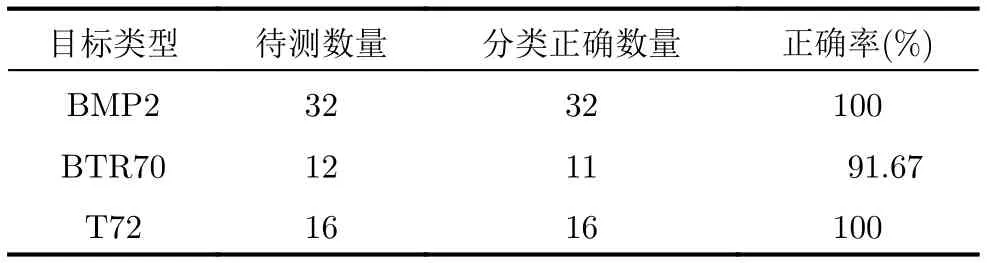

由仿真參數可知,仿真的角度集中在140°~160°,考慮180°模糊,取出上述實測圖像中方位角在140°~160°和320°~340°的實測圖像作為待測圖像,與散射數據所成圖像進行搜索匹配,統計類型分類正確的概率,結果如表5所示。

由表4和表5可知,BMP2和T72的類型識別效果很好,BTR70在角度受限的范圍內類型識別效果很好,但是對于196幅實測數據識別時正確率很低,這是由于BTR70的自適應閾值在140°~160°范圍內對仿真圖像的分割效果較好,而在遠離該角度范圍時,分割效果變差,識別出錯的概率增大。

表 5 目標識別正確率統計(僅考慮類型正確)Tab. 5 Target recognition accuracy statistics (Considering only the correct type)

在表5結果基礎上,統計同時滿足類型分類正確并且待測圖像與搜索得到的圖像之間方位角誤差<10°的比率,結果如表6所示。

由表4~表6可知,T72不僅類型分類正確率高,而且要求待測圖像與搜索得到的圖像之間方位角誤差<10°時的識別效果也很好,可以證明本文提出的算法是有效可行的。

表 6 目標識別正確率統計(考慮方位角誤差)Tab. 6 Target recognition accuracy statistics (Considering the azimuth error)

BMP2類型分類正確率高,但是要求待測圖像與搜索得到的圖像之間方位角誤差<10°時正確率迅速下降。由BMP2和BTR70的識別效果可知,實測數據搜索仿真數據還存在很大困難,CAD仿真模擬的效果對識別率的影響很大,仿真有待進一步完善。

取出BMP2、BTR70和T72中心角度φ=10°,30°,50°,...,150°,170°的散射數據,取出3.2節中15°俯仰角下MSTAR數據庫中BMP2、BTR70、T72實測數據作為待測圖像,與散射數據所成29幅圖像進行搜索匹配,統計類型分類正確的概率。統計結果如表7所示。

對比表4與表7可以看出,仿真的角度越多,仿真數據越充分,待測圖像分類正確的概率越大。

4 結論

基于模型的SAR自動目標識別算法不需要存儲大量的模板,可以部分地解決擴展工作條件下的目標識別問題,是SAR自動目標識別的研究趨勢。本文實現的簡化的基于模型的SAR自動目標識別算法簡單易實現,算法所需時間短,目標分類識別的效果較好,在識別目標類型的同時還可以獲得目標的方位角信息。當然,本文還存在著不足之處,本文考慮擴展工作條件不足,另外對于仿真圖像的搜索很大程度上依賴于仿真圖像的效果,如果仿真效果不好,對識別效果影響很大。后期還需進一步完善仿真,算法流程里還可以考慮在搜索匹配之前加入方位角估計,縮小搜索范圍,提高速度。

[1]張紅,王超,張波,等. 高分辨率SAR 圖像目標識別[M]. 北京:科學出版社,2009: 4–7. Zhang Hong,Wang Chao,Zhang Bo,et al.. High-Resolution SAR Image Target Recognition[M]. Beijing: Science Press,2009: 4–7.

[2]Moreira A,Prats-Iraola P,Younis M,et al.. A tutorial on synthetic aperture radar[J]. IEEE Geoscience and Remote Sensing Magazine,2013,1(1): 6–43.

[3]程肖. 基于散射中心模型的 SAR 圖像自動目標識別[D]. [碩士論文],國防科學技術大學,2009. Cheng Xiao. SAR ATR algorithm based on the scattering center model[D]. [Master dissertation],National University of Defense Technology,2009.

[4]裴季方. 基于鄰域判別嵌入的SAR 自動目標識別研究[D]. [碩士論文],電子科技大學,2013. Pei Ji-fang. SAR ATR research based on neighborhood judging embedded method[D]. [Master dissertation],University of Electronic Science and Technology of China,2013.

[5]Zhou J,Shi Z,Cheng X,et al.. Automatic target recognition of SAR images based on global scattering center model[J]. IEEE Transactions on Geoscience and Remote Sensing,2011,49(10): 3713–3729.

[6]張銳,洪峻,明峰. 基于目標CSAR回波模型的SAR自動目標識別算法[J]. 電子與信息學報,2011,33(1): 27–32. Zhang Rui,Hong Jun,and Ming Feng. SAR ATR algorithm based on the CSAR echo model[J]. Journal of Electronics & Information Technology,2011,33(1): 27–32.

[7]Chiang H C,Moses R L,and Potter L C. Model-based classification of radar images[J]. IEEE Transactions on Information Theory,2000,46(5): 1842–1854.

[8]Jones G and Bhanu B. Recognition of articulated and occluded objects[J]. IEEE Transactions on Pattern Analysisand Machine Intelligence,1999,21(7): 603–613.

[9]Boshra M and Bhanu B. Predicting performance of object recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(9): 956–969.

[10]Xu F and Jin Y Q. Bidirectional analytic ray tracing for fast computation of composite scattering from electric-large target over a randomly rough surface[J]. IEEE Transactions on Antennas and Propagation,2009,57(5): 1495–1505.

[11]Wissinger J,Ristroph R,Diemunsch J R,et al.. MSTAR's extensible search engine and model-based inferencing toolkit[C]. Proceedings SPIE Algorithms for Synthetic Aperture Radar Imagery VI,1999,3721: 554–570.

[12]Ross T D,Worrell S W,Velten V J,et al.. Standard SAR ATR evaluation experiments using the MSTAR public release data set[C]. Proceedings SPIE Algorithms for Synthetic Aperture Radar Imagery V,1998,3370: 566–573.

周 雨(1991–),女,江蘇南京人,復旦大學電磁波信息科學教育部重點實驗室碩士生,研究方向為合成孔徑雷達自動目標識別。

E-mail: 14210720128@fudan.edu.cn

王海鵬(1979–),男,河南遂平人,復旦大學電磁波信息科學教育部重點實驗室副教授,研究方向為雷達系統設計與算法開發、遙感圖像處理與信息獲取、機器學習與目標識別、智能圖像處理等。

E-mail: hpwang@fudan.edu.cn

陳思喆(1990–),男,陜西西安人,復旦大學電磁波信息科學教育部重點實驗室碩士生,研究方向為合成孔徑雷達目標檢測與分類。

E-mail: 13210720083@fudan.edu.cn

SAR Automatic Target Recognition Based on Numerical Scattering Simulation and Model-based Matching

Zhou Yu Wang Hai-peng Chen Si-zhe

(Key Laboratory for Information Science of Electromagnetic Waves,Fudan University,Shanghai 200433,China)

This study proposes a model-based Synthetic Aperture Radar (SAR) automatic target recognition algorithm. Scattering is computed offline using the laboratory-developed Bidirectional Analytic Ray Tracing software and the same system parameter settings as the Moving and Stationary Target Acquisition and Recognition (MSTAR) datasets. SAR images are then created by simulated electromagnetic scattering data. Shape features are extracted from the measured and simulated images,and then,matches are searched. The algorithm is verified using three types of targets from MSTAR data and simulated SAR images,and it is shown that the proposed approach is fast and easy to implement with high accuracy.

Synthetic Aperture Radar (SAR); Automatic Target Recognition (ATR); SAR image simulation; Model-based

1 引言

合成孔徑雷達(Synthetic Aperture Radar,SAR)是一種高分辨率成像雷達,與可見光、紅外等遙感技術相比,可以全天時、全天候成像探測。合成孔徑雷達具有穿透能力,可以監測和偵察隱蔽在植被下的目標[1]。SAR自問世以來已經被廣泛應用于地球科學、氣候變化研究、環境和地球系統監測、海洋資源利用、行星探測、戰場感知偵察等領域,具有極高的民用價值和軍用價值[1–4]。SAR成像時受到系統固有特性的影響,使得其對目標的方位角十分敏感,方位角的變化將會導致差異很大的目標圖像;由于特殊的相干成像機理,合成孔徑雷達圖像存在特有的斑點噪聲,因此SAR圖像與光學圖像在視覺效果上差異很大。目標識別作為SAR應用的一個重要方向,在軍事和民用領域都有廣泛的應用。近年來,SAR分辨率越來越高,傳感器模式增多,工作波段和極化方式越來越多元化,使得SAR圖像中信息爆炸性增長,人工判讀的工作量超出了人工迅速做出判斷的極限,人工判讀帶來的主觀和理解上的錯誤就難以避免。因此,SAR自動目標識別(Automatic Target Recognition,ATR)技術的研究顯得尤為重要[2]。

s: The National Natural Science Foundation of China (61571132,61331020)

TN959

A

2095-283X(2015)-06-0666-08

10.12000/JR15080

10.12000/JR15080.

2015-06-29;改回日期:2015-10-14;網絡出版:2015-11-19

王海鵬 hpwang@fudan.edu.cn

國家自然科學基金(61571132,61331020)

引用格式:周雨,王海鵬,陳思喆. 基于數值散射模擬與模型匹配的SAR自動目標識別研究[J]. 雷達學報,2015,4(6): 666–673.