基于前景檢測的視差優化算法

(桂林電子科技大學信息與通信學院,廣西 桂林 541004)

隨著信息技術的飛速發展,雙目立體視覺已經在很多領域得到了廣泛應用。雙目立體視覺三維測量是基于視差原理,而視差是根據兩特征匹配點的相對位置獲得的。根據采用優化方法的不同,立體匹配算法可以分為局部匹配算法和全局匹配算法。目前,國內的研究現狀是在基于特征的選擇上,以及在匹配的相似度的度量上進行研究,同時針對遮擋的問題、弱紋理問題也進行了討論[1]。在國際上主要是基于顏色分割,進行全局立體匹配,在局部立體匹配方面,在聚合上采用了自適應的權值進行聚合匹配能量,同時也采用多窗體、自適應的支持窗體匹配算法。但是到目前為止,所有的算法都不能完整的反映像素點的真實視差,只能局部的,或多或少的反映真實視差,在實際應用過程中視差圖會有很多無效黑斑區域,本文提出一種基于前景檢測,利用最小二乘法直線擬合的方法,局部優化視差[2]。

1 算法相關

1.1 匹配算法

目前的所有匹配算法都可以歸結為在下面三個方向上進行的創新,即選擇匹配基元、選擇相似度函數和優化算法。目的都是為了盡量減少基元在匹配中的模糊性或奇異性,能盡量找到能反映像素點的真實視差。在文獻[3]中把立體匹配分為4個步驟:匹配代價計算、支持能量聚合、視差計算和優化、視差的精細和評價方法,可以認為目前所有的研究工作都歸納為在這4個步驟之內,任何改進都是針對4個步驟中的其中一個進行的改進和研究,但并不是每一種算法都必須包含這4個步驟,而是只采用其中的個別步驟,例如局部的立體匹配算法就沒有視差優化和視差細化階段,而全局立體匹配算法卻包含了視差優化和視差細化步驟,反而沒有能量聚合步驟。

局部立體匹配算法主要是采用局部優化方法進行視差值估計,局部立體匹配算法有SAD,SSD等算法,與全局立體匹配算法一樣,也是通過能量最小化方法進行視差估計,但是,在能量函數中,只有數據項,而沒有平滑項。主要是利用局部的信息進行能量最優化,所以得到的視差估計是局部最優,而不是全局最優[4]。局部立體匹配算法得到的視差值準確度不是很高,但是其速度比較快,效率比較高,能滿足實時性要求。

全局立體匹配算法主要是采用了全局的優化理論方法估計視差,建立全局能量函數,通過最小化全局能量函數得到最優視差值[5]。主要的算法有圖割、信念傳播、動態規劃等算法。全局立體匹配算法是通過能量最小化方法進行視差估計,在其建立的能量函數中,除了數據項之外,還有平滑項。數據項主要是測量像素之間的相似性問題,而平滑項是平滑像素之間的視差關系,保證相鄰像素之間視差的平滑性[6]。全局立體匹配算法得到的結果比較準確,但是其運行時間比較長,不適合實時運行。

1.2 雙目視覺原理

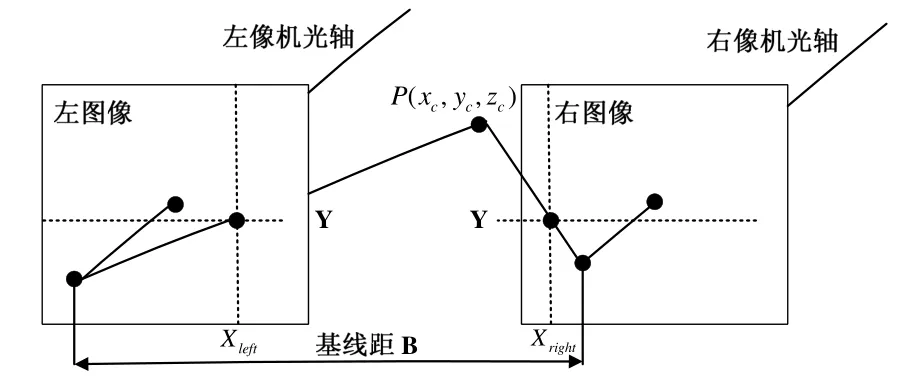

雙目立體成像原理圖如圖1所示:

圖1 雙目立體成像原理圖

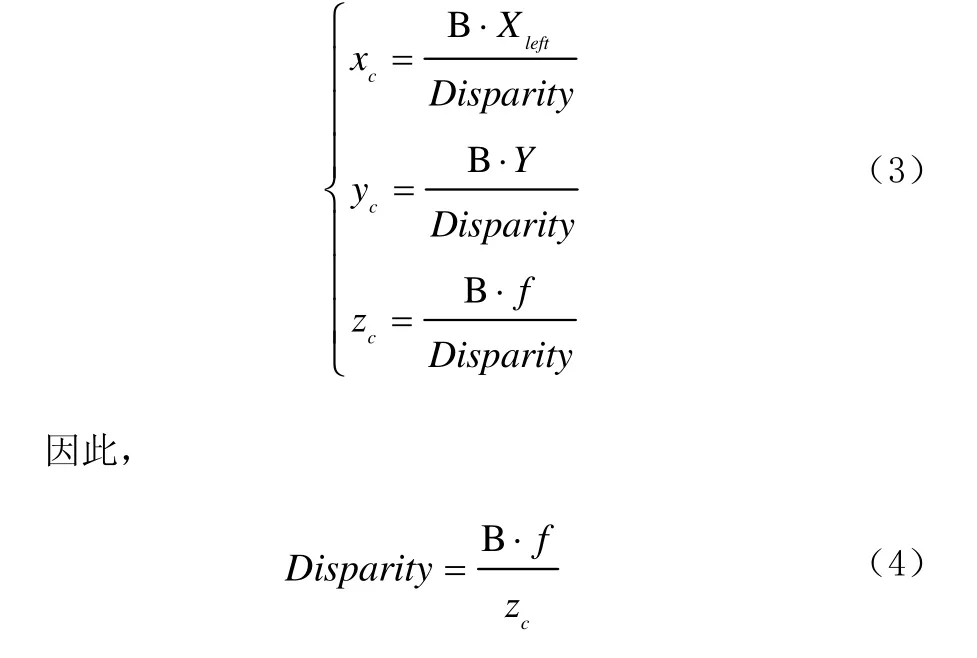

其中基線距B為兩攝像機的投影中心連線的距離;相機焦距為f。設兩攝像機在同一時刻觀看空間物體的同一特征點分別在“左眼”和“右眼”上獲取了點P的圖像,它們的圖像坐標分別為現兩攝像機的圖像在同一個平面上,則特征點P的圖像坐標Y坐標相同,即則由三角幾何關系得到:

則視差為:

由此可計算出特征點P在相機坐標系下的三維坐標為:

左相機像面上的任意一點只要能在右相機像面上找到對應的匹配點,就可以確定出該點的三維坐標[7]。這種方法是完全的點對點運算,像面上所有點只要存在相應的匹配點,就可以參與上述運算,從而獲取其對應的三維坐標。

2 算法實現

本文提出的基于前景檢測的視差優化算法,是在前景區域內,按行檢測出有效視差和無效視差,并記錄存取,有效視差作為最小二乘法的已知條件,對無效視差部分進行直線擬合,而有效視差保持不變,達到整個目標物體區域有完整的視差圖,并分離出這區域的視差圖。算法的實現分為兩部分,分別是前景區域提取和最小二乘法優化視差。

2.1 前景區域提取

前景檢測主要分為:幀差法、平均背景法、光流法、前景建模法、背景非參數估計、背景建模法等。背景差分法具有簡單,運動速度快,對緩慢變換的光照不是很敏感等優點,但同時也會有空洞等缺點。基于實時性考慮,本文采用的幀差法是背景相減法中的一種,幀差法的基本原理就是將前后兩幀或者當前幀與固定背景幀圖像的對應像素點的灰度值相減,得到幀差灰度圖[8]。如果對應像素灰度相差很大就可以認為此處景物為前景。針對幀差法會產生空洞的缺點,以及更好的提取前景物體,本文將得到的幀差灰度圖二值化后,利用形態學的取最大連通域法進行處理,能很大程度的去除空洞現象,得到感興趣區域二值化前景圖,最后用淹模法(mask)摳出目標物體。

2.2 最小二乘法優化視差

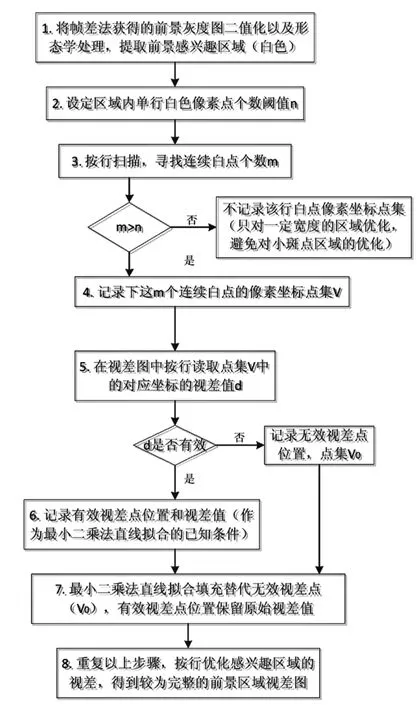

圖2 算法實現流程圖

本文提出的視差優化算法是在傳統匹配算法計算得出視差圖的基礎上,在前景區域內利用最小二乘法直線擬合對前景區域內的無效視差進行優化,得到一個比較完整的前景區域視差圖,由于在特定應用中我們并不是對所有的區域感興趣,因而其他不感興趣區域的視差好壞我們并不關心。

算法實現過程流程框圖如圖2所示。

視差的生成是以左視圖為基匹配的,所以視差圖的像素點和左視圖有一一對應的關系[9],在左視圖中進行前景檢測生成二值化前景圖,然后進行掩模處理,摳出前景區域。這樣,左視圖、視差圖和前景圖三幅圖的像素點坐標都是以一一對應的關系。把前景區域對應的像素點集合作為感興趣區域,那么左視圖、視差圖以及前景圖中的感興趣區域是一樣的;對視差圖的感興趣區域利用最小二乘法直線擬合實現對前景區域的視差優化,呈現較為完整的前景視差圖。

算法說明:算法中第2、3、4步為算法前半段,按行掃描二值化前景區域,記錄連續不間斷白色像素點數大于n(閾值)的所有連續點的像素坐標,得坐標集 V。這部分是對前景圖進行處理,獲取感興趣區域的像素坐標集V,其中V只是記錄下感興趣區域的各個像素的坐標值,由于左視圖、視差圖以及前景圖中的感興趣區域是一樣的,所以V也是一樣的。

2.3 算法優缺點

該算法是針對前景區域的局部視差優化算法,其優缺點明顯,該算法的優點:算法相對簡單,運算復雜度底;能克服紋理性差等因素造成的影響,生成完整的感興趣區域視差;算法只對視差進行優化,對前面的匹配等過程不造成影響;對三維點云有間接優化作用,生成更多有效的三維點,有助于三維重建與三維測距。

算法的缺點:適用場合有限;算法存在一定的誤差,不滿足高精度要求;會增加有效視差圖生成的時間復雜度。

3 實驗結果與分析

實驗過程可以分為兩部分:第一部分,感興趣區域提取,即前景檢測和提取;第二部分,基于感興趣區域的視差優化。

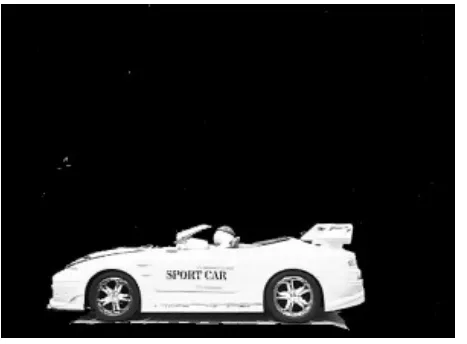

前景區域提取實驗圖如圖2(a)、2(b)所示,利用幀差法獲得前景二值化圖,接著對二值化圖采用形態學最大連通域法有效去除黑斑,最后利用淹模法獲得前景真實像素圖。

圖2(a) 前景提取效果圖

圖2(b) 前景提取效果圖

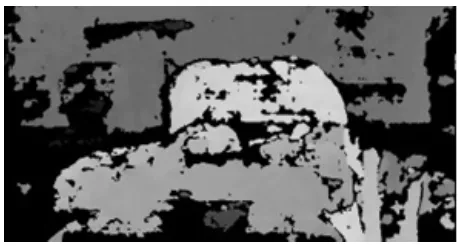

圖3(a) 沒優化效果圖

圖3(b) 優化后效果圖

在獲得感興趣區域后(如圖 2(b)所示),利用本文提出的基于前景的視差優化算法,對視差圖進行優化,得到較為完整的感興趣區域視差圖,其他非感興趣區域不處理,如圖3(b)所示。作為對比,圖3(a)為沒有采用本文提出的基于前景檢測的視差優化算法,生成的視差圖。對比可以明顯看出本文提出的算法在視差優化方面顯著的效果。

[1]章毓晉.圖像工程[M].北京:清華大學出版社, 2006.

[2]伊傳歷,劉冬梅,宋建中.改進的基于圖像分割的立體匹配算法[J].計算機工程. 2008.

[3]Daniel Scharstein, Richard Szeliski. A taxonomy and evaluation of dense two-frame stereo correspondence algorithms[J].International Journal of Computer Vision,2002, 47(1/2/3): 7-42.

[4]Boykow Y, Kolmogorov V. An experimental comparison of min-cut/max-flow algorithms for energy minimization in vision [J].IEEE Transaction on Pattern Analysis and Machine Intelligence, 2004, 26(9): 1124-1137.

[5]Bleyer M, Gelautz M. A layered stereo algorithm using segmentation and global visibility constraions[J].ISPRS Journal of Photogrammetry and Remote Sensing,2005,59(3): 128-150.

[6]Bleyer M, Gelautz M. Graph-cut-based stereo matching using image segmentation with symmetrical treatment of occlusions[J].Signal Processing Image Communication. 2007,22(2): 127-143.

[7]Asmaa Hosni, Michael Bleyer, Margrit Gelautz, Christoph Rhemann. Local stereo matching using geodesic support weights-In international conference on image processing[J]2009. TR-188-2-2009-08.

[8]Qingxiong Yang, Liang Wang, Ruigang Yang, Henrik Stewenius,and David Nister, Stereo Matching with Color-Weighted Correlation, Hierarchical Belief Propagation, and Occlusion Handling, In IEEE Transactions on Pattern Analysis and Machine Intelligence[J].2009Vol.31,No.3, 492-504.

[9]Xiaoyong Lin, Yu Liu and Wenzhan Dai. Study of Occlusions Problem in Stereo Vision. In IEEE Proceedings of the 7th World Congress on Intelligent Control and Automation. [C].2008, 5062-5067.