基于PCNN和非線性濾波萬有引力的醫學圖像融合

劉雯敏,陳秀宏

江南大學 數字媒體學院,江蘇 無錫 214122

基于PCNN和非線性濾波萬有引力的醫學圖像融合

劉雯敏,陳秀宏

江南大學 數字媒體學院,江蘇 無錫 214122

1 引言

圖像融合技術[1]是通過多個成像方式不同的傳感器采集到關于同一個具體目標或場景的圖像信息,然后按照一定的規則加以綜合處理,生成一個新的信息量更大、對周圍環境適應性更高的解釋。這個解釋是從單一傳感器獲取的信息中無法得到的,是對目標或場景的描述更加準確、可靠和全面的圖像。目前,圖像融合技術在計算機視覺、遙感技術、軍事應用以及醫學圖像處理等領域都表現出巨大的應用潛力。特別是當今醫學成像已經成為現代醫療診斷不可或缺的一部分,迫切需要高質量的醫學圖像融合方法將有效的信息進行融合。

近年來國內外常見的醫學圖像融合方法有加權平均、局域方差、基于多分辨率塔式融合算法和神經網絡方法[2-4]等。其中,基于小波變換的多分辨率融合算法應用最為廣泛,但該方法存在丟失某些微弱細節信息等不足,在處理大量的醫學圖像數據時計算復雜、實時性差。針對這一問題,本文采用提升小波變換對醫學圖像進行處理。提升小波變換能夠降低運算的復雜程度、減少存儲器開銷和提高運算速度,從而降低了醫學圖像融合過程的難度。為了使融合圖像反映出更加真實完整的信息,本文將提升小波變換和符合生物視覺特性的脈沖耦合神經網絡[5](Pulse Coupled Neural Networks,PCNN)相結合,并將圖像像素非線性濾波的萬有引力定義為PCNN的鏈接強度,使得鏈接強度的大小能夠根據圖像自適應調整,保留更多的細節信息。實驗結果表明,該方法能夠更加有效地保留源圖像中的邊緣及細節信息,提高了醫學圖像的融合質量。

2 理論基礎

2.1 提升小波變換

傳統的小波變換是在歐氏空間內通過基底的平移和伸縮構造小波基的,不適合于非歐氏空間的應用,因此小波提升方案應運而生。1995年Sweldens等人提出了一種區別于小波變換,不依賴于傅里葉變換的新的小波構造方法——提升格式[6](Lifting Scheme),稱之為第二代小波變換,它在保持第一代小波特性的基礎上克服了其平移和伸縮的不變性,同時提供了一種快速的實現方式,使小波變換的運算復雜度降低一半,提高了運算速度。提升的實現形式給出了小波完全的空間域解釋,可以在原有小波的基礎上構造出更有效地適用于特殊應用的小波。它從另一個角度給小波的構造和性質作出了解答。同時它也把數值分析領域的“細分插值”、“均值插值”、“高階矩”、“歐拉算法”等概念和小波分析的“消失矩”、“尺度函數”、“小波函數”等概念巧妙地融合為一體。

提升算法給出了雙正交小波簡單而有效的構造方法,使用了基本的多項式插補來獲取信號的高頻分量,然后通過“保持原信號的均值和高階矩不變”的限制條件來獲取信號的低頻分量。提升算法的基本思想是,將現有的小波濾波器分解成基本的構造模塊,分步驟完成小波變換。

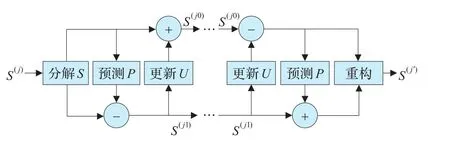

提升方案把第一代小波變換過程分為以下三個步驟[6-7]:分裂(Split)、預測(Predict)和更新(Update)。

(1)分裂:將原始數集S(j)={s(kj),k∈Z}(j=0,1,…,N為分裂層次)分為兩個較小子集,最簡單的分裂方法就是輸入信號根據奇偶性分為兩組。分別為偶數樣本集 S(j0)={,k∈Z}和奇數樣本集 S(j1)={,k∈Z},即 split(S(j))=(S(j0),S(j1))。這個過程稱為懶小波(Lazy Wavelet)變換。

(2)預測:在這個階段,保持偶數樣本S(j0)不變,在基于原始數據相關性的基礎上,利用偶數樣本S(j0)來對奇數樣本S(j1)做出預測,即將濾波器P對偶數樣本作用后作為奇樣本的預測值,用奇樣本的實際值與預測值P(S(j0))相減得到殘差信號(又可稱為細節系數)來代替奇數樣本S(j1),即令S(j1)=S(j1)-P(S(j0)),其中 P為預測算子。這一差值反映了兩者之間的逼近程度,稱之為細節系數或者小波系數,對應于原始信號S(j)的高頻部分。一般來說,數據的相關性越強,小波系數的幅值就越小,預測就越準確。

(3)更新:經過分裂步驟后產生子集的某些特征可能與原始數據并不一致,更新操作的思想就是要找到一個更好的子數據集S(j-1),使它能夠保持原始數據集S(j)的某些特性。可以利用已經計算好的小波系數S(j1),構造算子U,作用在S(j1)上并疊加到偶數樣本S(j0)上,從而得到更新后的近似信號,即:S(j0)=S(j0)+U(S(j1))。

P和U取不同的函數,可構造出不同的小波變換。

經過小波提升,可將樣本 S(j)分解為低頻部分S(j0)和高頻部分S(j1);對于低頻數據子集S(j0)可以再進行相同的分裂、預測和更新,把S(j0)進一步分解為S(j-1,0)和S(j-1,1);…;如此下去,經過n次分解后,原始數據S(j)的提升小波表示為{S(j-n,0),S(j-n,1),S(j-n+1,1),…,S(j-1,1)}。其中S(j-n,0)表示信號的低頻部分,而{S(j-n,1),S(j-n+1,1),…, S(j-1,1)}則是信號從低到高的高頻部分系列[7-9]。

由于圖像的小波提升是一個完全可逆的過程,反變換與正變換運算相反并且結構對稱,可以實現精確的重構。重構過程是分解過程的逆步驟,三個步驟分別為:

(1)反更新:S(j0)=S(j0)-U(S(j1))。

(2)反預測:S(j1)=S(j1)+P(S(j0))。

(3)合并:把偶數樣本S(j0)和奇數樣本S(j1)合并成新的數據集S(j),即S(j)=merge(S(j0),S(j1))。

提升算法的分解和重構過程如圖1所示。

圖1 提升算法的分解和重構過程

2.2 脈沖耦合神經網絡(PCNN)

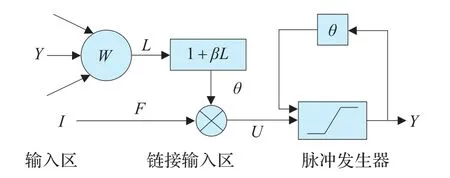

脈沖耦合神經網絡是由若干個神經元相互鏈接所構成的反饋型神經網絡,每個神經元由三個功能單元構成:反饋輸入域、耦合鏈接輸入域和脈沖發生器。Eckhorn神經元模型[5]參數較多,在具體應用中參數的設定十分麻煩。也缺乏誘異激發所指的同步振蕩的明確描述,就是說在圖像分析時,缺乏灰度值相近的相鄰(像素對應)神經元產生同步振蕩脈沖輸出所構成的相似像素集群概念的清晰數學描述,導致類似研究成果的分析比較困難。為此,眾多文獻對Eckhorn神經元模型做了種種改進,得到許多改進的神經元模型[10-12]。文獻[12]中修正后的模型簡潔直觀,如圖2所示。因此,本文在進行醫學圖像融合時就采用這個簡化的PCNN模型。

圖2 脈沖耦合神經元的簡化模型

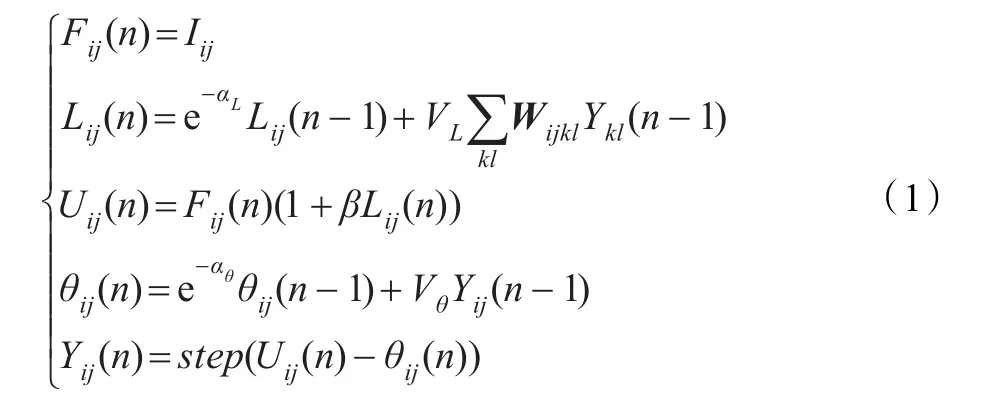

PCNN模型在用于圖像處理時是一個單層二維并且橫向連接的神經網絡,網絡中的神經元是與圖像中的像素點一一對應的,即圖像中任意像素點(i,j)對應在PCNN中神經元的位置也為(i,j)。神經元Nij經過n次迭代的數學表達式如下:

其中,i,j表示像素在圖像矩陣中的位置;Iij為外部刺激輸入,圖像處理時為對應點像素的灰度值;n為迭代次數;Uij、Yij分別為神經元的內部狀態信號和外部輸出;Lij、Fij分別為鏈接輸入和反饋輸入;β為鏈接強度;Wijkl為鏈接權值矩陣;αL、αθ和θij分別為衰減時間常數和動態門限;VL、Vθ分別為鏈接輸入和動態門限的放大系數。

在上述模型中,首先接收域接收到外部的輸入刺激Iij;在接受輸入后調制部分就利用周圍神經元的耦合鏈接Lij和鏈接強度 β,來確定神經元耦合關系的強弱并對接收部分的信號進行調制,來確定神經元耦合關系的強弱并對接收部分的信號進行調制,則產生神經元內部活動信號Uij;之后Uij與此時脈沖發生器產生的動態閾值θij做比較,便可產生此刻的輸出信號Yij。如果Uij>θij,則Yij=1,稱為神經元點火,點火成功則輸出一個脈沖;如果Uij≤θij,則Yij=0,沒有點火則不輸出脈沖。若神經元點火成功有脈沖輸出,則其動態閾值就會突然增加,又因為閾值突然增大使第二次不可能再次點火成功而產生脈沖輸出,于是之后閾值又開始呈指數衰減,直到閾值衰減到小于其內部活動項時,脈沖又再次產生,如此不斷地周而復始直至達到迭代次數n。

式(1)中描述的PCNN模型有很多參數,這些參數的設定對圖像處理的結果也有很大的影響,但在理論上其參數的設定與圖像處理結果之間的機理還不十分清楚。因此參數設定一直是PCNN應用的一個難題。大多數情況下,這些參數的設定都是根據具體的應用環境通過多次實驗的方法確定的,近年也出現了一些PCNN參數自動設定方法的相關研究[13-14]。

(1)VL和Vθ分別為PCNN鏈接輸入和動態門限的放大系數,VL對周圍神經元的耦合輸入進行比例限制,通常取值為1。Vθ對神經元的點火周期起著重要的調節作用,它決定了神經元點火時刻閾值將被提升的程度。通常Vθ取值較大[8],本文中取Vθ=25。

(2)αL和αθ分別為鏈接輸入和動態門限的衰減時間常數,αθ控制著動態門限下降的速度,αθ越大,動態門限下降越慢,PCNN模型運行時間越長;反之,動態門限下降越快,模型運行時間越短。通常這兩個參數都是根據經驗值再結合具體應用多次實驗設定的,本文中通過多次實驗取αL=0.2,αθ=0.2。

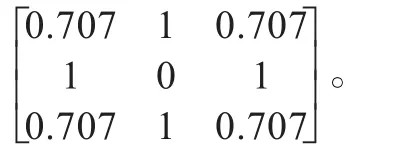

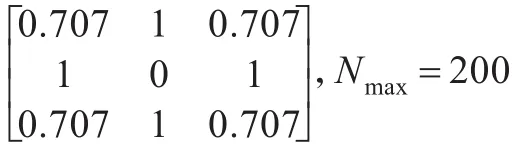

(3)Wijkl為鏈接權值矩陣,表示了中心神經元受周圍神經元影響的大小,反映鄰近神經元對中心神經元傳遞信息的強弱。Wijkl有多種取值方式,本文中用到的取值方式為歐幾里德距離的倒數,在3×3的區域則有W=

(4)β為鏈接強度系數,調節著周圍神經元之間的相互影響,同時影響中心神經元點火周期,較大的鏈接系數能引起較大范圍的脈沖同步。鏈接強度系數通常都是根據經驗和多次實驗手工設定的固定值,大多數情況下 β是一個在[0,1]區間上的常數。本文中為了提高醫學圖像融合的質量,并增強PCNN的自適應能力,鏈接強度系數β并不設定為一個常數,而設置為一個動態變化的參數。

2.3 基于非線性濾波的萬有引力

萬有引力定律是經典物理學中的一個定義,它描述了宇宙中任何兩個物體間都存在著相互吸引力,有其中任一物體所受到的引力大小與兩個物體質量的乘積成正比,與兩物體之間距離的平方成反比,可用式(2)表示:

其中,m1,m2分別為兩物體的質量,G為萬有引力常量,||r||為兩物體之間的距離。

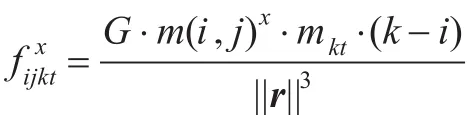

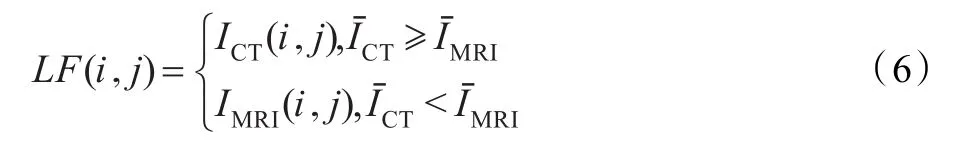

Sun等人[15]將這一經典的物理概念運用到圖像處理中,將圖像中的每個像素點都看作為宇宙中的一個物體,并認為每兩個像素點之間都存在引力,這樣一幅圖像就可以被理解為一個由許多物體組成的網格結構。為了方便處理,在簡化模型中規定引力的作用范圍是中心像素點3×3或5×5的鄰域內,在鄰域外的點對中心像素點的萬有引力則忽略不計。其中,每一對水平或豎直方向鄰接的像素間的距離為1,像素的質量取其對應的灰度值。如式(2)中所示,引力用向量表示,即兩個像素點之間的萬有引力為 f,窗口內所有其他像素點對中心像素點的引力合力為F。對圖像的每一個像素點,首先計算它的領域內其他像素點對它的引力 f,然后合并所有的 f,得到這個像素點在領域內所受的水平方向和垂直方向的合力Fx和Fy,最后得到總合力的大小為||F||=。文獻[15]將這個合力運用到邊緣檢測中,通過設置一個閾值,合力大于閾值的即為邊緣點,否則為非邊緣點。這個方法大膽新穎,并在邊緣檢測上取得了很好的效果。但是檢測到的邊緣較寬,并且嚴重依賴圖像的灰度值。

文獻[16]就在此基礎上進行了改進,提出了基于非線性濾波的萬有引力邊緣檢測方法。對圖像中任一像素點(i,j),其灰度值為 I(i,j),則基于非線性濾波的萬有引力方法如下:

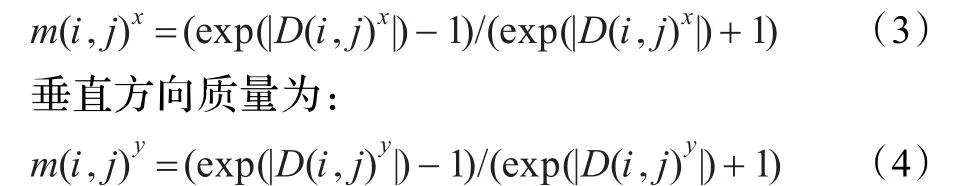

(1)計算其水平方向質量為:

其中,引入了一個非線性梯度的概念,D(i,j)x=+ D(i,j)-x為像素點的水平梯度,而 D(i,j)+x=T(I(i,j)-I(i-1,j))和 D(i,j)-x=-T(-(I(i+1,j)-I(i,j)))分別為水平梯度的左右梯度信息;D(i,j)y=D(i,j)+y+D(i,j)-y為垂 直 梯度,D(i,j)+y=T(I(i,j)-I(i,j-1))和 D(i,j)-y= -T(-(I(i,j+1)-I(i,j)))分別為垂直梯度的左右梯度信息;非線性算子T是一個簡單的閾值,如果X≥0,T(X)= X;否則T(X)=0。

這個梯度不僅定位準確,而且有一定的平滑噪聲的能力,所以構造以這個梯度為自變量的函數,替代中心像素點的灰度值,作為萬有引力中心物體的質量。這個函數需要滿足下列特性:當像素點梯度為零時,函數值為零;函數值隨梯度值增加而增加;當梯度值趨向無限大時,函數值趨近于1。所以構造出了求質量的式(3)和(4)。

(4)計算中心像素點I(i,j)所受總合力大小及方向。大小為||Fij||=;方向為θ=arctan()。

在文獻中使用到非線性濾波的萬有引力來與閾值比較,從而判斷圖像中的某一點是否為邊緣點,該方法具有很好的圖像邊緣定位能力[16],能夠高質量地反映出圖像中微小細節的反差和邊緣化的程度。鑒于這個優點,于是本文中就引入這一概念和方法,通過該方法求出圖像中每個像素的非線性濾波萬有引力,并構成矩陣B。將矩陣B歸一化后作為鏈接強度系數輸入到耦合神經網絡中,作為中心神經元調節與周圍神經元之間關系的一個依據。

3 基于PCNN和非線性濾波萬有引力的圖像融合方法

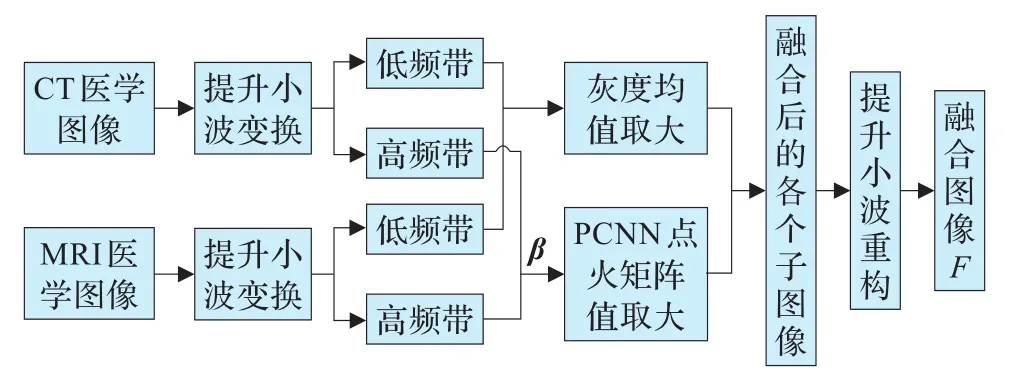

在提升小波變換的基礎上,并且結合耦合神經網絡和像素點非線性濾波的萬有引力,本文中的醫學圖像融合過程如下:

(1)將已精確配準的CT和MRI圖像分別進行N層提升小波分解,得到1個低頻分量和3N個高頻分量,則原圖像CT和MRI經過N層提升小波分解得到的低頻分量為 LCT和 LMRI,高頻分量為和(k=1,2,…,3N)。

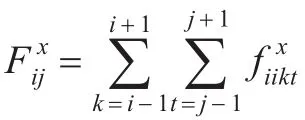

(2)低頻系數的融合規則。由于低頻分量(L)代表圖像的近似特征和緩變的區域信息,特別是在醫學圖像中能夠對病灶的定位起到重要的作用。因此采用區域灰度均值作為判斷的標準。窗口寬度為n×n的局部灰度均值定義為:

其中I(i,j)為像素點(i,j)的灰度值,w是窗口范圍。從而得低頻部分融合后圖像像素點灰度值LF(i,j)為:

(3)高頻系數的融合規則。高頻分量(H)代表的是圖像邊緣等突變的細節信息,對最后融合圖像的邊緣細節信息有決定性的作用,因此將PCNN和利于保留像素邊緣的非線性濾波萬有引力方法相結合作為高頻分量的融合規則。

簡化PCNN模型的關鍵點就在于鏈接強度β上,以往使用PCNN進行圖像處理時,都是根據經驗或大量實驗設定β為一個固定的數值,這樣的方法就缺少自適應性,無法獲得微小的細節信息。由人眼的視覺系統對圖像的邊緣信息以及微小的細節信息較為敏感的特性可知,脈沖耦合神經網絡中神經元的鏈接強度也應該是與圖像的邊緣細節信息有關的。因此,本文考慮到利用像素點的非線性濾波萬有引力來對鏈接系數進行動態調整,即有 β=B,使網絡中的神經元有不同的鏈接強度。像素點的非線性濾波萬有引力較大,對應神經元的鏈接強度就較大,該像素點對應的神經元被捕獲點火就越早。就可以根據圖像領域大小內其他像素點對中心像素的非線性濾波萬有引力的變化來自適應調整PCNN的鏈接強度,使融合結果更加符合人類視覺的特點,就更有利于提高圖像的融合效果。

③設置PCNN中各參數的初始值,如放大系數、衰減時間常數和鏈接權值矩陣等。

④采用式(1)計算各個中間結果,完成N次迭代的過程。最后輸出兩個點火矩陣和。

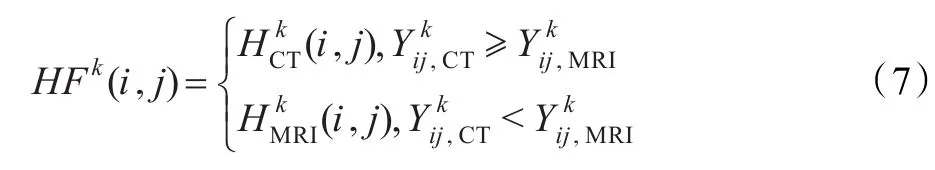

⑤最后由下式得到高頻子系數的融合結果HF,

(4)對融合后的子系數LF和HFk(k=1,2,…,3N)進行提升小波逆變換,得到最終的融合圖像F。

上述融合過程如圖3所示。

圖3 融合算法流程圖

4 評價指標

醫學圖像的融合目的一方面是提高信息量,并保留圖像的邊緣等細節信息以加強圖像的視覺效果。另一方面,醫學圖像融合的結果需要與原圖像保持最大的一致,同時保持與兩幅待融合圖像最大的相關性。基于以上原因在圖像融合現有的評價指標中選取下列指標對融合效果進行評價[17]。

4.1 信息熵

圖像的信息熵的含義為圖像的平均信息量,而信息量的增加是圖像融合的最基本要求。因此信息熵是衡量融合圖像信息豐富程度的一個重要指標,體現了融合圖像的細節表達能力。融合圖像的熵值越大,就表明圖像攜帶的信息量越大,包含的信息越豐富,圖像的表達能力越好。信息熵定義為:

其中,L為圖像的總灰度級數,Pi為圖像中灰度級數為i的像素出現的概率。

4.2 均值

均值是圖像中所有像素的灰度的平均值,反映了融合圖像的平均亮度。最后得到的融合圖像的均值適中則該融合圖像的視覺效果好。

其中,圖像大小為m×n,I(i,j)為像素點(i,j)的灰度值。

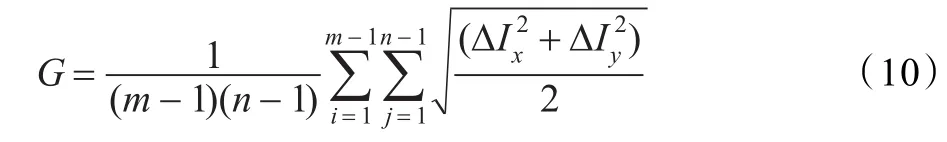

4.3 平均梯度

融合圖像質量的改進可以用平均梯度來表示,因為圖像的平均梯度反映的是圖像的清晰度,同時還反映出圖像中微小細節反差和紋理變換特征。融合圖像的平均梯度越大,就表示圖像的成像越清晰。圖像的平均梯度定義為:

其中,圖像大小為 m×n,ΔIx=I(i,j)-I(i+1,j),ΔIy= I(i,j)-I(i,j+1)分別為像素值(i,j)在x/y方向上的一階差分。

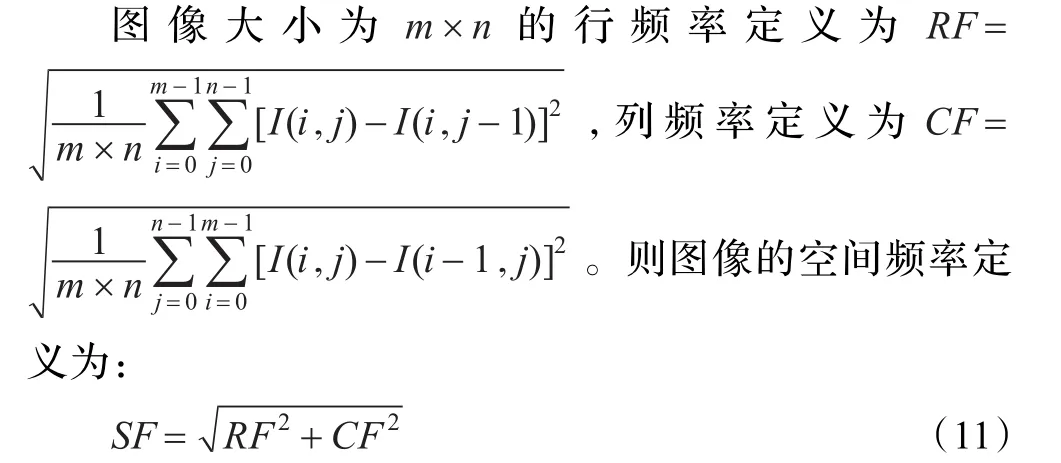

4.4 空間頻率

圖像的空間頻率[18]是反映圖像空間域的總體活躍度。融合圖像的空間頻率越大,則其總體活躍度越高,融合圖像的效果就越好。

4.5 邊緣保持度

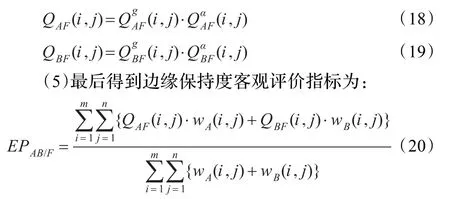

圖像的邊緣保持度可以衡量融合圖像對輸入的源圖像中的邊緣信息的保持程度[19]。該方法在對源圖像和融合圖像進行邊緣提取的基礎上,計算邊緣信息的保持量,將加權的邊緣信息保存量作為評價融合結果的衡量指標,邊緣保持度越大,說明融合圖像保留的源圖像的邊緣信息越多。邊緣保持度的具體求解步驟如下:

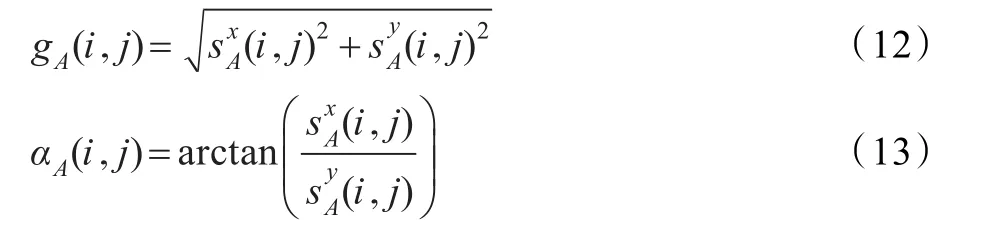

(1)計算源圖像IA、IB以及融合圖像IF的梯度幅值和相角,以計算IA的為例:

式中,sAx(i,j)和 sAy(i,j)分別為應用Sobel算子對圖像IA進行橫向和縱向濾波的結果。

(2)計算 IA與 IF、IB與 IF的相對幅值GAF(i,j)、GBF(i,j)和相角 AAF(i,j)、ABF(i,j)。以計算GAF(i,j)和AAF(i,j)為例。

(4)計算各像素邊緣信息的保留程度:

式中,圖像大小為 m×n,wA(i,j)=|gA(i,j)|L,wB(i,j)= |gB(i,j)|L。L為常數,本文中取1。

5 實驗與結果分析

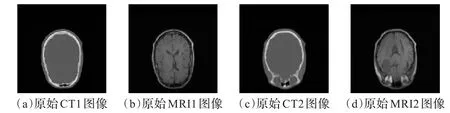

實驗采用兩組CT和MRI醫學圖像進行融合,兩組源圖像來自人體腦部的不同橫斷面。數據的源圖像都來自同一個人、同一生理部位的不同成像設備,空間位置和解剖結構都是精確對準的。源圖像如圖4所示。

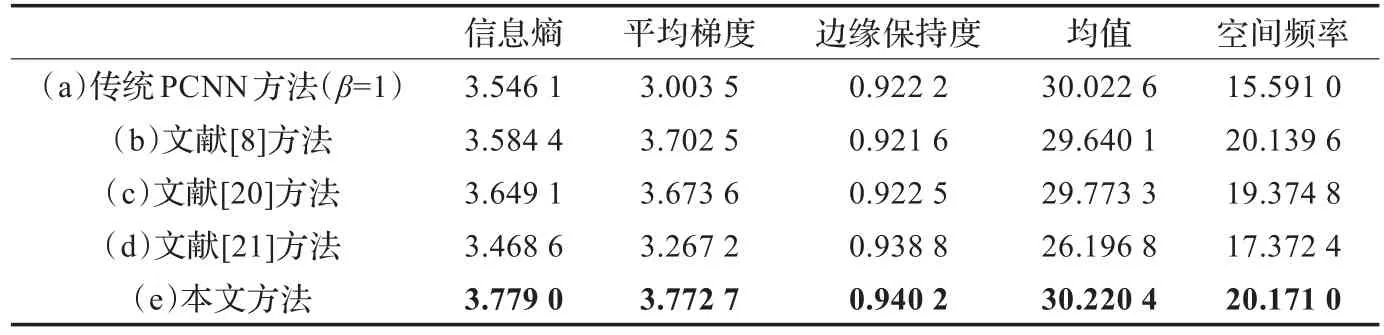

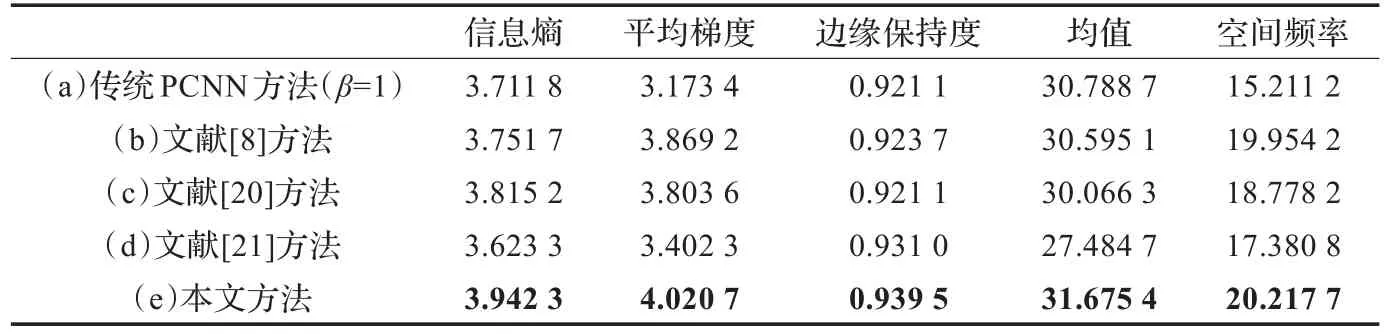

為了更加客觀定量評價融合效果,本文采用信息熵、平均梯度、邊緣保持度、均值和空間頻率作為融合結果的評價參數。其中信息熵反映了圖像信息的豐富程度;平均梯度反映了圖像的清晰度;邊緣保持度用于衡量融合圖像對輸入圖像中的邊緣信息的保持程度;均值反映了圖像的平均亮度;空間頻率則反映了圖像空間域的總體活躍度。這些參數均是越大,融合圖像的效果越好。比較結果如表1和表2所示。

圖4 兩組源圖像

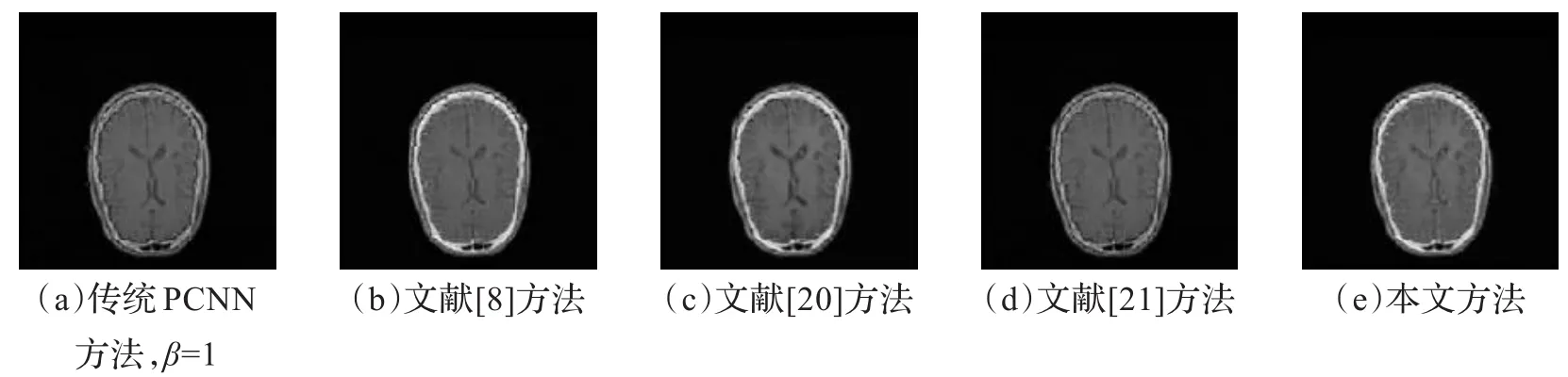

圖5 CT1與MRI1各方法融合結果比較

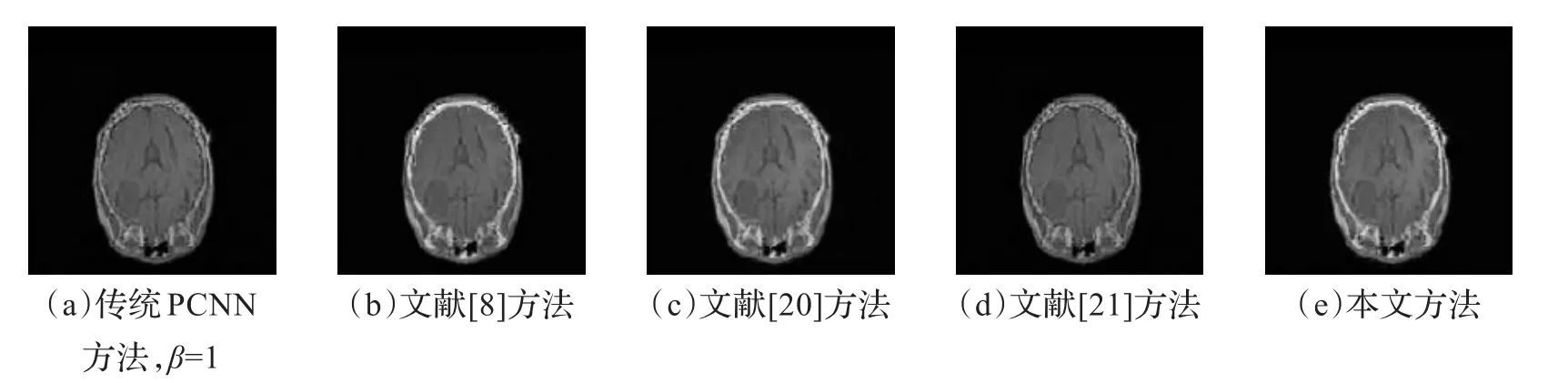

圖6 CT2與MRI2各方法融合結果比較

表1 圖5中各個融合結果的評價參數

表2 圖6中各個融合結果的評價參數

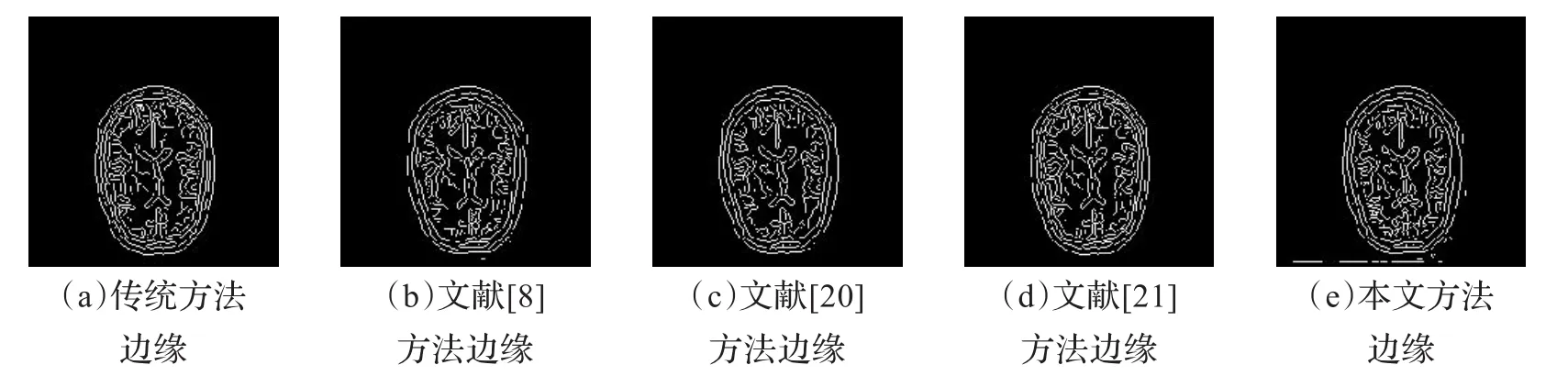

圖7 CT1與MRI1各方法融合結果邊緣提取圖

圖8 CT2與MRI2各方法融合結果邊緣提取圖

由表1和表2可知,這些融合方法都取得了不錯的融合效果,其中,傳統的融合方法參數相較之下均值較大,即有較好的視覺效果;文獻[8]的方法空間頻率較高;文獻[20]的方法信息熵較高,包含的信息較豐富;文獻[21]的方法則是有較高的邊緣保持度。本文方法融合圖像的信息熵最大,即包含了更多細節信息;平均梯度相比也有所提高,即增加了融合圖像的清晰度;均值即平均亮度的提高改善了視覺效果;空間域的總體活躍度也較高。所以本文中的融合方法得到的融合圖像質量最好。

為了更直觀地表現融合算法的效果,對上述實驗結果再采用Canny算子進行邊緣提取,提取結果如圖7和圖8所示。可以發現,本文方法的邊緣細節信息得到了更好的保留,邊緣更加連續。因此,本文方法在進行醫學圖像診斷時能夠提供更多的細節信息,滿足醫學圖像日益多樣化和復雜化的需要。

6 結束語

圖像中目標的邊緣和輪廓是其重要的特征,特別是在醫學圖像中,不同的邊緣代表的是不同組織或器官的界限。本文在提升小波變換的基礎上,將脈沖耦合神經網絡和邊緣提取性能很好的非線性濾波萬有引力方法相結合,構成具有自適應能力的PCNN,并將其應用到反映圖像邊緣細節信息的高頻子圖像的融合規則中,這樣可有效地保留源圖像的不同信息,強化了邊緣和紋理特征。實驗結果表明,本文的圖像融合方法改善了融合圖像的視覺效果,提高了各個評價參數質量,為醫學診斷和治療提供了更有效、更細節、更清晰的信息,在多模態醫學圖像融合處理中具有有效性和先進性以及廣闊的應用前景。

[1]Mallat S G.A theory for multiresolution signal decomposition:the wavelet representation[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1989,11(7):674-693.

[2]張強,周海銀,王炯琦.基于局部方差和高通濾波的小波變換圖像融合[J].計算機仿真,2008,25(8):223-226.

[3]Wen C Y,Chen L K.Multi-resolution image fusion technique and its application to forensic science[J].Forensic Science International,2004,140:217-232.

[4]Li Wei,Zhu Xuefeng.A new algorithm of multi-modality medical image fusion based on pulse-coupled neural networks[C]//Lecture Notes in Computer Science,2005,3610:995-1001.

[5]Eckhorn R,Reitboeck H J,Arndt M,et al.Feature linking via synchronization among distributed assemblies:simulation of results from cat cortex[J].Neural Computation,1990,2(3):293-307.

[6]Daubechies I,Sweldens W.Factoring wavelet transforms into lifting steps[J].Journal of Fourier Analysis and Application,1998,4(3):247-269.

[7]Peng Lizhong,Chu Xiaoyong.The lifting scheme of 4-channel orthogonal wavelet transforms[J].Progress in Natural Science,2006,16(1):100-104.

[8]楊艷春,黨建武,王陽萍.基于提升小波變換與自適應PCNN的醫學圖像融合方法[J].計算機輔助設計與圖形學學報,2012,24(4):494-499.

[9]Ranganath H S,Kuntimad G,Johnson J L.Pulse coupled neural networks for image processing[C]//Southeastcon’95,Raleigh,NC,1995:37-43.

[10]Kuntimad G,Ranganath H S.Perfect image segmentation using pulse coupled neural networks[J].IEEE Transactions on Neural Networks,1999,10(3):591-598.

[11]Johnson J L,Padgett M L.PCNN models and applications[J].IEEE Transactions on Neural Networks,1999,10(3):480-498.

[12]Ranganath H S,Kuntimad G.Iterative segmentation using pulse coupled neural networks[C]//Proceedings SPIE,1996,2760:543-554.

[13]Ma Yide,Dai Rolan,Li Lian,et al.Image segmentation of embryonic plant cell using pulse-coupled neural networks[J].Chinese Science Bulletin,2002,47(2):167-172.

[14]馬義德,齊春亮.基于遺傳算法的脈沖耦合神經網絡自動系統的研究[J].系統仿真學報,2006,18(3):722-724.

[15]Sun G Y,Liu Q H,Liu Q,et al.A novel approach for edge detection based on the theory of universal gravity[J]. Pattern Recognition,2007,40(10):2766-2775.

[16]張春雪,陳秀宏.基于非線性濾波的萬有引力邊緣檢測方法[J].計算機應用,2011,31(3):763-766.

[17]Qu Guihong,Zhang Dali,Yan Pingfan.Information measure for performance of image fusion[J].Electronic Letters,2002,38(7):548-551.

[18]陳美玲,陶玲,錢志余.一種改進的醫學圖像融合技術及其效果[J].生物醫學工程學雜志,2009,26(4):711-715.

[19]Xydeas C S,Petrovic V.Objective image fusion performance measure[J].Electronic Letters,2000,36(4):308-309.

[20]薛寺中,周愛平,梁久禎.基于小波變換的自適應脈沖耦合神經網絡圖像融合[J].計算機應用,2010,30(12):3225-3228. [21]鄒北驥,胡藝齡,辛國江.基于小波分解和PCNN的圖像融合方法[J].計算機工程與科學,2011,33(2):102-106.

LIU Wenmin,CHEN Xiuhong

School of Digital Media,Jiangnan University,Wuxi,Jiangsu 214122,China

In order to better meet the modern medicine clinical diagnosis and treatment needs,improve the medical image fusion quality,this paper proposes a new medical image fusion algorithm based on lifting wavelet transform,combined with the Pulse Coupled Neural Networks(PCNN)and pixel point of nonlinear filtering gravitation.A fusion rule based on the area average gray is adopted in low-frequency coefficients.Adaptive PCNN fusion rule is adopted in high-frequency coefficients.It makes the pixel’s nonlinear filtering gravitation as the linking strength of simplified PCNN model.So PCNN can adaptively control the size of linking strength,and according to the ignition matrix to determine the fusion of high-frequency coefficients.Experiments show that the fused image obtains more edge detail information than other methods and every index has improved.It has a better fusion performance.

medical image fusion;lifting wavelet transform;Pulse Coupled Neural Networks(PCNN);nonlinear filtering gravitation;linking strength

為了更好地滿足現代醫學臨床診斷和治療的需要,提高醫學圖像的融合質量,提出在提升小波變換的基礎上,結合脈沖耦合神經網絡(PCNN)和像素點的非線性濾波萬有引力的醫學圖像融合方法。低頻子系數采用基于區域灰度均值的融合規則;高頻子系數采用自適應PCNN的融合規則,將像素的非線性濾波萬有引力作為簡化的PCNN模型中的鏈接強度,使PCNN能夠自適應調節鏈接強度的大小,并根據點火矩陣確定高頻子系數。實驗結果表明,該方法得到的融合圖像比其他融合方法保留了更多的邊緣細節信息,各項評價指標均有所提高,有更好的融合性能。

醫學圖像融合;提升小波變換;脈沖耦合神經網絡;非線性濾波萬有引力;鏈接強度

A

TP391.4

10.3778/j.issn.1002-8331.1301-0250

LIU Wenmin,CHEN Xiuhong.Medical image fusion method based on PCNN and nonlinear filtering of gravitation. Computer Engineering and Applications,2014,50(24):191-198.

中央高校基本科研業務費專項資金資助(No.JUSRP211A70)。

劉雯敏(1989—),女,碩士研究生,主要研究方向:計算機圖形與圖像處理;陳秀宏(1964—),男,博士,教授。

2013-01-22

2013-04-02

1002-8331(2014)24-0191-08

CNKI網絡優先出版:2013-04-18,http∶//www.cnki.net/kcms/detail/11.2127.TP.20130418.1618.015.html