多源遙感圖像融合語(yǔ)義分割發(fā)展現(xiàn)狀與展望

何 友,劉 瑜*,譚大寧,張一鳴,張財(cái)生,孫 順,丁自然,姜喬文

(1. 海軍航空大學(xué), 山東 煙臺(tái) 264001; 2. 清華大學(xué) 電子工程系, 北京 100084)

0 引 言

近年來(lái),隨著空間感知技術(shù)的發(fā)展,機(jī)載和星載平臺(tái)的任務(wù)載荷不斷豐富,超高分辨率光學(xué)相機(jī)、合成孔徑雷達(dá)(SAR)和激光雷達(dá)(LiDAR)等多種傳感器被用于對(duì)地、對(duì)海探測(cè)任務(wù),數(shù)據(jù)獲取來(lái)源正從過(guò)去的單一型向多樣化方向發(fā)展[1-3]。由于技術(shù)局限性,利用單一傳感器數(shù)據(jù)的探測(cè)識(shí)別技術(shù)往往不能夠全面地反映目標(biāo)物的整體和局部特征。無(wú)論是民用領(lǐng)域的地質(zhì)災(zāi)害監(jiān)測(cè)、滸苔赤潮監(jiān)測(cè)、土地利用監(jiān)測(cè),還是軍用領(lǐng)域的機(jī)場(chǎng)港口監(jiān)測(cè)、邊境態(tài)勢(shì)監(jiān)測(cè)和海上艦船目標(biāo)檢測(cè),單一傳感器獲取的信息已經(jīng)很難滿足實(shí)際需求,探索多源遙感圖像語(yǔ)義信息提取成為當(dāng)下研究的一大熱點(diǎn)[4-5]。

多源遙感圖像語(yǔ)義信息提取就是將不同種類(lèi)傳感器獲取的同一地區(qū)的影像數(shù)據(jù)進(jìn)行預(yù)處理,然后通過(guò)特定算法將多遙感平臺(tái)、多遙感器、多電磁譜段影像的優(yōu)勢(shì)有機(jī)結(jié)合起來(lái),執(zhí)行目標(biāo)檢測(cè)和地物分類(lèi)等任務(wù)[6-7]。以SAR與光學(xué)圖像為例,SAR圖像具有全天時(shí)、全天候、寬視場(chǎng)以及極化信息豐富等顯著優(yōu)勢(shì),而光學(xué)影像則更加適合人眼的視覺(jué)解譯,因此將SAR與光學(xué)圖像進(jìn)行融合,可以充分發(fā)揮多類(lèi)型傳感器數(shù)據(jù)融合的優(yōu)勢(shì)[8]。發(fā)展多源遙感圖像融合語(yǔ)義信息提取技術(shù)已成為國(guó)內(nèi)外遙感發(fā)展的重要趨勢(shì)。美國(guó)、德國(guó)等利用多源衛(wèi)星開(kāi)展在軌信息融合處理技術(shù)研究。自2012年起,美國(guó)著手發(fā)展空間計(jì)算技術(shù),組織開(kāi)展了一系列包括在軌信息處理、空天地一體化觀測(cè)和協(xié)同組網(wǎng)等在內(nèi)的關(guān)鍵技術(shù)研究。德國(guó)的BIRD小衛(wèi)星綜合可見(jiàn)光、中波紅外和熱紅外3個(gè)波段的遙感圖像實(shí)現(xiàn)地物分類(lèi)和亞像元火點(diǎn)探測(cè)等在軌融合處理任務(wù)。澳大利亞開(kāi)展了在軌處理驗(yàn)證試驗(yàn),其在FedSat衛(wèi)星搭載了可重構(gòu)的在軌處理原型系統(tǒng),滿足在軌處理需求下利用光學(xué)傳感器融合數(shù)據(jù)實(shí)現(xiàn)災(zāi)害監(jiān)測(cè)。然而,利用多源遙感圖像進(jìn)行語(yǔ)義信息提取涉及較多技術(shù)難題。在數(shù)據(jù)的獲取上,各種平臺(tái)的傳感器精度和時(shí)鐘難以完全相同,且數(shù)據(jù)在觀測(cè)角度、時(shí)相、尺度和譜段上有差異,如何將多源乃至多模態(tài)遙感圖像進(jìn)行時(shí)空對(duì)準(zhǔn)仍是實(shí)現(xiàn)多源遙感圖像語(yǔ)義分割的首要問(wèn)題;在融合層級(jí)上,遙感圖像融合分為數(shù)據(jù)層融合、特征層融合和決策層融合,前者面臨計(jì)算開(kāi)銷(xiāo)大、難以滿足時(shí)效性要求的問(wèn)題,后者則容易遺漏部分特征細(xì)節(jié)信息造成誤判,如何快速智能提取有用信息仍需要設(shè)計(jì)一體化處理流程,克服單一層面融合的局限性;在模型訓(xùn)練方式上,一般的遙感圖像語(yǔ)義分割采用從頭訓(xùn)練的方式,語(yǔ)義信息提取網(wǎng)絡(luò)的遷移性和可解釋性不高,先驗(yàn)信息和數(shù)字地圖信息沒(méi)有利用到輔助分割中來(lái)。

隨著人工智能的快速發(fā)展,利用深度學(xué)習(xí)方法解決上述問(wèn)題逐漸成為可能。在醫(yī)學(xué)和自動(dòng)駕駛領(lǐng)域的配準(zhǔn)與分割技術(shù)已經(jīng)可以實(shí)現(xiàn)多模態(tài)信息的融合互補(bǔ),證明了利用不同成像模式的互補(bǔ)信息進(jìn)行單類(lèi)圖像分割方面的有效性與可行性[9]。對(duì)于遙感圖像解譯而言,單源遙感圖像語(yǔ)義分割可將圖像中的每個(gè)像素鏈接到類(lèi)標(biāo)簽,這些標(biāo)簽包括建筑物、車(chē)、艦船、植被等。隨著衛(wèi)星觀測(cè)數(shù)據(jù)的爆炸式增長(zhǎng),多光譜、高光譜、全色、紅外、SAR等遙感圖像的高效、快速融合是未來(lái)新的研究熱點(diǎn)。相比單源遙感圖像,多源遙感圖像的融合分割可以將同一地物的不同類(lèi)型進(jìn)行綜合,以獲得滿足目標(biāo)檢測(cè)、災(zāi)害評(píng)估和關(guān)注區(qū)域提取等任務(wù)的高質(zhì)量信息,產(chǎn)生比單一傳感器圖像更加精準(zhǔn)、可靠的估計(jì)和判決。以全卷積神經(jīng)網(wǎng)絡(luò) (FCN)為主要結(jié)構(gòu)的基于深度學(xué)習(xí)的快速語(yǔ)義分割網(wǎng)絡(luò)發(fā)展迅速,有監(jiān)督語(yǔ)義分割和無(wú)監(jiān)督語(yǔ)義分割均可滿足一般圖像處理應(yīng)用時(shí)效性和準(zhǔn)確性要求[10-11]。近年來(lái),人工智能、大數(shù)據(jù)分析和多模態(tài)等技術(shù)飛速發(fā)展,基于數(shù)據(jù)驅(qū)動(dòng)的多源數(shù)據(jù)融合框架得到了廣泛關(guān)注,其將來(lái)自不同類(lèi)型衛(wèi)星的多源、多維和多特征的數(shù)據(jù)進(jìn)行融合,快速對(duì)互補(bǔ)冗余信息進(jìn)行預(yù)處理、特征提取、分類(lèi)等綜合處理,最后進(jìn)行特征級(jí)和決策級(jí)的智能化融合,從而提高融合檢測(cè)結(jié)果的可信水平和量測(cè)精度,提升全地域、全天候、全天時(shí)的快速響應(yīng)和空間信息處理能力。大量研究表明,多源遙感圖像語(yǔ)義分割已經(jīng)進(jìn)入快速發(fā)展階段,但是該技術(shù)涉及遙感圖像從獲取、預(yù)處理、配準(zhǔn)、融合到分割的復(fù)雜過(guò)程,目前的研究缺乏系統(tǒng)性梳理和總結(jié)。本文立足國(guó)內(nèi)外遙感圖像語(yǔ)義分割發(fā)展現(xiàn)狀,系統(tǒng)性梳理了多源遙感圖像語(yǔ)義分割的關(guān)鍵技術(shù)及前沿進(jìn)展,通過(guò)仿真的方式對(duì)各關(guān)鍵技術(shù)的理論原理與適用條件進(jìn)行了分析,歸納出現(xiàn)有關(guān)鍵技術(shù)的薄弱環(huán)節(jié),并提出一體化智能處理思路,為多源遙感圖像融合處理提供參考借鑒。

1 遙感圖像語(yǔ)義分割研究進(jìn)展

語(yǔ)義分割的根本是從圖像中提取感興趣的目標(biāo)區(qū)域,它將圖像中的每個(gè)像素都標(biāo)注上對(duì)應(yīng)的類(lèi)別,可以用來(lái)識(shí)別構(gòu)成可區(qū)分類(lèi)別的像素集合。在語(yǔ)義分割完的圖像上,不同像素區(qū)域被劃分為不同的語(yǔ)義可解釋性類(lèi)別。目前,針對(duì)單一來(lái)源的語(yǔ)義分割發(fā)展迅速,研究覆蓋遙感地物分類(lèi)、災(zāi)害評(píng)估和目標(biāo)提取等。多源信息融合語(yǔ)義分割仍以兩個(gè)信息源的數(shù)據(jù)融合為主,二維空間如紅外與光學(xué)圖像、SAR與光學(xué)圖像融合語(yǔ)義分割,三維空間如LiDAR與光學(xué)圖像、高程/深度信息與光學(xué)圖像融合語(yǔ)義分割。當(dāng)某一來(lái)源的信息出現(xiàn)時(shí)序變化時(shí),又衍生出時(shí)相數(shù)據(jù)變化檢測(cè),如災(zāi)害變化檢測(cè)、苔滸赤潮變化檢測(cè)、溢油變化檢測(cè)等,其原理與語(yǔ)義分割方法相近,都是綜合利用多源數(shù)據(jù)提取感興趣的目標(biāo)區(qū)域。本節(jié)主要內(nèi)容是對(duì)從“單源”到“多源”遙感圖像融合語(yǔ)義分割的理論原理與研究方法進(jìn)行詳細(xì)總結(jié)。

1.1 單源圖像語(yǔ)義分割現(xiàn)狀

目前,圖像的語(yǔ)義分割方法可以分為傳統(tǒng)方法和基于深度學(xué)習(xí)的方法。傳統(tǒng)語(yǔ)義分割算法基于機(jī)器學(xué)習(xí)分類(lèi)器,如Texton Forest和Random Forest等。隨著以卷積神經(jīng)網(wǎng)絡(luò)(CNN)為代表的深度學(xué)習(xí)的發(fā)展,使用“數(shù)據(jù)+模型”驅(qū)動(dòng)的深度學(xué)習(xí)方法進(jìn)行圖像分割任務(wù)逐漸成為主流[12-14]。

基于深度學(xué)習(xí)的語(yǔ)義分割方法主要包括兩類(lèi):第一類(lèi)是基于滑窗/候選區(qū)域的語(yǔ)義分割模型。基于滑窗的語(yǔ)義分割模型[15]從圖像分類(lèi)領(lǐng)域衍生而來(lái),它以滑窗的形式對(duì)以像素點(diǎn)為中心的圖像窗口進(jìn)行處理,通過(guò)卷積分類(lèi)網(wǎng)絡(luò)對(duì)滑動(dòng)窗口進(jìn)行分類(lèi),以此預(yù)測(cè)窗口像素中心點(diǎn)的語(yǔ)義類(lèi)別。而基于候選區(qū)域的語(yǔ)義分割方法[16]則從目標(biāo)檢測(cè)領(lǐng)域擴(kuò)展而來(lái)。它首先提取圖像中的候選框,然后對(duì)各個(gè)候選框進(jìn)行特征提取和分類(lèi)預(yù)測(cè),在確定候選框中對(duì)象的語(yǔ)義類(lèi)別后對(duì)整幅圖像的語(yǔ)義分割,區(qū)分出不同語(yǔ)義類(lèi)別和背景。第二類(lèi)是基于編碼器-解碼器(上采樣/反卷積)結(jié)構(gòu)的端到端語(yǔ)義分割模型。文獻(xiàn)[17]在2015年的CVPR上提出FCN,與CNN不同的是FCN移除了全連接層,在解碼器中使用轉(zhuǎn)置卷積進(jìn)行特征圖上采樣。FCN具有開(kāi)創(chuàng)性意義,但也存在對(duì)細(xì)節(jié)不敏感、精度不高等問(wèn)題。為了彌補(bǔ)缺陷,文獻(xiàn)[18]提出了U-Net模型,它是FCN的延續(xù)和改進(jìn),使用典型的編碼器-解碼器結(jié)構(gòu),編碼器采用卷積層下采樣,解碼器采用反卷積上采樣。U-Net的優(yōu)勢(shì)在于通過(guò)對(duì)低層次特征映射的組合,構(gòu)建起高層次的語(yǔ)義特征,從而精確定位語(yǔ)義類(lèi)別,提高了圖像分割的精度。文獻(xiàn)[19]隨后提出SegNet模型,它由一個(gè)編碼器網(wǎng)絡(luò)(與VGG16的13個(gè)卷積層相同)、一個(gè)對(duì)應(yīng)的解碼器網(wǎng)絡(luò)以及一個(gè)像素級(jí)分類(lèi)層Softmax組成,具有模型參數(shù)數(shù)量少的特點(diǎn)。隨后文獻(xiàn)[20]提出的Deeplab系列模型進(jìn)行了進(jìn)一步優(yōu)化了編碼器-解碼器結(jié)構(gòu)模型。Deeplab v1結(jié)合深度卷積神經(jīng)網(wǎng)絡(luò)和概率圖模型DenseCRFs,將DenseCRFs作為網(wǎng)絡(luò)的后處理方法,使得語(yǔ)義分割不僅針對(duì)像素點(diǎn)本身,還要考慮以該像素點(diǎn)為中心的周?chē)袼攸c(diǎn)的值,最終分割結(jié)果的邊界更加準(zhǔn)確清晰。Deeplab v2和v3[21]分別設(shè)計(jì)和改進(jìn)了ASPP模塊,先由空洞卷積產(chǎn)生的不同感受野的特征圖,然后通過(guò)對(duì)不同特征圖進(jìn)行組合,從而獲得更加豐富的局部/全局上下文信息。Deeplab v3+[22]在v3的基礎(chǔ)上改進(jìn)了解碼器模塊,使得分割結(jié)果變得更加精細(xì)。語(yǔ)義分割的難點(diǎn)在于感受野的設(shè)置上,相近類(lèi)別的語(yǔ)義信息容易出現(xiàn)混淆,PSPNet[23]被提出用于解決網(wǎng)絡(luò)感受野的問(wèn)題,它延續(xù)了FCN的設(shè)計(jì)思路,引入了更多的上下文信息進(jìn)行分割,提出的金字塔池化模塊包含了不同區(qū)域不同尺度的特征,因而具有更好的分割精度。

1.2 多源遙感圖像融合語(yǔ)義分割現(xiàn)狀

近年來(lái),紅外圖像、多光譜圖像、SAR圖像及LiDAR點(diǎn)云數(shù)據(jù)的融合語(yǔ)義分割成為研究熱點(diǎn)和數(shù)據(jù)大賽的熱門(mén)賽題。一方面,以光學(xué)和SAR為基礎(chǔ)的遙感數(shù)據(jù)處理更偏向于多源化,融合分割處理可以進(jìn)一步提升地物分類(lèi)精度[24];另一方面,以自動(dòng)駕駛為代表的人工智能技術(shù)對(duì)環(huán)境的感知從2D平面擴(kuò)展到3D立體空間,多源數(shù)據(jù)融合分割正成為控制與決策的重要數(shù)據(jù)來(lái)源[25]。自2006年以來(lái),國(guó)際電氣與電子工程師協(xié)會(huì)地球科學(xué)和遙感學(xué)會(huì)為了推動(dòng)多源遙感數(shù)據(jù)融合處理的研究,逐年舉辦涉及光電融合和空-時(shí)-譜融合等領(lǐng)域的多源遙感數(shù)據(jù)融合的比賽。

目前,大多數(shù)的多源融合技術(shù)針對(duì)的是兩種數(shù)據(jù)的融合處理。文獻(xiàn)[26]首次提出基于彩色(RGB)圖像和深度(Depth)圖像的深度多模態(tài)融合,并提出早期融合的概念,在特征圖進(jìn)入分割網(wǎng)絡(luò)之前,將RGB和深度通道拼接,實(shí)現(xiàn)對(duì)室內(nèi)場(chǎng)景的精準(zhǔn)分割。由于不同數(shù)據(jù)源的圖像具有異質(zhì)性,簡(jiǎn)單的圖像拼接對(duì)多源特征提取的效果提升有限。隨后FuseNet[27]在2016年被提出以合并互補(bǔ)的RGB圖像信息和深度信息到語(yǔ)義融合分割框架。FuseNet采用編碼器-解碼器分割框架,雙分支的網(wǎng)絡(luò)同時(shí)從RGB和Depth提取特征,并將Depth特征融入RGB的特征圖中作為下一層的輸入,隨著網(wǎng)絡(luò)的深入,從深度編碼器獲得的抽象特征融入RGB分支。在遙感圖像處理方面,文獻(xiàn)[28]提出一種用于建筑物目標(biāo)分割任務(wù)的LiDAR和光學(xué)遙感圖像融合分割方法。該算法首先基于迭代形態(tài)濾波方法從激光雷達(dá)點(diǎn)云中提取初始建筑區(qū)域,然后通過(guò)融合LiDAR數(shù)據(jù)和相應(yīng)的RGB遙感圖像來(lái)生成一個(gè)組合梯度表面,最后應(yīng)用LiDAR分割初始化的流域算法在表面上找到建筑物邊緣。文獻(xiàn)[29]提出了一種用于多模態(tài)遙感數(shù)據(jù)分割的多階段融合多源注意力網(wǎng)絡(luò)。該網(wǎng)絡(luò)采用編碼器-解碼器結(jié)構(gòu),其多級(jí)融合模塊通過(guò)過(guò)濾多源遙感數(shù)據(jù)噪聲校正偏差信息,然后融合多源互補(bǔ)信息,通過(guò)提出的多源注意力機(jī)制聚合相似特征,增強(qiáng)異質(zhì)特征的可辨別性,融合分割效果優(yōu)于Mp-ResNet、ACNet、ESANet等方法。隨著多視點(diǎn)、多分辨率對(duì)地觀測(cè)系統(tǒng)的發(fā)展,跨傳感器平臺(tái)(衛(wèi)星、飛機(jī)、無(wú)人機(jī)和車(chē)輛)的數(shù)據(jù)融合成為可能。文獻(xiàn)[30]提出一種針對(duì)激光雷達(dá)數(shù)據(jù)和相機(jī)光學(xué)圖像融合的語(yǔ)義分割網(wǎng)絡(luò),可部署于自動(dòng)駕駛汽車(chē)用于車(chē)道線分割。它使用Deeplab v3+網(wǎng)絡(luò)對(duì)汽車(chē)前方的相機(jī)圖像進(jìn)行分割,然后與激光雷達(dá)采集的點(diǎn)云融合。除此之外,在建筑物和道路提取、自然災(zāi)害受損區(qū)域提取和海面溢油監(jiān)測(cè)等方面,多源遙感圖像融合分割也顯示出優(yōu)勢(shì)[31-32]。

1.3 多時(shí)相遙感圖像變化檢測(cè)研究現(xiàn)狀

作為多源遙感圖像融合中的重要分支,多時(shí)相遙感圖像變化檢測(cè)是借助多源遙感圖像進(jìn)行變化信息提取的有效手段。它通過(guò)處理同一區(qū)域前后時(shí)刻兩幅遙感圖像,獲取地面或海面前后不同時(shí)刻的變化信息[33]。早期的遙感影響變化檢測(cè)一直都是以像素為圖像分析的基本單元,即假設(shè)遙感圖像中各個(gè)像素是空間獨(dú)立的,不存在像素相關(guān),通過(guò)分析像素點(diǎn)的特征來(lái)檢測(cè)地面發(fā)生變化的區(qū)域。主要的變化檢測(cè)方法有圖像差分[34]、圖像比值[35]和回歸分析[36]等。由于基于像素的變化檢測(cè)方法無(wú)法區(qū)分出發(fā)生變化的具體目標(biāo),因此出現(xiàn)了基于對(duì)象的變化檢測(cè)方法。這類(lèi)方法對(duì)于光譜差異、畸變等表現(xiàn)出良好的穩(wěn)定性,同時(shí)對(duì)于判讀發(fā)生變化的具體信息更有幫助。文獻(xiàn)[37]提出一種基于對(duì)象的變化檢測(cè)方法,它以目標(biāo)作為變化檢測(cè)的基本分析單元,從而可以從目標(biāo)的不同維度特征獲取更加準(zhǔn)確的地面目標(biāo)變化信息。文獻(xiàn)[38]提出一種多尺度的變化檢測(cè)方法,其中小尺度針對(duì)建筑物,大尺度針對(duì)成片區(qū)域的植被,相比基于像素的變化檢測(cè)方法,該方法的檢測(cè)準(zhǔn)確率提升18%。之后又有研究者提出一種基于圖像目標(biāo)相關(guān)性分析的變化檢測(cè)方法,它以目標(biāo)的多維特征向量為基礎(chǔ),度量多時(shí)相圖像中不同目標(biāo)的相關(guān)性,并通過(guò)機(jī)器學(xué)習(xí)分類(lèi)算法得到變化檢測(cè)結(jié)果。

隨著深度學(xué)習(xí)技術(shù)的發(fā)展,研究者提出基于孿生網(wǎng)絡(luò)[39-40]的變化檢測(cè)方法。文獻(xiàn)[41]在FCN的基礎(chǔ)上設(shè)計(jì)了三種經(jīng)典的變化檢測(cè)網(wǎng)絡(luò),這些網(wǎng)絡(luò)利用配準(zhǔn)的多時(shí)相遙感圖像進(jìn)行變化檢測(cè),不同之處在于網(wǎng)絡(luò)的分支設(shè)計(jì)和融合方式上。值得注意的是,它提出的孿生全卷積網(wǎng)絡(luò)結(jié)構(gòu),對(duì)于解決變化檢測(cè)問(wèn)題具有啟發(fā)意義。文獻(xiàn)[42]針對(duì)異質(zhì)性遙感圖像提出了一種無(wú)監(jiān)督的變化檢測(cè)方法,它使用對(duì)稱(chēng)的網(wǎng)絡(luò)結(jié)構(gòu),通過(guò)兩邊的卷積層和深度卷積耦合層,將連接在網(wǎng)絡(luò)兩側(cè)的兩個(gè)輸入圖像分別轉(zhuǎn)換到同一特征空間,從而計(jì)算出同一特征空間不同的特征圖,然后應(yīng)用閾值算法得到最終的檢測(cè)結(jié)果。文獻(xiàn)[43]提出了一種基于CGAN圖像變化檢測(cè)方法,其原型結(jié)構(gòu)為pix2pix[44],它不考慮特定季節(jié)的物體變化以及亮度變化等因素造成的差異,能夠有效地對(duì)不同季節(jié)的多時(shí)相遙感圖像進(jìn)行變化檢測(cè)。然而,該方法對(duì)于高分辨率遙感圖像的變化檢測(cè)效果不佳,原因是上述方法是通過(guò)利用深度特征生成差異圖像或?qū)W習(xí)像素塊之間的變化關(guān)系來(lái)實(shí)現(xiàn)變化檢測(cè)的,這導(dǎo)致了誤差積累問(wèn)題,因?yàn)楂@得最終的變化圖需要較多的中間處理步驟。為了解決這一問(wèn)題,文獻(xiàn)[45]提出了一種新的端到端的變化檢測(cè)方法,該方法基于有效的語(yǔ)義分割編解碼器體系結(jié)構(gòu)UNet++[46],利用全局信息和細(xì)粒度信息生成具有較高空間精度的特征圖,然后采用多側(cè)輸出的融合策略,將不同語(yǔ)義層的變化圖進(jìn)行組合,生成精度較高的最終變化圖。在極高分辨率衛(wèi)星影像數(shù)據(jù)集上的實(shí)驗(yàn)結(jié)果驗(yàn)證了該方法的有效性和可靠性。除了光學(xué)和SAR圖像的變化檢測(cè),文獻(xiàn)[47]提出了一種LiDAR與光學(xué)圖像之間的變化檢測(cè)方法。該方法將多模態(tài)輸入一個(gè)輕量化孿生卷積神經(jīng)網(wǎng)絡(luò)進(jìn)行變化檢測(cè),為多模態(tài)變化檢測(cè)網(wǎng)絡(luò)的設(shè)計(jì)提供了借鑒意義。為了對(duì)時(shí)空信息進(jìn)行全局特征建模,文獻(xiàn)[48]在注意力機(jī)制的基礎(chǔ)上提出了基于孿生網(wǎng)絡(luò)的時(shí)空注意力變化檢測(cè)網(wǎng)絡(luò),它在特征提取過(guò)程中增加了一個(gè)時(shí)空注意力模塊以及金字塔時(shí)空注意力模塊,對(duì)于雙時(shí)相圖像的配準(zhǔn)誤差,以及遙感圖像的顏色和尺度的變化具有較強(qiáng)的魯棒性。為了提升高分辨率遙感圖像的變化檢測(cè)精度及準(zhǔn)確率,文獻(xiàn)[49]和文獻(xiàn)[50]分別使用Attention和Transformer注意力模塊提出了基于DenseNet的孿生變化檢測(cè)網(wǎng)絡(luò)和基于Transformer的變化檢測(cè)網(wǎng)絡(luò),模型在參數(shù)數(shù)量和結(jié)構(gòu)上更精簡(jiǎn)。

2 多源遙感圖像語(yǔ)義分割關(guān)鍵技術(shù)

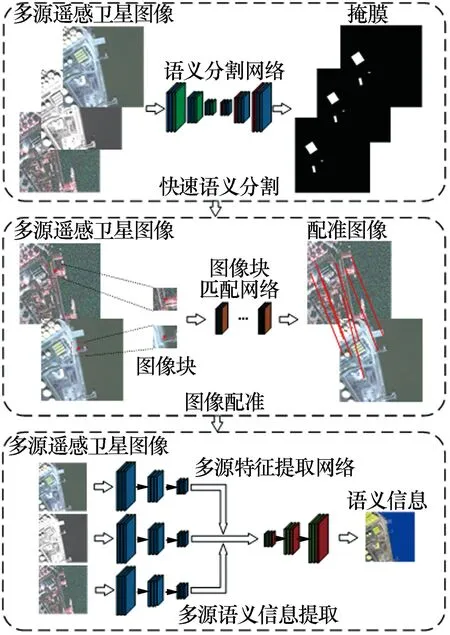

隨著遙感、人工智能等領(lǐng)域的快速發(fā)展,多源遙感圖像融合語(yǔ)義分割逐漸成為提升單源分割效果的主流方法。在實(shí)際的處理過(guò)程中,涉及快速語(yǔ)義分割、聯(lián)合語(yǔ)義輔助的多源圖像配準(zhǔn)與時(shí)序合成、多源遙感圖像語(yǔ)義信息提取等關(guān)鍵技術(shù)。多源遙感圖像語(yǔ)義分割的處理思路如圖1所示,輸入數(shù)據(jù)為多源遙感衛(wèi)星圖像、輔助地理信息數(shù)據(jù)(如控制點(diǎn)、參考圖像等),處理過(guò)程分為快速語(yǔ)義分割、語(yǔ)義輔助精確配準(zhǔn)與時(shí)序合成、語(yǔ)義信息智能提取3個(gè)有機(jī)融合的環(huán)節(jié),輸出地物覆蓋類(lèi)型圖、語(yǔ)義信息掩膜和變化圖等。

圖1 多源遙感圖像語(yǔ)義分割關(guān)鍵技術(shù)路線

2.1 單源遙感圖像快速語(yǔ)義分割

首先通過(guò)深度學(xué)習(xí)方法提取高分辨率遙感圖像語(yǔ)義信息,實(shí)現(xiàn)建筑物、水體和目標(biāo)(如艦船、飛機(jī))等少量類(lèi)別的快速語(yǔ)義分割,實(shí)際中常從衛(wèi)星遙感圖像中快速分割道路、水體、建筑物、植被等目標(biāo)地物,從而為后續(xù)遙感圖像配準(zhǔn)和合成提供有效輔助。由于單景遙感圖像分辨率高,直接進(jìn)行處理速度較慢,因此通常先進(jìn)行裁剪,通過(guò)滑窗方式裁剪指定尺寸的圖像塊作為快速語(yǔ)義分割的輸入。文獻(xiàn)[51]提出一種針對(duì)高分辨率遙感圖像的圖像處理方法,即通過(guò)滑窗方式將4 000×4 000像素的圖像裁剪指定尺寸(416×416像素)的圖像作為模型的輸入,且相鄰裁剪圖像重疊15%的區(qū)域以保證原圖各區(qū)域均能被正確分割。經(jīng)過(guò)逐個(gè)分割后將分割結(jié)果合并得到最終檢測(cè)結(jié)果。在快速語(yǔ)義分割方面,開(kāi)創(chuàng)性的FCN是大多數(shù)語(yǔ)義分割網(wǎng)絡(luò)結(jié)構(gòu)的基礎(chǔ),U-Net使用密集的跳躍連接進(jìn)一步利用了空間細(xì)節(jié),使得分割結(jié)果具有更準(zhǔn)確的邊緣。此后,為了改進(jìn)整體特征提取能力,采用金字塔池化模塊的PSPNet和采用空洞卷積金字塔池化模塊的DeepLab對(duì)全局上下文進(jìn)行編碼,提取全局語(yǔ)義信息。由于圖像分割速度與模型的計(jì)算開(kāi)銷(xiāo)緊密聯(lián)系,為了提高語(yǔ)義分割速度,基于FCN的SegNet[19]和ENet[52]相繼被提出,通過(guò)引入聯(lián)合編碼器-解碼器模型和減少層數(shù)的編碼器-解碼器模型,減少了計(jì)算成本。在ICNet[53]、BiSeNet[54]和GUN[55]等雙分支輕量化語(yǔ)義分割方法啟發(fā),Fast-SCNN結(jié)合共享權(quán)值的淺層網(wǎng)絡(luò)來(lái)學(xué)習(xí)細(xì)節(jié)特征,同時(shí)在低分辨率下高效地學(xué)習(xí)全局上下文特征,將語(yǔ)義分割速度提升至實(shí)時(shí)處理水平。通過(guò)快速語(yǔ)義分割,得到云區(qū)、水體、建筑物、樹(shù)木等對(duì)目標(biāo)地物,便于后續(xù)配準(zhǔn)和時(shí)序合成。隨著大型語(yǔ)言模型的成功,通用視覺(jué)分割模型GPT、采用 Transformer 編碼器-解碼器結(jié)構(gòu)的SEEM、集多種分割任務(wù)于一身的OMG-Seg等被用于語(yǔ)義分割任務(wù)。例如SEEM模型[56],盡管監(jiān)督學(xué)習(xí)使用數(shù)據(jù)標(biāo)簽來(lái)統(tǒng)一多源圖像并將它們與標(biāo)簽對(duì)齊,但它們的嵌入空間本質(zhì)上仍然不同,為了解決這個(gè)問(wèn)題,SEEM模型將不同類(lèi)型的標(biāo)簽與不同的輸出進(jìn)行匹配,使其支持各種組合方式,多源提取標(biāo)簽也可以簡(jiǎn)單地連接并饋送到 SEEM 解碼器中。

2.2 語(yǔ)義輔助精確配準(zhǔn)與融合

通過(guò)語(yǔ)義信息輔助實(shí)現(xiàn)多源遙感圖像配準(zhǔn),相比傳統(tǒng)幾何處理手段可以大幅度提升配準(zhǔn)的速度、魯棒性和自動(dòng)化程度。具體來(lái)說(shuō)就是充分利用前述環(huán)節(jié)識(shí)別出的語(yǔ)義分割信息剔除云層、植被等非固定目標(biāo)特征點(diǎn),同時(shí)利用提取的固定目標(biāo)特征信息用于多源異構(gòu)遙感數(shù)據(jù)高精度配準(zhǔn)與融合。文獻(xiàn)[57]提出一種用于多時(shí)相高分辨率航空?qǐng)D像配準(zhǔn)的語(yǔ)義特征提取方法,通過(guò)語(yǔ)義分割網(wǎng)絡(luò)提取隨時(shí)間變化不大的對(duì)象(如道路)的特征信息,幫助處理圖像配準(zhǔn)中的樹(shù)葉變化等問(wèn)題,解決了經(jīng)典手工特征無(wú)法解決的時(shí)變問(wèn)題,經(jīng)檢驗(yàn)在跨年份和季節(jié)的航拍圖像配準(zhǔn)實(shí)驗(yàn)中展示出良好的魯棒性和準(zhǔn)確性。為了在融合任務(wù)中考慮語(yǔ)義信息,文獻(xiàn)[58]提出一種基于語(yǔ)義分割的生成對(duì)抗網(wǎng)絡(luò),該網(wǎng)絡(luò)可根據(jù)熱輻射信息和紋理細(xì)節(jié)的差異,通過(guò)掩模將每個(gè)源圖像分為前景和背景,對(duì)前景和背景使用不同的特征提取方法,以更好地保留源圖像的信息實(shí)現(xiàn)異源融合。上述兩種應(yīng)用代表了語(yǔ)義分割提取出的語(yǔ)義信息輔助多源遙感圖像精確配準(zhǔn)和融合的方向,越來(lái)越多的研究者通過(guò)語(yǔ)義分割剔除影響配準(zhǔn)精度的特征點(diǎn)或者區(qū)域,并提高了配準(zhǔn)和融合的速度,以便壓縮多源遙感圖像語(yǔ)義信息智能提取的時(shí)間。

2.3 基于多源遙感圖像的語(yǔ)義信息智能提取

經(jīng)過(guò)前兩步處理后,多源異構(gòu)遙感圖像完成配準(zhǔn)與融合,因此可以通過(guò)人工智能等先進(jìn)技術(shù)手段,利用不同數(shù)據(jù)來(lái)源的差異性和互補(bǔ)性,從多源/多時(shí)相遙感圖像中提取目標(biāo)的幾何物理信息、語(yǔ)義信息及其時(shí)序變化信息,從而得到目標(biāo)掩膜、有地物覆蓋分類(lèi)的語(yǔ)義地圖、變化信息圖,如道路及建筑物輪廓、水體情況以及地物目標(biāo)的多時(shí)相變化圖等。文獻(xiàn)[59]提出一種基于U-Net的語(yǔ)義分割方法,從高分辨率多光譜遙感圖像中提取建筑,利用GIS地圖數(shù)據(jù)集來(lái)改進(jìn)建筑物提取結(jié)果。文獻(xiàn)[60]提出一種雙流高分辨率網(wǎng)絡(luò)HRNet來(lái)合并兩種異構(gòu)數(shù)據(jù)(SAR和光學(xué)圖像),并利用多模態(tài)壓縮激勵(lì)模塊來(lái)融合特征圖。實(shí)驗(yàn)表明,該方法對(duì)GF2和GF3衛(wèi)星獲取的遙感數(shù)據(jù)具有良好的處理效果。文獻(xiàn)[61]提出了一種端到端的多源遙感圖像語(yǔ)義分割網(wǎng)絡(luò)MCENet,它通過(guò)協(xié)同增強(qiáng)融合模塊來(lái)挖掘多源遙感圖像的互補(bǔ)特征,其中協(xié)同融合模塊用于解決類(lèi)內(nèi)差異問(wèn)題,增強(qiáng)聚合模塊用于解決類(lèi)間相似問(wèn)題。MCENet還采用了一種多尺度解碼器,通過(guò)學(xué)習(xí)尺度不變性特征來(lái)提高模型對(duì)小目標(biāo)和大尺度變化的魯棒性。實(shí)驗(yàn)證明MCENet在參數(shù)數(shù)量和推理速度方面更具優(yōu)勢(shì)。隨著遙感數(shù)據(jù)的爆炸式增長(zhǎng),如何高效地利用多源遙感數(shù)據(jù)的互補(bǔ)性提取有用信息成為研究的重點(diǎn)。

3 多源遙感圖像語(yǔ)義分割面臨的技術(shù)挑戰(zhàn)

對(duì)于遙感圖像解譯而言,對(duì)地面覆蓋物進(jìn)行分類(lèi)是一項(xiàng)重要的任務(wù),而語(yǔ)義分割則可以解決這一問(wèn)題。隨著衛(wèi)星觀測(cè)數(shù)據(jù)的爆炸式增長(zhǎng),多光譜、高光譜、全色、紅外、SAR等遙感圖像的高效、快速融合分割是未來(lái)新的研究熱點(diǎn)。相比單源遙感數(shù)據(jù),多源遙感圖像的融合分割可以將同一地物的不同類(lèi)型進(jìn)行綜合,以獲得滿足狀態(tài)判讀和變化區(qū)域檢測(cè)等任務(wù)的高質(zhì)量信息,產(chǎn)生比單一傳感器圖像更加精準(zhǔn)、可靠的估計(jì)和判決。對(duì)于多源遙感圖像語(yǔ)義分割與變化檢測(cè)任務(wù)而言,遙感數(shù)據(jù)呈現(xiàn)多波段、多極化、多尺度和異質(zhì)性等特點(diǎn),目前,仍然面臨著許多挑戰(zhàn):

1)數(shù)據(jù)規(guī)模與標(biāo)注問(wèn)題。多源遙感圖像語(yǔ)義分割任務(wù)需要處理的數(shù)據(jù)規(guī)模龐大且多樣,每個(gè)數(shù)據(jù)源可能具有不同的特性、分辨率和覆蓋范圍。GPT等AI大模型在處理自然語(yǔ)言任務(wù)時(shí),依賴(lài)于大規(guī)模的語(yǔ)料庫(kù)進(jìn)行訓(xùn)練。類(lèi)似地,多源遙感圖像語(yǔ)義分割也需要大量的標(biāo)注數(shù)據(jù)來(lái)訓(xùn)練模型,以學(xué)習(xí)從圖像到語(yǔ)義標(biāo)簽的映射。然而,遙感圖像的標(biāo)注工作既耗時(shí)又耗力,且標(biāo)注質(zhì)量直接影響模型的性能。因此,如何獲取足夠多且質(zhì)量高的標(biāo)注數(shù)據(jù)是一個(gè)重要挑戰(zhàn)。

2)多源圖像之間的相關(guān)性度量問(wèn)題。在多源遙感圖像語(yǔ)義分割任務(wù)中,如何準(zhǔn)確度量不同來(lái)源圖像之間的相關(guān)性是一個(gè)重要的技術(shù)挑戰(zhàn)。由于不同遙感數(shù)據(jù)源可能采用不同的傳感器、分辨率和拍攝角度,因此圖像之間的信息含量、特征表示和噪聲水平可能存在顯著差異。這導(dǎo)致在融合這些圖像時(shí),需要解決不同數(shù)據(jù)源之間的信息對(duì)齊和互補(bǔ)問(wèn)題。具體來(lái)說(shuō),度量多源圖像之間的相關(guān)性需要考慮以下幾個(gè)方面:

(1) 特征空間的一致性:不同遙感圖像可能具有不同的特征空間,因此需要將它們轉(zhuǎn)換到一個(gè)共同的表示空間,以便進(jìn)行比較和融合。這通常需要復(fù)雜的特征轉(zhuǎn)換和校準(zhǔn)技術(shù)。

(2) 時(shí)空對(duì)齊:由于不同遙感數(shù)據(jù)源可能采用不同的拍攝時(shí)間和地點(diǎn),因此需要進(jìn)行精確的時(shí)空對(duì)齊,以確保圖像之間的信息能夠準(zhǔn)確對(duì)應(yīng)。這涉及到復(fù)雜的圖像配準(zhǔn)和校正技術(shù)。

(3) 信息互補(bǔ)性:不同遙感數(shù)據(jù)源可能包含不同的信息,例如光學(xué)圖像可能提供地表紋理和顏色信息,而雷達(dá)圖像可能提供地表形態(tài)和結(jié)構(gòu)信息。因此,在度量相關(guān)性時(shí),需要考慮如何充分利用這些互補(bǔ)信息,以提高分割的精度和可靠性。

3)在軌或終端處理的時(shí)效性保障。對(duì)于多源遙感圖像語(yǔ)義分割任務(wù)來(lái)說(shuō),時(shí)效性是一個(gè)至關(guān)重要的考慮因素。由于遙感數(shù)據(jù)量大、處理復(fù)雜度高,因此在軌或終端處理的時(shí)效性保障成為了一個(gè)技術(shù)挑戰(zhàn)。具體來(lái)說(shuō),保障時(shí)效性需要考慮以下幾個(gè)方面:

(1) 高效算法設(shè)計(jì):為了實(shí)現(xiàn)在軌或終端的快速處理,需要設(shè)計(jì)高效的算法來(lái)降低計(jì)算復(fù)雜度,包括采用輕量級(jí)的網(wǎng)絡(luò)結(jié)構(gòu)、優(yōu)化算法參數(shù)、使用并行計(jì)算技術(shù)等。

(2) 硬件加速:利用高性能計(jì)算設(shè)備和專(zhuān)用硬件加速器(如GPU、FPGA等)可以顯著提高處理速度。通過(guò)優(yōu)化硬件和軟件之間的協(xié)同工作,可以實(shí)現(xiàn)在軌或終端的實(shí)時(shí)處理。

(3) 數(shù)據(jù)流管理:對(duì)于大規(guī)模遙感數(shù)據(jù)流的管理和調(diào)度也是一個(gè)挑戰(zhàn)。需要設(shè)計(jì)有效的數(shù)據(jù)流管理策略,確保數(shù)據(jù)能夠高效地從數(shù)據(jù)源傳輸?shù)教幚斫K端,并及時(shí)進(jìn)行處理和分析。

4結(jié)束語(yǔ)

本文從遙感圖像解譯角度簡(jiǎn)述了多源遙感圖像融合語(yǔ)義分割的優(yōu)勢(shì),具體對(duì)單源遙感圖像語(yǔ)義分割、多源遙感圖像融合語(yǔ)義分割和多時(shí)相遙感圖像變化檢測(cè)的發(fā)展現(xiàn)狀進(jìn)行了概述,梳理了多源遙感圖像融合語(yǔ)義分割的理論脈絡(luò),并總結(jié)了多源遙感圖像語(yǔ)義分割的關(guān)鍵技術(shù),厘清了多源高分辨率遙感圖像融合語(yǔ)義信息提取的基本思路和大體框架。

隨著天基探測(cè)需求的不斷增大,以及AI大模型的井噴式發(fā)展,多源遙感圖像融合也面臨著許多新的機(jī)遇。對(duì)于多源遙感圖像融合語(yǔ)義分割有以下方面的研究展望:

(1)AI大模型的應(yīng)用將極大提升多源遙感圖像語(yǔ)義分割的精度和效率。這些模型經(jīng)過(guò)大規(guī)模數(shù)據(jù)的訓(xùn)練,能夠?qū)W習(xí)到豐富的特征和上下文信息,從而更準(zhǔn)確地識(shí)別并分割出不同地物類(lèi)別。同時(shí),隨著模型的不斷優(yōu)化和簡(jiǎn)化,其計(jì)算復(fù)雜度將逐漸降低,為在軌快速處理提供了可能。

(2)多源遙感圖像的處理將更加注重信息的融合與協(xié)同。不同數(shù)據(jù)源之間的信息互補(bǔ)性使得多源數(shù)據(jù)的融合成為提高語(yǔ)義分割精度的關(guān)鍵。基于AI大模型的多源融合語(yǔ)義分割技術(shù)將更加注重如何有效地融合不同數(shù)據(jù)源的信息,以充分利用各自的優(yōu)勢(shì),提高分割的準(zhǔn)確性和可靠性。

(3)在軌快速處理方面,隨著硬件技術(shù)的不斷進(jìn)步,高性能計(jì)算設(shè)備和專(zhuān)用硬件加速器將在衛(wèi)星上得到更廣泛的應(yīng)用。這些設(shè)備能夠提供強(qiáng)大的計(jì)算能力,支持AI大模型在軌實(shí)時(shí)處理多源遙感圖像。同時(shí),針對(duì)在軌環(huán)境的特殊需求,未來(lái)的技術(shù)還將更加注重能耗和重量的優(yōu)化,以確保在軌處理的高效性和可持續(xù)性。此外,隨著深度學(xué)習(xí)技術(shù)的不斷發(fā)展,新的算法和模型將不斷涌現(xiàn),為多源遙感圖像語(yǔ)義分割提供更強(qiáng)大的支持。例如,通過(guò)引入注意力機(jī)制、圖神經(jīng)網(wǎng)絡(luò)等先進(jìn)技術(shù),可以進(jìn)一步提高模型的分割精度和魯棒性;通過(guò)設(shè)計(jì)更加輕量級(jí)的模型結(jié)構(gòu),可以實(shí)現(xiàn)在軌快速處理的同時(shí)保持較高的性能。

隨著相關(guān)技術(shù)的不斷進(jìn)步和優(yōu)化,有理由相信未來(lái)多源遙感圖像語(yǔ)義分割將更加準(zhǔn)確、高效和可靠,為城市規(guī)劃、環(huán)境監(jiān)測(cè)、災(zāi)害預(yù)警等領(lǐng)域提供更強(qiáng)大的支持。