局部判別損失無監督域適應方法*

王姍姍,汪夢竹,駱志剛

(1.安徽大學計算智能與信號處理教育部重點實驗室,安徽 合肥 230039; 2.國防科技大學計算機學院并行與分布計算重點實驗室,湖南 長沙 410073)

1 引言

在計算機視覺領域,模型的成功依賴于是否有足夠多的標簽數據進行訓練。然而,收集數據往往需要耗費巨大的精力和時間,在現實場景中并不具有可實現性。無監督域適應[1-5]是針對該特定問題提出的一種解決方案,旨在利用來自不同領域但有相關性的源域知識輔助學習目標領域的信息,從而提升分類的精度。然而,領域之間的差異仍然是制約無監督域適應方法得以大規模應用的瓶頸,目前的域適應方法主要用于減小領域之間的分布差異。

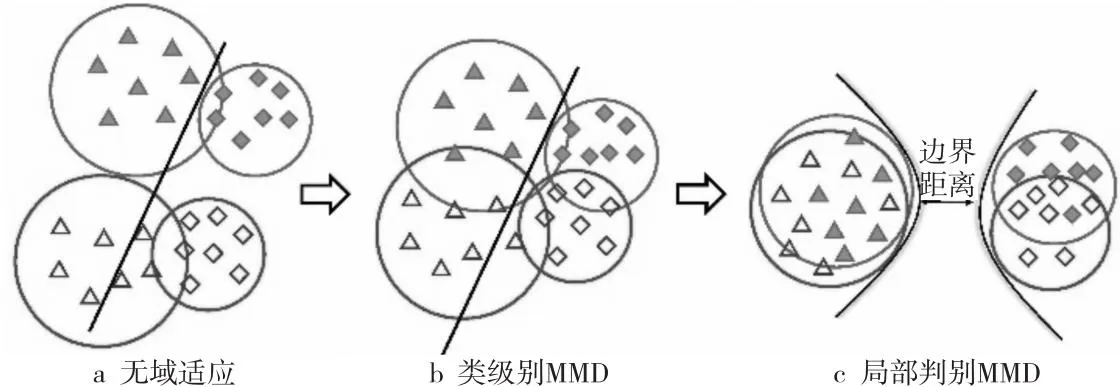

Figure 1 Motivation of the proposed method圖1 本文方法動機

為了降低域間分布差異帶來的負面影響,一系列方法[6-8]應運而生,其中大部分方法通過對齊域間分布來學習領域不變特征或分類器,如最大平均差異MMD(Maximum Mean Discrepancy)[9]和對抗學習[10,11]。但是,由于分布對齊是全局結構的邊緣對齊,模型易忽略細粒度的類級別條件分布信息,無法保證學習到的特征或分類器在目標領域內具有理想的判別能力。

因此,一個代表性的MMD變種——類級別MMD[12]被提出且廣泛用于量化領域間的條件分布差異,通過同時匹配全局結構的域級別信息和局部結構的類級別信息,從而實現邊緣分布和條件分布的聯合分布對齊。另外,文獻[13]從理論層面上重新審視了類級別的MMD方法,揭示實現最小化類級別的MMD等同于最大化源域和目標域的類內緊湊性,但如圖1所示(圖中無填充形狀表示源域,有填充形狀表示目標域),其忽略了特征的類間判別性,因此類級別的MMD方法可能會導致不同類別間的重疊。

受文獻[12,13]工作的啟發,本文擬從2個方面改進MMD的可判別性。一方面,為解決類別間的不平衡性問題,在對齊邊緣分布的基礎上,考慮對條件分布進行對齊。由于條件分布對齊需要利用標簽信息,而域適應中的目標域樣本不含標簽,因此首先需要為目標域樣本分配偽標簽。然后基于偽標簽,計算2個域中類級別MMD的權重,從而使難分類的類別與易分類的類別在域間分布中保持一致。另一方面,如圖1所示,盡管加權的類級別MMD方法考慮到每個類別的細粒度信息,但其忽略了類間的可判別性,容易導致類間樣本的不可分離性。因此,考慮到加權類級別MMD方法的缺陷,如圖1c所示,本文提出利用樣本特征建立一個富含更多信息的結構,用來學習具有判別性的特征。

在錨點樣本的升序列表中,將所有正樣本排列在負樣本之前,對樣本對進行局部對比損失的排序優化,并在不同類別的樣本之間設置一個強制邊界。盡可能為每一個樣本學習一個超球面,使正樣本對之間的距離小于閾值,從而既保持樣本之間的相似結構,又能實現類內緊致性和類間可分離性。

同時,為了捕獲長期依賴的精確位置信息,本文采用一種新的輕量級注意力機制,稱為協調注意力機制,協調注意力機制繼承了通道注意力機制的優點,可以模擬通道間的關系,有效提升模型的泛化性能。在5個數據集上進行實驗,本文的方法展現出了良好的效果。

本文工作是文獻[14]會議論文的擴展版本。與會議論文相比,本文進行了以下改進:將本文所提的方法擴展至注意力網絡結構中,具備了即插即用的效果;此外,在更多的數據集上驗證了本文方法的有效性。

本文主要工作總結如下:

(1)考慮了加權的類級別 MMD 方法和局部對比損失,提出了一種改進最大平均差異的無監督域自適應方法——局部判別損失域適應。

(2)從理論上分析加權的類級別 MMD 方法存在的問題,并闡述特征判別能力下降的原因。

(3)提出一種簡單有效、即插即用的域適應方法,提高了特征的可判別性,并將該方法擴展至注意力機制的網絡中,證明了其即插即用的泛化能力。

2 相關工作

針對無監督域適應問題,學術界曾提出了一系列縮小域間分布差異的方法。最大平均差異MMD[9]是其中的一種主流方法,通常用來對齊2個域之間的高維特征。條件 MMD方法[12]度量源域和目標域中經驗條件的希爾伯特-施密特核范數均值嵌入,最小化域間的均值差異,縮小域間分布差異。加權最大均值差異WMMD (Weighted Mean Maximum Discrepancy)[15]在原始的 MMD 方法的基礎上,利用源域和目標域的類別先驗概率,引入特定類級別的輔助權重。Long等人[12]提出的聯合分布適應JDA (Joint Distribution Adaptation)方法聯合了邊緣分布和條件分布,但該方法忽略了類別不平衡問題中類別權重的重要性。

另一類主流方法是借助對抗學習的思想縮小無監督域適應的域間分布差異。Wang等人[16]提出利用對抗學習的優化方法對齊特征,準確地遷移特征從而使域差異最小化。Wang等人[17]提出了一種自適應重加權的對抗域適應方法,但考慮的是遷移過程中樣本重要性的不同。Long 等人[18]提出了一種條件對抗方法,利用基于分類器預測獲得的判別信息構造對抗適應模型。 Li 等人[19]提出了一種距離損失,并將其應用至對抗域適應中,以應對平衡問題的挑戰。

與以上方法不同,本文方法旨在顯式地減少類級別的錯誤匹配,從而學習到具有判別性的領域不變特征。之前也有一些方法[20,21]從提高判別力的角度出發構造模型。Li等人[21]提出了領域不變表示和類判別表示DICD (Domain Invariant and Class Discriminative representations)方法,試圖同時最大化類間離散,最小化類內分散,改善類別的判別性特征。Satio等人[20]提出最大化分類差異MCD (Maximum Classifier Discrepancy)的方法,通過利用特定任務的決策邊界來調整源域和目標域的分布。

3 基于局部判別損失域適應

3.1 問題的定義

雖然使用 MMD 策略可以縮小2個域之間的分布差異,但僅用它還遠遠不夠,該策略依然受到2個方面的影響。一方面 MMD 方法未考慮類別間的不平衡性問題,易導致對齊過程中出現類間差異。另一方面,從文獻[13]中可知,最小化 MMD 方法等同于最大化源域和目標域之間的類內距離,由于類內距離和類間距離之間的關系互斥,類間距離無法得到約束,容易造成類間的重疊。為了解決這一問題,本文提出了一種判別策略來抑制 MMD 方法的不利影響,如圖2所示,其損失函數包括源域分類損失、局部對比損失和加權類級別MMD損失。

Figure 2 Unsupervised domain adaptation method圖2 無監督域適應方法

為解決類別間的不平衡性問題,本文首先提出采用加權類級別 MMD 的方法,但是基于權重分類的 MMD 方法忽略了特征的類間可分辨性,容易降低域的自適應性能。為提升判別性,在加權類級別MMD 的基礎上,本文擬為每一個類別設置一個保證邊界的策略,如圖 1c所示。同時,強行拉近正樣本對的距離,使其小于某個閾值。本文采用使每個樣本的超球面直徑小于某個閾值的方式代替簡單的拉近同類樣本的約束。在這2方面的作用下,本文能夠保持每個類別內樣本之間的相似性結構,并通過改進權重分類的 MMD 方法使其具有判別性。

3.2 加權類級別MMD方法

為了度量2個域之間的距離,本文采用域適應中常用的非參數度量方法:最大平均差異MMD方法[12]。它可以計算k維嵌入的源域特征均值與目標域特征均值之間的距離,計算公式如式(1)所示:

tr(ATSbA)=tr(ATSvA)-tr(ATSwA)

(1)

根據式(1),將加權的類級別MMD方法改寫如式(2)所示:

(2)

經過化簡之后,再次改寫式(2)可得式(3):

(3)

將式(3)代入式(2)后,可得式(4):

(4)

根據式(4)可以得出,加權類級別MMD方法的目標是最大化源域和目標域的類間距離,最小化源域和目標域的類內距離。但是,由于整個數據的方差為一個固定值,使用MMD使類內距離擴大時[13],類間的距離會越來越小。這樣不同的類別之間就會出現不同程度的混沌重疊,特征的可判別性就會大大降低。為了解決可判別性問題,本文設計了一個判別性策略,以提高類別的可判別特性。

3.3 判別性策略

與調和平均線性判別分析不同[22],本文的判別性策略為:給定一個選定的圖像樣本xi,盡可能將不同類別的樣本推至距離邊界β更遠的位置,將與其相同類別的樣本拉近至比邊界β-g更靠近的位置,因此2個邊界之間的邊界距離為g,如圖3所示。判別性策略的使用可以使任意的類別之間都具有一定的保證邊界。樣本對的損失函數的數學表達式如式(5)所示:

Ls(xi,xj,f(·))=(1-yij)·max(0,β-dij)+

yij·max(0,dij-(β-g))

(5)

其中,當yi=yj,即樣本標簽一致時,yij=1,表示樣本對為正樣本對;當yi≠yj時,yij=0,表示樣本對為負樣本對;dij=|f(xi)-f(xj)|2表示樣本對特征間的歐氏距離;xi和xj表示樣本;Ls表示樣本對的損失函數;f(xi)和f(xj)表示樣本特征。

Figure 3 Discriminative strategy圖3 判別性策略

對于所選樣本xi來說,由于不同的樣本到所選樣本的距離不同,為了充分平衡這層關系,本文根據它們與所選樣本的對應距離對樣本進行加權。在設計判別性策略的時候,本文考慮到每個樣本的可遷移性不同,從而給予每個樣本對不同的權重。為防止使用了加權的類級別MMD方法之后的模型過擬合,需減小易遷移樣本的權重,加大難遷移樣本的權重,所以權重策略表示如式(6)所示:

(6)

為了拉近所有正樣本的距離,并設置一個邊距來學習類別的超球面,本文將正樣本對的損失LP最小化為式(7):

(7)

其中f()表示訓練提取樣本特征的函數。

同樣地,為了使負樣本集Nc,i遠離邊界β之外,本文將負樣本損失LN最小化為式(8):

(8)

綜上,判別策略損失可以表示為式(9):

(9)

3.4 注意力機制

在通道注意力中,研究人員通常使用ResNet[23]網絡中的全局池化對空間信息進行全局編碼,但它將全局空間信息壓縮到通道描述符中,因此很難保留位置信息,而位置信息對于在視覺任務中捕獲空間結構至關重要。為了鼓勵注意模塊通過精確的位置信息在空間上捕捉遠程交互,本文將全局池化轉換為一對一維特征編碼操作。具體來說,給定輸入X,使用2個空間范圍的池核(H;1)或(1;W)分別沿水平方向坐標和垂直方向坐標對每個通道進行編碼。因此,第c個通道在高度h(0≤h (10) 類似地,第c個通道在寬度為w處的輸出表示為式(11): (11) 以上2種變換沿著2個空間方向進行特征聚合,返回一對方向感知注意力圖。這和擠壓激發SE模塊產生一個特征向量的方法截然不同,這2種變換允許注意力模塊捕捉到沿著一個空間方向的長程依賴,并保存沿著另一個空間方向的精確位置信息,這有助于網絡更準確地定位感興趣的目標。 具體來說,首先將式(10)和式(11)生成的聚合特征連接起來,接著將其輸入共享的1×1卷積變換函數F1(·),得到式(12): f=δ(F1([zh,zw])) (12) 其中,[·,·]表示沿空間維度的串聯操作,δ(·)是非線性激活函數,f∈RC/r×(H+W)是在水平方向和垂直方向上編碼空間信息的中間特征,zh表示經過編碼后的水平方向輸出特征,zw表示經過編碼后的垂直方向輸出特征。r用于控制卷積塊大小的縮小比。然后將f沿空間維度拆分為2個獨立的張量fh∈RC/r×H和fw∈RC/r×W,利用另外2個卷積變換Fh(·)和Fw(·),將fh和fw分別變換成具有相同通道數的張量,如式(13)所示: gh=σ(Fh(fh)), gw=σ(Fw(fw)) (13) 最后將輸出的gh和gw分別展開并用作注意力權重。協調注意模塊Y的輸出如式(14)所示: (14) 本文方法的目標是縮小域間差異,提高加權類級別MMD的可判別性。所以,本文所提模型通過注意力機制提取特征,在基本損失的基礎之上,加入了加權類級別MMD損失和判別性損失。總的損失函數Ltotal如式(15)所示: (15) 其中,Lc表示在源域樣本上的標準分類損失,p和q表示不同類別的樣本。 初始網絡模型采用在ImageNet2012數據集上預訓練得到的CNN模型,并對其進行微調。模型的訓練方式主要遵循標準的小批量隨機梯度下降算法。 本文在5個常用基準數據集上進行實驗,并將本文方法與域適應中的其他先進方法進行對比,從而驗證本文方法的有效性(方法的代碼已在https://github.com/dreamkily/A3N開源)。為了驗證本文方法的泛化性,數據集不僅包括 Office-31[24]、ImageCLEF-DA等小規模數據集,還包括 Office-Home[25]、VisDA-2017[26]和 DomainNet[27]大規模數據集。 (1)Office-31。Office-31是域適配領域的一個基準數據集。Office-31包含來自Amazon(A)、Webcam(W)和Dslr(D)3個領域的一共31種類別樣本,共4 652 幅圖像,可組成6項域適應任務,分別是A→W,W→A,W→D,D→W,A→D 和 D→A。 (2)ImageCLEF-DA。ImageCLEF-DA是域適應挑戰賽中的基準測試數據集。它包含3個域:Caltech-256(C)、ImageNet ILSVRC 2012(I)和Pascal VOC 2012(P)。每個域由12個類別組成,每個類別有50幅圖像樣本,共600幅圖像樣本。本文在所有6項挑戰性任務上進行方法評估,分別是 C→I,C→P,I→P,I→C,P→C,P→I。 (3)Office-Home。Office-Home是一個具有挑戰性的大規模數據集,包含65個類別共15 500幅圖像。它具有4個顯著不同的領域:Artistic (Ar),Clipart (Cl),Product (Pr)和Real-World (Rw)。本文在所有的12項挑戰性任務中進行方法評估。 (4)VisDA-2017。VisDA是一個非常大且具有挑戰性的域適應數據集,包含來自3個不同領域的12個類別,一共有超過280 000幅圖像。3個領域分別是訓練領域(Synthetic)、驗證領域(Real)和測試領域。 (5)DomainNet。DomainNet是迄今為止最大且最具挑戰性的域適應數據集。它包含來自6個不同領域的345個類別的圖像,共計約60萬幅。6個領域分別是Clipart(clp),Infograph(inf),Painting(pnt),Quickdraw(qdr),Real(rel)和Sketch(skt)。每個領域分別作為源域和目標域,共可以構建出30項域適應任務:clp→inf,…,skt→rel。 采用PyTorch平臺實現本文提出的方法,通過加權衰減為5×10-4、動量為0.9的小批量隨機梯度下降優化模型。使用以下方式調整,其中θ在訓練過程中從0到1線性變化,參數ηθ=η0/(1+αθ)β,參數α=10,β=0.75,用參數θ改變λ1,設λ1=2e-10θ-1,λ2=0.01,設置批數為32。 為了與其他域自適應方法進行比較,本文選擇了一些經典的和最新的高性能深度學習方法,包括遷移成分分析TCA (Transfer Component Analysis)[29]、測地線流核GFK (Geodesic Flow Kernel)[30]、深度域混淆DDC (Deep Domain Confusion)[31]、深度適應網絡DAN (Deep Adaptation Network),[32]、 域對抗神經網絡DANN (Domain Adversarial Neural Network)[10]、聯合對抗網絡JAN (Joint Adversarial Network)[12]、殘差遷移網絡RTN (Residual Transfer Network)[33]、條件領域對抗適應網絡CDAN (Conditional Domain Adversarial Network)[18]、對稱網絡SymNet (Symmetric Network)[34]、對抗性判別領域適應ADDA (Adversarial Discriminative Domain Adaptation)[28]、增強版協作對抗網絡iCAN (incremental Collaborative and Adversarial Network)[35]、域適應的可遷移注意力TADA (Transferable Attention for Domain Adaptation)[16]、多對抗領域適應MADA (Multi-Adversarial Domain Adaptation)[36]、深度子域自適應網絡DSAN (Deep Subdomain Adaptation Network)[37]、批量核范數最大化BNM (Batch Nuclear-norm Maximization)[38]、逐步自適應特征范數SAFN (Stepwise Adaptive Feature Norm)[39]、切片沃瑟斯坦差異SWD (Sliced Wasserstein Discrepancy)[40]和跨域梯度差異最小化CGDM (Cross-domain Gradient Discrepancy Minimization)[41]。 (1)Office-31上的實驗結果。Office-31是領域自適應研究方法中應用最廣泛的數據集之一,各方法在該數據集上的實驗結果如表1所示,其中,*代表無注意力機制,結果出自會議論文。 可以看出,本文提出的方法在現有的遷移學習任務中優于大多數對比方法。值得注意的是,本文通過加大難遷移樣本權重,降低容易遷移樣本權重的方法,大大提高了難遷移任務的分類精度,如D→A 任務中源域和目標域的分布差異顯著不同,而 W→A任務中源域數據集的規模比目標域規模小,但在這2個遷移任務中,本文方法表現出了相當高的性能。從表1可以看出,本文方法非常接近全監督設置結果的上界。 Table 1 Recognition accuracies on Office-31 dataset表1 Office-31數據集上的識別精度 % (2)ImageCLEF-DA上的實驗結果。Office-31數據集中的對象都來自辦公場景,與之不同,ImageCLEF-DA數據集中的對象資源更加多樣化。在ImageCLEF-DA數據集上對本文提出的方法進行了評估,以驗證其在不同場景下的有效性。在ImageCLEF-DA上使用ResNet-50作為本文方法的骨干網絡。從表2可以看到,本文方法優于對比方法,盡管任務變得更具有挑戰性,但該方法的識別精度基本都有提高。除Pascal數據集外,在其他數據集上的評估中,本文方法的識別精度均在90%以上。這表明,本文所提方法不僅適用于廣泛應用于辦公場景,而且還適用于更加多樣化的場景。 (3)Office-Home上的實驗結果。本文在Office-Home數據集上驗證本文方法在大規模數據場景下的泛化性。實驗依然采用ResNet-50作為本文方法的骨干網絡,結果如表3所示。從表3中可以看出,與最近報道的幾個著名的深度域自適應方法相比,本文方法的平均分類精度最優。 Table 2 Recognition accuracies on ImageCLEF-DA dataset表2 ImageCLEF-DA數據集上的識別精度 % (4)VisDA-2017和DomainNet上的實驗結果。本文遵循與CDAN[18]相同的實驗協議,并與最近在VisDA-2017和DomainNet數據集上報道的幾種深度方法的結果進行了比較,結果如表4和表5所示。從2個表可以看出,本文方法在平均分類精度方面取得了有競爭力的結果。 4.2.1 消融實驗 為了驗證本文方法各個部分所起的作用,本節在Office-31數據集上對不同策略下本文方法的不同變種進行消融實驗,結果如表6所示。ResNet-50的基線結果表示只使用源域分類器,且沒有MMD策略參與。ResNet+類級別MMD表示考慮類級別 MMD,識別性能從76.1%提高到了84.3%。ResNet-50+加權類級別MMD代表本文方法,即加權的類級別對齊方法,識別性能提高到了88.3%,加上注意力機制后,識別性能達到了88.6%。 Table 3 Recognition accuracies on Office-Home dataset 表3 Office-Home數據集上的識別精度 % Table 4 Recognition accuracies on VisDA-2017 dataset 表4 VisDA-2017數據集上的識別精度 % Table 5 Recognition accuracies on DomainNet dataset表5 DomainNet數據集上的識別精度 % Table 6 Ablation experiments on Office-31 dataset表6 Office-31數據集上的消融實驗 % 從表6可以看出,本文方法既得益于加權類級別的權重MMD,也受益于判別策略,注意力機制也對其性能的提升起到了作用。 4.2.2 特征可視化 本文在圖4a和圖4b中展示了任務A→W的可視化結果。特征分別由ResNet-50和本文方法進行提取,然后使用t-隨機鄰近嵌入t-SNE (t- distributed Stochastic Neighbor Embedding)嵌入特征[42]并進行特征可視化。圖4a容易造成一些難對齊樣本點分類錯誤。與之相比,圖4b顯示相同的類別非常接近,具有良好的對齊特性,這驗證了本文方法的有效性。結果表明,該方法學習到的特征在2個域之間可以很好地對齊,且保留了更多的類間判別性。 Figure 4 t-SNE figure圖4 t-SNE圖 4.2.3 域適應分布差異的量化 圖5給出了ResNet-50、CDAN和本文方法的A距離。A距離被廣泛用來度量分布散度,而且距離越小代表分布對齊越好。從圖5可以看出,本文方法能夠實現比CDAN更小的A距離,這意味著本文方法能夠更好地對齊2個域。 Figure 5 A-distance to quantitative distribution discrepancy圖5 A-distance量化域間分布差異 本文提出了一種新的無監督域適應方法,采用改進的加權 MMD 方法提升本文方法的判別性。具體地說,該方法包括3個主要部分:樣本判別構造模塊、加權的類級別MMD模塊和偽標簽分配模塊。其中,樣本判別構造模塊用于構造一個類間判別性損失,以衡量不同類別之間的差異;加權的類級別MMD模塊用于對齊不同域之間的特征分布;偽標簽分配模塊用于為每個樣本分配一個偽標簽,以幫助更好地學習。與以往的度量學習[43]、解耦表示學習[44]和對抗域適應方法訓練困難、收斂緩慢相比,本文方法實現簡單、收斂速度快且即插即用,在域適應數據集上的綜合實驗驗證了該方法的有效性。在未來的工作中,計劃基于此方法構建更有效的具有判別性的加權類級別 MMD,并將本文方法擴展到其他深度無監督域適應研究上,如跨域行人重識別,單目標、多目標跟蹤和視頻時刻檢索場景。3.5 本文模型網絡結構

4 實驗與結果分析

4.1 數據集與實驗設置

4.2 與當前先進方法的對比分析

5 結束語