AFBCNet:一種基于自適應(yīng)濾波器組的運動想象卷積神經(jīng)網(wǎng)絡(luò)*

申佳華,代成龍,李光輝

(江南大學(xué)人工智能與計算機學(xué)院,江蘇 無錫 214122)

腦-機接口技術(shù)(Brain-Computer Interface,BCI)歷經(jīng)三十多年的發(fā)展,逐漸架起了人與外部設(shè)備溝通的橋梁[1]。BCI 系統(tǒng)可以分析人腦的神經(jīng)活動,然后通過解碼技術(shù)讓人類能夠操控外部設(shè)備或者與外部直接通信。其中,基于腦電信號(Electroencephalogram,EEG)的BCI 得到了最廣泛的應(yīng)用,主要原因是非侵入式的EEG 信號采集成本相對較低、安全無創(chuàng),且基于EEG 的BCI 便于安裝與攜帶。目前,BCI 技術(shù)的應(yīng)用主要包括:①幫助病人進行身體康復(fù),比如中風(fēng)患者[2];②監(jiān)測人體狀況[3];③運動神經(jīng)受損人群的器官替代,比如操控輪椅和假肢[3];④為健康人群設(shè)計輔助功能,比如人體增強[4]。可見,BCI 系統(tǒng)有著非常廣泛且有前景的應(yīng)用,而EEG 的解碼技術(shù)成為了影響B(tài)CI 發(fā)展的主要因素之一,尤其是基于運動想象(Motor Imagery,MI)[5]的EEG 解碼。

MI-EEG 信號的解碼與分類問題是BCI 領(lǐng)域最具有挑戰(zhàn)性的任務(wù)之一[6]。現(xiàn)有的MI-EEG 的分類方法主要分為傳統(tǒng)的機器學(xué)習(xí)方法和深度學(xué)習(xí)方法,其中基于深度學(xué)習(xí)的方法在近年來逐漸超越了傳統(tǒng)機器學(xué)習(xí)方法,成為了MI-EEG 分類中最具前景的研究方向之一。

傳統(tǒng)的機器學(xué)習(xí)方法通常由信號的預(yù)處理、特征提取和特征分類三個部分組成。在信號的預(yù)處理階段,通常會采用帶通濾波器、典型相關(guān)分析(Canonical Correlation Analysis,CCA)[7]或者獨立成分分析(Independent Components Analysis,ICA)[8]等技術(shù)對MI-EEG 信號中的偽跡進行剔除,從而提高信噪比。在特征提取階段,目前的研究主要集中在空間濾波和黎曼幾何(Riemannian Geometry,RG)協(xié)方差學(xué)習(xí)上,比如共空間模式(Common Spatial Pattern,CSP)[6]、濾波器組共空間模式(Filter Bank Common Spatial Pattern,F(xiàn)BCSP)[9]等。在特征分類階段,主要使用線性判別分類器(Linear Discriminant Analysis,LDA) 和支持向量機(Support Vector Machine,SVM)等方法進行分類。盡管基于CSP 以及其改進的方法能夠得到不錯的結(jié)果,并且能夠進行快速訓(xùn)練和相對簡單的部署,但是傳統(tǒng)的機器學(xué)習(xí)方法的特征選擇過程非常依賴專業(yè)的先驗知識,并且這類方法通常會造成特征丟失和節(jié)律退化。

近年來,隨著深度學(xué)習(xí)在許多領(lǐng)域取得了很好的成績,BCI 領(lǐng)域的研究人員也開始積極地探索適合于MI-EEG 的解碼網(wǎng)絡(luò)的設(shè)計方法。Li 等[10]將α(8 Hz~13 Hz)和β(13 Hz~30 Hz)頻段劃分為10個時間窗口和3 個子帶,然后對每個子帶的時間窗口求平均功率,因此每個電極都獲得了多個平均功率作為時頻特征,其次通過插值算法將其排列到電極坐標圖上,得到一組復(fù)雜的特征圖,最后輸入改進的VGG 網(wǎng)絡(luò)進行訓(xùn)練。DFFN[11]采用CSP 進行空間濾波,然后計算時域?qū)?shù)功率并作為特征輸入類似于DenseNet 的網(wǎng)絡(luò)進行訓(xùn)練。Sakhavi 等[12]基于FBCSP 算法和通道卷積,提出了通道混合模型來提取了腦電信號的時空特征。Tabar 等[13]使用短時傅里葉變換重構(gòu)了腦電數(shù)據(jù)的時頻二維圖像,然后輸入堆疊式自編碼器進行訓(xùn)練。Zhao 等[14]結(jié)合強化學(xué)習(xí)和圖卷積方法來提高性能,采用深度強化學(xué)習(xí)來自動預(yù)測給定的大腦網(wǎng)絡(luò)所需的最佳特征傳播次數(shù),提高了網(wǎng)絡(luò)的泛化能力。RTGNN[15]使用張量分解來提取公共特征空間中每個視圖的圖結(jié)構(gòu)特征,并且通過強化學(xué)習(xí)過濾不相關(guān)的鄰居節(jié)點以提高性能。Schirrmeister 等[16]受到FBCSP 算法設(shè)計理念的啟發(fā),提出了一種時空雙步卷積(先時域卷積提取特定頻帶信號,然后空間卷積提取空間特征)的淺層解碼網(wǎng)絡(luò)ShallowNet,通過時空濾波器分解MIEEG 信號,并且在MI 數(shù)據(jù)集上與傳統(tǒng)的方法相比具有更高的精度。EEGnet[17]借鑒了時空雙步卷積的思想,提出了一種通用的輕量化網(wǎng)絡(luò)模型,尤其是在空間卷積上采用了Depthwise 卷積,對特定頻帶的信號逐層空間卷積,使信號得到進一步的分解。TCNet[18]在EEGnet 的基礎(chǔ)上引入了時域卷積網(wǎng)絡(luò)(Temporal Convolutional Networks,TCNs),進一步挖掘雙步卷積后的時域特征,并用驗證了TCNs 的有效性。上述幾種基于時空分解的神經(jīng)網(wǎng)絡(luò)模型在進行時域卷積時,使用的是傳統(tǒng)的卷積層,但是傳統(tǒng)的卷積層通常會聚焦于低頻部分而不善于學(xué)習(xí)窄帶信息。FBCNet[19]借鑒了FBCSP 的頻帶劃分模式,將4 Hz~40 Hz 的頻段劃分為9 個子頻帶來取代傳統(tǒng)時域卷積CNN,模型無需通過卷積層學(xué)習(xí)如何提取特定頻帶信息,并且利用方差層來進一步挖掘時空分解后的時域特征,然而這種方法會帶來頻帶切割的固化,從而不利于分解MI-EEG 信號。Zhao 等[20]利用領(lǐng)域遷移的技術(shù),同時訓(xùn)練了分類器、特征提取器和領(lǐng)域識別器,聯(lián)合優(yōu)化了中心損失、對抗損失和分類損失。Zhang 等[21]提出了一種類似于Inception的結(jié)構(gòu),并進行堆疊,使用多尺寸的卷積核提取特征,并通過添加高頻噪聲提升模型的性能,雖然這種Inception 模塊具有良好的性能,但是過大的卷積核也會造成參數(shù)量過多和過擬合的問題。

綜上所訴,為了解決傳統(tǒng)卷積層時域卷積存在的缺陷和頻帶組合模式固化問題,本文改進了時空雙步卷積過程,在時域卷積上采用了一種自適應(yīng)的矩形濾波器,這種方法可以讓模型自主學(xué)習(xí)最優(yōu)頻帶組合,通過對矩形帶通濾波器設(shè)計的先驗知識,用較少的參數(shù),使得濾波器的學(xué)習(xí)更加容易、收斂更加快速。這種自適應(yīng)的分解方式可以很容易地應(yīng)用到不同的受試者,并且對于不同的受試者,可以學(xué)習(xí)到不同的濾波器組。為了解決Inception 結(jié)構(gòu)的參數(shù)過多與過擬合問題,本文結(jié)合了深度可分離卷積(Depthwise Separable Convolution,DSC)和膨脹卷積的方法改進Inception 結(jié)構(gòu),既保持了性能也減少了參數(shù)數(shù)量。此外,目前大多數(shù)研究都集中在二分類任務(wù)上(如BCICIV_2b 數(shù)據(jù)集[16]),多分類任務(wù)的研究進展較為緩慢且大多數(shù)四分類算法的精度偏低(如BCICIV_2a 數(shù)據(jù)集[16],平均精度通常在68%~78%),還不足以應(yīng)用到實際場景且不足以進行輕量化設(shè)計與部署。相比于近年來的先進方法,本文所提出的基于自適應(yīng)濾波器組的運動想象卷積神經(jīng)網(wǎng)絡(luò)(Adaptive-Filter-Bank Convolutional Network,AFBCNet)極大地提高了模型的可解釋性與精確度。

本文剩余部分的行文結(jié)構(gòu)如下:第1 章介紹本文所用到的方法和技術(shù)。第2 章介紹所提出的模型。第3 章介紹實驗設(shè)置、開展實驗與分析討論。第4 章為總結(jié)。

1 相關(guān)方法簡介

1.1 深度可分離卷積

傳統(tǒng)的卷積神經(jīng)網(wǎng)絡(luò)在圖像分析、自然語言處理等領(lǐng)域取得了非常優(yōu)異的成績,通常使用深層、多尺度的卷積層來提取淺層到復(fù)雜的特征信息。卷積神經(jīng)網(wǎng)絡(luò)采用局部連接的方式來代替矩陣的乘法運算,從而降低了計算成本,同時也得到了更好的性能。給定輸入Xc+i-1,t+j-1,m(尺寸為C×T×M),傳統(tǒng)卷積核Ki,j,m,n(尺寸為Ck×Tk×M×N)的運算公式為:

然而,同時在一個計算步驟中整合空間和通道信息的計算量也依然較大。因此,基于拆分運算思想的DSC 應(yīng)運而生。與傳統(tǒng)卷積不同的是,DSC 將卷積運算分成了兩個簡單卷積運算,即先做DC(Depthwise Convolution)運算,然后做PC(Pointwise Convolution)運算。DC 對每個特征層分別使用一個卷積核,然后將所有卷積核的輸出拼接疊加在特征層維度。因此,DC 運算沒有整合通道上的特征信息,而后的PC 運算就可以彌補這個缺點。PC 實際上就是(1×1)的傳統(tǒng)卷積,這主要起到了兩個作用:①能夠自由地改變通道的數(shù)量;②能夠?qū)C 輸出的數(shù)據(jù)進行通道信息整合。DC 和PC 的運算公式分別為:

式中:和分別是DC 卷積核與PC 卷積核,Xc,t,m和Xc,t,n是DC 運算和PC 運算的輸出。因此,DSC在運算效率和參數(shù)規(guī)模上都遠遠優(yōu)于傳統(tǒng)卷積。

1.2 自適應(yīng)濾波器組

傳統(tǒng)的時域卷積很難應(yīng)對MI-EEG 數(shù)據(jù)的低信噪比、訓(xùn)練樣本少和學(xué)習(xí)難等問題,并且學(xué)習(xí)到的濾波器包含很大的噪聲,而自適應(yīng)濾波器組(Adaptive Filter Bank,AFB) 能夠解決傳統(tǒng)卷積帶來的問題[22]。首先通過對濾波器形狀的先驗知識,構(gòu)造矩形帶通濾波器g[t,f],其中f代表少量的可學(xué)習(xí)參數(shù)。g[t,f]的頻域特性可以表示為兩個低通濾波器的差分運算:

式中:rect(·)代表矩形函數(shù),f1、f2分別是可學(xué)習(xí)的低截止頻率和高截止頻率。G[f,f1,f2]經(jīng)過逆傅里葉變換得到其時域的表達式為:

式中:截止頻率的初始化范圍為[0,fs/2](fs為采樣頻率),且f2≥f1≥0。因此,通過先驗知識設(shè)計的濾波器g[t,f1,f2]是可微分的,可以與深度學(xué)習(xí)模型中的其他參數(shù)一起進行傳播優(yōu)化。最后,由于g[t,f1,f2]的離散近似特性,AFB 得到的帶通濾波器是非理想的且可能在通帶產(chǎn)生波紋,在阻帶產(chǎn)生有限的衰減。因此,為了平滑g[t,f1,f2]的截斷特性,在g[t,f1,f2]上乘上漢明窗口ω[t],其表達式為:

式中:a0=0.538 36[22],L為窗口長度。因此,給定輸入MI-EEG 信號X[t],其運算過程為:

1.3 Inception 模塊

隨著深度學(xué)習(xí)的研究與發(fā)展,深層的模型已經(jīng)逐漸遍布各個研究領(lǐng)域。雖然深層的模型能夠擬合任何連續(xù)函數(shù),但是隨著層數(shù)的加深,模型會出現(xiàn)過擬合、梯度消失、模型性能停滯、內(nèi)存開銷大等問題。因此,Inception 模型的初衷就是為了解決卷積神經(jīng)網(wǎng)絡(luò)的性能問題和計算內(nèi)存開銷問題。

Inception 模塊通過并行不同尺寸的卷積核和池化層來提取特征,并且通過(1×1)的卷積核來減少通道數(shù)量。計算機視覺中,最常用的卷積核為(3×3)和(5×5)。在MI-EEG 分類研究中,Inception 結(jié)構(gòu)最常用的卷積核為(1×25)、(1×75)與(1×125)[21],但是這也帶來了巨大的計算量和內(nèi)存開銷,并且在小樣本的MI 數(shù)據(jù)集上很容易過擬合。因此,如何改進Inception 結(jié)構(gòu)讓其適用于MI-EEG 的分類任務(wù)成為了一個難點。雖然Inception 從提高性能和減少計算量的角度提出了分解卷積核和空間分解非對稱卷積等方法,但是這在MI-EEG 上很難適用。本文所提出的通過膨脹卷積和DSC 等方法來改進Inception 模塊成為了一種新的解決方案。

2 AFBCNet 框架

本文提出了一種基于自適應(yīng)濾波器組的卷積神經(jīng)網(wǎng)絡(luò),其四分類任務(wù)的網(wǎng)絡(luò)框架如圖1 所示(以BCICIV_2a 數(shù)據(jù)集為例),網(wǎng)絡(luò)詳細設(shè)計參數(shù)如表1 所示。AFBCNet 主要包括三個模塊:①信號分解模塊;②Inception 時域特征提取模塊;③特征整合及分類模塊。

圖1 所提出模型的網(wǎng)絡(luò)架構(gòu)示意圖

表1 AFBCNet 網(wǎng)絡(luò)設(shè)計框架

首先,信號分解模塊借鑒了EEGnet 的時空雙線性分解技術(shù)[17]和FBCnet 的頻帶切割策略[19]。因此,該模塊由AFB 和Depthwise 空間卷積兩部分構(gòu)成。AFB 通過對濾波器形狀的先驗知識規(guī)定了卷積核的頻率特性,從而降低了模型的學(xué)習(xí)難度,因此更加適合小樣本的MI-EEG 數(shù)據(jù)集。第一步,AFB 通過F1個(1×16)的卷積核沿著原始MI-EEG信號E(E∈RC×T)的時間軸進行卷積,提取出F1組最優(yōu)頻帶的MI-EEG 序列。第二步,Depthwise 空間卷積層對第一步時域分解得到的F1層最優(yōu)頻帶的特征圖分別做D次空間卷積,卷積核大小為(C,1)。這種時空分解的方法能夠讓特定頻帶的信號得到多個空間濾波器,同時可以靈活地調(diào)節(jié)時空分解的粗細程度。此外,本文在每組濾波器后面增加批量歸一化層加快收斂,并在信號分解后采用平均池化來減小時間維度。

其次,本文利用改進的Inception 結(jié)構(gòu)進一步提取信號分解模塊得到的多頻帶時域信息,其網(wǎng)絡(luò)結(jié)構(gòu)如圖2 所示。雖然很多研究者嘗試使用不同的方法提取時空特征提取后的多頻帶時域信息,如TCNs[18]、方差層[19]等,但是在MI-EEG 分類上的性能提升有限。本文借鑒Inception v3 的設(shè)計思路并且結(jié)合深度可分離卷積與膨脹卷積來改進Inception結(jié)構(gòu)。相關(guān)研究表明[21],較大尺度的卷積核更有利于提取MI-EEG 信號特征,但是這也會帶來很多問題,比如參數(shù)過多、容易過擬合等。為了解決這些問題,本文采用DSC 來替代傳統(tǒng)的卷積核,并且通過將較大的DSC 卷積核拆分成兩個較小的DSC 卷積核的方式來減少參數(shù)量和運算。但是這種做法也帶來了感受野減小的問題。因此,本文在第二個較小的DSC 卷積核上加上膨脹系數(shù),使得感受野擴大到原來的平方倍。此外,本文在兩個較小的DSC 層之間加入批量歸一化層和ELU 激活函數(shù),并且在特征圖拼接之前,采用平均池化進一步減小時間維度。

圖2 改進的Inception 網(wǎng)絡(luò)結(jié)構(gòu)示意圖

最后,本文通過一層DSC 來整合Inception 模塊提取到的特征,并用全局平均池化將數(shù)據(jù)特征降維到F2個特征點。為了避免過擬合以及減少計算復(fù)雜性,網(wǎng)絡(luò)中沒有添加額外的全連接層,而是直接將F2個特征點輸入Softmax 分類器進行分類輸出。

3 實驗與分析

3.1 數(shù)據(jù)描述與預(yù)處理

本文采用了由格拉茨科技大學(xué)知識發(fā)現(xiàn)研究所腦-機接口實驗室提供的運動想象數(shù)據(jù)集[16],分別為四分類的BCICIV_2a 數(shù)據(jù)集與二分類的BCICIV_2b數(shù)據(jù)集。

BCICIV_2a 數(shù)據(jù)集是基于線索的無反饋四分類(左手、右手、雙腳和舌頭)數(shù)據(jù)集,該數(shù)據(jù)集采集了9 名受試者兩天的腦電數(shù)據(jù),其中包括22 通道的EEG 數(shù)據(jù)與3 通道的眼電數(shù)據(jù),采樣頻率為250 Hz,每個通道都經(jīng)過了0.5 Hz~100 Hz 的帶通濾波器和50 Hz 的陷波濾波器進行預(yù)處理。9 名受試者分別經(jīng)歷了兩天的采集實驗,每天進行6 輪采集,每輪采集48 條腦電數(shù)據(jù)(其中,四類任務(wù)各12 條)。本文使用第一天采集的數(shù)據(jù)作為訓(xùn)練集,第二天采集的數(shù)據(jù)作為測試集。此外,本文采用相關(guān)研究中常見的[0,4]s 線索后時間窗切割數(shù)據(jù)集。綜上,BCICIV_2a數(shù)據(jù)集包含9 個子數(shù)據(jù)集,每個數(shù)據(jù)集有288 條樣本,其尺寸為(22×1000)。

本文所采用的第二個數(shù)據(jù)集為BCICIV_2b 數(shù)據(jù)集,該數(shù)據(jù)集是基于線索的二分類數(shù)據(jù)集(左右手),也來源于9 名不同的受試者。數(shù)據(jù)集的采集頻率和濾波處理與BCICIV_2a 數(shù)據(jù)集一致。不同點在于BCICIV_2b 數(shù)據(jù)集只采集了6 個通道的數(shù)據(jù)(3 通道EEG 數(shù)據(jù)與3 通道眼電數(shù)據(jù))并且進行了五天的采集。該數(shù)據(jù)集前兩天采集的數(shù)據(jù)為無反饋的實驗范式,后三天采集的數(shù)據(jù)為有反饋的實驗范式。本文將前三天的數(shù)據(jù)集作為訓(xùn)練集,后兩天的數(shù)據(jù)集作為測試集,其每個樣本的尺寸為(3×1 000)。

目前大多數(shù)研究都對MI-EEG 數(shù)據(jù)集進行帶通濾波處理,為了降低自適應(yīng)濾波器組的學(xué)習(xí)難度、加快學(xué)習(xí)速度,本文對上述數(shù)據(jù)集進行了4 Hz~40 Hz的帶通濾波并剔除人工標記的臟數(shù)據(jù)。此外,本文不對數(shù)據(jù)集做任何預(yù)處理,使用原始的數(shù)據(jù)進行學(xué)習(xí),從而避免特征丟失。

3.2 實驗設(shè)置

本文采用的學(xué)習(xí)批次大小為64,損失函數(shù)為分類交叉熵,采用Adam 算法作為優(yōu)化算法,學(xué)習(xí)率設(shè)置為0.001,激活函數(shù)使用ELU 函數(shù),模型層的參數(shù)初始化采用標準Glorot 方法,Dropout 參數(shù)本文設(shè)置為0.7,K1、K2設(shè)置為7 和9。由于兩種數(shù)據(jù)集的通道數(shù)和任務(wù)難度不同,所以本文單獨設(shè)置了網(wǎng)絡(luò)模型中的F1和D參數(shù),BCICIV_2a 數(shù)據(jù)集的F1、D設(shè)置為32、4;BCICIV_2b數(shù)據(jù)集的F1、D設(shè)置為16、2。實驗的編程語言為Python3,深度學(xué)習(xí)框架為Tensorflow2.4,并且通過Nvidia GeForce RTX 3090 顯卡進行訓(xùn)練。

本文將劃分出來的訓(xùn)練集再劃分為訓(xùn)練集(占原訓(xùn)練集的80%)和驗證集(占原訓(xùn)練集的20%)。由于訓(xùn)練集的樣本較少,充分利用驗證集的訓(xùn)練策略更加適用于MI-EEG 數(shù)據(jù)集。因此,本文借鑒了計算機視覺領(lǐng)域開發(fā)的兩階段訓(xùn)練策略并加以調(diào)整[16]:①第一階段,通過早期停止策略用訓(xùn)練集訓(xùn)練模型,并且監(jiān)測驗證集的精度。當(dāng)驗證集精度歷經(jīng)200 輪訓(xùn)練不增加時,就滿足早期停止條件。此時,將模型的參數(shù)回滾到當(dāng)驗證集達到最佳精度時的模型參數(shù);②第二階段,加載第一階段保存的模型參數(shù),繼續(xù)在驗證集和訓(xùn)練集上訓(xùn)練,當(dāng)驗證集的損失值小于等于第一階段訓(xùn)練集損失值時,停止訓(xùn)練并保存模型。

3.3 評價指標

為了評估提出方法的性能,本文采用兩種最常見的指標進行性能評價,即精確度(Accuracy,Acc)和K系數(shù)(Kappa)。其公式分別為:

式中:TP、TN、FP 和FN 分別代表真正例、真反例、假正例和假反例,prand代表隨機猜測的準確度。若不剔除臟數(shù)據(jù),則四分類的prand=0.25。

3.4 單被試分類對比實驗

3.4.1 BCICIV_2a 對比實驗

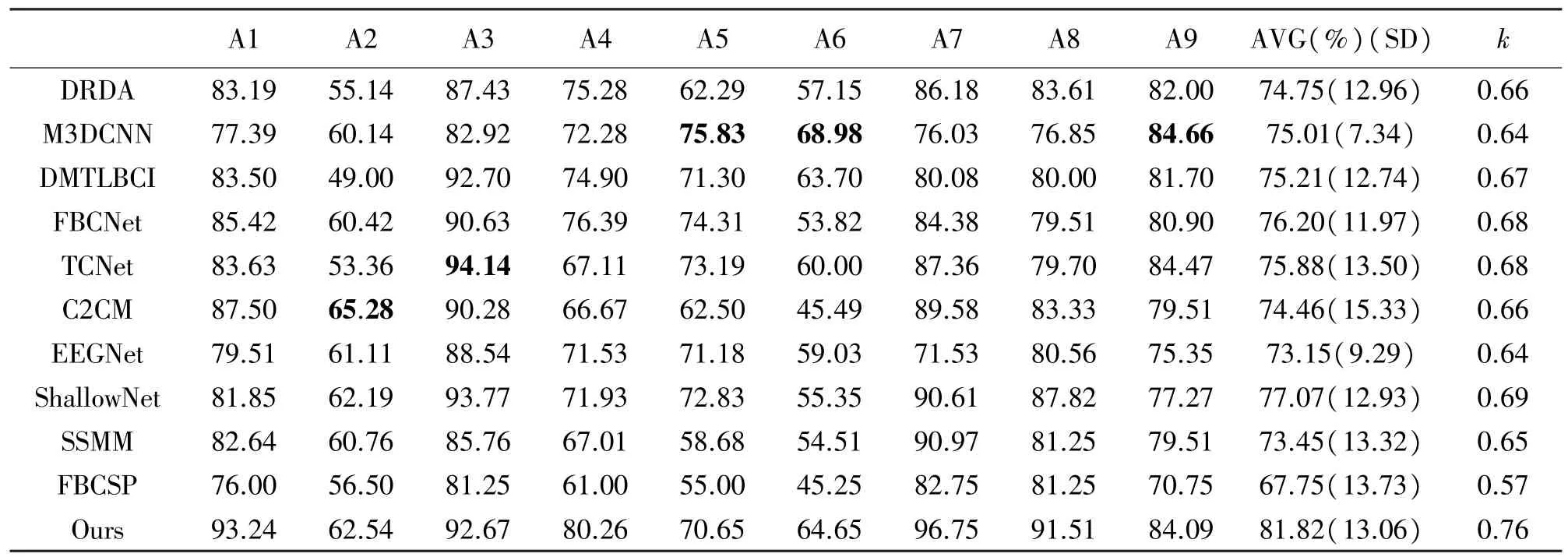

為了證明所提方法的有效性和精確性,本文首先在BCICIV_2a 數(shù)據(jù)集上進行四分類任務(wù)的對比實驗。本小節(jié)展示了所提方法與基于深度學(xué)習(xí)和傳統(tǒng)機器學(xué)習(xí)方法的對比結(jié)果。其中,基于深度學(xué)習(xí)的方法包括DRDA[20]、M3DCNN[23]、DMTLBCI[24]、FBCNet[19]、TCNet[18]、C2CM[12]、EEGNet[17]和ShallowNet[16];基于傳統(tǒng)機器學(xué)習(xí)的方法包括SSMM[20]和FBCSP[9]。對比結(jié)果如表2 所示(A1~A9 代表9名BCICIV_2a 受試者的編號,SD 為標準差)。

表2 BCICIV_2a 單被試對比實驗數(shù)據(jù):AFBCNet 與其他方法的對比。最佳的Acc 與K 用粗體標識

表2 列舉了十種先進的MI-EEG 分類算法在BCICIV_2a 數(shù)據(jù)集上的個體準確率、平均準確率、標準差和K系數(shù)。本文提出的方法明顯優(yōu)于其他機器學(xué)習(xí)算法,對單被試的平均準確率達到了81.82%,K系數(shù)達到了0.76。圖3(a)給出了測試集上的實驗結(jié)果和混淆矩陣。FBCSP 是一種常見的EEG 機器學(xué)習(xí)基線方法,該方法通過頻帶劃分與構(gòu)造最優(yōu)空間濾波器來提取特征,最后采用支持向量機進行分類。該方法在BCI 競賽上獲得了優(yōu)勝,但是其平均準確率僅有67.75%,比本文所提出的方法低了14.07%。SSMM 作為SMM[20]的改進方法,使用稀疏支持矩陣機對復(fù)雜的矩陣式EEG 信號進行回歸正則化,將數(shù)據(jù)轉(zhuǎn)化到低秩來捕捉固有的結(jié)構(gòu)特征,彌補了傳統(tǒng)分類器的結(jié)構(gòu)信息丟失問題,其準確率為73.45%。綜上所述,本文提出的方法在多分類腦電信號數(shù)據(jù)集上的性能明顯優(yōu)于傳統(tǒng)機器學(xué)習(xí)方法。

圖3 MI 單被試分類實驗結(jié)果的混淆矩陣

近年來,基于深度學(xué)習(xí)的方法已經(jīng)在MI-EEG分類上領(lǐng)先了傳統(tǒng)的機器學(xué)習(xí)方法,本文比較了近幾年來最先進的深度學(xué)習(xí)方法,其平均準確率在73%到78%之間,略強于傳統(tǒng)的機器學(xué)習(xí)方法。DRDA 和DMTLBCI 是基于遷移學(xué)習(xí)的方法,其準確率相比于傳統(tǒng)機器學(xué)習(xí)方法有了明顯的提升,分別達到74.75%和75.21%。DRDA 通過遷移多個受試者的EEG 數(shù)據(jù)來提高單被試的分類效果,該方法聯(lián)合優(yōu)化了特征提取模塊、分類器和領(lǐng)域鑒別器。其中,領(lǐng)域鑒別器通過對抗學(xué)習(xí)的策略來匹配受試者之間的特征分布偏移,但是這類方法考慮了其他受試者的腦電數(shù)據(jù),很難從中學(xué)習(xí)到有用的信息,且訓(xùn)練難度很大。FBCNet、TCNet、EEGNet 和ShallowNet是基于信號分解范式的卷積神經(jīng)網(wǎng)絡(luò),精度分別達到76.2%、75.88%、73.15%和77.05%。此外,基于信號分解范式的卷積神經(jīng)網(wǎng)絡(luò)目前在精度上、計算量、內(nèi)存需求和模型設(shè)計上都處于領(lǐng)先地位。因此,本文所提出的方法也繼承了這類方法的優(yōu)勢,在精度上更是達到了81.82%。M3DCNN 使用復(fù)雜的三維EEG 數(shù)據(jù)表示與多分枝結(jié)構(gòu)來改善模型性能,并證明了三維表達能夠有效提高模型分類精度,但是其精度、計算開銷上都遠比本文所提出的方法要低。因此,挖掘二維數(shù)據(jù)的關(guān)聯(lián)性和內(nèi)在特征比使用復(fù)雜結(jié)構(gòu)的數(shù)據(jù)更加有效。C2CM 利用混合通道卷積對時空特征進行分類,其精度達到74.46%。雖然C2CM 取得了不錯的性能,但是這種方法微調(diào)了每個受試者的模型體系結(jié)構(gòu)參數(shù)(卷積核大小和節(jié)點個數(shù)等),而本文提出的方法對所有的受試者都采用一致的結(jié)構(gòu)與參數(shù),這使得本文提出的模型能夠快速地適應(yīng)線下真實應(yīng)用場景。此外,本文所提出的方法在6 名受試者的平均精度上達到了80%以上,且其中3 名受試者的準確度達到了90%以上,只有3 名受試者的分類精度在80%以下。在其他研究中,這三名受試者的分類精度也無法得到有效的提升,因此可以認為這類受試者是運動想象盲。

此外,表2 列舉了各個方法的標準差,其中M3DCNN 的標準差最小,而本文所提出的方法的標準差為13.06,其中可能的原因是部分受試者的解碼效果取得了非常高的精確度,而運動想象盲的精確度與其他受試者的精確度差距增大。除去三名被認為是運動想象盲的受試者,本文所提方法的標準差為6.24,并且平均精確度達到了89.75%,進一步證明了所提方法在善于運動想象的受試者中的穩(wěn)健性與可靠性。

為了進一步證明AFBCNet 的解碼和分類能力,本文對BCICIV_2a 數(shù)據(jù)集的A7 受試者進行t 分布隨機領(lǐng)域嵌入(t-Distributed Stochastic Neighbor embedding,t-SNE)分析[8]。這是一種高維數(shù)據(jù)可視化的降維技術(shù),結(jié)果如圖4 所示。圖4(a)是A7 受試者原始數(shù)據(jù)的降維投影,可以看到在未經(jīng)解碼時,其數(shù)據(jù)是混亂且不可分的。圖4(b)是A7 受試者的經(jīng)過AFBCNet 分解后的降維特征,除了小部分的重疊區(qū)域,四類任務(wù)都具有高度的聚類性和離散性。

圖4 A7 受試者的t-SNE 分析

以上結(jié)果與分析表明,對于難度較大的四分類BCICIV_2a 數(shù)據(jù)集,AFBCNet 優(yōu)于傳統(tǒng)的機器學(xué)習(xí)方法(平均提高11.22%)和近年來先進的深度學(xué)習(xí)方法(平均提高6.6%),并且在單被試的分類實驗中的表現(xiàn)最佳,比次優(yōu)方法(ShallowNet)的精度高出4.75%。此外,本文所提出的方法在個體A1、A4、A7 和A8 上取得了最佳解碼、分類效果。

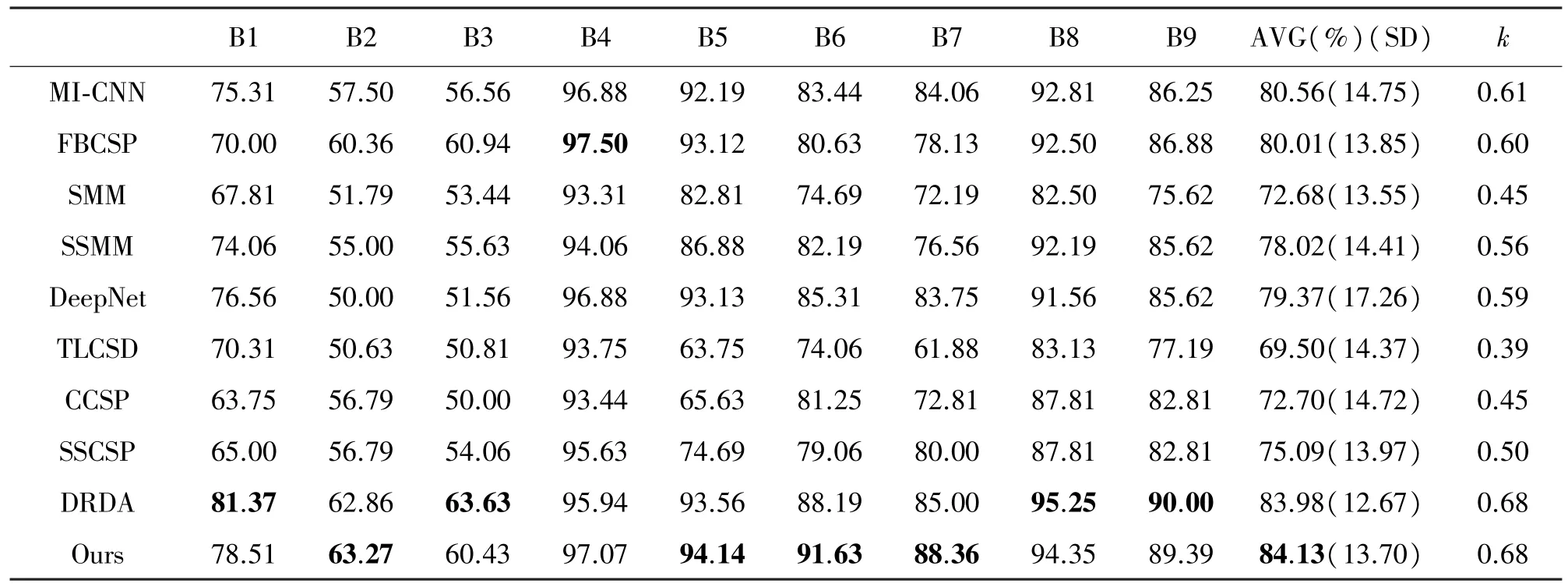

3.4.2 BCICIV_2b 對比實驗

為了進一步的驗證本文提出方法能夠勝任不同難度的任務(wù),本文對二分類的BCICIV_2b 數(shù)據(jù)集進行進一步的單被試對比實驗。本文不對網(wǎng)絡(luò)結(jié)構(gòu)做任何變動,僅調(diào)整F1、D和輸出分類層的類別數(shù)。在BCICIV_2b 數(shù)據(jù)集上的單被試對比實驗結(jié)果如表3 所示(B1~B9 代表9 名BCICIV_2b 受試者的編號),其對應(yīng)的混淆矩陣如圖3(b)所示。

表3 BCICIV_2b 單被試對比實驗數(shù)據(jù):AFBCNet 與其他方法的對比。最佳的Acc 與K 用粗體標識

在較為簡單的二分類數(shù)據(jù)集上,傳統(tǒng)的機器學(xué)習(xí)方法也表現(xiàn)出了出色的性能。其中,F(xiàn)BCSP、SMM和SSMM 分別達到了80.01%、72.68%和78.02%的準確率。雖然FBCSP 在四分類的數(shù)據(jù)集上的效果遠不如SMM(平均準確度70.75%)和SSMM,但是SMM 和SSMM 在二分類的數(shù)據(jù)集上表現(xiàn)卻較差。這表明傳統(tǒng)的手工提取特征方法和機器學(xué)習(xí)方法的泛化能力有限,而本文所提出的方法在僅調(diào)整F1和D參數(shù)的條件下,都能取得最優(yōu)的平均性能。CCSP、SSCSP 和TLCSD 是基于自適應(yīng)學(xué)習(xí)的機器學(xué)習(xí)方法[10],DRDA 是領(lǐng)域自適應(yīng)的深度學(xué)習(xí)方法。CCSP 和SSCSP 的分類性能較差,這可能是由于這類方法假設(shè)不同受試者的空間濾波器是相近的,并且通過逼近協(xié)方差均值的方式來估計協(xié)方差矩陣,然而事實上,不同的受試者之間的數(shù)據(jù)隔離性較大。DRDA 在二分類的數(shù)據(jù)集上的表現(xiàn)接近本文所提出的方法,但是其在四分類的數(shù)據(jù)集上的效果比AFBCNet 低了7.07%,且訓(xùn)練過程復(fù)雜,這說明領(lǐng)域遷移學(xué)習(xí)雖然有效,但是對于復(fù)雜的任務(wù)很難學(xué)習(xí)到有用的跨被試信息。

以上結(jié)果表明,本文提出的方法不僅在高難度的四分類數(shù)據(jù)集上有顯著的提升,在二分類的數(shù)據(jù)集上也同樣表現(xiàn)不俗,略高于次優(yōu)的DRDA算法。因此,對于不同的數(shù)據(jù)集和不同難度的任務(wù),本文提出的網(wǎng)絡(luò)模型具有很強的自適應(yīng)性與魯棒性。

3.5 跨被試分類對比實驗

目前,大多數(shù)研究都集中于單被試的實驗與模型訓(xùn)練,上述的實驗就是基于這種范式開展的,并且證明了本文提出的方法在這種情況下表現(xiàn)最佳。此外,為了驗證模型的健壯性與遷移能力,本文展開了第二種基于遷移學(xué)習(xí)范式的實驗,并在BCICIV_2a數(shù)據(jù)集上與DeepNet[16]、ShallowNet、DMTLBCI 和PSTSANN[25]算法進行比較。第二種實驗范式首先使用其他被試(不包括目標受試者)的EEG 數(shù)據(jù)進行預(yù)訓(xùn)練并保存參數(shù),然后使用目標受試者的數(shù)據(jù)繼續(xù)進行第一種實驗范式的訓(xùn)練并進行測試。其結(jié)果如表4 所示。

表4 BCICIV_2a 跨被試遷移學(xué)習(xí)分類實驗結(jié)果。最佳的Acc 用粗體標識。

由于不同受試者之間的MI-EEG 數(shù)據(jù)差異較大,因此,跨被試實驗的結(jié)果并不優(yōu)于單被試實驗的結(jié)果。在平均準確度上,本文所提出的方法相比于其他深度學(xué)習(xí)算法依然保持了最佳的性能,以1.96%的優(yōu)勢高于次優(yōu)的PSTSANN,并且在A1、A2、A4、和A7 受試者上的表現(xiàn)最佳。此外,實驗分類精度的大幅度退化主要發(fā)生在少數(shù)運動想象盲受試者上(A5 和A6),而在大多數(shù)受試者上精度退化在較小范圍內(nèi)。實驗結(jié)果表明,本文提出的方法不僅在單被試的情況下表現(xiàn)最佳,而且具有較強的遷移能力與魯棒性。

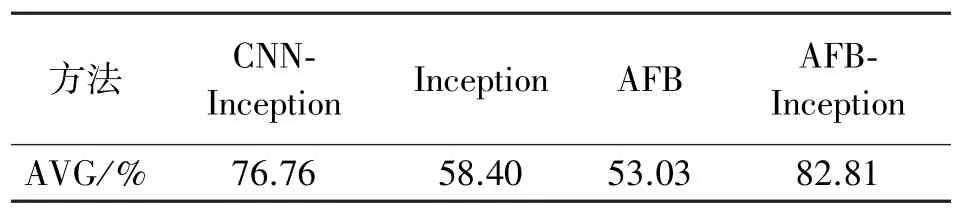

3.6 消融實驗

為了研究AFB 和改進的Inception 層對模型的影響,本文刪除一層來測試另一層的作用,結(jié)果如表5所示。由于模型緊湊且屬于承前啟后的分解范式,對于模型中層數(shù)的變動會極大地影響模型的精度。因此,只有Inception 或者AFB 層都不能對MIEEG 信號進行深度的解碼與分類。從實驗結(jié)果上來看,Inception 對于AFBCNet 的影響更大一些。

表5 基于BCICIV_2a 的模型消融實驗

為了更加合理地證明AFB 和改進的Inception的作用,本文使用傳統(tǒng)的卷積層來代替模型中的AFB 層(表5 中的CNN-Inception)進行實驗,其精度達到76.76%,略高于基于時空分解范式的卷積神經(jīng)網(wǎng)絡(luò)(FBCNet、EEGNet 和TCNet),而與次優(yōu)的ShallowNet 的表現(xiàn)非常接近。這表明通過改進的Inception 結(jié)構(gòu)提取時空分解后的特征比采用方差層和時域卷積網(wǎng)絡(luò)的效果更好。此外,相較于傳統(tǒng)的卷積核,AFB 的引入在性能上提高了5.06%,且降低了學(xué)習(xí)難度、大幅度減小了計算量、增強了模型的可解釋性。

4 結(jié)束語

本文提出了一種基于自適應(yīng)濾波器組的運動想象卷積神經(jīng)網(wǎng)絡(luò),在繼承傳統(tǒng)的解碼型結(jié)構(gòu)網(wǎng)絡(luò)的基礎(chǔ)上,更加注重解碼的精度與可解釋性。該模型在訓(xùn)練數(shù)量有限的多分類任務(wù)中能快速學(xué)習(xí)MIEEG 數(shù)據(jù)的內(nèi)在特征并進行有效分類。在BCICIV_2a 和BCICIV_2b 數(shù)據(jù)集上的實驗結(jié)果表明,本文提出的模型與傳統(tǒng)的機器學(xué)習(xí)方法和近年來先進的深度學(xué)習(xí)方法相比有明顯的優(yōu)勢。未來,我們計劃進行線下采集實驗與實際應(yīng)用的研究。