智能駕駛目標(biāo)感知檢測(cè)算法改進(jìn)研究

摘要:為了優(yōu)化智能駕駛感知目標(biāo)檢測(cè)算法,提高目標(biāo)檢測(cè)的準(zhǔn)確性和魯棒性,改進(jìn)了環(huán)境感知系統(tǒng)和優(yōu)化了傳統(tǒng)算法。結(jié)果表明:所提出的PINet算法在多傳感器數(shù)據(jù)融合的基礎(chǔ)上顯著提升了3D目標(biāo)檢測(cè)性能,全類(lèi)平均精度達(dá)到56.8%,nuScenes檢測(cè)分?jǐn)?shù)達(dá)到69%。由此,證明了該算法在實(shí)際行車(chē)場(chǎng)景中的有效性和適用性。

關(guān)鍵詞:智能汽車(chē);駕駛感知;PINet算法

0 前言

隨著人工智能和自動(dòng)駕駛技術(shù)的迅猛發(fā)展,智能駕駛感知系統(tǒng)作為實(shí)現(xiàn)車(chē)輛自主導(dǎo)航的關(guān)鍵技術(shù)之一,其目標(biāo)檢測(cè)算法的準(zhǔn)確性和效率至關(guān)重要。本文圍繞智能駕駛感知目標(biāo)檢測(cè)算法進(jìn)行了研究。針對(duì)現(xiàn)有算法在小目標(biāo)和遮擋目標(biāo)檢測(cè)方面的不足,提出了一種基于深度神經(jīng)網(wǎng)絡(luò)的新型特征提取方法,以增強(qiáng)算法對(duì)不同尺寸和形態(tài)目標(biāo)的檢測(cè)能力。針對(duì)檢測(cè)的實(shí)時(shí)性問(wèn)題,設(shè)計(jì)了高效的數(shù)據(jù)處理流程,并采用邊緣計(jì)算技術(shù)降低延遲,確保算法能夠快速響應(yīng)環(huán)境變化。

1 智能駕駛感知系統(tǒng)設(shè)計(jì)

1. 1 環(huán)境感知系統(tǒng)整體結(jié)構(gòu)設(shè)計(jì)

在智能駕駛感知目標(biāo)檢測(cè)算法的研究中,環(huán)境感知系統(tǒng)的整體結(jié)構(gòu)設(shè)計(jì)至關(guān)重要。該系統(tǒng)作為智能汽車(chē)的“眼睛”,不僅直接影響到?jīng)Q策規(guī)劃系統(tǒng)及車(chē)輛控制系統(tǒng)的智能化水平,還是確保智能汽車(chē)安全行駛的首要條件。基于此,本文提出了一種真實(shí)行車(chē)場(chǎng)景下點(diǎn)云和圖像融合的3D目標(biāo)檢測(cè)(PINet)算法,旨在通過(guò)多傳感器數(shù)據(jù)融合顯著提升3D目標(biāo)的檢測(cè)性能。該算法利用神經(jīng)網(wǎng)絡(luò)對(duì)點(diǎn)云和圖像信息進(jìn)行特征級(jí)融合,并結(jié)合跳躍特征金字塔模塊及動(dòng)態(tài)特征融合模塊設(shè)計(jì),不僅增強(qiáng)了算法處理復(fù)雜遮擋場(chǎng)景的能力,在惡劣天氣條件和光照不足的情況下還能表現(xiàn)出較好的魯棒性[1]。

1. 2 系統(tǒng)硬件設(shè)計(jì)

在針對(duì)智能駕駛感知目標(biāo)檢測(cè)算法的研究中,設(shè)計(jì)環(huán)境感知系統(tǒng)硬件時(shí)需要充分考慮到不同傳感器的特性和優(yōu)勢(shì),以實(shí)現(xiàn)異源數(shù)據(jù)間的冗余和互補(bǔ),充分發(fā)揮環(huán)境感知系統(tǒng)的能力。考慮到攝像頭能夠拍攝到包含豐富色彩和紋理的圖像或視頻流信息,在完成語(yǔ)義方面的任務(wù)時(shí)能夠發(fā)揮作用,本文選擇高分辨率、高幀率的車(chē)載攝像頭,以滿(mǎn)足不同場(chǎng)景下的視覺(jué)需求。

為了充分發(fā)揮各種傳感器的優(yōu)勢(shì)并彌補(bǔ)其不足,智能駕駛目標(biāo)感知檢測(cè)算法通采用多種傳感器組合的方式。例如,攝像頭可以用于識(shí)別目標(biāo)物體的類(lèi)別和外觀特征,激光雷達(dá)可以用于檢測(cè)障礙物的位置、大小和形狀,而毫米波雷達(dá)則可以用于跟蹤目標(biāo)物體的動(dòng)態(tài)變化和進(jìn)行安全預(yù)警。通過(guò)融合三種傳感器的數(shù)據(jù),可以實(shí)現(xiàn)對(duì)目標(biāo)物體的準(zhǔn)確檢測(cè)和定位,提高智能駕駛系統(tǒng)的可靠性和安全性。

此外,傳感器的安裝位置對(duì)于智能駕駛目標(biāo)感知檢測(cè)算法的性能也有重要影響。為了實(shí)現(xiàn)對(duì)車(chē)輛周?chē)h(huán)境的全方位感知,傳感器應(yīng)安裝在車(chē)輛的不同位置,以實(shí)現(xiàn)多角度覆蓋。同時(shí),傳感器的安裝位置應(yīng)避免被車(chē)輛的其他部件遮擋,以確保能夠獲取完整的環(huán)境信息。在考慮振動(dòng)和溫度影響時(shí),應(yīng)選擇合適的安裝方式和固定裝置,以確保傳感器的穩(wěn)定性和可靠性。

1. 3 傳統(tǒng)算法

在智能駕駛感知目標(biāo)檢測(cè)領(lǐng)域,傳統(tǒng)算法中的Haar級(jí)聯(lián)分類(lèi)器方法常用于行人和車(chē)輛等目標(biāo)的檢測(cè)。該算法通過(guò)使用簡(jiǎn)單的特征(如邊緣、線性等)和機(jī)器學(xué)習(xí)技術(shù)來(lái)識(shí)別圖像中的特定目標(biāo)。針對(duì)該算法,首先需要定義Haar特征,因?yàn)檫@些特征是圖像中簡(jiǎn)單且有效的特征。本文收集了大量帶有標(biāo)注的正樣本(包含目標(biāo),如車(chē)輛或行人)和負(fù)樣本(不包含目標(biāo)),利用這些數(shù)據(jù)訓(xùn)練一個(gè)級(jí)聯(lián)的AdaBoost分類(lèi)器[2]。

2 目標(biāo)檢測(cè)算法改進(jìn)

2. 1 攝像頭算法設(shè)計(jì)

在智能駕駛感知目標(biāo)檢測(cè)算法的改進(jìn)研究中,攝像頭算法主要利用Lift-Splat-Shoot網(wǎng)絡(luò)對(duì)圖像上的像素進(jìn)行深度估計(jì),生成偽點(diǎn)云,進(jìn)而將其轉(zhuǎn)換為鳥(niǎo)瞰圖特征,以增強(qiáng)算法對(duì)3D空間信息的理解和處理能力。考慮到算法對(duì)圖像特征提取的高要求,選用了EfficientNet-B0作為2D骨干網(wǎng)絡(luò)。EfficientNet-B0在保持網(wǎng)絡(luò)寬度與深度平衡的同時(shí),通過(guò)復(fù)合模型縮放技術(shù),可實(shí)現(xiàn)資源的優(yōu)化分配[3]。

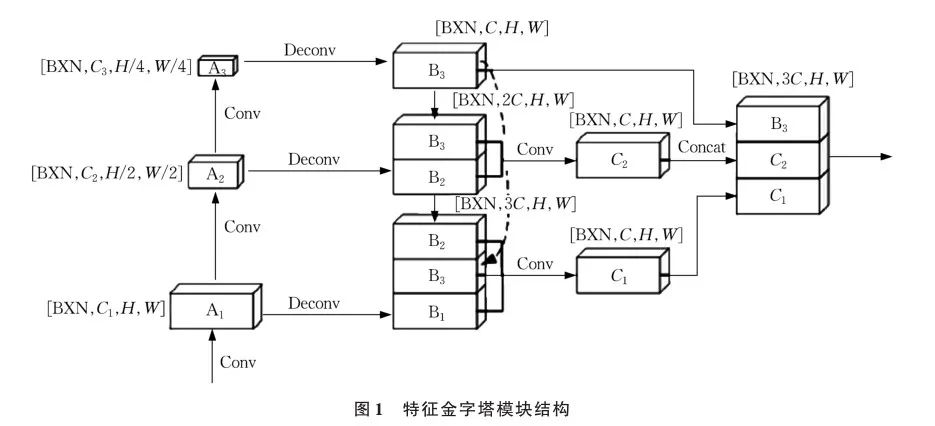

在攝像頭捕捉到的圖像中,遠(yuǎn)處的物體或被遮擋的物體在像素平面上的占比很小,這導(dǎo)致其在圖像中的信息量較少。隨著網(wǎng)絡(luò)深度的增加,這些物體的特征圖分辨率會(huì)進(jìn)一步減小,導(dǎo)致圖像細(xì)節(jié)信息丟失,檢測(cè)難度加大。特征金字塔網(wǎng)絡(luò)(FPN)是一種用于目標(biāo)檢測(cè)任務(wù)的深度學(xué)習(xí)架構(gòu),通過(guò)構(gòu)建一個(gè)多尺度的特征提取和融合機(jī)制來(lái)提高檢測(cè)性能。

特征金字塔能夠在不同的網(wǎng)絡(luò)層次上提取不同尺度的特征,將深層次的語(yǔ)義特征與淺層次的細(xì)節(jié)特征進(jìn)行融合,從而生成高分辨率且富含語(yǔ)義信息的特征圖。特征金字塔模塊結(jié)構(gòu)如圖1所示。特征金字塔網(wǎng)絡(luò)結(jié)構(gòu)的引入不僅增強(qiáng)了算法對(duì)不同大小物體的檢測(cè)能力,還改善了算法對(duì)復(fù)雜環(huán)境下目標(biāo)的識(shí)別效果。

EfficientNet-B0網(wǎng)絡(luò)包含8個(gè)階段,每個(gè)階段都通過(guò)卷積層來(lái)提取圖像特征并逐步下采樣。第1階段使用3×3的卷積核,輸出224×224的特征圖;第2階段保持特征圖尺寸為112×112,通道數(shù)增至48;第3階段的特征圖尺寸減小為56×56,通道數(shù)增至96;第4階段的特征圖進(jìn)一步減小為28×28,通道數(shù)增加至192;第5階段的特征圖尺寸減小為14×14,通道數(shù)達(dá)到304;第6階段的特征圖尺寸為7×7,通道數(shù)增至512;第7階段的特征圖尺寸為3×3,通道數(shù)增至1 024;第8階段輸出1×1的特征圖,通道數(shù)維持在1 024。

首先,將EfficientNet-B0作為編碼器的基礎(chǔ)網(wǎng)絡(luò),去掉最后階段的全連接層;然后,從EfficientNet-B0的第5、6、8階段提取特征圖,分別表示為A1、A2和A3。其中,A2的分辨率是A1的1/2,而A3的分辨率是A1的1/4。在解碼器部分,分辨率最大的特征圖A1通過(guò)卷積操作改變通道數(shù),使其與A2和A3的通道數(shù)保持一致[4]。

2. 2 動(dòng)態(tài)特征融合

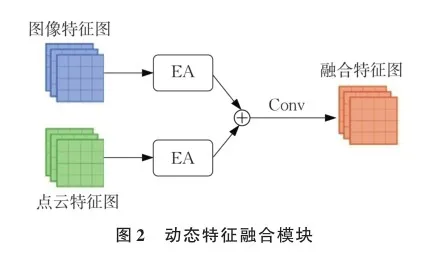

本文引入了一種動(dòng)態(tài)特征融合模塊,其整體框架如圖2所示。該模塊以通道注意力模塊為基礎(chǔ)進(jìn)行改進(jìn),設(shè)計(jì)了元素注意力模塊(EA)。動(dòng)態(tài)特征融合模塊由2部分組成:自適應(yīng)特征選擇和數(shù)據(jù)融合。在自適應(yīng)特征選擇階段,元素注意力模塊通過(guò)對(duì)不同分支提供的特征圖進(jìn)行自學(xué)習(xí),識(shí)別并賦予不同特征重要程度的權(quán)重。這一過(guò)程的實(shí)現(xiàn),首先是通過(guò)全局平均池化將輸入特征圖的維度從三維降低至一維;隨后,通過(guò)2個(gè)連續(xù)的全連接層生成注意力圖;在第1個(gè)全連接層后,使用ReLU激活函數(shù),而在第2個(gè)全連接層后,通過(guò)Sigmoid函數(shù)將輸出向量歸一化至[0,1]范圍內(nèi),以生成與輸入特征圖維度相匹配的注意力圖;最后,將注意力圖與輸入特征圖通過(guò)內(nèi)積方式相乘,實(shí)現(xiàn)對(duì)特征的加權(quán)增強(qiáng)[5]。

3 智能駕駛感知試驗(yàn)

3. 1 環(huán)境感知系統(tǒng)整體結(jié)構(gòu)

在智能駕駛感知目標(biāo)檢測(cè)算法的改進(jìn)研究中,環(huán)境感知系統(tǒng)的整體搭建是關(guān)鍵步驟。本文所提出的算法試驗(yàn)訓(xùn)練要求所配置的硬件具有高性能的計(jì)算能力和大量存儲(chǔ)空間,以滿(mǎn)足復(fù)雜數(shù)據(jù)處理和模型訓(xùn)練的需求。為此,試驗(yàn)機(jī)器采用了Xeon(R) Platinum 8255 C中央處理器。在軟件環(huán)境方面,試驗(yàn)采用的操作系統(tǒng)為Ubuntu 20.04 64 bit,CUDA版本為CUDA 11.1,其與NVIDIA顯卡緊密結(jié)合,可優(yōu)化算法的運(yùn)算速度。深度學(xué)習(xí)算法框架選用了mmdetection 3d 1.0.0 rc 4,編程語(yǔ)言則選擇Python 3.8,其豐富的庫(kù)支持和易用性使得算法更加高效[6]。

3. 2 系統(tǒng)運(yùn)行效果分析

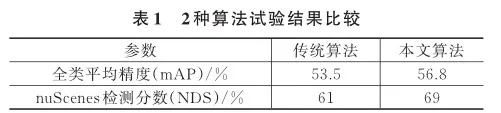

在對(duì)智能駕駛感知目標(biāo)檢測(cè)算法的改進(jìn)研究中,本文基于真實(shí)行車(chē)場(chǎng)景下點(diǎn)云與圖像融合的PINet算法進(jìn)行搭建。通過(guò)各傳感器采集的數(shù)據(jù)進(jìn)行融合,該算法增強(qiáng)了處理復(fù)雜遮擋場(chǎng)景的能力。相關(guān)試驗(yàn)結(jié)果見(jiàn)表1。

由表1可見(jiàn):mAP達(dá)到56.8%,NDS達(dá)到69%,表明該算法在處理復(fù)雜遮擋場(chǎng)景方面具有明顯的優(yōu)勢(shì),并且其性能明顯優(yōu)于傳統(tǒng)的3D目標(biāo)檢測(cè)算法。

通過(guò)對(duì)比不同算法的性能指標(biāo),可以看出該算法在準(zhǔn)確性和魯棒性方面都有顯著提升。這主要得益于點(diǎn)云與圖像的有效融合,以及對(duì)復(fù)雜遮擋場(chǎng)景的處理能力增強(qiáng)。這些改進(jìn)使得該算法能夠更好地適應(yīng)真實(shí)行車(chē)環(huán)境中的各種挑戰(zhàn),提高智能駕駛系統(tǒng)的安全性和可靠性。

4 結(jié)語(yǔ)

本文通過(guò)深入分析和系統(tǒng)研究,對(duì)智能駕駛感知目標(biāo)檢測(cè)算法進(jìn)行了改進(jìn)。針對(duì)當(dāng)前自動(dòng)駕駛領(lǐng)域內(nèi)感知系統(tǒng)所面臨的目標(biāo)檢測(cè)精度、魯棒性,以及實(shí)時(shí)性問(wèn)題,改進(jìn)了智能駕駛感知目標(biāo)檢測(cè)算法,并對(duì)其進(jìn)行了測(cè)試和驗(yàn)證。測(cè)試結(jié)果表明,在小目標(biāo)和遮擋目標(biāo)條件下改進(jìn)算法的識(shí)別能力得到了增強(qiáng)。通過(guò)自適應(yīng)特征選擇機(jī)制的引入,進(jìn)一步提升了該算法在復(fù)雜環(huán)境下,尤其是在極端天氣條件下的檢測(cè)性能。

參 考 文 獻(xiàn)

[1] 張新鈺,國(guó)紀(jì)龍,李駿,等.基于信息論的智能駕駛可解釋多模態(tài)感知[J].中國(guó)科學(xué):信息科學(xué),2024,54(6):1419-1440.

[2] 胡洋,趙一凡,楊華昌,等.黃驊港站智能調(diào)車(chē)自動(dòng)駕駛控制系統(tǒng)應(yīng)用研究[J].鐵道通信信號(hào),2024,60(5):9-17.

[3] 梁高洋,黃好,鐘聲峙,等.智能駕駛車(chē)輛感知邊界的測(cè)試技術(shù)研究[J].大眾科技,2024,26(1): 73-76.

[4] 張盼盼,宋佳順.四維標(biāo)注在智能駕駛BEV感知中的應(yīng)用[J].測(cè)繪通報(bào),2023(9):139-143.

[5] 蔣凱偉.基于深度學(xué)習(xí)的智能駕駛目標(biāo)檢測(cè)技術(shù)研究[D].北京:北京交通大學(xué),2023.

[6] 張姍.智能駕駛車(chē)輛環(huán)境感知系統(tǒng)建模與仿真[D].長(zhǎng)春:長(zhǎng)春大學(xué),2021.