深度學習方法在地震事件分類中的應用及可解釋性研究

路曉辰 楊立明 楊興悅 王祖東 王維歡 高永國 尹欣欣

摘要:

采用2016—2020年福建臺網所記錄的爆破和天然地震事件以及背景噪聲數據集,使用CNN模型、Inception10模型、ResNet18模型和Vgg16模型4種深度學習網絡模型進行分類研究。針對深度學習網絡模型的“黑盒”問題,將梯度類激活映射(Gradient-weighted Class Activation Mapping,Grad-CAM)算法引入這4種分類模型中,得到每個模型的可視化圖。通過可視化圖可以直觀地看出模型在做出分類決策時對于不同波形特征的依賴權重,為模型的可解釋性提供依據,進而提高模型的可信度。通過對模型的可視化圖分析得出,分類效果更好的CNN模型和Vgg16模型在做出決策時更依賴于地震波形的震相特征,對于震前和震后的波段關注較小;而ResNet18模型和Inception10模型對于震相特征的關注不夠敏銳。通過Grad-CAM算法對模型進行可視化分析得到的結果能夠很好地反映模型的分類效果,對于改進和選擇合適的分類模型具有重要意義。

關鍵詞:

可解釋性; Grad-CAM算法; 爆破事件分類; 深度學習

中圖分類號: P315.63????? 文獻標志碼:A?? 文章編號: 1000-0844(2023)02-0474-09

DOI:10.20000/j.1000-0844.20220926001

Application and interpretability of deep learning

methods in seismic event classification

LU Xiaochen1,2, YANG Liming3, YANG Xingyue2, WANG Zudong2,

WANG Weihuan2, GAO Yongguo2, YIN Xinxin2

(1. Lanzhou Institute of Seismology, CEA, Lanzhou 730000, Gansu, China;

2. Gansu Earthquake Agency, Lanzhou 730000, Gansu, China;

3. Qinghai Earthquake Agency, Xining 810000, Qinghai, China)

Abstract:

In this paper, four deep learning network models, i.e., the CNN, ResNet18, Vgg16, and Inception10 models, were used to classify blasting and seismic events, and the dataset used blasting events and natural seismic events recorded by the Fujian station network from 2016 to 2020. The gradient-weighted class activation mapping (Grad-CAM) algorithm was introduced into the four classification models to address the “black box” problem of deep learning network models, and a visualization of each model was obtained. The visualization diagram provides an intuitive view of the model's reliance weights for different waveform features when making classification decisions, thus providing a basis for the models interpretability and improving its credibility. Analysis of the visualization diagram shows that the CNN and Vgg16 models with better classification effects rely more on the seismic phase characteristics of seismic waveforms when making decisions and pay less attention to the pre-earthquake and post-earthquake bands. In contrast, the ResNet18 and Inception10 models are insufficiently sensitive to the seismic phase characteristics. The results obtained from a visual analysis of the models through the Grad-CAM algorithm well reflect the classification effect of the models, which is important for improving the models and selecting an appropriate classification model.

Keywords:

interpretability; Grad-CAM algorithm; classification of blasting events; deep learning

0 引言

從創建地震災害的構造事件目錄到監測核爆炸,區分爆炸和地震仍然是地震學中的一項重要任務。由于爆破和地震事件的波形具有相似性,如果人工區分較多的爆破和地震事件需要花費大量的時間,而且區分過程中個人的主觀性比較強。傳統方法主要通過提取震相特征去區分爆破和天然地震事件,比如提取波形數據的初動方向、P波和S波最大振幅比、尾波衰減等特征[1-3],或者使用傅里葉變換、小波變換等方法提取波形數據的頻域信息進行分析[4-5]。區分爆破和天然地震事件的傳統方法只是提取了事件波形中的部分特征,然后通過單個或多個震相特征去分類地震事件,這些方法會造成震相特征的損失,不能夠將整個波形的特征利用起來,從而會降低分類精度。最近深度學習在地震學各個領域應用廣泛,例如應用在到時拾取、地震事件分類、地震目錄的構建等。2020年Mousavi等[6]提出EQTransformer深度學習模型,用于同時進行地震檢測和相位選取。通過使用分層注意力機制,結合地震信號的相位和全波形的信息,提高了每個單獨任務的模型性能。2021年趙明等[7]將PhaseNet震相識別算法、REAL震相自動關聯技術與傳統定位技術VELEST和HYPODD相結合,自動構建長寧地震前震目錄。2022年高永國等[8]使用深度學習卷積神經網絡方法搭建兩個不同的模型,對甘肅地區的地震事件和爆破事件進行了分類研究。

雖然深度學習廣泛應用于地震學研究、圖片分類、自然語言處理及目標識別等領域,而且具有其獨特的優勢,但是深度學習網絡模型作為一個黑盒模型缺乏可解釋性,研究人員無法理解深度學習模型如何做出決策,限制了深度學習的應用和發展[9]。對于一些分類任務來說,較高的識別率并不代表模型能夠正確地捕捉到目標本身的特征。在文獻[10]中提到了華盛頓大學所做的一項實驗,華盛頓大學曾通過創建一個分類器來識別哈士奇與狼,但實際上模型是依據背景中是否存在積雪來做出的決策,而不是通過哈士奇和狼的本身特征來進行識別的。對于應用到地震事件分類中的模型來說,模型可能關注的主要特征為事件的位置和時間信息,而不是波形的真正鑒別特征,如初至波、波峰和尾波[11]。所以在爆破事件的分類研究中,加入對深度學習網絡模型的可解釋性分析具有重要的意義。隨著可解釋性方法的不斷提出和發展,深度學習的可解釋性研究已經應用于多個領域。Zhang等[12]提出MDNet模型,該模型在醫學圖像和診斷報告之間建立直接的多模態映射,而且可以將診斷報告的決策依據進行可視化。李瑋杰等[13]利用歸因方法進行雷達圖像深度學習模型的可解釋性研究。目前,在地震學中對于深度學習的可解釋性研究較少。

本文使用了4種深度學習網絡模型進行爆破和天然地震事件的分類,而且將梯度類激活映射(Gradient-weighted Class Activation Mapping,Grad-CAM)算法引入到分類模型中,嘗試解決地震事件分類模型的“黑盒問題”。通過加入分類模型的可解釋性研究,提高了模型的可信度,建立了人與機器之間的信任,推動了深度學習應用到實際的地震事件分類工作中去。可解釋性研究提高了模型的透明度,通過可視化圖可以了解到模型學習到的震相特征,為選擇模型、診斷模型、修改模型及應用模型提供了依據。

1 數據與方法介紹

1.1 數據集

本研究選取2016—2020年福建臺網所記錄的爆破事件和天然地震事件,從中去篩選其中的爆破事件和天然地震事件。截取每個事件的三通道波形,波形的開始時間為最近臺站P波到時的前2 s。每個通道截取20 s波形,波形采樣率為100 Hz,每段波形取2 000個點。選取每個事件震中距較小的臺站,以保證在20 s的時間窗中能完整記錄P波和S波。經過篩選得到9 794個天然地震三分量波形和5 244個爆破三分量波形,并加入7 000條三分量噪聲數據。最后對所有的波形數據進行歸一化處理。隨機打亂數據集的順序,將前20 000條三分量波形作為訓練集,剩余2 038條三分量波形作為驗證集。最終得到的訓練集包括8 914個天然地震三分量波形,6 317個噪聲數據,4 769個爆破數據。將沒有加入訓練集的2 038條三分量波形作為驗證集,驗證集包括880個天然地震數據,683個噪聲數據和475個爆破數據。

1.2 深度學習模型

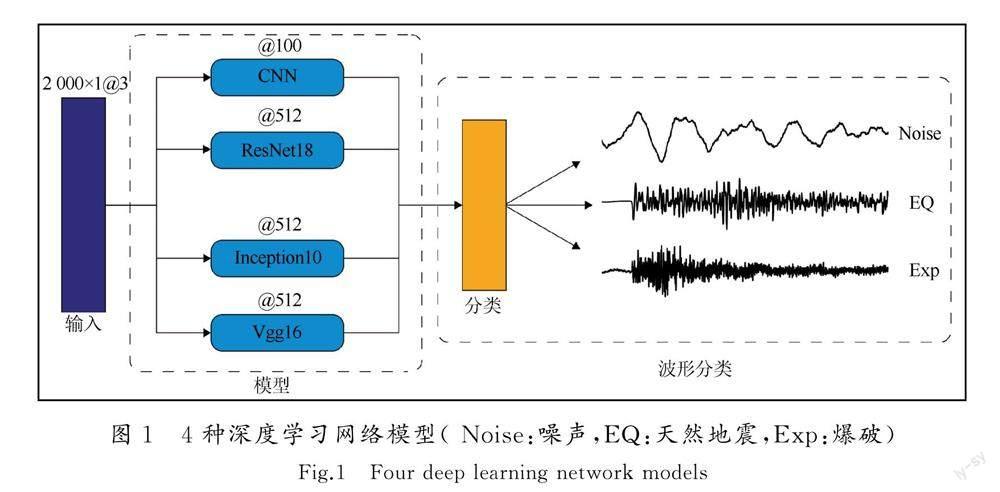

本文采用4種深度學習網絡模型進行地震事件和爆破事件的分類,包括CNN模型、ResNet 18模型、Inception 10和Vgg16模型(圖1)。

CNN模型主要包含5層二維卷積層,卷積核大小為3×1,卷積深度依次為16、32、64、128、256。模型的輸入尺寸為2 000×1×3,模型使用卷積神經網絡從輸入的三分量波形中自動提取特征。通過CNN(卷積神經網絡)層提取的特征被FC(全連接)層扁平化為100個特征,然后通過最后的全連接層進行分類。

ResNet模型利用殘差結構解決了深度網絡出現的梯度消失、梯度爆炸等模型退化問題[14]。ResNet模型選取經典的ResNet 18模型,一共使用4個殘差塊,每個殘差塊具有兩個3×3卷積,模型主要包括17個卷積層和1個全連接層。

Inception結構能夠增加網絡的深度及寬度,而且減少了模型的訓練參數個數,解決了深度網絡計算參數過多造成的過擬合和梯度消失等問題,從而提升了模型的性能[15]。Inception10模型主要采用Inception-v1模塊,具有1×1、3×3和5×5三種卷積核。

Vgg16模型包含13個卷積層和3個全連接層[16]。整個網絡都使用3×3的卷積核尺寸和2×2的最大池化尺寸。

1.3 Grad-CAM算法

為了解決深度學習網絡模型的可解釋性問題,學者們提出了很多解決方法。可解釋性方法可以分為事前可解釋性方法和事后可解釋性方法。事前可解釋性指模型本身具備解釋能力,事后可解釋性指使用特定方法去解釋訓練好的模型。曾春艷等[17]將深度學習可解釋方法總結為自解釋模型、特定模型解釋方法、不可知模型解釋方法及因果可解釋性4大類。

自解釋模型指本身具有可解釋性的模型。典型的自解釋模型有線性回歸模型[18]和決策樹模型。特定模型解釋方法通過研究模型的內部結構和參數來解釋模型,主要方法有激活最大化方法、基于梯度解釋方法及類激活映射方法。Erhan等[19]2009年提出了激活最大化分析法來可視化深度神經網絡(DNN)學習到的高層特征。2016年Sundararajan等[20]提出積分梯度方法解決了神經元和網絡飽和問題。2015年Zhou等[21]提出類激活映射技術,將深度學習網絡中的全連接層替換為全局平均池化層(Global Average Pooling,GAP),對最后一個卷積層每個特征圖的均值進行加權求和,最后通過熱力圖的形式對網絡模型進行可視化。2017年Selvaraju等[22-23]提出了梯度類激活映射Grad-CAM算法。不可知模型解釋方法是指不研究模型的結構和參數,僅通過模型的輸入和輸出來對模型進行解釋。典型的不可知模型解釋方法有LIME方法和LEMNA方法。因果可解釋性方法主要從因果關系的角度分析模型做出決策的原因,可以從基于模型的解釋、反事實解釋、決策公平性三個方面對因果可解釋性進行總結。基于模型的解釋指分析模型中的組成部分對模型做出決策的因果影響。反事實解釋描述了一種因果關系“如果沒有發生x,那么y就不會發生”。決策公平性是指某些敏感特征的不同取值不應該影響模型的預測結果。

對于深度學習模型的可解釋性,本文使用模型梯度類激活映射算法。Grad-CAM是類激活映射(Class Activation Mapping,CAM)的一種改進算法。其使用卷積層的梯度值來計算權值,從而不需要模型具有GAP層,改進了CAM算法需要更改模型結構、重新訓練等局限性。Grad-CAM算法首先計算c類的輸出分數yc相對于最后一個CNN層特征圖Ak的所有像素的梯度平均值,其中k代表第k個特征圖,式(1)定義了第k個特征圖對于類別c的權重值αck。

αck=1z∑ui∑vjycAkij (1)

式中:ycAkij為最后一個卷積層中每一個特征圖的梯度值;u和v是特征圖的寬度和高度;Akij表示第k個特征圖中坐標是(i,j)的像素點的像素值;z表示特征圖的像素點的個數。在模型做出決策之前,由目標類c的這些權重給出了每個特征映射的相對重要性。然后利用式(2)計算出類判別定位映射:

LcGrad-CAM=RELU(∑nkαckAk) (2)

式中:n為最后一個卷積層中特征映射的總數;αck為權重值。因為只需要對目標類有積極影響的特征,所以將ReLU層應用于加權特征映射的線性組合。導出的定位圖是最后一個特征圖在同一維上的所有特征圖的非負加權平均值,利用雙線性插值對輸入圖像分辨率進行上采樣,形成最終的熱圖。計算出的Grad-CAM權重歸一化到0~1的范圍,權重值越高,說明該震相特征重要性越大。每個模型均使用網絡模型的最后一個卷積層來形成可視化圖。

2 訓練結果及評價指標

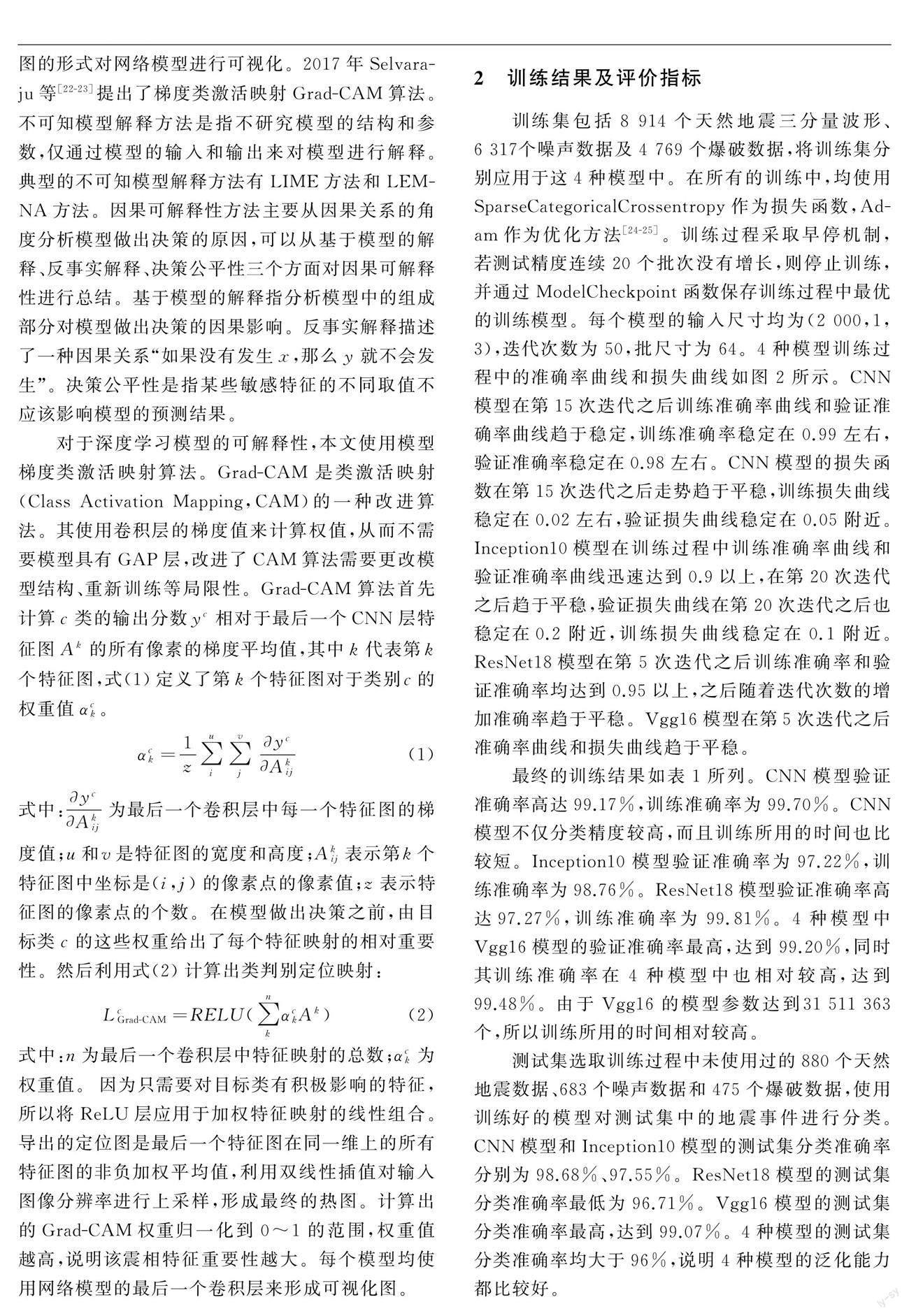

訓練集包括8 914個天然地震三分量波形、6 317個噪聲數據及4 769個爆破數據,將訓練集分別應用于這4種模型中。在所有的訓練中,均使用SparseCategoricalCrossentropy作為損失函數,Adam作為優化方法[24-25]。訓練過程采取早停機制,若測試精度連續20個批次沒有增長,則停止訓練,并通過ModelCheckpoint函數保存訓練過程中最優的訓練模型。每個模型的輸入尺寸均為(2 000,1,3),迭代次數為50,批尺寸為64。4種模型訓練過程中的準確率曲線和損失曲線如圖2所示。CNN模型在第15次迭代之后訓練準確率曲線和驗證準確率曲線趨于穩定,訓練準確率穩定在0.99左右,驗證準確率穩定在0.98左右。CNN模型的損失函數在第15次迭代之后走勢趨于平穩,訓練損失曲線穩定在0.02左右,驗證損失曲線穩定在0.05附近。Inception10模型在訓練過程中訓練準確率曲線和驗證準確率曲線迅速達到0.9以上,在第20次迭代之后趨于平穩,驗證損失曲線在第20次迭代之后也穩定在0.2附近,訓練損失曲線穩定在0.1附近。ResNet18模型在第5次迭代之后訓練準確率和驗證準確率均達到0.95以上,之后隨著迭代次數的增加準確率趨于平穩。Vgg16模型在第5次迭代之后準確率曲線和損失曲線趨于平穩。

最終的訓練結果如表1所列。CNN模型驗證準確率高達99.17%,訓練準確率為99.70%。CNN模型不僅分類精度較高,而且訓練所用的時間也比較短。Inception10模型驗證準確率為97.22%,訓練準確率為98.76%。ResNet18模型驗證準確率高達97.27%,訓練準確率為99.81%。4種模型中Vgg16模型的驗證準確率最高,達到99.20%,同時其訓練準確率在4種模型中也相對較高,達到99.48%。由于Vgg16的模型參數達到31 511 363個,所以訓練所用的時間相對較高。

測試集選取訓練過程中未使用過的880個天然地震數據、683個噪聲數據和475個爆破數據,使用訓練好的模型對測試集中的地震事件進行分類。CNN模型和Inception10模型的測試集分類準確率分別為98.68%、97.55%。ResNet18模型的測試集分類準確率最低為96.71%。Vgg16模型的測試集分類準確率最高,達到99.07%。4種模型的測試集分類準確率均大于96%,說明4種模型的泛化能力都比較好。

準確率是一個比較直觀的評價分類器效果的指標,但是在樣本不均衡的情況下并不能作為很好的指標來衡量結果。為了評估每個模型的性能,本文加入查準率、召回率和F1值去評價每個模型的分類效果[26]。F1值為查準率和召回率的調和平均值,以便更好地反映模型的整體性能。

通過測試集來計算各個模型的查準率、召回率和F1值來評價模型的性能。從表2中可以看出4種模型的查準率、召回率和F1值均接近1,所以各個模型的分類性能比較好。

3 模型的可解釋性研究

本文將Grad-CAM算法應用到模型的可解釋性研究當中。計算出的Grad-CAM權重值歸一化到0~1的范圍,值越高說明重要性越大。CNN模型和Vgg16模型做出分類決策主要依賴P波和S波。ResNet18模型和Inception10模型的關注點較少,整條波形的高權值部分較少。

4種模型識別天然地震事件的可視化圖如圖3所示,每個子圖顯示了模型做出分類決策所依賴的波形特征,波形特征的Grad-CAM權重值越大,代表模型做出決策時更加依賴此波形特征,每個波形圖的標題顯示了波形的真實類別、預測類別以及預測概率,輸入波形的真實類別為天然地震事件。4種模型預測此輸入波形為天然地震事件的概率均為1,預測此輸入波形為噪聲數據或者爆破事件的概率為0。CNN模型在識別天然地震波形時主要依賴于P波和S波,權值在S波之后顯著下降。Vgg16模型和CNN模型相似,同樣將注意力放在P波和S波的震相上面,對于其他位置的關注度很低。ResNet18模型更關注S波,對于P波的依賴較小。Inception10模型對于S波的關注度較大,分類時對于其他波段的關注度較小。

4種模型識別爆破事件的可視化圖如圖4所示,輸入波形的真實類別為爆破事件波形。Inception10模型預測輸入波形為爆破事件的概率為0.97,波形為天然地震的概率為0.03,波形為噪聲數據的概率為0。CNN模型、Vgg16模型和ResNet18模型預測輸入波形為爆破事件的概率均為1。CNN模型識別爆破事件權值在P波和S波處最大,對于震前和能量衰減階段的關注度非常低,主要注意力集中在能量較高的部分。Vgg16模型識別爆破事件時P波的權值最大,隨后權值開始降低。ResNet18模型的關注點相對較少,僅僅關注到部分P波和S波的震相特征,在波形的末尾處有權值較高的部分。Inception10模型最大注意力在S波振幅較大處,整條波形的權值比較平均。

圖5為4種模型識別噪聲數據的可視化圖,輸入波形的真實類別為噪聲數據。4種模型預測輸入波形為噪聲數據的概率均為1。CNN模型和Vgg16模型在識別噪聲數據時,波形的高權值部分較多。而ResNet18模型和Inception10模型所依賴的波形特征較少。

4 結論

本文使用CNN模型、ResNet18模型、Inception模型和Vgg16模型對地震和爆破事件波形進行分類,并通過Grad-CAM算法對4種深度學習模型的可解釋性進行了分析。

在福建地區的地震事件分類應用中,4種模型的測試集分類準確率均在96%以上。其中CNN模型和Inception10模型的準確率分別為98.68%和97.55%。ResNet18模型的準確率為96.71%,在4種模型中最低。Vgg16模型的準確率最高,達到99.07%。4種模型在地震事件的分類任務中準確率均比較高,而且具有較好的泛化能力。通過對模型的可解釋性分析可以看出,Vgg16模型和CNN模型能夠比較準確地注意到波形中P波和S波的震相特征,對于地震波到達之前和能量衰減的位置依賴性較小,而ResNet18模型和Inception模型做出判決時對于整條波形的依賴比較廣泛,不能很好地注意到地震波的震相特征。因此,由模型的可解釋性分析也可以預測出Vgg16和CNN模型的分類效果應該好于其他2種模型,而實際的分類結果確實如此。

本文通過為每個模型加入Grad-CAM算法,使得模型的黑盒問題得到解決,提高了研究人員對于深度學習網絡的信任度,能夠讓研究人員了解到模型做出判決時對于波形的依賴,從而能夠選擇更合適的模型并且去修改模型。對于地震事件分類任務來說,波形數據比較小,CNN模型結構簡單,分類精度高,訓練耗時少,更適合應用于地震事件分類任務中。由于CNN模型和Vgg16模型對于P波和S波初至較為敏感,也可嘗試將這2種模型應用到P波和S波到時拾取的研究中。

致謝:福建省地震局林彬華高級工程師提供的地震波形資料,美國勞倫斯利弗莫爾國家實驗室Kong教授提供的神經網絡可視化代碼,以及python開源編程平臺,在此一并表示感謝。附所用深度學習模型及可視化程序代碼鏈接:https://github.com/Luxiaochen2022/Grad-CAM.git。

參考文獻(References)

[1] 邊銀菊.Fisher方法在震級比mb/MS判據識別爆炸中的應用研究[J].地震學報,2005,27(4):414-422.

BIAN Yinju.Application of Fisher method to discriminating earthquakes and explosions using criterion mb/MS[J].Acta Seismologica Sinica,2005,27(4):414-422.

[2] 楊芳,朱嘉健,劉智,等.廣東地區地震與爆破事件識別方法研究[J].華南地震,2016,36(3):110-115.

YANG Fang,ZHU Jiajian,LIU Zhi,et al.Study on identification methods between earthquakes and explosions occurred in Guangdong region[J].South China Journal of Seismology,2016,36(3):110-115.

[3] 蔡杏輝,邵平榮,段剛,等.福建地區人工爆破與天然地震的判定[J].地震地磁觀測與研究,2013,34(增刊1):87-91.

CAI Xinghui,SHAO Pingrong,DUAN Gang,et al.Waveform distinction between artificial explosions and natural earthquakes recorded in Fujian area[J].Seismological and Geomagnetic Observation and Research,2013,34(Suppl01):87-91.

[4] 崔鑫,許力生,許忠淮,等.小地震與人工爆破記錄的時頻分析[J].地震工程學報,2016,38(1):71-78.

CUI Xin,XU Lisheng,XU Zhonghuai,et al.Time-frequency analysis of records of small earthquakes and explosions[J].China Earthquake Engineering Journal,2016,38(1):71-78.

[5] 霍祝青,王俊,張金川,等.江蘇地區天然地震與人工爆破識別研究[J].地震工程學報,2015,37(1):228-231.

HUO Zhuqing,WANG Jun,ZHANG Jinchuan,et al.Recognition study on earthquakes and explosions in Jiangsu area[J].China Earthquake Engineering Journal,2015,37(1):228-231.

[6] MOUSAVI S M,ELLSWORTH W L,ZHU W Q,et al.Earthquake transformer:an attentive deep-learning model for simultaneous earthquake detection and phase picking[J].Nature Communications,2020,11:3952.

[7] 趙明,唐淋,陳石,等.基于深度學習到時拾取自動構建長寧地震前震目錄[J].地球物理學報,2021,64(1):54-66.

ZHAO Ming,TANG Lin,CHEN Shi,et al.Machine learning based automatic foreshock catalog building for the 2019 MS6.0 Changning,Sichuan earthquake[J].Chinese Journal of Geophysics,2021,64(1):54-66.

[8] 高永國,尹欣欣,李少華.基于深度學習的地震與爆破事件自動識別研究[J].大地測量與地球動力學,2022,42(4):426-430.

GAO Yongguo,YIN Xinxin,LI Shaohua.Automatic recognition of earthquake and blasting events based on deep learning[J].Journal of Geodesy and Geodynamics,2022,42(4):426-430.

[9] 化盈盈,張岱墀,葛仕明.深度學習模型可解釋性的研究進展[J].信息安全學報,2020,5(3):1-12.

HUA Yingying,ZHANG Daichi,GE Shiming.Research progress in the interpretability of deep learning models[J].Journal of Cyber Security,2020,5(3):1-12.

[10] FJELLAND R.Why general artificial intelligence will not be realized[J].Humanities and Social Sciences Communications,2020,7(1):1-9.

[11] KONG Q K,WANG R J,WALTER W R,et al.Combining deep learning with physics based features in explosion-earthquake discrimination[J].Geophysical Research Letters,2022,49(13):l098645.

[12] ZHANG Z Z,XIE Y P,XING F Y,et al.MDNet:a semantically and visually interpretable medical image diagnosis network[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Honolulu,HI,USA:[s.n.],2017:3549-3557.

[13] 李瑋杰,楊威,劉永祥,等.雷達圖像深度學習模型的可解釋性研究與探索[J].中國科學:信息科學,2022,52(6):1114-1134.

LI Weijie,YANG Wei,LIU Yongxiang,et al.Research and exploration on the interpretability of deep learning model in radar image[J].Scientia Sinica (Informationis),2022,52(6):1114-1134.

[14] HE K M,ZHANG X Y,REN S Q,et al.Deep residual learning for image recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Las Vegas,NV,USA:[s.n.],2016:770-778.

[15] SZEGEDY C,LIU W,JIA Y Q,et al.Going deeper with convolutions[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Boston,MA,USA:[s.n.],2015:1-9.

[16] SIMONYAN K,ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[EB/OL].2014:arXiv:1409.1556.https://arxiv.org/abs/1409.1556.

[17] 曾春艷,嚴康,王志鋒,等.深度學習模型可解釋性研究綜述[J].計算機工程與應用,2021,57(8):1-9.

ZENG Chunyan,YAN Kang,WANG Zhifeng,et al.Survey of interpretability research on deep learning models[J].Computer Engineering and Applications,2021,57(8):1-9.

[18] HAUFE S,MEINECKE F,GORGEN K,et al.On the interpretation of weight vectors of linear models in multivariate neuroimaging[J].NeuroImage,2014,87:96-110.

[19] ERHAN D,BENGIO Y,COURVILLE A,et al.Visualizing higher-layer features of a deep network[R].Montreal:University of Montreal,2009.

[20] SUNDARARAJAN M,TALY A,YAN Q Q.Gradients of counterfactuals[EB/OL].2016:arXiv:1611.02639.https://arxiv.org/abs/1611.02639.

[21] ZHOU B L,KHOSLA A,LAPEDRIZA A,et al.Learning deep features for discriminative localization[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Las Vegas,NV,USA:[s.n.],2016:2921-2929.

[22] SELVARAJU R R,DAS A,VEDANTAM R,et al.Grad-CAM:why did You say that?[EB/OL].2016:arXiv:1611.07450.https://arxiv.org/abs/1611.07450.

[23] SELVARAJU R R,COGSWELL M,DAS A,et al.Grad-CAM:visual explanations from deep networks via gradient-based localization[C]//Proceedings of the IEEE International Conference on Computer Vision.Venice,Italy:[s.n.],2017:618-626.

[24] GOODFELLOW I,BENGIO Y,COURVILLE A.Deep learning[M].Cambridge,Boston,Massachusetts,USA:The MIT Press,2016.

[25] KINGMA D P,BA J.Adam:a method for stochastic optimization[EB/OL].2014:arXiv:1412.6980.https://arxiv.org/abs/1412.6980.

[26] 林學楷,許才軍.深度學習驅動的地震目錄構建:PhaseNet和EqT模型的對比與評估[J].武漢大學學報(信息科學版),2022,47(6):855-865.

LIN Xuekai,XU Caijun.Deep-learning-empowered earthquake catalog building:comparison and evaluation of PhaseNet and EqT models[J].Geomatics and Information Science of Wuhan University,2022,47(6):855-865.