基于毫米波雷達(dá)與視覺(jué)融合的碰撞預(yù)警 *

李勇滔,孫晨旭,鄭偉光,2,許恩永,李育方,王善超

(1. 廣西科技大學(xué),重型車輛零部件先進(jìn)設(shè)計(jì)制造教育部工程研究中心,柳州 545616;2. 吉林大學(xué)汽車工程學(xué)院,長(zhǎng)春 130000;3. 東風(fēng)柳州汽車有限公司,柳州 545616)

前言

隨著汽車“新四化”(電動(dòng)化、智能化、網(wǎng)聯(lián)化、共享化)概念的提出[1],汽車的各方面技術(shù)不斷發(fā)展,由于目前交通道路日益復(fù)雜,極易發(fā)生交通安全事故,而高級(jí)駕駛輔助系統(tǒng)(advanced driving assistance system, ADAS)是提高智能汽車安全性與平穩(wěn)性的重要技術(shù)之一,通過(guò)主動(dòng)安全裝置避免事故發(fā)生[2-3]。環(huán)境感知為駕駛輔助系統(tǒng)的核心技術(shù)之一,其通過(guò)不同類型的車載傳感器獲取周圍環(huán)境的物理信息,從而提醒駕駛員或輔助系統(tǒng)做出決策[4]。

毫米波雷達(dá)預(yù)警裝置具有高識(shí)別率、不易受環(huán)境影響以及較高的靈敏度和抗干擾性成為智能預(yù)警裝置的首選,但其分辨檢測(cè)目標(biāo)的類別能力較差,對(duì)靜目標(biāo)識(shí)別率低[5]。于增雨[6]針對(duì)上述分類較差問(wèn)題,提出了一種結(jié)合CNN 與LSTM 的毫米波雷達(dá)目標(biāo)分類方法,加強(qiáng)了對(duì)細(xì)節(jié)信息與時(shí)序信息的關(guān)注,有效地提高了目標(biāo)分類的正確度。王戰(zhàn)古[7]考慮到天氣與車輛狀態(tài)等因素的影響,建立了多因素耦合的雷達(dá)車輛檢測(cè)模型,有效提高了毫米波雷達(dá)在不良天氣下對(duì)車輛檢測(cè)的精度。

與毫米波雷達(dá)裝置相比,視覺(jué)傳感器能夠獲取豐富的圖像信息,能夠準(zhǔn)確識(shí)別靜態(tài)目標(biāo)及其類別。視覺(jué)傳感器目標(biāo)檢測(cè)算法主要分為兩大類算法,一類為基于傳統(tǒng)的機(jī)器學(xué)習(xí)目標(biāo)檢測(cè)方法,另一類則為基于深度學(xué)習(xí)的目標(biāo)檢測(cè)方法。其中,基于傳統(tǒng)的機(jī)器學(xué)習(xí)目標(biāo)檢測(cè)注重于特征的提取,與具體應(yīng)用密切相關(guān),但泛化能力及魯棒性較差,又因?yàn)閺?fù)雜的道路環(huán)境與車輛特征的復(fù)雜性,導(dǎo)致識(shí)別率低,誤檢率高[8]。深度學(xué)習(xí)目標(biāo)檢測(cè)算法主要有兩大類:一類為基于候選區(qū)域提名的目標(biāo)檢測(cè)算法,如RCNN[9]、SPP-net[10]等;另一類為基于端到端(end-toend)的目標(biāo)檢測(cè)算法,無(wú)須區(qū)域提名的,如YOLO[11]、SSD[12]。張海明等[13]基于Faster R-CNN 網(wǎng)絡(luò)模型做出改進(jìn),針對(duì)池化層壓縮特征圖丟失信息問(wèn)題,加入了空洞卷積,并采用多尺度特征融合等方法,提高了目標(biāo)檢測(cè)的精度。談文蓉等[14]針對(duì)車輛檢測(cè)速度無(wú)法適應(yīng)高速環(huán)境與小目標(biāo)檢測(cè)困難的問(wèn)題,對(duì)YOLOv4 算法的主干網(wǎng)絡(luò)、FPN 層與PAN 層進(jìn)行改進(jìn),提高了識(shí)別準(zhǔn)確率與檢測(cè)速度,但在雨天和雪天等環(huán)境下精度較低。

然而,視覺(jué)傳感器檢測(cè)目標(biāo)易受環(huán)境影響[15]。但是,通過(guò)毫米波雷達(dá)與機(jī)械視覺(jué)的目標(biāo)融合算法可以互相彌補(bǔ)單個(gè)傳感器的缺陷,且它們的成本低廉。Wang等[16]針對(duì)雷達(dá)的現(xiàn)有缺陷問(wèn)題,利用提出的標(biāo)定方法對(duì)攝像頭與雷達(dá)進(jìn)行標(biāo)定,并采用視覺(jué)算法YOLO 與雷達(dá)檢測(cè)結(jié)果進(jìn)行決策級(jí)融合,結(jié)合兩傳感器各自優(yōu)勢(shì),減少了車輛檢測(cè)的誤差。張炳力等[17]針對(duì)單一傳感器檢測(cè)精度差問(wèn)題,將雷達(dá)檢測(cè)結(jié)果與深度視覺(jué)YOLOv2 算法檢測(cè)算法結(jié)合,并通過(guò)EKF 算法對(duì)目標(biāo)進(jìn)行追蹤,提高了檢測(cè)準(zhǔn)確率,但采用的EKF 算法易受噪聲影響,會(huì)出現(xiàn)嚴(yán)重波動(dòng)。胡延平等[18]提取視覺(jué)圖像Haar-like 特征,利用Adaboost分類算法檢測(cè)車輛并生成車輛感興趣區(qū)域,與雷達(dá)信息目標(biāo)融合,最后通過(guò)KCF-KF 組合濾波算法對(duì)車輛目標(biāo)追蹤。雖然該方法有效地提高了環(huán)境感知的準(zhǔn)確率,但所采用的傳統(tǒng)視覺(jué)檢測(cè)算法受到人工調(diào)試經(jīng)驗(yàn)的影響,采用的追蹤算法也未考慮外部環(huán)境影響。甘耀東等[19]對(duì)上述出現(xiàn)的問(wèn)題,提出了自適應(yīng)擴(kuò)展卡爾曼濾波算法進(jìn)行毫米波雷達(dá)追蹤目標(biāo),并與改進(jìn)的SSD 深度視覺(jué)檢測(cè)目標(biāo)信息相結(jié)合進(jìn)行信息的決策級(jí)數(shù)據(jù)融合,充分考慮到外部因素對(duì)雷達(dá)追蹤的影響,有效地提高了識(shí)別車輛目標(biāo)的精度。但文獻(xiàn)中設(shè)計(jì)的自適應(yīng)追蹤算法采用傳統(tǒng)的開窗估計(jì)法,可能會(huì)使新息估計(jì)方差與實(shí)際差別較大,而采用的SSD 視覺(jué)檢測(cè)算法需要人工設(shè)置預(yù)選框,導(dǎo)致調(diào)試過(guò)程非常依賴經(jīng)驗(yàn)。

前碰撞預(yù)警系統(tǒng)通過(guò)安全距離與碰撞時(shí)間的設(shè)計(jì),發(fā)出報(bào)警信息來(lái)提醒駕駛員做出判斷。王艷玲[20]研究了駕駛員行為特性與環(huán)境因素對(duì)反應(yīng)時(shí)間的影響,提出了基于模糊理論控制的安全距離模型,通過(guò)不同的反應(yīng)時(shí)間來(lái)設(shè)置安全距離閾值,提高了預(yù)警系統(tǒng)的安全性與穩(wěn)定性,但未進(jìn)行實(shí)車測(cè)試,也未考慮車輛實(shí)際狀態(tài)。

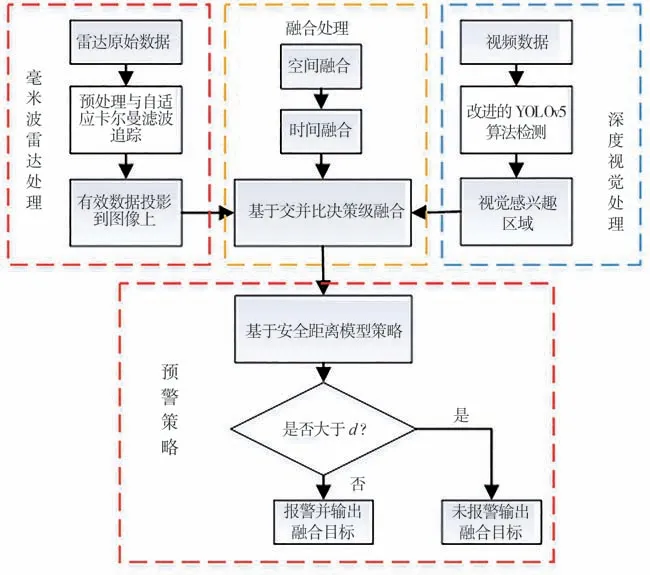

針對(duì)上述問(wèn)題,本文提出了一種基于毫米波雷達(dá)與視覺(jué)融合車輛碰撞預(yù)警方法,其中對(duì)于雷達(dá)追蹤目標(biāo)問(wèn)題,提出一種改進(jìn)的遺忘自適應(yīng)卡爾曼濾波算法追蹤目標(biāo);對(duì)于視覺(jué)檢測(cè)目標(biāo)算法,采用改進(jìn)的YOLOv5 視覺(jué)檢測(cè)算法,由此提高檢測(cè)精度。最后將雷達(dá)追蹤目標(biāo)ROI與視覺(jué)檢測(cè)ROI進(jìn)行決策級(jí)融合,如圖1 所示。經(jīng)實(shí)驗(yàn)證明,該方法提高了前方車輛識(shí)別的準(zhǔn)確性與對(duì)外部環(huán)境的適應(yīng)性。

圖1 融合預(yù)警算法的整體框架

1 基于毫米波雷達(dá)追蹤前方目標(biāo)

1.1 毫米波雷達(dá)數(shù)據(jù)預(yù)處理

毫米波雷達(dá)輸出數(shù)據(jù)為目標(biāo)點(diǎn),包括探測(cè)目標(biāo)點(diǎn)的橫向距離、縱向距離、速度、角度等信息。在輸出的原始數(shù)據(jù)中含有大量的空目標(biāo)、虛假目標(biāo)以及非危險(xiǎn)目標(biāo),對(duì)真實(shí)有效目標(biāo)造成了一定的干擾,也增大處理程序的計(jì)算量。因此,迫切需要去除干擾目標(biāo)。針對(duì)空目標(biāo),其距離和相對(duì)速度等物理信息均為0,將此類數(shù)據(jù)篩選去除即可。基于相對(duì)速度與橫向距離能夠有效地將干擾數(shù)據(jù)進(jìn)行濾波,設(shè)置有效數(shù)據(jù)點(diǎn)橫向距離與相對(duì)速度閾值為

式中:X為后車與前方目標(biāo)的橫向距離;X0為設(shè)置的有效目標(biāo)橫向距離閾值;v為前方目標(biāo)與后車的相對(duì)速度。毫米波雷達(dá)的檢測(cè)速度范圍為-66~66 m/s,根據(jù)相關(guān)公路規(guī)定以及大量實(shí)驗(yàn)證出,選取X0=4.75 m。

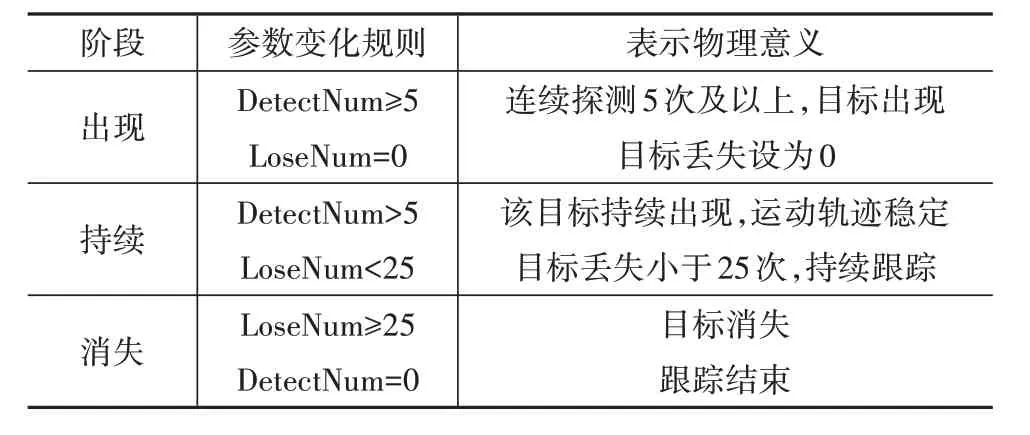

針對(duì)持續(xù)時(shí)間較短、連續(xù)出現(xiàn)較少的虛假目標(biāo),本文采用目標(biāo)生命周期的方法[21]對(duì)虛假目標(biāo)進(jìn)行過(guò)濾,將生命周期設(shè)置為如下3 個(gè)階段:形成、持續(xù)和消失。為此設(shè)定下列參數(shù):DetectNum 為前方目標(biāo)被探測(cè)的次數(shù);LoseNum 為前方目標(biāo)連續(xù)丟失的次數(shù)。

當(dāng)前方目標(biāo)每幀被探測(cè)到一次,則DetectNum加1;當(dāng)前方目標(biāo)每幀丟失一次,LoseNum 加1。根據(jù)設(shè)置閾值來(lái)處理,具體生命周期處理規(guī)則如表1所示。

表1 目標(biāo)生命周期階段表示規(guī)則

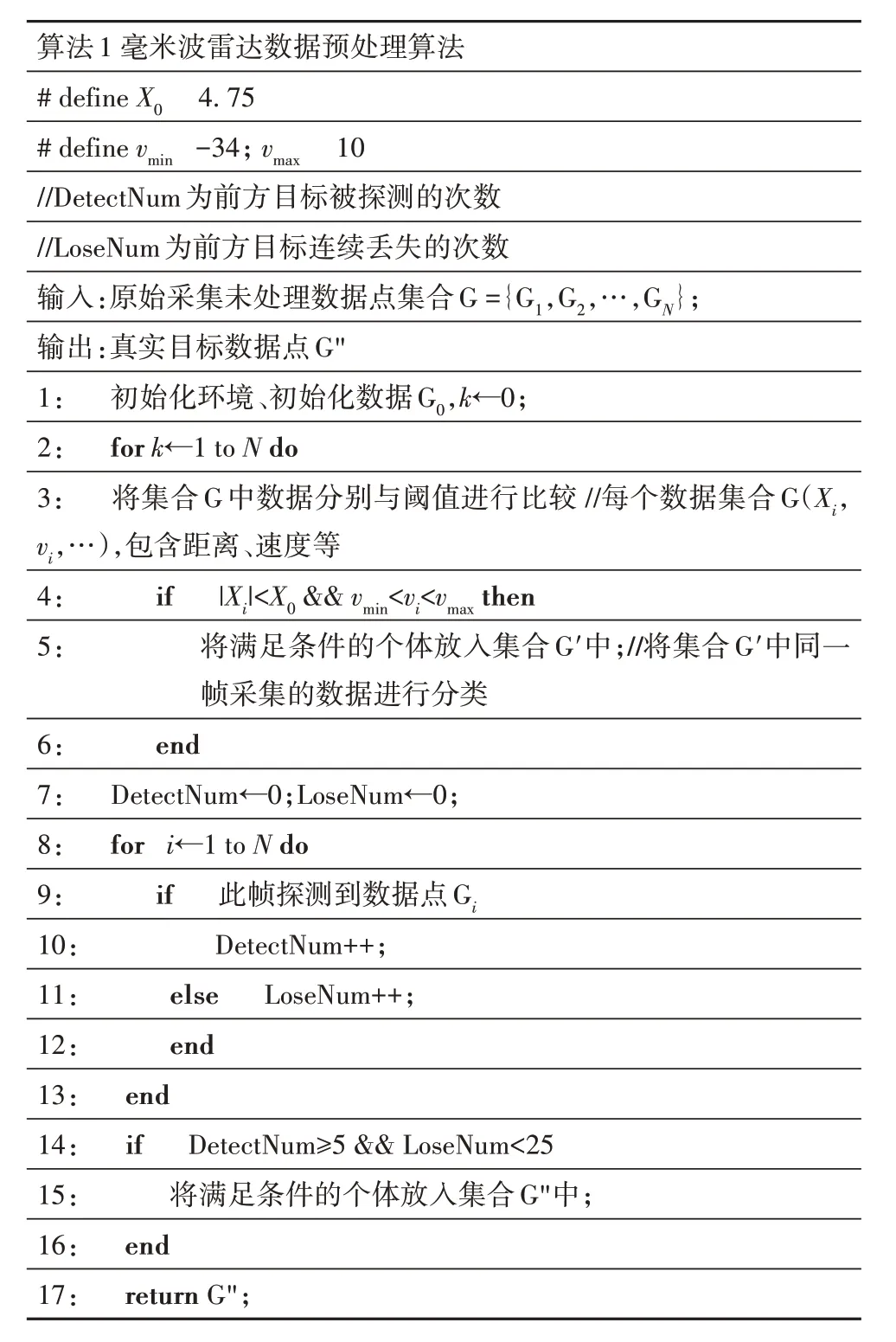

毫米波雷達(dá)數(shù)據(jù)預(yù)處理具體算法流程如算法1偽代碼所示。首先定義閾值等相關(guān)參數(shù),通過(guò)橫向距離與相對(duì)速度閾值條件對(duì)集合G的每個(gè)數(shù)據(jù)點(diǎn)進(jìn)行篩選,得到處理后的數(shù)據(jù)集合G′,將同一時(shí)間采集的數(shù)據(jù)進(jìn)行分類,并對(duì)此集合每幀數(shù)據(jù)進(jìn)行生命周期統(tǒng)計(jì),最后計(jì)算出真實(shí)目標(biāo)數(shù)據(jù)集合G"。

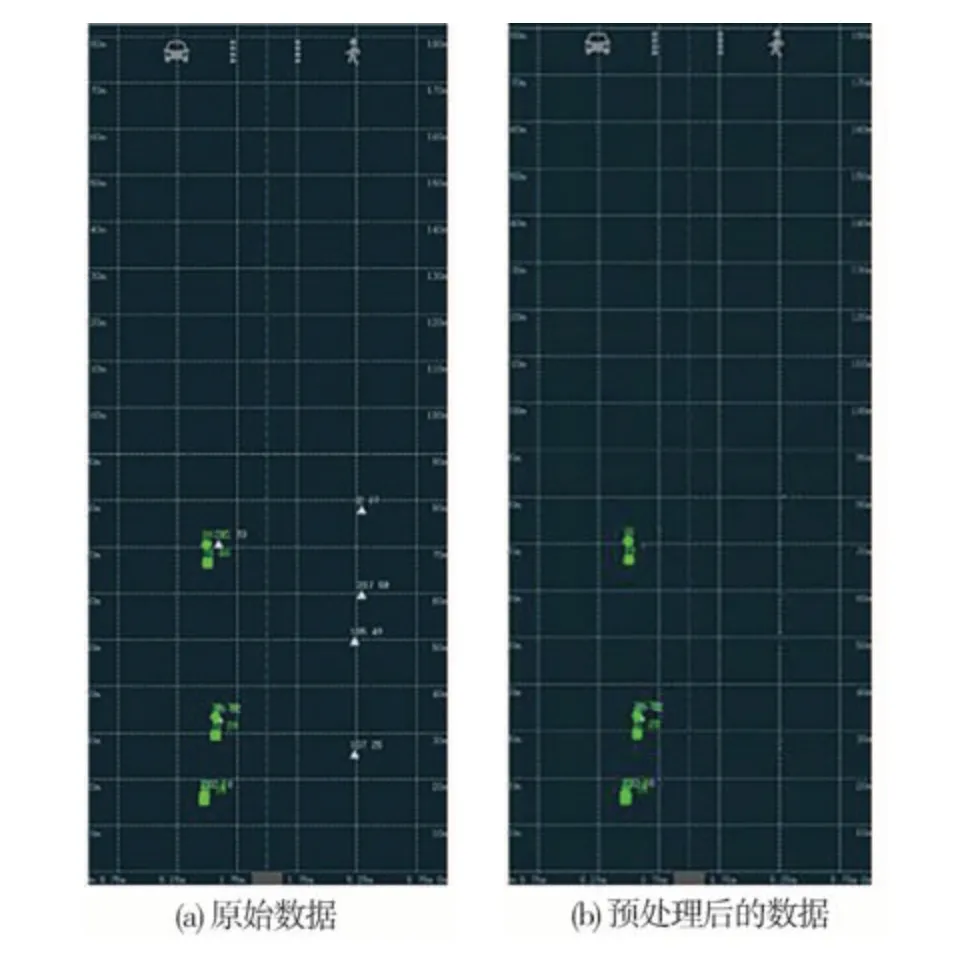

圖2 所示為毫米波雷達(dá)選取原始數(shù)據(jù)與數(shù)據(jù)預(yù)處理的對(duì)比。圖中的數(shù)據(jù)點(diǎn)表示檢測(cè)到的數(shù)據(jù),其中綠點(diǎn)表示有效目標(biāo),而白點(diǎn)表示噪聲。

圖2 原始數(shù)據(jù)預(yù)處理效果對(duì)比圖

1.2 改進(jìn)的遺忘自適應(yīng)卡爾曼濾波追蹤

毫米波雷達(dá)通過(guò)檢測(cè)前方目標(biāo),獲取目標(biāo)位置等數(shù)據(jù),然后對(duì)該數(shù)據(jù)進(jìn)行處理,自動(dòng)形成航跡,并預(yù)測(cè)目標(biāo)在下一時(shí)刻的位置。當(dāng)雷達(dá)獲取目標(biāo)距離速度信息時(shí),由于測(cè)量誤差或過(guò)程中產(chǎn)生的噪聲,使所獲取的信息數(shù)據(jù)不準(zhǔn)確,因此須采用濾波算法降低測(cè)量與實(shí)際值的誤差。卡爾曼濾波(KF)是一種采用最小估計(jì)均方差(MMSE)準(zhǔn)則的遞歸算法,可以通過(guò)獲得先前觀察到的目標(biāo)狀態(tài)估計(jì)和當(dāng)前狀態(tài)的測(cè)量值來(lái)估計(jì)目標(biāo)的當(dāng)前狀態(tài)。由于交通道路車輛的非線性運(yùn)動(dòng)過(guò)程,可采用擴(kuò)展卡爾曼濾波(EKF)將非線性問(wèn)題線性化。EKF 主要包括目標(biāo)狀態(tài)估計(jì)與更新校正兩大部分。

算法1 毫米波雷達(dá)數(shù)據(jù)預(yù)處理算法# define X0 4.75# define vmin -34; vmax 10//DetectNum為前方目標(biāo)被探測(cè)的次數(shù)//LoseNum為前方目標(biāo)連續(xù)丟失的次數(shù)輸入:原始采集未處理數(shù)據(jù)點(diǎn)集合G={G1,G2,…,GN};輸出:真實(shí)目標(biāo)數(shù)據(jù)點(diǎn)G"1: 初始化環(huán)境、初始化數(shù)據(jù)G0,k←0;2: for k←1 to N do 3: 將集合G 中數(shù)據(jù)分別與閾值進(jìn)行比較 //每個(gè)數(shù)據(jù)集合G(Xi,vi,…),包含距離、速度等4: if |Xi|<X0 && vmin<vi<vmax then 5: 將滿足條件的個(gè)體放入集合G′中;//將集合G′中同一幀采集的數(shù)據(jù)進(jìn)行分類6: end 7: DetectNum←0;LoseNum←0;8: for i←1 to N do 9: if 此幀探測(cè)到數(shù)據(jù)點(diǎn)Gi 10: DetectNum++;11: else LoseNum++;12: end 13: end 14: if DetectNum≥5 && LoseNum<25 15: 將滿足條件的個(gè)體放入集合G"中;16: end 17: return G";

(1)目標(biāo)狀態(tài)估計(jì)

對(duì)于前方目標(biāo)做非線性運(yùn)動(dòng),其狀態(tài)方程與測(cè)量方程分別為

式中:Wk-1為過(guò)程噪聲;Vk為測(cè)量噪聲,皆服從于高斯分布,Wk-1~N(0,Q),Vk~N(0,R) 。利用泰勒公式將式(3)中的非線性方程進(jìn)行求偏導(dǎo),得到雅可比矩陣,保留1 階項(xiàng)以實(shí)現(xiàn)對(duì)非線性函數(shù)近似線性化。

擴(kuò)展卡爾曼濾波更新依賴測(cè)量精度R和預(yù)測(cè)精度Q,由于外部環(huán)境等因素不斷干擾信息過(guò)程,致使噪聲以及其方差統(tǒng)計(jì)特性是未知且不斷變化的,且不確定因素會(huì)造成擴(kuò)展卡爾曼濾波無(wú)法精確追蹤目標(biāo)等問(wèn)題。根據(jù)此問(wèn)題,本文提出了一種遺忘自適應(yīng)拓展卡爾曼濾波算法(FAKF)。

將k時(shí)刻式(3)實(shí)際觀測(cè)值Zk和預(yù)測(cè)觀測(cè)值Z^ -k之差,即新息ek,其公式為

則新息協(xié)方差Cek為

為保證協(xié)方差矩陣Rk是正定的,本文采用基于殘差的自適應(yīng)方法來(lái)估計(jì)Rk。

將k時(shí)刻實(shí)際觀測(cè)值Zk和估計(jì)觀測(cè)值^k之差定義為殘差εk,其公式為

殘差的理論協(xié)方差Cεk公式為

從上式得出噪聲協(xié)方差矩陣Rk為

通過(guò)記憶指數(shù)加權(quán)法來(lái)估計(jì)新息的協(xié)方差矩陣,傳統(tǒng)的開窗法只是對(duì)數(shù)據(jù)的平均,而此方法可以對(duì)最新測(cè)量的數(shù)據(jù)加權(quán),提高最新時(shí)刻數(shù)據(jù)的權(quán)重,減少舊數(shù)據(jù)的影響,設(shè)置加權(quán)系數(shù),根據(jù)負(fù)指數(shù)函數(shù)的運(yùn)算規(guī)則對(duì)加權(quán)系數(shù)進(jìn)行賦值,其公式為

式中b為遺忘因子,在運(yùn)用過(guò)程中,當(dāng)系統(tǒng)受到影響較少變化平緩時(shí),b取較大值,反之b取較小值,b的取值范圍為0.7~0.95。

由于式(9)對(duì)加權(quán)系數(shù)序列的要求,令

則加權(quán)系數(shù)為

利用遺忘因子求出自適應(yīng)Rk:

同理利用新息求出狀態(tài)噪聲方差Q:

加入遺忘因子后求出自適應(yīng)估計(jì)值為

1.3 建立目標(biāo)追蹤運(yùn)動(dòng)模型

在復(fù)雜的交通環(huán)境中,常見(jiàn)的CV 模型[22](恒定速度模型)、CA 模型[23](恒定加速度模型)為線性運(yùn)動(dòng)模型,不適合障礙目標(biāo)的追蹤。考慮到目標(biāo)的轉(zhuǎn)向等運(yùn)動(dòng),本文采用更精確的CTRV 模型[24](恒速度恒角速度運(yùn)動(dòng)模型)。設(shè)運(yùn)動(dòng)目標(biāo)的追蹤狀態(tài)量為

式中:x、y為目標(biāo)位置;v為速度(x、y的合速度);θ為朝向角;w為偏航角速度。

假設(shè)目標(biāo)的直線加速度aa和偏航角加速度aw為常數(shù),考慮到實(shí)際運(yùn)動(dòng)中伴隨著加速度的噪聲,最終狀態(tài)方程為

考慮到ω= 0時(shí),簡(jiǎn)化公式為

在CTRV 模型中,對(duì)各個(gè)元素求偏導(dǎo)可以得到狀態(tài)方程與觀測(cè)方程的雅克比矩陣F和H。

2 基于深度學(xué)習(xí)的目標(biāo)檢測(cè)

選擇YOLOv5 深度學(xué)習(xí)目標(biāo)檢測(cè)算法,只使用一個(gè)CNN 網(wǎng)絡(luò)直接預(yù)測(cè)不同目標(biāo)的類別與位置,并采用全圖信息來(lái)進(jìn)行預(yù)測(cè)目標(biāo)的bounding boxes,以識(shí)別目標(biāo)的類別。在準(zhǔn)確率較高的情況下,實(shí)現(xiàn)端到端實(shí)時(shí)目標(biāo)檢測(cè)任務(wù)。

YOLOv5 具有比較簡(jiǎn)潔的結(jié)構(gòu),確保一定整體檢測(cè)精度的條件下,計(jì)算處理速度快,但YOLOv5 在復(fù)雜的道路環(huán)境下檢測(cè)準(zhǔn)確度還不夠,漏檢率和誤檢率較高。YOLOv5 的4 個(gè)模型中的YOLOv5s 模型由于深度淺、寬度窄的因素,部署成本降低,便于模型的快速部署[25]。因此,選擇YOLOv5s 并對(duì)其進(jìn)行改進(jìn)。

2.1 改進(jìn)的CBAM注意力機(jī)制

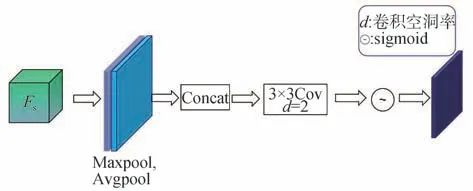

為提高YOLOv5 的檢測(cè)精度,本文提出了在卷積Conv模塊加入雙通道的注意力機(jī)制(convolutional block attention module,CBAM),結(jié)合了通道注意力和空間注意力的輕量級(jí)模塊,促使卷積網(wǎng)絡(luò)更加注重于所需局部目標(biāo)特征的信息區(qū)域,減少全局冗余信息。基于通道注意力部分(CAM),特征圖輸入,通過(guò)并行的最大池化處理(MaxPool)與平均池化處理(AvgPool)后,進(jìn)入多層共享神經(jīng)網(wǎng)絡(luò)(MLP),然后將MLP 輸出的特征進(jìn)行基于元素逐層相加,再經(jīng)過(guò)sigmoid 激活函數(shù)操作,生成具有權(quán)重的通道注意力特征圖。對(duì)于空間注意力模塊(SAM),將通道進(jìn)行壓縮,在通道維度分別進(jìn)行平均池化處理和最大池化處理,再將兩個(gè)通道的特征圖進(jìn)行通道拼接(concat),最后通過(guò)卷積操作,經(jīng)過(guò)sigmoid 激活生成最終的特征。經(jīng)過(guò)實(shí)驗(yàn),將兩個(gè)模塊串行組合最優(yōu)化,特征圖先進(jìn)行通道注意力模塊,再啟用空間注意力模塊,其過(guò)程公式為

式中:F為輸入的特征圖;MC為通道注意力的輸出加權(quán)處理;F1為經(jīng)過(guò)通道注意力加權(quán)特征圖;MS為空間注意力的輸出加權(quán)處理;F2為F1空間注意力加權(quán)得到輸出特征圖。

CBAM 中的通道注意力模塊是將特征圖在空間維度上進(jìn)行壓縮,得到一維矢量,然后通過(guò)逐元素求和合并,最終得到通道注意力圖。由于空間的降維處理導(dǎo)致部分通道特征信息缺失,為避免此情況發(fā)生,選用ECA 模塊代替CAM 模塊。ECA 為不降維的局部跨信道交互策略,該策略可以通過(guò)一維卷積有效地實(shí)現(xiàn)。輸入特征圖通過(guò)全局平均池化(GAP),自適應(yīng)選擇通過(guò)大小為k的一維卷積核大小進(jìn)行卷積且特征提取。k的自適應(yīng)取值公式為

式中:k表示局部跨通道交互的覆蓋范圍;C為通道維度;|t|odd表示距離t最近的奇數(shù);γ設(shè)為1;b設(shè)為2。

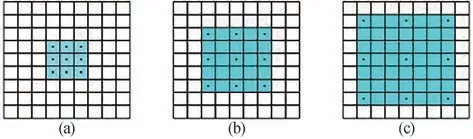

此外,空間注意力模塊中的池化操作會(huì)先壓縮特征圖,然后利用上采樣還原特征圖,這種先壓縮再還原的方式會(huì)導(dǎo)致特征圖的信息丟失,促使網(wǎng)絡(luò)提取的特征量不足,精度下降。利用空洞卷積[26]可以在感受野增大的同時(shí),保持特征圖尺寸不變,一定程度避免了特征信息的丟失。空洞卷積結(jié)構(gòu)如圖3 所示,以3×3 為例,可以通過(guò)3×3 的卷積操作,從而達(dá)到5×5或7×7的卷積效果。

圖3 空洞卷積的效果圖

空洞卷積實(shí)際卷積核大小計(jì)算公式為

式中:k1為原始卷積核大小;d為空洞卷積參數(shù)空洞率。因此可以將空洞卷積與SAM 結(jié)合,首先將輸入分別進(jìn)行通道維度上的平均池化和最大池化,再進(jìn)行空洞率為2 的空洞卷積處理,具體改進(jìn)的SAM 結(jié)構(gòu)如圖4所示。

圖4 改進(jìn)的SAM空間注意力結(jié)構(gòu)

2.2 數(shù)據(jù)集驗(yàn)證與對(duì)比結(jié)果

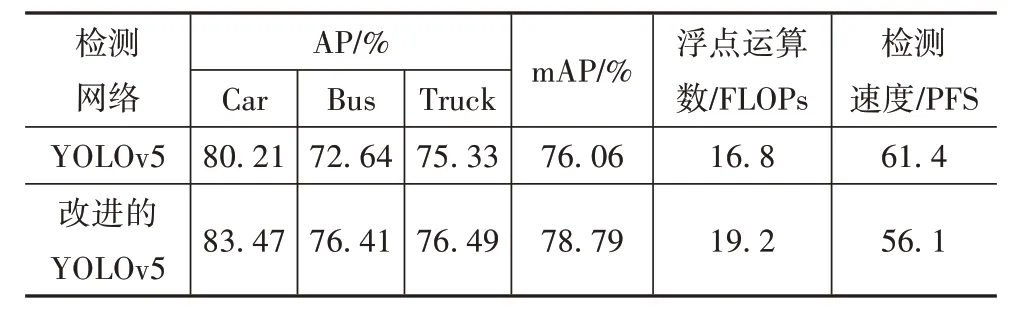

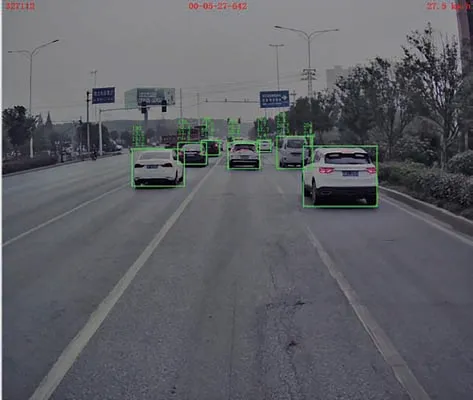

以國(guó)際通用的NYC3Dcars車輛公開檢測(cè)數(shù)據(jù)集為主,其他數(shù)據(jù)集為輔進(jìn)行整合,用作本文的數(shù)據(jù)集庫(kù),并利用labellmg 標(biāo)注工具進(jìn)行手動(dòng)標(biāo)注,如圖5所示,并定義好檢測(cè)車輛的類別,將改進(jìn)后的YOLOv5s模型作為數(shù)據(jù)集訓(xùn)練權(quán)重,選用2 026張數(shù)據(jù)集作為YOLOv5 的訓(xùn)練集,并選用1 488 張數(shù)據(jù)集作為測(cè)試。該數(shù)據(jù)集分為晴天、晴雨、晴夜、雨夜4 種天氣環(huán)境,占比分別為 34%、25%、30%、11%。檢測(cè)后對(duì)檢測(cè)數(shù)據(jù)集所有車輛類別進(jìn)行mAP 指標(biāo)計(jì)算,所得指標(biāo)為76.16%,而本文提出的改進(jìn)YOLOv5訓(xùn)練mAP為78.79%。

圖5 手動(dòng)標(biāo)注數(shù)據(jù)集示意圖

圖6 為視覺(jué)算法檢測(cè)效果。表2 為YOLOv5 與本文改進(jìn)的YOLOv5 的檢測(cè)對(duì)比結(jié)果。表中浮點(diǎn)運(yùn)算數(shù)表示算法的計(jì)算量,本文算法與YOLOv5 算法相比,在輕微增加計(jì)算量與降低檢測(cè)速度的前提下,檢測(cè)平均精確度提高了2.73%,其中在YOLOv5 檢測(cè)時(shí),環(huán)境中其他非危險(xiǎn)物體被誤檢測(cè)為車輛目標(biāo),如廣告牌、房屋等,以及遠(yuǎn)處多車輛重疊未能檢測(cè)出全部車輛目標(biāo)等情況。而本文改進(jìn)算法,添加了改進(jìn)的注意力機(jī)制,更加注重目標(biāo)特征,對(duì)上述問(wèn)題起到一定的減輕作用,但還須借助毫米波雷達(dá)使精確度進(jìn)一步提升。

表2 本文算法與YOLOv5算法的檢測(cè)精度對(duì)比

圖6 視覺(jué)算法檢測(cè)效果圖

3 毫米波雷達(dá)與視覺(jué)融合預(yù)警策略

本文提出的融合方法是將雷達(dá)數(shù)據(jù)形成感興趣區(qū)域,并與攝像頭識(shí)別的圖像數(shù)據(jù)進(jìn)行匹配。由于毫米波雷達(dá)與攝像頭的空間位置和采樣頻率不同,同一目標(biāo)不同傳感器感知的信息無(wú)法匹配。因此,當(dāng)毫米波雷達(dá)與攝像頭融合算法進(jìn)行前方目標(biāo)識(shí)別時(shí),需要對(duì)不同傳感器在空間和時(shí)間上進(jìn)行同步。

3.1 空間融合

毫米波雷達(dá)與視覺(jué)融合的關(guān)鍵之一是實(shí)現(xiàn)毫米波雷達(dá)坐標(biāo)系、三維世界坐標(biāo)系、相機(jī)坐標(biāo)系之間精確的轉(zhuǎn)換關(guān)系,將不同的傳感器坐標(biāo)的測(cè)量值統(tǒng)一到一個(gè)坐標(biāo)系,主要的空間同步方法為將以毫米波檢測(cè)得到的目標(biāo)坐標(biāo)系轉(zhuǎn)換到圖像坐標(biāo)系上。具體步驟為將毫米波雷達(dá)坐標(biāo)系的坐標(biāo)轉(zhuǎn)換到世界坐標(biāo)系,然后將世界坐標(biāo)系的坐標(biāo)轉(zhuǎn)換到圖像像素坐標(biāo)系。毫米波坐標(biāo)到世界坐標(biāo)系的轉(zhuǎn)換關(guān)系為

式中:[XY]為世界坐標(biāo)系的二維橫縱坐標(biāo);[XwYw]為毫米波雷達(dá)在世界坐標(biāo)系的偏移量;[XrYr]為毫米波雷達(dá)二維坐標(biāo)。

世界坐標(biāo)系(Xw,Yw,Zw)轉(zhuǎn)化為圖像像素坐標(biāo)系(u,v) 的關(guān)系式為

式中:Zc為相機(jī)坐標(biāo)系中的Z軸坐標(biāo);(u0,v0)是圖像坐標(biāo)系投影點(diǎn)在像素坐標(biāo)系中的坐標(biāo);R為相機(jī)外參旋轉(zhuǎn)矩陣,是一個(gè)3×3的正交矩陣,有3個(gè)自由度;T為相對(duì)位移向量;f為攝像頭焦距;dx、dy分別為每個(gè)像素對(duì)應(yīng)像素坐標(biāo)系橫縱坐標(biāo)軸的單位物理量。

3.2 時(shí)間融合

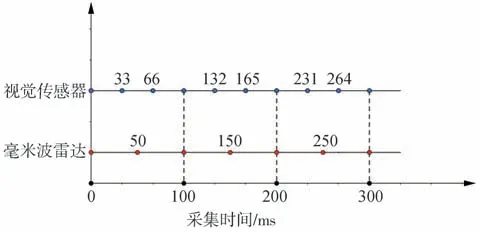

毫米波雷達(dá)與視覺(jué)傳感器經(jīng)過(guò)空間的融合后,還須在時(shí)間采集上進(jìn)行融合。本文采用毫米波雷達(dá)的目標(biāo)更新頻率為20 Hz,而視覺(jué)傳感器的采集頻率為30 Hz。即雷達(dá)每幀采集數(shù)據(jù)的時(shí)間間隔為50 ms,視覺(jué)傳感器的為33.3 ms。以毫米波雷達(dá)為基準(zhǔn),將具有較快采樣率的傳感器與具有較慢采樣率的傳感器兼容,融合具體原理如圖7所示。雷達(dá)每隔2幀時(shí)采集數(shù)據(jù),視覺(jué)傳感器每隔3 幀采集數(shù)據(jù),二者以100 ms 為周期同時(shí)進(jìn)行采樣。例如,當(dāng)毫米波雷達(dá)在100 ms 時(shí),獲取一幀數(shù)據(jù)信息,同時(shí)視覺(jué)傳感器也完成圖像的采集,在采集時(shí)間上保持同步,以實(shí)現(xiàn)多傳感器時(shí)間上的融合。

圖7 毫米波雷達(dá)與視覺(jué)時(shí)間融合

3.3 基于交并比的決策級(jí)融合

本文提出決策級(jí)融合,將毫米波雷達(dá)檢測(cè)結(jié)果與視覺(jué)檢測(cè)結(jié)果對(duì)同一目標(biāo)進(jìn)行匹配,毫米波雷達(dá)基于遺忘自適應(yīng)卡爾曼濾波處理后,輸出的數(shù)據(jù)點(diǎn)通過(guò)空間轉(zhuǎn)換投影到圖像上,如圖8所示。

圖8 圖像投影上的雷達(dá)數(shù)據(jù)

而視覺(jué)傳感器通過(guò)改進(jìn)的YOLOv5 算法,識(shí)別障礙車輛目標(biāo),由此形成視覺(jué)感興趣區(qū)域,與雷達(dá)數(shù)據(jù)點(diǎn)為中心的感興趣融合采用交并比[27](IoU)的方法進(jìn)行數(shù)據(jù)匹配。交并比公式為

式中SC、SR分別為攝像頭與雷達(dá)感興趣區(qū)域面積。設(shè)置交并比的閾值為0.3、0.5。當(dāng)0.5 ≤IoU≤1時(shí),雷達(dá)與攝像頭對(duì)同一目標(biāo)均可識(shí)別,且檢測(cè)結(jié)果基本匹配。當(dāng)0.3 ≤IoU<0.5 時(shí),此時(shí)融合效果一般,但仍判斷目標(biāo)存在,此時(shí)根據(jù)毫米波雷達(dá)與視覺(jué)各自優(yōu)勢(shì),視覺(jué)輸出目標(biāo)的類別,毫米波雷達(dá)輸出目標(biāo)動(dòng)態(tài)信息。

3.4 基于安全距離的前碰撞預(yù)警策略

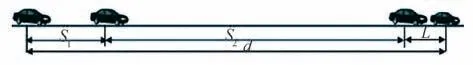

當(dāng)毫米波雷達(dá)與視覺(jué)傳感器檢測(cè)到前方障礙目標(biāo)后,須通過(guò)碰撞預(yù)警控制策略對(duì)其做出決策,輔助駕駛員及時(shí)發(fā)現(xiàn)前方危險(xiǎn)。本文在馬自達(dá)安全距離模型[28]的基礎(chǔ)上,結(jié)合了駕駛環(huán)境變化和駕駛員制動(dòng)行為特征的影響,提出了一種精確的分段距離估計(jì)模型,如圖9所示。

圖9 防撞最小安全距離模型

如圖10 所示,當(dāng)前方車輛突然停止時(shí),后車駕駛員并沒(méi)有立即做出相應(yīng)的制動(dòng),而是通過(guò)τ1時(shí)間之后才開始意識(shí)到采取措施,直到τ2時(shí)間才開始進(jìn)行制動(dòng),在反應(yīng)時(shí)間段τ=τ1+τ2中,主車視為勻速運(yùn)動(dòng)。踩下制動(dòng)踏板時(shí),由于離合器膜片彈簧內(nèi)端和分離軸承間的空隙,此時(shí)制動(dòng)力逐漸增長(zhǎng),此時(shí)主車做變加速運(yùn)動(dòng),此階段需要經(jīng)過(guò)時(shí)間τ3。制動(dòng)逐漸穩(wěn)定后,主車開始做勻減速運(yùn)動(dòng),此階段經(jīng)歷τ4時(shí)間,后車停止。預(yù)警最小安全距離d為

圖10 減速度變化圖

式中:v0為后車初速度,km/h;amax為后車最大減速度;L為車身長(zhǎng)度,m。主車檢測(cè)到前方目標(biāo),當(dāng)超過(guò)最小安全距離d時(shí),做出報(bào)警決策。

4 實(shí)驗(yàn)與分析

為驗(yàn)證本文融合預(yù)警方法的準(zhǔn)確性與實(shí)效性,在晴天、晴夜、多云白天、多云夜晚、雨天、雨夜等多種天氣條件下進(jìn)行實(shí)車測(cè)試。道路環(huán)境也包括不同路面、不同工況等多種情況,實(shí)驗(yàn)采用的毫米波雷達(dá)型號(hào)為深圳的ANNGIC FR55F,工作頻率范圍為76~77 GHz,采用的圖像識(shí)別傳感器型號(hào)為深圳的ANNGIC FV-12M,輸出圖像分辨率為1280 ×1080 pixels,幀率為30 幀/s,計(jì)算機(jī)采用Intel Core i5-7300 處理器,內(nèi)存為8 GB。算法采用MATLAB語(yǔ)言,上述設(shè)備滿足實(shí)驗(yàn)計(jì)算要求。實(shí)驗(yàn)車輛與傳感器如圖11所示。

圖11 實(shí)驗(yàn)車輛與傳感器

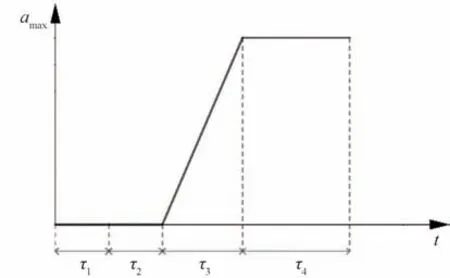

在東風(fēng)柳汽商用車試驗(yàn)中心將實(shí)驗(yàn)車按照規(guī)定的運(yùn)動(dòng)狀態(tài)與路徑進(jìn)行測(cè)試,記錄毫米波雷達(dá)探測(cè)的實(shí)車數(shù)據(jù),以驗(yàn)證本文提出的基于遺忘因子的自適應(yīng)卡爾曼濾波算法的可靠性,如圖12 所示。分別利用FAEKF 算法與EKF 算法追蹤前方目標(biāo),并將兩種算法進(jìn)行對(duì)比。圖12(a)中的真實(shí)值是對(duì)車速傳感器的實(shí)時(shí)車速與時(shí)間積分后進(jìn)行差值計(jì)算獲得,測(cè)量值為毫米波雷達(dá)傳感器測(cè)得,兩值皆用高斯噪聲處理。圖12(b)為兩種算法每段時(shí)間與真實(shí)值的百分比誤差,可以明顯看出本算法的誤差較低,通過(guò)均方根誤差RMSE 來(lái)評(píng)價(jià)兩種算法的精度,具體公式為

圖12 EKF與FAEKF的軌跡圖與誤差曲線

式中:表示算法處理的最優(yōu)估計(jì)值;yi表示真實(shí)值。通過(guò)計(jì)算得出傳統(tǒng)算法EKF 的RMSE值為12.043 6,而本文算法FAEKF的RMSE值為9.750 4,對(duì)比顯示,本文所用的算法得到的最優(yōu)估計(jì)值與實(shí)際值誤差較小,精度更高。

毫米波雷達(dá)與視覺(jué)融合效果圖如圖13 所示,其中前3幅圖為晴天與晴雨道路場(chǎng)景,后3幅圖為夜天與夜雨道路場(chǎng)景。每幅圖中左邊動(dòng)畫圖的綠點(diǎn)為毫米波雷達(dá)檢測(cè)出的障礙車輛,右邊圖為融合效果圖。為展示本文提出的融合預(yù)警算法相比于傳統(tǒng)的EKF算法和YOLOv5 算法結(jié)合的融合預(yù)警算法的優(yōu)勢(shì),將不同算法分別進(jìn)行實(shí)車測(cè)試,預(yù)警的定義為當(dāng)目標(biāo)進(jìn)入最小安全距離,系統(tǒng)應(yīng)該正常預(yù)警,若未報(bào)警則是漏警,而誤報(bào)警的定義為前方未有危險(xiǎn)目標(biāo)而錯(cuò)誤報(bào)警。表3 為本文預(yù)警算法與YOLOv5 和EKF聯(lián)合的傳統(tǒng)融合預(yù)警算法的實(shí)驗(yàn)對(duì)比結(jié)果。通過(guò)對(duì)比可得,基于相同的場(chǎng)景環(huán)境與里程數(shù),相比于傳統(tǒng)方法,本方法在預(yù)警準(zhǔn)確率、漏警率和誤警率方面都有明顯優(yōu)勢(shì)。傳統(tǒng)方法中使用的YOLOv5 算法在夜晚的識(shí)別效果較差,且傳統(tǒng)的EKF 算法易受環(huán)境等噪聲的影響,誤警率較高。而本方法采用的視覺(jué)算法更加注重目標(biāo)特征信息,一定程度上降低了漏檢率,采用的FAEKF 跟蹤算法自適應(yīng)更新環(huán)境等噪聲影響,提高了雷達(dá)跟蹤目標(biāo)的準(zhǔn)確性。總體上本預(yù)警方法的準(zhǔn)確率為94.72%,漏警率為2.97%,誤警率為2.53%,相比傳統(tǒng)的融合方法,準(zhǔn)確率提高了2.41%,漏警率與誤警率分別降低了0.78%、1.85%。

表3 本文融合預(yù)警算法與傳統(tǒng)預(yù)警算法實(shí)驗(yàn)對(duì)比結(jié)果

圖13 融合算法檢測(cè)結(jié)果圖

5 結(jié)論

提出一種基于毫米波雷達(dá)與視覺(jué)融合的碰撞預(yù)警方法對(duì)前方車輛目標(biāo)進(jìn)行監(jiān)測(cè),通過(guò)報(bào)警方式提醒駕駛員做出決策。根據(jù)毫米波雷達(dá)目標(biāo)識(shí)別率較低的問(wèn)題,提出了基于遺忘因子的自適應(yīng)卡爾曼濾波算法,通過(guò)遺忘因子自適應(yīng)更新與修正噪聲及其方差統(tǒng)計(jì)特性,提高追蹤目標(biāo)的準(zhǔn)確性。對(duì)于深度視覺(jué)算法精度較低、準(zhǔn)確率較差的問(wèn)題,提出了改進(jìn)的YOLOv5 算法,在卷積模塊中加入改進(jìn)的CBAM雙通道注意力機(jī)制,對(duì)前方車輛進(jìn)行識(shí)別,促進(jìn)了視覺(jué)檢測(cè)的精度。

本文的毫米波雷達(dá)與視覺(jué)融合的預(yù)警決策方法通過(guò)不同道路場(chǎng)景的實(shí)車測(cè)試,驗(yàn)證結(jié)果證明,該融合檢測(cè)碰撞預(yù)警方法的誤警率和漏警率更低,具有更好的魯棒性與準(zhǔn)確性。