低光照圖像增強(qiáng)研究方法綜述

彭大鑫,甄 彤,李智慧

1.河南工業(yè)大學(xué)糧食信息處理與控制教育部重點實驗室,鄭州450001

2.河南工業(yè)大學(xué)信息科學(xué)與工程學(xué)院,鄭州450001

在科技高速發(fā)展的今天,各種設(shè)備也使用得越來越多,視頻圖像的應(yīng)用也越來越廣泛。由于條件的復(fù)雜性特別是在夜晚條件下形成的視頻圖像往往亮度較低、噪聲較大、對比度較低,很難達(dá)到理想的采集效果,獲取想要的信息。因此對這些低光照條件下形成的圖像進(jìn)行增強(qiáng)就很有必要。低光照圖像增強(qiáng)的目的是突出關(guān)鍵信息,盡可能地排除干擾信息,將原來不清晰或者亮度較低的圖像變得清晰或者增強(qiáng)亮度[1]。在低光條件下,由于光照條件的不確定性,捕獲的圖像質(zhì)量不佳,并夾雜著噪聲導(dǎo)致對比度和亮度嚴(yán)重下降,從而影響圖像暗區(qū)的細(xì)節(jié),出現(xiàn)色彩偏差。根據(jù)增強(qiáng)算法設(shè)計的不同,目前的低光照圖像增強(qiáng)算法主要分為傳統(tǒng)的低光照圖像增強(qiáng)算法以及基于深度學(xué)習(xí)的低光照圖像增強(qiáng)算法。傳統(tǒng)的增強(qiáng)方法主要是對圖像的像素進(jìn)行處理,目的是提高圖像的對比度、亮度以及去除噪聲。但是這類方法不能注意到低光照圖像自身對光照的需求關(guān)系同時忽略了內(nèi)在的上下文信息,進(jìn)而產(chǎn)生圖像顏色失真以及噪聲較大的現(xiàn)象。為了克服上述方法的不足,深度學(xué)習(xí)技術(shù)成為了低光照圖像增強(qiáng)的主流技術(shù)。深度學(xué)習(xí)的方法分為有監(jiān)督和無監(jiān)督的方法。有監(jiān)督的方法利用端到端的網(wǎng)絡(luò)[2]來學(xué)習(xí)輸入低光照圖像與正常光照圖像的映射來達(dá)到增強(qiáng)的目的。無監(jiān)督的方法建立一種非配對映射來增強(qiáng)圖像[3]。但實時性問題沒有得到解決,仍然有改進(jìn)的空間。

綜上,低光照圖像增強(qiáng)方法有規(guī)律可循并且呈現(xiàn)百家爭鳴的態(tài)勢,但仍然存在著許多問題。因此有必要對低光照圖像增強(qiáng)方法進(jìn)行全面分析討論及對比。本文從傳統(tǒng)方法以及深度學(xué)習(xí)方法兩個方面進(jìn)行詳細(xì)分析與闡述。具體方法間的區(qū)別與聯(lián)系如圖1所示。

圖1 各類方法間的聯(lián)系與區(qū)別Fig.1 Relationship and difference between various methods

1 傳統(tǒng)的低光照圖像增強(qiáng)算法

目前最常見的低光照圖像增強(qiáng)方法大致包括以下幾種,包括色調(diào)映射算法、直方圖均衡化算法、伽馬校正算法、暗通道先驗算法、基于Retinex分解的算法以及基于融合的算法。

1.1 色調(diào)映射算法

關(guān)于色調(diào)映射的增強(qiáng)分為全局和局部兩種方法。全局色調(diào)映射過程是將全部的像素點都通過同樣方法加以處理,這就會導(dǎo)致圖像的較亮部分或者較暗部分沒有考慮到,造成圖像顏色映射處理過后缺少了部分的細(xì)節(jié)信息。局部色調(diào)映射時像素點周圍的空間位置也需要被考慮,因為在執(zhí)行多尺度轉(zhuǎn)換的同時,擁有同樣亮度值的兩個像素點之間會表現(xiàn)出不同的比值,因此在它們的空間位置周圍的對比度數(shù)據(jù)也不相同。

色調(diào)映射在保證在高光和低陰影區(qū)域的部分對比度和細(xì)節(jié)數(shù)據(jù)的同時處理之后也會出現(xiàn)一些噪聲。為增加低光照圖像的對比度以及保持顏色一致不變性,趙軍輝等人[4]將Lab 顏色空間和顏色映射融合,提供了一種圖像增強(qiáng)方案。所提算法很好地保存了圖像細(xì)節(jié)的自然程度,同時也強(qiáng)化了圖像的反差度。曹紅艷和劉長明等人[5]提出的自適應(yīng)閾值和色調(diào)映射結(jié)合的算法解決了趙軍輝等的方法可能產(chǎn)生的過度增強(qiáng)以及光暈問題。該方法使用了改進(jìn)的基于貝葉斯的自適應(yīng)閾值方法以實現(xiàn)去噪,并轉(zhuǎn)換顏色空間,較好地提高了圖像品質(zhì),具有很大的對比度。龐澤邦等人[6]將交叉分解的思想與色調(diào)映射算法結(jié)合有效提升了圖像的質(zhì)量。同樣,朱世松等人[7]提出了一種基于協(xié)同濾波的色調(diào)映射算法。該算法結(jié)合色度亮度顏色空間進(jìn)一步提升了圖像的質(zhì)量。

色調(diào)映射算法通過對像素及其周圍像素的處理來達(dá)到對比度增強(qiáng)的效果。由于考慮了這種位置關(guān)系,使得處理之后的圖像具有較好的細(xì)節(jié)信息,全局與局部信息更加凸顯。

由于不同位置的像素值不同,在處理的時候可能會產(chǎn)生不好的效果。該方法的缺點總結(jié)如下:

(1)由于像素之間的關(guān)系兼顧不到位,會使得增強(qiáng)之后的圖像對比度往往不高。

(2)處理之后的圖像細(xì)節(jié)信息有待進(jìn)一步加強(qiáng)。

1.2 直方圖均衡化算法

直方圖均衡化方法,是圖像增強(qiáng)空域法[8]中一個最常見的圖像增強(qiáng)方式,其通過擴(kuò)展灰度數(shù)值的覆蓋范圍來增加對比度和突出部分細(xì)節(jié)內(nèi)容。但也有某些缺點:灰度層的異常拉伸會形成偽影,鋸齒效應(yīng)以及過度增強(qiáng),還會導(dǎo)致圖像細(xì)節(jié)丟失。為了解決上述問題,許多學(xué)者提出了不同的算法。如MEMBHE 算法[9],利用動態(tài)直方圖均衡化來解決過度增強(qiáng)的問題。但是這也會導(dǎo)致增強(qiáng)效果不理想。王利娟等人[10]提出了一種加權(quán)直方圖均衡化的方法,該方法通過加權(quán)方法來解決細(xì)節(jié)丟失問題。楊嘉能等人[11]提出了自適應(yīng)校正的動態(tài)直方圖均衡算法,有效地防止了灰度級的合并,并且較大程度上保留了圖像的細(xì)節(jié)。康利娟等人[12]提出了一種多級直方圖形狀分割的圖像增強(qiáng)技術(shù),在保留細(xì)節(jié)的同時有效抑制了噪聲。Jebadass 等人[13]結(jié)合模糊集理論,首先將低光照圖像模糊化,再利用對比度有限的自適應(yīng)直方圖均衡化方法增強(qiáng)圖像,進(jìn)一步改善了圖像的質(zhì)量。

直方圖均衡化是對圖像的灰度值均衡化,使其均勻分布在整個灰度域范圍內(nèi)。通過均勻化之后的圖像表現(xiàn)有較好的對比度。該方法的缺點總結(jié)如下:

(1)由于是對圖像的直方圖直接拉伸,會導(dǎo)致過度拉伸進(jìn)而產(chǎn)生塊效應(yīng)使圖像質(zhì)量下降。

(2)由于是基于直方圖,不同區(qū)域如過曝光和曝光不足區(qū)域的反差不太明顯,導(dǎo)致圖像細(xì)節(jié)信息丟失。

1.3 伽馬校正算法

伽馬校正有著簡便快捷的特性,但是卻容易產(chǎn)生色彩失真對比度不夠的現(xiàn)象。對于低光照圖像,伽馬校正可能會引起過增強(qiáng)及欠增強(qiáng)的問題。因此許多的改進(jìn)算法被提出。侯利霞等人[14]提出了一種自適應(yīng)的伽馬校正的圖像增強(qiáng)算法,通過多尺度分解并結(jié)合自適應(yīng)伽馬校正來提升圖像的對比度。楊先鳳等人[15]提出了一個改進(jìn)的自適應(yīng)伽馬轉(zhuǎn)換圖像增強(qiáng)算法,該算法改進(jìn)了伽馬函數(shù)并且自適應(yīng)定義了相關(guān)基本參數(shù),使得相關(guān)圖像的亮度和對比度得到了提升。

伽馬校正對圖像亮度的處理取決于伽馬值與1 的大小關(guān)系,大于1 時亮度被抑制,小于1 時亮度被提升。因此其具有簡單快速的優(yōu)點。但也存在一些不足,總結(jié)如下:

(1)采用伽馬校正往往會造成圖像的色彩失真,對于不同的場景效果不佳。

(2)伽馬值和像素值之間的關(guān)系未能對應(yīng)好,使得處理之后的圖像過度曝光。

1.4 暗通道先驗算法

基于暗通道先驗的方法借鑒了暗通道先驗?zāi)P偷乃枷搿?/p>

Dong 等人[16]發(fā)現(xiàn)把一幅低光照圖像倒置所得的圖像和霧天圖像極為接近。基于這一研究,Dong 等人將暗通道所需理論運用到了反轉(zhuǎn)后的低光照圖像上,將低光照圖像增強(qiáng)算法與圖像除霧算法相結(jié)合給出了暗通道算法。之后,在Dong 的基礎(chǔ)上學(xué)者進(jìn)行了深入的研究。暗通道先驗算法中透射率的估計是關(guān)鍵。劉峰等人[17]提出使用快速導(dǎo)向濾波器計算透射率,但是得到的圖像具有塊效應(yīng)。王碩等人[18]提出了能自適應(yīng)校正估算的透射率的算法,該算法針對圖像中部分不適應(yīng)暗通道算法的區(qū)域設(shè)計了置信度計算法方法來自適應(yīng)地補(bǔ)償估算的透射率。算法很好地解決了天空區(qū)域可能會出現(xiàn)的偽影問題,但是仍然不能解決部分區(qū)域的細(xì)節(jié)問題。Li等人[19]細(xì)化了透射率并且優(yōu)化了大氣光值,很好地解決了噪聲以及邊緣問題,為低光照圖像增強(qiáng)提供了很好的理論支持。

暗通道先驗算法基于去霧原理,該算法考慮了成像模型使得處理之后的圖像有更好的視覺效果。其關(guān)鍵是大氣光值以及透射率的估計。其值估計直接決定了圖像增強(qiáng)后的質(zhì)量的好壞。

該方法的缺點總結(jié)如下:

(1)估計透射率時,使用不同的方法會導(dǎo)致塊效應(yīng)現(xiàn)象的出現(xiàn)。

(2)該方法的計算復(fù)雜,速度較慢。

(3)對于一些特定的區(qū)域處理效果不是太理想。

1.5 基于Retinex分解的算法

Retinex 算法以色彩一致性的理論為基礎(chǔ),由于其更符合人眼的視覺系統(tǒng),所以一系列算法應(yīng)運而生。Land 首先提出了Retinex 算法[20],該算法利用路徑隨機(jī)法在一定范圍內(nèi)來計算某一像素的相鄰像素的相對亮度值,由于是隨機(jī)路徑選擇,得到的結(jié)果不具有太多的可參考性。Funt 等人提出的迭代計算的Retinex 算法[21]很好地解決了上述問題,該算法利用螺旋的路徑通過多次迭代來估計光照分量與消除分量,但是迭代的起始點選擇不確定會造成視覺效果較差,同時也會有一些噪聲。中心環(huán)繞的Retinex方法的引入很好地解決了以上方法帶來的問題,其結(jié)合濾波估計來改進(jìn)Retinex 算法。Jobson 等人[22]通過結(jié)合高斯核提出了一種單尺度Retinex算法(SSR),由于SSR算法利用高斯核函數(shù)估計亮度圖像,這就難以保證圖像的對比度。此外在一些亮度差異較大的邊緣區(qū)域也會導(dǎo)致光暈現(xiàn)象。多尺度Retinex 算法(MSR)[23]的提出有效地解決了上述問題。經(jīng)過不斷改進(jìn)之后,帶色彩恢復(fù)的多尺度Retinex 算法[24]MSRCR 又被提出。MSRCR 算法很好地解決了出現(xiàn)的顏色失真問題,但會出現(xiàn)偽影導(dǎo)致紋理細(xì)節(jié)不夠清晰。針對上述問題,常戩等人[25]提出一種空間轉(zhuǎn)換和自適應(yīng)灰度矯正的低光照圖像增強(qiáng)算法,該算法結(jié)合Retinex理論避免了過亮或過暗現(xiàn)象的出現(xiàn)。同時,蘇康友等人[26]通過引入顏色恢復(fù)因子提出了改進(jìn)的Retinex算法,消除了光照不均勻的干擾。隨著研究的進(jìn)一步深入,許多研究者發(fā)現(xiàn)圖像的細(xì)節(jié)信息不能完全恢復(fù)。基于此,李淼等人[27]將殘差思想與Retinex理論相結(jié)合提出了改進(jìn)算法,該算法能更好地提取圖像細(xì)節(jié)特征,能恢復(fù)更多的細(xì)節(jié)信息。

上述基于Retinex分解的算法充分結(jié)合了顏色恒常性理論。隨著研究的不斷深入,雖然上述方法如SSR算法估計了光照分量并且消除了光照分量的影響,在視覺上取得了不錯的效果,但是一些問題仍然存在。比如暗區(qū)沒有得到充分改善、細(xì)節(jié)紋理信息不夠突出以及出現(xiàn)噪聲等。為了解決上述問題,Pan 等人[28]利用亮度增強(qiáng)函數(shù)以及改進(jìn)的自適應(yīng)對比度增強(qiáng)方法,通過多尺度融合獲得增強(qiáng)的圖像。Yang 等人[29]提出一種模糊C 均值聚類算法與Retinex 理論相結(jié)合的低光照圖像增強(qiáng)算法。由于聚類是對圖像的灰度直方圖進(jìn)行聚類,這就使得增強(qiáng)后的圖像具有豐富的細(xì)節(jié)信息。針對噪聲的問題,Ma 等人[30]提出了一個基于Retinex 理論的低光照圖像增強(qiáng)的變異模型,該模型能有效地生成無噪聲的圖像,并能很好地適用于不同的光照條件。Lin 等人[31]提出了一種新穎的基于Retinex 理論的低光圖像增強(qiáng)方法,該方法利用收縮映射和像素權(quán)重來抑制噪聲并保留細(xì)節(jié)。

該方法基于色彩恒常性理論,通過估計光照分量并且消除光照分量的影響來增強(qiáng)圖像。Retinex理論的引入更好地提升了圖像的質(zhì)量,更加符合實際。但也會存在不足,總結(jié)如下:

(1)在估計照度分量的時候會產(chǎn)生圖像失真。

(2)對噪聲不敏感、去噪效果不好。

1.6 基于融合的算法

基于融合的方法需要將不同曝光條件下的圖像融合,但是得到其他曝光條件的圖像目前來說是一個難題。基于此,王殿偉等人[32]通過曝光插值技術(shù)生成了中等曝光圖像,并以低光照圖像和高曝光圖像為主要輸入,以此來得到增強(qiáng)后的圖像。Rao 等人[33]將人對夜間與白天的照度圖融合來增強(qiáng)圖像,但是這樣的處理往往會使圖像具有不好的視覺效果。翟海祥等人[34]融合多種圖像并與Retinex 理論結(jié)合提出了新的增強(qiáng)算法,改善了圖像的質(zhì)量不佳問題。有時基于融合的方法處理之后會使圖像變得不自然,基于此,Ueda 等人[35]提出了一種基于融合的圖像增強(qiáng)算法。其通過凸組合系數(shù)同時兼顧全局與局部信息對圖像增強(qiáng),使得增強(qiáng)后的圖像變得更加自然。

基于融合的方法考慮了不同圖像的差異性,增強(qiáng)后的圖像亮度及對比度較好。但仍然存在著不足:

(1)不同曝光條件下的圖像難以獲取。

(2)增強(qiáng)之后的圖像往往質(zhì)量不穩(wěn)定。

綜合以上方法,分別從六個方面對傳統(tǒng)的低光照圖像增強(qiáng)方法進(jìn)行分析與總結(jié)。在深度學(xué)習(xí)技術(shù)還沒興起之前經(jīng)過學(xué)者的不斷探索,傳統(tǒng)的方法不斷被改進(jìn)并表現(xiàn)出了不錯的性能。在上述方法中,大都是對圖像的像素進(jìn)行處理。直方圖均衡化算法通過拉伸灰度范圍使得圖像對比度以及亮度得到提升;Retinex 分解的方法結(jié)合了低光照圖像的成像特點有針對性地增強(qiáng),可以獲得更多的細(xì)節(jié)信息以及更好的視覺效果。其他各種方法也在一定程度上增強(qiáng)了圖像。傳統(tǒng)的低光照圖像增強(qiáng)方法對比如表1所示。

2 基于深度學(xué)習(xí)的低光照圖像增強(qiáng)方法

隨著技術(shù)的不斷更新,深度學(xué)習(xí)在各個領(lǐng)域表現(xiàn)出了強(qiáng)大的應(yīng)用潛力。同時也越來越多地應(yīng)用到低光照圖像增強(qiáng)領(lǐng)域。根據(jù)方法的差異,可分為有監(jiān)督與無監(jiān)督的方法。

2.1 有監(jiān)督的方法

有監(jiān)督的方法需要事先搜集配對的圖像,以此來建立正常圖像與低光照圖像的映射關(guān)系。

受Retinex理論的影響,Zhang等人[36]提供了一種低光照圖像增強(qiáng)網(wǎng)絡(luò),網(wǎng)絡(luò)結(jié)構(gòu)如圖2所示。其可以解決更嚴(yán)重的視覺問題,同時方便隨時調(diào)整對比度,得到效果較好的圖像。在此基礎(chǔ)上,Zhang 等人[37]又加了一種映射函數(shù),提出了KinD++算法,使處理后的圖像更加符合實際情況。因為現(xiàn)有的方法通常依賴于一些假定,它們也往往忽視了圖像噪聲等其他因素的影響,所以它們往往無法同樣解決包含光度、反差、偽影,以及噪聲等內(nèi)容的影響。為解決上述問題,Wang 等人[38]提出了一種基于歸一化流的增強(qiáng)方法。通過標(biāo)準(zhǔn)化流模型來學(xué)習(xí)低光與正常光圖像的對應(yīng)關(guān)系,更好地模擬了正常光圖像的曝光分布,從而提升了對比度以及去除了噪聲。之后,Jiang 等人[39]提出了一種新的退化到細(xì)化生成網(wǎng)絡(luò)(DRGN),該網(wǎng)絡(luò)更加關(guān)注圖像的細(xì)節(jié)信息,在提升圖像的可視性的同時保持了比較好的自然度。

圖2 KinD的網(wǎng)絡(luò)結(jié)構(gòu)圖Fig.2 KinD network structure diagram

上述方法設(shè)計了合適的網(wǎng)絡(luò)取得了良好的效果。但是現(xiàn)有的一些方法沒有充分考慮到關(guān)鍵特征導(dǎo)致細(xì)節(jié)不突出。基于此問題,Xu 等人[40]提出了一個分層的特征挖掘網(wǎng)絡(luò)HFMNet,其在不同的網(wǎng)絡(luò)層中提取光照和邊緣特征,并且建立了一個特征挖掘注意力(FMA)模塊,結(jié)合分層監(jiān)督損失,充分地挖掘關(guān)鍵特征。提高了圖像的可視性。深度學(xué)習(xí)方法具有強(qiáng)大的特征學(xué)習(xí)和映射能力,學(xué)習(xí)能力的提高也是一個亟待解決的問題。Lu等人[41]提出了一種多分支拓?fù)錃埐罹W(wǎng)絡(luò),利用拓?fù)錃埐顗K提高了網(wǎng)絡(luò)的學(xué)習(xí)能力,提升了圖像的質(zhì)量。一些方法如CNN通常是對空間域的低頻局部特征進(jìn)行采樣,這就會導(dǎo)致一部分信息被忽略,為此Zhuang 等人[42]提出具有相位感知的傅里葉卷積的雙分支擴(kuò)張網(wǎng)絡(luò)進(jìn)行低光圖像增強(qiáng)。其能更加全面地關(guān)注圖像信息并突出圖像的紋理細(xì)節(jié),但不能更好地挖掘深層多尺度特征。Fan等人[43]提出了帶照度約束的多尺度低光照圖像增強(qiáng)網(wǎng)絡(luò),該網(wǎng)絡(luò)用Res2Net[44]通過提取深層多尺度特征來增強(qiáng)模型的能力從而避免了顏色失真問題同時具有更自然的視覺效果。

針對在不同照明環(huán)境下獲得的圖像可能會出現(xiàn)過增強(qiáng)或欠增強(qiáng)的情況,Wu等人[45]提出了一種基于Retinex理論的深度展開網(wǎng)絡(luò)(URetinex Net),該網(wǎng)絡(luò)將隱式先驗正則化模型與Retinex 理論結(jié)合,更好地抑制了噪聲以及保留了細(xì)節(jié)。但是這類算法需要成對圖像作為數(shù)據(jù)集,事實上成對圖像并不是很好獲取。Lu等人[46]針對上述問題提出了一種雙分支曝光融合網(wǎng)絡(luò)來解決低光照圖像增強(qiáng)問題,其結(jié)構(gòu)圖如圖3所示。該方法通過估計不同光照水平的傳遞函數(shù),提出了一種快速有效的增強(qiáng)策略。為了進(jìn)一步應(yīng)對輸入圖像的盲目性帶來的挑戰(zhàn),引入了一種新的生成和融合策略,其中對輕微失真和嚴(yán)重失真的圖像分別在兩個增強(qiáng)分支中進(jìn)行增強(qiáng),然后使用自適應(yīng)注意力機(jī)制進(jìn)行最終融合。此外,還提出了兩階段去噪策略,以確保有效地降低噪聲。

圖3 TBEFN的網(wǎng)絡(luò)結(jié)構(gòu)分支圖Fig.3 Branch diagram of TBEFN network structure

為了進(jìn)一步地去除噪聲以及消除色偏,Lu等人[47]提出了頻分多尺度學(xué)習(xí)網(wǎng)絡(luò)。將低光照圖像分為高頻和低頻兩個分量,利用多尺度特征提取以及注意力機(jī)制來增強(qiáng)圖像。Xu 等人[48]提出結(jié)構(gòu)紋理感知網(wǎng)絡(luò),其利用低光圖像的結(jié)構(gòu)和紋理特征來增強(qiáng)圖像,更好地關(guān)注全局與局部的關(guān)系來去除噪聲以及減輕色彩失真。Garg等人[49]設(shè)計了利用色相飽和度亮度的光通道增強(qiáng)算法,使用自編碼器和卷積神經(jīng)網(wǎng)絡(luò)結(jié)合色相飽和度亮度的光通道來解決顏色失真等問題。Chen 等人[50]將卷積和自我注意力機(jī)制結(jié)合來增強(qiáng)低光照圖像,在提取特征的同時關(guān)注局部與全局特征進(jìn)而消除噪聲以及色偏問題。Yang等人[51]提出了基于多流信息補(bǔ)充的增強(qiáng)網(wǎng)絡(luò),通過信息補(bǔ)充恢復(fù)圖像的豐富結(jié)構(gòu)并且去除噪聲以及消除色偏。

有監(jiān)督的方法依賴于配對的數(shù)據(jù)集,構(gòu)建端到端的網(wǎng)絡(luò)學(xué)習(xí)低光照圖像到正常光照圖像的映射關(guān)系。這種方法更加依賴于特征信息的提取,注意力機(jī)制能使網(wǎng)絡(luò)關(guān)注更加有效的信息,設(shè)計合適的網(wǎng)絡(luò)可以使圖像的內(nèi)在信息更好地表達(dá)出來最終生成高質(zhì)量的圖像。但仍存在不足,該方法的缺點總結(jié)如下:

(1)有監(jiān)督方法依賴配對的數(shù)據(jù)集,但是配對的數(shù)據(jù)集很難獲取,并且也費時費力。

(2)模型的泛化能力不夠。由于是依賴配對的數(shù)據(jù)集訓(xùn)練,導(dǎo)致在某一特定數(shù)據(jù)集上取得不錯的效果,但是在其他場景下效果不佳。

2.2 基于無監(jiān)督的方法

無監(jiān)督的方法不需要配對的數(shù)據(jù)集。這極大地提高了研究效率。Jin等人[52]針對增強(qiáng)后會產(chǎn)生過度增強(qiáng)以及增強(qiáng)不足的問題,提出了一種無監(jiān)督的增強(qiáng)方法。該方法引入層分解網(wǎng)絡(luò)和光效應(yīng)抑制網(wǎng)絡(luò)進(jìn)一步抑制了亮區(qū)和提高了暗區(qū)的增強(qiáng)程度,保持了較好的對比度。

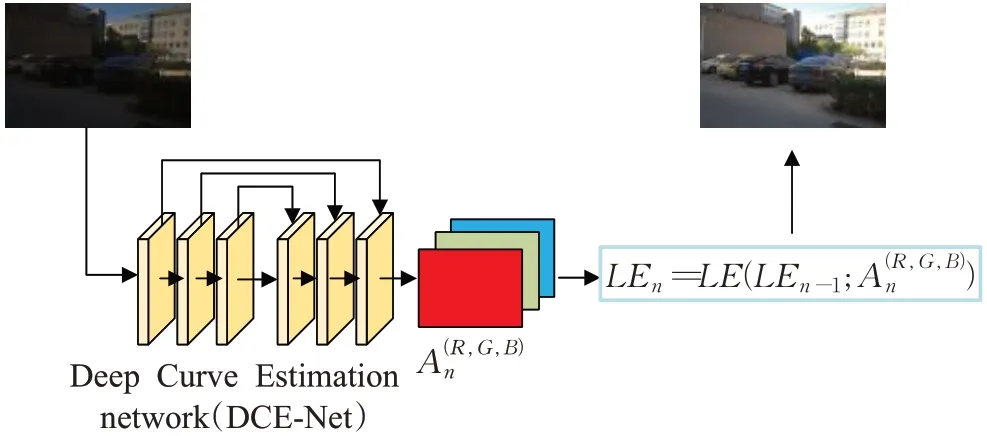

Guo 等人[53]提出了一種新的無參考深度曲線估計(Zero DCE),其用輕量化的深度網(wǎng)絡(luò)DCE-Net 來調(diào)整給定圖像的動態(tài)范圍,并且不需要事先準(zhǔn)備成對的數(shù)據(jù)集。流程如圖4 所示。但是該方法并沒有考慮噪聲的影響,并且網(wǎng)絡(luò)模型較大比較耗時。Li等人[54]進(jìn)一步介紹了Zero DCE的加速和輕型版本,稱為Zero DCE++,它利用了只有10 000參數(shù)的小型網(wǎng)絡(luò)。Zero DCE++具有快速的處理速度,同時保持了Zero DCE 的增強(qiáng)性能。使網(wǎng)絡(luò)更加輕量化,便于開展。

圖4 Zero DCE結(jié)構(gòu)圖Fig.4 Zero DCE structure diagram

在弱光條件下獲得的圖像往往帶有噪聲并且有不同程度的退化。大多數(shù)恢復(fù)方法忽略了噪聲并在拉伸對比度時將其放大。基于此Jiang 等人[55]在U-Net 網(wǎng)絡(luò)的基礎(chǔ)之上結(jié)合注意力機(jī)制提出了一種快速有效的增強(qiáng)策略(EnlightenGAN)。其結(jié)構(gòu)圖如圖5 所示。Jiang等人還提出了基于局部和全局的自我特征保留損失的損失函數(shù),更加提升了網(wǎng)絡(luò)的精度,以生成高質(zhì)量的增強(qiáng)圖像。

圖5 EnlightenGAN網(wǎng)絡(luò)結(jié)構(gòu)圖Fig.5 EnlightenGAN network structure diagram

上述方法考慮了網(wǎng)絡(luò)的性能以及推理速度,使用GAN 網(wǎng)絡(luò)以及利用U-Net 網(wǎng)絡(luò)的特征提取能力在確保網(wǎng)絡(luò)性能的前提下有效提升了增強(qiáng)之后的圖像的質(zhì)量。

Fu 等人[56]提出了一種新的無監(jiān)督低光照圖像增強(qiáng)網(wǎng)絡(luò)LE-GAN,該網(wǎng)絡(luò)以生成對抗網(wǎng)絡(luò)為基礎(chǔ)網(wǎng)絡(luò),并使用非成對的低光照圖像進(jìn)行訓(xùn)練。同時該網(wǎng)絡(luò)引入感知注意模塊增強(qiáng)特征提取去除噪聲以及消除色偏,進(jìn)一步地引入新的損失函數(shù)以解決過度曝光問題。Ni等人[57]提出了一種新的用于無監(jiān)督低光照圖像增強(qiáng)的循環(huán)交互式生成對抗網(wǎng)絡(luò)(CIGAN),該網(wǎng)絡(luò)分三個部分并且結(jié)合注意力機(jī)制來提升圖像質(zhì)量。Wang等人[58]提出了一種混合注意力機(jī)制引導(dǎo)的生成對抗網(wǎng)絡(luò)MAGAN,該網(wǎng)絡(luò)通過引入混合注意力層來學(xué)習(xí)像素和圖像之間的關(guān)系來增強(qiáng)圖像同時達(dá)到去除噪聲的目的。Qiao 等人[59]提出了一種基于反注意力機(jī)制的生成對抗網(wǎng)絡(luò)方法,該方法利用深度聚合金字塔池模塊結(jié)合多尺度背景信息來去除噪聲,利用反注意力模塊來消除色差提升增強(qiáng)圖像的質(zhì)量。Xu等人[60]提出了一種新的質(zhì)量感知損失來進(jìn)一步提升圖像的質(zhì)量。Jiang 等人[61]提出了一種無監(jiān)督的分解與校正網(wǎng)絡(luò),并引入了噪聲去除網(wǎng)絡(luò)去除噪聲。受CycleGAN[62]的啟發(fā),Bhattacharya 等人[63]提出了一種圖像增強(qiáng)模型(D2BGAN),將幾何和照明一致性以及上下文損失與多尺度顏色、紋理和邊緣鑒別器相結(jié)合有效地去除了偽影。

無監(jiān)督的方法不需要配對的數(shù)據(jù)集。該方法更加有效地關(guān)注低光圖像與正常光圖像之間的關(guān)系。一致性損失確保兩者之間的相似性,注意力模塊關(guān)注更深層次的全局與局部特征,因此得到的圖像具有更好的效果。雖然不依賴配對數(shù)據(jù)集,但成像效果往往不是太好,并且依賴于較高的硬件條件。

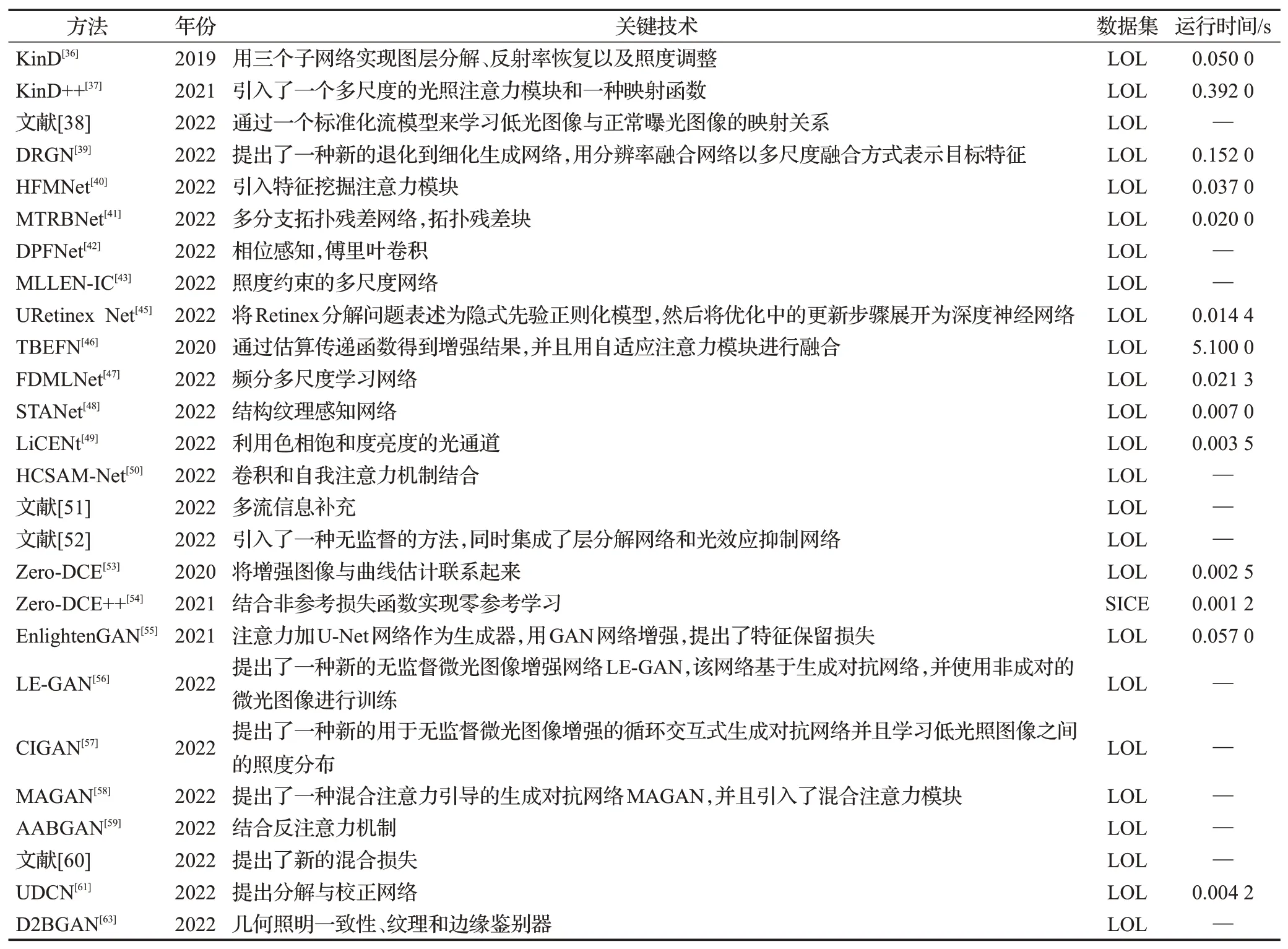

綜合以上方法,分別從有監(jiān)督以及無監(jiān)督兩個方面進(jìn)行歸納分析與總結(jié)。在有監(jiān)督的方法中,設(shè)計端到端的網(wǎng)絡(luò)提取更多的圖像特征來確保圖像的質(zhì)量。在無監(jiān)督的方法中,結(jié)合GAN 網(wǎng)絡(luò)和其他無監(jiān)督網(wǎng)絡(luò)以及各種損失函數(shù)來引導(dǎo)網(wǎng)絡(luò)生成高質(zhì)量的增強(qiáng)圖像。各種方法的對比如表2所示。

表2 基于深度學(xué)習(xí)的方法對比Table 2 Comparison of methods based on deep learning

3 數(shù)據(jù)集以及評價標(biāo)準(zhǔn)

3.1 數(shù)據(jù)集介紹

要想使訓(xùn)練的模型具有泛化性,必須要與數(shù)據(jù)集結(jié)合。深度學(xué)習(xí)指的是深度神經(jīng)網(wǎng)絡(luò)。所以說數(shù)據(jù)集對于訓(xùn)練來說是非常重要的。用于低光照圖像增強(qiáng)的數(shù)據(jù)集根據(jù)是否有配對分為有配對數(shù)據(jù)集和無配對數(shù)據(jù)集。對應(yīng)于有監(jiān)督訓(xùn)練和無監(jiān)督訓(xùn)練。有配對數(shù)據(jù)集有LOL、SICE、MIT-Adobe FiveK、SID、DRV。無配對數(shù)據(jù)集有Exclusive Dark、HDR等。

LOL 數(shù)據(jù)集[64]都是在現(xiàn)實環(huán)境中拍攝得到的。該數(shù)據(jù)集是一個含有大量真實場景圖片的數(shù)據(jù)集,照片的最大尺寸是400×600。該數(shù)據(jù)集保留了真實條件下的特征和屬性,廣泛應(yīng)用于圖像增強(qiáng)研究中。

SICE 數(shù)據(jù)集[65]包括589 個來自室內(nèi)和室外場景的圖片,共包含4 413 張不同程度下的曝光圖像。大多數(shù)圖像的分辨率在3 000×2 000 到6 000×4 000 之間。在MEF 和HDR 算法評估、圖像質(zhì)量評估等方面有廣闊的應(yīng)用前景。

MIT-Adobe FiveK 數(shù)據(jù)集[66]由MIT 提出,為了解決訓(xùn)練量過大以及輸出圖像與輸入圖像之間的關(guān)聯(lián)性不大的問題。包含了5 000 張圖像,包括直接來自相機(jī)的原始圖像和經(jīng)過處理后的圖像。數(shù)據(jù)集中約有4%的低光照圖像,幾乎涵蓋了各種場景。

SID 數(shù)據(jù)集[67]包含了5 094 個原始的曝光不足的圖像,每一個曝光不足的圖像都對應(yīng)一個正常曝光的圖像。圖像是由索尼相機(jī)Fujifilm 和Sony 拍攝。涵蓋了室外場景和室內(nèi)場景。室外場景通常是在光線不足的條件下拍攝,照度在0.2~5 lx之間。室內(nèi)場景則更暗,照度在0.03~0.3 lx之間。

DRV數(shù)據(jù)集[68]是專門用于處理視頻圖像的。該數(shù)據(jù)集包含室內(nèi)場景和室外場景,圖片分辨率大小為3 672×5 496。

Exclusive Dark 數(shù)據(jù)集[69]由10 種不同類型的低光圖像組成。HDR 數(shù)據(jù)集[70]包含74 個場景,原圖大小為5 760×3 840。為了避免對其錯位帶來的問題下采樣到1 500×1 000。

3.2 評價標(biāo)準(zhǔn)

3.2.1 主觀評價

主觀評價就是根據(jù)視覺效果進(jìn)行評價。由于視覺評價具有一定的誤差,所以主觀評價只能是做個參考,不太能準(zhǔn)確判定圖像的增強(qiáng)質(zhì)量。

3.2.2 客觀評價

客觀評價就是根據(jù)一定的數(shù)學(xué)公式計算,根據(jù)得出的結(jié)果值的大小來判定圖像的增強(qiáng)質(zhì)量,顯然這種方法具有準(zhǔn)確性,有很大的參考價值。常用的評價標(biāo)準(zhǔn)有均方誤差(mean square error,MSE)、峰值信噪比(peak signalto-noise ratio,PSNR)、結(jié)構(gòu)相似性(structural similarity index measurement,SSIM)、自然圖像質(zhì)量評估(naturalness image quality evaluator,NIQE)、信息熵(information entropy,IE)。

(1)MSE:均方誤差,表示待評價圖像質(zhì)量與標(biāo)準(zhǔn)圖像間的平均灰度的偏差程度,其值越小代表誤差越小,圖像品質(zhì)也越好。公式如下:

其中,f′(i,j)和f(i,j)分別表示待評價圖像和原始的圖像,M和N分別表示圖像的長與寬。

(2)PSNR:峰值信噪比,是一種評價圖像的客觀標(biāo)準(zhǔn)。其值越大代表圖像質(zhì)量越好。

MAXI表示圖像顏色的最大數(shù)值,8位采樣點表示為255。

(3)SSIM:結(jié)構(gòu)相似性,是一種全參考的圖像質(zhì)量評價指標(biāo),它分別從亮度、對比度、結(jié)構(gòu)三方面度量圖像相似性。取值范圍0-1,值越大代表失真越少。

其中,μx是x的平均值,μy是y的平均值是x的方差,是y的方差,σxy是x和y的協(xié)方差。c1=(k1L)2,c2=(k2L)2是用來維持穩(wěn)定的系數(shù),L是像素值的動態(tài)范圍。k1=0.01,k2=0.03。

(4)NIQE:自然圖像質(zhì)量評估,是一個客觀的評價指標(biāo),提取自然圖像中的特征來對測試圖像進(jìn)行測試,這些特征擬合成一個多元的高斯模型。其值越低代表圖像質(zhì)量越好。

(5)IE:信息熵,代表了圖像細(xì)節(jié)的豐富程度,其值越大說明圖像的細(xì)節(jié)越豐富。

4 各種方法的分析對比

為了說明本文所述算法的效果及實用價值,本章將從方法性能以及方法復(fù)雜性兩個方面進(jìn)行分析對比。

4.1 性能分析對比

4.1.1 傳統(tǒng)的低光照圖像增強(qiáng)方法性能對比

在傳統(tǒng)的低光照圖像增強(qiáng)方法中,在不同場景下的低光照圖像上測試。傳統(tǒng)的低光照圖像增強(qiáng)算法的性能對比如表3所示。

表3 傳統(tǒng)的圖像增強(qiáng)方法的定量比較Table 3 Quantitative comparison of traditional image enhancement methods

表3是上述傳統(tǒng)方法用低光照圖像測試的定量評估效果(IE 的值越大越好)。可見,由于Retinex 結(jié)合了顏色恒常性理論,使得增強(qiáng)后的圖像更加自然,所以該方法的信息熵值最高,達(dá)到了7.94。保留了更多的細(xì)節(jié)信息,優(yōu)于其他算法。

傳統(tǒng)的低光照圖像增強(qiáng)方法的定量比較如下:在傳統(tǒng)方法中,直方圖均衡化的IE值為4.43。色調(diào)映射算法的IE 值為7.27,比直方圖均衡化方法提高了64.11%。伽馬校正算法的IE值為7.78,比直方圖均衡化方法提高了75.62%。暗通道先驗算法的IE 值為7.16,比直方圖均衡化方法提高了61.63%。Retinex分解的算法的IE值為7.94,比直方圖均衡化方法提高了79.23%。基于融合的算法的IE 值為7.04,比直方圖均衡化方法提高了58.92%。

4.1.2 基于深度學(xué)習(xí)的低光照圖像增強(qiáng)算法性能對比

在深度學(xué)習(xí)的方法中,用Pytorch框架和Tensorflow框架基于LOL 數(shù)據(jù)集在GPU 上進(jìn)行測試。并且設(shè)置Adam 優(yōu)化器以及動態(tài)變化的學(xué)習(xí)率。初始學(xué)習(xí)率為0.000 1。基于深度學(xué)習(xí)增強(qiáng)方法的性能對比如表4所示。表4 是深度學(xué)習(xí)的方法的定量評估結(jié)果。在評估時在LOL數(shù)據(jù)集上進(jìn)行測試,用PSNR指標(biāo)進(jìn)行定量評估,其值越大代表圖像質(zhì)量越好。如表4 所示,由于引入了標(biāo)準(zhǔn)化流模型來學(xué)習(xí)低光圖像與正常光圖像的映射關(guān)系,文獻(xiàn)[38]所提方法的性能優(yōu)于其他算法,在LOL數(shù)據(jù)集上的PSNR值達(dá)到了25.19。

表4 基于深度學(xué)習(xí)的圖像增強(qiáng)方法的定量比較Table 4 Quantitative comparison of image enhancement methods based on deep learning

基于深度學(xué)習(xí)的增強(qiáng)方法的定量比較如下:

在有監(jiān)督的方法中,MLLEN-IC 的PSNR 值為15.11。KinD 的PSNR 值為20.87,比MLLEN-IC 提高了38.12%。KinD++的PSNR 值為21.30,比MLLEN-IC 提高了40.97%。文獻(xiàn)[38]的PSNR值為25.19,比MLLEN-IC提高了66.71%。DRGN的PSNR值為19.88,比MLLENIC提高了31.57%。HFMNet的PSNR值為22.64,比MLLENIC 提高了49.83%。MTRBNet 的PSNR 值為21.21,比MLLEN-IC提高了40.37%。DPFNet的PSNR值為24.15,比MLLEN-IC提高了59.83%。URetinex Net的PSNR值為21.33,比MLLEN-IC提高了41.16%。TBEFN的PSNR值為17.14,比MLLEN-IC提高了13.44%。FDMLNet的PSNR值為24.66,比MLLEN-IC提高了63.20%。STANet的PSNR值為21.35,比MLLEN-IC提高了41.30%。LiCENt的PSNR值為18.44,比MLLEN-IC提高了22.04%。HCSAMNet 的PSNR 值為24.52,比MLLEN-IC 提高了62.28%。文獻(xiàn)[51]的PSNR值為24.92,比MLLEN-IC提高了64.92%。

在無監(jiān)督的方法中,Zero-DCE的PSNR值為14.86。文獻(xiàn)[52]的PSNR值為21.52,比Zero-DCE提高了44.82%。EnlightenGAN 的PSNR 值為17.48,比Zero-DCE 提高了17.63%。LEGAN 的PSNR 值為22.45,比Zero-DCE 提高了51.08%。CIGAN的PSNR值為19.89,比Zero-DCE提高了33.85%。MAGAN 的PSNR 值為22.39,比Zero-DCE 提高了50.67%。AABGAN 的PSNR 值為19.38,比Zero-DCE提高了30.42%。文獻(xiàn)[60]的PSNR值為20.38,比Zero-DCE提高了37.15%。UDCN的PSNR值為19.83,比Zero-DCE 提高了33.45%。D2BGAN 的PSNR 值為16.53,比Zero-DCE提高了11.24%。

4.2 復(fù)雜度分析對比

4.2.1 傳統(tǒng)的低光照圖像增強(qiáng)方法復(fù)雜度對比

為了評估傳統(tǒng)的低光照圖像增強(qiáng)算法實用價值,對所述算法的復(fù)雜度進(jìn)行了分析對比,如圖6所示。

圖6 傳統(tǒng)的圖像增強(qiáng)方法的復(fù)雜度與效果對比Fig.6 Comparison of complexity and effect of traditional image enhancement methods

由圖6 可以看出,算法的復(fù)雜度在不斷提高,但是效果在不斷變好。

4.2.2 基于深度學(xué)習(xí)的低光照圖像增強(qiáng)算法復(fù)雜度對比

為了評估基于深度學(xué)習(xí)的低光照圖像增強(qiáng)算法實用價值,對所述算法的復(fù)雜度進(jìn)行了分析對比,如表5所示。

表5 基于深度學(xué)習(xí)的圖像增強(qiáng)方法的復(fù)雜度對比Table 5 Comparison of complexity of image enhancement methods based on deep learning

如表5 所示,本文以算法的運行時間來進(jìn)行評估。可以看出,Zero-DCE++通過直觀和簡單的非線性曲線映射實現(xiàn)圖像增強(qiáng),具有最快的運算速度。優(yōu)于其他算法。表中“—”表示評估時未用到該指標(biāo)或該數(shù)據(jù)集。

5 總結(jié)及展望

本文總結(jié)了近年來的低光照圖像增強(qiáng)技術(shù)。對于傳統(tǒng)的方法進(jìn)行了分類闡述,對于深度學(xué)習(xí)的方法將其分為有監(jiān)督方法和無監(jiān)督方法進(jìn)行詳細(xì)的闡述與分析。又詳細(xì)介紹了所用到的數(shù)據(jù)集。最后詳細(xì)給出了所用到的主流的評價指標(biāo)。深度學(xué)習(xí)的方法與傳統(tǒng)方法相比更加快捷,但也會出現(xiàn)細(xì)節(jié)信息丟失、圖像特征提取不到位、噪聲的產(chǎn)生等問題。通過深入研究文獻(xiàn),發(fā)現(xiàn)低光照圖像增強(qiáng)方法仍然面臨著諸多挑戰(zhàn)以及仍有許多未來可研究的方向。

(1)結(jié)合一些特定的網(wǎng)絡(luò)結(jié)構(gòu)

應(yīng)用合適的網(wǎng)絡(luò)結(jié)構(gòu)能極大地提高增強(qiáng)的圖像質(zhì)量,之前的方法大都是以U-Net 網(wǎng)絡(luò)結(jié)構(gòu)為基礎(chǔ)改進(jìn)的,但是這樣并不能保證能適用于所有的低光照圖像增強(qiáng)的情況,又考慮到低光圖像的對比度低,像素值小等情況,選用合適的網(wǎng)絡(luò)結(jié)構(gòu)應(yīng)用于增強(qiáng)是很有必要的。結(jié)合低光照圖像的特點,深度可分離卷積[71]、自校準(zhǔn)卷積[72]可以替換原有的網(wǎng)絡(luò);結(jié)合神經(jīng)結(jié)構(gòu)搜索技術(shù)[73-74]獲得更加高性能的網(wǎng)絡(luò)結(jié)構(gòu);Transformer可以更加關(guān)注輸入與目標(biāo)之間的關(guān)系,將Transformer[75-80]應(yīng)用于低光照圖像增強(qiáng)可以得到質(zhì)量較高的圖像。因此,如何結(jié)合低光照圖像的特點進(jìn)一步地探究合適有效的網(wǎng)絡(luò)結(jié)構(gòu)盡可能多地獲取到圖像的特征用于后續(xù)處理也是一個未來的研究方向。

(2)使用新的損失函數(shù)

損失函數(shù)是決定生成圖像與原始圖像質(zhì)量的關(guān)鍵。目前的大多數(shù)模型都是參考視覺任務(wù)來設(shè)計的,常用的損失函數(shù)已經(jīng)不能解決一些特定問題,所以設(shè)計一種新的損失函數(shù)是非常有必要的。一些深度神經(jīng)網(wǎng)絡(luò)[81-82]的理論給圖像增強(qiáng)任務(wù)帶來了可能。因此,如何將現(xiàn)實的視覺效果與低光圖像的特征相結(jié)合來設(shè)計損失函數(shù)是一個極具潛力的研究方向。

(3)低光照視頻增強(qiáng)

雖然低光照圖像增強(qiáng)研究較多,但是低光照視頻增強(qiáng)的研究卻很少。低光照視頻需要考慮視頻幀與幀之間的連續(xù)性以及閃爍問題。將現(xiàn)有的方法直接應(yīng)用到低光照視頻增強(qiáng)中,往往會產(chǎn)生偽影以及不連續(xù)的問題。因此如何應(yīng)用到視頻領(lǐng)域以及結(jié)合視頻去模糊[83-84]以及視頻超分辨率[85]保持視頻幀與幀之間的連續(xù)性也是一個未來值得研究的方向。

(4)結(jié)合語義信息

近年來,語義信息應(yīng)用得越來越多,在低光照圖像增強(qiáng)中也是十分重要的。語義信息包含了圖像的顏色等特征,能使得網(wǎng)絡(luò)區(qū)分圖像中的不同亮度的區(qū)域,對于細(xì)節(jié)恢復(fù)很有益處,已經(jīng)廣泛應(yīng)用于圖像超分辨率[86-87]、人臉修復(fù)[88]等方面。因此,利用語義信息帶來的優(yōu)勢結(jié)合語義信息[89]也是一個未來的熱門研究方向。