基于雙判別器對抗模型的半監督跨語言詞向量表示方法

張玉紅 植文武 李培培 胡學鋼

(大數據知識工程教育部重點實驗室(合肥工業大學) 合肥 230009)

(合肥工業大學計算機與信息學院 合肥 230601)

(zhangyh@hfut.edu.cn)

詞向量是將單詞表示為多維、連續的實數向量數學嵌入,由于其能較好地表示語義、語法和結構等特征信息,在自然語言處理(natural language processing,NLP)任務中得到了廣泛應用[1].然而詞向量的訓練需要豐富的語料庫,這使得小語種如阿拉伯語、葡萄牙語等的詞向量訓練受到限制.為此,研究者提出了跨語言詞向量表示方法[2-4],即利用資源豐富的大語種詞向量表示來輔助資源相對匱乏的小語種詞向量表示,該問題的研究已廣泛應用于跨語言詞性標注[5]、跨語言信息檢索[6]、跨語言實體連接和分類[7]等領域.

近年來,跨語言詞向量表示的研究取得了很大的進步,已有方法主要分為2 類:一類是聯合訓練方式[8],即在不同語言中使用單詞對齊的平行語料庫同時訓練跨語言詞向量;另一類是映射方式[2-3,9],即在預訓練的不同語言詞向量空間之間學習一個線性映射矩陣.由于平行語料庫的構造需要昂貴的代價,因此目前研究主要集中在后者.

文獻[3]發現,不同語言的詞向量空間具有相似的幾何結構,即同構性假設.基于這一發現,通過最小化種子字典對的距離來學習線性映射關系,從而對齊詞對.后續的研究[2,9]主要從減小字典規模等角度對文獻[3]改進.隨著生成對抗模型的廣泛應用,研究者們提出了基于對抗的無監督跨語言詞向量表示方法[10-12].文獻[10]將生成對抗模型引入跨語言詞向量表示,構建了不需要平行語料庫的無監督跨語言詞向量學習方法.隨后的工作致力于提升無監督方法的穩定性和準確性.文獻[11]通過在判別器中加入噪音提高對抗的穩定性.文獻[12]引入對抗訓練的后處理步驟,迭代更新學習到的映射矩陣.

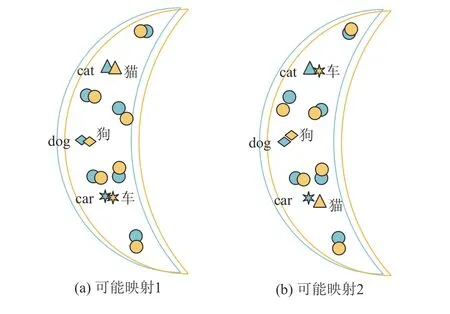

盡管基于對抗訓練的無監督方法在近距離語言對上取得了一定的成功,但在遠距離語言對上效果卻不盡人意.比如,在英語到西班牙語和英語到德語的近語言對上,其平均結果在80%左右,但在英語到土耳其語、普什圖語等遠語言對上的平均結果不足30%,有些語言對上甚至小于3%.顯然該類方法在遠距離語言對上效果難以令人滿意[13].造成這一結果的原因可能有2 個:1)遠距離語言對上同構性假設的不成立導致這種線性映射關系難以成立[14].一般情況下,不同語系的語言由于在單詞語義、句法結構等方面存在較大差異被認為是遠語言對,其詞向量空間之間的同構性也較弱.2)無監督方法從全局角度最小化源語言空間與目標語言空間的距離來求解映射關系,僅能實現詞向量空間的全局對齊,是一種粗粒度的對齊,而這種粗粒度對齊條件下可能存在多種細粒度的映射關系,從而難以保證細粒度詞的對齊精度.如圖1 所示,中文和英文2 個空間在全局對齊的條件下,可能產生“cat”與“貓”對齊,也可能產生“cat”與“車”對齊.

Fig.1 The possible mapping in unsupervised methods圖1 無監督方法產生的多種可能映射

綜上可見,跨語言詞向量表示方法的效果大多依賴于同構假設和監督信號,無監督方法應用于非同構語言對時難以實現高質量對齊.因此,如何在遠語言對上學習較好的映射關系是當前跨語言詞向量表示中的挑戰性問題.

現實應用中盡管監督信息是昂貴的,但獲取少量監督信息在多數場景下仍是可行的.此外,在映射關系的迭代學習過程中產生的預對齊詞對對學習映射關系也具有一定的監督作用.鑒于此,提出基于雙判別器對抗的半監督跨語言詞向量映射學習方法.首先,為了緩解遠語言對上非同構性對映射關系學習的影響,使用自動編碼器分別將源語言詞向量空間與目標語言詞向量空間映射到隱空間,使其在隱空間上具有相對較好的同構性.其次,在已有對抗模型生成的全局初始映射基礎上增加一個細粒度判別器,并引入負樣本字典和預對齊字典等信息進行半監督學習,通過計算初始生成字典與負樣本字典、預對齊字典之間的距離進一步判斷初始生成字典的正確性,消減詞對映射的多種可能,提高初始字典對齊精度.本文的創新點有3 個方面:

1)設計了一個雙向映射共享的細粒度判別器以構成包含雙判別器的對抗模型,對原判別器生成的映射關系進行優化,以提升方法的性能.

2)提出引入負樣本字典,并將其和預對齊字典一起進行半監督對抗學習,通過計算兩者與初始生成字典的距離來判別初始生成字典的有效性,從而在全局對齊基礎上提高細粒度的單詞對齊精度.

3)多個數據集上的實驗結果表明本文方法能通過半監督方式進一步優化全局對齊,提高詞語對齊的精度.

1 相關工作

基于映射的跨語言詞向量表示方法將不同語言的詞向量空間映射到一個共同空間,使得共同空間中不同語言具有相同語義的詞盡可能接近.根據種子字典的數量與作用,已有方法大致分為3 類:監督方法、無監督方法和半監督方法.

1.1 監督方法

監督方法主要是借助部分對齊的詞對來學習映射關系.

文獻[3]發現不同語言的詞向量空間具有相似幾何結構,通過最小化5 000 個種子字典的歐式距離學習1 個線性映射矩陣,將源語言詞向量空間映射到目標語言詞向量空間.隨后的工作對其進一步完善和改進.文獻[15]使用典型關聯分析(canonical correlation analysis,CCA),將源與目標映射到第三方共享空間,實現雙向映射關系學習.在映射學習任務中經常出現1 個詞同時被認為是多個詞的映射,這種現象被稱作為Hubness 問題,該問題是影響映射學習性能的主要因素之一.文獻[16]通過優化正確映射對與錯誤映射對之間的最大邊界解決Hubness 問題,提高映射學習性能.為解決不一致問題,文獻[17]從歸一化詞向量、對線性映射施加正交約束、最大化詞與詞向量間的相似度3 個角度避免映射矩陣學習陷入局部最優.文獻[18]引入CSLS(cross-domain similarity local scaling)距離作為字典間的優化函數學習映射關系,提高了跨語言詞向量表示性能.

相對來說,監督方法取得了較為滿意的效果,但其效果很大程度依賴于種子字典是否充分.

1.2 無監督方法

無監督方法中映射關系的學習不需要平行語料庫,具體可分為基于啟發性規則和基于生成對抗模型2 個子類.

1)基于啟發式規則.文獻[19]使用主成分分析對齊2 種語言單詞分布的二階矩,再利用計算機視覺中的迭代最近點(iterative closest point,ICP)方法迭代細化對齊.文獻[20]通過探索詞向量空間之間的結構相似性學習初始矩陣,然后使用具有魯棒性的自學習步驟改進映射矩陣.文獻[21]將詞向量對齊看作是最優傳輸(optimal transport,OT)問題,使用GW(Gromov-Wasserstein)距離衡量詞對間的相似度.

2)基于生成對抗模型.文獻[10]提出使用對抗訓練來構造雙語字典,采用線性映射矩陣作為生成器,二元分類器作為判別器,該方法在雙語詞典構建任務上取得了突破性的成果,但存在難以收斂問題.文獻[11]將高斯噪音注入判別器以提高對抗訓練的穩定性.文獻[12]在對抗訓練基礎上引入后處理步驟,迭代更新對抗訓練學習到的映射矩陣,同時使用CSLS 尋找最鄰近詞以緩解Hubness 問題.文獻[22]引入自動編碼器構建隱空間后再進行對抗訓練,緩解了跨語言向量空間非同構假設帶來的影響.

目前無監督方法的性能與監督方法具有明顯差距,尤其是在遠語言對上.

1.3 半監督方法

半監督方法借助少量的字典或者其他弱監督信息學習映射關系.

文獻[2]借助自學習框架,僅使用 25 個詞對學習線性映射,獲得與監督方法相當的性能.文獻[23]使用少量對齊的種子字典和未對齊的嵌入空間進行半監督學習,并利用過濾技術緩解Hubness 問題.此外,文獻[24]在沒有種子詞典情況下,將2 種語言中出現的少量相同字符串作為弱監督信號學習線性映射.文獻[9]利用相同拼寫的字符串作為弱監督信號學習映射關系.

盡管半監督方法利用監督信息提高了跨語言詞向量表示學習的精度,但這種提升大多表現在近距離語言對上,在遠距離語言上的表現仍難以令人滿意.

2 基于雙判別器的跨語言詞向量表示方法

給定預訓練的源語言詞向量空間X={x1,x2,…,xn}和目標語言詞向量空間Y={y1,y2,…,yn},n為向量空間中的單詞數,本文的任務是學習一個雙向映射關系,將2 個向量空間映射到1 個公共空間,使得2個互為翻譯的詞在該空間上彼此距離最近,從而實現跨語言詞向量表示.

2.1 方法框架

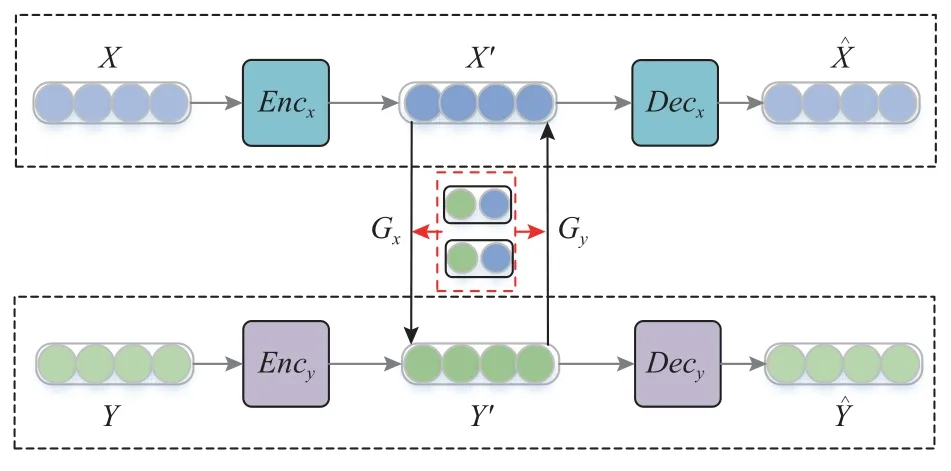

為提高遠語言對上詞向量對齊效果,提出半監督的雙判別器對抗詞向量表示方法.圖2 展示了本文方法框架,分為2 個模塊:1)基于自編碼器構建隱空間X′和Y′,以緩解遠語言對上同構性假設不成立的影響;2)在學習到的隱空間上,利用負樣本字典Dng和預對齊種子字典Dal進行半監督對抗訓練,學習雙向映射關系以對齊2 個隱空間中的詞對.其中負樣本字典Dng是在映射關系訓練過程中產生的,將在2.3 節詳細介紹.

Fig.2 The framework of our method圖2 本文方法框架

隱空間構建的具體方法為:首先,使用2 個編碼器Encx與Ency分別將源語言與目標語言詞向量空間X和Y映射到2 個獨立的隱空間X′和Y′;其次,利用解碼器Decx,Decy對隱空間解碼得到與,通過最小化2 個空間的重構誤差,即?=X,=Y,以保證編碼后的隱空間能代表原空間的信息.

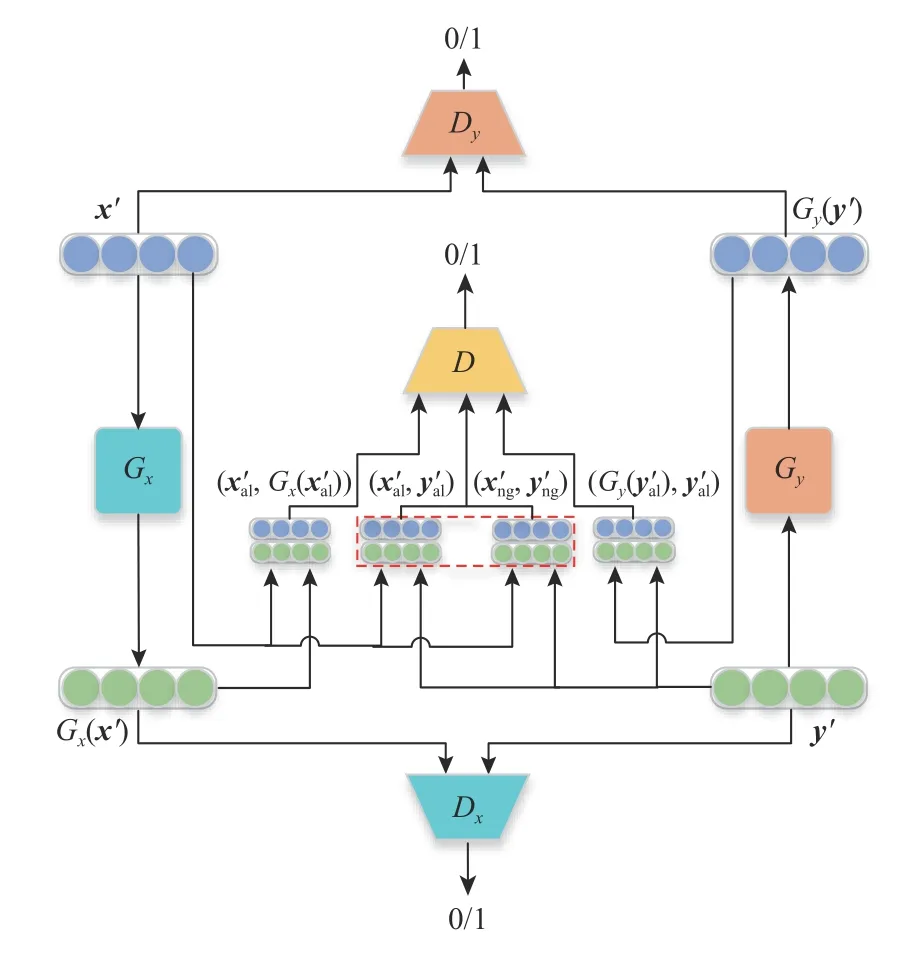

下面重點介紹基于2 個隱空間X′和Y′,半監督學習雙向線性映射Gx和Gy的過程,如圖3 所示.圖3 中生成器Gx和判別器Dx構成初始對抗模型,從全局角度學習X′到Y′的初始映射.在此基礎上,引入細粒度判別器D和字典信息(包括負樣本字典Dng和預對齊字典Dal)半監督地對初始映射關系進行細粒度優化,從而得到較為準確的X′到Y′的詞語對齊映射.同樣地,生成器Gy、判別器Dy以及細粒度判別器D用于學習Y′到X′的映射.為保證雙向映射后的詞對能相互對齊,提高對齊精度,雙向映射學習過程共享細粒度判別器D.

Fig.3 The bidirectional mapping learning based on double discriminators圖3 基于雙判別器的雙向映射學習

雙向映射關系學習過程中,需要考慮雙向的損失函數,可具體表示為

由于雙向映射學習過程類似,下面以源語言到目標語言的映射學習Lx為例進行說明.X到Y的映射學習過程分為初始映射關系學習和共享細粒度優化2 個步驟.

2.2 初始映射關系學習

初始對抗模型包含1 個生成器和1 個判別器.生成器Gx用于生成X′到Y′的初始映射,基于該映射生成的詞對盡可能地混淆判別器Dx;而Dx則用于識別輸入是X′的生成空間Gx(x′) 還是Y′空間.通過Gx和Dx不斷地對抗訓練形成初始映射關系Gx和基于該關系生成的初始對齊字典

在這一過程中,判別器Dx的損失函數可定義為

其中Ex和Ey分 別表示對源語言空間X′和目標語言空間Y′的采樣,通過最小化LDx使判別器Dx能最大程度地鑒別出Gx(x′)和y′.

而生成器Gx的損失函數表示為

2.3 共享細粒度優化

2.2 節所述的初始對抗模型僅基于全局距離度量生成一個初始的映射關系,由于缺乏必要的監督信號引導,導致其生成的詞對映射存在多種可能,難以保證正確性.為此,在原有對抗模型基礎上引入負樣本字典和預對齊字典 (Xal,Yal)作為監督信號,利用雙向映射共享的細粒度判別器D識別是真實翻譯對還是通過生成器生成的初始映射對,從而識別初始映射對中的正確翻譯對,提升對齊精度.

在細粒度判別器判別過程中,需要考慮2 個主要問題.

在預對齊字典 (Xal,Yal)基礎上進一步引入負樣本

對抗訓練的成功依賴于如何有效區分真實樣本和偽樣本,而預對齊字典和負樣本分別提供了正、負樣本的監督信號,有利于提高判別器D的判別能力.本文設計了隨機負采樣和基于鄰近相似度2 種負樣本字典生成方法.

①隨機負采樣方法.初始映射生成后,一般采用最近鄰方法尋找初始翻譯對,從而使初始翻譯對的2 個詞具有一定的相關性.本文面向所有的初始翻譯對,采用隨機采樣策略獲取負樣本,具體可表示為

②基于相似度的負采樣方法.隨機負采樣策略在全局范圍內隨機選擇負樣本,其選擇的負樣本與正樣本具有較強差異性但相關性不足.為此提出基于相似度的負樣本采樣方法.首先,從所有初始翻譯對中選擇最接近Gx(x′) 的前k個目標詞;其次,排除第1 個目標詞以及監督種子對,以避免其與真實對齊的樣本重復;然后,從前2~k個中進行采樣.與隨機負采樣方法相比,這種策略具有2 方面優勢:一方面,將負樣本范圍確定在基于近似度的前k個樣本中,確保選擇的負樣本與真實對齊樣本具有一定的語義相關性;另一方面,排除了第1 個目標詞和監督種子,從前2~k個中采樣.這種方案即使在第1 個目標詞為正樣本不滿足時,從前2~k個中排除監督種子字典后再采樣,能大概率排除真實對齊被采樣為負樣本的情況,確保兩者的語義差異性.因此,本方案所選的負樣本與真實對齊樣本既有語義相關性又有語義差異性,達到負樣本的參照作用.這里k=5,相似度計算采用余弦函數,記為

2)如何進行判別

共享細粒度判別器D的任務是利用監督的負樣本和對齊字典,通過判別初始映射生成的詞對與字典間的距離,從初始映射對中進一步篩選出更靠近監督詞對的翻譯對.因此,共享細粒度判別器D的損失函數可被定義為

此外,需要說明的是,為了對齊種子字典的空間分布,式(6)中判別器D不是從整個詞向量空間中采樣,而是從種子字典中采樣.

在上述方法的基礎上,為保證映射關系的準確性,引入循環一致性約束,即源空間被映射到目標空間后可以準確地再映射回源空間,源語言的循環一致性損失函數表示為

綜上,從源到目標的半監督對抗訓練損失函數可表示為

類似地,從目標到源的半監督對抗訓練損失函數表示為

3 實驗結果及分析

3.1 數據集與對比實驗

采用Muse[12]與Vecmap[20]這2 個數據集來驗證方法的有效性.數據集和源代碼見https://github.com/joyce99/ZhiWenwu/tree/master/MUSE-master.

Muse 數據集包含30 種語言,詞向量維度為300,是使用FastText 方法基于維基語料庫訓練所得,包含110 個語言對的種子字典.種子字典分為訓練集與測試集,分別包含5 000 個和1 500 個翻譯對.本文從中選擇了9 個語言對,分別是英語(En)、西班牙語(Es)、意大利語(It)、法語(Fr)、阿根廷語(Ar)、土耳其語(Tr)、南非荷蘭語(Af)、普什圖語(Fa)、奧羅語(Et).根據GH(Gromov-Hausdorff)距離[23](記為dGH)計算語言對之間的空間分布相似度,dGH<0.3 表示2個空間為近語言對,dGH≥0.3 表示2 個空間為遠語言對.

Vecmap 數據集包含英語(En)、西班牙語(Es)、意大利語(It)、芬蘭語(Fi)、德語(De)等單語詞向量.由于該數據集是基于網絡爬取的語料庫,其訓練所得詞向量質量不高,導致其同構性較弱.現有方法在該數據集上的效果普遍不理想.該數據集僅提供英語到西班牙語、意大利語、芬蘭語、德語的單向字典.為完成雙向映射學習,額外補充了反向字典.具體做法是將英語到其他語種的字典反轉和去重,以確保測試集為1 500 個翻譯對.

對比實驗包括無監督方法、監督方法和半監督方法.無監督方法包括:1)文獻[12]基于生成對抗網絡對齊2 個空間以獲得初始詞典,并引入后處理步驟,迭代更新對抗學習的映射矩陣;2)文獻[20]利用詞向量的結構空間相似性獲得初始映射矩陣,并利用自學習算法迭代更新初始映射矩陣;3)文獻[22]利用自動編碼器將詞向量空間映射到隱空間以緩解同構假設的約束,然后利用對抗訓練來對齊隱空間.監督方法包括:1)文獻[12]通過最小化翻譯詞對間的距離學習正交映射,并使用CSLS 距離尋找最近鄰;2)文獻[25]將映射到共享空間的步驟簡化為訓練單個正交轉換.半監督方法則使用對齊的雙語詞典和未對齊的嵌入進行半監督映射矩陣學習,并用過濾技術緩解Hubness 問題[23].

3.2 實驗設置

針對預訓練的詞向量空間,在Muse 和Vecmap數據集中選擇詞頻最高的前20 萬個詞向量作為訓練樣本來學習跨語言詞向量表示.在學習隱空間過程中,自編碼器設置類似于文獻[22],設置隱空間維度為400.在半監督對抗訓練中,判別器Dx,Dy,D都使用包含204 個隱藏層的多層感知器,其激活函數為Leaky-ReLU 函數.其中判別器Dx和Dy使用詞頻前75 000 個詞向量作為輸入,判別器D從種子字典中進行采樣,種子字典的初始數量為5 000 對,會隨著迭代訓練不斷擴大數量.參照文獻[12]的做法,每更新5 次判別器后更新1 次生成器.在對抗訓練過程中,采用隨機梯度下降方法,其中批大小為32,學習率為0.01,衰減率為0.98.采用CSLS 檢索方法搜索最近鄰種子字典,參數k=10.

實驗采用P@1 作為評估指標來驗證方法的精度,其計算方法為:

其中ti為方法學習到的映射空間中距離源空間單詞si最近的單詞.如果 (si,ti)為正確翻譯對,則 (si,ti)=1,否則 (si,ti)=0.

3.3 實驗結果與分析

3.3.1 近語言對的結果

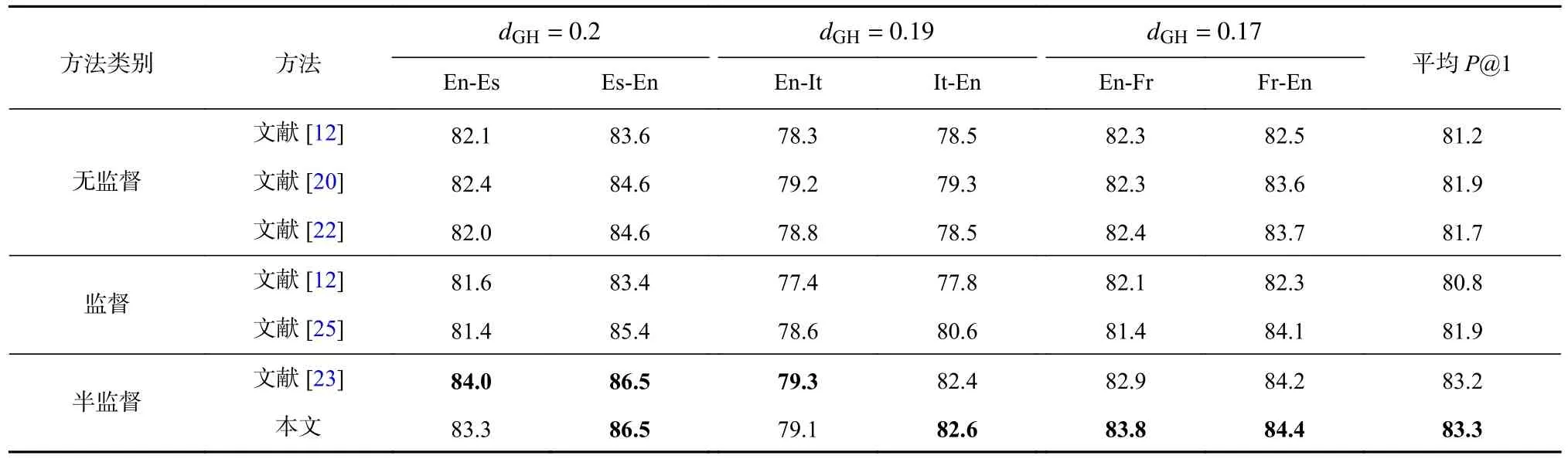

表1 展示了各方法在Muse 數據集上近語言對的實驗結果,由表1 可知:

Table 1 P@1 Comparison of All Methods on Similar Language Pairs in Muse Dataset表1 各方法在Muse 數據集上近語言對的P@1 對比 %

1)各個方法在近語言對上的結果總體差異較小.

2)文獻[23]方法與本文方法是2 個半監督方法,與其他方法相比,其性能平均提高了1%.半監督方法在學習過程中不斷生成預對齊翻譯詞對,這些翻譯對作為監督信號來輔助下一次迭代學習過程.當算法收斂時,所得的監督信號數量總體大于監督方法中給定的翻譯詞對數量,尤其是近語言對.因此,半監督方法比預先僅給定部分監督信號的監督方法更有效.

3)本文方法超越了大多數基準方法,在4 種語言對上略勝于文獻[23]的半監督方法,說明了本文方法具有一定的優越性.

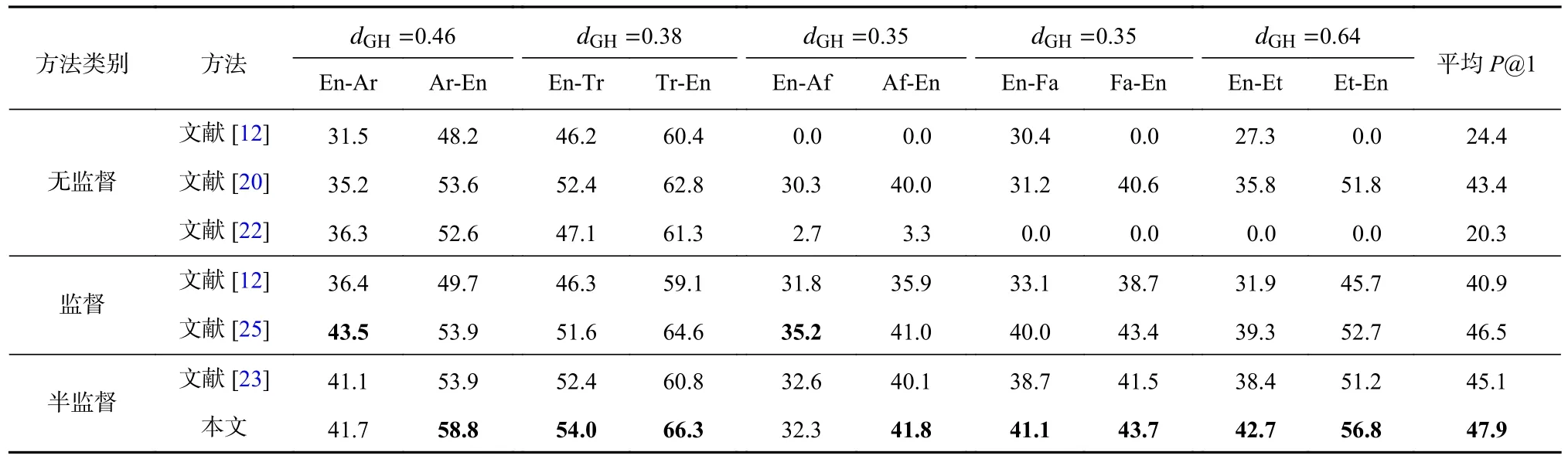

3.3.2 遠語言對的結果

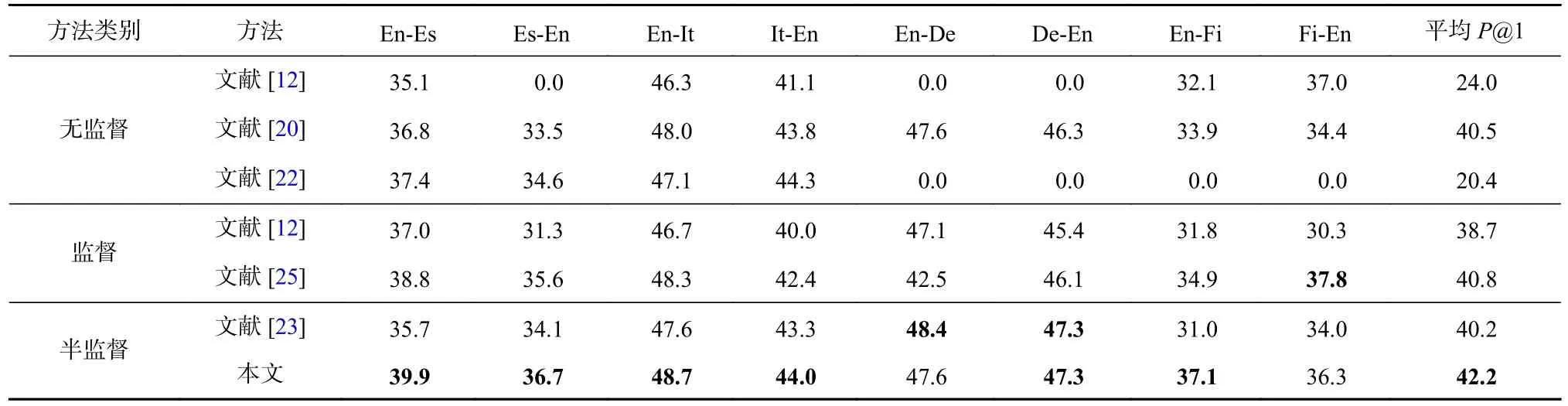

表2 和表3 分別展示了各方法在Muse 數據集的遠語言對和Vecmap 數據集上各語言對的表現.

Table 2 P@1 Comparison of All Methods on Dissimilar Language Pairs in Muse Dataset表2 各方法在Muse 數據集上遠語言對的P@1 對比 %

Table 3 P@1 Comparison of All Methods on All Language Pairs in Vecmap Dataset表3 各方法在Vecmap 數據集上各語言對的P@1 對比 %

1)與近語言對相比,半監督方法和監督方法在遠語言對上的性能差異較大,一定程度上表明了種子字典等監督信號對于遠語言對的映射學習具有重要作用.

2)半監督方法和監督方法性能好于無監督方法,而半監督方法和監督方法性能相差不大,表明了半監督方法僅利用少量種子字典就達到了監督方法的性能.

3)與監督方法相比,本文方法在2 個數據集上都具有一定的優勢,表明了在訓練過程中,利用前一次迭代預訓練的種子字典和負樣本字典輔助下一輪種子字典的生成是有效的.

4)本文方法優于無監督方法.由表2 可見,3 個無監督方法[12,20,22]在多個語言對上無法收斂.而本文方法P@1 在所有語言對上的結果有明顯提升.與文獻[20]方法相比,本文方法的P@1 分別提升了5.3%和2.2%.與文獻[22]的方法相比,其P@1 也提升了27.6%和20.2%.實驗性能的提升表明引入細粒度判別器進行半監督學習能進一步提高2 個空間的對齊精度.

5)本文方法好于其他半監督方法.與文獻[23]的半監督方法相比,本文方法的P@1 平均提高了2.9%.這主要得益于自動編碼器與多判別器的引入.通過自動編碼器構建隱空間,一定程度上緩解同構假設的約束,而引入細粒度判別器能進一步提高對齊精度.

3.3.3 不同種子字典數量的影響

為進一步評估本文方法的有效性,在Muse 數據集的2 個近語言對(En-Es,En-Fr)和2 個遠語言對(En-Tr,En-Et)上討論了各個方法性能隨種子字典個數(500,1 000,2 500,5 000)的變化趨勢,結果如圖4 所示.

Fig.4 P@1 varying with the number of dictionary圖4 P@1 隨種子字典數量的變化

1)近語言對(En-Es,En-Fr)上,隨著種子字典數量的增加,文獻[12]方法、文獻[23]方法與本文方法的性能相比變化不大.可見同構條件下,利用線性映射關系能較好地對齊2 個空間,不需要過多的監督信號引導.而對于遠語言對(EN-Tr,EN-Et)來說,文獻[22-23]的性能隨種子字典數目的增加而增加,而本文方法隨種子字典數目的增加相對穩定,說明種子字典在非同構條件下對于詞向量對齊具有重要作用.

2)在遠語言對(En-Tr,En-Et)上,與其他方法相比,本文方法性能較優,且隨種子字典數量的增加,其表現相對穩定.由此可見,本文方法的良好性能不過度依賴種子字典是否充分,即使在種子字典較少情況下也能達到較好效果.

3)值得注意的是,無論近語言對還是遠語言對,文獻[22]方法的性能隨種子字典數量變化較大.在En-Es 上,字典數量為500 時其精度約為66%,當字典數量為2 500 時其精度達到了81%.原因可能是該方法沒有使用生成的新種子字典更新映射矩陣.

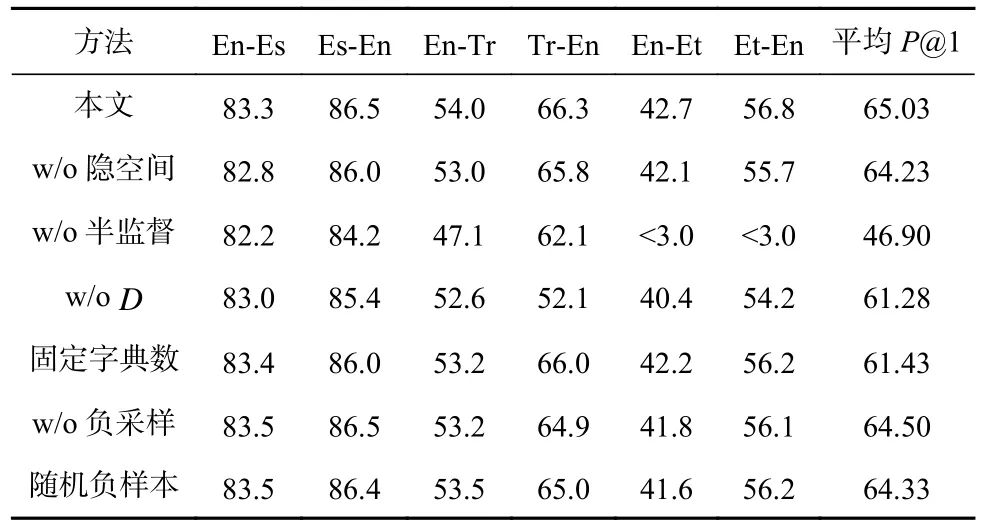

3.3.4 消融實驗

為進一步分析本文方法中不同部分的作用和有效性,設計了消融實驗,分別分析了自動編碼器、細粒度判別器D、種子字典和負樣本字典對算法性能的影響.在Muse 數據集上選取En-Es(近語言對)、En-Tr 和 En-Et(遠語言對)進行了實驗.結果如表4 所示.

Table 4 Ablation Experiment in Muse Dataset表4 在Muse 數據集上的消融實驗 %

1)“w/o 隱空間”即去除自編碼機構建隱空間的過程.與本文的全模型相比,“w/o 隱空間”在2 個遠語言對上精度都有所下降,表明隱空間能在一定程度緩解遠語言對不滿足同構假設的影響.

2)“w/o 半監督”不使用監督信號訓練模型,即去掉種子字典和細粒度判別器.與全模型相比,“w/o半監督模塊”在遠語言對上的精度小于3%,不能實現收斂.這是由于沒有種子字典的誘導,無監督對抗模型在遠距離語言對上難以實現高質量的對齊.

3)“w/oD”保留種子字典但去掉細粒度判別器.與全模型相比,“w/oD”在2 個語言對上的精度都有下降.由此可見,本文方法中的細粒度判別器D能進行細粒度的對齊,從而生成更高質量的映射矩陣.

4)“固定字典數”即在訓練迭代過程中,不將上一輪迭代的預對齊字典加入種子字典中.與全模型相比,“固定字典數”的實驗結果稍有所下降,說明在訓練過程中利用預對齊字典不斷擴大種子字典數量具有一定的有效性.

5)與全模型相比,“w/o 負采樣”的實驗性能在3 個語言對上平均下降0.53%.這說明負采樣在對抗訓練學習中具有一定的監督作用,能提高判別器D的判別能力,從而提高生成器的學習能力.

6)隨機負樣本是在本文方法基礎上將相似度負樣本生成方法替換為隨機負樣本生成方法.與全模型相比,隨機負樣本的性能略微下降,平均精度下降了0.7%.這是由于全模型在前k個最近鄰范圍內進行負采樣,使得負樣本與真實對齊詞較為接近.因此,基于最近鄰生成負樣本的策略使得細粒度判別器D的訓練更好地反映了翻譯詞對與最近鄰詞之間的關系,從而促使生成器盡可能地生成靠近其正確翻譯詞而遠離其k最鄰近的詞向量.

4 總結與展望

本文提出了基于雙判別器對抗的半監督跨語言詞向量映射學習方法,在已有對抗模型生成的初始映射基礎上,增加了一個雙向映射共享的細粒度判別器,并引入負樣本字典和預對齊字典進行半監督學習,在全局空間距離最小化基礎上進一步判斷初始生成字典的正確性,從而提高初始字典的對齊精度.在2 個跨語言數據集上的實驗效果表明,本文方法能夠有效提升跨語言詞向量表示性能.

未來,我們將會研究如何在遠距離語言對上生成高質量的種子字典,進一步削弱種子字典的約束.同時,我們也將進一步探索如何在自動編碼器中引入監督信號,從而更好地構建高語義隱空間.

作者貢獻聲明:張玉紅提出論文想法、方法設計,負責實驗指導、論文的寫作與修改;植文武參與實驗設計與探究、代碼實現、實驗數據整理與分析、論文的寫作與修改;李培培負責部分實驗數據分析、論文的修改;胡學鋼指導實驗設計和論文的修改.