基于深度學(xué)習(xí)的無人機(jī)遙感影像增強(qiáng)*

中鐵第一勘察設(shè)計院集團(tuán)有限公司 魏域君

無人機(jī)遙感影像的質(zhì)量對無人機(jī)遙感的應(yīng)用至關(guān)重要,通常由于天氣原因,無人機(jī)遙感影像存在曝光不足,圖像偏暗的情況,需要手工利用調(diào)色軟件進(jìn)行調(diào)色,效率偏低。隨著深度學(xué)習(xí)的快速發(fā)展,深度學(xué)習(xí)在圖像智能化處理方面取得了廣泛的應(yīng)用。本文提出了一種適合高分辨率無人機(jī)遙感影像暗光增強(qiáng)的深度網(wǎng)絡(luò)模型,該模型能夠保持輸入影像的高分辨率特征,經(jīng)過訓(xùn)練后的模型以原始暗光圖像作為輸入,直接生成光照增強(qiáng)后的無人機(jī)影像,無需手工設(shè)計參數(shù)調(diào)色。實驗證明本文方法具有較強(qiáng)的魯棒性,對無人機(jī)遙感圖像暗光增強(qiáng)取得了較好的效果,提高了生產(chǎn)效率。

隨著測繪地理信息行業(yè)的快速發(fā)展,無人機(jī)遙感技術(shù)作為一門新興技術(shù),在測繪工作中取得了廣泛的應(yīng)用。無人機(jī)遙感的優(yōu)勢有以下幾點:(1)無人機(jī)體積較小,重量較輕,這保證了無人機(jī)的靈活性,可在各種地形條件下起飛;(2)無人機(jī)遙感監(jiān)測效率較高,可快速高效的處理各種突發(fā)事件[1];(3)無人機(jī)遙感可獲取大范圍的高分辨率遙感影像,具有監(jiān)測尺度大的特點。由于以上獨特的優(yōu)勢,無人機(jī)遙感技術(shù)被廣泛的應(yīng)用于實景三維建設(shè)、高分辨率正射影像制作、災(zāi)害檢測、航拍視頻視頻制作等業(yè)務(wù)。因此,獲取清晰度高、對比度強(qiáng)的無人機(jī)遙感影像是無人機(jī)遙感的核心。而由于天氣原因,在光照條件較差的情況下,通過無人機(jī)航飛獲取的遙感影像通常情況下存在曝光不足,圖像偏暗的情況,通常需要利用CaptureOne、PhotoScan 軟件進(jìn)行處理,對暗光條件下的無人機(jī)遙感影像進(jìn)行人工增強(qiáng),這需要耗費較大的勞動力和時間,效率較低。而傳統(tǒng)的基于直方圖均衡和Retinex 理論的暗光圖像自動增強(qiáng)算法,很難適應(yīng)遙感圖像地物類別復(fù)雜、信息量大的特點,因此效果都不令人滿意。

隨著深度學(xué)習(xí)的快速發(fā)展,卷積神經(jīng)網(wǎng)絡(luò)(CNN)被廣泛的應(yīng)用到低層次的圖像處理任務(wù)中。在此基礎(chǔ)上,一些研究者提出了很多基于深度學(xué)習(xí)的自然圖像暗光增強(qiáng)模型,通常是利用深度網(wǎng)絡(luò)將暗光圖像分解為光照分量和反射分量,通過調(diào)整光照分量進(jìn)行暗光增強(qiáng),然而這類方法并不能很好地適應(yīng)場景復(fù)雜的高分辨率遙感影像。因此,本文提出了一種基于卷積神經(jīng)網(wǎng)絡(luò)的端到端的遙感影像暗光增強(qiáng)模型,無需進(jìn)行光照分解,以暗光條件下的無人機(jī)遙感圖像作為輸入,通過深度網(wǎng)絡(luò)直接輸出光照增強(qiáng)后的影像。通過實驗證明了本文方法對無人機(jī)遙感圖像暗光增強(qiáng)取得了較好的效果。

1 基于卷積神經(jīng)網(wǎng)絡(luò)的無人機(jī)影像暗光增強(qiáng)

本文通過訓(xùn)練卷積神經(jīng)網(wǎng)絡(luò)模型來實現(xiàn)無人機(jī)影像暗光增強(qiáng),訓(xùn)練樣本集可表示為{Li,Hi|i=1,...,N},其中Li為暗光圖像,Hi為對應(yīng)的經(jīng)過光照增強(qiáng)后的無人機(jī)影像,這是人工通過CaptureOne 等軟件調(diào)色得到的。本文設(shè)計了一種適合無人機(jī)影像暗光增強(qiáng)的高分辨率網(wǎng)絡(luò)模型,該模型能夠保持輸入影像的高分辨率特征,經(jīng)過訓(xùn)練后的模型以原始暗光圖像作為輸入,輸出光照增強(qiáng)后的無人機(jī)影像。

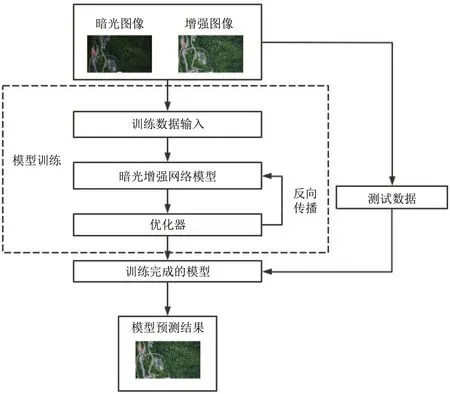

本文方法技術(shù)流程如圖1 所示。

圖1 技術(shù)流程Fig.1 Technical process

1.1 網(wǎng)絡(luò)模型

無人機(jī)遙感由于要獲取清晰的地物細(xì)節(jié),具有很高的影像分辨率,一般優(yōu)于5cm/每像素。因此,對無人機(jī)遙感影像進(jìn)行暗光增強(qiáng),除了對光照分量進(jìn)行調(diào)整之外,保持影像的細(xì)節(jié)信息也是非常重要的。現(xiàn)有的大多深度網(wǎng)絡(luò)模型一般都使用采樣間隔為2 的最大池化層和卷積層來擴(kuò)大感受野,從輸入的高分辨率影像中提取出高層語義特征,得到低分辨率特征圖,然后采用反卷積或上采樣的方式恢復(fù)原始尺寸,得到輸出結(jié)果。使用這種網(wǎng)絡(luò)模型必然會導(dǎo)致細(xì)節(jié)信息的丟失,從而使暗光增強(qiáng)后的遙感影像丟失細(xì)節(jié)信息。因此,本文提出了一種高分辨率網(wǎng)絡(luò)結(jié)構(gòu)RS-HRNet 來進(jìn)行無人機(jī)遙感影像暗光增強(qiáng)。

RS-HRNet 以高分辨率網(wǎng)絡(luò)模型HRNet[2]為基礎(chǔ),網(wǎng)絡(luò)存在多個分支,第一個分支為高分辨率分支,在網(wǎng)絡(luò)傳播的整個過程中都維持高分辨率的特征表示,隨著高分辨率分支向后傳播,逐漸增加高分辨率到低分辨率的網(wǎng)絡(luò)分支,并將多個分辨率的網(wǎng)絡(luò)分支進(jìn)行并行連接,通過多分支網(wǎng)絡(luò)互相交換信息完成多尺度特征的融合,使得網(wǎng)絡(luò)生成的特征既有高層次信息,又能保持較高的分辨率。網(wǎng)絡(luò)結(jié)構(gòu)如圖2 所示。

圖2 網(wǎng)絡(luò)結(jié)構(gòu)Fig.2 Network architecture

RS-HRNet 與HRNet 不 同 的 地 方 在 于,HRNet 前 兩層使用采樣間隔為2 的卷積層,將輸入尺寸為(H,W)的影像進(jìn)行4 倍降采樣,得到尺寸為(H/4,W/4)的特征圖,最后再通過連續(xù)上采樣將特征尺寸恢復(fù)為(H,W)輸出最終結(jié)果。本文通過實驗發(fā)現(xiàn),如果直接采用這種方式,網(wǎng)絡(luò)模型雖然能通過訓(xùn)練預(yù)測出光照增強(qiáng)后的影像,但是影像會損失一定程度的清晰度,失去細(xì)節(jié)信息。所以RS-HRNet 在HRNet 的基礎(chǔ)上,將前兩層卷積層的采樣間隔設(shè)置為1,同時在最后去掉上采樣操作,將特征圖的尺寸始終保持為(H,W),與輸入影像尺寸一致。

1.2 損失函數(shù)

給 定 訓(xùn) 練 樣 本{Li,Hi|i=1,...,N}, 其 中Li為 暗 光圖像,Hi為對應(yīng)的經(jīng)過光照增強(qiáng)后的無人機(jī)影像,RSHRNet 以Li為輸入,通過一系列卷積層、歸一化層和激活函數(shù)后輸出增強(qiáng)后的影像H?i,本文以Charbonnier 損失函數(shù)[5]對網(wǎng)絡(luò)模型進(jìn)行訓(xùn)練,Charbonnier 損失是一種帶常量的L1 損失函數(shù),相比L1 損失函數(shù)更加穩(wěn)定,在圖像超分辨率、圖像生成、圖像復(fù)原等領(lǐng)域都取得了較好的效果。RS-HRNet 的損失函數(shù)如公式(1)所示:

其中ε 為常量,在本文實驗中根據(jù)經(jīng)驗將ε 設(shè)置為10-3。

1.3 模型訓(xùn)練與預(yù)測

實驗的主要步驟如下:

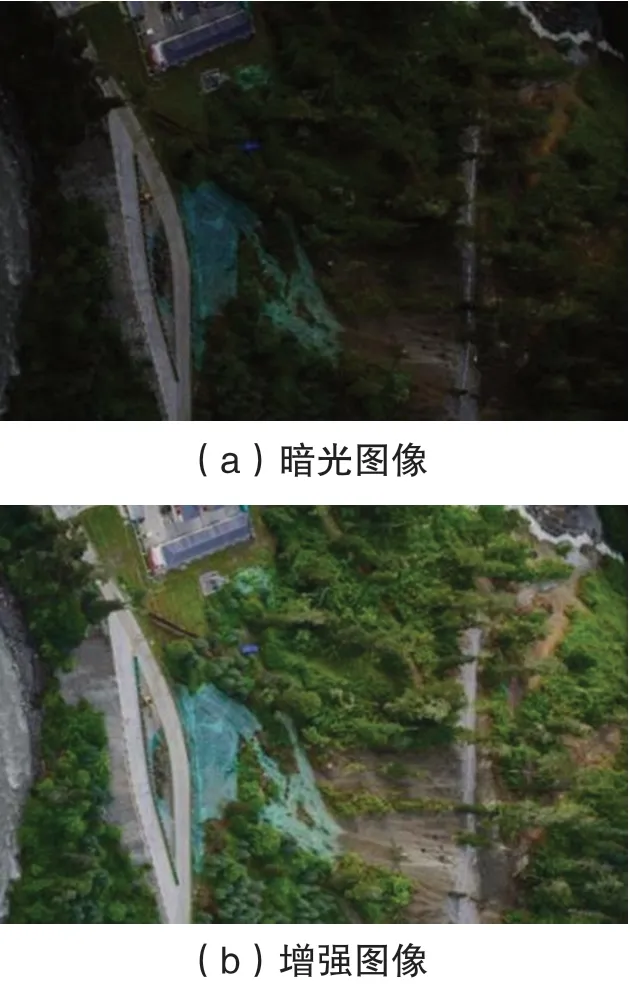

(1)獲取暗光增強(qiáng)訓(xùn)練數(shù)據(jù)。實驗采用在暗光條件下使用飛馬OP3000 傾斜航攝儀獲取的西部某地區(qū)無人機(jī)遙感影像作為暗光圖像,用CaptureOne 手工將該數(shù)據(jù)進(jìn)行光照增強(qiáng)作為增強(qiáng)后的圖像。如圖3 所示,暗光圖像與增強(qiáng)圖像對構(gòu)成了本次實驗的訓(xùn)練數(shù)據(jù)。影像勻為三通道彩色影像,分辨率為5cm/像素,尺寸為7952×5304。數(shù)據(jù)分為訓(xùn)練集和測試集,訓(xùn)練集包含812 對影像,測試集包含203 對影像。

圖3 訓(xùn)練圖像對Fig.3 Training paired data

(2)構(gòu)建深度網(wǎng)絡(luò)模型RS-HRNet。在暗光增強(qiáng)數(shù)據(jù)集上訓(xùn)練模型,獲取遙感圖像暗光增強(qiáng)模型參數(shù)。本文采用Pytorch 深度學(xué)習(xí)框架訓(xùn)練RS-HRNe 網(wǎng)絡(luò)模型,Pytorch 框架易于上手,模型構(gòu)建效率高。

(3)模型預(yù)測,將待處理的測試影像輸入訓(xùn)練好的RS-HRNet 網(wǎng)絡(luò)模型,得到光照增強(qiáng)之后的無人機(jī)遙感圖像。

2 實驗與分析

2.1 實驗數(shù)據(jù)

本文采用飛馬OP3000 傾斜航攝儀獲取的西部某地區(qū)無人機(jī)遙感影像作為實驗數(shù)據(jù),影像勻為三通道彩色影像,分辨率為5cm/像素,尺寸為7952×5304。數(shù)據(jù)分為訓(xùn)練集和測試集,訓(xùn)練集包含812 對影像,測試集包含203 對影像,訓(xùn)練集用于訓(xùn)練網(wǎng)絡(luò)模型,測試集用于測試模型效果。

2.2 實驗參數(shù)

實驗采用Adam 優(yōu)化器作為網(wǎng)絡(luò)優(yōu)化方法,學(xué)習(xí)率設(shè)為2e-4,BatchSize 設(shè)置為4,最大迭代次數(shù)為30,采用的顯卡型號為NVIDIA T600,顯存大小為4GB。

2.3 實驗結(jié)果與分析

本實驗在暗光測試集圖像上進(jìn)行暗光增強(qiáng),由于用CaptureOne 手工將暗光圖像進(jìn)行光照增強(qiáng)后的圖像和原暗光圖像配對作為訓(xùn)練集。因此將模型在測試集上的圖像增強(qiáng)結(jié)果與利用CaptureOne 軟件手動光照增強(qiáng)之后的結(jié)果(在本文中稱作真值)進(jìn)行相似度對比,通過相似度對比評估該算法的魯棒性與暗光增強(qiáng)效果。

本文采用PSNR 和SSIM 對暗光增強(qiáng)效果進(jìn)行評估,PSNR 為峰值信噪比,SSIM 為結(jié)構(gòu)相似性,都是衡量增強(qiáng)結(jié)果與真值之間相似性的指標(biāo)。

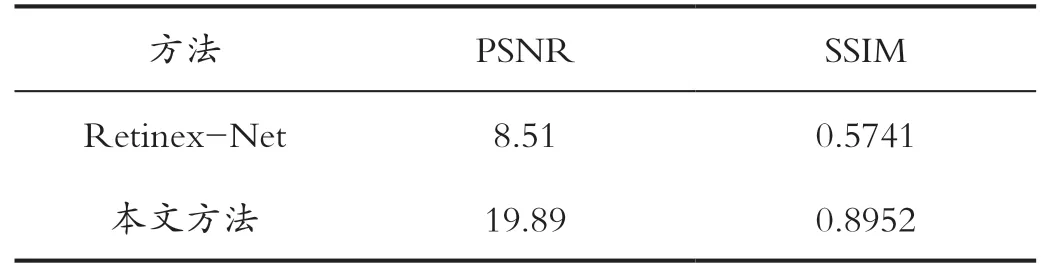

為了驗證本文提出的基于RS-HRNet 暗光增強(qiáng)方法的有效性,本文將方法與近年提出的基于Retinex-Net[3]的暗光增強(qiáng)方法進(jìn)行對比,該方法是基于Retinex 理論[4]的卷積神經(jīng)網(wǎng)絡(luò)模型,開啟了基于深度學(xué)習(xí)進(jìn)行暗光增強(qiáng)的研究熱潮。RS-HRNet 與Retinex-Net 的對比實驗評估結(jié)果如表1 所示。

表1 對比實驗結(jié)果Tab.1 Comparative experiment results

圖4 測試集圖像增強(qiáng)結(jié)果Fig.4 Enhancement of test images

從表1 可以看出,本文方法相比Retinex-Net 在PSNR和SSIM 上都有明顯優(yōu)勢,從如圖4 所示的測試結(jié)果可以看出,基于Retinex-Net 的方法雖然能夠達(dá)到光照增強(qiáng)的效果,但是增強(qiáng)影像的色調(diào)存在明顯的失真,而本文方法在增強(qiáng)了光照的同時仍然保持了圖像的原始色彩信息,究其原因是因為Retinex-Net 分為兩階段:第一個階段是光照分量與反射分量分解;第二個階段是增強(qiáng)光照分量,第一個階段分解的誤差容易影響到第二個階段,形成誤差累計。而本文方法是端到端直接生成增強(qiáng)圖像,采用高分辨率網(wǎng)絡(luò)較好的保持了圖像的細(xì)節(jié)信息,與人工調(diào)色結(jié)果(真值)更為接近,效果更好。

3 結(jié)語

針對高分辨率無人機(jī)遙感圖像暗光增強(qiáng)問題,本文提出了一種基于卷積神經(jīng)網(wǎng)絡(luò)的端到端的遙感影像暗光增強(qiáng)模型,通過訓(xùn)練深度網(wǎng)絡(luò)直接預(yù)測光照增強(qiáng)后的影像。通過與現(xiàn)有基于深度學(xué)習(xí)的暗光增強(qiáng)方法進(jìn)行對比,結(jié)果表明了本文方法的有效性,下一步工作將考慮模型的計算效率,消除分塊效應(yīng),進(jìn)一步提高暗光增強(qiáng)的效果。

數(shù)字技術(shù)與應(yīng)用2023年4期

數(shù)字技術(shù)與應(yīng)用2023年4期

- 數(shù)字技術(shù)與應(yīng)用的其它文章

- 在計算機(jī)網(wǎng)絡(luò)安全中虛擬網(wǎng)絡(luò)技術(shù)的應(yīng)用

- 計算機(jī)信息技術(shù)在互聯(lián)網(wǎng)安全管理中的應(yīng)用

- 計算機(jī)網(wǎng)絡(luò)安全在統(tǒng)計方面的應(yīng)用

- 局域網(wǎng)環(huán)境下的計算機(jī)網(wǎng)絡(luò)安全技術(shù)應(yīng)用分析*

- 有關(guān)大數(shù)據(jù)挖掘技術(shù)運用于網(wǎng)絡(luò)安全探討

- 大數(shù)據(jù)時代計算機(jī)網(wǎng)絡(luò)信息安全與防護(hù)