圖卷積神經網絡在點云語義分割中的研究綜述

張 蕊,孟曉曼,曾志遠,金 瑋,武益超

華北水利水電大學 信息工程學院,鄭州 450046

近年來,隨著三維成像技術的快速發展與激光掃描設備的日益普及,3D點云數據[1-2]的獲取變得越發便捷。點云是由一系列點組成的具有顯著空間幾何特征信息的點集。相較于二維圖像數據[3-4],點云數據具有豐富的深度信息和空間信息等優勢,能夠有效地表達空間中物體的大小、結構、位置和方向,故其空間信息利用程度更高。但其稀疏性、隨機性和非結構化的特點使得基于點云的語義分割[5-7]充滿挑戰。點云語義分割是將每一個點歸類為其所屬對象的語義類別的技術。它作為點云數據處理和分析的基礎技術,在地圖地理信息、導航定位、計算機視覺、模式識別等領域中都有著廣泛的應用。在計算機視覺中的自動駕駛技術,自動駕駛技術的關鍵內容是環境辨別和路況檢測,構建網絡模型實現點云語義分割是環境辨別和路況檢測的基礎,模型分割精度越高,環境辨別和路況檢測越精準,自動駕駛技術越成熟。在地理地圖信息領域,由于地理面積龐大,地形復雜,人工處理需要消耗更多的人力物力,且效率較低,點云語義分割可以高效地識別并分割山川、河流、樹木等目標,減少人力物力的使用,且處理效率高。在導航定位領域,點云語義分割技術的成熟程度決定導航技術的準確度,分割精度越高,導航準確度越高。

傳統的卷積神經網絡[8-9](convolutional neural net‐work,CNN)在二維圖像語義分割[10-12]上取得了很好的分割效果。這類網絡能很好地處理圖像、文本和語音等這類歐氏空間數據,但其卻很難直接對點云等不規則數據進行處理。在二維圖像領域,一張圖片可以表示為分布均勻的像素點,卷積神經網絡通過卷積核在局部進行特征學習,從而獲取圖片的特征信息;而在三維數據領域,一個場景是由一系列點組成的,這些點(點云)具有非結構化、分布不均勻和數據量大等特點,傳統卷積神經網絡很難直接對其進行處理。為了使點云數據適用于卷積神經網絡,研究者們將其轉換為規則的結構(即多視圖、體素和網格),作為網絡模型的輸入,但這種轉換會丟失大量空間幾何信息,因此研究者們開始廣泛關注如何直接對點云數據構造深度學習模型。目前已有一些綜述性論文[13-15]對基于深度學習的點云語義分割研究進行了總結和分析。它們將基于深度學習的點云語義分割方法按照間接法和直接法進行分類,并對這兩類方法進行了詳細劃分。圖卷積神經網絡[16-17](graph convolutional neural network,GCN)直接在圖結構上進行操作,根據節點之間的依賴關系,提取特征。由于其獨特的特征提取方式特別適合對點云數據進行建模,近些年成為學者研究的重要課題之一。基于圖卷積神經網絡的點云語義分割方法研究屬于直接法中的一類,雖然在上述幾篇綜述性文章中有所體現,但這些文章中對其介紹相對粗略,沒有對其進一步詳細劃分。因此,本文對基于圖卷積神經網絡的三維點云語義分割方法進行分類整理,在算法內容上,添加了最近提出的新方法,總結了近幾年多種三維點云語義分割算法,并且按照圖卷積網絡的類型對其進行分類。此外,介紹一些常用的點云數據集以及評價指標。最后對點云語義分割面臨的挑戰做出總結并進行展望。

1 基于圖卷積神經網絡的點云分割方法

隨著卷積神經網絡[18-19]技術的迅速出現,基于深度學習[20-21]的語義分割的精度得到了大幅度提高。深度學習已經廣泛應用于二維圖像的處理中,但由于3D點云數據的不規則性、無序性等特點,使其在點云語義分割上的應用仍面臨著諸多挑戰。

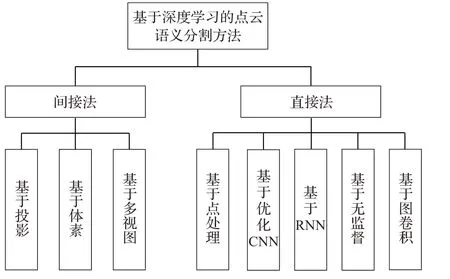

目前基于深度學習的點云語義分割方法可以分為間接方法和直接方法兩大類,如圖1所示。其中間接方法包括基于投影[22-24]、基于體素[25-27]、基于多視圖[28-30]等方法。基于投影的方法通過投影能夠縮小點云的維度和計算成本,但其存在離散化誤差和遮擋等問題,會造成空間信息的丟失;基于體素的方法將點云轉化為體素格式,與投影方法相比信息丟失得少,但是會引起體素的粒度以及邊界的模糊等問題,使分割精度降低;基于多視圖的方法利用多視角下的每個視圖來表示三維模型,解決了點云數據的結構化問題,但這些算法空間信息損失較為嚴重,分割精度不高。直接方法包括基于點處理[31-33]、基于優化CNN[34-36]、基于RNN[37-39]、基于無監督[40-42]、基于圖卷積[43-97]等方法。這類方法直接對點云進行操作,充分利用點云數據的特點,能夠有效降低空間信息損失。本文主要介紹直接方法中的基于圖卷積的方法。

圖1 基于深度學習的點云語義分割方法分類Fig.1 Point cloud semantic segmentation method classification based on deep learning

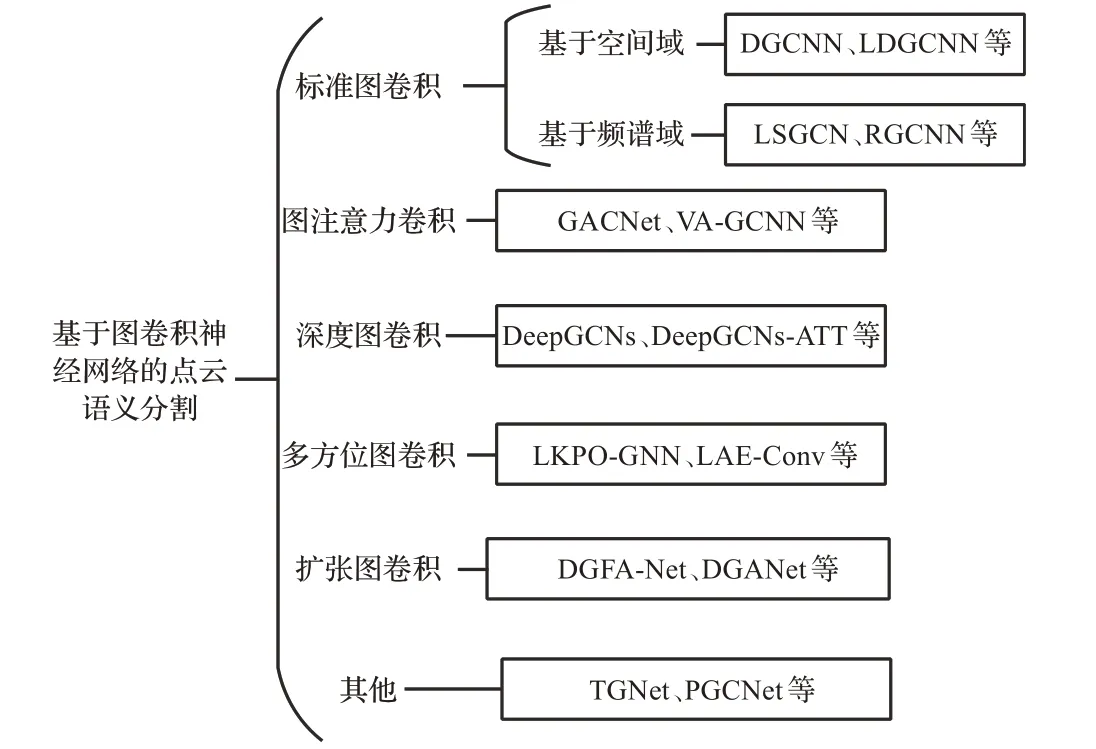

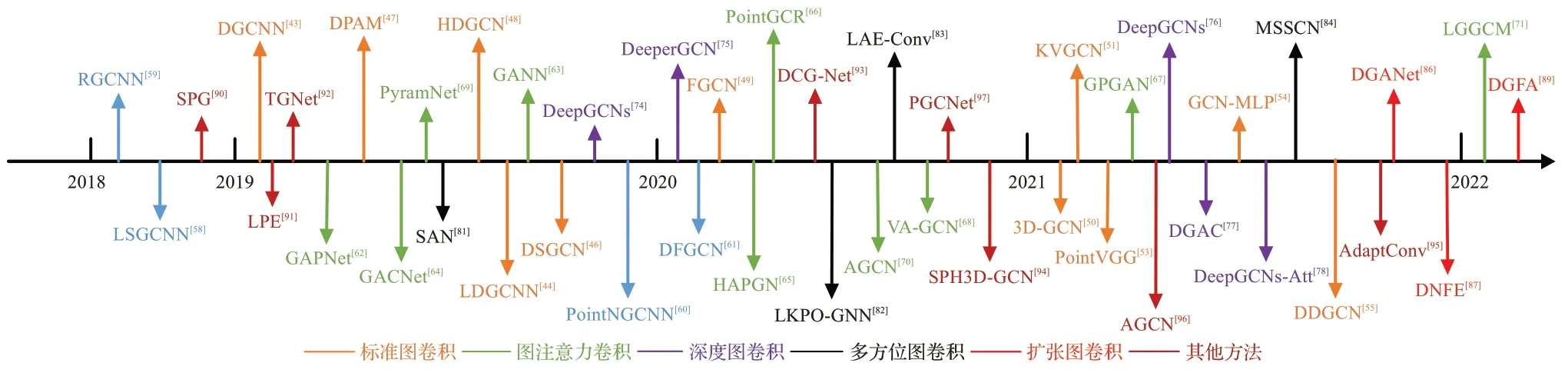

根據圖卷積網絡的類型,本文將基于圖卷積的方法分為標準圖卷積方法、圖注意力卷積方法、深度圖卷積方法、全方位圖卷積方法、擴張圖卷積方法和其他方法,并在圖2中依次列舉了近幾年的網絡模型。根據收集到的點云語義分割網絡模型,圖3統計了近年來基于圖卷積神經網絡的點云語義分割方法的發展時間線。接下來,本文將依次對每一類方法進行詳細介紹。

圖2 基于圖卷積神經網絡的點云語義分割方法Fig.2 Semantic segmentation method of point cloud based on graph convolutional neural network

圖3 基于圖卷積的點云語義分割方法時間線Fig.3 Timeline of point cloud semantic segmentation method based on graph convolution

1.1 標準圖卷積方法

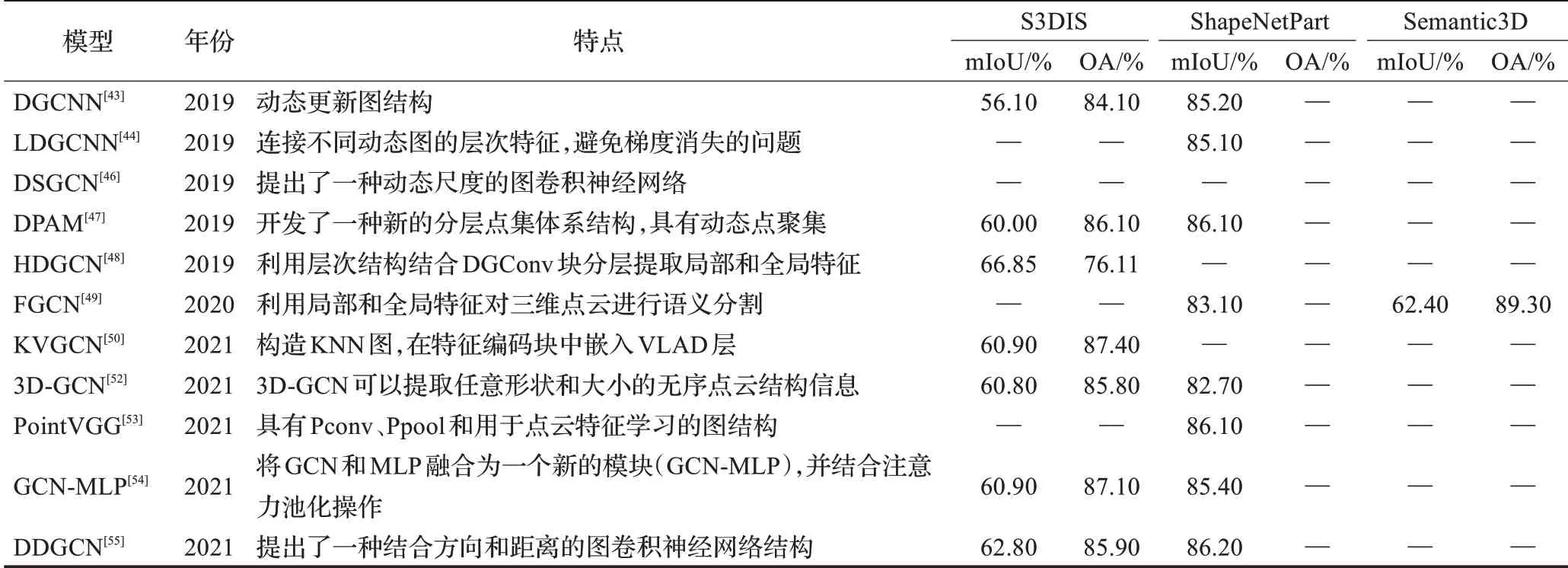

1.1.1 空間域

在圖結構中,節點包含豐富的特征信息,邊代表各個節點之間的依賴關系。基于空間域的圖卷積方法利用點云中的每個點及其相鄰點構成圖結構,直接對點云數據進行卷積,充分利用點云數據的特點,能夠有效降低空間信息損失。下面將介紹一些基于該類方法的網絡模型,并在表1中對該類方法的網絡模型進行了對比分析。

表1 基于空間域的方法模型的對比分析表Table 1 Comparative analysis table of method models based on spatial domain

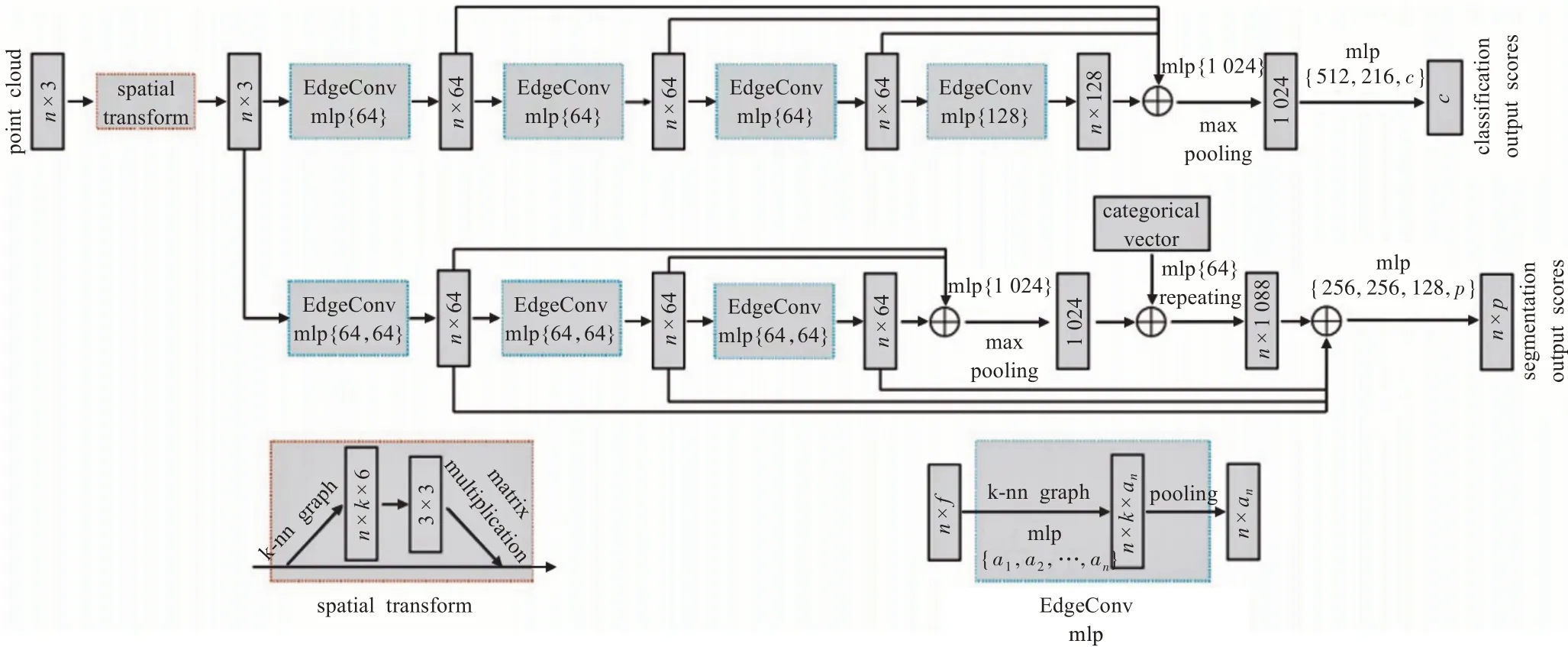

Wang等人[43]首先將圖卷積神經網絡應用到點云處理的過程中,并將其與PointNet[31]相結合,提出了動態圖卷積(dynamic graph CNN,DGCNN)網絡,實現了對點云的直接語義分割。PointNet網絡忽略了點之間的幾何關系,無法提取點云的局部特征。為了解決這一問題,DGCNN網絡用邊緣卷積運算(EdgeConv)替換了PointNet網絡中疊加的多層感知機(multilayer perceptron,MLP),EdgeConv可以在提取點云的局部幾何特征的同時保持置換不變性。DGCNN網絡所構建的圖是動態的,在網絡的每一層之后進行更新,構建新的圖結構。該網絡提高了分割性能,但空間變換網絡的引入使得網絡中可訓練參數相應增加,從而增加模型的優化難度。DGCNN網絡結構圖如圖4所示[43]。

圖4 DGCNN網絡結構圖Fig.4 DGCNN network structure

為了減小網絡模型的優化難度,Zhang等人[44]采用DenseNet[45]的思想,在DGCNN網絡的基礎上提出鏈接動態圖卷積神經網絡(linked dynamic graph CNN,LDGCNN)模型來處理上述問題。該網絡將不同動態圖的層次特征連接起來,計算出信息邊緣向量,有效地避免了梯度消失的問題,減小了網絡的規模,在Shape-Net數據集上獲得了較好的語義分割結果。Xiu等人[46]對DGCNN網絡進行擴展,提出了一種動態尺度圖卷積神經網絡(dynamic-scale GCN),旨在通過結合動態尺度采樣和多尺度鄰域圖對多尺度局部結構信息進行建模。該網絡采樣和近鄰圖構造都是動態實現的,因此在訓練前不需要對數據進行擴充或預處理。

點云特征的提取大都通過分層體系結構實現了優異的性能,然而以往的點聚集策略只是在原有的歐幾里德空間中以固定的方式進行點采樣和分組,不能適應更多不同的場景。為此,Liu等人[47]提出了一種新的分層點集學習體系網絡結構(dynamic points agglomeration,DPAM)。DPAM網絡具有動態點聚集的特點,在網絡層次結構的每一層,根據訓練點的基本分布對點進行采樣、分組和池化,并對點的特征進行自適應權重聚合。該網絡基于圖神經網絡,以點相似圖為輸入,在點之間進行消息傳遞,學習聚集矩陣。點聚集(采樣、分組和池化)是一個輕量級模塊,可以插入到大多數現有的體系結構中。此外,該網絡還提出了一種參數共享方案,減少內存的使用并且減小計算量。

Liang等人[48]提出了一種分層深度圖卷積神經網絡(hierarchical depthwise graph convolutional neural net‐work,HDGCN)。HDGCN網絡包含一個DGConv塊,DGConv塊具有從鄰近點聚集特征和向鄰近點傳輸特征的能力,可以有效地提取局部特征。為了減少內存消耗,HDGCN網絡用1×1的卷積作為逐點卷積來取代空間圖卷積。受層次結構在圖像語義分割和點云語義分割中成功應用的啟發,HDGCN網絡將層次結構與DGConv塊相結合,分層提取點云的局部和全局特征。層次結構增加了感受野,在不同層次提供不同尺度的形狀信息。該網絡在一致性方面存在局限性,點云分割精度有待進一步提升。

Khan等人[49]提出了新的點云語義分割網絡(featurebased graph convolutional network,FGCN)。FGCN網絡使用圖卷積網絡(GCN)將空間信息或局部鄰域特征編碼為對稱圖結構,對無向對稱圖中相鄰點的空間排列進行編碼,并將其與從2D CNN提取的特征一起傳遞到包含三層局部圖卷積的圖卷積網絡,利用局部和全局特征對3D點云進行語義分割,以生成完整的分割圖。該網絡能夠有效提高分割任務的整體性能,但與現有架構相比,需要占用更多的內存。

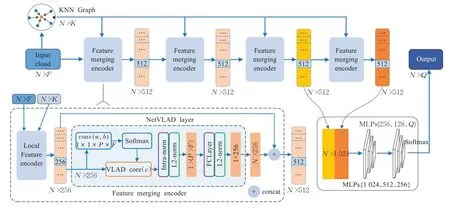

為了能夠從局部結構中學習特征,以及將局部和全局信息進行聚合,Luo等人[50]提出了K-近鄰搜索(KNN)和VLAD(vector of locally aggregated descriptor)[51]結合的圖卷積網絡(KNN searching and VLAD combined graph convolutional network,KVGCN),該網絡通過多個MLP對KNN構造圖的邊緣進行卷積,提取具有代表性的局部特征,然后在特征編碼塊中嵌入VLAD層,聚合局部和全局上下文特征,并且多次重復使用特征編碼塊,將提取的特征采用跳躍連接的方式進行連接,增強網絡的性能,從而提高語義分割的準確性。該網絡中提出的特征合并編碼器中引入了強大的池化機制,該機制具有可學習的參數,可以通過反向傳播進行訓練,從局部特征聚合全局表示,但其在KNN構造圖中的參數K和VLAD中的參數D均為固定值,限制了密集區域特征學習的能力。KVGCN的網絡結構圖如圖5所示[50]。

圖5 KVGCN網絡結構圖Fig.5 KVGCN network structure

Lin等人[52]提出了一種用于點云分析的圖卷積網絡(3D-GCN)。3D-GCN網絡可以提取任意形狀和大小的無序點云信息,且具有平移不變性、縮放不變性和旋轉不變性,對三維點云數據的識別和分割具有足夠的魯棒性。受圖像卷積和池化技術的啟發,Li等人[53]提出了一種新型網絡,即PointVGG,該網絡包含點卷積Pconv、點池化Ppool和用于點云特征學習的圖結構,通過逐層連接學習豐富的高級特征。Wang等人[54]將圖卷積網絡(GCN)和多層感知機(multilayer perceotron,MLP)融合為一個新的網絡結構(GCN-MLP),并結合注意力池化操作,建立了一個高效的點云特征提取模塊。GCNMLP網絡將語義和實例分割整合到一個統一的模型中,高效地實現了室內場景的分割結果。

借助圖卷積神經網絡的思想,Chen等人[55]提出了基于方向和距離的圖卷積網絡(graph convolutional network based on direction and distance,DDGCN)。DDGCN網絡將方向和距離結合起來,進一步獲取點云中的局部特征。首先,該網絡以鄰接矩陣的形式獲取點云中的采樣點,其次,通過計算每個點之間的余弦相似度,得到點云的相似度矩陣,然后選擇KNN算法來提取最相似的點,形成局部鄰域圖,最后,對鄰域圖進行動態圖卷積,得到點云的局部特征。實驗結果表明,該網絡在分類和語義分割任務中具有最佳的性能效果。

基于空間域的標準圖卷積方法主要根據每個點與其鄰節點之間的關系構成圖結構,在圖上進行卷積等操作。與直接基于點的方法相比,考慮了點之間的幾何關系,能更好地捕獲局部特征。但由于特征的各向同性,標準卷積在點云語義分割中存在固有的局限性,忽略了物體的結構,導致分割結果中物體輪廓差,雜散區域小。

1.1.2 頻譜域

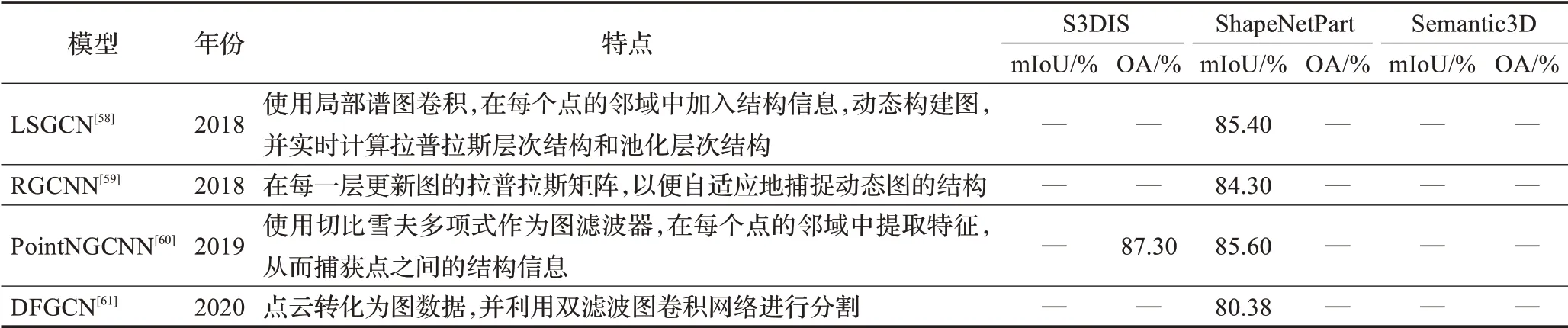

圖的非歐幾里德特性(如不規則的結構)使得對圖的卷積和濾波相對圖像的卷積和濾波較為困難。因此,研究人員從頻譜的角度定義圖卷積,譜圖卷積的介紹[56]中定義了傅里葉域的卷積,這種方式在特征向量計算的基礎上以矩陣-向量積的形式構造卷積,然而,使用特征向量會導致縮放問題。ChebyNet[57]利用Chebyshev多項式逼近譜卷積,直接使用拉普拉斯算子作為濾波器,提取局部特征,并且提高了測試精度。由于譜圖卷積的計算復雜性,目前基于該類方法的網絡模型較少,下面將介紹一些基于譜域卷積的網絡模型,并在表2中對該類方法的網絡模型進行了對比分析。

表2 基于頻譜域的方法模型的對比分析表Table 2 Comparative analysis table of method models based on spectral domain

Wang等人[58]提出了一種新的網絡模型(local spec‐tral graph convolutional network,LSGCN)。LSGCN網絡在PointNet++[32]框架的基礎上利用譜圖卷積,并采取不同的池化策略能夠有效解決現有點云深度學習方法的局限性。該網絡將局部譜特征學習與遞歸聚類和池化相結合,為從無序點云中提取點集特征提供了一種新的體系結構,具體操作為:在點集特征學習中使用局部譜圖卷積,在每個點的鄰域中加入結構信息,動態構建圖結構,以端到端的方式進行訓練,并實時計算拉普拉斯算子和池化層次結構。該網絡具有處理各種數據集和任務的多功能性,具有很大的使用價值。

Te等人[59]提出了一種用于點云語義分割的網絡模型(regularized graph convolutional network,RGCNN)。RGCNN網絡由三個圖卷積層組成,每個層包含圖的構造、圖的卷積和特征濾波。該網絡利用圖譜論,將點云中的點特征視為圖上的信號,并將不規則點云的特征矩陣和鄰接矩陣作為輸入,然后通過Chebyshev多項式逼近定義圖上的卷積,通過設計層間特征關系的圖拉普拉斯矩陣,實現了動態圖結構的自適應捕獲。同時,根據所學到的相關特征,不斷更新矩陣。RGCNN網絡不僅解決了點云的置換不變性問題,而且對點云中的噪聲和密度具有較強的魯棒性,但由于其邊界劃分不清晰,在一定程度上限制了分割性能。

Lu等人[60]提出了一種基于鄰域圖過濾器的深度學習網絡模型(point neighborhood graph convolutional network,PointNGCNN)。PointNGCNN網絡選擇每個中心點周圍的K個最近鄰,并將其轉換為基于中心點的局部坐標,將這些點的特征作為圖信號,然后計算每個鄰域的拉普拉斯矩陣,使用Chebyshev多項式作為提取鄰域特征的圖濾波器,將每個鄰域的特征矩陣和拉普拉斯矩陣加入到網絡中,使用最大池化操作得到每個中心點的特征。在鄰域中使用圖過濾器比使用多層感知機能更有效地提取鄰域點之間的結構信息。

Li等人[61]提出了一種將點云轉化為圖數據的網絡(double filter graph convolutional network,DFGCN),DFGCN網絡首先過濾原始點云,去除噪聲和異常值,并減少圖合成的計算量。然后,使用點云中每個點的坐標和法向量將這些點轉換為圖中的節點,從而構建一個全連通圖。最后,將數據視為一個信號,用低階Chebyshev多項式逼近卷積運算,并采用低通道濾波思想減少計算量。實驗結果表明,該網絡模型具有較強的魯棒性和通用性,但其擴展性較差,圖結構發生變化時,需要重構拉普拉斯矩陣。

基于頻譜域的標準圖卷積方法使用依賴于拉普拉斯矩陣特征分解的圖的頻譜表示,相應的特征向量可以看作是譜圖論諧波分析中的傅里葉基,譜卷積可以定義圖上兩個信號的傅里葉變換的元素乘積,這種譜卷積不能保證濾波器的空間定位,因此需要昂貴的計算,此外,由于譜方法與其相應的拉普拉斯矩陣相關聯,因此,在一個圖上學習的譜CNN模型不能轉移到具有不同拉普拉斯矩陣的另一個圖上,泛化能力較差。

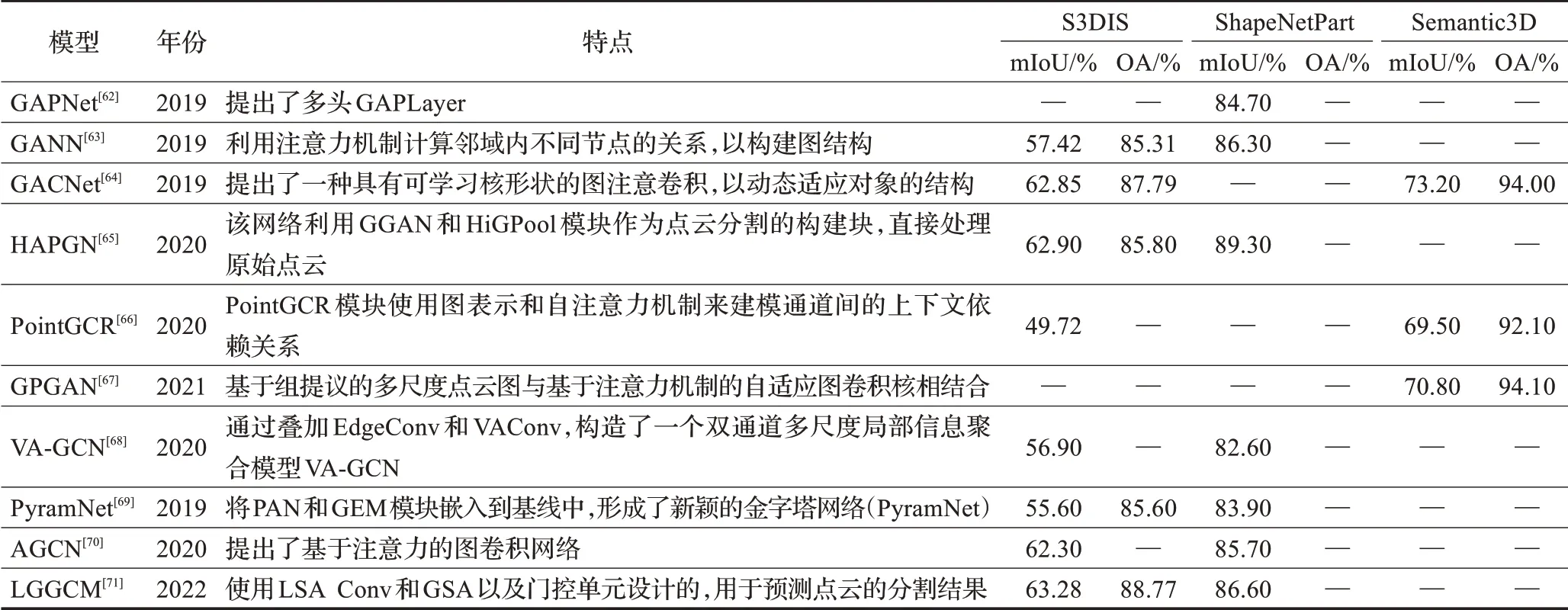

1.2 圖注意力卷積方法

注意力機制的基本思想是使系統忽略無關信息而關注重要信息。注意力機制通過神經網絡算出梯度并且通過前向傳播和后向反饋來學習得到注意力的權重。為了進一步提高精度,研究人員提出了將注意力機制引入到點云語義分割中。下面將介紹一些基于圖注意力卷積方法的網絡模型,并在表3中對該類方法的網絡模型進行了對比分析。

表3 基于圖注意力卷積方法模型的對比分析表Table 3 Comparative analysis table of standard graph convolutional method models based on graph attention convolution

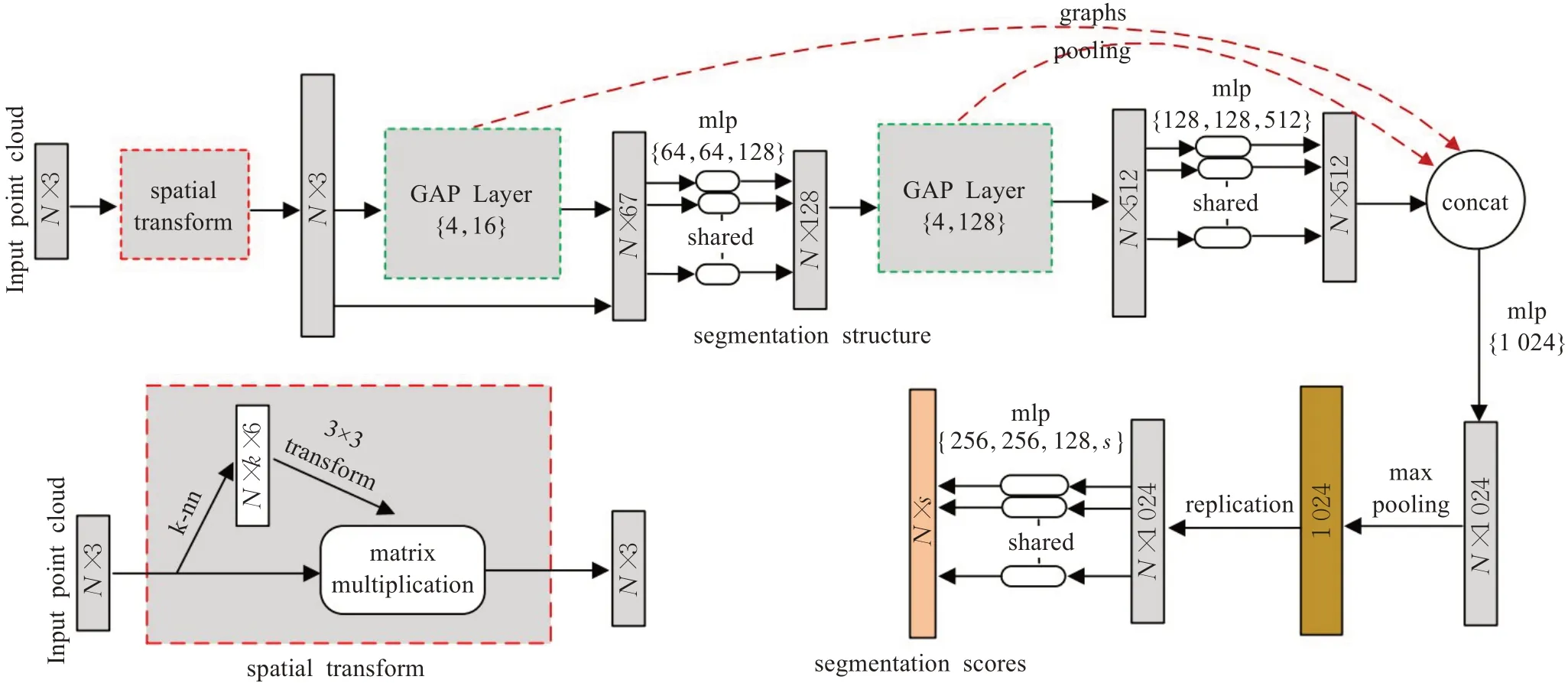

Chen等人[62]將自注意力機制(self-attention)與GCN結合,提出了一種用于點云分割的網絡(graph atten‐tion based point neural network,GAPNet)。GAPNet網絡中的GAPLayer通過突出顯示鄰域中不同的注意力權重來學習每個點的注意力特征。此外,為了充分提取特征,該網絡還采用了一種多頭注意力機制用來聚合從不同的GAPLayer層獲取的特征;為了增強網絡的魯棒性,該網絡提出基于鄰節點的注意力池化層來捕獲局部信息。該網絡模型最先在點云分割中加入人眼視覺系統中的注意力機制,但其對點云數據的泛化能力較差,不能高效、穩健地處理大規模的點云數據。GAPNet網絡結構如圖6所示[62]。

圖6 GAPNet網絡結構圖Fig.6 GAPNet network structure

Li等人[63]提出了新的網絡(graph attention neural network,GANN)。該網絡利用注意力機制計算鄰域內不同節點的關系,以構建圖結構。Wang等人[64]提出了一種新的具有可學習內核形狀的圖注意力卷積神經網絡(graph attention convolutional network,GACNet)。其中,GAC是一個通用的、簡單的模塊,保持了標準卷積的權值共享特性,可以有效地在圖數據上實現,GACNet網絡在分割目標的邊緣部分取得了較好的效果。

Chen等人[65]提出了一種新的分層注意池化圖網絡(hierarchical attentive pooling graph network,HAPGN)。HAPGN網絡利用門控圖注意網絡(gated graph atten‐tion network,GGAN)和分層圖池化模塊(hierarchical graph pooling,HiGPool)作為點云分割的構建塊,直接處理原始點云。GGAN不僅可以突出不同鄰域點的重要性,為不同鄰域點指定不同的權重,還可以突出不同表示子空間的重要性,以增強局部特征提取。HiGPool是一個新穎的池化模塊,它可以捕獲點的空間布局,從而充分學習層次特征,且其在對噪聲和低點云密度的魯棒性實驗中有較好的效果。

全局上下文相關性對三維點云語義分割具有重要的意義。Ma等人[66]提出了一個點全局上下文推理(point global context reasoning,PointGCR)網絡模型,沿著通道維度捕獲全局上下文信息。PointGCR網絡使用圖結構和自注意力機制來建模通道間的上下文依賴關系。PointGCR是一個即插即用、端到端的可訓練模塊。Jiang等人[67]提出了一種改進的深度學習網絡架構,該網絡將基于組提議的多尺度點云圖與基于注意力機制的自適應圖卷積核相結合,從而提高了標記精度。實驗結果驗證了該模型的有效性,表明該模型能夠提高整體性能,但其重要模塊的集成、嵌入能力有待提升。

為了充分提取點云的局部信息,Hu等人[68]提出了一種雙通道多尺度局部信息聚合網絡模型(a vector attention graph convolutional network,VA-GCN),該網絡中包含一種高效的向量注意力模塊(vector attention convolution,VAConv)。VAConv模塊利用中心點與其相鄰點之間向量的仰角和方位角關系構建邊緣特征的注意力權重矩陣,同時,在局部信息中加入受相對向量約束的全局信息,豐富輸出特征的語義。之后,VA-GCN網絡通過疊加EdgeConv和VAConv,融合加權邊緣特征和全局特征,并在全局語義中添加了低維和高維的相對幾何關系。Kang等人[69]提出了一種端到端的網絡結構——金字塔網絡(pyramid attention network,PyramNet)。PyramNet網絡中設計了兩種新的算子——金字塔注意網絡(PAN)和GEM。在增加接受野的同時,PAN不僅可以為每個點分配一些較強的語義特征,而且盡可能地保留了幾何信息。GEM將點云結構和圖關聯起來,利用協方差矩陣探索點之間的關系,增強網絡的局部特征表達能力。

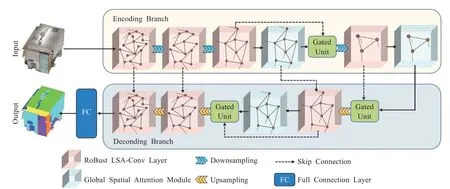

Xie等人[70]提出了基于注意力的圖卷積網絡(atten‐tion-based graph convolutional network,AGCN)。AGCN網絡充分學習和聚合局部結構信息,具有較低的計算開銷和更快的訓練速度。Du等人[71]提出了局部-全局圖卷積方法(local-global graph convolutional method,LGGCM),LGGCM框架是包含LSA Conv(local spa‐tial attention convolution)和GSA(global spatial atten‐tion)兩大模塊。LSA Conv模塊包括兩個部分:生成由鄰節點組成的局部圖的加權鄰接矩陣,以及更新和聚合節點特征以獲得局部點云的空間幾何特征。此外,LSA Conv模塊中嵌入的中心點平滑模塊,通過自適應地調整中心點的位置坐標,增強了卷積操作對噪聲干擾的魯棒性。帶有門控單元(gated unit)的GSA模塊旨在計算局部結構之間的相關性并學習點之間的依賴關系。AGCN網絡可以進一步提高區分目標邊界的能力,但其對點較稀疏的類別(如立柱、沙發等),分割性能有待提升。LGGCM的網絡模型如圖7所示[71]。

圖7 LGGCM網絡結構圖Fig.7 LGGCM network structure

基于圖注意力卷積的方法通過給不同的相鄰點分配特定的注意力權重,從而忽略無關信息,關注重點信息,與標準圖卷積方法相比,該類方法考慮物體結構,能更進一步提取點云特征,在一定程度上有效提升點云分割精度,但三維點云語義分割中類不平衡問題仍是一個具有挑戰性的問題。對于點較多的區域(如天花板、墻壁等)分割精度通常較高,而對于點少的類別(如立柱、沙發等),分割效果還有待提升。

1.3 深度圖卷積方法

卷積神經網絡中存在的梯度消失問題限制了網絡的深度。ResNet[72]中引入輸入和輸出層之間的殘差連接,極大地緩解了梯度消失的問題。目前為止,ResNets可以達到152層甚至更多,DenseNet提供了進一步的擴展,在跨層中引入了更多的連接。深層網絡可能由于池化導致空間信息丟失的問題也通過擴展卷積[73]得到了解決。于是,研究者們將深度網絡這一概念應用到GCN中。下面將介紹一些基于深度圖卷積方法的網絡模型,并在表4中對該類方法的網絡模型進行了對比分析。

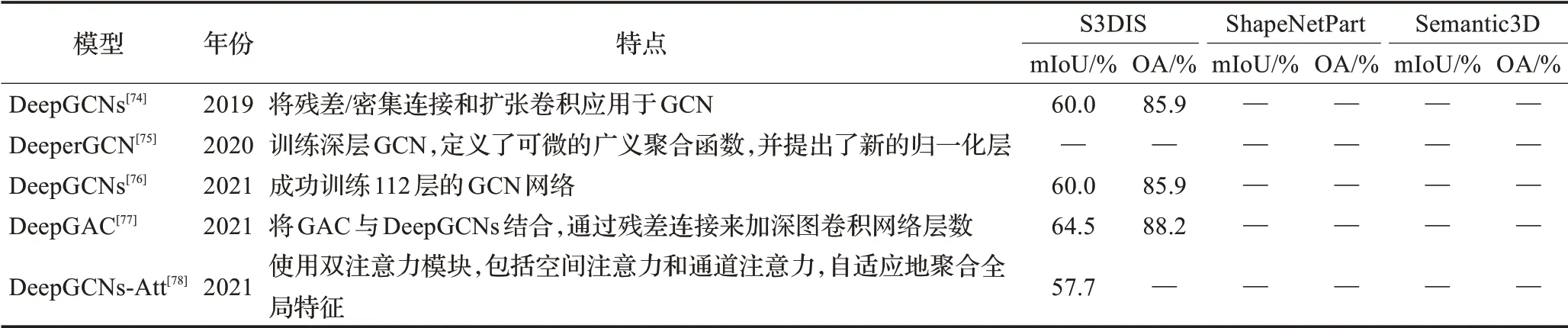

表4 基于深度圖卷積方法模型的對比分析表Table 4 Comparative analysis table of models based on depth graph convolutional method

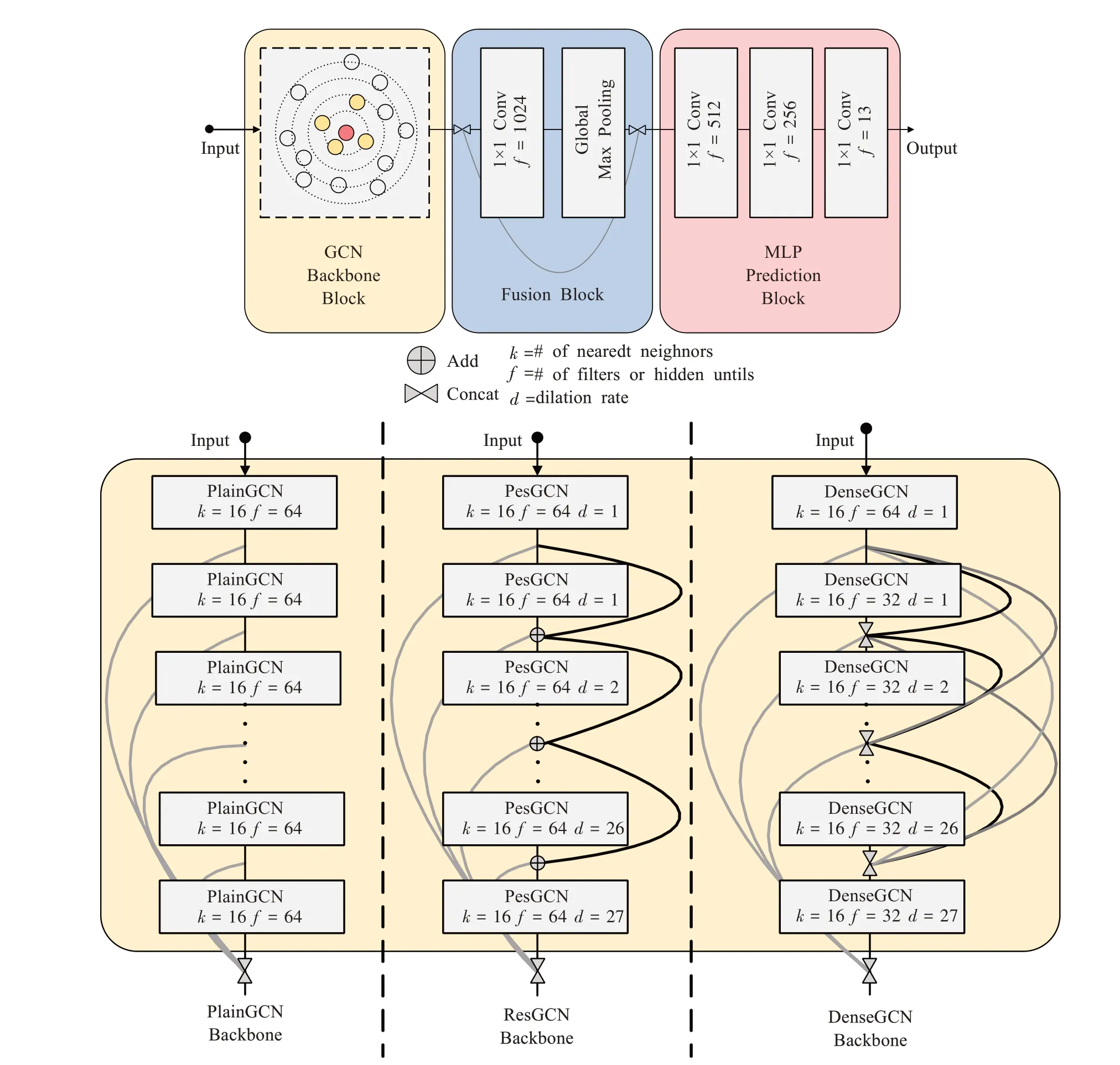

Li等人[74]提出了一種深度圖卷積(deep graph con‐volutional networks,DeepGCNs)。DeepGCNs網絡將殘余連接、密集連接和擴張卷積進行融合,訓練深層GCNs。并且在GCNs中添加跳躍連接,解決阻礙GCNs層數更深的問題。此外,擴張卷積有助于在不損失分辨率的情況下獲得更大的接受域。即使在點的最近鄰數很少的情況下構造圖結構時,也能實現高性能的點云語義分割,但該網絡的擴展能力較弱,不能轉換到其他網絡架構。DeepGCNS網絡結構如圖8所示[74]。

圖8 DeepGCNs網絡結構圖Fig.8 DeepGCNs network structure

DeeperGCN[75]網絡能夠訓練深層GCN,定義了可微的廣義聚合函數,并提出了新的歸一化層。Deep‐erGCN網絡在節點屬性預測和圖屬性預測的大規模圖學習任務上的性能有了明顯提升,但該網絡層次深度較深,需要更多內存資源且消耗更多時間,訓練模型會增加能源消耗。Li等人[76]將殘差連接、密集連接和擴張卷積整合到一個圖框架中,提出了深度GCN架構(Deep‐GCNs)。該網絡成功訓練112層的GCN網絡。實驗結果表明,該網絡在分類和分割任務中取得了不錯的結果。

Chai等人[77]提出的深度圖注意力網絡(deep graph attention convolutional network,DeepGAC)將圖注意力卷積GAC與DeepGCNs結合,通過殘差連接來加深圖卷積網絡層數,可以有效解決網絡過深所導致的梯度消失和網絡退化的問題。采用注意力機制可以使網絡有選擇地關注最相關的鄰域點并為其分配不同的注意力權重,并且通過動態圖卷積來生成更好的圖結構。實驗結果表明,該網絡在窗戶、沙發和桌子這類形狀相似以及難以區分的目標物上效果良好,但對于柱體和雜物等這類特征信息不夠明顯的物體,測試結果略差。

由于DeepGCNs算法不能充分利用點云的全局特征進行語義分割,因此,Wang等人[78]提出了一種稱為DeepGCNs-Att的新型網絡結構來有效地聚合全局上下文特征。該網絡使用ResGCN作為GCN主干塊,在網絡的輸出層使用多層感知機進行降維,然后使用空間注意力和通道注意力,自適應地聚合全局特征。在相同的GCN層數下,該網絡模型比其他模型具有更高的精度和更快的計算速度。實驗表明,DeepGCNs-Att網絡對采樣密度變化具有很強的魯棒性,并且具有很好的正確率。

基于深度圖卷積的方法主要使用殘差/密集連接和擴張卷積來解決深層網絡存在的梯度消失問題,并且在一定程度上提升了網絡分割性能,但該類方法網絡設計和算法使用上面還有一定的進步空間,而且選擇更合適的抽樣方法能進一步提高分割性能。

1.4 多方位搜索圖卷積方法

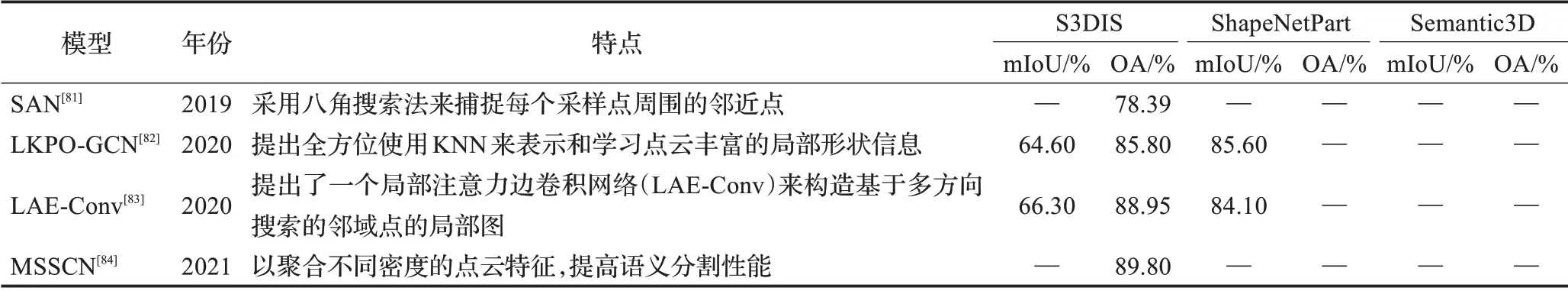

PointSIFT[80]等最近的研究表明,空間結構信息可以提高語義分割的性能。現有的很多網絡大多使用KNN搜索算法來生成圖結構,這種方法會忽略某些空間結構信息,因此,一些研究者提出了多方位搜索圖卷積網絡。下面將介紹一些基于多方位搜索圖卷積方法的網絡模型,并在表5中對該類方法的網絡模型進行了對比分析。

表5 基于多方位搜索圖卷積方法模型的對比分析表Table 5 Comparative analysis table based on multi-directional search graph convolution method model

Cai等人[81]提出了用于點云語義分割的空間聚合網絡(spatial aggregation net,SAN)。SAN網絡首先,采用八角搜索法來捕捉每個采樣點周圍的鄰近點,其次,使用多方向卷積來提取不同方向的采樣點的信息,最后,使用最大池化來聚合來自不同方向的信息。實驗結果表明,該網絡對小物體在分割精度和時間復雜度方面都有良好的效果,但由于該網絡處理大規模點云數據時訓練時間較長,且大規模點云作為輸入進行二次采樣的過程會導致嚴重的信息丟失,而不能直接用于大規模的點云分割任務。

Zhang等人[82]通過在全方位圖卷積神經網絡結構中提出局部KNNs模式,以捕獲全局和局部空間布局,稱為LKPO-GNN,該網絡將無序的三維點云轉化為有序的一維序列,以便將原始數據輸入神經網絡和降低計算復雜度。LKPO-GNN網絡選擇全方位KNNs來形成質心的局部拓撲結構,用來描述點云中的局部形狀,然后,使用GNN聚合局部空間結構,并將無序點云表示為全局圖。該模型可以獲得更深層次的特征表示,從而提高分類和分割性能,實驗結果表明了該模型的簡單性和有效性。

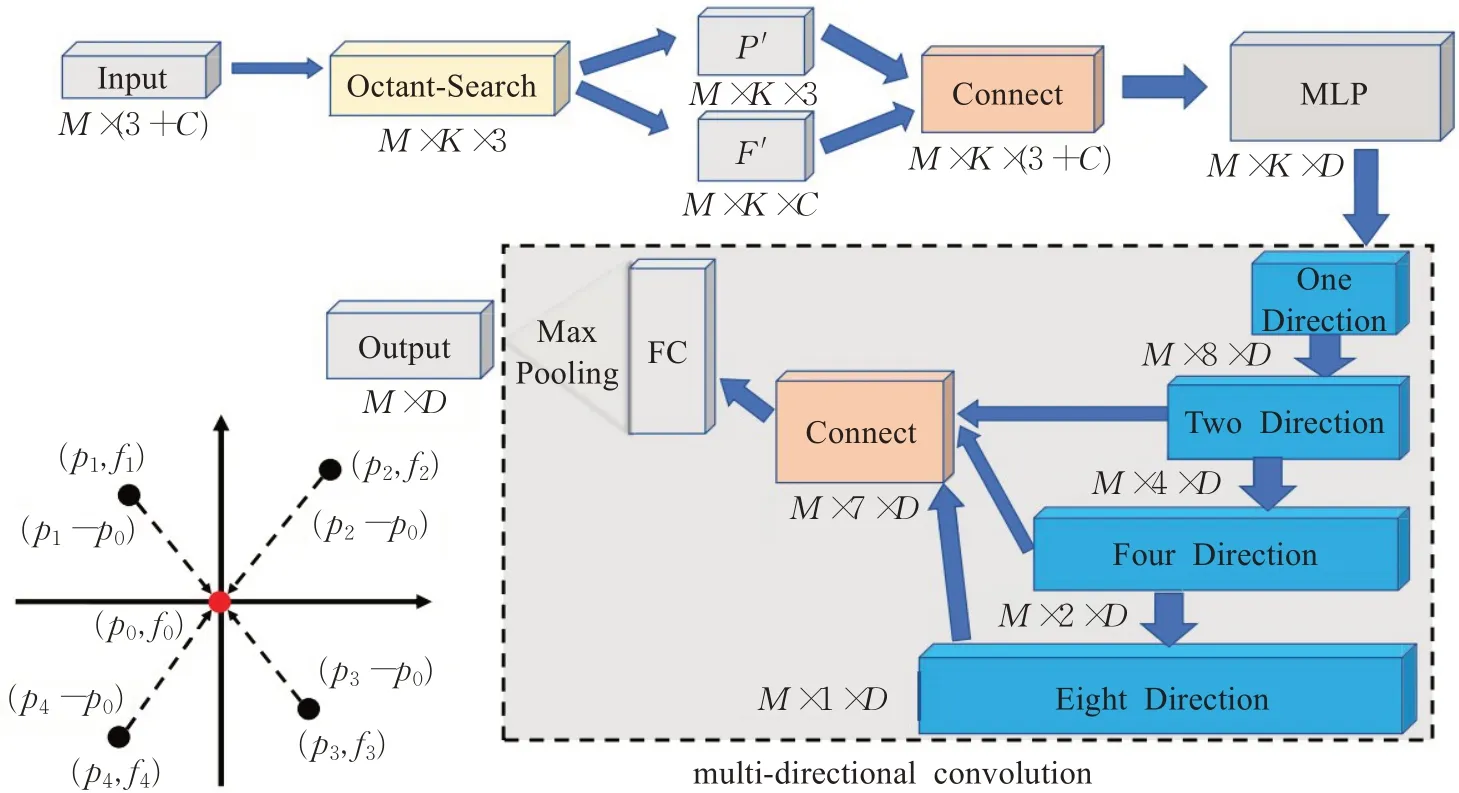

Feng等人[83]提出了一個局部注意力邊卷積網絡(local attention-edge convolution,LAE-Conv)來構造基于多方向搜索的鄰域點的局部圖。LAE-Conv網絡將注意力系數分配給每條邊,然后將中心點特征聚合為其鄰域的加權和。該網絡提出了一種新穎的逐點空間注意力模塊,用來學習遠程上下文信息并通過提高從LAEConv層獲取的局部特征的表征能力來顯著改善分割結果。該網絡將LAE-Conv層與逐點注意力模塊結合起來,可以學習豐富的局部特征及其上下文相關性,實驗結果表明,該方法能有效提高分割結果,但網絡參數還有待進一步降低,同時網絡分割結果有待進一步提高。LAE-Conv網絡結構如圖9所示[83]。

圖9 LAE-Conv網絡結構圖Fig.9 LAE-Conv network structure

Du等人[84]提出了一種基于多尺度特征融合框架的點云語義分割網絡(semantic segmentation network based on multi-scale feature fusion,MSSCN),以聚合不同密度的點云特征,提高語義分割性能。MSSCN網絡首先使用隨機下采樣獲得不同密度的點云,其次利用空間聚合網絡(spatial aggregation net,SAN)作為骨干網絡從點云數據中提取局部特征,然后將提取的特征描述符在不同尺度上進行拼接,最后,利用損失函數結合不同密度點云的不同語義信息進行網絡優化。該網絡不僅對容易分離的物體(如天花板、地板等)分割效果較好,而且對很難分離的物體(如梁、柱等)也能達到良好的分割精度,且抗干擾性和魯棒性較好,但該網絡依賴于用于特征提取的骨干網,而且通過直接映射,在特征融合過程中仍然會丟失部分預測的點信息。

基于多方位圖卷積的方法從多個方向搜索鄰域點構造局部圖,提取多方向空間結構信息,與標準圖卷積方法以及圖注意力卷積方法相比,該類方法能更充分地利用局部鄰域點的幾何相關性。但如何對整個點云場景進行預處理,并在不丟失幾何信息的前提下提取出足夠的點來滿足有限存儲空間仍是一個非常具有挑戰性的問題,且該類方法在處理更復雜的場景分割任務中還有待探究。

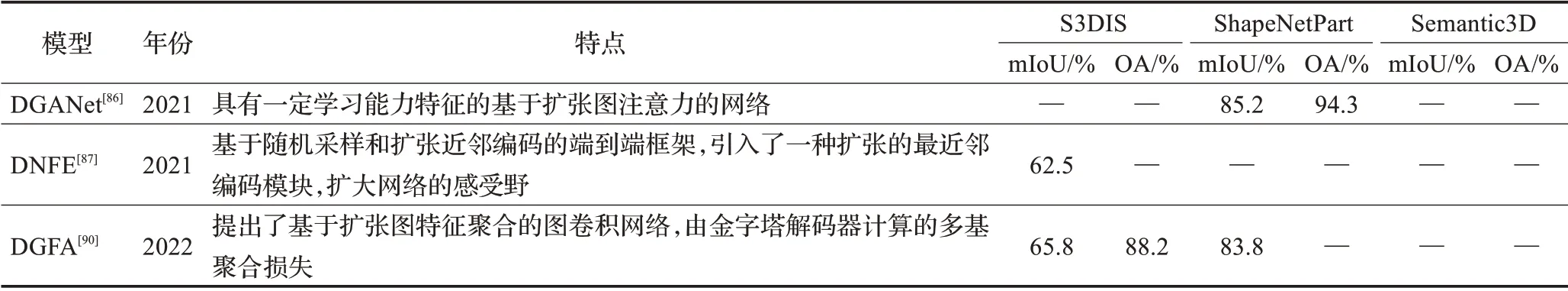

1.5 擴張圖卷積方法

點云的特征提取是三維場景點云分析和處理的重要內容,然而由于點云數據在三維空間中具有不規則無序的結構,如何充分利用點云數據的局部細粒度特征仍然存在挑戰,Engelmann等人[85]評估了目前使用點卷積的方法中最常用的提高感受野的策略,提出了擴張點卷積(DPC)網絡來顯著增加感受野的大小。下面將介紹一些基于擴張圖卷積方法的網絡模型,并在表6中對該類方法的網絡模型進行了對比分析。

表6 基于擴張圖卷積方法模型的對比分析表Table 6 Comparative analysis table of convolutional method model based on dilated graph

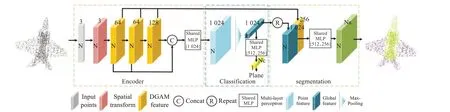

Wan等人[86]提出了一種具有一定學習能力特征的基于擴張圖注意力的網絡(dilated graph attentionbased network,DGANet)用于點云局部特征的提取。DGANet網絡利用改進的K近鄰搜索算法為每個點構建局部擴張圖,該圖對每個點與其鄰接點之間的幾何關系進行建模,使得網絡在進行卷積操作時以最大的感受野學習每個點的局部特征。DGANet網絡中的擴張圖注意模塊(dilated graph attention module,DGAM)可以在構建的擴張圖上動態地學習局部判別性注意力特征,并采用圖注意力池化來聚合重要特征。DGANet網絡能夠充分提取點云上的局部特征,在三維物體分類和分割任務中都取得了可觀的性能,但該網絡架構對點云局部特征提取還有待進一步細化。DGANet網絡結構如圖10所示。

圖10 DGANet網絡結構圖Fig.10 DGANet network structure

為了學習更多的三維幾何信息,Wang等人[87]設計了一個基于隨機采樣和擴張近鄰編碼的端到端框架,引入了一種擴張的最近鄰編碼模塊,擴大網絡的感受野。該網絡基于KNN算法,找到每個點的2K(K值是KNN算法中的一個超參數)個近鄰點,隨機選取50%作為關鍵點進行后續計算。在不增加網絡參數的情況下,該網絡模型對大規模點云的計算和存儲都是高效的,并且在兩個不同的網絡(RandLA-Net[88]、Point Transformer[89])中評估了擴張近鄰編碼,驗證了擴張近鄰編碼的有效性。

點云的語義分割通過密集地預測每個點的類別來產生對場景的全面理解。由于感受野的單一性,點云的語義分割對于多感受野特征的表達仍然存在挑戰性,這個問題導致了對具有類似空間結構的實例的錯誤分類。因此,Mao等人[90]提出了一種基于擴張圖特征聚合(di‐lated graph feature aggregation,DGFA)的圖卷積網絡DGFA-Net。為了提取多感受野特征,DGFA以擴張圖卷積(DGConv)作為其基本構建塊,旨在通過捕獲具有各種感受區域的擴張圖來聚合多尺度特征表示。實驗結果表明,DGFA-Net網絡優于基線方法,實現了不錯的分割性能。

基于擴張圖卷積方法主要擴大網絡的感受野,從而更充分地提取點云特征,與前幾種方法相比,該類方法能夠學習更多的三維幾何信息,該類方法對大規模點云具有較高的計算效率和存儲效率,也是目前主流方法之一。但該類網絡在點云局部特征提取方面還有待細化,如何將二維圖像特征與三維點特征融合,進一步增強局部點的特征表示也將是研究的重點。

1.6 其他方法

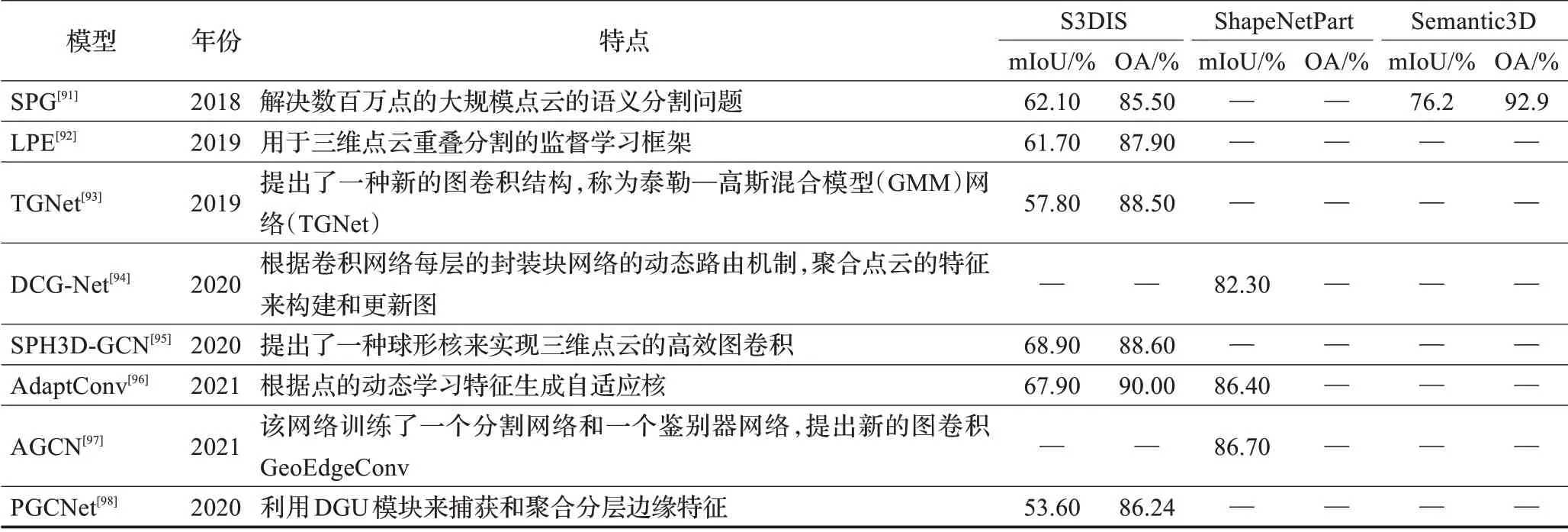

Landrieu等人[91]提出了一種新的基于深度學習的框架來解決數百萬點的大規模點云的語義分割問題,點云特征可以被超點圖(super point graph,SPG)有效捕獲,SPG提供了物體之間上下文關系的特征表示,但SPG的分割結果對局部點密度非常敏感。在此基礎上,Landrieu等人[92]又提出了一種用于三維點云重疊分割的監督學習框架,引入了圖結構對比損失函數,和一個輕量級的架構——局部點嵌入器。Li等人[93]提出了泰勒-高斯混合模型(Taylor Gaussian network,TGNet),以有效地從點云中學習局部聚合特征。TGNet網絡由基本幾何單元TGConv組成,TGConv對不規則點集進行局部卷積。TGNet網絡在多尺度鄰域上使用TGConv提取從粗到細的語義深度特征,同時提高其尺度不變性。此外,該網絡在輸出層內采用條件隨機場(conditional ran‐dom field,CRF)進一步改善分割結果。實驗結果證明了該方法的有效性。

Bazazian等人[94]提出了新的網絡(dynamic capsule graph convolutional network,DCG-Net)對點云進行分析,完成分類和分割任務。DCG-Net網絡根據卷積網絡每層的封裝塊網絡的動態路由機制,聚合點云的特征來構建和更新圖。Lei等人[95]提出了一種球形核來實現3D點云的高效圖卷積。球形核保持平移不變性和不對稱性,有助于精細的幾何學習。標準卷積在3D點之間的特征關系進行了無差別的描述,呈現出較差的特征學習的內在局限性。因此,Zhou等人[96]提出了自適應圖卷積(adaptive graph convolution,AdaptConv),根據點的動態學習特征生成自適應核。與使用固定/各向同性內核相比,AdaptConv提高了點云卷積的靈活性,有效且精確地捕獲了來自不同語義部分的點之間的不同關系。

由于網絡結構和局部特征聚合方法的粗糙性,目前很多網絡都存在分割精度低、復雜度高等問題。為了克服這些問題,Kim等人[97]提出了一種用于三維點云分割的對抗圖卷積網絡(adversarial graph convolutional network,AGCN)。該網絡訓練了兩個網絡,一個分割網絡和一個鑒別器網絡。鑒別器網絡在最后一個卷積層中計算來自分割網絡的真實圖和預測標簽圖的兩個各自嵌入特征之間的差異,以訓練分割網絡。這種對抗性訓練有助于提高分割網絡的分割精度和訓練穩定性,使網絡能夠學習平滑一致的真實標簽的高級特征。Sun等人[98]使用曲面片作為更有效地表示,并提出了一種新的室內場景分割框架,稱為曲面片圖卷積網絡(patch graph convolutional network,PGCNet)。為了更好地提取局部特征和聚集相鄰信息,PGCNet網絡構造了場景面片圖(scene patch graph,SPG)和動態圖U-Net(DGU)模塊。在SPG中,將曲面片視為節點,其空間關系視為邊,構造圖結構。DGU模塊在U形編碼器-解碼器中集成了動態邊緣卷積操作,在DGU模塊的每一層,通過動態邊緣層更新圖結構。但目前該網絡的擴展性有限,還不能擴展到其他室內任務。表7中對這些網絡模型進行了對比分析。

表7 基于其他圖卷積方法模型的對比分析表Table 7 Comparative analysis table based on other graph convolutional method models

基于文章中1.1節至1.5節的內容,總結出各類點云語義分割方法的優點、缺點、適用范圍和應用場景,以便更直觀地對基于標準圖卷積、圖注意力卷積、深度圖卷積、多方位搜索圖卷積方法以及基于擴張圖卷積方法進行比較,具體內容如表8所示。

2 點云數據集和評價指標

2.1 點云數據集

為了驗證所提出的算法對點云語義分割的效果,有效的數據集尤為重要。復雜的神經網絡模型,需要大量的訓練數據才能使模型有效,因此,含有豐富數據的數據集在模型訓練中起著不可或缺的作用。一些研究機構提供了可靠的開源3D點云數據集。表9展示了這些數據集的年份、類別個數、訓練集、測試集以及驗證集。

表9 常見的3D點云數據集Table 9 Common 3D point cloud datasets

(1)PartNet數據集[99]2019年由英特爾人工智能研究人員與加州大學圣地亞哥分校和斯坦福大學合作開發,該數據集包含24種類別,573 585個零部件實例和26 671個3D模型,可用于形狀分析、動態3D場景建模和可行性分析等任務。

(2)ShapeNet Part數據集[100]2016年由斯坦福大學、普林斯頓大學、Adobe研究人員、UT奧斯汀研究人員和TTIC的研究人員共同制作而成,該數據集包含16種類別,16 881個形狀,共有50個物體零部件,其中每個形狀通常包含2~5個零部件,可應用于物體零部件分割任務。

(3)S3DIS數據集[101]2016年由斯坦福的大學開發,該數據集包含6個區域,共272個3D空間場景,13種類別,用于室內場景語義分割任務。

(4)ScanNet數據集[102]2017年由斯坦福大學普林斯頓大學慕尼黑工業大學共同開發,該數據集是一個RGB-D視頻數據集,共1 513個采集場景數據,包含21個語義類別,應用于3D對象分類、語義體素標簽和CAD模型檢索等。

(5)Semantic3D數據集[103]2017年由瑞士蘇黎世聯邦理工大學開發,該數據集包含8個語義類別,掃描范圍包括各種城市戶外場景,如教堂、街道、鐵路、廣場、村莊、足球場和城堡等,應用于自動駕駛等任務。

(6)vKITTI數據集[104]2016年由法國歐洲施樂研究中心計算機視覺小組和美國亞利桑那州大學研究小組共同開發,是一個大型戶外數據集,由KITTI數據集模擬而成,具有真實世界場景,其中包含城市場景中的13個語義類別,應用于對象檢測和多對象跟蹤、場景級和實例級語義分割等。

(7)Paris-Lille-3D數據集[105]2018年由巴黎高等礦業學院的研究小組開發,是一個城市MLS數據集,包含1 431萬個標記點,涵蓋50個不同的城市對象類別。整個數據集由3個子集組成,分別為713萬、268萬和457萬個點,可以用于自動駕駛等任務。

2.2 評價指標

點云語義分割的評價指標主要有總體精準度(overall accuracy,OA)、平均精準度(mean accuracy,MA)、平均交并比(mean intersection over Union,MIoU)和加權交并比(frequency weighted intersection over union,FWIoU)等。

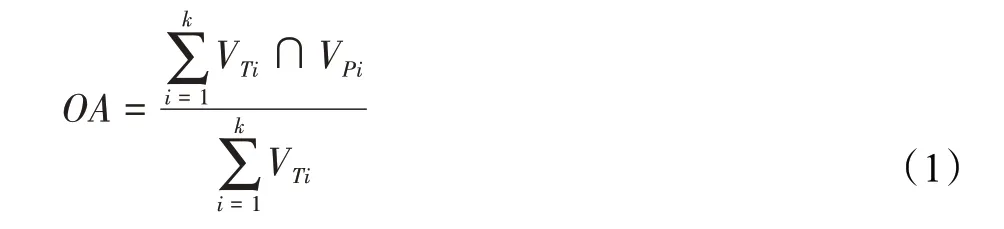

OA表示計算每一個隨機樣本的語義標簽和預測值相一致的概率。OA的計算公式為:

MA表示對每個類別中隨機樣本的語義標簽和預測值相一致的概率進行求和并取平均。MA的計算公式為:

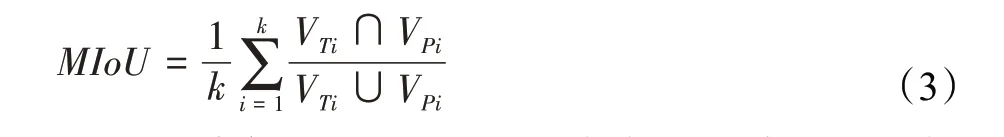

IoU表示真實區域與預測區域這兩個集合的交集和并集的比率,MIoU表示計算每個類別的IoU,然后求和再取平均。MIoU的計算公式為:

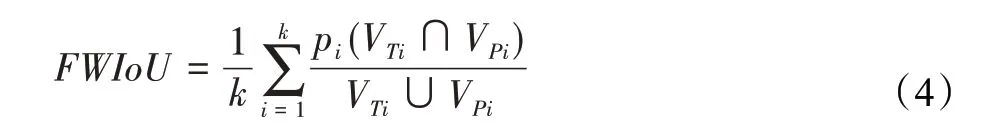

FWIoU是在MIoU的基礎上,根據每一類出現的頻率為其設置權重。FWIoU的計算公式為:

其中,k代表一共有k個類別,VTi代表每個類別的真實樣本數,VPi代表每個類別的預測的真樣本數,pi代表每個類別所占權重。

3 展望

點云語義分割作為3D場景理解的基礎,一直以來都是研究的核心之一。圖卷積神經網絡獨特的特征提取方式特別適合對點云數據進行建模。本文對基于圖卷積神經網絡的三維點云語義分割方法進行了分類整理。針對1.1節至1.5節中不同類型的圖卷積點云語義分割方法,逐一分析其面臨的問題并進行展望:

(1)文中將1.1節中的標準圖卷積的方法分為基于空間域的方法和基于頻譜域的方法。基于空間域的方法考慮了點之間的幾何關系,能更好提取點云局部特征,但其忽略了物體的結構,導致分割結果中物體輪廓較差,這一問題在1.2節介紹的方法中已經得到有效解決。為了進一步提高網絡模型分割精度,未來需要在參數設置、網絡架構等方面進一步優化。基于頻譜域的方法使用依賴于拉普拉斯矩陣特征分解的圖的頻譜表示,需要昂貴的計算代價,且在一個圖上學習的譜卷積神經網絡模型不能轉移到具有不同拉普拉斯矩陣的另一個圖上,泛化能力較差,未來需要對該類方法網絡模型進行優化,盡可能減少計算代價并且提高網絡的泛化能力。

(2)1.2節中圖注意力卷積的方法引入了注意力機制,解決了標準圖卷積方法中存在的忽略物體結構問題,但三維點云語義分割中類不平衡問題仍是一個具有挑戰性的問題。針對稀疏點云導致的分割精度不高的問題,是該類方法所需要研究的一個重點內容。此外,該類方法對點云數據的泛化能力較差,不能高效、穩健地處理大規模的點云數據,且重要模塊的集成、嵌入能力有待提升,未來需要提高該類網絡模型的泛化能力。

(3)1.3節中深度圖卷積的方法引入了殘差連接、密集連接和擴張卷積,解決了深層網絡中存在的梯度消失問題,但分割精度還有待更進一步的提升。網絡的擴展性較差,且由于網絡層次深度較深,需要更多內存資源且消耗更多時間,訓練網絡模型會增加能源消耗。未來,該類方法在網絡設計、模型優化、算法使用和網絡擴展性等方面還有一定的進步空間。

(4)1.4節中多方位圖卷積的方法,采用多方位搜索法來捕捉每個采樣點周圍的鄰近點,能更充分地利用局部鄰域點的幾何相關性,但如何對整個點云場景進行預處理,并在不丟失幾何信息的前提下提取出足夠的點來滿足有限存儲空間仍是一個非常具有挑戰性的問題,且該類方法在處理更復雜、更大規模的場景分割任務中還有待探究。未來,該類方法需要進一步優化網絡模型,處理更復雜的點云場景數據,為人工智能等技術提供更好的模型支持。

(5)大規模場景的點云語義分割一直是重要的研究方向之一,1.5節中擴張圖卷積方法擴大了網絡的感受野,對大規模點云具有較高的計算效率和存儲效率,但該類網絡在點云局部特征提取方面還有待細化。由于場景信息的限制,單一的表示方法限制了分割精度,使用多模態(例如投影、體素和點云)進行語義分割可能會獲得更高的精度。如何將二維圖像特征與三維點特征融合,進一步增強局部點的特征表示也將是研究的重點。

(6)數據集的選定對網絡模型的訓練效果的好壞至關重要,訓練網絡模型需要大量的數據,現有的數據集并不能滿足點云語義分割發展的需求。因此,收集一些數據豐富且高效的數據集是進行點云語義分割的首要條件。現有的戶外數據集相對室內數據集而言較少,所以收集整理這類數據集對點云語義分割的發展至關重要。

目前,基于圖卷積的方法是直接基于點云語義分割方法的研究熱點。以上這些方法致力于全面探索逐點特征以及點/特征之間的聯系。然而,其使用的鄰域搜索機制,例如KNN、ball query和分層架構,容易忽略局部區域之間的低級特征,進一步增加了全局上下文特征提取的難度。因此,在算法設計和使用上還有待進步。

4 結束語

本文以圖卷積技術為核心,對近幾年的點云語義分割方法進行了綜述。首先,按照網絡的類型將這些方法分為了標準圖卷積方法、圖注意力方法、深度圖方法、多方位圖卷積方法、擴張圖卷積方法和其他方法。其次,分別詳細介紹了這六大類對應的網絡模型,在表1至表7中對每類方法的網絡模型在一些數據集上的性能表現進行了對比分析,并且在表8中對各類點云語義分割方法的優缺點、適用范圍、應用場景進行了比較。然后,描述了部分常用的點云數據集和評價指標。最后,討論了不同類型的點云語義分割方法所面臨的問題,并進行了展望。隨著深度學習技術的發展,圖卷積神經網絡被廣泛應用于點云來完成語義分割,并取得了很好的分割結果。與其他方法相比,基于圖卷積神經網絡的方法不僅可以檢測點之間的關系,還可以得到邊界特征。圖卷積神經網絡在點云分割方面有諸多優勢,但仍存在有待改進的問題,點云語義分割在圖卷積神經網絡上的研究仍然還有很大的進步空間。