基于改進YOLOv5算法的織物疵點檢測系統

謝團結林賢偉胡連信嚴明華王澤峰

(1.湖州師范學院,浙江湖州,313000;2.湖州市菱湖萬事美毛紡織有限公司,浙江湖州,313009)

紡織業是我國國民經濟的支柱型產業和重要的民生產業,也是我國國際競爭優勢明顯的產業,在繁榮市場、擴大出口、吸納就業、增加收入、促進城鎮化發展等方面發揮著重要作用[1]。在我國紡織業發展的過程中,織物質量是影響織物價格的關鍵因素,有疵點的織物比沒有疵點的織物價格降幅達50%[2]。為了提高產業經濟效益,需要對織物疵點進行檢測。當前織物疵點檢測主要依靠人工目測的方式完成[3],人工目測不僅人工成本高,而且肉眼在對織物進行檢測的過程中,極易產生疲勞反應,直接影響織物的細微疵點檢測。

國內外針對織物疵點,提出了許多相關檢測算法。按照檢測方法的不同,能夠將這些研究算法分為4大類。一是基于統計的方法。該類方法是利用織物疵點圖像的灰度像素值,通過計算這些像素值得到描述圖像紋理特征的統計量。鄒超設計了一種基于模糊類別共生矩陣的織物疵點在線檢測系統,有效提高了織物疵點檢測的速度[4]。LATIF-AMET A等人提出應用共生矩陣對織物疵點進行檢測[5]。二是基于頻域的方法。KARLEKAR V V等人提出了一種結合小波變換和形態學的織物疵點檢測方法[6]。李益紅等人提出基于Gabor濾波器的均值歸一化方差算法,降低了運算量,提高了準確率,達到了93%[7]。三是基于模型的方法。該類方法主要是在圖像層面構建模型,通過假設檢驗的方法判斷織物紋理是否符合所建立的模型。常用的模型方法有自回歸模型[8-9]和馬爾科夫隨機場[10-11]。該類方法最大的缺點是不易識別小疵點。四是基于學習的方法。唐有赟等人提出了一種基于輕量級模型的經編織物疵點在線檢測算法,這個算法在滿足經編織物疵點檢測精度的基礎上,具有更快的檢測速度,是目前人 工檢測速 度 的4倍~6倍[12]。ZHENG L等人提出了一種基于改進YOLOv5的織物疵點檢測系統探測器,該算法能快速準確地提高織物疵點檢測和疵點定位的準確性[13]。

1 系統設計

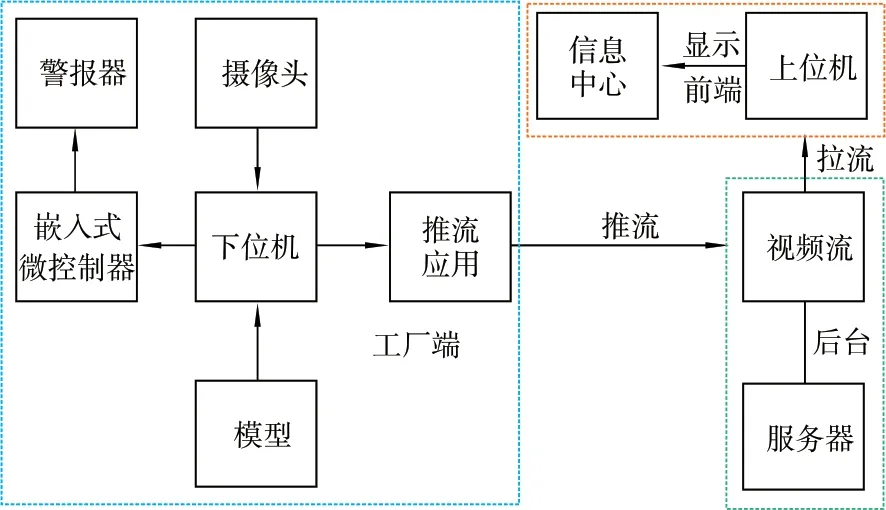

本研究設計的織物疵點在線檢測系統結構如圖1所示。該系統硬件由相機、光源、下位機、嵌入式微控制器、警報器組成,軟件用python語言編寫,PC界面采用pyqt設計,數據庫采用MySQL。首先訓練織物疵點檢測模型,然后把訓練好的模型搭載到下位機上,計算機通過讀取攝像頭錄取的視頻對織物進行識別。并把識別到的結果通過ffmpeg推流應用傳到rtmp視頻流服務器,上位機通過讀取rtmp視頻流在前端進行顯示。如果發現了織物疵點,警報器就會發出響聲,并停止機器的運行,提醒工作人員織物出現了疵點,所有的織物疵點都會存儲在數據庫中,對織物質量提供參考。

圖1 系統結構圖

2 YOLOv5模型與改進

2.1 YOLOv5模型

YOLO[14]是 單 階 段 目 標 檢 測 的 算 法,YOLOv5模 型 分 為Input、Backbone、Neck、Prediction 4個部分。

2.1.1 Input

Input包含Mosaic數據增強、自動錨框計算和自適應圖片縮放。Mosaic數據增強隨機將4張圖片進行拼接,豐富了圖片的背景,增加了很多小目標,讓網絡的魯棒性更好。YOLOv5中將計算錨框的功能加入到代碼中,每次訓練時,自動計算出訓練集中的最佳錨框值。YOLOv5的自適應圖片縮放,是為了提高推理速度,自適應圖片縮放相比于統一縮放,能夠減少圖片冗余信息和計算量,推理速度也得到了提升。

2.1.2 Backbone

Backbone模塊主要是由Conv結構、CSP[15]結構、SPPF[16]構成。Conv結構包括Conv2d二維卷積,BatchNormal,SiLU激 活 函 數。Conv結 構 負責對特征圖進行特征提取,并更改特征圖通道數。CSP結構主要通過減少網絡優化中的梯度信息重復,減少神經網絡計算量。YOLOv5的CSP結構有兩種不同的結構,一種為帶殘差結構的,一種為不帶殘差結構的。SPPF主要作用是為了增強特征圖的表達能力。

2.1.3 Neck

Neck部 分 采 用FPN[17]+PAN[18]結 構,FPN是自頂向下,對特征層進行下采樣,將高層的強語義特征傳遞下來,使得所有尺度下的特征都有豐富的語義信息。FPN中間經過多層的網絡后,底層的目標信息已經非常模糊了,PAN加入了自底向上的路線,對特征層進行上采樣,彌補并加強了定位信息。

2.1.4 Prediction

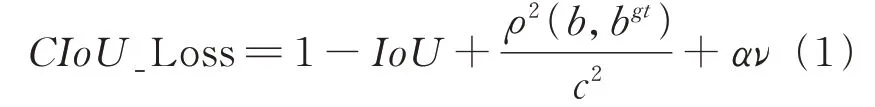

Prediction使用了二維普通卷積,其采用了CIoU_Loss[19]計算位置損失,以及BCEWithLogits_Loss計算置信度損失和分類損失。CIoU_Loss和BCEWithLogits_Loss的計算如公式(1)和公式(2)所示。

式中:α為權重;ν為衡量長寬比的相似度;b,bgt分別表示預測框和目標框的中心點,兩者之間距離采用歐式距離ρ;c表示能同時包含預測框和目標框的最小包圍框的斜距。

式中:n為樣本總數;wn為權重調節系數;yn為數據標簽值;xn為數據預測值;σ為Sigmoid函數。

2.2 改進YOLOv5模型

在紡織產業中,織物疵點更多是比較細微的,很難被發現。YOLOv5作為單階段檢測的算法,相對于二階段檢測Faster RCNN,存在著對小目標識別不夠準確的缺陷。模型對于比較細微的織物疵點,檢測精度無法滿足工業需求,存在檢測精度低和漏檢等情況。本研究針對織物疵點較細微、不易識別的特點,添加卷積注意力模塊(CBAM)[20],提高對小目標的檢測精度和識別效果。CBAM是一種結合了空間和通道的注意力機制模塊,能夠增強重要特征的表達能力,抑制無相關噪聲信息,進而提高檢測精度。

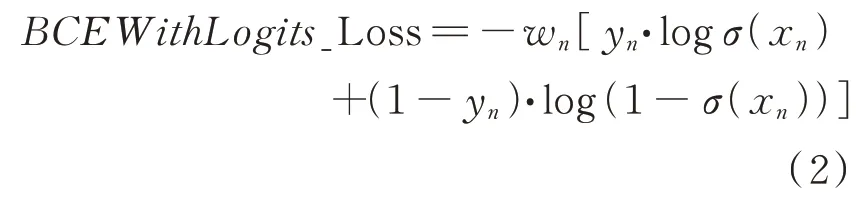

本研究提出的算法模型如圖2所示。由于特征層SPPF的輸出包含比較多的特征信息,經過卷積之后會損失特征圖特征。為了提高模型整體識別精度,并控制模型的大小,本研究把第4個Concat連接層提前到SPPF,具體連接線如圖2虛線連接線所示。融合更多的特征層以及學習更多的特征,加快了模型收斂速度,提高了整體精度,獲得了更好的效果。為了提高模型檢測小目標的精度,本研究提出了將CBAM模塊添加到第一個CSP模塊之后的方法,具體位置如圖2虛線框包圍的CBAM所示。通過在CSP模塊之后添加CBAM模塊,增加網絡的深度,并讓網絡更加關注特征圖的重要信息,提高網絡的表達能力,進而提高識別精度。

圖2 改進YOLOv5結構圖

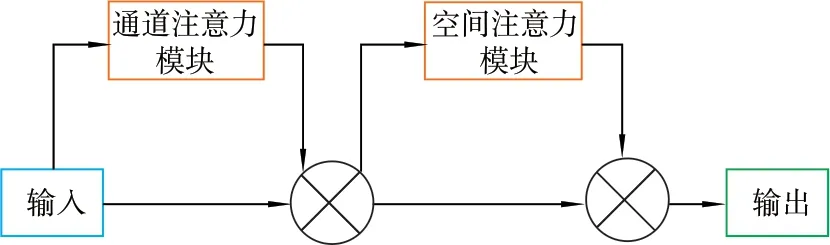

CBAM模塊如圖3所示,包括通道注意力模塊和空間注意力模塊。通道注意力模塊在通道提取特征圖的特征,空間注意力模塊在空間提取特征圖的特征。CBAM既關注通道特征,又關注空間特征,更有利于小目標的識別。

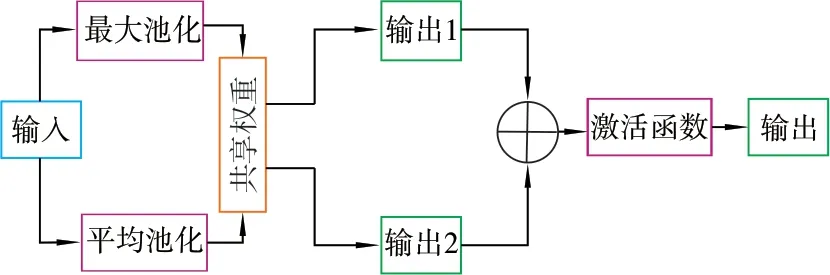

通道注意力模塊結構如圖4所示。輸入特征層分別進行通道全局最大池化和平均池化,然后經過共享權重層,接著對輸出1和輸出2進行加和操作,最后經過Sigmoid激活函數,輸出特征層。該模塊負責對通道特征進行增強,提取通道上的重要特征信息,通過平均池化與最大池化平行計算,使通道上的特征信息更加明顯,該模塊的計算過程如公式(3)所示。

圖3 CBAM結構

圖4 通道注意力模塊結構

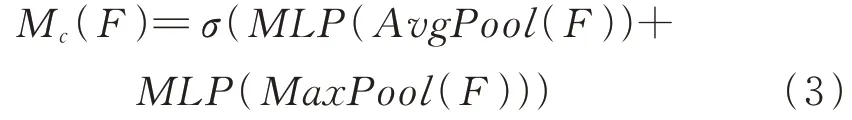

式中:σ為Sigmoid激活函數;MLP為共享權重層;F為輸入特征圖;MaxPool為通道全局最大池化;AvgPool為通道全局平均池化。

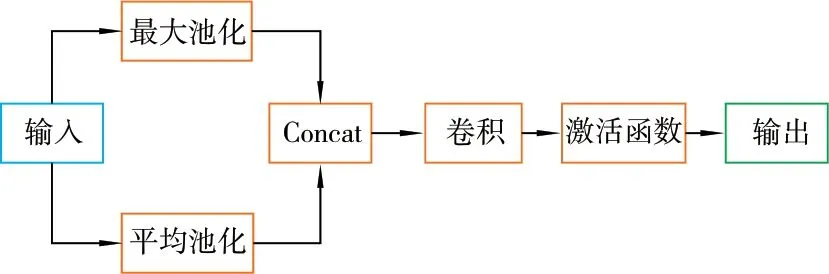

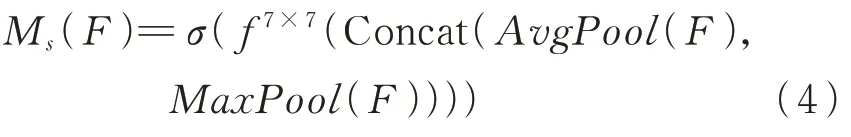

空間注意力模塊結構如圖5所示。輸入特征層分別進行空間全局最大池化和平均池化,然后對輸出進行特征堆疊,接著對堆疊后的特征進行卷積操作,最后經過Sigmoid激活函數,輸出特征層。該模塊負責對空間特征進行增強,提取空間上的重要信息,并通過Concat連接計算,將最大池化與平均池化的信息融合,使空間上的特征信息更加明顯,該模塊的計算過程如公式(4)所示。

圖5 空間注意力模塊結構

式 中:σ為Sigmoid激 活 函 數;F為 輸 入 特 征圖;MaxPool為通道全局最大池化;AvgPool為通道全局平均池化;f7×7為7×7大小的卷積核;Concat為連接操作。

3 數據預處理

3.1 數據集采集

本研究使用的織物疵點數據集來自于浙江湖州某紡織工廠。在工業生產過程中,工業相機價格昂貴,普通工業相機在1萬元起,成本較高。為了實現降低成本以及提高系統在紡織行業的適用性,本系統選擇用普通相機替代工業相機,并達到工業需求標準。因為網絡上公共織物疵點數據集種類繁雜、大小不一、分辨率不同,硬件設備也不同,基于此數據集訓練得出的模型,很難適用于定制化的紡織工廠,所以本研究直接采用工廠數據,并通過擴容得到大容量數據集用于機器學習,以達到對工廠織物疵點的精確識別。調研發現,紡織廠的疵點類型主要有破洞、毛疵、斑點,本研究對這3種疵點進行收集,一共收集到710張不同類型的疵點織物,圖片大小為1 280 pixel×720 pixel。

3.2 數據集擴容

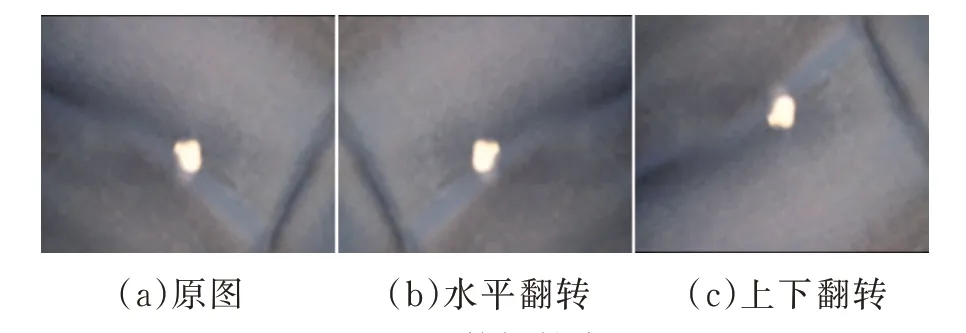

一般而言,神經網絡需要大量的參數,比如AlexNet參數量為60 965 128,但是大量的參數需要更多的樣本數據進行機器學習訓練,才能達到令人滿意的效果。而在實際情況中,真實的樣本數據很難采集。例如在紡織工廠,平均200 m的織物才會出現1個~2個疵點。針對數據量太少的問題,本研究采取水平翻轉、上下翻轉的方法對疵點織物數據集進行擴容處理,以增加數據量。對數據所做的處理如圖6所示。

圖6 數據擴容

3.3 數據標注

本研究使用labelImg標注工具對數據進行標注,標注數據的格式為YOLO格式。本研究將標注的織物疵點分為3類,分別為斑點、毛疵、破洞。將標注好的織物疵點數據集按7∶1的比例分為訓練集、測試集。

4 試驗與分析

4.1 試驗配置

本系列試驗進行機器學習訓練的操作系統為Centos7.9,CPU為Xeon(R)Sliver 4214,GPU為TITAN RTX,顯存為24 GB,充足的顯存為試驗的順利進行提供了保障,并縮短了機器學習的時間。深度學習框架選擇了Pytorch1.7,Cuda為Cuda10.0版本,程序語言為Python3.7。

4.2 網絡訓練

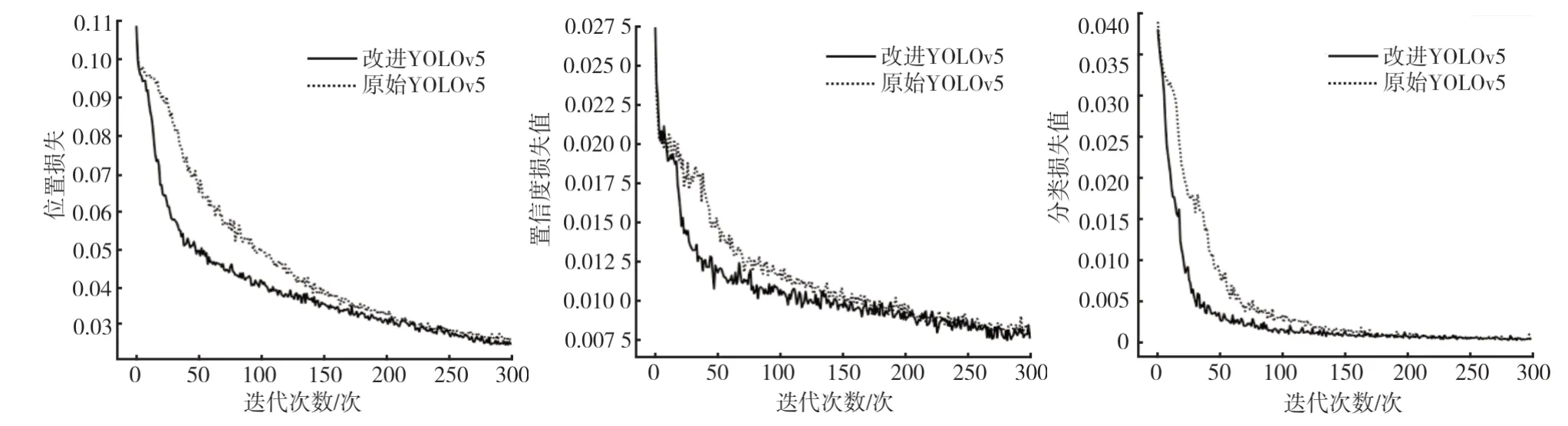

改進前與改進后算法所采用的超參數相同。其中學習率為0.01,動量為0.937,權重衰減為0.000 5,優化器為SGD,批量大小為90,輪數為300。本研究提出的改進YOLOv5與原始YOLOv5算法在訓練時的損失值變化過程如圖7所示。

圖7 損失值變化過程

改進算法的位置損失、置信度損失和分類損失收斂速度都更快并且損失值也更小。對于位置損失和置信度損失,在訓練輪數為300左右時,改進算法的損失值普遍小于原始算法。對于分類損失,在訓練輪數為300左右時,改進算法和原始算法的損失值趨向于相等,但改進算法在訓練輪數為100左右時,損失值逐漸平緩,原始算法在訓練輪數為150左右時,損失值才逐漸平緩。通過對比,本研究提出的算法更易于訓練,并且損失值更小。

4.3 結果與分析

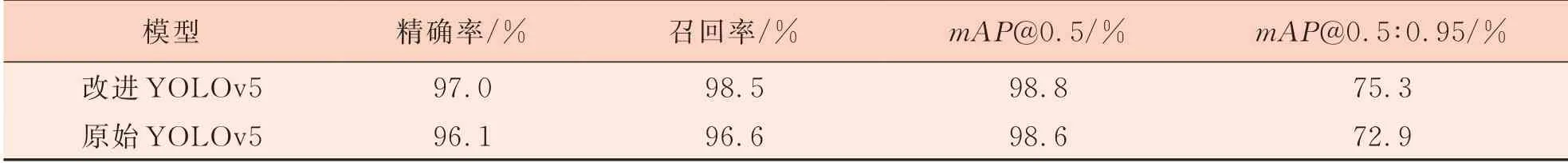

本研究將改進YOLOv5與原始YOLOv5進行比較,在織物訓練集上,兩者的性能參數如表1所示。可以看出,改進算法相比于原始算法精確率提高了0.9個百分點,召回率提高了1.9個百分點,mAP@0.5提高了0.2個百分點,mAP@0.5∶0.95提高了2.4個百分點,這得益于本研究提出的算法融合了更多的特征,并加入了CBAM模塊,增強重要特征的表達能力,進而從訓練數據中學習到更多的特征,表現出比原始算法更好的性能。

表1 訓練結果性能對比

把訓練好的改進YOLOv5模型與原始YOLOv5模型在測試集上進行測試,兩者模型部分圖片測試結果如圖8所示。改進模型對斑點的置信度為0.61,對毛疵的置信度為0.67,對破洞的置信度為0.91;原始模型對斑點沒有檢測出,對毛疵的置信度為0.55,對破洞的置信度為0.86。改進算法相對于原始算法對織物疵點有更高的置信度,識別效果更好。

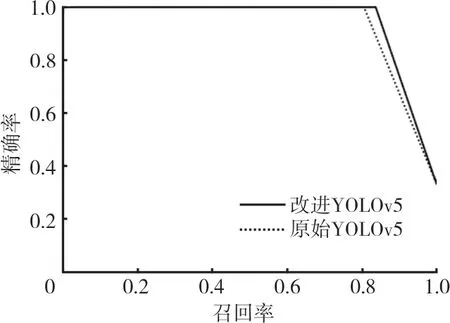

改進YOLOv5模型和原始YOLOv5模型在織物測試集上的PR曲線如圖9所示。

圖9 PR曲線

從PR曲線能夠看出,改進模型相比于原始模型的曲線面積更大,在織物測試集上的識別效果更優。

改進YOLOv5模型和原始YOLOv5模型測試結果性能對比如表2所示。在織物測試集上,改進模型的參數相比于原始模型參數增加了131 682,mAP@0.5提高了2.1個百分點,檢測速度差別不大,在TITAN RTX GPU上,幀數僅相差18幀。本研究提出的算法,在檢測速度比原始算法降低比較小的情況下,對織物疵點檢測的精確度更高。

表2 測試結果性能對比

5 結語

針對現在織物疵點基本靠人工目測,存在人工成本較高、檢測效率低、容易漏檢等問題,本研究基于原始YOLOv5算法對其改進,設計了一種自動化檢測織物疵點的系統。針對原始算法識別精度不高的問題,以及織物數據集疵點比較細微難以識別的問題,改進算法通過融合更多的特征層,在原始算法加入CBAM模塊,從而提高對織物疵點檢測的精度。相比于原始YOLOv5算法,改進YOLOv5算法的mAP@0.5提高了2.1個百分點。本研究算法對于紡織廠的織物疵點能夠更好地識別,從而提高織物良品率以及產業收益。

由于紡織廠織物疵點的數據量少,公共織物疵點數據和紡織廠織物疵點數據不相同,包括織物的疵點、材料以及顏色不一致。因此,本研究的數據集并不全面,后續會增加織物疵點的數據量,優化織物檢測算法,以獲得更大的性能提升。