基于沙漏結(jié)構(gòu)的實(shí)時(shí)語(yǔ)義分割算法

張 政,禹素萍,許武軍,范 紅

(東華大學(xué)信息科學(xué)與技術(shù)學(xué)院,上海 201600)

0 引言

近年來(lái),隨著深度學(xué)習(xí)技術(shù)的快速發(fā)展和GPU 計(jì)算能力的不斷提高,深度學(xué)習(xí)相關(guān)的技術(shù)已經(jīng)應(yīng)用到了很多領(lǐng)域,如圖像分類(lèi)、目標(biāo)檢測(cè)和跟蹤、語(yǔ)義分割等。如今,圖像的語(yǔ)義分割已是計(jì)算機(jī)視覺(jué)領(lǐng)域不可或缺的一部分,并且已經(jīng)在諸多方面體現(xiàn)出其應(yīng)用價(jià)值,如自動(dòng)駕駛、醫(yī)療診斷、娛樂(lè)應(yīng)用等。

圖像的語(yǔ)義分割被定義為對(duì)圖像進(jìn)行逐像素的分類(lèi),具有圖形分類(lèi)和目標(biāo)檢測(cè)兩者的特性。隨著將深度學(xué)習(xí)在圖像語(yǔ)義分割領(lǐng)域的應(yīng)用,越來(lái)越多的算法在近幾年不斷涌現(xiàn),不斷刷新這個(gè)領(lǐng)域的最高精度。這一切的起點(diǎn)便是2015 年Long 等發(fā)布的全卷積神經(jīng)網(wǎng)絡(luò)(FCN),將最后的全連接層替換成卷積層,并且在編碼器和解碼器結(jié)構(gòu)中引入了跳躍連接,為此后的研究標(biāo)定了新的起點(diǎn)。

在語(yǔ)義分割的領(lǐng)域需要考慮兩個(gè)問(wèn)題:分割精度和分割時(shí)間。因此劃分出了兩種不同風(fēng)格的語(yǔ)義分割網(wǎng)絡(luò),第一種是以分割精度為目標(biāo)的Deeplab 系列語(yǔ)義分割網(wǎng)絡(luò),其中最新的Deeplab v3+網(wǎng)絡(luò)在沿用了之前版本中的空洞空間金字塔池化(atrous spatial pyramid pooling,ASPP)結(jié)構(gòu)的基礎(chǔ)上進(jìn)行改進(jìn),添加了解碼器模塊,并且改進(jìn)了Xception 模型,使Deeplab v3+ 在cityscapes 數(shù)據(jù)集上的平均交并比(MIoU)達(dá)到了82.1%。但是算法模型大,推理時(shí)間長(zhǎng)的缺點(diǎn)讓Deeplab v3+在考慮實(shí)時(shí)性的領(lǐng)域難以應(yīng)用。第二種是以犧牲部分精度換取分割時(shí)間的,以提高分割實(shí)時(shí)性的網(wǎng)絡(luò),如ENet,ERFNet,ESPNet等。大多數(shù)實(shí)時(shí)語(yǔ)義分割網(wǎng)絡(luò)使用了Resnet,Mobilenet v2等輕量級(jí)的骨干網(wǎng)絡(luò),采用高效的特征融合方式,做到了語(yǔ)義分割領(lǐng)域中分割實(shí)時(shí)性的突破。

為了解決上述分割精度和分割實(shí)時(shí)性不可兼得的問(wèn)題,本文構(gòu)建了基于沙漏結(jié)構(gòu)的實(shí)時(shí)語(yǔ)義分割網(wǎng)絡(luò),使用沙漏結(jié)構(gòu)搭建骨干網(wǎng)絡(luò),相比倒置殘差結(jié)構(gòu),在僅僅增加少量計(jì)算量的情況下,達(dá)到更高的精度。借鑒了Deeplab v3+中空洞空間金字塔池化模塊并加以改進(jìn),使用深度可分離卷積替換原有的普通卷積,在降低計(jì)算量的同時(shí)保證語(yǔ)義特征的提取,加快推理時(shí)間,提高實(shí)時(shí)性。并且將經(jīng)過(guò)不同空洞卷積所得到的特征圖進(jìn)行逐層特征疊加,進(jìn)一步抑制空洞卷積產(chǎn)生的網(wǎng)格現(xiàn)象,針對(duì)不同維度的特征,使用注意力機(jī)制進(jìn)行引導(dǎo),設(shè)計(jì)了特征融合模塊,提高語(yǔ)義分割的精準(zhǔn)度。

1 模型設(shè)計(jì)

1.1 融合空洞卷積的沙漏模塊

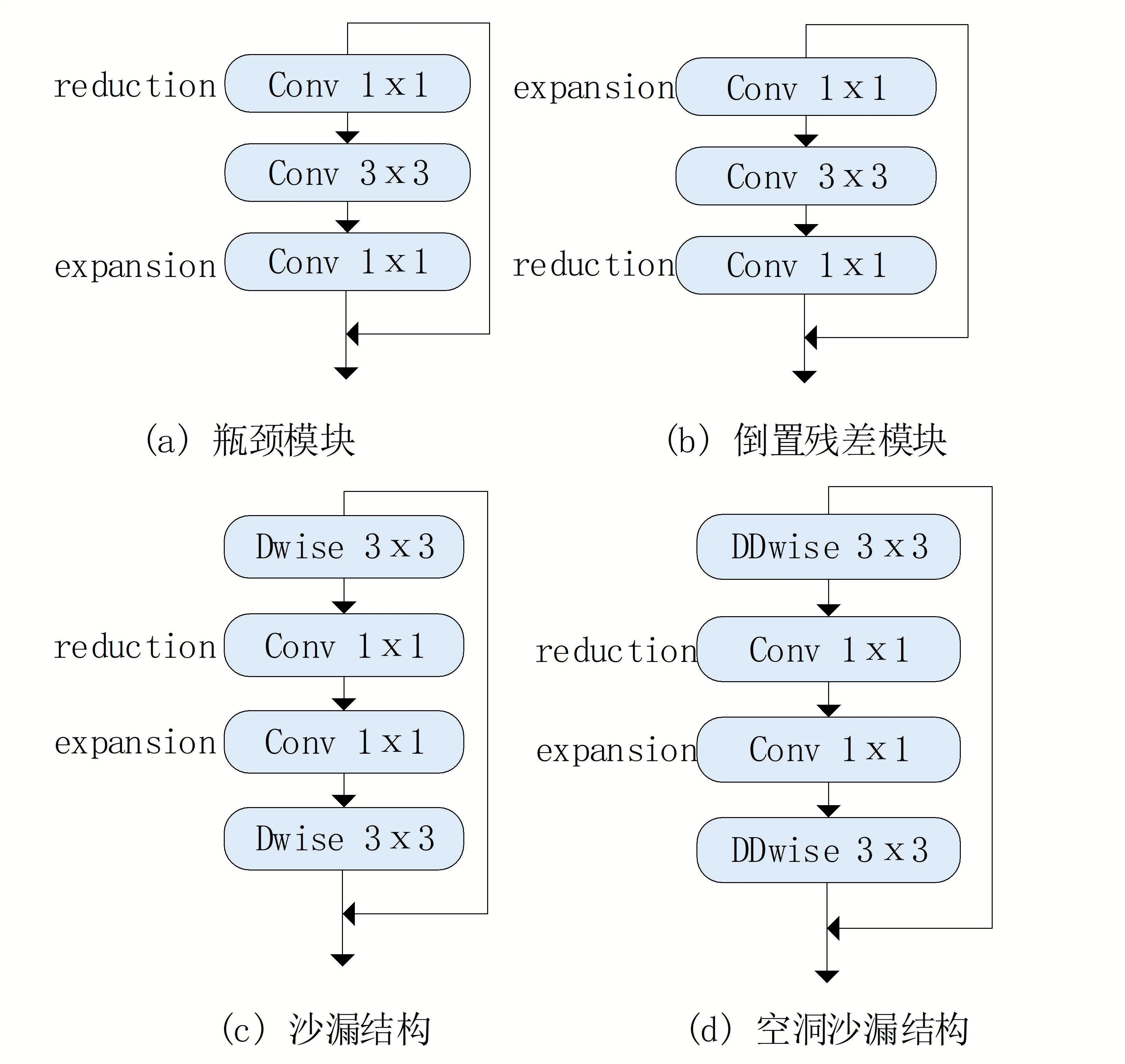

近年來(lái),為了構(gòu)建輕量的骨干網(wǎng)絡(luò),出現(xiàn)了瓶頸結(jié)構(gòu)、倒置殘差結(jié)構(gòu)和本文中的沙漏結(jié)構(gòu)。如圖1(a)所示,瓶頸結(jié)構(gòu)先使用1 × 1 的卷積降維,以減小通道數(shù),再使用普通卷積進(jìn)行特征提取,最后使用1 × 1 的卷積升維。瓶頸結(jié)構(gòu)不僅降低了計(jì)算量,而且加深了網(wǎng)絡(luò)層數(shù),便于訓(xùn)練。如圖1(b)所示,倒置殘差結(jié)構(gòu)是MoblieNet V2提出的,它提高了移動(dòng)網(wǎng)絡(luò)在多類(lèi)型任務(wù)分類(lèi)中的性能。倒置殘差結(jié)構(gòu)中首先使用1 × 1 的卷積進(jìn)行通道數(shù)的上升,用來(lái)獲得更多的圖像特征,之后使用大小為3 × 3 的卷積核提取特征,最后再使用1 × 1 的卷積核進(jìn)行降維處理。由于特征維數(shù)的縮小,容易導(dǎo)致傳播中的梯度混淆,從而削減梯度跨層傳播的能力,進(jìn)而影響訓(xùn)練過(guò)程中的收斂和模型的性能。因此,沙漏結(jié)構(gòu)應(yīng)運(yùn)而生。如圖1(c)所示,與倒置殘差結(jié)構(gòu)相比,沙漏結(jié)構(gòu)在線(xiàn)性高維之間創(chuàng)建跳躍連接,能夠傳輸網(wǎng)絡(luò)結(jié)構(gòu)中的更多信息,并且將深度卷積應(yīng)用在高維空間中,以學(xué)習(xí)更具表現(xiàn)力的特征。

基于對(duì)上述模塊的研究,本文構(gòu)建了融合空洞卷積的沙漏模塊,作為骨干網(wǎng)絡(luò)提取特征。如圖1(d)所示,將原始沙漏結(jié)構(gòu)中的深度卷積,修改為空洞深度卷積(DDwise)用來(lái)拓展感受野,進(jìn)而獲取更多的上下文信息。

圖1 輕量級(jí)網(wǎng)絡(luò)結(jié)構(gòu)

1.2 改進(jìn)的空洞空間金字塔池化模塊

空洞空間金字塔池化模塊利用不同空洞率的空洞卷積對(duì)骨干網(wǎng)絡(luò)輸出的特征圖進(jìn)行并行的多尺度特征提取,并將提取出的特征圖使用堆疊的方式進(jìn)行融合。

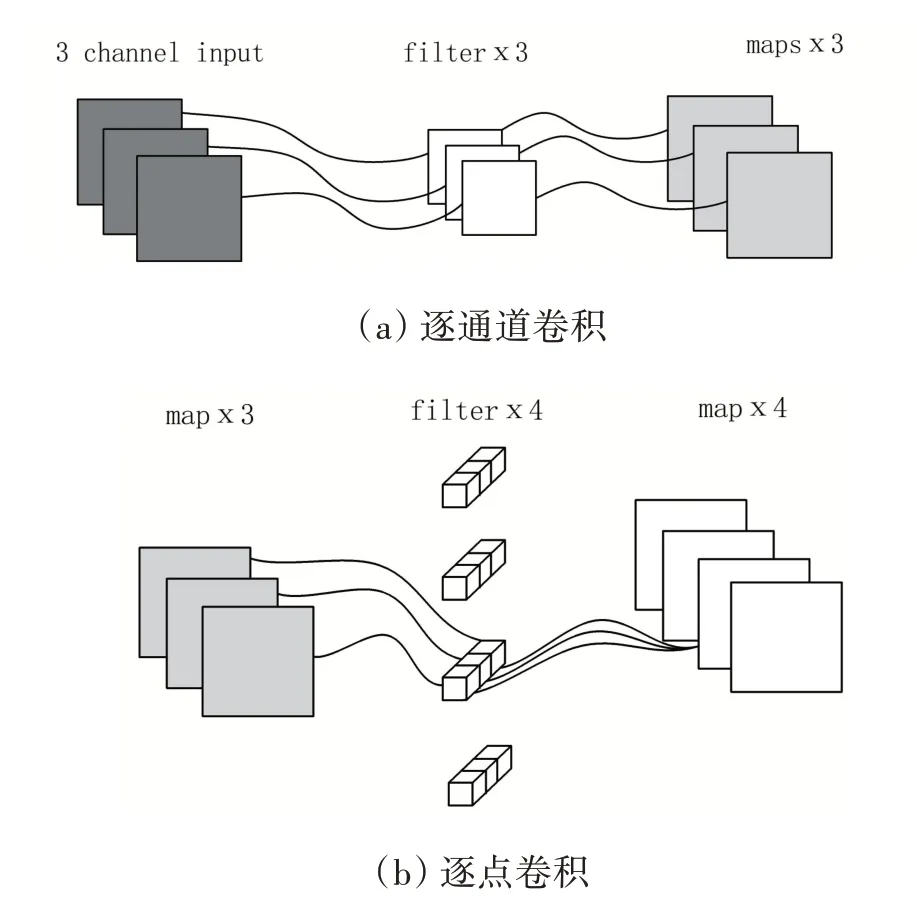

為了減少算法網(wǎng)絡(luò)的參數(shù),提高網(wǎng)絡(luò)的實(shí)時(shí)性,并且保證模型精度。本文在ASPP 模塊中引入了深度可分離卷積,用來(lái)替換原有的普通卷積。如圖2所示,深度可分離卷積可以分為兩部分:逐通道卷積、逐點(diǎn)卷積。如圖2(a)所示,首先逐通道卷積在二維平面上進(jìn)行,卷積核的數(shù)量為輸入的特征的通道數(shù)。如圖2(b)所示,逐點(diǎn)卷積核的大小是1 × 1 ×,表示輸入的通道數(shù),逐點(diǎn)卷積通過(guò)將輸入的特征圖在通道方向上進(jìn)行加權(quán)組合,得到輸出的特征圖。

圖2 深度可分離卷積

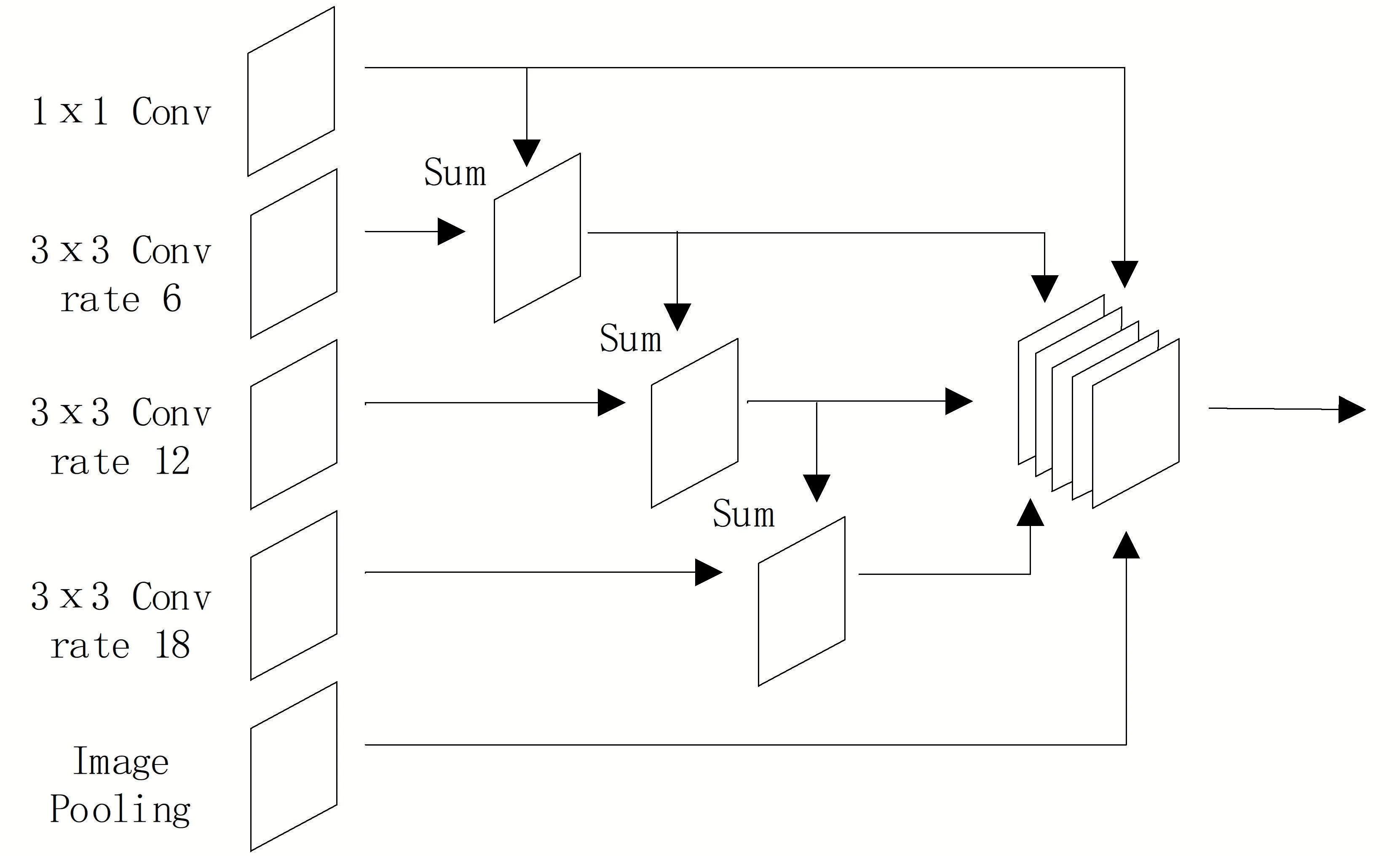

雖然ASPP 模塊為特征提取網(wǎng)絡(luò)提供了較大的感受野,但同時(shí)疊加了由不同空洞率而得到的特征圖,導(dǎo)致出現(xiàn)網(wǎng)格現(xiàn)象。為解決這一問(wèn)題,本文借鑒了ESPNet 中分層特征融合的思想,在所有特征圖進(jìn)行融合之前,將使用不同空洞率所得到的特征圖進(jìn)行逐元素相加。這個(gè)方法不僅簡(jiǎn)單有效,而且不會(huì)增加模型的復(fù)雜度。

改進(jìn)后的ASPP 模塊如圖3 所示,將ASPP模塊中卷積后的特征圖相加有利于在同一維度下增加其中的信息量,提高最終的分割精度。

圖3 改進(jìn)的ASPP模塊

1.3 特征融合模塊

在實(shí)時(shí)語(yǔ)義分割算法中,通常使用以下方法來(lái)提高模型的前向傳播速度:①通過(guò)裁剪輸入圖像的尺寸,降低計(jì)算量;②縮短網(wǎng)絡(luò)的通道數(shù)來(lái)縮短前向推理時(shí)間,同時(shí)也會(huì)丟失部分特征信息。這些方法有效,可以顯著提升網(wǎng)絡(luò)模型的實(shí)時(shí)性,但同時(shí)也會(huì)丟失部分空間細(xì)節(jié),物體邊界分割不連貫,甚至產(chǎn)生誤分割現(xiàn)象。

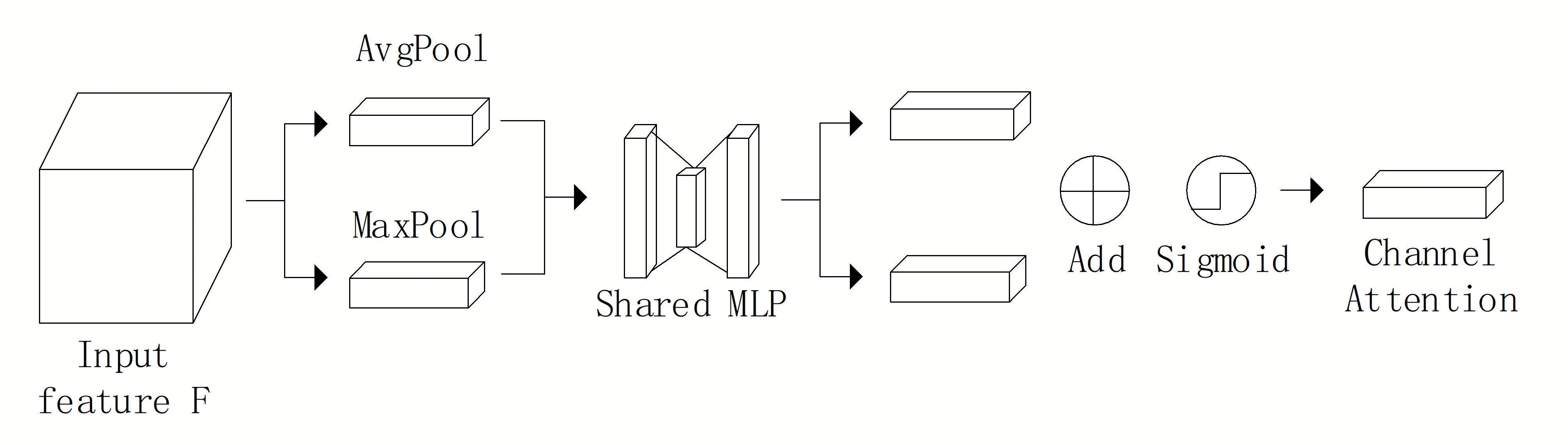

為了解決上述問(wèn)題,研究人員通常使用跳躍連接,融合骨干網(wǎng)絡(luò)中不同層次的特征圖,來(lái)補(bǔ)充下采樣過(guò)程中空間細(xì)節(jié)的損失。但是這種方法也存在一定的缺陷,通過(guò)骨干網(wǎng)絡(luò)提取出來(lái)的高維度特征圖丟失的空間細(xì)節(jié)信息,并不能夠直接通過(guò)融合低維度特征的方式直接恢復(fù)。因此本文使用了特征融合模塊對(duì)低維度層特征和高維度特征進(jìn)行融合,進(jìn)一步補(bǔ)充因?yàn)槎啻蜗虏蓸訉?dǎo)致的空間信息損失。本文中特征融合模塊的設(shè)計(jì)借鑒了CBAM注意力模型中的通道注意力機(jī)制,如圖4所示。

圖4 通道注意力模塊

首先對(duì)輸入的特征F(××)進(jìn)行全局最大池化和全局平均池化,得到兩個(gè)1 × 1 ×的特征圖。接著對(duì)得到的兩個(gè)特征圖分別使用兩個(gè)卷積層提取特征和一層激活函數(shù),第一層使用1 × 1 的卷積特征提取,同時(shí)進(jìn)行降維,緊接著的激活函數(shù)是Relu,第二個(gè)卷積層使用1 ×1的卷積進(jìn)行升維。最后將輸出的兩個(gè)特征圖進(jìn)行相加,經(jīng)過(guò)Sigmoid 激活函數(shù)后,生成最終的通道注意力特征,即每個(gè)通道對(duì)應(yīng)特征值的權(quán)重。

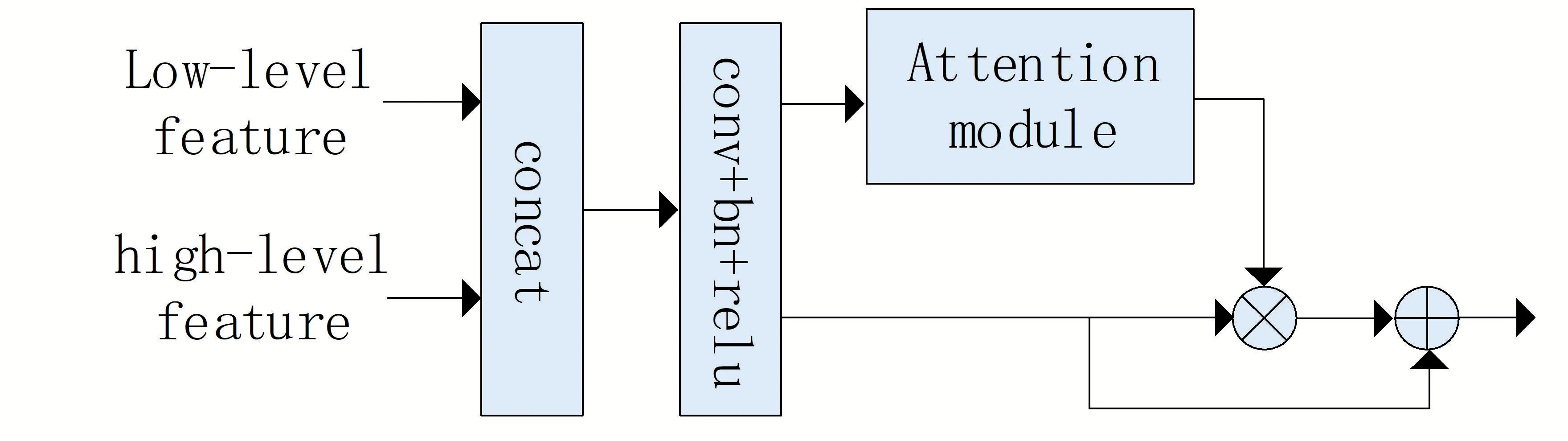

特征融合模塊如圖5 所示,其中Attention module 為上一節(jié)中的通道注意力模塊。首先將低維度特征圖和高維度特征圖進(jìn)行疊加,再使1 × 1 的卷積進(jìn)行降維,接著將輸出的特征圖傳入通道注意力機(jī)制模塊,將得到的通道權(quán)重和第一步得到的特征圖進(jìn)行相乘,最后將相乘后的特征圖和降維后的特征圖相加,至此特征融合結(jié)束。

圖5 特征融合模塊

1.4 網(wǎng)絡(luò)結(jié)構(gòu)

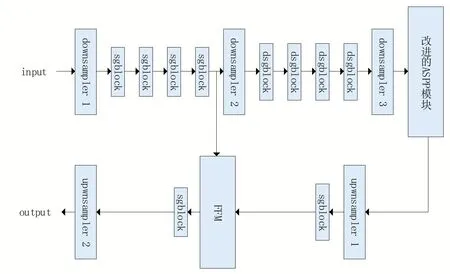

本文的網(wǎng)絡(luò)結(jié)構(gòu)是非對(duì)稱(chēng)的編解碼器結(jié)構(gòu),即編碼器模型遠(yuǎn)大于解碼器模型。編碼器由下采樣模塊、普通沙漏模塊、空洞沙漏模塊、改進(jìn)的ASPP 模塊組成,解碼器由上采樣模塊和普通的沙漏模塊組成。在分割任務(wù)中,輸入的圖像一般比較大,其中包含了豐富的信息。此時(shí)優(yōu)先使用下采樣模塊可以有效縮小圖片的尺寸,縮短后續(xù)的處理時(shí)間。之后使用沙漏模塊提取語(yǔ)義特征,并在更深的維度使用空洞沙漏模塊,增大感受野,獲取更多的上下文信息。由于在下采樣過(guò)程中特征圖變小,我們需要圖像恢復(fù)到輸入圖像的尺寸用來(lái)計(jì)算最終的精確度,進(jìn)而引入了上采樣模塊。通常的上采樣方式有以下幾種:雙線(xiàn)性插值,反卷積,反池化,本文采用反卷積構(gòu)建上采樣模塊進(jìn)行上采樣。

本文的網(wǎng)絡(luò)結(jié)構(gòu)如圖6 所示,其中downsampler 表示的下采樣模塊,借鑒的是ENet 中的下采樣模塊,采用雙路分支,主分支使用卷積提取特征,拓展分支使用最大池化提取特征,最后在拼接后使用批歸一化和Relu 激活函數(shù),輸出的特征圖是輸入原圖尺寸的1/2。sgblock 即上文所述的沙漏模塊,dsgblock 即融合了空洞卷積的沙漏模塊,ASPP 模塊采用的是改進(jìn)后的ASPP 模塊,上采樣模塊使用的是反卷積,批歸一化和Relu 激活函數(shù)的組合,upsampler1 采用了四倍上采樣后使用沙漏模塊細(xì)化特征,再和低維度的特征圖進(jìn)行特征融合,F(xiàn)FM 模塊即上文所述的特征融合模塊,upsampler2使用的是雙倍上采樣,恢復(fù)到輸入原圖的大小。

圖6 整體網(wǎng)絡(luò)結(jié)構(gòu)

2 實(shí)驗(yàn)及分析

2.1 語(yǔ)義分割數(shù)據(jù)集介紹

本文使用的是CamVid(cambridge-driving labeled video database)數(shù)據(jù)集,是由劍橋大學(xué)發(fā)布的像素級(jí)別標(biāo)注的公開(kāi)數(shù)據(jù)集,總共有11 個(gè)語(yǔ)義類(lèi)別,主要應(yīng)用于語(yǔ)義分割領(lǐng)域,尤其是道路交通的分割。在CamVid 中總共有701 張城市的街景圖像,訓(xùn)練集中的圖片有367張,驗(yàn)證集中的圖片有101 張,剩下的233 張圖片作為測(cè)試集使用,部分標(biāo)注圖片如圖7所示。

圖7 CamVid數(shù)據(jù)集

2.2 評(píng)價(jià)標(biāo)準(zhǔn)

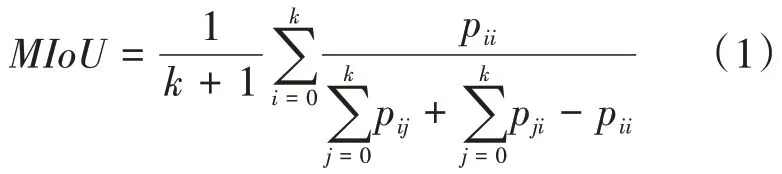

本文使用的準(zhǔn)確度評(píng)估指標(biāo)是語(yǔ)義分割中的平均交并比(mean Intersection over Union,MIoU),推理速度評(píng)估指標(biāo)是幀速率(frames per second,F(xiàn)PS)。

平均交并比():計(jì)算的是真實(shí)值和預(yù)測(cè)值兩個(gè)集合之間交集和并集的比值,是圖像語(yǔ)義分割中評(píng)價(jià)準(zhǔn)確度的常用指標(biāo)。計(jì)算公式表示為:

其中+1表示的是類(lèi)別的總數(shù),p表示的是實(shí)際類(lèi)別是,并且正確預(yù)測(cè)是類(lèi)別的像素的數(shù)目,p表示的是實(shí)際類(lèi)別是,被判斷為類(lèi)別的像素?cái)?shù)目。

幀速率():是指每秒鐘刷新圖片的次數(shù)。計(jì)算公式表示為:

指標(biāo)越高,則表示算法的實(shí)時(shí)性越好,主觀感受越流暢。

2.3 實(shí)驗(yàn)環(huán)境和參數(shù)設(shè)置

本文的模型使用的硬件平臺(tái)是Intel i7-11700,內(nèi)存為64 G,使用的顯卡為RTX 2080Ti,軟件環(huán)境是Ubuntu 18.04 操作系統(tǒng),使用的深度學(xué)習(xí)框架是Pytorch。

訓(xùn)練時(shí)使用的批量大小為10,使用Adam優(yōu)化方法,初始的學(xué)習(xí)率是0.0005,L2 正則化系數(shù)是0.0002,學(xué)習(xí)率衰減策略為固定步長(zhǎng)衰減,步長(zhǎng)為90,衰減率為0.1。

2.4 實(shí)驗(yàn)結(jié)果與分析

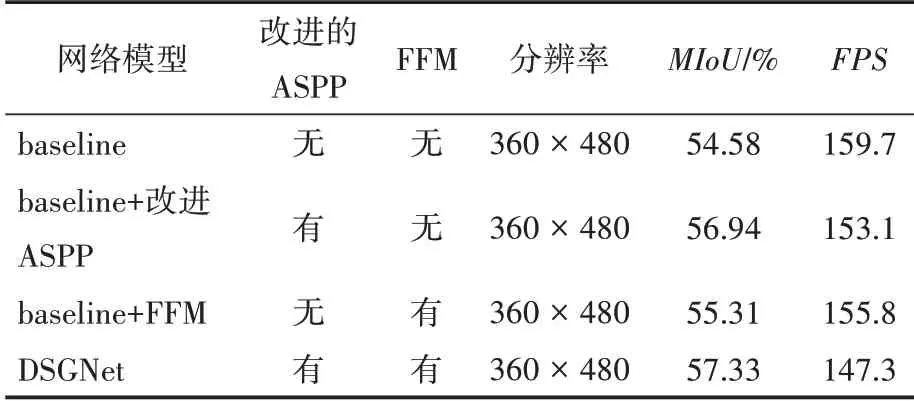

本文對(duì)改進(jìn)的ASPP模塊和FFM 模塊進(jìn)行了消融實(shí)驗(yàn),來(lái)驗(yàn)證兩個(gè)模塊對(duì)最終結(jié)果的影響,在CamVid數(shù)據(jù)集上的結(jié)果如表1所示。

表1 消融實(shí)驗(yàn)結(jié)果

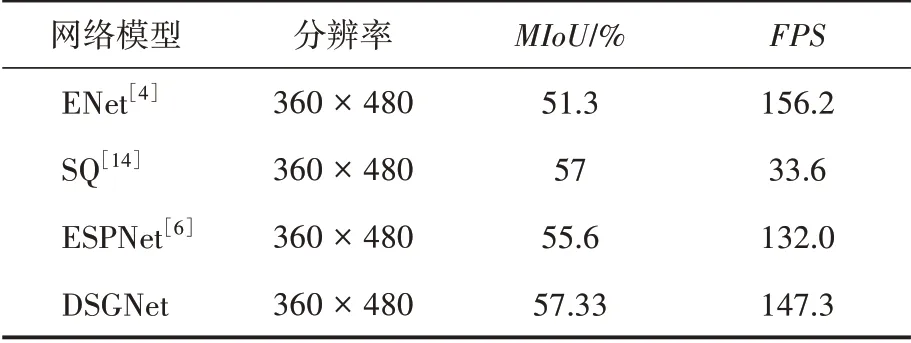

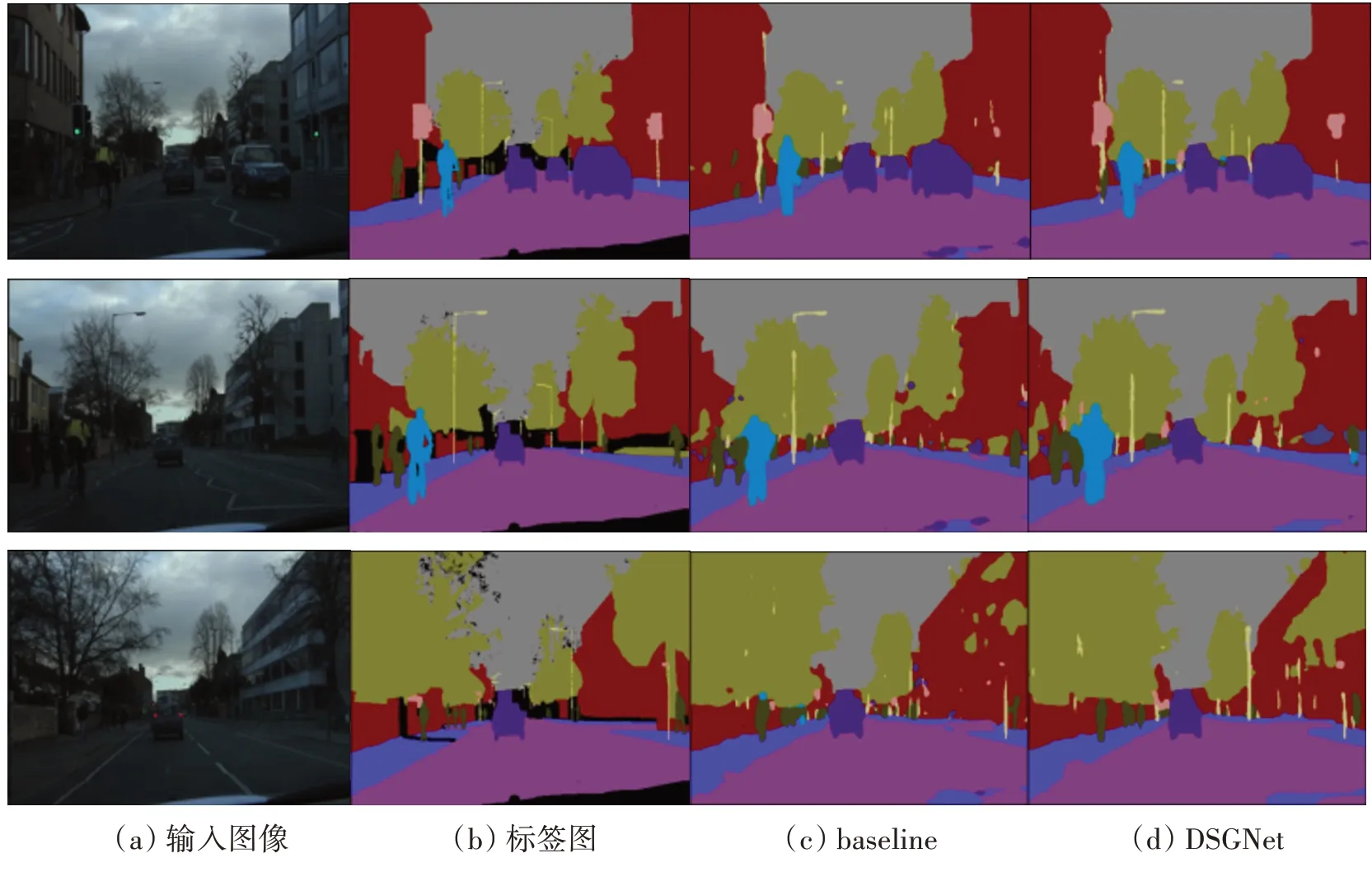

分割結(jié)果如圖8所示,與其他語(yǔ)義分割算法對(duì)比見(jiàn)表2。

表2 本文算法與其他語(yǔ)義分割算法在CamVid數(shù)據(jù)集的對(duì)比結(jié)果

將本文中使用dsgblock構(gòu)建的骨干網(wǎng)絡(luò)定義為baseline,將添加改進(jìn)ASPP 模塊和特征融合模塊后的網(wǎng)絡(luò)定義為DSGNet。由表1 所知,本文基于沙漏結(jié)構(gòu)創(chuàng)建的語(yǔ)義分割網(wǎng)絡(luò)在CamVid數(shù)據(jù)集上以159.7FPS 的速度達(dá)到了54.58%MIoU的精確度。在只加入改進(jìn)的ASPP 模塊后平均交并比提升了2.33 個(gè)百分點(diǎn),同時(shí)FPS 下降到153.1。在只使用特征融合模塊FFM 的情況下,比原始網(wǎng)絡(luò)的MioU 提升了0.73 個(gè)百分點(diǎn),同時(shí)FPS下降了3.9。最終,將改進(jìn)的ASPP模塊和特征融合模塊都加入原始網(wǎng)絡(luò)后,MIoU 有顯著提升,達(dá)到了57.33%,同時(shí)FPS也達(dá)到了147.3。

圖8 展示了CamVid 數(shù)據(jù)集中原始的輸入圖像和標(biāo)簽圖,baseline 對(duì)于原圖的分割存在以下幾個(gè)問(wèn)題:①對(duì)于建筑物和樹(shù)相連的部分存在誤分割現(xiàn)象;②對(duì)于小物體的分割效果不夠理想;③對(duì)于物體的邊緣分割效果不夠精細(xì)。在加入改進(jìn)的ASPP 模塊后,提升了模型整體的感受野,能夠更多地獲取上下文信息,特征融合模塊也可以更好地將高低維度的特征信息進(jìn)行融合。因此DSGNet 相對(duì)于baseline,建筑物和樹(shù)木之間的誤分割現(xiàn)象明顯減少,路面和建筑物的邊緣能夠較好地還原,細(xì)小物體的分割效果明顯增強(qiáng),如廣告牌,電線(xiàn)桿等。

圖8 分割效果可視化對(duì)比

由表2可知,本文提出的基于沙漏結(jié)構(gòu)的語(yǔ)義分割網(wǎng)絡(luò)與其他語(yǔ)義分割網(wǎng)絡(luò)相比各有優(yōu)劣。與表中實(shí)時(shí)性較高的ENet 相比,本文網(wǎng)絡(luò)的FPS 指標(biāo)略低,但是平均交并比顯著高于ENet。和SQ 相比,在平均交并比相似的情況下,實(shí)時(shí)性顯著高于SQ。本文網(wǎng)絡(luò)在CamVid數(shù)據(jù)集上的表現(xiàn),均略高于ESPNet。

3 結(jié)語(yǔ)

為解決語(yǔ)義分割中實(shí)時(shí)性和精確度不能兼顧的問(wèn)題,本文提出了基于沙漏結(jié)構(gòu)的實(shí)時(shí)語(yǔ)義分割網(wǎng)絡(luò)。將深度可分離卷積和ASPP 模塊結(jié)合可降低參數(shù)量,同時(shí)提高了推理速度。針對(duì)ASPP 模塊中空洞卷積產(chǎn)生網(wǎng)格現(xiàn)象的問(wèn)題,將不同空洞率提取出的特征圖進(jìn)行有效堆疊,從而抑制網(wǎng)格現(xiàn)象。為了將不同維度的特征圖進(jìn)行有效的融合,基于注意力機(jī)制提出特征融合模塊。實(shí)驗(yàn)結(jié)果表明,改進(jìn)的ASPP 模塊和特征融合模塊在基于沙漏結(jié)構(gòu)的語(yǔ)義分割網(wǎng)絡(luò)中有效地減少了誤分割的現(xiàn)象。

由最終分割結(jié)果可知,本文提出的算法仍然存在部分場(chǎng)景中邊緣分割不夠精細(xì)的問(wèn)題。針對(duì)上述問(wèn)題,如何設(shè)計(jì)更加高效的骨干網(wǎng)絡(luò),如何精確提取邊緣語(yǔ)義信息將是今后研究的重點(diǎn)。