虛擬運動目標人機交互方法設計與仿真

龍 年,劉智惠

(湖北工業大學工程技術學院,湖北 武漢 430000)

1 引言

目前,人機交互技術已得到全面發展,但是仍存在一些技術方面問題未得到有效解決。傳統人機交互技術主要通過鍵盤等機械化設備完成。隨著智能傳感和人機交互技術的日益成熟,使其被廣泛應用于視頻以及語言信息交換中,但是部分人機交互只能通過感知技術完成,這樣會導致用戶體驗感下降,無法高精度實現人機交互。

為更好解決上述問題,相關專家給出了一些較好的研究成果,例如張凱樂等人通過文本對話和體感交互兩種技術實現用戶情緒調節,同時還通過融入情緒因素的Sep 2 Sep模型完成人機交互。張興旺等人分析總結南海海圖可視化的人機交互技術理論,構建了一種可視化人機交互模型和體系結構,同時針對相應的應用模式進行分析和研究。但是以上傳統方法忽略了對多體感特征的融合,無法高精度識別和跟蹤目標,導致虛擬手型逼真度偏低。

為解決傳統方法的弊端,結合多體感融合技術,提出一種基于多體感融合的虛擬運動目標人機交互方法。仿真結果表明,所提方法能夠獲取逼近的虛擬手型,同時還能精準跟蹤和識別目標,獲取更加滿意的人機交互結果。

2 基于多體感融合的虛擬運動目標人機交互

2.1 虛擬運動目標識別和跟蹤

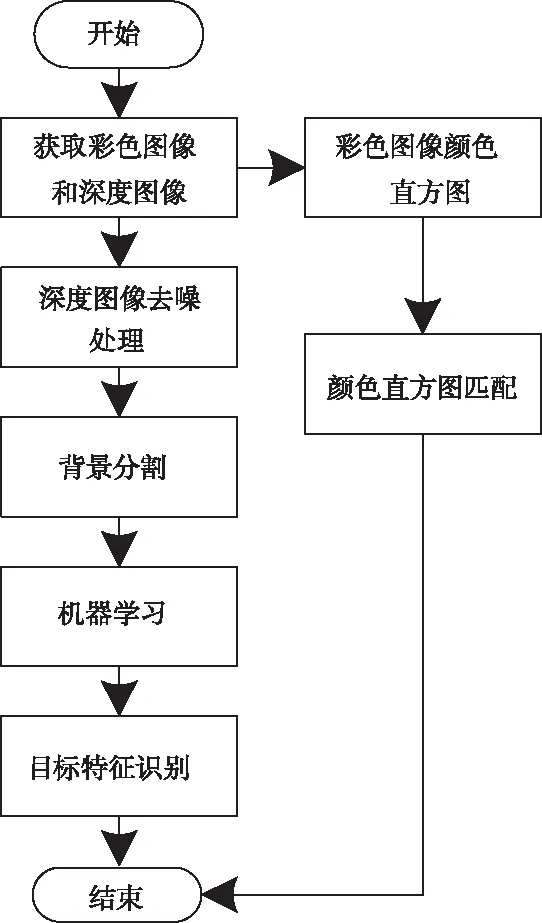

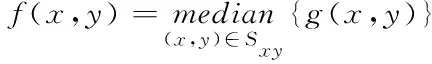

采用Kinect跟蹤識別虛擬運動目標時,需優先解決目標識別問題,但是由于Kinect并不具備識別功能,因此需要借助顏色直方圖進行目標識別;同時Kinect也無法直接對人體進行骨骼跟蹤,骨骼數據是在深度圖像的基礎上經過去噪以及分割等相關技術獲取的。其中,目標識別和跟蹤主要包括虛擬目標的身份識別和目標人員的位置跟蹤,具體的操作步驟如圖1所示。

圖1 虛擬運動目標識別和跟蹤流程圖

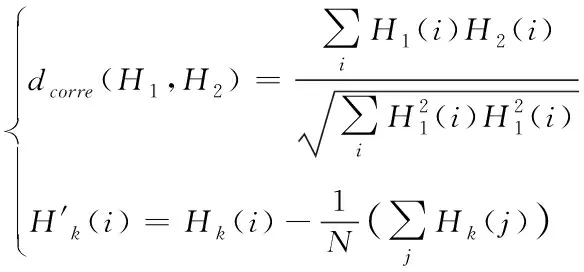

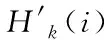

在實際工作的過程中,會同時出現多個虛擬運動目標,為了獲取更好的識別結果,以下主要通過基于圖像信息的人員識別方法進行分析研究,采用Kinect對研究區域內的彩色圖像進行拍攝,同時通過顏色直方圖匹配結果精準識別研究區域內的虛擬目標。其中,顏色直方圖主要用來描述各個色彩在整個圖像中所占的百分比。顏色直方圖匹配對應的計算式為

(1)

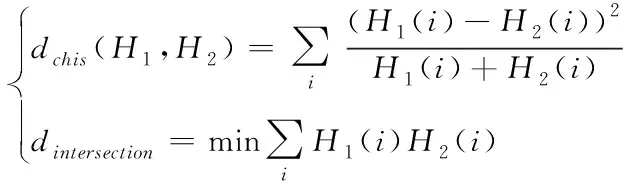

卡方匹配和相交匹配對應的計算公式為

(2)

式中,d

(H

,H

)代表卡方;d

代表相交。通過式(1)和式(2)可知,相關和相交匹配算法的計算結果取值越大,則說明直方圖匹配程度越高,其中完全匹配值為1;卡方匹配算法的計算結果取值越小,也可以證明直方圖的匹配程度越高,完全匹配時取值為0。

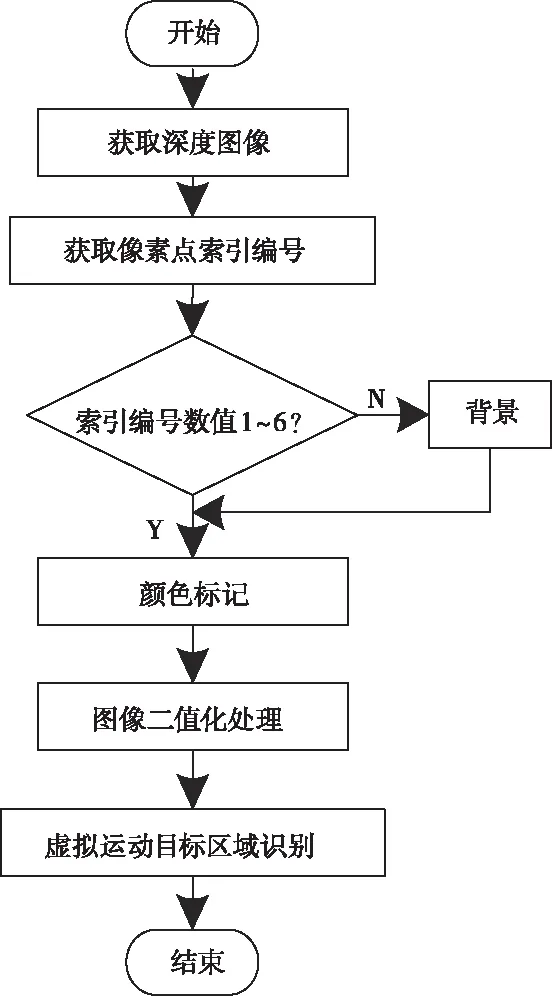

為剔除圖像中含有的全部噪聲,采用中值濾波方法進行去噪處理。其中,中值濾波公式為

(3)

式中,f

(x

,y

)代表濾波輸出值;S

代表圖像中全部的像素點數量;g

(x

,y

)代表像素的灰度值。繪制虛擬目標的結構圖像,需要優先將虛擬運動目標在深度圖像中分離出來,以下主要使用基于用戶索引號的目標檢測和背景分割方法,具體的操作流程如圖2所示。

圖2 虛擬運動目標檢測和背景分割操作流程

1)優先利用Kinect獲取各個研究場景的深度圖像;

2)通過深度圖像提取像素點的深度值和用戶索引編號。

3)通過步驟2)獲取的索引編號標記虛擬運動目標。

4)二值化處理采集圖像,同時設定研究區域內的像素取值為255,剩余節點的像素取值均設定為0,進而將目標從背景中分離出來。

在進行虛擬運動識別前期,需要明確虛擬目標運動的起點和結束點。其中虛擬運動目標的起點和結束點的主要判定依據為手心球半徑,通過SDK即可獲取手心球半徑,同時設定閾值的取值為30 mm。當手心半球半徑高于閾值時,則說明目標的手掌處于張開狀態;反之,則處于閉合狀態。如果手心球半徑從低于30 mm逐漸增加到30 mm,則說明該點起點,當Leap Motion再次捕捉到閾值小于30 mm,則停止識別。

虛擬運動目標識別和跟蹤定位的實現就是在已有的目標輪廓圖像中準確識別出各個結構,同時確定關節點的具體坐標。上述操作過程主要是通過機器學習技術完成的。優先訓練決策樹樣本,獲取基于決策樹的分類模型,利用機器學習對深度圖像像素點的特征值分類和評估,進而獲取對應的部位結構。為有效消除虛擬運動目標自身與外部因素對數據噪聲的影響,本研究主要通過Kalman濾波算法對數據得到最優值和測量值進行迭代消除,有效濾除數據中的噪聲。

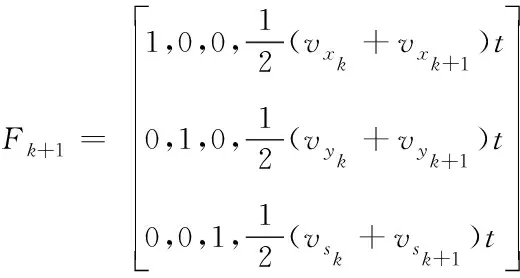

Kalman濾波算法是在時間的動態系統上完成濾波操作的,因此需要在算法中加入離散控制系統,計算公式如式(4)所示

x

+1=F

+1x

+B

+1u

+1(4)

式中,x

+1代表在k

+1時刻系統的運行狀態;x

代表在k

時刻系統的運行狀態;F

+1代表作用在x

上的變換矩陣;B

+1代表系統的控制參數;u

+1代表控制矩陣。在k

+1時刻,系統中的測量值需要滿足以下條件Z

+1=H

+1x

+1+v

+1(5)

式中,H

+1代表在x

+1時刻的狀態投射到測量空間的測量矩陣;v

+1代表測量噪聲。通過式(4)能夠推導出在k

+1時刻的狀態,具體計算式為x

(k

+1|k

)=F

+1x

(k

|k

)+B

+1u

(k

+1)(6)

式中,x

(k

+1|k

)代表利用系統在k

時刻的狀態值預測k

+1時刻的最優值;x

(k

|k

)代表系統在k

時刻的最優值;u

(k

+1)代表在k

+1時刻系統的測量值,設定u

(k

+1)的取值為0,則式(6)能夠簡化為x

(k

+1|k

)=F

+1x

(k

|k

)(7)

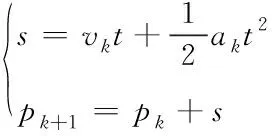

在Kalman濾波預測階段,主要采用leap SDK獲取對下一時間段的位置和位姿信息進行預測。設定在k

時刻,虛擬運動目標的中心坐標為p

,結合運動定律能夠獲取以下形式的計算式

(8)

式中,v

代表虛擬運動目標的運行速度;a

代表加速度;p

+1代表在時間t

時刻的坐標位置,s

代表虛擬目標運動變化規律,則有

(9)

根據計算獲取在k

+1時刻的預測值,其中k

+1時刻的測量值是通過傳感器得到的,則在k

+1時刻的最優值為x

(k

+1|k

+1)=x

(k

+1|k

)+g

(k

+1)Z

(k

+1-h

(k

+1|k

))(10)

基于上述分析,通過深度圖像提取虛擬運動目標結構信息,融合全部提取的結構信息,跟蹤識別人機交互目標。

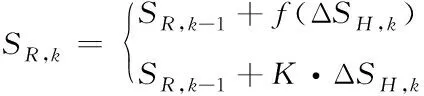

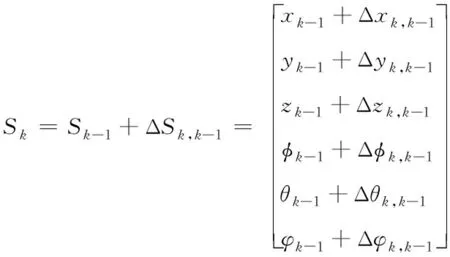

2.2 基于多體感融合的虛擬運動目標人機交互

虛擬運動目標位姿和機械臂末端的轉換是實現人機交互的重要環節,轉換的主要目的為確保目標和機械臂兩者能夠更好地在笛卡爾空間進行映射,同時兩者之間存在密切關聯。由于虛擬運動目標的機體結構和感知系統具有一定的局限性,如果操作員的位置保持不變,在運動空間S

內的任意一點均能夠和目標進行關聯。為了更好實現人機交互,在控制機械臂執行任務的過程中,需要將虛擬運動目標和機械臂末端的運動方向和速度保持一致。其中,兩者之間的空間映射能夠定義為

(11)

上式中,S

和S

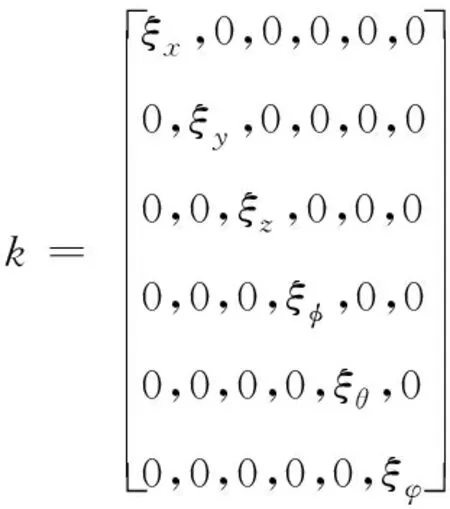

代表位姿矩陣;k

代表映射比例矩陣,則有

(12)

式中,S

代表在k

時刻的位姿變化;S

-1代表在k

-1時刻的位姿變化;ΔS

,-1代表k

-1時刻到k

時刻的位姿變化情況。不同的映射比例矩陣k

會造成虛擬運動目標和運動空間之間的映射不同,形成不一樣的映射結果。為了更好實現研究目標和機械臂末端兩者之間的映射,需要結合實際需求和相關約束條件進行映射比例矩陣設計。由于在研究區域內各個虛擬運動目標是獨立的,則k

有

(13)

式中,ξ

代表線性參數。由于操作人員在進行機器人人機交互的過程中,慣性測量單元會影響目標的姿態變換。為了更好解決上述問題,設定ξ

、ξ

和ξ

三者的取值均小于1。同時慣性測量單元存在噪聲,為了避免對人機交互結果產生影響,以下主要通過靜態閾值過濾進行濾波處理,具體的計算式為

(14)

式中,δ

和δ

代表機械手臂自然轉動最小值和最大值。在上述分析的基礎上,全面分析阻尼理論對數據穩定性的影響,根據機器人和虛擬運動目標兩者之間的結構特征,組建兩者間的笛卡爾映射關系,有效實現虛擬運動目標人機交互。

3 仿真研究

為驗證所提基于多體感融合的虛擬運動目標人機交互方法的有效性,分別從三個方面進行測試分析,具體實驗操作過程如下所示:

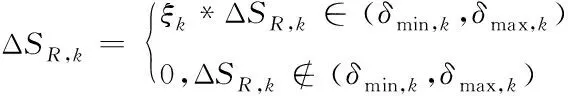

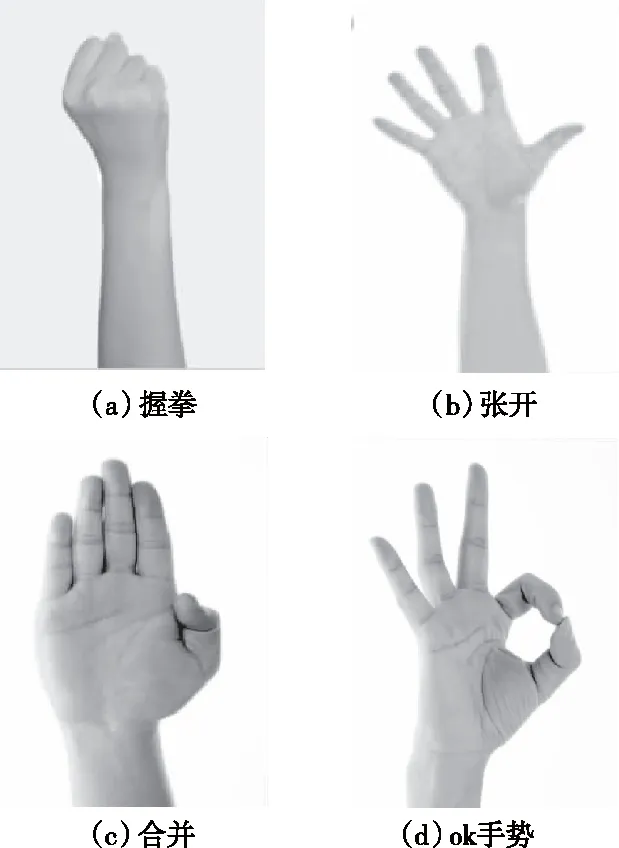

1)虛擬手勢測試

為了驗證所提方法的應用有效性,選取虛擬手作為測試對象。優先測試手部關節旋轉的正確性,其中真實測試對象如圖3所示,獲取的實驗結果如圖4所示。

圖3 測試對象

圖4 虛擬手勢仿真結果

分析圖4的實驗結果可知,獲取的虛擬手勢仿真結果和真實結果更加接近,同時整個手型的變化也更加自然,同時滿足基本變化規律,全面證實了所提方法的優越性。

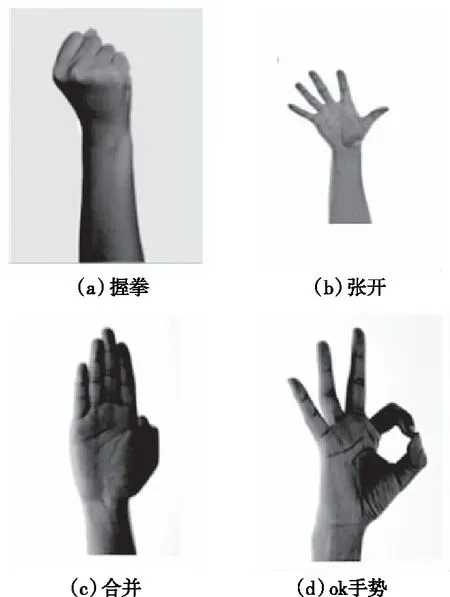

2)交互動作識別性能測試

為了測試用戶對各個類型手臂動作的識別性能,實驗選取20名學生參與測試,要求全部參與者做7個不同的動作各10次,共計總樣本數量1400次。以下詳細給出所提方法的準確識別次數和識別率變化情況,具體實驗結果如表1所示。

表1 交互動作識別結果測試

分析表1中的實驗數據可知,所提方法對于各個類型的交互動作都具有較高的識別率,主要是因為所提方法在實際研究的過程中,對虛擬運動目標進行跟蹤識別,全面增強了交互動作識別結果的準確性。

3)標記跟蹤能力

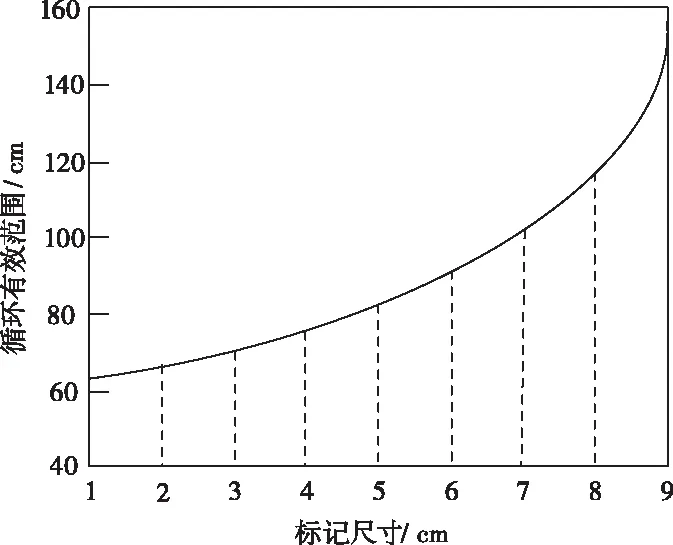

為了驗證所提方法的標記跟蹤能力,重點分析標記尺寸和循環有效范圍兩者之間的關系,具體實驗結果如圖5所示。

圖5 循環有效范圍和標記尺寸兩者之間的關系分析

分析圖5中的實驗數據可知,隨著標記尺寸的持續增加,循環有效范圍也逐漸增加,更加充分證明了所提方法的有效性。

4 結束語

人機交互一直是機器人研究領域的熱點話題,體感傳感器的出現有效改變了傳統人機交互模式。為了使人機交互更加自然和直接,結合多體感融合技術,提出一種基于多體感融合的虛擬運動目標人機交互方法。仿真結果表明,所提方法能夠獲取更真實的虛擬手型,同時還能夠提升目標跟蹤和識別結果的準確性,更好地實現人機交互。

雖然現階段所提方法取得了一些顯著的研究成果,但是由于受到時間因素的限制,導致所提方法仍然存在一定的不足,后續將重點針對以下幾方面的內容展開研究:

1)目前手勢設計還不夠豐富,后續可以加入旋轉手勢,以獲取更多的無縫銜接效果。

2)后續可以將虛擬角色替換為更加可愛的形象,全面激發小孩游戲的趣味性。

3)在濾波算法的基礎上,進一步提升人機交互算法的穩定性和可靠性。

4)可在所提的人機交互方法中加入移動互聯網技術,同時開展人機交互的新模式,例如用戶可以利用網頁完成機器人控制等。

5)由于所提方法受到硬件的限制,當大部分關鍵點重合在一起時,獲取的識別結果并不理想。為了更好地解決上述問題,可以優化交互邊緣,為用戶制定相應的規則,促使整體性能得到進一步提升。