病理輔助診斷系統中數字濾光片的實現方法

王紫旋,謝怡寧,何勇軍

摘要:病理輔助診斷系統采用在切片上放置濾光片的方法實現光源過濾,得到單色平行光,用于計算圖像的光密度參數來反映切片中某物質含量。但濾光片的使用不僅會導致圖像的顏色對比度降低,從而干擾醫生后續診斷、增加誤診可能性,而且提高了支出成本。為了解決該問題,訓練CGAN模型實現無濾光圖到有濾光圖的轉換,取代硬件濾光片,并將訓練好的模型稱作數字濾光片。為提高數字濾光片性能,在生成器中添加全尺度跳躍連接以提高生成圖像質量,在損失函數中添加積分光密度的約束以利于準確測量生成圖像的細胞核積分光密度。實驗表明,數字濾光片可達到硬件濾光片的濾光效果,生成圖像在視覺效果上逼近真實濾光圖像。在計算細胞核積分光密度的任務上,生成圖像與均值為119的真實濾光圖像偏差5.3%,表現效果分別比CycleGAN、pix2pix、pix2pixHD方法提升10.9%、3.2%、6.1%。

關鍵詞:醫學研究;條件生成對抗網絡;圖像翻譯;光密度;濾光片

DOI:10.15938/j.jhust.2022.01.006

中圖分類號: TP391.1? 文獻標志碼: A? ?文章編號: 1007-2683(2022)01-0040-07

Realization Method of Digital Filter in Pathological

Assistant Diagnosis System

WANG Zixuan,XIE Yining,HE Yongjun

(School of Computer Science and Technology, Harbin University of Science and Technology, Harbin 150080, China)

Abstract:The pathologyassisted diagnosis system adopts the method of placing a filter on the slice to filter the light source and obtain the monochromatic parallel light, which is used to calculate the optical density parameter of the image to reflect the content of a certain substance in the slice. But the use of filter not only reduces the color contrast of the image, which interferes with the doctors followup diagnosis and increases the possibility of misdiagnosis, but also increases expenditure costs. In order to solve this problem, the CGAN model is trained to realize the conversion from unfiltered image to a filtered image, which is used to replace the hardware filter, and the trained model is called a digital filter. In order to improve the performance of the digital filter, a fullscale jump connection is added to the generator to improve the quality of the generated image, and the integral optical density constraint is added to the loss function to facilitate accurate measurement of the integrated optical density of the nucleus in the generated image. Experiments show that the digital filter can achieve the filtering effect of a hardware filter, and the generated image is close to the real filtered image in terms of visual effects. In the task of calculating the integral optical density of the cell nucleus, the generated image deviates 5.3% from the real filtered image with a mean value of 119, the performance is improved by 10.9%, 3.2%, and 6.1% compared with CycleGAN, pix2pix, and pix2pixHD methods.

Keywords:medical research; conditional generative adversarial network (CGAN); image translation; optical density; optical filter

0引言

在醫學研究中,經常利用圖像的光密度參數來反映切片中某物質的含量或反應的強度[1-2]。該操作的理論基礎是朗伯比爾定律[3]:當一束平行單色光垂直通過某一均勻非散射的吸光物質時,其吸光度與吸光物質的濃度及吸收層厚度成正比,與照射光強度無關。即要通過計算圖像的光密度參數來反映切片中某物質的含量,則需要滿足切片被單色平行光透過的前提條件。醫學研究中廣泛采用在切片上放置濾光片的方法來滿足該條件[4]。病理輔助診斷系統[5-6]的實現中利用到該原理。該系統首先將病理切片和濾光片置于顯微鏡下,進行掃描拍攝得到病理圖像[7]。然后計算病理圖像細胞核的積分光密度[8](integral optical density,IOD)來得到細胞核DNA含量,并給出輔助診斷結果。最后由病理醫生觀察病理圖像,結合輔助診斷結果來給定最終的診斷結果。由上述過程可知,病理輔助診斷系統的使用中必須在切片上放置濾光片。但是濾光片的使用既會導致圖像的顏色對比度降低,從而干擾醫生后續診斷、增加誤診可能性,又提高了支出成本。為了解決以上問題,提出訓練深度學習模型實現濾光片的功能,并將訓練好的模型稱作數字濾光片。在處理病理圖像時,先用數字濾光片將病理圖像轉化為其對應添加濾光片后的圖像,然后再基于轉化后的圖像進行IOD值的計算,用于準確反映細胞核DNA含量。數字濾光片的應用不會影響病理醫生后續診斷,同時降低硬件濾光片的使用成本。據調研,目前文獻上還沒有用軟件實現濾光片功能的相關方法報道。

數字濾光片的功能類似于圖像翻譯(imagetoimage translation),即將一幅圖像轉化為另一幅圖像。圖像翻譯旨在通過設計端到端的模型,將源域圖像轉換到目標域圖像。通常由源域提供圖像內容,目標域提供圖像“風格”(圖像屬性或圖像風格)。在源域內容下實現目標域的“風格”化,從而實現源域圖像到目標域圖像的轉換。目前圖像翻譯研究在圖像的美化、風格遷移等方面取得了一定的效果[9-10]。傳統圖像翻譯的方法主要是基于模型框架的構造和詳細紋理的合成。Hertzmann等[11]進行多圖像訓練得到細節紋理生成模型,該模型僅利用到提取的底層特征合成新風格圖像,應用在具有復雜信息的圖像時效果不佳。近年來,許多基于深度學習的圖像翻譯方法取得了重大進展,主要可以分為兩類:基于卷積神經網絡(convolutional neural network,CNN)的方法和基于生成對抗網絡(generative adversarial network,GAN)[12]的方法。第一類方法主要是基于CNN網絡對圖像進行內容和風格的特征提取,然后再將圖像的風格和內容進行重塑,從而實現圖像的風格翻譯。Gatys等[13]采用深度卷積神經網絡來提取特征,并不斷地迭代優化,從而生成新風格圖像。第二類方法主要采用生成對抗網絡及其衍生模型,可以更好地控制圖像的風格,生成更高質量的圖像。Isola等[14]提出基于條件生成對抗網絡(conditional generative adversarial network,CGAN)[15]的網絡,實現了從源域到目標域圖像的轉換,是一種適用于圖像翻譯的通用網絡。Wang等[16]在此基礎上,提出多級生成網絡和多級判別網絡,以提高生成圖像的分辨率。以上生成對抗網絡采用了監督學習的方法,要求訓練數據必須在源域空間和Y目標域間嚴格成對。然而現實中獲得符合要求的成對樣本往往比較困難。CycleGAN[17]、DiscoGAN[18]、DualGAN[19]引入了循環不變性損失(cycle consistency loss),通過訓練兩組生成器和判別器來分別學習兩類圖像間的來回映射,解決了在圖像翻譯任務中模型需要成對數據才能訓練的問題,實現了非成對數據的訓練。上述方法只能實現兩個域間的變換。若涉及到多域變換問題,則需要分別為每一對圖像域構建合適的模型,不僅降低操作效率,而且影響生成圖像的質量。基于以上原因,Yunjey Choi等[20]提出了StarGAN,將目標域的信息作為標簽,通過對域標簽的控制來實現多域變換。

圖像翻譯方法可以將圖像轉化成對應添加濾光效果的圖像,實現數字濾光片功能。但以上圖像翻譯方法生成的圖像主要追求人眼視覺效果。本文實現的數字濾光片用于病理輔助診斷系統,由數字濾光片生成的圖像不僅要滿足符合人眼視覺效果,還要有利于精準測量圖像中細胞核IOD值。因此本文采用pix2pix[14]框架實現數字濾光片,并在pix2pix的生成器中添加全尺度跳躍連接以提高生成圖像質量,在損失函數中添加IOD的約束以利于準確測量生成圖像的細胞核IOD。實驗結果表明,本文實現的數字濾光片生成圖在視覺效果上與真實濾光圖像逼近;在計算細胞核IOD任務上,生成圖像的細胞核IOD值與均值為119的真實濾光圖像偏差5.3%。因此本文實現的數字濾光片能夠有效實現數字濾光,可取代硬件濾光片。

本文創新點表現在:①提出并實現數字濾光片,數字濾光片可取代硬件濾光片;②為提高數字濾光片的濾光效果,在pix2pix的生成器中添加全尺度跳躍連接,并在損失函數中加入IOD的約束。

1數字濾光片的實現

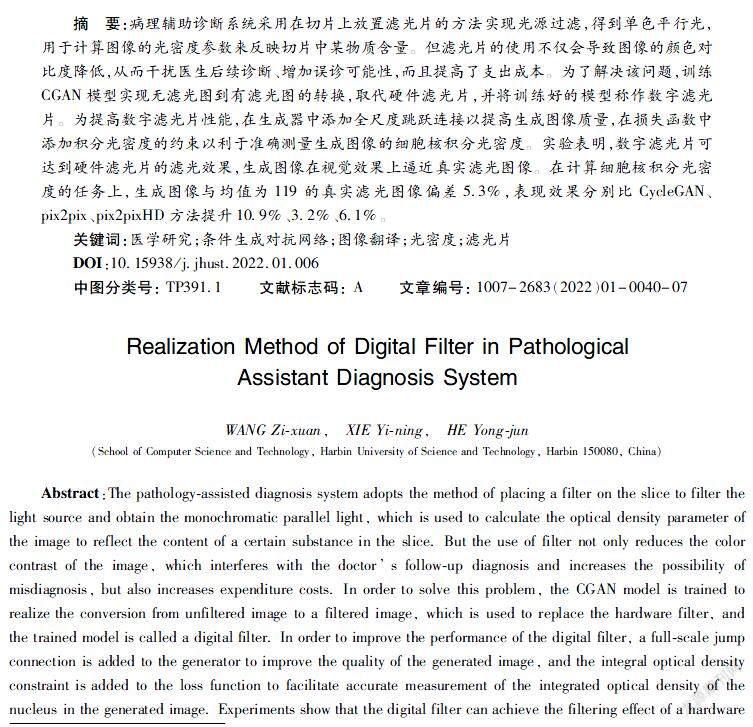

1.1方法流程

數字濾光片的原理是利用pix2pix具有圖像翻譯的特性,實現由無濾光圖像到有濾光圖像的映射。具體實現方法如圖1所示。首先采集顯微鏡下病理切片圖像,得到病理圖像;然后對病理圖像進行預處理和數據增強,得到數據集;最后為提高濾光效果,對pix2pix進行改進,并用訓練集對改進后的模型進行訓練。訓練完成的生成網絡即可用作數字濾光片。

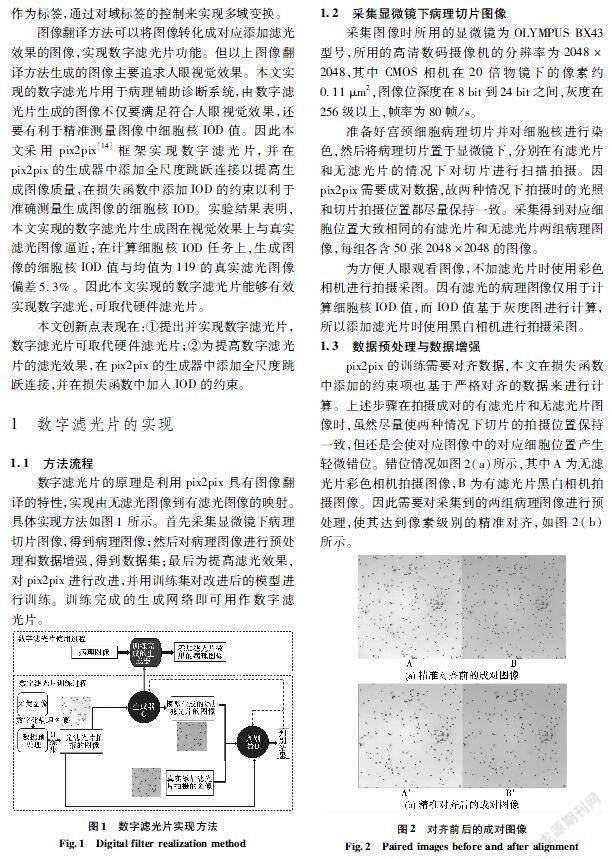

1.2采集顯微鏡下病理切片圖像

采集圖像時所用的顯微鏡為OLYMPUS BX43型號,所用的高清數碼攝像機的分辨率為2048×2048,其中CMOS相機在20倍物鏡下的像素約0.11μm2,圖像位深度在8bit到24bit之間,灰度在256級以上,幀率為80幀/s。

準備好宮頸細胞病理切片并對細胞核進行染色,然后將病理切片置于顯微鏡下,分別在有濾光片和無濾光片的情況下對切片進行掃描拍攝。因pix2pix需要成對數據,故兩種情況下拍攝時的光照和切片拍攝位置都盡量保持一致。采集得到對應細胞位置大致相同的有濾光片和無濾光片兩組病理圖像,每組各含50張2048×2048的圖像。

為方便人眼觀看圖像,不加濾光片時使用彩色相機進行拍攝采圖。因有濾光的病理圖像僅用于計算細胞核IOD值,而IOD值基于灰度圖進行計算,所以添加濾光片時使用黑白相機進行拍攝采圖。

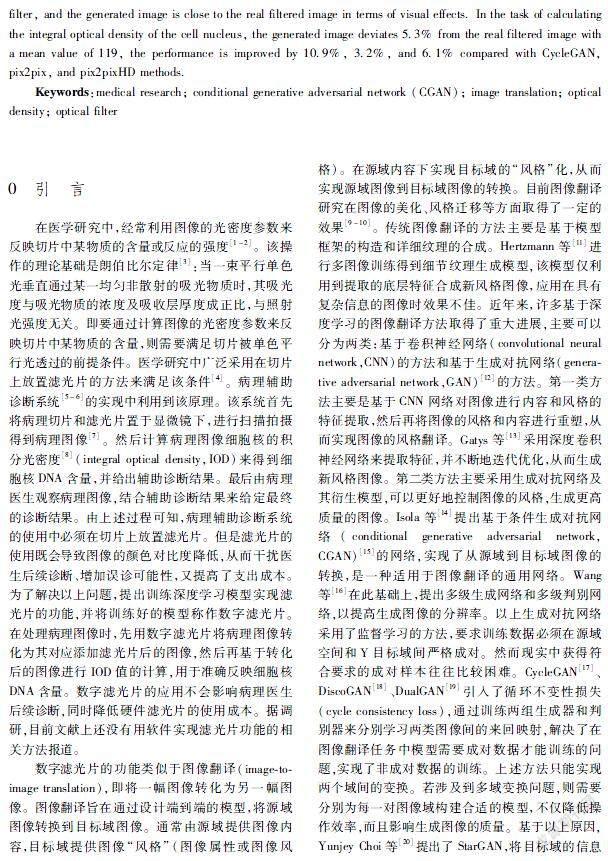

1.3數據預處理與數據增強

pix2pix的訓練需要對齊數據,本文在損失函數中添加的約束項也基于嚴格對齊的數據來進行計算。上述步驟在拍攝成對的有濾光片和無濾光片圖像時,雖然盡量使兩種情況下切片的拍攝位置保持一致,但還是會使對應圖像中的對應細胞位置產生輕微錯位。錯位情況如圖2(a)所示,其中A為無濾光片彩色相機拍攝圖像,B為有濾光片黑白相機拍攝圖像。因此需要對采集到的兩組病理圖像進行預處理,使其達到像素級別的精準對齊,如圖2(b)所示。

數據預處理過程如圖3所示。首先,輸入圖像A和圖像B;其次,對A和B進行圖像二值化操作;然后,遍歷A圖中的所有輪廓,對于當前輪廓a,若在B圖中找到一個輪廓b,使兩個輪廓的最小外接矩形中的所有像素值都相等,則兩輪廓為完全對應輪廓;接著判斷a和b的相對位置,并根據該相對位置來裁剪B圖,使得b在裁剪后B圖中坐標與a在A圖中坐標相同;最后以(1024,1024)像素點為中心,分別在A圖和裁剪后B圖上裁剪1792×1792大小的圖像,得到精準對齊的圖像A和B。

經數據預處理后,得到了50組1792×1792大小的精準對齊的成對圖像。對所有圖像進行十六等分切割,為提高數字濾光片魯棒性,對圖像進行翻轉、旋轉、縮放、裁剪、移位、添加高斯噪聲、轉置輸入、模糊等數據增強操作。成對圖像采取相同的操作,保證了操作后成對圖像仍精準對齊。經上述操作后,得到8000組448×448大小的成對圖像。

1.4數字濾光片的實現模型

本文使用基于CGAN的pix2pix框架實現數字濾光片。為提高數字濾光片性能,在pix2pix的生成器中添加全尺度跳躍連接以提高生成圖像質量,并在損失函數中添加IOD的約束以利于準確測量生成圖像的細胞核IOD。

1.4.1生成器

生成器以輸入的病理圖像為條件,生成滿足條件且與真實濾光圖像難以分辨的病理圖像。pix2pix框架的生成器G采用Encoderdecoder結構,并在每一個i和n-i層之間添加跳躍連接,其中n是總層數。

為了獲取更多輸入圖像的信息,使生成圖像具有更多細節特征,使得數字濾光片取得更好的濾光效果,本文參照Huang等[21]提出的 UNet 3+結構,在pix2pix的生成器中添加全尺度跳躍連接。但與UNet 3+不同的是,本任務經實驗對比,采用平均池化從較小規模的編碼器層獲取底層信息,采用雙立方插值從較大規模的解碼器層傳輸高級語義信息,會達到比原始UNet 3+中的跳躍連接更好的效果。經本文改進后的生成器結構如圖4所示。輸入圖像首先經過8層卷積層提取特征,然后經由8層反卷積層還原放大至原圖大小。其中卷積核的大小均為4×4。

1.4.2判別器

判別器的作用是在輸入的病理圖像的條件下,對生成器生成的圖像判斷為假,對真實濾光圖像判斷為真。此處的判別器D采用了條件判別器 PatchGAN[14],加快計算以及收斂。

1.4.3損失函數

原始CGAN的目標函數為

LcGAN(G,D)=Ex,y[logD(x,y)]+

Ex,z[log(1-D(x,G(x,z)))]

其中:G代表生成器;D代表判別器;x代表輸入到生成器網絡中的不添加濾光片的圖像;y代表訓練集中x對應的真實濾光圖像;z代表輸入噪聲。

pix2pix在原始CGAN的基礎上添加了式(2)所示的L1 Loss,得到最終的目標函數如式(3)所示:

LL1(G)=Ex,y,z[||y-G(x,z)||1](2)

G*=argminGmaxDLcGAN(G,D)+λLL1(G)(3)

其中λ表示L1正則化約束所占據的比例參數。

本文實現的數字濾光片,具有硬件濾光片的濾光效果。真實濾光圖像是在添加濾光片后由黑白相機拍攝得到的灰度圖像,根據其計算出的細胞核IOD最能準確反映細胞核IOD。因此,將生成圖像

與真實濾光圖像的細胞核IOD的平均絕對誤差作為MAE Loss,如式(4)所示:

LMAE(G)=Ex,y,z[1n∑ni=1|yi_IOD-G(x,z)i_IOD|]

其中:yi_IOD和G(x,z)i_IOD分別表示真實濾光圖像與生成圖像中第i個對應細胞核的IOD值;n表示兩張圖像共同識別出的對應細胞核的數目。

在光學領域,IOD的計算公式[8]如式(5)所示:

IOD=∑OD=∑log(Ia/Ib)(5)

其中:Ia為光線通過介質前的入射光強度;Ib為通過介質后的透射光強度。在圖像處理領域,圖像光照的變化可反映為圖像灰度值的變化。在實際計算時,使用圖像的背景灰度值表示Ia,用被測量物體的灰度值表示Ib。

將MAE Loss作為懲罰項加入到pix2pix的損失函數中,可以使本文的數字濾光片更好地實現硬件濾光片的功能。改進后的pix2pix的目標函數為

G*=argminGmaxDLcGAN(G,D)+λ1LL1(G)+λ2LMAE(G)(6)

其中:λ1和λ2分別表示L1正則化約束和LMAE(G)懲罰項所占據的比例參數,參數λ1延用pix2pix中設定的值,λ2的值設為1。

2實驗分析

2.1數據集準備

在數據預處理與數據增強步驟中,得到了8000組448×448大小的精準對齊的成對圖像。隨機選取其中6400組圖像作為訓練集,剩余1600組圖像作為測試集。

2.2評價指標

本文將網絡生成圖與真實濾光圖的對應細胞核IOD的平均絕對誤差(mean absolute error,MAE)作為評價指標,來衡量本文方法的優劣。具體公式如式(7)所示。

MAE=1n∑ni=1|yi_IOD-G(x,z)i_IOD|(7)

其中:n表示兩張圖像共同識別出的對應細胞核的數目;yi_IOD和G(x,z)i_IOD分別表示真實濾光圖像與生成圖像中第i個對應細胞核的IOD值。

2.3實驗過程

實驗采用Pytorch 1.4.0深度學習框架,在Linux Ubuntu 18.04.2操作系統下運行,配有4個NVIDIA GeForce RTX 2080 Ti顯卡,CPU為12核的Intel(R) Xeon(R) CPU E5-2678 v3 @ 2.50GHz,內存125G。為解決模型訓練優化過程中可能出現的學習率消失等問題,使用Adam[22]函數作為優化器,初始參數β1和β2設為0.9、0.999,∈設為1×10-8,初始學習率設為0.001。

在網絡訓練階段,將無濾光圖輸入到網絡的生成器G中,得到假的有濾光圖。將假的有濾光圖和真實濾光圖輸入到網絡的判別器D中,Patch的大小設置為70×70。判別器D來判別當前圖像是真實的有濾光圖還是假的有濾光圖。網絡的生成器和判別器聯合進行訓練,對一方參數進行更新時,另一方的參數保持固定,然后交換參數固定方與更新方,雙方不斷進行博弈、優化。

在測試階段,將訓練好的生成器用作數字濾光片,然后取測試集中的無濾光圖,輸入到數字濾光片中,得到生成的有濾光圖。

2.4實驗結果展示與分析

將本文方法的濾光效果與無濾光效果、CycleGAN[17]濾光效果、pix2pix[14]濾光效果、pix2pixHD[16]濾光效果進行對比。

2.4.1人眼視覺效果

以測試集中一張圖為例,各方法的濾光效果如圖5所示。

由圖5可以看出,與真實濾光圖相比,CycleGAN網絡生成圖的細節不清晰、細胞核顏色過深;pix2pixHD生成圖的清晰度要遠大于真實濾光圖,導致部分細胞核的細節顏色較深;pix2pix生成圖雖然在整體視覺效果上逼近真實濾光圖,但個別

細胞核卻有較大差距(例如圖像底部中間位置的細胞核);本文方法生成圖在整體視覺效果和具體細節上均表現較好,與真實濾光圖逼近。

2.4.2MAE定量評估

測試集中真實濾光圖像的細胞核IOD均值為119,記作M。針對測試集中圖像,計算各方法生成圖與真實濾光圖的對應細胞核IOD的MAE,并計算各MAE值占M的比例。各方法對比結果如表1所示。

如表1所示,Ours的MAE/M值為5.3%,說明本文方法生成圖的細胞核IOD與真實濾光圖的對應細胞核IOD僅相差5.3%。同時,Ours的MAE/M值明顯小于不添加濾光片時的值,說明本文方法生成的有濾光圖大大降低了與真實濾光圖的差距。以上兩點都說明了本文實現的數字濾光片可以很好地將無濾光圖轉化為有濾光圖。此外,Ours的MAE/M值明顯小于其他方法,說明相較于用其他方法實現的數字濾光片,本文實現的數字濾光片效果更好。

實驗還選取了一些含較多團狀細胞、細胞模糊的圖像進行測試。測試結果分別如表2、表3所示。

如表2、表3所示,對于團狀細胞較多、細胞模糊等復雜圖像,相較于其他方法,本文實現的數字濾光片也表現優異。

3結論

針對病理輔助診斷系統中硬件濾光片技術會干擾醫生診斷、增加支出成本等問題,本文訓練CGAN模型實現濾光片的功能,并將訓練好的模型稱作數字濾光片。為提高數字濾光片的濾光性能,在生成器中添加全尺度跳躍連接以提高生成圖像質量,在損失函數中添加IOD的約束以利于生成圖像的細胞核IOD的準確測量。實驗表明,本文實現的數字濾光片生成圖在視覺效果上與真實濾光圖像逼近;在計算細胞核IOD任務上,生成圖與與均值為119的真實濾光圖偏差5.3%,分別比CycleGAN、pix2pix、pix2pixHD方法提升了10.9%、3.2%、6.1%。因此該技術的采用可以取代硬件濾光片,實現對圖像的有效濾光。

參 考 文 獻:

[1]汪薇, 王詩航. 光密度值測定在實驗醫學研究中的應用及意義[J]. 解剖科學進展, 2006(3):286.

WANG Wei,WANG Shihang. Application and Significance of Optical Density Value Measurement in Experimental Medical Research[J]. Progress of Anatomical Sciences, 2006(3):286.

[2]李志華, 夏潮涌, 黃中新, 等. 乳腺癌細胞核DNA含量不同分析方法的比較[J]. 中國體視學與圖像分析, 2003(3):154.

LI Zhihua, XIA Chaoyong, HUANG Zhongxin, et al. Compare the Difference on Measuring Methods of DNA Content of Breast Cancer[J]. Chinese Journal of Stereology and Image Analysis, 2003(3):154.

[3]李朋軍, 夏潮涌. 腫瘤細胞DNA干系倍體分析及其臨床應用[J]. 中國體視學與圖像分析, 2005(2):72.

LI Pengjun, XIA Chaoyong. Analysis and Clinical Application of DNA Stemline Ploidy of Tumor Cells[J]. Chinese Journal of Stereology and Image Analysis,2005(2):72.

[4]魏清柱, 夏潮涌, 劉江歡. 濾光片對細胞核DNA含量檢測的影響[J]. 中國體視學與圖像分析, 2009,14(3):292.

WEI Qingzhu, XIA Chaoyong, LIU Jianghuan, et al. The Influence of Filter on Measurement of Nuclear DNA Content[J]. Chinese Journal of Stereology and Image Analysis,2009,14(3):292.

[5]新型乳腺癌病理診斷輔助系統[J]. 上海生物醫學工程,1998(4):36.

New Pathological Diagnostic Aid for Breast Cancer[J]. Shanghai Journal of Biomedical Engineering, 1998(4):36.

[6]王繼偉, 樊偉, 陳崗, 等. 基于深度卷積神經網絡的數字病理輔助診斷系統設計[J]. 中國數字醫學, 2020,15(12):48.

WANG Jiwei, FAN Wei, CHEN Gang, et al. Design of the Digital Pathologyassisted Diagnosis System Based on the Deep Convolutional Neural Network[J]. China Digital Medicine, 2020,15(12):48.

[7]盧祎,張雪媛,何勇軍.基于焦平面估計的快速掃片方法[J].哈爾濱理工大學學報,2020,25(1):51.

LU Yi, ZHANG Xueyuan, HE Yongjun. Fast Scanning Method Based on Multipoint Focusing[J]. Journal of Harbin University of Science and Technology, 2020,25(1):51.

[8]李楓. 圖像分析中光密度參數物理意義的正確理解和使用[J]. 解剖學雜志, 2009,32(2):271.

LI Feng. Proper Understanding and Use of the Physical Meaning of Optical Density Parameters in Image Analysis[J]. Chinese Journal of Anatomy, 2009,32(2):271.

[9]陳淑環, 韋玉科, 徐樂, 等. 基于深度學習的圖像風格遷移研究綜述[J]. 計算機應用研究, 2019,36(8):2250.

CHEN Shuhuan, WEI YuKe, XU Le, et al. Survey of Image Style Transfer Based on Deep Learning[J]. Application Research of Computers,2019,36(8):2250.

[10]LEDIG C, THEIS L, HUSZR F, et al. Photorealistic Single Image Superresolution Using a Generative Adversarial Network[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2017: 4681.

[11]HERTZMANN A, JACOBS C E, OLIVER N, et al. Image Analogies[C]//Proceedings of the 28th Annual Conference on Computer Graphics and Interactive Techniques, 2001: 327.

[12]GOODFELLOW I, POUGET A J, MIRZA M, et al. Generative Adversarial Nets[J]. arXiv:1406.2661.2014..

[13]GATYS L A, ECKER A S, BETHGE M. A Neural Algorithm of Artistic Style[J]. arXiv Preprint arXiv:1508.06576, 2015.

[14]ISOLA P, ZHU J Y, ZHOU T, et al. Imagetoimage Translation with Conditional Adversarial Networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2017: 1125.

[15]MIRZA M, OSINDERO S. Conditional Generative Adversarial Nets[J]. arXiv Preprint arXiv:1411.1784, 2014.

[16]WANG T C, LIU M Y, ZHU J Y, et al. Highresolution Image Synthesis and Semantic Manipulation with Conditional Gans[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018: 8798.

[17]ZHU J Y, PARK T, ISOLA P, et al. Unpaired Imagetoimage Translation Using Cycleconsistent Adversarial Networks[C]//Proceedings of the IEEE International Conference on Computer Vision, 2017: 2223.

[18]KIM T, CHA M, KIM H, et al. Learning to Discover Crossdomain Relations with Generative Adversarial Networks[C]//International Conference on Machine Learning. PMLR, 2017: 1857.

[19]YI Z, ZHANG H, TAN P, et al. Dualgan: Unsupervised Dual Learning for Imagetoimage Translation[C]//Proceedings of the IEEE inTernational Conference on Computer Vision, 2017: 2849.

[20]CHOI Y, CHOI M, KIM M, et al. Stargan: Unified Generative Adversarial Networks for Multidomain Imagetoimage Translation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018: 8789.

[21]HUANG H, LIN L, TONG R, et al. Unet 3+: A Fullscale Connected Unet for Medical Image Segmentation[C]//ICASSP 2020-2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2020: 1055.

[22]KINGMA D P, BA J. Adam: A Method for Stochastic Optimization[J]. arXiv Preprint arXiv:1412.6980, 2014.

(編輯:溫澤宇)