基于數據融合驅動和DLSTM網絡的軸承RUL預測

段桂英 姜洪開

1(山東藝術學院公共課教育部 山東 濟南 250014)2(西北工業大學航空學院 陜西 西安 710072)

0 引 言

滾動軸承作為轉子機械設備的核心元件,被廣泛應用于航空航天、工業生產及電力系統,軸承發生故障將會導致巨大的經濟損失,甚至造成災難性后果。因此,對軸承進行可靠的剩余壽命預測能夠有針對性地進行維修保養,從而在保證安全的前提下提升設備的使用效率[1-2]。

現有的RUL預測方法可以分為三類[3],即基于模型的方法、數據驅動的方法和混合方法。其中,數據驅動方法與其他兩種方法相比更易于實現,也能夠更加全面地進行分析。文獻[4]描述了一種針對自動變速器離合器基于卡爾曼濾波器(Kalman filter,KF)的RUL預測方法。文獻[5]提出了一種使用支持向量回歸(SVR)的直接RUL估計方法,該方法避免了估計退化狀態或閾值設置故障。文獻[6]采用回波狀態網絡模型,使用時間序列數據對燃料電池進行RUL預測等。但是這些方法通過映射監視信號和RUL值之間的關系可以實現RUL預測,但是沒有考慮反映健康狀態微小變化的不同時間序列信號的相關性。

循環神經網絡(RNN)作為上述問題的一種解決方案,可以跨時間步長從先前處理的序列數據中提取有用的重要信息,并將其集成到當前的單元狀態中以對序列數據進行建模[7]。但是訓練中梯度消失或爆炸的問題限制了傳統RNN的廣泛應用。文獻[8]創建了一種改進的名為LSTM的RNN結構來緩解此問題,通過引入一組記憶神經元,LSTM在學習魯棒性和敏感數據方面表現出了卓越的能力。但是該方法僅分析振動信號,而未考慮多傳感器數據的融合處理,無法體現數據驅動的全面性,導致預測精度不高,而且由于網絡結構的限制,引入深度學習對預測精度提升的效果不佳。

為解決上述問題,本文結合AMEA及網格搜索策略,提出了一種基于多傳感器信號融合的DLSTM網絡剩余壽命預測模型。

1 長短期記憶網絡

與常見的神經網絡不同,RNN具有獨特的結構,即隱藏層的輸出將作為輸入反復返回,這意味著隱藏層在一段時間內與其自身具有自連接特性。因此,RNN在處理時序相關數據方面具有很強的能力。其在時間t處的隱藏層的輸出描述為:

ht=φ(whx+whhht-1+bh)

(1)

式中:whx和whh分別是隱藏層神經元的輸入數據ht和先前輸出ht-1的權重系數;bh表示偏差。

然而,由于在模型訓練期間反向傳播過程中存在梯度消失問題,RNN無法獲取數據中的長期依存關系。因此,在LSTM網絡結構中,LSTM神經元通過取代傳統的RNN隱藏神經元來構建LSTM層。每個LSTM神經元都有三個精心設計的門函數,即遺忘門、輸入門和輸出門。這種結構確保LSTM神經元具有發現和記憶長期依賴性的能力。

LSTM神經元中的三個門函數為控制信息的輸入和刪除提供了良好的非線性控制機制。輸入門決定了將進入神經元狀態的信息,遺忘門決定了神經元狀態中需要丟棄的信息,輸出門決定從神經元狀態導出什么信息。LSTM神經元的計算過程可以用數學公式表示為:

gt=φ(wgx+wghht-1+bg)

(2)

it=σ(wixxt+wihht-1+bi)

(3)

ft=σ(wfxxt+wfhht-1+bf)

(4)

ot=σ(woxxt+wohht-1+bo)

(5)

st=gt?it+st-1?ft

(6)

ht=φ(st)?ot

(7)

式中:wgx、wfx、wix和wox是輸入數據xt的權重;wgh、wih、wfh和woh是LSTM神經元先前輸出的ht-1的權重;bg、bf、bi和bo表示輸入節點、遺忘門、輸入門和輸出門的偏差;gt、ft、it和ot是輸入節點、遺忘門、輸入門和輸出門的輸出;σ(·)和φ(·)表示S型和tanh函數;st和st-1是LSTM神經元在時間t和t-1時的狀態;?表示逐點乘法。

2 RUL預測模型

深度學習作為人工神經網絡的擴展,可以通過多層網絡結構來自適應地捕獲數據中的潛在特征[9]。從結構的角度來看,DLSTM包含多個隱藏層,這是深度學習的一種形式。本文構建了一個DLSTMN模型,以實現多傳感器數據的自動融合和RUL的準確預測。

圖1 預測模型結構圖

輸入數據的輸入由輸入神經元控制,因此輸入神經元的數量等于所選傳感器信號的數量。傳感器時間序列信號數據分為不同部分,分別用于網絡模型訓練、驗證和測試。輸入數據被構造成二維矩陣。矩陣中的行數和列數為k和T,k代表所選傳感器個數,T代表采樣點的個數。最終將多傳感器數據融合到RUL值。

多個LSTM層堆疊在構造的DLSTM模型中,實現了多傳感器數據的深度挖掘和融合。不同的LSTM層在空間上相連,數據從上層輸出到下一層的神經元,相同的LSTM層與時間有關,LSTM層的先前輸出將作為輸入循環到該層。每個LSTM層中都包含許多LSTM神經元以捕獲傳感器數據的長期依賴性。在每一層LSTM神經元之間形成信息交換,實現跨時間的自連接。此外,每個神經元的輸出不僅在下一刻循環進入自身,而且還與其他神經元共享。

輸出層采用完全連接的密集層,在該層中將LSTM層的輸出信號送入其中,最終將多傳感器數據融合到RUL值。采用均方誤差函數作為機器學習中常用的損失函數,以使預測的RUL和RUL標簽之間的誤差最小。在測試階段,將在線傳感器數據依次發送到經過訓練的DLSTM中,并獲取預測的RUL。

3 模型優化

3.1 模型結構

DLSTM模型結構的大小,包括LSTM層數和每個LSTM層的神經元數,需要人為確定。這些是DLSTM模型中兩個重要的參數,用于控制網絡的體系結構和拓撲。許多文獻提出了DLSTM的參數優化方法[10],且取得了較好的效果,但優化過程卻極其復雜。由于DLSTM網絡結構的復雜性和長的訓練過程,DLSTM與這些優化方法相結合必然會對計算資源提出更高的要求。

DLSTM將網格搜索用于網絡配置探索,原理簡單明了,算法容易實現,計算資源要求低。LSTM層數和各層神經元數的候選構成一個二維網格,并驗證網格中各節點參數以選擇最佳的網絡結構參數。最后,將具有最佳驗證預測性能的參數視為最優參數,并用于在線RUL預測中。

3.2 損失函數的優化

損失函數的優化算法將直接影響DLSTM訓練的效率和時間,本文DLSTM模型采用AMEA代替傳統的隨機梯度下降(Stochastic gradient descent,SGD)優化算法,使DLSTM的損失函數最小。在SGD算法中,保持固定的學習速率(Learning rate,LR)來更新所有的權值,這意味著LR在訓練中保持不變。AMEA通過分析梯度的一階矩估計(FME)和二階矩估計(SME),針對不同的參數設計獨立的自適應LR[6]。因此,AMEA具有較高的計算效率,但需要較少的配置資源。用AMEA更新網絡參數的過程表示為:

(8)

mt=β1mt-1+(1-β1)gt

(9)

(10)

(11)

(12)

(13)

3.3 引入主動丟棄法

通常神經網絡的訓練更加耗時,因此隨著網絡層數增加,過擬合成為一個嚴重的問題[11]。過擬合會導致預測模型在訓練數據中表現出色,但在測試數據中表現不佳。為了解決該問題,DLSTM模型采用了主動丟棄法來防止重復捕獲相同的特征。

應用于DLSTM模型的信號主動丟棄方法的示意圖如圖2所示。其中,深色圈是隱藏層中的神經元,它們在DLSTM的訓練過程中,根據一定的概率暫時從網絡中丟棄。由于丟棄是隨機發生的,所以在每個小批量中訓練不同的網絡。因此,信號丟棄可以有效地緩解DLSTM的數據過擬合問題。需要指出的是,信號丟棄只在訓練過程中起作用,在測試過程中被禁用,這意味著所有隱藏的神經元都在測試過程中起作用。本文測試了所有候選遺漏值,將最優值應用到DLSTM中。

圖2 主動丟棄法應用于DLSTM模型

4 實 驗

4.1 數據集描述

用于評估本文方法的數據集是由CMAPSS提供的NASA渦扇發動機轉子軸承數據集,可變地輸入不同轉速,以模擬轉子軸承中的不同故障和退化過程。在實驗過程中,轉子軸承開始在良好的狀態下運行,并出現了一些故障,這些故障會導致性能下降,直到出現事故為止。

CMAPSS提供A組-D組四個數據集。每個數據集都包括訓練集和測試集。訓練集會保存整個壽命周期的信號,而測試集僅包含多個傳感器數據,這些數據在軸承故障和RUL需要預測之前的某個時間終止。訓練集和測試集都由一系列循環組成,每個循環包含26列,分別指軸承序號、循環索引、3個操作設置和21個傳感器測量值。

由于軸承具有明顯的健康退化過程,本文采用了A組和C組兩組數據集。A組只有一種故障模式,而C組有兩種故障模式。此外,A組和C組都包含100個訓練軸承和100個測試軸承。

實驗中所有方法都是在Anaconda和Python 3.6上執行的。計算設備是一個具有Intel Core i5- 4460(3.20 GHz)CPU、16 GB RAM的計算機。

4.2 性能評價指標

本文提出的方法采用指標得分(Score)、均方根誤差(RMSE)和RUL誤差范圍三個指標來評估RUL預測性能。

數據創建者提供的指標得分表示為:

(14)

RMSE計算如下:

(15)

Score和RMSE都用來評估預測RUL和實際RUL之間的差異,較小的Score或RMSE值代表較好的預測效果。然而,這兩個指標之間存在微妙的差異,如圖5所示。可以看出,比起早期的預測,Score對晚期預測的懲罰更大。

圖3 Score和RMSE之間差異的圖示

指標RUL誤差范圍代表所有RUL預測值的誤差范圍。RUL誤差范圍越小,預測方法的有效性和穩定性越高。

4.3 多傳感器數據預處理

軸承獲得的多傳感器數據存在較大的隨機波動和噪聲干擾,可能影響RUL預測的性能。采用指數平滑算法去除噪聲,減弱傳感器數據的隨機波動,其表達式為:

(16)

α的大小直接決定了軸承振動傳感器數據的平滑效果,從而間接影響RUL預測的精度。圖4展示出了與A組中的原始傳感器數據相比具有不同α值的傳感器2的預處理傳感器數據。傳感器數據平滑使用了三個不同的α值,分別為0.25、0.5和0.75。可以看出,與原始傳感器數據相比,平滑的傳感器數據的波動減小,并且平滑的傳感器數據能夠很好地反映原始傳感器數據的趨勢。通過一系列對比實驗發現,α值為0.25的預處理傳感器數據波動較小,這意味著數據平滑效果更好。因此,本文實驗將α設置為0.25。

綜上所述,從21個傳感器獲取的信號包含在CMAPSS數據集中。然而,并不是所有的傳感器都能很好地表示退化過程。為了得到準確的RUL預測,需要選擇傳感器。合理的傳感器信號與健康退化過程具有良好的相關性,表現出單調遞增或遞減的趨勢[12]。因此,通過分析信號數據的單調性(Mon)和相關性(Corr)來實現傳感器的選擇。

為了測量軸承數據的趨勢,首先提取軸承數據的平均趨勢特征:

(17)

式中:f(t)是時間t處傳感器信號的趨勢值;fU(t)和fL(t)分別表示傳感器信號的上、下包絡。

對傳感器信號的Mon和Corr進行分析,分別定義如下:

(18)

式中:T表示信號樣本的數量。

接下來,通過Mon和Corr的組合找到一個復合選擇標準(CSC),其表示為:

(19)

式中:Ω表示所有候選傳感器信號;ωi表示加權系數。由式(19)可以看出,CSC與Mon和Corr呈線性正相關,即CSC指數越高,傳感器越能反映變化趨勢。為了選擇更好的特征,將閾值設置為0.75。

圖5展示了A組和C組中傳感器的分類CSC值,從圖5(a)可以看出,A組中的21個傳感器(S1-S21)的CSC被排序。S2、S3、S4、S7、S8、S11、S12、S13、S15、S17、S20和S21的CSC大于閾值,因此它們被選中。在圖5(b)中,選擇傳感器S4、S7、S11、S12、S15、S20和S21的數據來構建C組中的訓練數據集。

圖5 傳感器的CSC排序值

RUL標簽值對預測性能有顯著影響,RUL標簽被假定在初始階段是恒定的,然后線性下降。根據文獻[13],早期的采樣點用一個恒定的RUL值進行標記,綜合考慮將其設置為125。

5 結果分析

5.1 案例一

對數據集A組進行分析,以驗證本文方法。首先,在多傳感器數據預處理完成后,利用100個滾動軸承的傳感器數據建立訓練數據集,其中隨機選取90個滾動軸承進行DLSTM模型訓練,其余10個軸承驗證模型的有效性。其次,考慮數據集中監測信號的特性,建立了用于RUL預測的DLSTM模型,并對其參數進行了優化確定。利用網格搜索方法對模型進行訓練,以探索最優的DLSTM結構。由LSTM層數和各層形式的神經元數構成二維網格,并將網格中的每個節點參數驗證為候選參數。考慮到時間限制和計算復雜性,將LSTM層數設置為1到6,并且每個LSTM層中的神經元數設置為50至300。該網格中每兩個參數組合用于構造一個新的DLSTM。采用10個驗證引擎對每個模型結構進行驗證,并利用RMSE對模型訓練結果進行比較。圖6展示了不同層數和神經元數的DLSTM的訓練結果。可以看出,每個模型結構具有不同的性能,DLSTM模型具有5個LSTM層,每個LSTM層有100個神經元,達到了最優的性能。因此,在這種情況下,DLSTM模型由5個LSTM層和100個神經元構成。表1記錄了部分參數組合情況下DLSTM的訓練結果,其選擇了6個參數組合,取得了較好的訓練效果。通過對參數和訓練時間的比較,發現DLSTM的訓練時間隨著LSTM層數和DLSTM層數的增加而逐漸延長。

圖6 不同層數和神經元數的DLSTM的RMSE分布

表1 部分參數組合情況下DLSTM的訓練結果

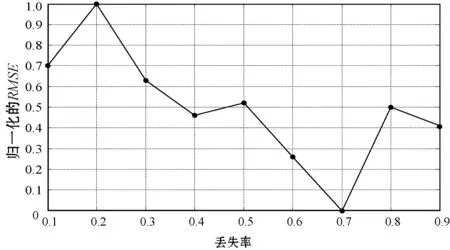

為了減少DLSTM模型的數據過度擬合,采用了丟棄法。本文嘗試用不同的丟棄率來確定構造的DLSTM的最佳值。圖7展示了具有不同丟棄值的構造的DLSTM的訓練結果,可以看出,當丟棄率為0.7時,DLSTM模型具有最小的RMSE值并獲得最佳的訓練性能。因此為了獲得良好的DLSTM訓練效果,本文將丟棄率設置為0.7。

圖7 用不同的丟棄率訓練DLSTM

為了使損失函數最小化,本文將不同的優化算法與AMEA進行了比較,包括SGD、均方根(RMSprop)、自適應梯度(Adagrad)和Adadelta。圖8展示了使用不同優化算法訓練DLSTM,可以看出,這四個優化器都可以幫助DLSTM在經過1 000個階段后實現網絡優化。盡管如此,與其他算法相比,DLSTM中的AMEA具有更高的效率和更好的收斂性。因此,AMEA在構造的DLSTM中用作損失函數優化器。

圖8 用不同的優化器訓練DLSTM

最后,建立了一個包含5層LSTM和100個神經元的DLSTM模型用于軸承RUL的預測。將丟棄值設為0.7,損失函數優化算法采用AMEA。表2顯示了構建DLSTM模型的其他參數。

表2 本文DLSTM模型的其他參數

模型訓練完成后,利用10個軸承對訓練后的DLSTM進行性能驗證。圖9比較了10個軸承的預測RUL和真實RUL以進行驗證,其中虛線代表預測曲線,實線表示真實剩余壽命。可以看出,這些預測能夠很好地反映出10個軸承真實RUL的變化。

圖9 4個軸承的驗證預測結果

在線過程中,將測試軸承的監測信號依次輸入DLSTM,得到預測的RUL。圖10顯示了A組中100個軸承的實際RUL與預測RUL。結果表明,兩者非常吻合。

圖10 100個軸承的實際RUL與預測RUL

本文使用了一些最新的研究成果與DLSTM進行了比較,包括MLP[14]、SVR[15]、相關向量回歸(RVR)[6]、深卷積神經網絡(DCNN)[9]、帶模糊聚類的ELM(ELM-FC)[16]、支持向量機(SVM)[17]、具有KF的回波狀態網絡(ESN-KF)[18]和基于相似性的方法(SBA)[19]。表3展示了各方法的性能比較,其中NA表示信息不可用。表4比較了不同方法的關鍵參數,它們的得分Score、RMSE與RUL誤差范圍有關。可以看出,在這種RUL預測問題中,許多方法都顯示了各自的優勢,包括DCNN、ELM和SBA等。與其他方法相比,DLSTM具有最小的Score、RMSE和RUL誤差范圍。這意味著所提出的DLSTM具有最好的預測性能,驗證了本文的DLSTM對該軸承預測問題的有效性。

表4 所有方法的關鍵參數

5.2 案例二

由于包含了更多的故障模式,使用C組數據集進行準確的RUL預測比A組數據集困難得多。本文利用C組數據集比較了DLSTM和其他RNN方法的RUL預測性能,包括深度遞歸神經網絡(DRNN)、深門控遞歸單元(DGRU)、雙向GRU(BDGRU)和雙向LSTM(BDLSTM)。所有的方法都采用了網格搜索和丟棄的方法來獲得最優模型,關鍵參數見表4。圖11展示了五個模型的RUL誤差的箱形圖。五個模型100個軸承的RUL誤差集中在0附近,與其他模型相比,DLSTM的RUL預測誤差更為集中,說明DLSTM預測穩定性更好。

圖11 五個模型的RUL誤差的箱形圖

表5根據三個評估指標和時間消耗比較了五個模型的預測結果,可以看出,所提出的DLSTM在Score、RMSE和RUL誤差范圍方面始終優于其他RNN模型。BDLSTM和BDGRU由于其獨特的雙向網絡結構,能夠更好地處理時間序列數據,因此,BDLSTM和BDGRU的評估指標略差于最優結果。由于DRNN結構最簡單,與其他進化的RNN結構相比,DRNN的預測結果相對較差。在時間消耗分析方面,DLSTM與其他模型相比沒有明顯的優勢,這是因為DLSTM具有相對復雜的網絡結構。所有模型的在線平均計算時間均符合工業要求,因此DLSTM可以應用于工業系統的實際設備中。

表5 C組數據集上五個模型的性能比較

6 結 語

本文通過建立的DLSTM模型,提出了一種多傳感器數據融合驅動的滾動軸承RUL預測方法,并通過實驗數據進行了驗證,得出如下結論:

(1) DLSTM模型能夠通過DL結構捕獲傳感器時間序列信號之間隱藏的長期依賴性,從而充分地利用傳感器數據,提升預測精度。(2) 多傳感器數據融合驅動與建立的DLSTM相結合可以有效地提升剩余壽命的預測精度,并且具備良好的效率和收斂性。(3) DLSTM模型在線平均計算時間相對其他預測方法并未體現明顯的優勢,但是能夠符合工業要求,驗證了DLSTM可以應用于工業系統的實際設備中。(4) 該方法具有多傳感器數據融合能力,方法本身具備一般性,可廣泛應用于其他領域的不同類型設備。