基于實時交通狀況和自適應像素分割的運動車輛檢測

孫 敏, 李 免, 趙玉舟, 孫 偉,2*, 張小瑞

(1. 南京信息工程大學 自動化學院, 江蘇 南京 210044;2. 江蘇省大氣環境與裝備技術協同創新中心, 江蘇 南京 210044;3. 南京信息工程大學 無錫研究院, 江蘇 無錫 214100)

1 引 言

在智能交通系統中,車輛檢測是車輛跟蹤、車輛識別的重要前提,良好的車輛檢測會使后續的跟蹤、識別更加準確、可靠,且對緩解日益嚴重的交通擁堵和方便大眾出行具有重要的經濟和社會意義。

目前常用的基于計算機視覺的車輛檢測方法大致分為兩類:(1)基于視頻序列的車輛檢測方法;(2)基于特征學習的車輛檢測方法。

基于視頻序列的車輛檢測方法包括光流法[1]、幀間差分法[2]、背景減除法[3]、Blob分析[4]等。光流法利用像素點矢量特性,根據運動速度建立光流場來分析運動目標,該方法計算復雜,對設備運算能力要求高,難以實現快速檢測。幀間差分法是指在相鄰幀圖像之間做差分運算,將超過設定閾值的像素點作為運動目標,該方法速度快,但容易出現“空洞”現象,準確性較差。背景減除法需要建立合理的背景模型,但只適用于攝像頭固定且初始場景相對穩定的場景,當目標在場景中緩慢移動時,容易出現“鬼影”,不能保證算法的準確性。

基于特征學習的車輛檢測方法可分為基于人工特征的方法和基于自動特征的方法。在基于人工特征檢測方面,陳華清[5]等人提出基于Hog特征的檢測模型,利用Hog特征的全局不變性對車輛進行全局特征提取。在基于自動特征檢測方面,劉志成等人提出基于深度學習的多層卷積網絡對車輛進行檢測,如DCNN[6]、Yolo[7]。鄧淇天等人提出基于多特征融合的車輛檢測算法[8]。基于人工特征的方法對光照、拍攝視角以及汽車尺度變化比較敏感,易導致檢測率和可靠性下降。基于自動特征的方法盡管能有效克服光照、車輛尺度變化的影響,但訓練網絡需要大量的數據樣本,且模型訓練時間長、硬件配置條件高。

傳統基于像素的自適應分割器方法(Pixel-Based Adaptive Segmenter,PBAS)[9]使用多幀連續圖像來初始化背景模型,在一定程度上能緩解基于樣本點的非參數背景模型的“鬼影”現象,具有類似人工特征檢測模型的實時性和準確率,而且不像自動特征模型那樣需要大量的訓練樣本和高的硬件配置。但面對車輛在場景中出現緩慢移動或短暫滯留情況時,傳統PBAS方法在進行背景模型初始化時仍可能帶入“鬼影”。并且傳統PBAS算法需要實時計算更新背景模型參數,而在實際交通場景中背景模型是否需要更新跟車輛所處的交通狀態直接相關,如果交通狀態沒有明顯發生改變,就不需要實時更新背景模型參數;如果不加區分,直接實時地計算和更新背景模型參數反而會導致計算量的急劇增加。因此,有必要對傳統PBAS算法進行改進。

本文提出一種基于實時交通狀況和自適應像素分割的車輛檢測算法,其創新之處如下:(1)所提算法能根據車流量的多少對當前交通狀況進行評估,根據評估結果自適應地決定是否需要對車輛檢測的背景模型進行更新以及如何進行更新,從而顯著提高車輛檢測的準確率和實時性;(2)采用多幀不連續的間隔圖像來構建理想的初始模型,在提高算法實時性的同時能降低因車輛緩慢移動或短暫滯留產生“鬼影”的概率;(3)提出基于時-空變化度的背景區域變化評價方法,聯合時域變化度、空域結構變化度和空域顏色變化度,對背景區域是否發生變化進行評價,為背景模型是否需要更新提供可靠的決策依據;(4)基于時-空變化度制訂自適應的學習率更新策略,通過設置信任區間,并根據當前交通狀況和像素點是否處于信任區間內來判斷當前的背景模型是否需要更新,從而大幅減小模型的計算量。

2 基于實時交通狀況和自適應像素分割的車輛檢測算法

傳統PBAS方法在進行背景模型初始化時會帶入“鬼影”[10],并且由于PBAS算法需要更新前景-背景的判斷閾值和學習率等參數導致每幀圖像的處理速度降低,模型計算量隨時間急劇增加,一定程度上會影響算法的實時性[11]。

為解決傳統PBAS方法的不足,本文從背景模型初始化、交通狀況評估與信任區間更新、前景檢測和背景更新4個方面對傳統PBAS方法進行改進。

2.1 背景模型初始化

針對車輛在交通場景中出現緩慢移動或短暫滯留的情況,使用多幀不連續圖像初始化背景模型,在降低“鬼影”產生的同時降低運算量。

假定像素(x,y)的背景模型為B′(x,y),則背景模型初始化時,采用固定時間間隔的多幀背景圖像為:

(1)

其中,K為固定的時間間隔,I1是第一幀圖像的像素值,I1+(N-1)×K為第1+(N-1)×K幀圖像的像素值。將第一幀圖像的像素值初始化為背景模型的第一個樣本,將第1+(N-1)×K幀圖片的像素值初始化為背景模型的第N個樣本。后續實驗表明,當K=10,N=20時,模型能夠取得較好的效果,既能防止車輛緩慢行駛或短暫滯留產生的“鬼影”現象,又能保證算法的實時性。

2.2 交通狀況評估與信任區間更新

在城市交通環境中,交通狀況的變化對PABS背景模型的更新影響較大[12]。一般而言,當交通狀況發生變化時,背景模型及參數需要及時更新以適應變化的交通場景;當交通狀況保持不變時,背景模型及參數則不需要更新以保證算法的實時性[12]。為了使模型能夠適應實際的交通狀況,本文提出一種改進的交通狀態評估和信任區間更新方法。

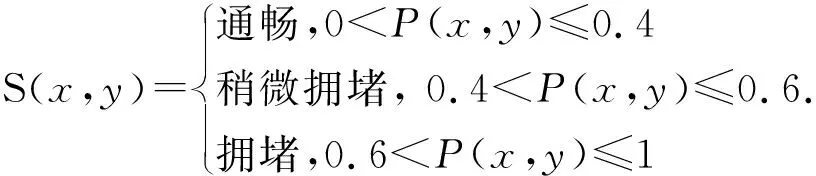

首先,為任意像素點(x,y)設定信任時間段c(x,y),并稱該時間段為這個像素點的信任區間。采用與文獻[13]類似的交通狀態評估方法,首先定義交通擁堵度P(x,y)=d(x,y)/f(x,y),其中,d(x,y)表示信任區間內從第一幀到當前幀檢測結束時像素點被檢測為前景的次數,f(x,y)表示當前幀在信任區間的幀序數。然后根據P(x,y)將當前交通狀況簡化為“通暢”、“輕微堵塞”和“堵塞”3個狀態,如式(2)所示:

(2)

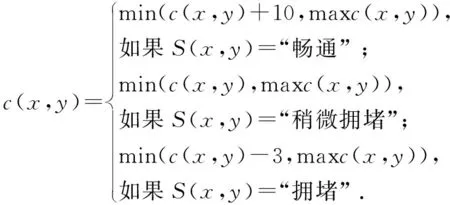

定義h(x,y)為信任區間內像素點前景-背景之間轉變的次數。h(x,y)數值越小,表示該背景模型越穩定;h(x,y)數值越大,表示背景模型越不穩定,需要更新背景模型以獲得穩定的背景模型。因此,在每個信任區間結束時,可以基于h(x,y)和f(x,y)判定每一像素點位置背景模型的穩定性,進而更新c(x,y)的值。具體更新步驟如下:

(1)如果h(x,y)/f(x,y)<τd,意味著此時背景模型穩定,當前幀的背景模型應當被保留,信任區間按式(3)進行更新:

(3)

需要注意的是,τd為預先設定的閾值,如果τd的值過大,算法則不能及時感應到交通狀態的變化;如果其值設定的過小,算法對交通狀態的變化會過于敏感,抗干擾性就會降低。通過大量的現場實驗,本文設置τd=1/3,能夠較好地平衡算法的敏感性和抗干擾性。

(2)如果h(x,y)/f(x,y)≥τd,意味著背景模型可能不穩定,則應更新當前背景模型以適應動態場景,此時信任區間按式(4)進行更新:

(4)

在實際的更新過程中,令c(x,y)∈[minc(x,y),maxc(x,y)]=[25,30],設c(x,y)的初始值為25,在信任區間更新后,h(x,y)、d(x,y)、f(x,y)的值都重置為0。

2.3 前景檢測

(5)

為了提高判定背景區域是否發生變化的準確性,本文提出了一種基于時-空變化度的背景區域變化評價方法,其中,空域變化度由區域結構變化度和顏色變化度兩部分組成。

(6)

基于時域變化度、空域結構變化度和空域顏色變化度,提出的時-空變化度計算公式如式(7)所示:

Vt,s(x,y)=Vt(x,y)+βVs,s(x,y)+γVs,c(x,y),

(7)

利用時-空變化度,按公式(8)更新判定閾值:

(8)

Rinc/dec表示閾值增加/減少參數,Rscale表示全局參數,Rinc/dec=0.05,Rinc/dec決定了R′(x,y)的調整幅度。Rscale=5,本文R′(x,y)的最小值Rlower取值為18,R(x,y)的初始值也設為18。

此外,為了解決背景模型在更新過程中前景點易過快融入背景的問題,所提算法在學習率T(x,y)中加入了自適應控制策略,如式(9)所示:

(9)

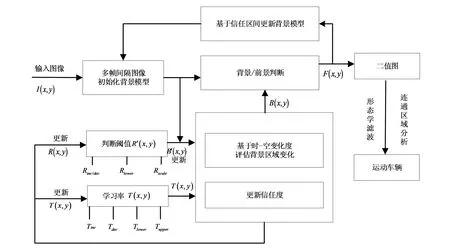

其中,Tinc和Tdec為固定的增減參數,同時給T(xi)設定上下限:Tlower 對當前圖像像素進行前景和背景分類后,還需根據實際交通背景的變化,選擇性地更新背景模型[14],具體策略如下: (1)當f(x,y) (2)當f(x,y)=c(x,y),即當前幀的像素點在信任區間的末尾。如果h(x,y)/f(x,y)<τd、Ft(x,y)=0且當前交通狀況S(x,y)為暢通時,則需要背景更新。當信任區間結束后,如果h(x,y)/f(x,y)<τd且當前交通狀況S(x,y)為暢通時,則需要利用當前的交通狀況更新背景;如果h(x,y)/f(x,y)≥τd,此時不管當前像素值I(x,y)檢測結果為背景或前景,僅在交通狀態S(x,y)為暢通時,才進行背景更新。 綜上所述,基于實時交通狀況和自適應像素分割算法的車輛檢測流程如圖1所示。 圖1 基于實時交通狀況和自適應像素分割算法的車輛檢測示意圖Fig.1 Vehicle detection algorithm based on real-time traffic condition and adaptive pixel segmentation 本文實驗基于Windows 7系統,所使用CPU為IntelCore i5-6500,主頻3.20 GHZ,內存8 G,顯卡型號為GTX1050,顯存2 G,軟件環境為Matlab R2016a,opencv 2.4.9。為了驗證本文算法的有效性,本文從OTB網站[15]下載了多個不同環境下的交通車輛視頻序列作為測試集進行測試。 在正常光照情況下,各車輛檢測算法檢測結果如圖2所示。 從圖2(b)和2(c)中可以看出,光流法和幀間差分法存在明顯的“空洞”現象,車前玻璃到車頂區域較為明顯,嚴重影響車輛的完整性,但其算法簡單,實時性好;由圖2(d)可以看出,運用vibe模型進行車輛檢測減少了“空洞”現象,但同一車輛不同部分存在邊界不連續的現象,且vibe模型計算量大,不能滿足實時性的要求;圖2(e)是基于實時交通狀況和自適應像素分割算法的車輛檢測結果,從中可以看出,該算法保證了運動車輛的完整性,檢測效果最佳。對比這4種算法可以得到,基于實時交通狀況和自適應像素分割的運動目標檢測算法能夠保證運動目標的完整性,且有效提高了運動車輛檢測的準確性。 圖2 不同算法檢測運動車輛對比結果Fig.2 Results of different algorithms for detecting moving vehicles 分別選取陰雨天氣、多車檢測、光照變化等復雜場景進行對比實驗并進行分析,檢測結果如圖3所示。 在陰雨天氣下,光照不足、空氣中的流動雨滴等因素給運動目標的檢測造成干擾,光流法所檢測出的車輛輪廓不連續,幀差法出現了明顯的“空洞”現象,vibe模型將周邊的路標誤檢為前景,本文提出的算法較好地檢測出了車輛的完整輪廓。多車檢測中,光流法、幀差法、vibe模型檢測結果或多或少存在著空洞現象。由于周圍建筑物遮擋,小車受到的光照由強變弱,光流法、幀差法、vibe模型均不能完整地檢測出運動車輛,而本文提出的算法能夠在上述兩個場景中清晰地檢測出運動車輛,且噪聲也較少。 圖3 白天復雜場景下4種算法檢測結果Fig.3 Detection results of four algorithms in complex scenes 由表1可知,本文算法在不同場景中檢測的性能指標Recall、Precision和F-measure分別為0.929,0.864,0.888,均高于其他檢測算法。此外,由表2可知,本文算法的處理時間為88.37 ms,比傳統PBAS算法的運算速度快近10 ms,能夠更好地應對城市內快速變化的交通環境。綜合表1和表2,在相同條件下,對相同場景的運動目標進行檢測時,相較于傳統PBAS算法,本文所提算法所用時間較短,同其他常用算法相比,本文所提算法的Recall、Precision和F-measure指標均為最高。 表1 5種檢測算法在3個場景下檢測性能指標對比Tab.1 Comparison of five detection algorithms in three scenarios 表2 不同檢測算法的平均處理時間Tab.2 Average processing time of different detection algorithms (ms) 為了驗證本文算法在夜晚弱光和交通狀態變化情況下的性能,采集某一丁字路口的交通視頻進行實驗。基于本文算法,某一幀視頻的檢測結果如圖4所示,其中圖4右邊為快速主干車道,車道上的車輛運動速度較快;左邊為慢速旁支車道,因為要進入主干車道,速度較慢并有短暫滯留。從圖4中可以看出,盡管是在光照不足的夜晚,無論是速度較快的車輛還是速度較慢、短暫滯留的車輛,本文所提算法均能將其準確完整地檢測出來。進一步對圖4所示慢速旁支車道車輛檢測的結果進行統計,結果表明本文方法的檢測準確率達到0.827,而基于光流法、幀差法、vibe模型和傳統PBAS方法的檢測準確率分別為0.606,0.432,0.579,0.746。說明在車速較慢或短暫滯留交通狀態下,本文方法比其他4種方法的車輛檢測效果更好。 圖4 夜晚路口交通狀況變化時的檢測結果Fig.4 Detection results for different vehicle speeds at night 除了與基于人工特征的方法進行對比之外,本文還與基于YOLOv3的自動特征檢測方法[16]在PASCAL VOC 數據庫上進行了對比,檢測結果如表3所示。從表3可以看出,基于YOLOv3的方法在Recall、Precision方面都有較好的表現,但在算法復雜性和可移植性方面,本文方法具有明顯的優勢。這是因為基于YOLOv3的車輛檢測方法采用CNN和深度學習算法進行自動特征提取,其網絡結構和訓練過程復雜繁瑣,不僅需要GPU顯卡進行加速,而且需要采集數量龐大的訓練樣本并對其進行人工標注和長時間訓練,因而在實際應用中也不利于向已有的嵌入式設備上進行移植。 表3 與基于YOLOv3檢測算法的性能對比Tab.3 Performance comparison between YOLOv3-based method and the proposed method 本文算法針對在城市交通中車輛檢測存在的一系列問題做出優化。城市道路上,光照變化、多車重疊等干擾情況較多,因此本文算法在進行前景檢測時,結合時域和空域進行綜合判定,在Precision和Recall方面都有較好表現。此外,相較于國道、高速公路等道路,城市道路背景較為不穩定,本文算法為背景模型更新設定的信任區間,能夠在背景出現小幅度變化時維持穩定,減少了算法的計算量,因此相比傳統PBAS算法在平均處理時間上占有一定優勢。 本文提出了一種基于實時交通狀況和自適應像素分割的運動車輛檢測方法。該算法采用多幀間隔圖像來獲取理想的初始模型,從而降低了“鬼影”產生的可能性。車輛檢測性能指標Recall、Precision和F-measure分別為0.929,0.864,0.888,均高于傳統檢測算法。提出的基于時-空變化度的背景區域變化評價方法,能夠及時有效地更新判定閾值和學習率。通過設置信任區間,并根據當前交通狀況和像素點是否處于信任區間內判斷當前的背景模型是否適合更新,降低了計算的復雜度。在測試中,本文所提算法處理時間為88.37 ms,比傳統PBAS算法的運算速度快近10 ms。實驗結果表明,本文提出的算法能夠快速、準確地檢測出運動目標,而且在復雜城市道路場景下仍具有較強的魯棒性。2.4 背景更新

3 實 驗

4 結 論