改進SSD算法及其在地鐵安檢中的應用

張 震,李孟洲,李浩方,馬軍強

(鄭州大學電氣工程學院,鄭州450001)

0 概述

近年來,隨著互聯網大數據的快速發展、計算機運算能力的提升以及國內外在深度學習研究上的突破,目標檢測技術日趨成熟。目前,將目標檢測與實際應用場景結合是一個熱門方向[1],但較少用于地鐵安檢方面,地鐵安檢仍采用人為識別的方法。由于安檢工作人員的熟練程度以及精神狀態都可能會影響安檢的準確率[2],因此將目標檢測用于地鐵安檢具有重要的研究意義。

GIRSHICK 等于2014年提出了R-CNN(Regions with CNN Features)[3]算法,促使深度學習在目標檢測領域快速發展。此后,SPP-Net(Spatial Pyramid Pooling Networks)、YOLO[4-5]、YOLO2、Fast RCNN[6]、Faster RCNN[7]、SSD[8]、DSSD[9]等算法的出現也進一步促進了目標檢測的發展。目前主流的目標檢測算法大致分為兩類:一類是基于R-CNN 進行展開,以Faster RCNN 為代表的兩階段算法;另一類是以YOLO 和SSD 為代表的一階段算法。兩階段算法先進行區域選取,再對所選區域進行分類,一階段算法則是對產生的區域同時進行這兩項操作。兩階段算法的檢測精度略高于一階段算法,但檢測速度很慢,因此,兩階段算法不適用于地鐵安檢這類對實時性要求較高的應用場景。在一階段算法中,SSD 算法已被廣泛應用于目標檢測并取得了不錯的效果,如文獻[10]將SSD 應用于艦船目標檢測,文獻[11]將SSD 應用于柑橘實時分類檢測,文獻[12]將SSD 應用于果園行人實時檢測。

本文提出一種改進的SSD 算法,通過輕量級網絡融合對傳統SSD 算法中的金字塔特征層進行特征增強,同時加入一種基于殘差模塊的檢測單元以避免增加網絡模型容量,從而在提高檢測精確度的同時保證識別速度。

1 SSD 目標檢測

SSD 目標檢測算法在YOLO 的基礎上融合了RPN 的思想。該算法在多個不同尺度上對輸入圖片進行檢測,且在各特征層上都使用不同的卷積模型,從而使模型具有更高的識別準確率。此外,作為一階段算法,其檢測速度比兩階段算法快得多。

雖然SSD 能夠改善傳統算法對物體尺度敏感、對尺度變化大的物體泛化能力差的缺點,但仍存在對小目標檢測精度低的問題[13-15]。對此,多種改進的SSD 算法相繼被提出[16-18],如DSSD、DSOD 等。DSSD 將SSD 的基礎網絡由VGG-16 改為ResNet,并且引入反卷積層用于傳遞信息,盡管提高了識別小目標的準確率,但是網絡結構復雜,使識別速度變慢,實時性變差。DSOD 先將基礎網絡換為DenseNet,再融合兩層特征圖,不僅加快了訓練速度,而且提高了檢測性能。

1.1 傳統SSD 的網絡結構

傳統SSD 檢測模型結構分為兩部分:第一部分是利用卷積神經網絡來提取輸入圖像特征信息的分類網絡VGG-16;第二部分是后端的多尺度檢測網絡。由于淺層的特征圖適用于小目標檢測,而深層的特征圖適用于大目標檢測,因此多尺度檢測網絡需要在不同深度的特征圖上進行回歸計算和極大值抑制,并輸出最終結果。傳統SSD 網絡結構如圖1所示。

圖1 傳統SSD 網絡結構Fig.1 Structure of traditional SSD network

1.2 傳統SSD 特征圖默認邊框尺度

SSD 算法通過利用多尺度的方法來獲取特征圖。假設檢測時采用的特征圖層數為n,那么第k個默認框比例sk可表示為:

其中:smin表示特征層的默認框占輸入圖像的最小比例,一般取為0.2;smax表示特征層的默認框占輸入圖像的最大比例,一般取為0.95。為加強默認框適應檢測物體大小的能力,SSD 算法對相同特征層設置了不同寬高比的默認框。本文選擇默認框的寬高比尺寸為r={1,2,3,1/2,1/3},其中,默認框的寬度和高度分別為:

其中,m表示5種默認框的寬高比尺寸,m∈{1,2,3,4,5}。當默認寬高比等于1 時,增加1 個默認框比例s′k:

因此,SSD 在每個特征圖共產生6 個默認框,第6 個默認框的寬度和高度表示為:

其中:(cx,cy)代表特征層上默認框的中心坐標;wb和hb分別代表默認框的寬度和高度;wfeature和hfeature分別代表特征層的寬度和高度;wimage和himage分別代表原始圖像的寬度和高度。求得的(xmin,ymin,xmax,ymax)代表第k層特征圖上中心坐標為、寬度和高度分別為wk和hk的默認框映射到原始圖像的具體坐標。

1.3 傳統SSD 的損失函數

SSD 算法的損失函數可表示:

其中:x為當前預測框的類別匹配信息;c代表標注類別;l代表預測邊界框坐標;g代表標注邊界框坐標;N代表匹配到的default box 的數量;Lconf(x,c)代表分類損失;Lloc(x,l,g)代表位置損失;α代表兩者的權重,本文將其設置為1。

Lloc(x,l,g)借鑒Faster RCNN 的位置回歸函數smoothL1,可表示為:

其中:xij,p={1,0}代表當前第i個預測框匹配類別p的第j個目標框真值;Pos代表樣本中正例;Box代表預測框中心的坐標及其寬和高的集合;li,m代表先驗框的預測值;g?j,m代表真實框的位置參數。SL1可表示為:

Lconf(x,c)用交叉熵損失函數可表示為:

1.4 傳統SSD 目標檢測存在的不足

傳統SSD 算法低層次的定位效果好但是分類精度低,又由于6 個不同特征圖相互獨立,因此其對小目標的檢測效果一般。造成以上情況的主要原因是:

1)特征圖維度會隨著CNN 層數的增加而變小,進而得到語義特征更加明顯的結果,同時位置信息也變得更加模糊。如果采用的是SSD_300×300 的模型,則主要依賴Conv4_3 檢測小目標,雖然其分辨率較高,而且先驗框的尺寸和檢測目標更接近,但是特征表達的能力卻僅來源于前10 層卷積層,顯然不能很好地捕捉深層次語義信息。

2)隨著卷積層數的增加,輸入圖像的感受野和映射區域也會擴大,卷積感受野過大時會降低精確定位目標的性能,并且當映射區域過大時,如果出現在檢測區域包括多個檢測目標的情況,則無法有效地區分目標。

針對以上問題,本文提出融合輕量級網絡來改進傳統SSD 算法,通過加入基于殘差模塊的檢測單元來避免增加網絡模型容量以及運算復雜度,同時提高檢測精確度。

2 改進的SSD 算法

本文改進的SSD 算法整體網絡結構框圖如圖2所示,首先對Conv4_3、Conv7、Conv8_2、Conv9_2、Conv10_2(簡記為ConvY_Y)這5 個特征層進行卷積操作(由于Pool11 的特征層尺寸很小,包含語義信息較多,因此無需對其進行卷積操作)。為避免特征融合后再進行特征降維操作,要求進行卷積操作后生成的Conv4_3_0、Conv7_0、Conv8_2_0、Conv9_2_0、Conv10_2_0(簡記為ConvY_Y_0)的特征維數不超過原始的特征維數[19]。然后將Conv4_3和Conv4_3_0、Conv7 和Conv7_0、Conv8_2 和Conv8_2_0、Conv9_2和Conv9_2_0 以及Conv10_2 和Conv10_2_0 這5 對兩兩融合,依次得到Conv4_3_1、Conv7_1、Conv8_2_1、Conv9_2_1 和Conv10_2_1,并與Pool11 形成最終的金字塔特征層[19]。

圖2 整體網絡結構框圖Fig.2 Block diagram of overall network structure

ConvY_Y_0 比ConvY_Y 具有更強的語義信息和更大的卷積特征尺度。同時,由于本文提出的卷積沒有改變補邊的特征尺寸,因此能更好地保留原特征圖的邊緣信息。所以,本文最終形成的金字塔特征層與傳統SSD 算法的金字塔特征層相比,增強了特征層的語義信息,改善了SSD 算法對小物體識別率低的問題。由于生成的特征層相比于最初的特征層特征維數沒有升高,特征圖的邊緣特征沒有損失,因此在特征融合時高層特征不僅無需調整尺寸,而且不用進行降維操作,相比于傳統的特征融合操作,本文采用的特征融合方法更具優勢。上述改進雖然提高了檢測精度,但是難免會使檢測網絡復雜化,從而降低識別速率。針對以上情況,本文新加入基于殘差模塊的檢測單元,從而實現特征圖維度與主分支維度的統一,避免網絡模型容量和運算復雜度增加。

2.1 特征融合策略

特征對應元素相加與特征連接是特征融合策略中最流行的2 種融合方式[16,20]。基于特征連接的特征融合方式,本文設計一種輕量級特征融合方式來對金字塔特征層進行特征增強。

在進行特征融合時,要求ConvY_Y_0與ConvY_Y尺寸相同且ConvY_Y_0的維數不高于ConvY_Y,因此,在進行特征融合的操作時不必調整特征圖的尺寸,也不用對融合后的特征進行降維,從而大幅簡化了操作。

在進行特征融合時,設x為輸入特征,f(x)表示對x進行卷積操作,y表示x卷積后的特征,則y=f(x)。如果(x,y)表示特征x和特征y進行首尾相連的操作,那么相應的特征連接操作可表示為Fconcat=(x,y),表示特征x和特征y進行首尾相連操作后得到的特征。

特征連接的特征融合方式如圖3所示,將ConvY_Y_0 的特征維數統一設置為128 維,低于ConvY_Y 特征層的特征維數,然后直接將ConvY_Y與ConvY_Y_0 串聯得到ConvY_Y_1,將這種特征融合稱為輕量級網絡融合。

圖3 特征連接的特征融合方式Fig.3 Feature fusion mode of feature connection

2.2 基于殘差模塊的檢測單元

本文通過加入一種基于殘差模塊的檢測單元來避免增加網絡模型的容量以及運算復雜度,并防止直接用主干網絡來預測目標[21]。殘差模塊分為短接分支和主分支2 個部分,其結構如圖4所示。主分支共包含3 個卷積層,即2 個1×1 的卷積層和1 個3×3的卷積層;短接分支主要作用是用1 個1×1 的卷積層使特征圖與主分支的維度達到統一[21]。在網絡訓練過程中,每個卷積層后都添加了1 個非線性激活層,此做法不僅可以降低預測單元所產生的梯度值對主干網絡形成的影響,而且還可以起到緩沖的作用。同時,由于殘差模塊的加入,預測層的網絡深度加深,能有效改善淺層特征圖語義表征能力較弱的問題[21]。本文新加入殘差模塊的作用雖然與插入3×3卷積模塊基本相同,但是殘差模塊中的1×1 卷積層可以將特征圖調整到比較低的維度[21]。因此,本文新插入的殘差模塊要比直接插入1 個3×3 卷積模塊占用的模型參數低得多。

圖4 ResBlock 結構Fig.4 Structure of ResBlock

本文采用類似Faster RCNN 的anchor 機制,Faster RCNN 采用的是3×3 的卷積核,因為模型參數與運算量會隨著卷積核的減小而降低,所以本文嘗試采用1×1 的卷積核,經過實驗發現1×1 的卷積核不僅沒有明顯降低檢測精度,反而能夠提高網絡的運算速率。此外,由于加入的殘差模塊可以起到統一維度的效果,因此即使是不同預測單元上的分類器也能夠在訓練過程中達到參數共享。相比于傳統SSD 直接在網絡卷積層上面提取目標,然后再針對不同的檢測單元訓練出其對應的分類器而言,本文所采取的操作要更為簡單實用。綜上,本文新加入的殘差模塊能夠大幅降低網絡模型大小,從而提高網絡的運算速率。

2.3 網絡模型的訓練策略

在網絡模型訓練的過程中,需要對訓練數據集進行翻轉、旋轉以及亮度與尺度變化,從而提高網絡模型的穩健性。由于本文算法形成了新的金字塔特征層,與傳統SSD 相差較多,因此不能直接在已經訓練好的SSD 模型上修改。本文以VGG-16 網絡作為改進SSD 算法的基礎框架,訓練位置損失函數采用smooth L1,訓練分類損失函數采用Log loss。此外,本文算法的學習率、提取各個特征層所對應的Box長寬比以及挖掘決策困難樣本均和傳統SSD 算法相同,IOU 值設置為0.5。

本文使用的GPU 型號為GTX1080 Ti,基于Ubuntu16.04 操作系統,在TensorFlow 平臺上完成對改進SSD 算法的訓練以及測試的工作。由于設備的限制,本文提出的算法采取單GPU 訓練。

3 實驗與結果分析

本文算法主要解決了傳統SSD 算法對小目標識別率低的問題,并新加入基于殘差模塊的檢測單元避免增加網絡模型容量以及運算復雜度。實驗通過對mAP、FPS 的測試來驗證本文算法對傳統SSD 的改進程度。此外,將本文訓練好的算法用于地鐵安檢圖像的檢測,以驗證其應用性能。

3.1 實驗步驟

首先將在ImageNet 訓練好的VGG-16 網絡作為本文算法的基礎框架,然后在PASCAL-VOC2007 的訓練集與驗證集上來訓練本文算法,并以mAP 和FPS 作為性能指標在其測試集上檢測本文算法對小目標檢測的能力,最后與性能優異的改進SSD 算法、YOLOv3 算法和Faster RCNN 算法進行比較。

3.2 評價指標

本文使用的評價指標為平均準確率均值(mAP)與檢測速率(FPS)。其中,平均準確率均值是所有類別平均準確率(AP)的平均值,檢測速率為每秒處理圖像的幀數。

平均準確率定義為:

其中,R代表召回率,P代表準確率。

3.3 PASCAL-VOC2007 的測試結果

PASCAL-VOC2007 是1 個標準的小目標數據集,其具體的物體類別見表1。該數據集提供的圖片集共分為20 種類別。

表1 PASCAL-VOC2007 具體的物體類別Table 1 PASCAL-VOC2007 specific object categories

為對比本文算法與傳統SSD、DSSD、DSOD、YOLOv3 和Faster RCNN 的檢測性能,從PASCALVOC2007 數據集中挑選189 具有代表性的圖片,共涉及11 種物體類別,分別為飛機、船、小轎車、鳥、貓、狗、馬、羊、瓶子、盆栽植物和人。對這些圖片進行相應的處理后,標注物體的ground truth 共有1 601 個。分別采用傳統SSD 算法、DSSD 算法、DSOD 算法、YOLOv3 算法、Faster RCNN 算法和本文算法進行目標檢測實驗,mAP 指標測試結果如表2所示,FPS 指標測試結果如表3所示。其中,本文算法與傳統SSD算法是在單個1080 Ti GPU 測試的,而其他算法則是在單個Titan X GPU 上測試的。

表2 不同算法在PASCAL-VOC2007 數據集上的mAP 指標Table 2 mAP indicators of different algorithms on PASCAL-VOC2007 data set

表3 不同算法在PASCAL-VOC2007數據集上的FPS指標Table 3 FPS indicators of different algorithms on PASCAL-VOC2007 data set

從表2 可以看出,本文算法的mAP 指標相比于傳統SSD 算法提高了8.5%,并且檢測物體越小,檢測精度提升得越高,比DSOD 算法的mAP提高1%,比YOLOv3 算法提高2%,比Faster RCNN算法提高3.9%。本文算法比DSSD 算法的mAP低0.8%的原因是DSSD 的基礎網絡是ResNet-101,該網絡比VGG-16 網絡深、性能好,但是結構也更為復雜,大幅降低了檢測速率,不適用于對檢測速度要求較高的檢測場景,從表3 中也驗證了這一結論。

由于本文算法在進行特征融合時既不需要進行降維操作也不需要調整圖片尺寸,同時加入了一種基于殘差模塊的檢測單元,可避免增加網絡模型容量以及運算復雜度,因此本文算法的FPS 相比于傳統SSD 的85 frame/s 僅損耗了2 frame/s,可達到83 frame/s,遠高于DSSD、DSOD 和Faster RCNN 算法,同時也高于YOLOv3 的51 frame/s。

3.4 地鐵安檢圖像的檢測結果

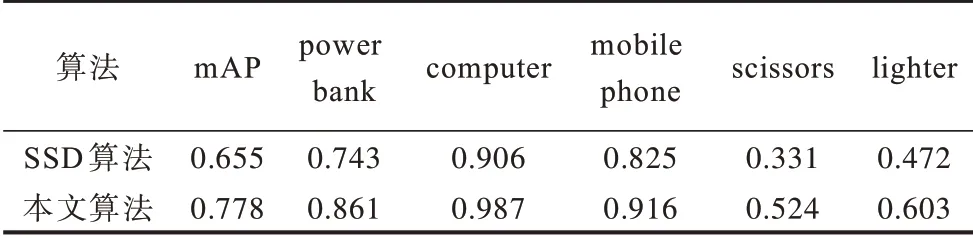

地鐵安檢圖像中的一些小物體(如指甲刀、打火機等)往往只占據檢測圖片中的很小一部分,同時有可能會被別的物體覆蓋,增加了檢測的難度。本文收集了約550 張的地鐵安檢圖像,其中,包含的檢測目標數量基本均衡,對所有圖像采用多目標標記,然后隨機選取總數的30%作為測試集,其余的分為訓練集和驗證集。分別用傳統的SSD 算法和本文算法進行目標檢測實驗,圖5 為部分的檢測結果,從中可以看出本文算法對檢測結果的改進。表4 為測試各類目標的mAP 指標。

表4 傳統SSD 算法與本文算法的mAP 指標對比Table 4 Comparison of mAP indicators of traditional SSD algorithm and the proposed algorithm

圖5 傳統SSD 算法與本文算法的檢測結果對比Fig.5 Comparison of detection results of the proposed algorithm and traditional SSD algorithm

4 結束語

從圖5 的檢測結果圖和表4 中的檢測結果可以看出,本文算法較傳統SSD 算法檢測更準確,在對小目標(如scissors)上檢測精度提升更為明顯,mAP 提升了12.3%。

本文對SSD 算法中各尺度特征進行尺寸大小不變的卷積操作,將卷積前后對應的特征進行輕量級網絡融合,進而生成新的金字塔特征層,最后通過加入基于殘差模塊的檢測單元,提升檢測精確度。實驗結果表明,在用于地鐵安檢圖像檢測時,該算法對于小目標的檢測精度較傳統SSD 算法提升明顯,并且能夠保證檢測速率,檢測速率達到83 frame/s。后續將對本文算法的網絡結構進行優化,進一步加快檢測速度,并且嘗試將算法應用于其他特定場景中。