一種面向圖神經網絡的圖重構防御方法

陳晉音 黃國瀚 張敦杰 張旭鴻 紀守領

1(浙江工業大學網絡空間安全研究院 杭州 310023) 2(浙江工業大學信息工程學院 杭州 310023) 3(浙江大學控制科學與工程學院 杭州 310007) 4(浙江大學計算機科學與技術學院 杭州 310007)

隨著深度學習的興起,圖神經網絡(graph neural network, GNN)成為了獲取圖節點特征和關系的有效工具之一.圖神經網絡可以通過訓練獲得節點或連邊的低維表達,并應用在不同下游任務中,例如:節點分類[1]、鏈路預測[2]、圖分類[3]、社區發現[4]等.盡管圖神經網絡在圖表示學習領域取得了的成功,但是一些研究[5-7]表明:圖神經網絡容易受到對抗樣本的攻擊,即對抗樣本中加入的擾動是經過精心設計并且是細微的,具有隱蔽性且能使得GNN失效.已有研究表明:現實應用已經受到攻擊,例如在電子商務領域,網絡水軍集中撰寫大量的虛假評論將使電商平臺的點評系統和推薦系統產生錯誤判斷,給真實的消費者錯誤的消費引導;在社交媒體網絡中,虛假新聞如果不能被有效檢測,則有可能導致謠言傳播并引起恐慌.因此,如何提高圖神經網絡的魯棒性至關重要.

目前,已經提出了許多對抗攻擊算法用于圖神經網絡漏洞發現,主要策略包括:添加連邊或刪除連邊[5-7]和添加虛假節點[8-9].這些攻擊的目的在于通過操縱某些節點或連邊,直接或間接影響目標節點的表達,或使圖神經網絡模型的全局性能下降.針對這些對抗攻擊,研究者提供了不同的防御策略:1)對抗訓練[10-11],將對抗樣本和干凈樣本混合訓練模型,提升模型對已知對抗攻擊的防御能力;2)對抗擾動檢測[12],通過發現對抗樣本與干凈樣本的差異實現對抗擾動檢測;3)基于注意力機制的模型加固[13-14],通過學習注意力機制實現對抗樣本的懲罰,從而訓練獲得魯棒的GNN模型;4)圖純化[15-17],通過對對抗擾動進行剔除并純化圖結構,從而保證模型的輸出準確性.此外,在樣本輸入模型進行訓練之前,對擾動圖進行純化降低攻擊帶來的影響,是一種可行且有效的方法[15-17].總結已有的防御方法,依然存在3個問題:1)已有不同的對抗攻擊方法通過增刪連邊生成對抗網絡,這些對抗樣本的擾動是否存在一定的規律;2)已有很多防御方法會犧牲正常樣本的分類效果達到防御的目的,如何確保GNN模型在正常樣本性能的前提下,盡可能消除對抗性攻擊的影響;3)如何從圖的結構、特征等方面的變化上對防御方法的有效性進行分析.

針對3個問題,本文首先分析了不同對抗攻擊方法的對抗樣本,通過攻擊實驗觀察得到對抗攻擊添加的連邊對應的節點對之間往往具有低結構相似度和低特征相似度的特點.基于實驗觀察,提出一種基于節點共同鄰居數和特征相似度的圖重構方法,通過刪除低相似度的可疑連邊以最小化對抗連邊帶來的影響;其次,通過連接節點特征相似度較高的節點以獲得圖數據增強,重構1個有利于圖神經網絡分類任務的新圖.由于圖卷積網絡(graph convolutional network, GCN)[18]和基于注意力機制的圖注意力網絡(graph attention network, GAT)[19]在圖表示學習領域中被廣泛使用,因此,將其作為本文實驗的目標模型.為了測試方法的有效性,本文采用了3種有效的攻擊方法來生成對抗網絡,即NETTACK[5],Metattack[20],DICE[21].實驗驗證了本文提出的基于圖重構的圖神經網絡防御方法能夠有效地降低攻擊者的性能,并提高圖神經網絡在干凈圖數據節點分類任務上的性能.

總結本文主要工作包括3個方面:

1) 提出了一種圖重構防御方法GRD-GNN,根據圖的結構信息(即節點的共同鄰居數)和節點自身特征相似度來篩選并降低對抗連邊帶來的影響.

2) 從多角度對方法的有效性進行分析,并通過圖神經網絡提取的信息的可視化,對GRD-GNN有效性進行了直觀解釋.

3) 在3個真實數據集上進行測試,并與最新的一些防御方法進行對比.大量的實驗驗證了本文提出的方法在保證干凈樣本分類任務的前提下比已有的防御方法取得更好的防御性能.

1 相關工作

本節簡要介紹圖神經網絡對抗攻擊和防御方面的相關工作.

1.1 面向圖神經網絡的攻擊

已有研究表明:圖神經網絡容易受到對抗擾動的攻擊,這些攻擊根據模型的結構精心設計微小的擾動并添加到原始網絡中,從而使得圖神經網絡失效.針對節點分類任務,Zügner等人[5]首次提出面向圖數據的對抗攻擊算法NETTACK,針對目標節點的置信度得分在目標函數的指導下迭代生成對抗連邊和特征.為了進一步降低模型的全局性能而不是僅針對個別目標,他們提出了一種基于元梯度的對抗攻擊方法Metattack[20],能大幅度降低圖神經網絡模型的全局分類性能;此外,Dai等人[6]提出的基于強化學習的對抗攻擊方法RL-S2V和Chen等人[7]提出的快速梯度攻擊方法FGA也被證明是有效的圖對抗攻擊方法;此外,不同于一般方法中添加或刪除連邊的方式,Greedy-GAN[8]利用生成對抗網絡(generative adversarial networks, GAN)生成一些與真實節點相似的虛假節點并插入到網絡中;類似地,Sun等人[9]也通過添加虛假節點和連邊的方式毒化數據集來降低圖神經網絡的性能;在沒有目標模型任何信息的情況下,黑盒攻擊方法GF-Attack[22]通過攻擊圖過濾器生效;對于鏈路預測任務,IGA[23]通過圖自編碼器(graph auto-encoder, GAE)[24]的梯度信息對目標連邊進行隱藏,從而使其進行錯誤預測;Zhou等人[25]通過刪除圖中的連邊來攻擊圖的局部相似度和全局相似度;針對社區發現任務,Chen等人提出了基于遺傳算法的Q-Attack方法[26]和進化擾動攻擊EPA[27].綜上所述,現有的圖對抗攻擊方法主要是通過添加或刪除圖中的關鍵連邊,從而降低GNN模型在各項任務中的性能.

1.2 面向圖神經網絡的防御

一方面攻擊的方法層出不窮;另一方面,研究者們開始注重模型漏洞的發現和加固,即如何采取有效的防御方法來增強圖神經網絡模型對對抗攻擊的魯棒性.針對防御方法的對象不同,防御方法可分為2類,即針對輸入數據的轉換的防御方法和針對模型結構的防御方法.針對數據轉換的防御,Dai等人在文獻[6]中提出了在訓練過程中隨機丟棄一些連邊進行對抗訓練來達到防御對抗攻擊的效果,實驗證明了這種方法對于模型魯棒性提高的作用不明顯;Wu等人[15]根據節點之間的Jaccard相似度利用貪心算法尋找相似度低的連邊,并通過設置閾值的方式刪除連邊達到防御效果,但是Jaccard相似度適用于2進制特征而忽略了特征中潛在的數值大小;Entezari等人[16]通過研究NETTACK的擾動性質,發現NETTACK僅影響圖的高秩(低奇異值)部分,據此提出了一種基于奇異值分解(singular value decomposition, SVD)的圖純化方法,該方法僅使用了top-k個奇異值對擾動圖進行過濾,從而達到濾除對抗連邊的效果,然而,由于僅考慮了前top-k個奇異值,因此存在丟失一些關鍵信息的風險;Jin等人[17]根據圖的稀疏性、低秩性和節點的特征平滑設計了一種魯棒的圖神經網絡Pro-GNN,在中毒圖的基礎上重新構建干凈圖,實驗證明,Pro-GNN具有良好的抵抗中毒攻擊的能力,然而由于Pro-GNN需要迭代地構建干凈圖并交替地進行優化,這使得Pro-GNN的復雜度變高,訓練時間較長,且需要占據較多的計算資源;在針對模型結構的防御方法中,Zhu等人[14]利用高斯分布對噪聲的容忍度,將其作為圖卷積層中節點的隱層表示,并根據方差為鄰居節點分配注意力權重,由于被攻擊節點對其他節點的影響的方差大,并被分配了較小的注意力權重,因此可以降低不良影響的傳播,該方法是對方差進行平滑而起到防御作用的,具有較強的通用性,但是該方法對不利影響的吸收能力也是有限的,對于一些較強的攻擊,針對性不強,因此該方法的防御能力是有限的;此外,Chen等人[10]提出了使用平滑蒸餾和平滑損失函數的方法來實現梯度隱藏,并對模型進行對抗訓練,從而增強了圖神經網絡模型對基于梯度的對抗攻擊方法的魯棒性,該方法對基于梯度的對抗攻擊方法具有較好的防御性能,但也需要生成大量對抗樣本進行訓練,防御代價較高;Tang等人[13]設計了一種具有懲罰性聚合機制的圖神經網絡PA-GNN,通過限制擾動連邊的消息傳遞從而使聚合函數更專注于真實的鄰居節點,由于需要預先使用對抗樣本和注意力機制訓練一個具有懲罰能力的元模型來對PA-GNN進行初始化,因此該方法的復雜程度較高;Jin等人[28]強調了現有GCN模型的Laplacian算子在空間域中信息融合范圍有限以及在譜域中的不良偽像,并進一步提出了一種可變冪算子替代Laplacian算子,得到可變冪網絡,可同時不同距離的特征變換函數和全局參數,從而提高圖神經網絡的魯棒性.

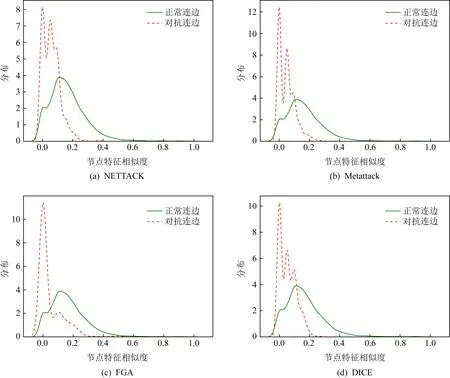

Fig. 1 The distribution of node features similarity圖1 節點特征相似度分布

綜上所述,現有的面向圖神經網絡的防御方法主要可以分為針對輸入數據的轉換的防御方法和針對模型結構的防御方法.盡管這些防御方法取得了一定的效果,但是仍存在局限性和挑戰.針對輸入數據的轉換防御方法需要對輸入圖進行預處理,而預處理后的圖的質量將直接影響GNN模型的性能.理論上這種防御方式對任何種類的對抗樣本都有一定的防御效果,但是其缺點在于可能增加模型對干凈樣本的誤報率,即使GNN模型損失一定的性能獲取對對抗攻擊的魯棒性.如何提高GNN模型在干凈樣本上的性能是該類方法的主要挑戰.針對模型結構的防御方法需要從模型內部結構進行改進,這提高了模型的復雜性,尤其是與對抗訓練相結合的防御方式需要更多的計算資源與訓練時間.

2 基于圖重構的圖神經網絡防御方法

2.1 動 機

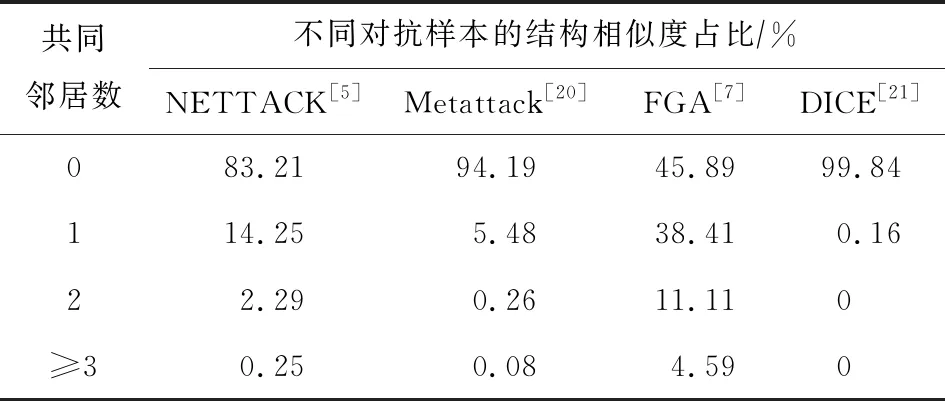

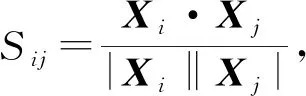

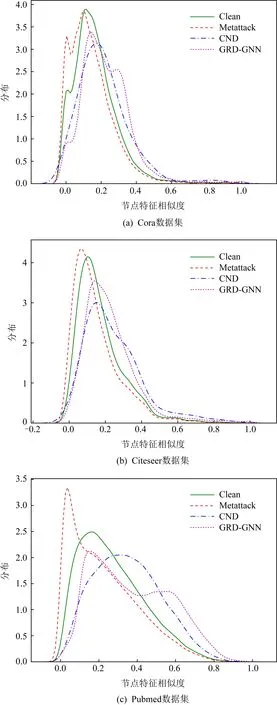

在提出本文的方法之前,首先觀察4種攻擊算法生成的不同對抗樣本的結構相似度和節點特征相似度,以Cora數據集為例,結果如表1和圖1所示.由表1可知,大部分對抗連邊所連接的節點對之間幾乎不存在共同鄰居(common neighbors, CN),這說明了它們周圍的結構相似性較低.此外從節點自身屬性特征考慮,如圖1所示,這些被對抗連邊所連接的節點屬性特征也具有低相似度的特點.在此基礎上,本文提出了一種面向圖神經網絡的圖重構防御方法GRD-GNN.

Table 1 The Proportion of Structural Similarity of Node Pairs Connected by Adversarial Edges

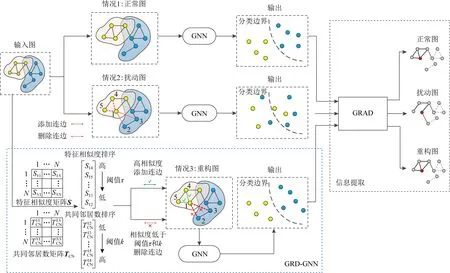

Fig. 2 The framework of GRD-GNN algorithm圖2 GRD-GNN算法框架圖

2.2 目標模型

(1)

(2)

其中,VL是帶有標簽的節點集合,|F|是圖中節點的標簽數,Y是真實標簽矩陣.

此外,為了驗證本文提出方法的通用性,本文還在GAT模型[19]上進行實驗.與GCN模型不同的是,GAT模型在卷積層中引入了注意力機制,為不同的鄰居節點分配不同權重.節點i的隱層表達為

(3)

其中,Wk是與輸入相關的線性變換的權重矩陣;K代表獨立的注意力機制的數量;a∈R2M,M是節點特征的維數.此外,值得注意的是權重矩陣W是共享的.GAT模型的最終輸出層被定義為

(4)

此處δ(·)在節點分類任務中為softmax函數或sigmoid函數.

2.3 GRD-GNN算法框架

本節對本文提出的基于圖重構的GRD-GNN算法的具體細節進行詳細介紹.GRD-GNN的框架圖如圖2所示,當GNN模型的輸入為一張正常圖時,輸出正常,并應用于圖關鍵結構提取等任務,獲得正常的目標節點相關的關鍵子圖;當GNN模型的輸入為1張擾動圖時,模型的分類性能下降,由解釋器GRAD提取的目標節點相關子圖與正常圖不一致;GRD-GNN的輸入無論是正常圖還是擾動圖都將依據節點特征相似度和共同鄰居數進行圖重構,具體步驟為根據輸入特征相似度閾值τ和共同鄰居數閾值k,刪除低于相似度閾值的連邊,并連接具有高相似度的節點,輸出重構圖,并作為GNN模型的輸入,獲得正常的輸出,并由解釋器GRAD提取目標節點相關的關鍵子圖,此時輸出與正常圖比較,驗證GRD-GNN的有效性.

更具體地,GRD-GNN算法主要分為2個步驟:

1) 濾除對抗擾動.通過構建結構相似度和節點特征相似度對圖中的連邊進行貪心搜索,查找可疑連邊,刪除相似度得分低于給定閾值的連邊,達到清除圖中對抗連邊的效果.

2)

圖增強.在步驟1)的基礎上,利用節點自身特征的相似度進行排序,在保證節點在輸入圖中的度值情況下連接高節點相似度的連邊,達到圖增強的效果.

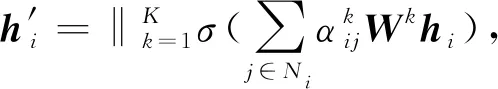

1) 濾除對抗擾動.共同鄰居數[29]是復雜網絡研究中的1種經典的結構相似度算法.2個節點的共同鄰居數越少,則說明兩者在網絡中的關系越疏遠.因此,CN常用于評估節點對之間的結構相似度.NCN被定義為

(5)

其中,Γ(i)表示節點i周圍的鄰居節點集合,Γ(j)表示節點j周圍的鄰居節點集合.則CN關于鄰接矩陣A表達形式為

TCN=AA,

(6)

此外,為了從節點自身屬性上衡量2個節點之間的相似性,本文采用了余弦相似度來計算2個特征向量之間的距離,得到特征相似度矩陣S.節點i和節點j之間的余弦相似度可以表示為

(7)

其中,X為節點的特征,|·|代表取模運算.

在上述相似度計算的基礎上進行可疑連邊篩選和濾除,將θdel定義為刪除連邊操作:

(8)

(9)

2)

圖增強.在KNN(k-nearest neighbor)算法[30]的啟發下,本文根據節點對的余弦相似度進行圖增強.本文定義了選擇矩陣Λ進行增強連邊的選擇:

Λij=Sij×(-2eij+1),

(10)

式(10)表明當連邊eij存在時忽略該連邊,僅考慮圖中不存在的連邊作為候選連邊集.

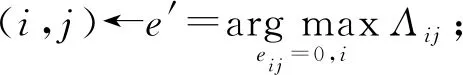

(11)

e′為需要添加的連邊,通過上述方式最終獲得經過重構后的增強圖G′及對應的鄰接矩陣A′.

算法1.GRD-GNN算法.

輸出:重構后的鄰接矩陣A′.

① 根據式(6)計算結構相似度矩陣TCN;根據式(7)計算節點特征相似度矩陣S;

② foreijin連邊集合do

end for

④ 計算選擇矩陣Λij=Sij×(-2eij+1);

num+=1;

end for

⑥ return重構圖G′及對應鄰接矩陣A′.

2.4 GRD-GNN有效性分析

為了能更直觀地解釋GRD-GNN算法的有效性,本文從防御前后圖結構的度分布情況、節點屬性特征分布情況和模型提取的embedding信息等多個角度進行分析.其中,重構圖的度分布應當盡量與干凈圖一致;圖中節點的特征相比擾動圖應當有更高的相似度;模型提取的重構圖的embedding信息應當與干凈圖相似,從而說明GRD-GNN的有效性.

本文實驗中還使用了基于梯度的可解釋性方法GRAD[31]對圖神經網絡在攻擊前后和防御前后提取到的圖關鍵結構進行了可視化.進行防御后GRAD提取的關鍵子圖應與從干凈圖中提取的關鍵子圖相似或一致,從而說明GRD-GNN的有效性.其中GRAD是一種基于梯度和顯著性映射的解釋方法,圖神經網絡損失函數的梯度被用于解釋圖神經網絡的行為.

3 實驗與分析

為了驗證本文提出的基于圖重構的圖神經網絡防御方法的有效性,本文在3個真實數據集和2種圖神經網絡模型上進行實驗,并與最新的防御方法進行比較,驗證本文方法的有效性.

3.1 實驗環境

實驗環境是:Python3.6開發,運行環境的CPU為i7-7700K 3.5 GHz×8,GPU為TITAN XP 12 GB,內存為16 GB×4 memory (DDR4),開發及實驗的操作系統為Ubuntu 16.04 (OS).

3.2 數據集及評價指標

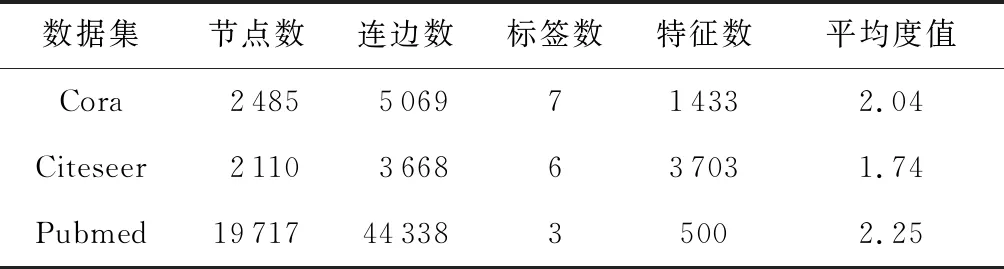

本文在3個圖神經網絡研究中常用的真實數據集上評估GRD-GNN的防御性能,分別是Cora,Citeseer,Pubmed,與文獻[17]相同,本文采用了3個數據集中的最大連通圖作為實驗對象.表2總結了3個數據集的基本統計信息:

Table 2 The Basic Statistics of Graph Datasets表2 圖數據集的基本統計信息

1) Cora數據集.Cora數據集是1個引文網絡數據集,包含了大量機器學習相關的論文,共分為7類.其中共有2 485篇文章和5 096條引用記錄.每個節點包含1 433條特征.

2) Citeseer數據集.Citeseer數據集也是1個引文網絡數據集,它包含了2 110篇文章和3 668條引用關系,共分為6類,含有3 703個特征.

3) Pubmed數據集.Pubmed數據集是1個生物鄰域相關的引文網絡,包含了19 717篇文章、44 338條引用關系和500個特征,分為3類.

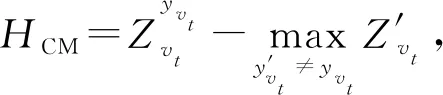

本文實驗的評價指標采用模型的預測準確率(accuracy)和分類裕度(classification margin, CM),其中CM指標表示為

(12)

3.3 攻擊方法

在本文實驗中,使用了3種經典的、具有較強攻擊性能的對抗攻擊算法,即NETTACK算法[5]和Metattack算法[20]和DICE算法[21].下面對這3種算法進行簡要介紹:

1) NETTACK[5].NETTACK算法首先根據重要的數據特征選擇候選的連邊和特征,其次設計了2個評估函數用于評估在修改候選連邊和特征后的目標置信度變化,最后通過修改得分最高的連邊或特征,并迭代地更新對抗網絡.

2) Metattack[20].Metattack將輸入的網絡G作為一個超參數,構建成Bi-level的優化問題,并利用基于網絡連邊的元梯度進行對抗網絡的迭代更新,是一種無目標攻擊算法.

3) DICE[21].DICE對目標節點隨機斷開b條連邊,再隨機連接K-b條連邊,其中K是目標節點原有的連邊數.

3.4 對比防御方法

為了驗證GRD-GNN的有效性,本文將其與GCN和其他4種防御方法進行比較,分別為RGCN[14],Jaccard_based[15],SVD_based[16],Pro-GNN[17].下面對4種防御方法進行簡要介紹:

1) RGCN[14]. RGCN利用了高斯分布對擾動的容忍性,將圖卷積層的隱層節點表示為高斯分布以吸收對抗攻擊帶來的影響.此外還利用方差為鄰居節點分配注意力權重,具有高方差的節點將受到懲罰.

2) Jaccard_based[15]. Jaccard_based通過計算節點特征的Jaccard相似度,并設置一定的閾值對連邊進行篩選、刪除,最終得到1張經過凈化的圖.

3) SVD_based[16]. SVD_based旨在將受擾動的圖進行SVD分解,通過截取top-k個高奇異值(低秩),重新組成1張新的沒有擾動的圖.

4) Pro-GNN[17].利用了圖的低秩、稀疏性和節點特征的平滑特性,從受擾動的圖和模型參數中學習到1張干凈的圖來防御對抗攻擊.

此外,在本文的實驗中還設置了1組對照CND(common neighbor delete),即僅在共同鄰居數的指導下進行連邊刪除.

3.5 防御實驗

在防御的過程中需要解決2個主要的問題,即:1)在干凈樣本上,需要保持圖神經網絡模型的性能.2)在第1個問題的基礎上盡可能地消除對抗攻擊帶來的影響.

1) 在干凈樣本上的分類性能

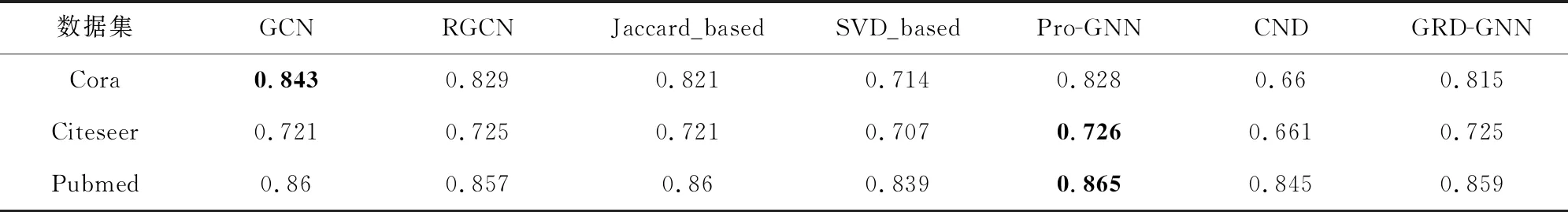

首先,為了驗證防御方法在干凈樣本(未添加擾動)上對圖神經網絡模型的性能影響,本文在GCN模型上對各防御方法進行測試,結果如表3所示:

Table 3 Accuracy of Different Defense Methods on Clean Data表3 不同防御方法在干凈數據上的準確率

由表3可知,大部分的防御方法都能較好地保持GCN模型的分類性能,在規模較小的數據集Cora和Citeseer中,SVD_based和對照組CND的性能下降較為明顯,其原因在于,兩者均對圖結構有較大程度的改變,因此對GCN模型的分類性能具有較大的影響.而在較大規模的Pubmed數據集中,兩者對圖的改動對整體圖結構的影響相比Cora,Citeseer較小,因此,仍能一定程度保持GCN模型的分類性能.本文提出的GRD-GNN方法雖然沒有得到最優的分類效果,但是在整體上均能保持與僅有GCN模型相近的性能.這也驗證了GRD-GNN能較好地保持GCN模型的性能.

2) 針對目標攻擊的防御效果

根據節點的數據特征(例如度分布、中心性等)可以對節點在圖中的重要程度進行劃分.攻擊者常對一些具有高價值的目標進行攻擊,目標攻擊的目的在于使模型對目標節點的分類錯誤,以獲得對攻擊者而言的最大收益.因此,能否對目標節點進行有效保護使檢驗防御方法對目標攻擊方法的防御能力的重要指標之一.本節實驗即是驗證各個防御算法對目標攻擊的防御效果.

Table 4 Accuracy of Different Defense Method Against NETTACK Based on GCN表4 在NETTACK攻擊下不同防御方法基于GCN模型的準確率

實驗中,本文采用了具有較強攻擊能力且具有良好隱蔽性的圖對抗攻擊算法NETTACK.由表2可知,3個數據集中的節點平均度值較低,分別為2.04,1.74,2.25,因此設置每個目標節點都將受到1~5條擾動連邊的攻擊(5條擾動連邊的添加可視為較大程度的擾動),以測試防御算法對不同程度擾動的防御能力.實驗采用模型節點分類準確率(accuracy)作為指標,結果如表4所示.

由表4可知,隨著擾動的增加,在大部分情況下,GRD-GNN在各個數據集上均能取得最佳效果,由于對比算法.甚至在每個節點上的擾動增加到5條連邊時,模型對目標節點的分類準確率仍能達到與在無擾動情況下相近的性能.這說明GRD-GNN能夠有效地防御對抗攻擊.

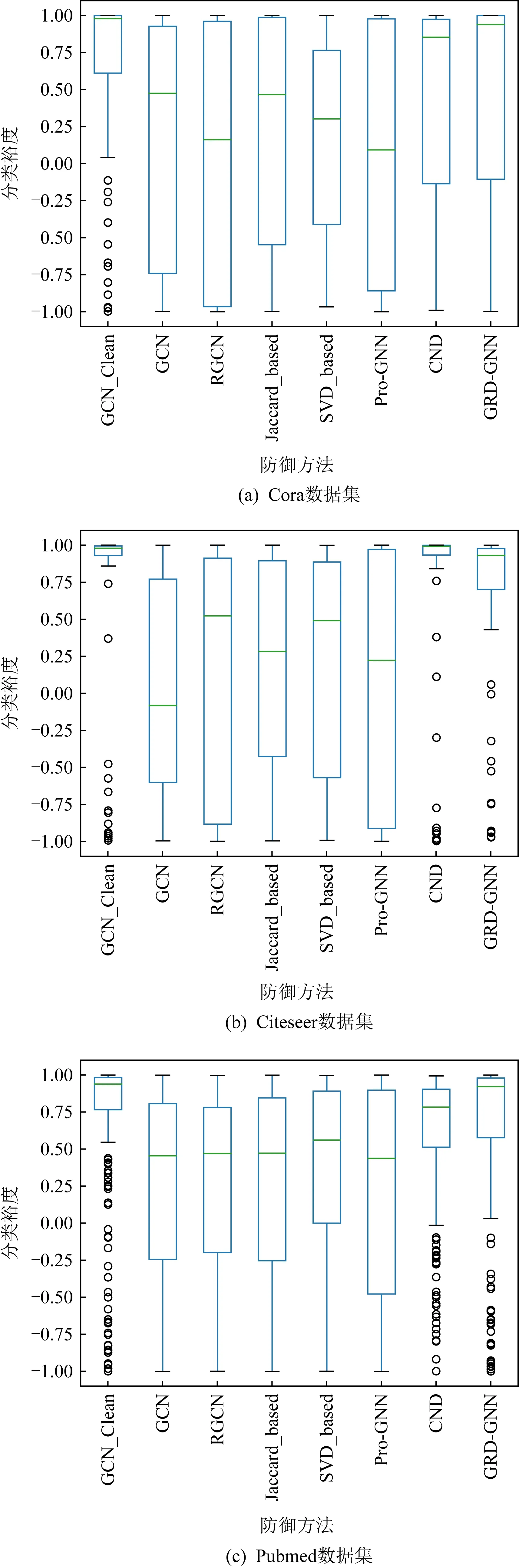

實驗從模型的分類準確率角度驗證了本文提出方法的有效性,這是一種宏觀的性能體現.此外,能否使圖神經網絡對節點進行更加令人信服的分類也是體現防御方法性能的一個方面.本文實驗中引入了CM[5]指標來對防御方法的防御能力進行微觀上的評判.需要說明的是,CM指標代表了目標節點與正確分類邊界的距離,因此,當節點被正確分類時,其對應的模型輸出置信度應當越高越好.為了更明顯地對比,實驗中采用了添加5條連邊的擾動進行攻擊,結果如圖3所示.

Fig. 3 The boxplot of Classification Margin on three datasets圖3 3個數據集上的Classification Margin箱線圖

圖3表明相比其他對比算法,除去對照組CND,GRD-GNN的箱體更短一些,這說明其數據更集中,且與未經過擾動的GCN模型的輸出更接近,節點被正確分類的置信度更高,防御的性能更好.而在Citeseer數據集上略低于對照組CND的原因可能在于,相比Cora,Pubmed數據集,Citeseer數據集更稀疏,CND對圖結構的改動更大一些,其中也包括了在無擾動圖中自身攜帶的一些噪聲,且目標節點的度值較大,因此即使在損失了相當一部分模型的整體性能的情況下,CND仍能對目標節點進行較好的分類.

3) 針對無目標攻擊的防御效果

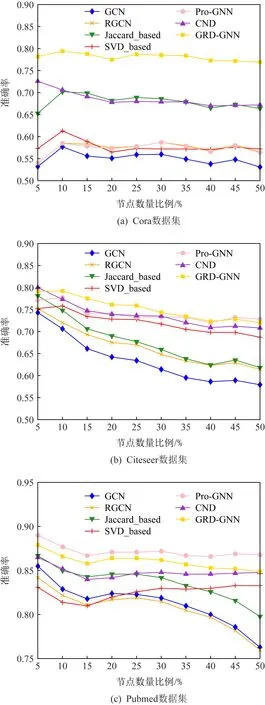

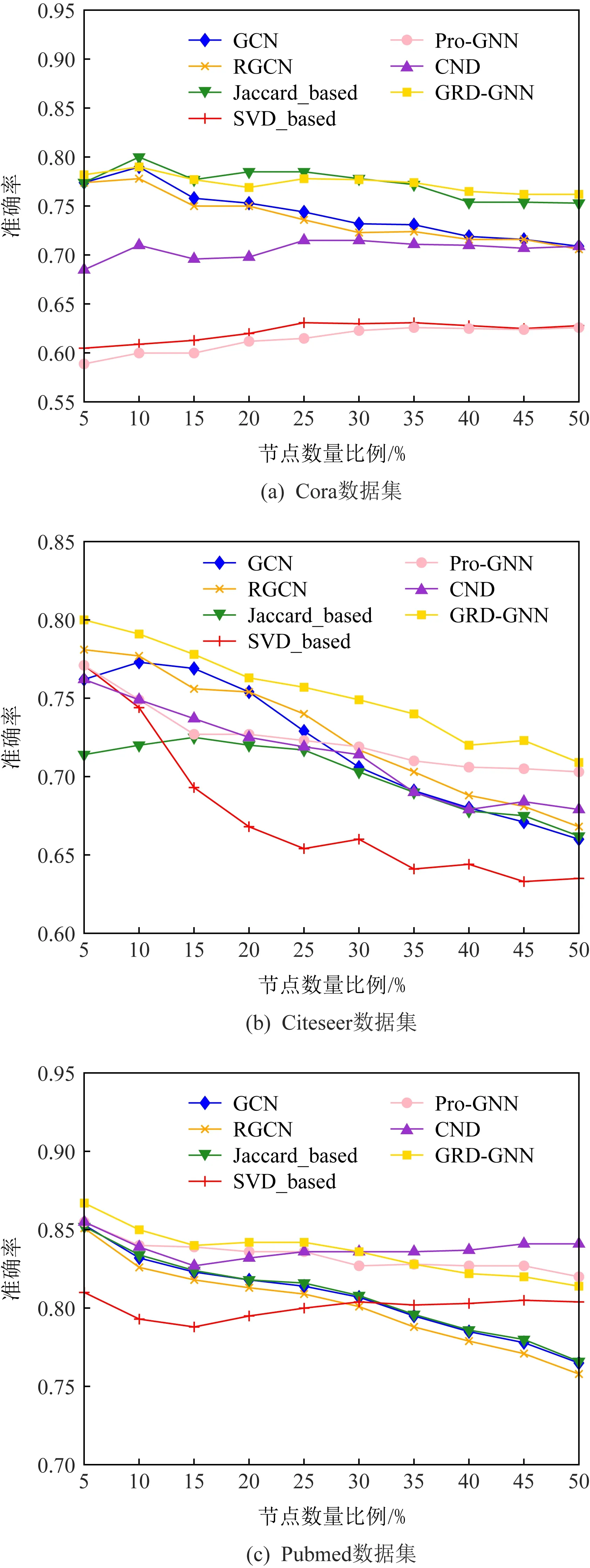

在針對圖神經網絡的對抗攻擊方法中,有一類攻擊者注重于通過修改少數連邊而使圖神經網絡模型的性能大幅下降,而不是僅針對某一些節點的攻擊,例如Metattack就是其中一種強力的攻擊算法.在針對無目標攻擊的防御實驗中,本文采用了Metattack和DICE對圖神經網絡進行攻擊,并在Metattack攻擊達到修改網絡中25%連邊和DICE達到修改網絡中50%連邊的高強度攻擊情況下對各防御方法進行性能測試,實驗的評價指標為模型的節點分類準確率.在圖結構中,對關鍵節點的保護是至關重要的,這樣的節點數量在網絡中占的比重不大,對攻擊者而言卻又具有較高價值.因此,實驗中通過對節點的度值進行節點重要性排序,實驗中取度值在前50%的節點集合進行測試,模擬在高強度攻擊的情況下防御方法對關鍵節點的保護能力.實驗的結果如圖4和圖5所示.

Fig. 4 Accuracy of nodes with different degrees under Metattack (25% edges are modified)圖4 在Metattack(修改25%的連邊數)攻擊下不同度值節點的準確率

Fig. 5 Accuracy of nodes with different degrees under DICE (50% edges are modified)圖5 在DICE(修改50%的連邊數)攻擊下不同度值節點的準確率

分析圖4可知,高度值節點對Metattack的攻擊容忍性較高,而度值較低的節點更容易受到對抗攻擊的影響,因此Accuracy曲線總體呈下降趨勢.從圖4中可以看到,在大多數情況下,GRD-GNN算法均能取得較好的效果,尤其是在Cora數據集上的性能提升尤為明顯,在Pubmed數據集上的性能雖然略遜于Pro-GNN,可能是由于Pro-GNN方法更加復雜,但這也大大增加了Pro-GNN的計算資源消耗,在時間成本上,GRD-GNN比Pro-GNN更加占據優勢.此外,在Pubmed數據集上,CND,SVD_based在度值較小的節點上的分類準確率略有上升,原因在于兩者對圖的修改程度比較大,而這種修改對低度值節點的影響大于對高度值的影響.如圖5所示,由于DICE的隨機性,使得其對其防御難度增加,但是在大多數情況下,GRD-GNN均能取得最好的性能,但是基于擾動存在于圖的高秩部分條件的SVD_based性能明顯下降.這說明了SVD_based具有更加苛刻的限制條件.

4) 防御通用性

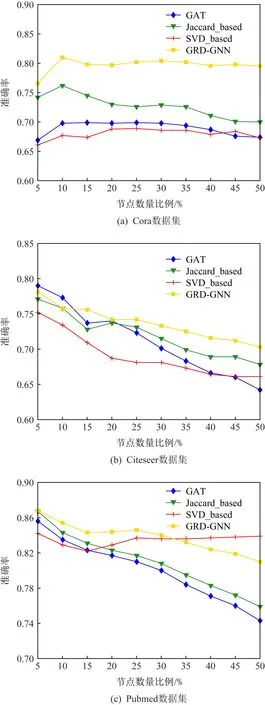

作為一種對輸入圖進行重構的方法,GRD-GNN算法可以匹配不同的圖神經網絡,是一種通用的圖神經網絡防御方法.同樣地,Jaccard_based,SVD_based是對擾動圖進行純化,因此也適用于各類圖神經網絡.由于模型限制和硬件條件限制,在本節實驗中,采用Jaccard_based,SVD_based,GRD-GNN這3種方法進行對比,在圖注意力網絡GAT模型上進行測試.實驗中的擾動設置與針對目標攻擊的防御效果和針對無目標攻擊的防御效果的實驗相同.實驗結果如表5、圖6和圖7所示.

結合表5、圖6和圖7,在大多數情況下,GRD-GNN相比其余2種圖純化方法都能取得最佳效果.無攻擊情況下,3種防御方法均使GAT的分類性能下降,其中SVD_based在Cora,Citeseer數據集上使模型性能大幅下降,而Jaccard_based,GRD-GNN均能較好地保持GAT模型在干凈樣本上的分類性能;在NETTACK攻擊場景中,當攻擊所添加的擾動較小時,對GAT模型攻擊性尚未體現,因此GRD-GNN的對NETTACK的防御能力沒有充分體現;在擾動程度較大時,相比其他2種防御方法,GRD-GNN的優勢得以體現,尤其是在Citeseer,Pubmed數據集上,甚至能取得與無攻擊情況下相近性能,在Cora數據集上也能獲得較大的準確率提升.與實驗的結果類似,GRD-GNN都能取得較好的效果,而在Metattack攻擊場景中,GRD-GNN在3個數據集上相比于另外2種防御方法取得了很大的優勢.實驗證明了GRD-GNN可以有效地加載在其他圖神經網絡上,以提高圖神經網絡對對抗攻擊的魯棒性.

Table 5 Accuracy of Different Defense Method Against NETTACK Based on GAT

Fig. 6 Accuracy of GAT with different degrees under Metattack (25% edges are modified)圖6 在Metattack(修改25%的連邊數)攻擊下不同度值GAT的準確率

Fig. 7 Accuracy of GAT with different degrees under DICE (50% edges are modified) 圖7 在DICE(修改50%的連邊數)攻擊下不同度 值GAT的準確率

3.6 有效性分析

3.5節主要對GRD-GNN與其他防御方法進行比較,測試了不同攻擊場景、不同模型上的性能,本節將進一步從不同角度探究GRD-GNN方法的有效性原因.

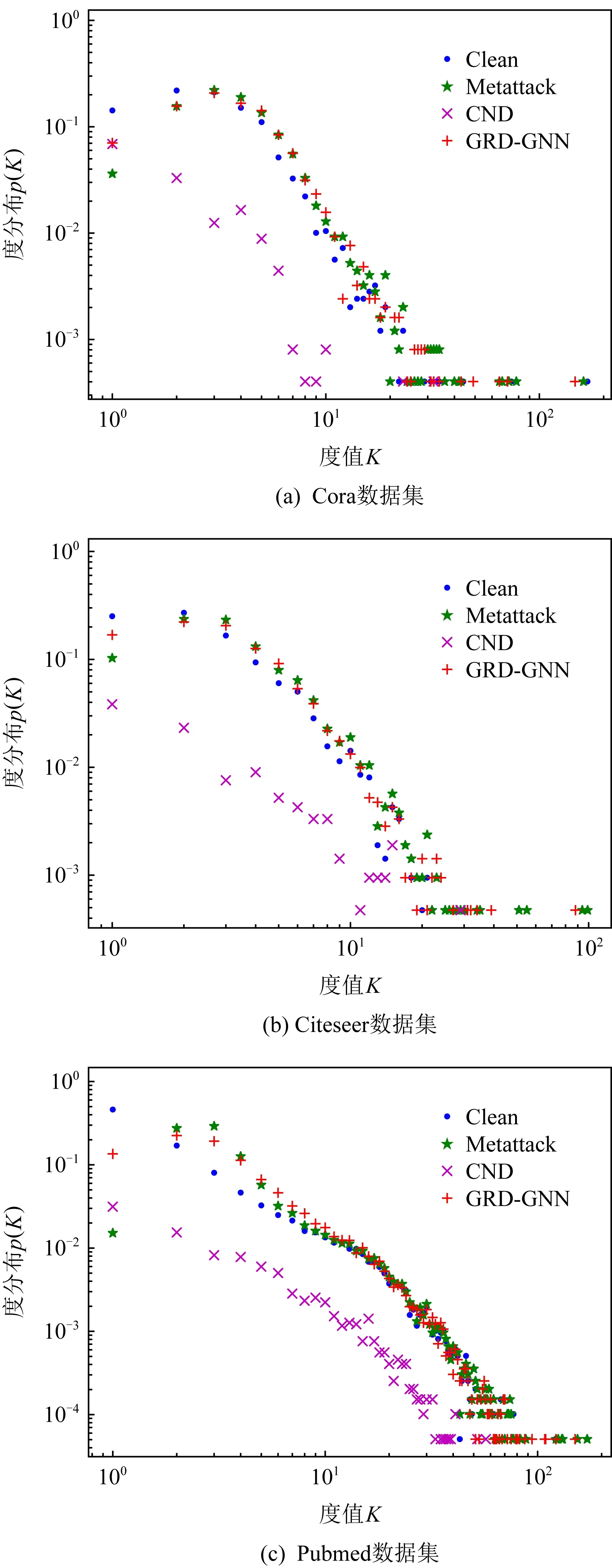

1) 原圖與重構圖的度分布比較

首先通過圖的度分布情況來評判GRD-GNN重構圖的優劣.由于NETTACK針對目標節點進行攻擊,且添加的擾動相較于網絡連邊數量不多,因此對圖的度分布影響不大,故本文對Metattack攻擊(修改25%連邊)進行分析.如圖8所示為干凈圖、經過Metattack擾動圖、CND重構圖和GRD-GNN重構圖的度分布情況.各數據集呈現明顯的冪律分布,因此,經過重構后的圖也應當保持冪律分布的特性.其中,CND對圖結構有明顯的破壞,這是其使GCN模型總體性能下降的原因之一.觀察經過Metattack攻擊的圖可知,Metattack對低度值的節點影響較大.而經過GRD-GNN重構后的圖分布與干凈圖更為接近,說明GRD-GNN能在一定程度上消除Metattack對圖結構的影響.

Fig. 8 Degree distribution of graphs圖8 圖的度分布

2) 原圖與重構圖的節點相似度分布比較

從連邊對應節點的特征相似度考慮,具有相同標簽的節點應當具有高相似度.同樣使用Metattack(修改25%連邊)進行攻擊,對圖中兩兩節點之間的特征相似度分布進行分析,如圖9所示.

Fig. 9 Node similarity distribution in the graph圖9 圖中的節點相似度分布

由圖9可知,在Metattack的攻擊下,大量的不相似節點將被連接在一起,因此,節點間的相似度分布與干凈圖相比偏低.而CND根據節點的結構相似度對連邊進行刪除,可以有效地刪除一些對抗連邊,但是同時也導致了正常連邊的缺失.GRD-GNN在連邊刪除的基礎上基于節點特征相似度對圖進行重構,因此GRD-GNN重構圖的節點特征相似度分布較高,且圖結構更加完整,更有利于圖神經網絡模型的分類性能提升.

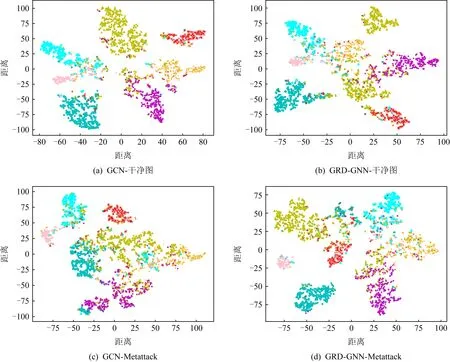

3) 防御前后embedding對比

本實驗對GCN模型提取到的embedding利用t-SNE方法映射到2維空間進行可視化,以此判斷模型生成的embedding的質量.由于NETTACK是對部分目標節點進行攻擊,在t-SNE圖中難以觀察到,因此本實驗采用無目標攻擊的Metattack作為攻擊者,以Cora數據集為例,結果如圖10所示.

比較圖10(a)(b),GCN和GRD-GNN在干凈圖上都能分辨出明顯的7個簇,但是GRD-GNN重構出的分布較為分散,這與GRD-GNN在干凈圖上的分類準確率較GCN模型略有下降的實驗結果相對應.對比圖10(a)(c),在Metattack的攻擊下,GCN模型提取的embedding質量明顯下降,不同類別之間的類間距離縮小,不同類別的節點混雜,這是在Metattack攻擊下,GCN模型節點分類準確率大幅下降的原因.最后比較圖10(a)(c)(d),即比較防御前后的效果,可以發現,GRD-GNN能明顯提升GCN在攻擊下的embedding提取質量,同類節點間更加緊湊,類與類之間距離增大,因此使GCN模型的分類性能得以恢復,這也直接證明了GRD-GNN的有效性.相同的結論也能在Citeseer,Pubmed數據集上得出.

Fig. 10 t-SNE of embedding generated by GCN (Cora)圖10 GCN生成的embedding的t-SNE圖

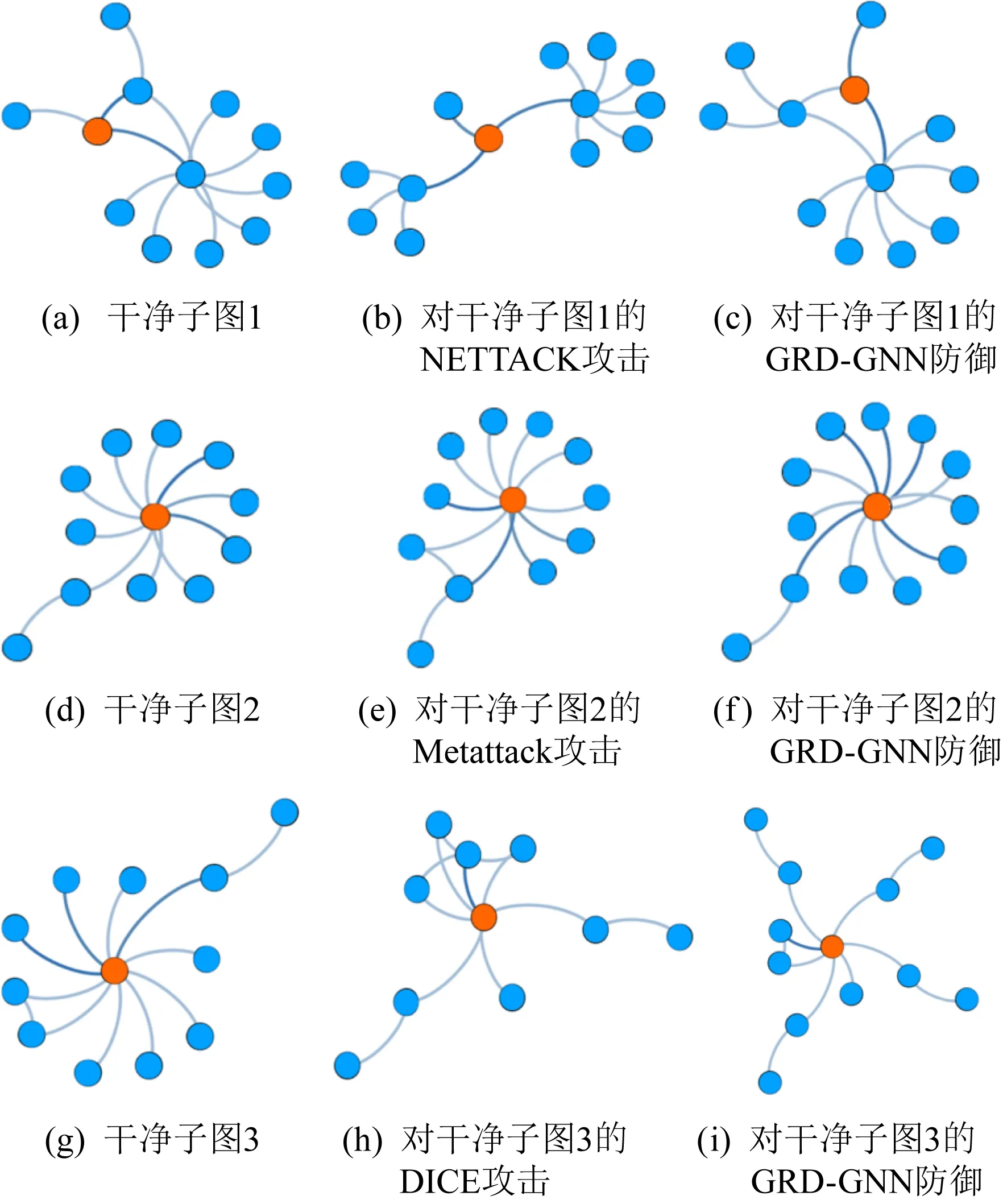

3.7 圖關鍵結構可視化及解釋

在很多情況下,圖神經網絡常被作為黑箱模型使用.近年來,許多工作試圖探索圖神經網絡究竟學習到了什么,而這對于提高模型的透明度,減少模型出現系統性錯誤的風險有重要作用.因此,通過對比圖神經網絡在攻擊前后和防御前后學習到的關鍵結構,也可以對防御算法的優劣進行評判.圖11為基于GRAD解釋方法提取的與目標節點相關的重要子圖.以Cora數據集為例,圖11(a)~(c)為在NETTACK攻擊下,防御前后提取到的子圖,可見NETTACK添加擾動后與干凈圖有較大的區別,這也是因為NETTACK是一種目標攻擊,對目標節點的連邊修改較多,而由GRD-GNN重構的圖結構雖然與干凈圖相比并不是完全相同,但是結構上更加相似.在Metattack攻擊場景中也能得到相似的結論.需要說明的是Metattack為無目標攻擊,因此對目標節點的擾動可能不大.如圖11(e)所示,Metattack攻擊下提取到的子圖中出現了環結構,這在干凈圖中是沒有的,GRD-GNN重構圖中提取到的子圖與干凈圖基本一致.由于DICE的隨機性,GRD-GNN重構圖中提取到的重要子圖雖然與干凈圖不太一致,但是任能保留一些主要結構,如圖11(g)(i)中的環結構.

Fig. 11 Important graph structure related to target node based on GRAD explainer (Cora)圖11 基于GRAD解釋方法的目標節點相關的重要子圖(Cora)

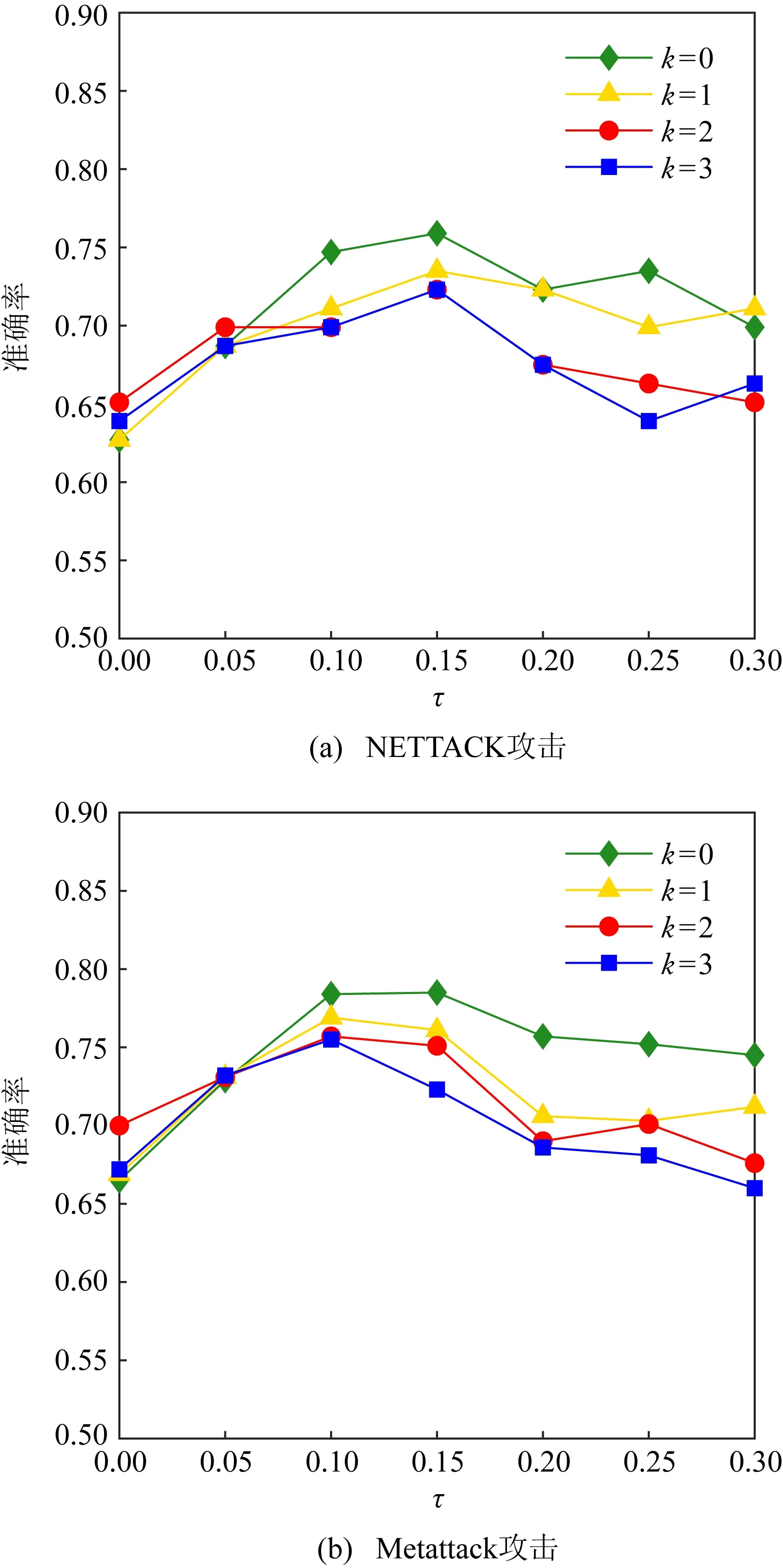

3.8 參數敏感性分析

本節主要對GRD-GNN的2個參數(即結構相似度閾值k和節點特征相似度閾值τ)的敏感性進行分析.實驗中,本文在固定某個閾值的條件下,改變另一個閾值來研究不同的閾值對GRD-GNN性能的影響.本實驗中以Cora數據集為例,在NETTACK添加5條連邊的攻擊和Metattack修改圖中25%連邊的情景下分別進行測試,其中結構相似度閾值k由0~3設置,步長為1;節點特征相似度τ由0~0.3設置,步長為0.05.GRD-GNN的性能變化如圖12所示.為所有參數選擇合適的值,可以提高GRD-GNN的準確率.當隨著結構相似度閾值k的提高,GRD-GNN性能下降,這是由圖的稀疏性導致的,即結構相似度閾值k的值越高,更有可能刪除圖中相對重要的連邊,導致圖神經網絡模型性能下降.而節點特征相似度τ過小或過大都會損壞模型的性能.因此,較小的結構相似度閾值k和適當的節點特征相似度τ可以有效地提高GRD-GNN的防御性能.根據結構相似度閾值k和節點特征相似度τ對不同數據集的敏感性不強,故本文中采用網格搜索的方式對閾值進行優化,從而獲得局部最優值.本文實驗設置結構相似度閾值k參數集合為[0,1,2,3],節點特征相似度τ參數集合為[0,0.05,0.1,0.15,0.2,0.25,0.3].

Fig. 12 Parameter sensitivity analysis圖12 參數敏感性分析

4 總 結

本文首先觀察了4種攻擊算法生成的不同對抗樣本的結構相似度和節點特征相似度,發現對抗連邊傾向于連接結構相似度和節點特征相似度較低的節點.在此觀察的基礎上,本文提出了一種基于圖重構的圖神經網絡防御方法.這是一個通用的防御框架,可以接入到圖神經網絡的輸入部分來達到輸入數據轉換的防御效果.本文提出的GRD-GNN算法在確保GNN模型在干凈樣本上的性能的同時,對輸入的擾動圖進行重構,獲得濾除對抗連邊的增強圖,從而提高GNN模型對對抗攻擊的魯棒性.本文在3個真實數據集上進行大量實驗,驗證了本文提出的基于圖重構的圖神經網絡防御方法取得了最佳的效果.此外,本文還從度分布、節點屬性特征分布和GNN模型提取的embedding信息等多個角度分析了方法的有效性,并且使用圖神經網絡解釋方法對防御方法的有效性進行可視化解釋.但是在實驗中,盡管引入了圖增強機制,但是GRD-GNN還是降低了GNN模型在干凈樣本上的部分性能,因此在未來的工作中,我們將致力于保持甚至提高GNN模型在干凈樣本上的性能,并進一步降低對抗攻擊帶來的影響,提高GNN模型對對抗攻擊的防御能力.