基于地標(biāo)景物識(shí)別的非傳統(tǒng)定位系統(tǒng)

陳一銘 朱杰

摘 要:目前受限于GPS等專業(yè)定位系統(tǒng)的高成本,人們?nèi)粘I钪衅毡椴捎靡苿?dòng)端的定位設(shè)備(如手機(jī)),但是部分地區(qū),如深山和峽谷區(qū),通信信號(hào)很差,手機(jī)的移動(dòng)網(wǎng)絡(luò)失效,此時(shí),基于手機(jī)GPS和移動(dòng)網(wǎng)絡(luò)的傳統(tǒng)定位及導(dǎo)航方式失效,不能對(duì)自己定位并進(jìn)行區(qū)域?qū)Ш健R虼耍枰环N在弱信號(hào)地區(qū),通過單機(jī)識(shí)別地標(biāo)、景物來判斷當(dāng)前位置的系統(tǒng),作為輔助定位的方式,幫助人們?cè)谔厥馇闆r下實(shí)現(xiàn)離線定位和相對(duì)導(dǎo)航。

關(guān)鍵詞:深度學(xué)習(xí);圖像識(shí)別;相對(duì)定位

1? ? 研究背景和意義

在精準(zhǔn)扶貧浪潮下,習(xí)近平總書記鼓勵(lì)青年用創(chuàng)新創(chuàng)業(yè)成果服務(wù)地區(qū)振興戰(zhàn)略、助力精準(zhǔn)扶貧。開發(fā)貧困地區(qū)豐富的旅游資源,興辦旅游經(jīng)濟(jì)實(shí)體,完善相關(guān)地區(qū)的基建設(shè)施,使旅游業(yè)形成區(qū)域支柱產(chǎn)業(yè),進(jìn)而成為實(shí)現(xiàn)貧困地區(qū)居民和地方財(cái)政雙脫貧致富的重要途徑。

近年來,旅游已經(jīng)成為人們生活必不可少的一部分,但大部分目的區(qū)域?qū)τ诼每蛠碚f都是陌生環(huán)境,旅客需要依靠對(duì)應(yīng)的定位和地圖系統(tǒng)來獲取自己當(dāng)前的位置以及制定去往下一個(gè)景點(diǎn)的具體路線策略。由于對(duì)陌生地區(qū)的環(huán)境與地形不熟悉,為了準(zhǔn)確判斷當(dāng)前主體的地理位置,大眾普遍采用基于移動(dòng)端GPS的網(wǎng)絡(luò)地圖來實(shí)現(xiàn)定位。不局限于日常生活,野外勘探、考察等行為也需要一個(gè)相對(duì)可靠的便攜定位系統(tǒng),以此作為其他專業(yè)定位方式的補(bǔ)充。但是,除了專業(yè)GPS定位外,大眾普遍采用的移動(dòng)設(shè)備(如手機(jī))受制于網(wǎng)絡(luò)或電信基站信號(hào),對(duì)于山區(qū)、隧道、峽谷等弱信號(hào)地區(qū)或干擾信號(hào)區(qū)的定位普遍不夠準(zhǔn)確甚至?xí)А?/p>

本項(xiàng)目提出一種在弱信號(hào)地區(qū),通過深度學(xué)習(xí)來幫助用戶識(shí)別目標(biāo)對(duì)象,多維分析識(shí)別地標(biāo)性地貌、景色來判斷當(dāng)前位置的方法。同時(shí)將此方法落地成便攜應(yīng)用(APP)后可以作為GPS定位的重要補(bǔ)充,為復(fù)雜地貌區(qū)及偏遠(yuǎn)地區(qū)的發(fā)展和個(gè)人用戶的使用,提供可靠、便捷的地理信息保障。

2? ? 國內(nèi)外研究現(xiàn)狀

基于圖像識(shí)別的定位技術(shù)一般分為大范圍空間的圖像定位和特定某一區(qū)域定位。大范圍空間的圖像定位技術(shù)常見的有衛(wèi)星遙感圖像定位、聲波圖像定位等,這些定位技術(shù)在原理上有相似之處,但又存在根本差異。但目前國內(nèi)外研究中,利用圖像識(shí)別定位的主要共性,都是通過確定整體地域的對(duì)應(yīng)方位關(guān)系,進(jìn)而定位觀測目標(biāo)的實(shí)際地理位置。

在圖像定位的技術(shù)體系中,圖像處理技術(shù)是關(guān)鍵,其次才是數(shù)據(jù)匹配和相對(duì)位置的區(qū)域分析。圖像識(shí)別技術(shù)屬于人工智能機(jī)器學(xué)習(xí)在圖像領(lǐng)域的應(yīng)用,為了使得圖像識(shí)別技術(shù)能夠更加精準(zhǔn)地進(jìn)行識(shí)別,引入了深度學(xué)習(xí)。圖像識(shí)別技術(shù)使用神經(jīng)網(wǎng)絡(luò)對(duì)目標(biāo)特征進(jìn)行提取和組合,形成高級(jí)語義特征概念,達(dá)到識(shí)別目標(biāo)的目的,而圖像識(shí)別技術(shù)引入深度學(xué)習(xí),對(duì)比于傳統(tǒng)的圖像處理技術(shù)能夠得到更加細(xì)致抽象的目標(biāo)特征表示。但是目前對(duì)應(yīng)的視覺識(shí)別和圖像處理技術(shù)還并不成熟,只有譬如文字識(shí)別、人臉識(shí)別等圖像識(shí)別技術(shù)達(dá)到了應(yīng)用水平,其他大部分仍處在理論和實(shí)驗(yàn)階段。

由于圖像識(shí)別技術(shù)核心在于神經(jīng)網(wǎng)絡(luò)中的網(wǎng)絡(luò)層對(duì)目標(biāo)特征的提取,為了減少神經(jīng)網(wǎng)絡(luò)在設(shè)備中的運(yùn)算負(fù)荷,深度神經(jīng)網(wǎng)絡(luò)的提出對(duì)圖像識(shí)別算法進(jìn)行了更加精細(xì)的改進(jìn)。并且現(xiàn)如今隨著計(jì)算機(jī)運(yùn)算算力的大幅度提高、運(yùn)算效率提升和GPU加速技術(shù)的發(fā)展,圖像識(shí)別技術(shù)的識(shí)別率和精準(zhǔn)度都有了顯著的提升。

本文中的圖像識(shí)別技術(shù),是在移動(dòng)端上進(jìn)行的,最常見的設(shè)備就是手機(jī)。神經(jīng)網(wǎng)絡(luò)在研究識(shí)別模型中往往很少考慮設(shè)備的算力,而神經(jīng)網(wǎng)絡(luò)中含有大量的參數(shù),在識(shí)別過程中將會(huì)耗費(fèi)一定的時(shí)間,對(duì)于能夠落地商用的圖像識(shí)別模型來說,如何在滿足快速識(shí)別的同時(shí)保證精準(zhǔn)識(shí)別,這是最主要的問題。雖然手機(jī)等移動(dòng)設(shè)備具備便攜優(yōu)勢(shì),但在算法模型的搭建和運(yùn)行上還是有一定劣勢(shì)。當(dāng)下國內(nèi)外基于移動(dòng)設(shè)備的圖像識(shí)別技術(shù)研究主要集中于局部特征提取、人像識(shí)別、文字識(shí)別、圖像分類等方面。

3? ? 定位系統(tǒng)的設(shè)計(jì)和主要架構(gòu)

本文涉及的定位系統(tǒng)是基于移動(dòng)端圖像識(shí)別和數(shù)據(jù)分析的,主要介紹了圖像處理技術(shù)、算法模型封裝應(yīng)用技術(shù)和定位導(dǎo)航的測算技術(shù)。為了讓系統(tǒng)具備離線圖像識(shí)別及定位功能,系統(tǒng)形式上主要由可下載區(qū)域圖像特征參數(shù)的服務(wù)器端和客戶使用的客戶端構(gòu)成。同時(shí)在移動(dòng)端程序部署對(duì)應(yīng)的深度學(xué)習(xí)模型和識(shí)別算法,通過識(shí)別地標(biāo)地形、標(biāo)志性景物來判斷當(dāng)前位置。再根據(jù)預(yù)先錄入的區(qū)域地標(biāo)分布圖,實(shí)現(xiàn)三角定位和導(dǎo)航。

系統(tǒng)主要由三部分組成,分別是儲(chǔ)存并分析出數(shù)據(jù)特征的服務(wù)器端、用于圖像輸入和搭載程序的移動(dòng)端以及在移動(dòng)端進(jìn)行識(shí)別分析的算法模型。具體如圖1所示。

圖1? 系統(tǒng)邏輯流程

3.1? 服務(wù)器端

在服務(wù)器端,事先采集某一區(qū)域的地標(biāo)建筑或地形圖片,將圖像進(jìn)行規(guī)范化處理并進(jìn)行類別標(biāo)注,將處理后的大量此類圖片在卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)進(jìn)行訓(xùn)練學(xué)習(xí)。結(jié)合Core ML框架在經(jīng)過多次迭代訓(xùn)練學(xué)習(xí)后,會(huì)得到圖像識(shí)別模型,將經(jīng)過訓(xùn)練的數(shù)據(jù)參數(shù)文件保存在手機(jī)端可訪問的服務(wù)器上。同時(shí)在服務(wù)器端自動(dòng)生成可供手機(jī)APP下載和安裝的數(shù)據(jù)特征包。

3.2? 移動(dòng)端

在到達(dá)目的地之前,從遠(yuǎn)程服務(wù)器上預(yù)先獲取對(duì)應(yīng)此景區(qū)的數(shù)據(jù)特征文件,嵌入到本地。到達(dá)目的地后,即可將已下載的數(shù)據(jù)參數(shù)文件加載到算法模型之中。用戶使用相機(jī)功能拍攝地標(biāo)景物,將拍攝的圖像作為深度神經(jīng)網(wǎng)絡(luò)的輸入,經(jīng)過深度網(wǎng)絡(luò)處理后,生成圖像的特征表示。然后通過建立圖像檢索任務(wù),將拍攝圖像的數(shù)據(jù)參數(shù)與下載的數(shù)據(jù)參數(shù)匹配,獲取匹配度,根據(jù)具體的地標(biāo)景物判斷用戶的地理位置,來實(shí)現(xiàn)對(duì)用戶的定位。

3.3? 算法模型

Core ML是Apple的機(jī)器學(xué)習(xí)框架。Core ML支持多種機(jī)器學(xué)習(xí)模型,其中包括神經(jīng)網(wǎng)絡(luò)(Neural Network)、組合樹 (Tree Ensemble)、支持向量機(jī)(Support Vector Machine)以及廣義線性模型(Generalized Linear Model)。

在本系統(tǒng)的應(yīng)用過程中,使用Core ML 轉(zhuǎn)換器,輸入預(yù)訓(xùn)練好的圖像數(shù)據(jù),通過調(diào)用轉(zhuǎn)換器的convert方法,將結(jié)果保存為Core ML模型格式(.mlmodel),最后通過預(yù)先下載將其置入手機(jī)APP程序之中。

4? ? 關(guān)鍵技術(shù)分析

4.1? 圖像識(shí)別技術(shù)

圖像識(shí)別技術(shù)是指利用相關(guān)程序?qū)δ繕?biāo)圖像進(jìn)行錄入、處理、分析和理解,以識(shí)別各種不同模式的目標(biāo)和對(duì)象的技術(shù)。圖像識(shí)別的流程分為4個(gè)步驟:圖像獲取→圖像預(yù)處理→特征提取→圖像識(shí)別。圖像識(shí)別技術(shù)是人工智能的一個(gè)重要領(lǐng)域,在大數(shù)據(jù)時(shí)代下,對(duì)海量數(shù)據(jù)的數(shù)據(jù)模式信息進(jìn)行快速、準(zhǔn)確的檢索是現(xiàn)今研究的熱點(diǎn),而由于圖像中所包含的內(nèi)容信息更加豐富,圖像識(shí)別技術(shù)在該背景下就顯得尤為重要。

傳統(tǒng)圖像識(shí)別技術(shù)的特征提取主要依賴于人工設(shè)計(jì)的提取器,在一定程度上無法提取到更加深層次的高級(jí)語義特征,而且所設(shè)計(jì)的提取器往往需要有專業(yè)的知識(shí)和經(jīng)驗(yàn)對(duì)提取器的參數(shù)進(jìn)行調(diào)整,對(duì)此,采取基于深度神經(jīng)網(wǎng)絡(luò)的圖像識(shí)別技術(shù),該圖像識(shí)別技術(shù)在識(shí)別效率上遠(yuǎn)超傳統(tǒng)圖像識(shí)別技術(shù)。為了能夠達(dá)到更高的圖像識(shí)別精度和速度,深度神經(jīng)網(wǎng)絡(luò)的選擇是本系統(tǒng)能夠達(dá)到預(yù)期目標(biāo)的關(guān)鍵。在識(shí)別過程中,一般會(huì)將錄入圖像的特征參數(shù)與已下載數(shù)據(jù)包中的特征參數(shù)進(jìn)行對(duì)比。為了提取目標(biāo)地點(diǎn)的主要圖像特征參數(shù),選擇采用CNN構(gòu)建深度學(xué)習(xí)模型。

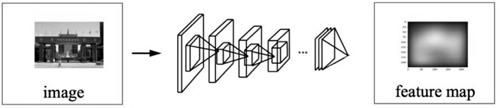

CNN是最具有代表性的深度神經(jīng)網(wǎng)絡(luò)。深度神經(jīng)網(wǎng)網(wǎng)絡(luò)往往具有泛化性的特點(diǎn),即能夠普遍適應(yīng)于各種數(shù)據(jù)模式,但也因此在處理各種數(shù)據(jù)模式時(shí)會(huì)比較復(fù)雜,調(diào)整參數(shù)時(shí)會(huì)比較困難。CNN就是針對(duì)圖像處理所設(shè)計(jì)出來的深度神經(jīng)網(wǎng)絡(luò)。對(duì)于圖像數(shù)據(jù)來說,不同圖像像素之間的距離與圖像識(shí)別目標(biāo)的相似性有關(guān),圖像像素之間的距離越近則相似度越高。CNN在圖像處理過程中能夠?qū)D像進(jìn)行弱化或者消除冗余信息的影響,提取到更加細(xì)致的圖像特征,輸出目標(biāo)圖像的特征向量,如圖2所示,形成特征熱圖。

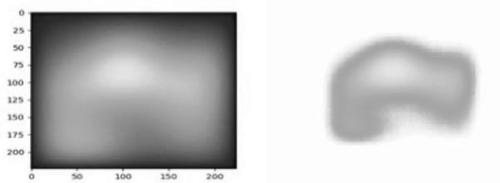

場景的環(huán)境是復(fù)雜的,要求在處理圖像過程中,去除目標(biāo)之外的元素。因此,需要尋找目標(biāo)邊界,并進(jìn)行處理,留下核心區(qū)域。VGG16模型算法是CNN的典型算法,該模型對(duì)圖像處理能夠顯現(xiàn)出優(yōu)良的性能。因此,本文的處理方法為通過VGG16算法將攝入圖像處理為熱圖形式,然后根據(jù)RGB顏色,依據(jù)亮度最高的區(qū)域選擇閾值,再保留以閾值為基準(zhǔn)上下浮動(dòng)一定范圍的區(qū)域。具體如圖3所示。

圖3? 圖像處理

經(jīng)過深度神經(jīng)網(wǎng)絡(luò)的處理、訓(xùn)練、學(xué)習(xí),對(duì)提取的特征向量進(jìn)行運(yùn)算,得出特征向量的距離,并進(jìn)行匹配,得到匹配度,根據(jù)匹配度以及該特征向量所對(duì)應(yīng)的類別標(biāo)簽,最終得出識(shí)別定位結(jié)果。

4.2? 區(qū)域定位及導(dǎo)航技術(shù)原理

第一步是獲取用戶當(dāng)前場景的標(biāo)志地形,通過手機(jī)程序中置入的模型生成特征參數(shù),并與已知的區(qū)域特征參數(shù)進(jìn)行檢索匹配,進(jìn)而實(shí)現(xiàn)單機(jī)環(huán)境下的地理信息獲取和應(yīng)用。

當(dāng)獲得用戶大致地理坐標(biāo)范圍后,要求用戶輸入目標(biāo)地點(diǎn),就可以根據(jù)二者的經(jīng)緯度坐標(biāo)在二維空間中建立相連的路線,并確定大致的行進(jìn)方向,以此確定行進(jìn)方案。在用戶行進(jìn)過程中,需要實(shí)時(shí)確定用戶坐標(biāo)位置的變化,動(dòng)態(tài)地規(guī)劃行進(jìn)路線,因此需要進(jìn)行用戶運(yùn)動(dòng)軌跡推算,估計(jì)用戶的行進(jìn)距離和行進(jìn)方向。

本文使用現(xiàn)有的行人航跡推算法來估計(jì)用戶的行進(jìn)距離和行進(jìn)方向。該推算法基于智能手機(jī)的內(nèi)置傳感器,但由于手機(jī)傳感器的精度限制,行人航跡推算法需要通過分析加速度數(shù)據(jù),進(jìn)行步長估計(jì)和計(jì)步得到用戶的行走長度信息,再結(jié)合陀螺儀和磁力計(jì)完成對(duì)用戶運(yùn)動(dòng)方向信息的估計(jì),最后,為了消除運(yùn)動(dòng)過程中累計(jì)產(chǎn)生的估計(jì)誤差,引入了地標(biāo)對(duì)用戶的位置進(jìn)行矯正。基于手機(jī)傳感器的行人航跡推算法如圖4所示。

圖4? 基于手機(jī)傳感器的行人航跡推算法

行人航跡推算法主要包含3個(gè)部分:計(jì)步與步長估計(jì)算法、方向估計(jì)算法、地標(biāo)矯正算法。計(jì)步與步長估計(jì)算法用來確定用戶的行進(jìn)距離,方向估計(jì)算法用來估計(jì)用戶的行進(jìn)方向,地標(biāo)矯正算法用于糾正用戶的估計(jì)位置,減少運(yùn)動(dòng)時(shí)累計(jì)產(chǎn)生的誤差以及位置偏移。

現(xiàn)代手機(jī)傳感器如:加速度計(jì)、陀螺儀、磁力計(jì)的數(shù)據(jù)表示大多為三維矢量,即加速度、角速度、磁場強(qiáng)度;而由于數(shù)據(jù)噪聲的存在,手機(jī)傳感器收集到的信息可以表示為真實(shí)數(shù)據(jù)與噪聲加合的形式,因此,在使用數(shù)據(jù)前需要對(duì)數(shù)據(jù)進(jìn)行濾波處理,用某種標(biāo)準(zhǔn)的濾波器濾除部分噪聲。在對(duì)數(shù)據(jù)進(jìn)行預(yù)處理后,即可開始行人航跡推算法的計(jì)算。

在計(jì)步方面,計(jì)步與步長估計(jì)算法利用加速度信息判斷。由于人類步行時(shí)加速度呈現(xiàn)正弦特征,即每前進(jìn)一步都會(huì)產(chǎn)生一個(gè)加速度峰值和加速度谷值,另一方面,計(jì)步模型不考慮人的后退情況,因?yàn)閷?duì)于一般用戶,此種行為很少出現(xiàn)。此外,手機(jī)不同的放置狀態(tài)也會(huì)影響計(jì)步的效果,現(xiàn)有的研究多將手機(jī)放置狀態(tài)分為4種:置于口袋,隨臂擺動(dòng),置于身前,靠在耳邊。每種放置狀態(tài)的加速度曲線均不相同,但仍然呈現(xiàn)正弦特征,因而有利于加速度特征的訓(xùn)練及手機(jī)放置模式的判斷。

在加速度數(shù)據(jù)完成計(jì)步后,可以利用加速度進(jìn)行步長的估算,根據(jù)數(shù)據(jù)反饋確定用戶的行進(jìn)距離。一般而言,不同用戶的步長各不相同,同一用戶每一步的步長也不相同。目前估算步長的方法主要有兩種:一是通過輸入用戶身高來估計(jì)步長,此種需要先驗(yàn)知識(shí)的估算會(huì)造成使用的繁瑣,且忽視了每一步步長的遞增差異。目前對(duì)于步長的估計(jì),較為普遍的方法是通過獲得加速度的谷值和峰值動(dòng)態(tài)地估計(jì)和預(yù)算。

移動(dòng)設(shè)備的陀螺儀可以記錄手機(jī)轉(zhuǎn)動(dòng)的三軸角速度,而磁力計(jì)則可以記錄相對(duì)于手機(jī)的三軸磁場強(qiáng)度。陀螺儀的記錄精度會(huì)隨時(shí)間增加而降低,而磁力計(jì)又會(huì)受到人體磁場及環(huán)境磁場的干擾,因此常常把二者相結(jié)合來估計(jì)運(yùn)動(dòng)的行進(jìn)方向。

地標(biāo)矯正使用已知的特殊位置來矯正對(duì)行進(jìn)距離和行進(jìn)方向的估計(jì)。用戶在行進(jìn)過程中,對(duì)具有地標(biāo)特征的景物或者建筑進(jìn)行拍照識(shí)別,以此作為已知的特殊位置對(duì)估計(jì)進(jìn)行地標(biāo)矯正,可以通過增加采樣次數(shù)的方式提高矯正的精確度。

因此,本文所提出的非傳統(tǒng)定位及導(dǎo)航方法首先根據(jù)地標(biāo)景物及輔助定位元素大致確定用戶的地理坐標(biāo)范圍,由用戶輸入目的地后進(jìn)行兩地之間的路線規(guī)劃,在用戶行進(jìn)過程中,根據(jù)手機(jī)傳感器數(shù)據(jù)估計(jì)用戶的行進(jìn)方向和距離,動(dòng)態(tài)地利用地標(biāo)矯正的方法對(duì)估計(jì)進(jìn)行矯正。

5? ? 實(shí)際測試與實(shí)驗(yàn)

本文實(shí)驗(yàn)將使用VGG16算法對(duì)圖像目標(biāo)進(jìn)行訓(xùn)練學(xué)習(xí),訓(xùn)練的數(shù)據(jù)集和測試所使用的數(shù)據(jù)集為自己采集得到的學(xué)校地標(biāo)建筑,并進(jìn)行類別的標(biāo)注。訓(xùn)練的深度學(xué)習(xí)框架為Core ML機(jī)器學(xué)習(xí)框架,將訓(xùn)練好的圖像識(shí)別模型放入到配套的APP中進(jìn)行圖像的識(shí)別。

5.1? 測試結(jié)果

目前基于Core ML機(jī)器學(xué)習(xí)框架已經(jīng)開發(fā)出配套APP。經(jīng)測試,在算法模型輸出體積類比數(shù)據(jù)包體積縮小1 000倍的基礎(chǔ)上,保守估計(jì)仍可有達(dá)到90%以上的識(shí)別準(zhǔn)確率。項(xiàng)目后期擬將該系統(tǒng)擴(kuò)大應(yīng)用于司法、治安等場景中(測試數(shù)據(jù)為112 M的圖片集,模型輸出大小為88 K,識(shí)別準(zhǔn)確率為91%),具體如圖5所示。

圖5? 系統(tǒng)實(shí)際應(yīng)用界面

5.2? 創(chuàng)新點(diǎn)與問題

實(shí)驗(yàn)過程中使用了Apple Core ML預(yù)置模型,112 M的測試圖片集,生成的特征模型大小僅為88 K。在數(shù)據(jù)集體量一般,識(shí)別目標(biāo)輪廓較清晰的情況下(如大門、建筑物、山坡等),準(zhǔn)確率非常高。但缺點(diǎn)是對(duì)于花朵等小目標(biāo)的識(shí)別準(zhǔn)確率較低。

基于地標(biāo)景物識(shí)別的非傳統(tǒng)定位系統(tǒng),在實(shí)際測試中擁有非常好的實(shí)用性。但是在極復(fù)雜的地域下,由于所獲得的圖像環(huán)境不再是單一的環(huán)境,存在無窮的變化,比如光影、角度、遠(yuǎn)近等,同時(shí)人為因素對(duì)圖像質(zhì)量的影響也錯(cuò)綜復(fù)雜。另外,由于深度學(xué)習(xí)模型的層數(shù)越深,復(fù)雜度就會(huì)越高,這就對(duì)運(yùn)行算法程序的硬件設(shè)備產(chǎn)生了較高的要求,限制了其在移動(dòng)端更深入的發(fā)展。在后續(xù)研究和應(yīng)用中,可以通過深度學(xué)習(xí)處理不同自然環(huán)境帶來的差異性影響,同時(shí)進(jìn)一步優(yōu)化模型架構(gòu),建立更高效的算法模型和應(yīng)用思路。

[參考文獻(xiàn)]

[1]楊狀元,林建中.人工智能的現(xiàn)狀及今后發(fā)展趨勢(shì)展望[J].科技信息,2009(4):524-525.

[2]王宇樓.人工智能的現(xiàn)狀及今后的發(fā)展趨勢(shì)展望[J].科技展望,2016(22):299.

[3]張耀銘,張路曦.人工智能:人類命運(yùn)的天使抑或魔鬼—兼論新技術(shù)與青年發(fā)展[J].中國青年社會(huì)科學(xué),2019(1):1-23.

[4]余凱,賈磊,陳雨強(qiáng),等.深度學(xué)習(xí)的昨天、今天和明天[J].計(jì)算機(jī)研究與發(fā)展,2013(9):1799-1804.

[5]何瀟然.基于深度學(xué)習(xí)的文物圖像內(nèi)容理解[D].北京:北京化工大學(xué),2016.

[6]蘇邵麟.基于手機(jī)傳感器和地標(biāo)的Radio Map建立算法研究[D].哈爾濱:哈爾濱工業(yè)大學(xué),2016.

[7]尹蕊.基于卷積神經(jīng)網(wǎng)絡(luò)的景物標(biāo)記[D].北京:北京交通大學(xué),2016.

[8]趙雁飛.基于稀疏表示和超限學(xué)習(xí)機(jī)的智能地標(biāo)識(shí)別算法[D].杭州:杭州電子科技大學(xué),2016.

[9]張東靈.基于圖像識(shí)別的大范圍小區(qū)域定位技術(shù)研究[D].廣州:廣東工業(yè)大學(xué),2012.

[10]吳加順.基于圖像識(shí)別的輔助定位系統(tǒng)設(shè)計(jì)與實(shí)現(xiàn)[D].武漢:華中科技大學(xué),2018.