基于卷積神經網絡的植物圖像分類方法研究

左羽 陶倩 吳戀 王永金

摘 要:近年來,卷積神經網絡已經成為圖像分類領域的應用研究熱點,其對圖像特征進行自提取、自學習,解決了以往圖像分類方法的圖像低層特征到高層概念之間存在的語義鴻溝。為了解決植物圖像的自動分類問題,該文提出一種基于卷積神經網絡(CNN)的植物圖像分類方法,以植物圖像為研究對象,將經典卷積神經網絡VGG16與全卷積網絡(FCN)相結合,把VGG16中兩個通道數為4 096的全連接層改為卷積層,構造一個新的VGG16模型為植物圖像分類模型。文中制作了一個由43類每類500張總共21 500張植物圖像組成的圖像數據集,作為植物圖像分類模型的訓練數據集。實驗結果表明,所提方法在植物的圖像分類上的準確率達到97.23%。應用文中提出的卷積神經網絡對植物圖像進行分類可以取得目前最好的植物圖像分類效果。

關鍵詞:卷積神經網絡;圖像特征;圖像分類;全卷積網絡;植物圖像;數據集

中圖分類號:TP305文獻標識碼:A文章編號:2095-1302(2020)03-00-04

0 引 言

植物是地球上生命存在的主要形態之一,是人類生產生活中不可或缺的一部分,植物種類繁多,在判斷植物類別時,給研究人員也帶來了諸多不便。傳統的植物分類識別,主要依靠植物相關的從業人員或植物專家的從業經驗和專業知識去判別植物的種類,而不同從業人員對植物物種的認識是有限的,植物的分類識別仍是一個問題。

近年來,深度學習發展迅猛,深度學習及卷積神經網絡被廣泛應用于語音識別、目標檢測、圖像分類等領域。而植物圖像分類屬于圖像分類的范疇,研究如何通過深度學習及卷積神經網絡對植物圖像進行快速準確的識別分類,在幫助人們認識植物及植物分類方面具有重要的意義。圖像分類利用圖像中所體現的圖像信息,將不同的類別進行區分,是計算機視覺與圖像處理領域的基礎性研究問題。植物是地球上不可缺少的生物,研究植物圖像的快速識別分類具有很高的學術價值和科技應用價值。

20世紀80年代,圖像分類的研究取得重要進展,出現SIFT,HOG等圖像特征提取算法,隨著對機器學習理論的研究,植物圖像的分類算法也日漸發展。1993年,Guyer等人對40類植物提取其葉片的形狀、面積、周長、長寬度等特征[1],然后將這些低層特征轉化為高層特征進行定性描述,以此對植物圖像進行分類。Satti等人提出將植物圖片的顏色、形狀、葉片邊緣齒輪等特征相結合[2],輸入到人工神經網絡(Artificial Neural Network,ANN)中進行植物圖像的分類,該方法應用在33 種不同植物的圖像庫中,平均識別率為93.3%。Lee等人提出將植物圖像中葉片的脈絡和形狀特征相結合[3],使用快速傅里葉變換得到頻域數據作為特征,在32種植物圖像庫中的平均識別準確率為97.19%。楊天天等人針對7種柳屬植物葉片圖像,單純地通過葉片相關特征進行多特征融合比較[4],綜合判別正確率達到90.8%,實現了對特定種屬葉片圖像分析的高準確率識別。王麗君則將觀葉植物的多特征進行融合[5],通過分析觀葉植物的形態特征,提取觀葉植物葉片圖像的顏色、形狀和紋理等共計26個特征,基于支持向量機(Support Vector Machines,SVM)算法完成觀葉植物葉片分類識別,識別率達到91.41%。

綜上,在以往的植物圖像分類算法中,多傾向于對單一的植物葉片圖像預先提取多種葉片特征,作為分類識別的依據,使用以上方法對植物進行識別分類,圖像低層特征到高層概念之間存在的語義鴻溝難以解決,應用成本高,植物種類單一,識別的準確率也較低。為此,本文提出一種基于卷積神經網絡的植物圖像分類方法。

1 植物圖像分類模型設計

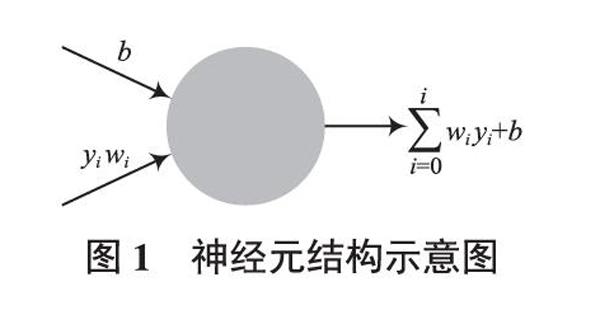

卷積神經網絡(Convolutional Neural Network,CNN)是一種前饋式神經網絡,它的靈感來源于人體內的神經元,圖1為神經元結構示意圖。CNN對大型的圖像處理有出色的表現,目前已成功地應用到圖像識別當中。CNN基本由兩個部分組成:一是特征提取層,在卷積神經網絡中,每個節點的輸入都與前一層的局部接收域相連,從而提取圖像局部的特征信息并確定特征間的位置關系;二是特征映射層,多個特征映射層組成一個計算層,每個特征映射是一個平面,在這個平面上的神經元共享權值。CNN的優點在于整個模型可以自動學習多個層次的特征,這些學習到的特征能夠很好地用于圖像的分類。

最早的卷積神經網絡是LeNet5,是由Yann Lecun教授在1994年提出的,之后又在1998年發表了卷積神經網

絡[6]的前言探索。近年來深度學習和卷積神經網絡的應用呈爆發性增長。在ILSVRC之后的競賽中涌現了眾多經典的深度卷積神經網絡模型。截至2017年,涌現的經典卷積神經網絡模型有LeNet,AlexNet[7],GoogleNet[8],VGG16[9],ResNet[10],FCN[11],Fast R-CNN[12],SPP-Net[13]等。

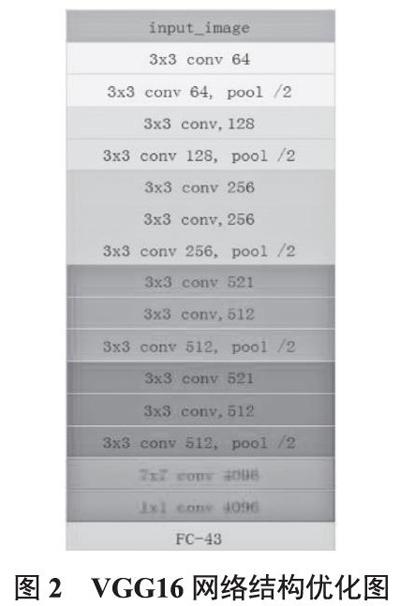

其中,VGG16(Very Deep Convolutional Networks)是由牛津大學的視覺幾何組的Karen和 Andrew實現的卷積神經網絡。它的主要目的是研究在大規模圖像識別任務中卷積網絡的深度對模型精確度的影響,它的主要貢獻也在于展示出了算法的優良性能的關鍵是網絡的深度。

FCN(Fully Convolutional Networks)是Jonathan Long等人提出的全卷積網絡,用于圖像的分割。FCN將CNN中末尾的全連接層改為卷積層,使得整個網絡模型能接收任意大小的輸入圖像尺寸,避免了由于尺寸不同帶來的重復存儲和復雜計算的問題。

在本文中,結合VGG16與FCN兩者的優點,在VGG16的基礎上將VGG16中末尾兩個通道數為4 096的全連接層轉為一個7×7的卷積層和一個1×1的卷積層,從而構造一個新的VGG16網絡模型。圖2為新的VGG16網絡模型,用于植物圖像的分類。

由于VGG16模型有16層,模型參數眾多,少量的數據無法對網絡中的參數進行完全的訓練。在本文中,應用已在大數據集ImageNet上充分訓練的VGG16神經網絡模型參數作為本文中新的VGG16網絡模型的初始化參數。在43類植物,每類500張共21 500張的植物圖像數據集上進行分類訓練。

2 實驗設計及結果分析

2.1 圖像預處理

在以往的圖像分類任務中,進行植物圖像的分類研究時,一個很大的問題是沒有公開統一的數據集,使得各種分類算法間的結論難以做對比。在現今的信息化時代下,圖像的信息每天都在呈指數級增長,普通的植物圖像數據的獲取變得容易。在本文中,收集了43類植物的數據集作為實驗的研究數據。

為了減少過擬合現象,對收集來的植物圖像進行隨機水平、垂直翻轉、隨機縮放操作來擴充數據集,然后再將數據集以5∶1的比例劃分為訓練集和測試集。對收集的大小不一的植物圖像數據做尺寸歸一化,重設為224×224大小,為了使得所有的特征均值都在0附近,保證植物圖像的平穩性,對圖像做了均值規整化處理。圖3為模型訓練時使用的圖像。

2.2 參數設置

在現實生活中,很多問題不都是簡單的線性問題,線性模型能解決的問題是有局限性的,所以在深度學習中,強調非線性。在神經元結構示意圖中,可以看出神經元的輸出為所有輸入的加權和,所以整個神經網絡是一個線性的網絡,在每一個神經元輸出后加上一個激活函數,去除神經元輸出的線性化,則神經網絡就實現了去線性化。圖4展示了去線性化的過程。

本文在每層卷積層后加一個ReLU激活函數[14],實現神經網絡的去線性化。相比sigmoid和tanh激活函數,ReLU激活函數只需要一個閾值就可以得到激活值,不用進行復雜的運算,所以正向傳播的計算速度快,ReLU激活函數可以極大地加快收斂速度。

文中使用在分類問題中廣泛使用的交叉熵[15]作為損失函數,交叉熵表達的是兩個概率分布之間的距離。假設p代表正確答案,q代表預測值,則:

交叉熵的值越小,p和q的概率分布越接近,預測值越接近真實值,預測準確率越高。

學習率是深度學習中的一個重要參數,合理的學習率設置是訓練出一個好的模型的重要因素。當學習率過小時,雖然能保證收斂性,但是會降低網絡優化的速度,需要很多輪的迭代才能達到比較理想的網絡優化效果,訓練花費的時間較長。當學習率設置過大時,會導致參數不能收斂到一個極小值,達不到網絡優化的效果。所以在學習率設置方面,初始學習率設為0.005,指數衰減系數設為0.1,衰減速度為672。在前期收集植物的圖片數據集時,每一類的圖片數據集都收集了相同的數量,所以在用Tensorflow實現網絡時,學習率設置為呈階梯狀衰減,在每完整地使用一次訓練數據時,學習率衰減一次,這樣就使得所有的訓練數據對模型的優化具有相同的作用。

2.3 防止過擬合

在機器學習與深度學習中,過擬合是一個常見的問題,具體表現為在訓練集上表現好,在測試集上表現不好,如果模型出現這種情況,那么模型的實用性就較差。為了降低過擬合的概率,在機器學習中主要有幾種常用方法:參數范數懲罰也就是正則化,模型過擬合可能是由于模型過于復雜,所以要對參數添加限制(正則化懲罰項);增加訓練數據集使模型擬合更多特征;在訓練時設置合理的迭代次數,避免模型對訓練集的過擬合;Dropout阻斷卷積神經網絡中部分神經元之間的協同作用,減輕部分神經元之間的聯合適應性,防止模型過擬合。在本文中,選用Dropout方法防止模型的過擬合。經過驗證,隱含節點Dropout率為0.5時網絡模型的效果是最好的,此時生成的隨機網絡結構最多。

2.4 實驗結果分析

圖5為模型經過80 700次迭代后,訓練精度與loss值的變化曲線。

實驗結果對比見表1所列。

由表1可得,VGG16+FCN-26為最早進行實驗時使用了26類植物圖像進行訓練的測試精度方法;VGG16+FCN-43為最終實驗使用的43類植物圖像的測試精度方法。可見,使用VGG16 + FCN的網絡模型對植物的圖像分類準確率更高。

3 結 語

為了提高植物圖像分類的精度,本文提出結合VGG16和FCN兩者的優點,將VGG16的兩個通道數為4 096的全連接層改為卷積層,構造一個新的模型,然后在收集的

43類植物的圖像數據集中進行訓練。實驗結果表明,此方法平均分類準確率達到97.23%,高于傳統的植物圖像分類方法。今后的研究方向是將此模型應用于各類數據集上,提高此模型的容錯性。

參 考 文 獻

[1] GUYER D E,MILES G E,GAULTNEY L D,et al. Application of machinetoshape analysis in leaf and plant identification[J].Transactions of the asae,1993,36(1):163-171.

[2] SATTI V,SATYA A,SHARMA S. An automatic leaf recognition system for plant identification using machine vision technology [J]. International journal of engineering science and technology,2013,5(4):874-886.

[3] LEE K,HONG K. An implementation of leaf recognition system using leaf vein and shape [J]. International journal of Bio-Science and Bio-Technology,2013,5(2):57-66.

[4]楊天天,潘曉星,穆立薔.基于葉片圖像特征數字化信息識別

7種柳屬植物[J].東北林業大學學報,2014,42(12):75-79.

[5]王麗君. 基于寸片困像多特征提取的觀葉植物種類識別化[D]. 北京:北京林業大學,2014.

[6] LECUN Y,BOTTOU L,BENGIO Y,et al. Gradient-based learning applied to document recognition [J]. Proceedings of the IEEE,1998,86(11):2278-2324.

[7] KRIZHEVSKY A,SUTSKEVER I,HINTON G E. ImageNet classification with deep convolutional neural networks[C]// International Conference on Neural Information Processing Systems. Curran Associates Inc,2012:1097-1105.

[8] SZEGEDY C,LIU W,JIA Y Q,et al. Going deeper with convolutions [C]// IEEE Conference on Computer Vision and Pattern Recognition. IEEE Computer Society,2015:1-9.

[9] SIMONYAN K,ZISSERMAN A.Very deep convolutional networks for large-scale Image recognition [J]. Computer science,2014.

[10] HE K,ZHANG X,REN S,et al. Deep residual learning for image recognition [C]// Computer Vision and Pattern Recognition.IEEE,2016:770-778.

[11] LONG J,SHELHAMER E,DARRELL T. Fully convolutional networksfor semantic segmentation [J]. IEEE transactions on pattern analysis& machine intelligence,2017,39(4):640-651.

[12] GIRSHICK R. Fast R-CNN [J]. Computer science,2015:72-78.

[13] HE K,ZHANG X,REN S,et al. Spatial pyramid pooling in deep convolutional networks for visual recognition [J]. IEEE transactions on pattern analysis &machine intelligence,2014,37(9):1904.

[14] ZHI Chen,PIN-HAN Ho. Global-connected network with generalized ReLU activation [J]. Pattern recognition,2019:96.

[15] HU Kai,ZHANG Zhenzhen,NIU Xiaorui,et al. Retinal vessel segmentation of color fundus images using multiscale convolutional neural network with an improved cross-entropy loss function [J]. Neurocomputing,2018:309.