基于兩階段鄰域回歸的圖像超分辨率重建

端木春江 沈碧婷

摘 ?要: 針對現(xiàn)有的鄰域回歸超分辨率算法僅通過一次方案從低分辨率空間映射到高分辨率空間,不能很好地表示復(fù)雜的映射關(guān)系,提出了一種兩階段鄰域回歸的圖像超分辨率重建方法。在第一階段,用傳統(tǒng)的鄰域回歸方法重建初始高分辨率圖像,然后把一個正則化項加入超分辨率重建模型中,以提高重建圖像的精度。在第二階段,以增強的方式訓(xùn)練殘差字典和殘差回歸學(xué)習(xí),降低映射誤差。與別的鄰域回歸方法不同,采用了四個方向的Sobel算子代替一階梯度和二階梯度來提取低分辨率圖像特征。實驗結(jié)果表明,所提出的方法性能優(yōu)于傳統(tǒng)的超分辨率重建方法。

關(guān)鍵詞: 鄰域回歸; 兩階段; 殘差字典; 殘差回歸

中圖分類號:TP391 ? ? ? ? ?文獻標(biāo)識碼:A ? ? 文章編號:1006-8228(2020)01-10-04

Abstract: In order to solve the problems existed in the existing neighborhood regression super-resolution algorithms that map from low-resolution space to high-resolution space in only one scheme, and cannot represent the complex mapping relationships well, an image super-resolution reconstruction algorithm based on two-stage neighborhood regression is proposed. In the first stage, the original high-resolution image is reconstructed by the traditional neighborhood regression method, and then a regularization term is added to the super-resolution reconstruction model to improve the accuracy of the reconstructed image. In the second stage, the residual dictionary and residual regression are trained in an enhanced manner, reducing mapping errors. Different from the other neighborhood regression method, the Sobel operator in four directions is used instead of one order gradient and two order gradient to extract low-resolution image features. The experimental results show that the proposed method outperforms the traditional super-resolution reconstruction method.

Key words: neighborhood regression; two-stage; residual dictionary; residual regression

0 引言

圖像超分辨率重建是用一定的算法,把低分辨率圖像恢復(fù)到高分辨率圖像的方法。由于該方法簡單且高效,已經(jīng)被廣泛運用在衛(wèi)星遙感、視頻監(jiān)控、城市交通等領(lǐng)域[1]。

圖像超分辨重建的方法可分為三大類:基于插值、基于重建、基于學(xué)習(xí)的方法。目前基于學(xué)習(xí)的方法是該領(lǐng)域的研究的熱點。Yang[2]依據(jù)稀疏編碼原理,提出稀疏表示的超分辨率算法。Zeyde[3]采用主成分分析方法對低分辨率圖像特征向量進行降維,用ksvd方法訓(xùn)練字典,極大加快了重建速度。Timofte提出錨定鄰域回歸的方法(ANR)[4]和其改進的方法(A+)[5],訓(xùn)練階段訓(xùn)練出字典原子的映射矩陣,重建階段把低分辨率圖像塊特征與最匹配的字典原子的映射矩陣相乘,重建出高分辨率圖像,在一定程度上提高圖像質(zhì)量且不增加時間。Dong首次把卷積神經(jīng)網(wǎng)絡(luò)應(yīng)用在圖像超分辨率重建中,提出基于深度卷積網(wǎng)絡(luò)的非線性回歸超分辨率重建方法(SRCNN)[6]。

雖然鄰域回歸重建效果不錯,但是存在著一些不足之處:低分辨率圖像和高分辨率圖像之間的映射關(guān)系是復(fù)雜和非線性,僅使用一組簡單的線性函數(shù)去表示該映射關(guān)系是不夠的。

為了更好表示低分辨率圖像和高分辨率圖像之間復(fù)雜的映射關(guān)系,本文在A+方法的基礎(chǔ)上,提出兩階段鄰域回歸的超分辨率方法,近似表示低、高分辨率圖像之間映射關(guān)系。所提出的方法有兩個階段,在第一階段,用鄰域回歸方法恢復(fù)初始高分辨率圖像,在目標(biāo)約束函數(shù)中加入一個先驗知識,優(yōu)化高分辨率圖像。在第二階段,分別進行殘差字典訓(xùn)練和殘差回歸學(xué)習(xí)。此外,低分辨率圖像特征用四個Sobel算子提取,提取的特征更豐富。

1 基于鄰域回歸的圖像超分辨率重建原理

首先回顧基于鄰域回歸的超分辨率重建算法。假設(shè)[pilNsi=1]和[pihNsi=1]分別表示從訓(xùn)練集中提取出來的低、高分辨率圖像塊的特征,低分辨率字典[D=dkKk=1]從低分辨率空間訓(xùn)練得到。對每個原子[dk],在低分辨率空間中找到它的max個最近鄰,組成錨點的鄰域[Nl,k],并在高分辨率空間中找到其對應(yīng)的鄰域[Nh,k]。采用嶺回歸和[l2]范數(shù)正則化最小回歸的方法,來獲得每對低、高分辨率圖像塊特征的鄰域[Nl,k,Nh,kKk=1]的映射矩陣,這個問題用式⑴表示:

把殘差圖像[e]當(dāng)作第二階段的高分辨率圖像訓(xùn)練集,把第一階段重建的高分辨率圖像[X1]當(dāng)作第二階段的低分辨率圖像訓(xùn)練集,按照第一階段訓(xùn)練低分辨率字典和高分辨率字典的方法,得到第二階段的殘差低分辨率字典[RDl]和殘差高分辨率字典[RDh]。訓(xùn)練得到的殘差字典具有較小的冗余性,能更好的適應(yīng)圖像的高頻細(xì)節(jié)。

同樣的,按照第一階段求解字典原子的映射矩陣的方法,在第二階段進行殘差回歸學(xué)習(xí),得到第二階段的殘差字典原子的映射矩陣[F2,k]。

2.4 圖像重建階段

本文提出的方法在重建階段算法如下:

Step1 輸入低分辨率測試圖像;

Step2 對測試圖像分塊,并用PCA方法對測試圖像塊進行降維;

Step3 為每一個測試圖像塊在[Dl]中找到最近原子,按照式(18)重建高分辨率圖像塊,把所有測試圖像塊遍歷完,拼接高分辨率圖像塊,得到初始高分辨率圖像;

Step4 根據(jù)式⑺對初始高分辨率圖像進行優(yōu)化,得到第一階段的高分辨率圖像;

Step5 把第一階段的高分辨率圖像作為第二階段的低分辨率測試圖像,重復(fù)Step2;

Step6 給第二階段的每一個測試圖像塊在[RDl]中找到最近原子,根據(jù)式⒅從低分辨率空間映射到高分辨率空間,組合所有高分辨率圖像塊后,得到第二階段的初始高分辨率圖像;

Step7 按照式⑺對第二階段初始高分辨率圖像進行優(yōu)化,得到輸出高分辨率圖像。

3 實驗結(jié)果與評價

為了驗證所提方法的有效性,本文使用了標(biāo)準(zhǔn)的圖像測試集:Set14,進行放大3倍超分辨率重建,并和Zeyde、ANR、A+和SRCNN等方法進行比較。

實驗中,訓(xùn)練集使用91幅圖像,[Dh,Dl]和[RDh,RDl]的原子數(shù)目均取1024,原子的近鄰數(shù)取2048,迭代次數(shù)[t=120],提取圖像塊大小取[9×9]。

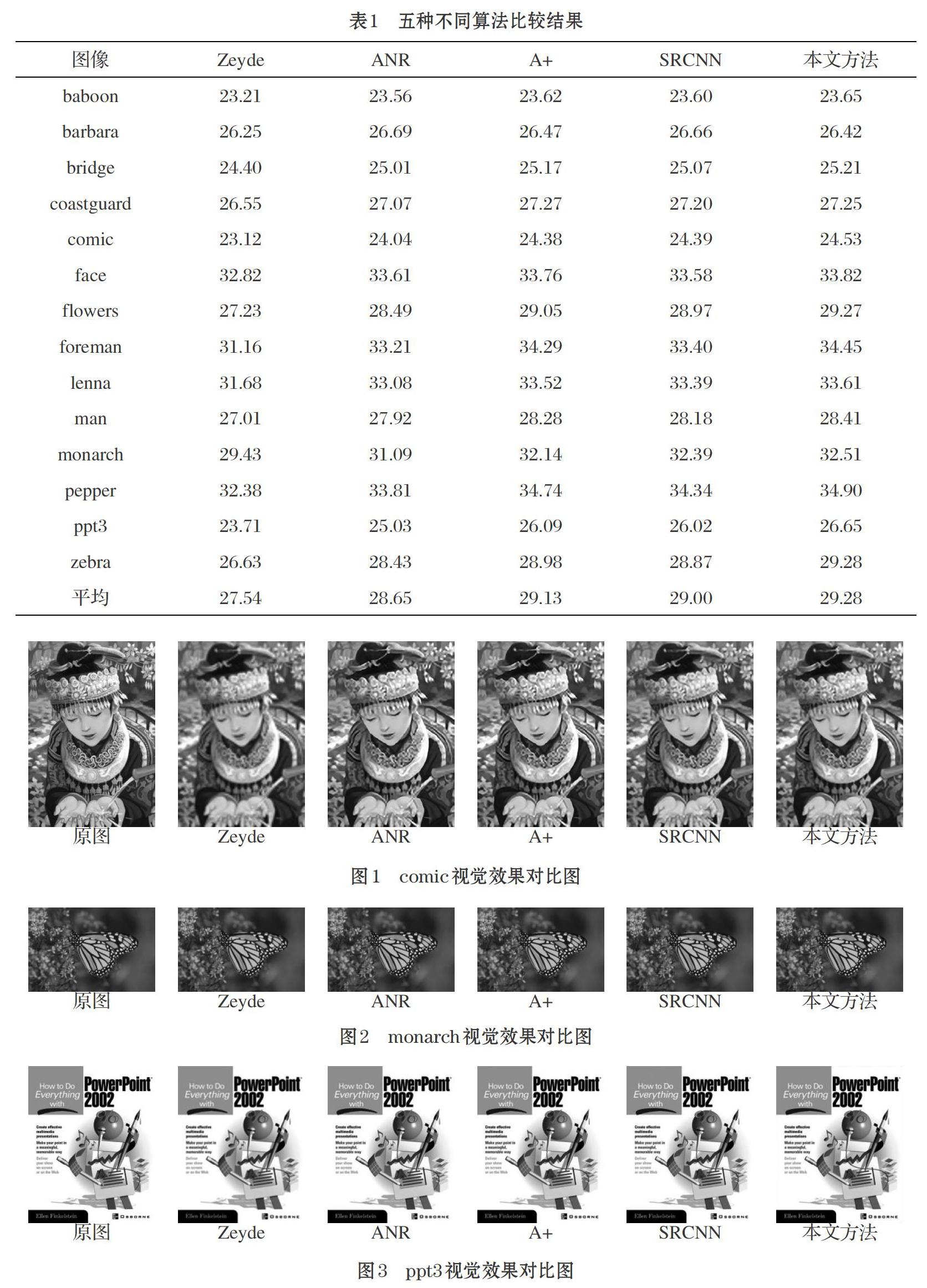

本文采用峰值信噪比(PSNR)作為圖像重建效果的客觀評價指標(biāo)。表1給出了五種方法比較結(jié)果,對比表中數(shù)據(jù),本文提出的方法平均峰值信噪比分別比Zeyde高1.74dB、比ANR高0.63dB、比A+高0.15dB、比SRCNN高0.28dB。實驗結(jié)果表明:本文所提出的方法在性能指標(biāo)上比傳統(tǒng)的超分辨率方法好。

為了進一步分析所提出算法的有效性,圖1,圖2和圖3分別給出comic、monarch和ppt3這三幅圖像在放大三倍情況下的視覺效果對比圖像。從人的感官上看,所提出的算法重建得到的圖像有更豐富的細(xì)節(jié)信息,而且也不存在虛假的邊緣。

5 結(jié)束語

本文提出兩階段鄰域回歸的超分辨率重建方法,用來解決從低分辨率空間映射到高分辨率空間的映射關(guān)系不夠理想的問題。通過兩階段的學(xué)習(xí),有效的降低原始高分辨率圖像和重建高分辨率圖像之間的誤差。通過實驗數(shù)據(jù)和視覺效果對比,表明本文提出的方法優(yōu)于傳統(tǒng)的超分辨率方法。但本文所提出的方法仍不能較好的表示低分辨率圖像映射到高分辨率圖像之間的映射關(guān)系,因此接下來可以考慮進一步優(yōu)化該映射關(guān)系,進一步提高圖像的質(zhì)量。

參考文獻(References):

[1] Zhang Y,F(xiàn)an Q,Bao F,et al. Single-Image Super-Resolution Based on Rational Fractal Interpolation[J]. IEEE Transactions on Image Processing,2018:1-1.

[2] Yang J,Wright J,Huang T S,et al. Image Super-Resolution Via Sparse Representation[J]. IEEE Transactions on Image Processing,2010.19(11):2861-2873

[3] Roman Zeyde,Michael Elad, Matan Protter.On Single Image Scale-Up Using Sparse-Representations[C]// International Conference on Curves and Surfaces. Springer-Verlag,2012:711-730

[4] Timofte R,De V,Gool L V.Anchored Neighborhood Regression for Fast Example-Based Super-Resolution[C]// IEEE International Conference on Computer Vision. IEEE Computer Society,2013:1920-1927

[5] Timofte R,Smet V D,Gool L V.A+:Adjusted Anchored Neighborhood Regression for Fast Super-Resolution[C]// Asian Conference on Computer Vision.Springer,Cham,2014:111-126

[6] Dong C,Loy C C,He K,et al. Image Super-Resolution Using Deep Convolutional Networks[J]. IEEE Trans Pattern Anal Mach Intell,2014.38(2):295-307

[7] Dong W,Zhang L,Shi G,et al.Image Deblurring and Super-resolution by Adaptive Sparse Domain Selection and Adaptive Regularization[J].IEEE Transactions on Image Processing,2010.20(7):1838-1857

[8] 楊敏,李敏,易亞星. 一種改進的稀疏表示紅外圖像超分辨率重建[J].電光與控制,2016.12:1-4,共4頁.