一種基于非對(duì)稱(chēng)決策融合的行人檢測(cè)方法?

孫 妍 譚毅華 李彥勝 田金文

(華中科技大學(xué)多譜信息處理技術(shù)國(guó)家級(jí)重點(diǎn)實(shí)驗(yàn)室 武漢 430070)

1 引言

行人識(shí)別是行人跟蹤和行為分析的基礎(chǔ),因此對(duì)行人的快速準(zhǔn)確地識(shí)別是十分重要的。盡管關(guān)于檢測(cè)方法精確度的提升已有諸多研究,如使用基于Haar 特征[1],或加入運(yùn)動(dòng)信息[3]、先驗(yàn)信息輔助檢測(cè)[2],也有采用全局灰度特征的方法[4],除此之外,基于神經(jīng)網(wǎng)絡(luò)和深度學(xué)習(xí)的行人檢測(cè)也有所研究和進(jìn)展[10~13],然而,自從光流信息被開(kāi)始使用獲取運(yùn)動(dòng)特征[19~20],在運(yùn)動(dòng)檢測(cè)平臺(tái)上基于光流[21]的運(yùn)動(dòng)特性仍然不能很好地實(shí)現(xiàn)實(shí)時(shí)行人識(shí)別,所以關(guān)于行人檢測(cè)仍具有更多的潛在線索來(lái)提高識(shí)別的準(zhǔn)確性。故本文意在利用從單幀、圖像序列到場(chǎng)景上下文的運(yùn)動(dòng)信息,在單目視頻監(jiān)控中挖掘盡可能多的信息,以提高行人識(shí)別的準(zhǔn)確程度。

當(dāng)行人暫時(shí)保持靜止時(shí),運(yùn)動(dòng)信息消失;當(dāng)行人開(kāi)始移動(dòng)時(shí),它會(huì)再次出現(xiàn)。所以Stefan Walk和Konrad Schindler 等提出整合多方面特征以提高行人識(shí)別的準(zhǔn)確性[22]。但在實(shí)際跟蹤過(guò)程中,相比經(jīng)常變化的運(yùn)動(dòng)特征,保持不變的行人外觀特征更加穩(wěn)定一些;如果貿(mào)然將這二者融合起來(lái)用于跟蹤,不穩(wěn)定的運(yùn)動(dòng)特征可能反而影響跟蹤效果。基于此種情況,本文提出了一種非對(duì)稱(chēng)決策融合的方法來(lái)處理這種不穩(wěn)定特征的融合,在使用該方法進(jìn)行融合的特征,可以獲得更準(zhǔn)確的行人識(shí)別結(jié)果。

2 行人識(shí)別檢測(cè)算法框架介紹

對(duì)監(jiān)控?cái)z像視頻的單幀數(shù)據(jù)進(jìn)行分析時(shí),整幅圖像上的行人由于出現(xiàn)位置的不同,其尺度大小、出現(xiàn)概率都是各不相同的。因此,選取的滑動(dòng)窗口將會(huì)成為影響檢測(cè)效果一個(gè)很重要的因素。如圖所示,圖1(a)為固定位置后不同尺寸的滑動(dòng)窗口在原始圖像上的投影大小對(duì)比示意,圖1(b)為固定大小的滑動(dòng)窗口改變位置后的示意圖。可以看出,選取這兩種不同的滑動(dòng)窗口將對(duì)下一步的行人檢測(cè)結(jié)果是否準(zhǔn)確有著不可忽略的影響,因此滑動(dòng)窗口的選擇相當(dāng)重要。

圖1 不同尺度、方位的行人檢測(cè)滑動(dòng)窗口示意圖

鑒于上述的情況,本文擬采用固定尺寸的滑動(dòng)窗口對(duì)原圖像降采樣后的圖像金字塔[18]進(jìn)行行人信息的提取。每個(gè)滑動(dòng)窗口都可以使用度量(location,scale)被唯一的標(biāo)記,其中l(wèi)ocation表示了該滑動(dòng)窗口所處的位置,scale 表示該滑動(dòng)窗口所處的圖像金字塔層級(jí)中圖像尺度。這樣,當(dāng)使用的所有窗口在原圖像上映射后,就相當(dāng)于我們使用了位置、尺度均有變化的滑動(dòng)窗口用于檢測(cè)。而從圖1 可以看出,每個(gè)窗口最下方的中點(diǎn)“足點(diǎn)(foot)”可以唯一標(biāo)記該窗口位置信息,窗口高度(height)可以唯一標(biāo)記該窗口尺度信息,統(tǒng)一起見(jiàn),下文我們將使用足點(diǎn)和窗口高度(foot,height)作為該窗口的唯一標(biāo)記。

圖2 單目監(jiān)控視頻下的行人檢測(cè)框架

如圖2 所示為本文使用的特征組合框架,首先通過(guò)滑動(dòng)窗口提取行人外觀特征,訓(xùn)練外觀特征分類(lèi)器;另一方面,本文利用相鄰幀之間的光流信息[26]訓(xùn)練基于運(yùn)動(dòng)特征分類(lèi)器,然后根據(jù)上述兩種分類(lèi)器所產(chǎn)生的結(jié)果,建立非對(duì)稱(chēng)融合分類(lèi)器,該分類(lèi)器將用于行人檢測(cè),輸出檢測(cè)結(jié)果。

3 滑動(dòng)窗特征提取與決策融合

3.1 行人外觀特征獲取

本文采用了J. Wu 等[5]所提出的Centrist 特征作為行人描述符,Centrist 特征主要描述了滑動(dòng)窗口中目標(biāo)的輪廓信息,具有較強(qiáng)的識(shí)別正負(fù)樣本的能力,具有快速的評(píng)價(jià)速度和較高的精度。概括來(lái)說(shuō),Centrist 特征是在原始圖像的Sobel 邊緣圖上計(jì)算出的一致變換的直方圖。設(shè)Χ代表滑動(dòng)窗口的Centrist 特征,我們使用s=(Χ,foot,height)作為擴(kuò)展特征向量來(lái)表示行人的描述特征,以便更好地計(jì)算行人的先驗(yàn)概率。

3.2 行人運(yùn)動(dòng)特征獲取

在視頻監(jiān)控應(yīng)用中,大多數(shù)行人目標(biāo)都沿著特定的方向移動(dòng),所以其運(yùn)動(dòng)信息將能夠提供出判斷目標(biāo)為行人的重要依據(jù)。由于光流的運(yùn)動(dòng)幅度可以很好地給出運(yùn)動(dòng)物體的輪廓信息,所以本文將通過(guò)計(jì)算光流的運(yùn)動(dòng)信息來(lái)提取目標(biāo)的運(yùn)動(dòng)特征。

通過(guò)光流計(jì)算,圖像中的每個(gè)像素在足夠的迭代后均可以準(zhǔn)確地獲得光流向量(u,v)。盡管靜止的攝像機(jī)在大多數(shù)時(shí)間內(nèi)可以人為其所導(dǎo)致的背景運(yùn)動(dòng)為零,但我們有時(shí)也需要考慮攝像機(jī)的抖動(dòng)可能性,因此,我們令(mˉx,mˉy)表示背景的平均運(yùn)動(dòng)分別在x方向和y方向的位移。平均運(yùn)動(dòng)位移通過(guò)計(jì)算運(yùn)動(dòng)矢量較為接近的像素集合組成的區(qū)域可以獲得,然后就可得到運(yùn)動(dòng)物體的相對(duì)運(yùn)動(dòng)信息,即運(yùn)動(dòng)幅度I和運(yùn)動(dòng)相位p,公式如下:

如圖3 所示,(a)、(b)為用于計(jì)算的相鄰幀原圖,(c)為該光流的幅值I表示,(d)為該光流的相位p 信息。可以看出通過(guò)計(jì)算得到的光流的幅值I 可以獲得運(yùn)動(dòng)目標(biāo)的完整輪廓信息并提取到運(yùn)動(dòng)目標(biāo)的運(yùn)動(dòng)特征。最后,再將運(yùn)動(dòng)幅值歸一化至[0,255]區(qū)間內(nèi)即可。

下一步本文將使用場(chǎng)景的外觀圖像和運(yùn)動(dòng)圖像來(lái)進(jìn)行行人目標(biāo)檢測(cè)工作。通過(guò)滑動(dòng)窗口提取Centrist 特征的方法分別在原圖像和運(yùn)動(dòng)圖像上計(jì)算,就可以獲得行人目標(biāo)的外觀特征集合和運(yùn)動(dòng)特征集合。此外,本文提出的運(yùn)動(dòng)特征提取方法也可以推廣使用到背景有緩慢運(yùn)動(dòng)的場(chǎng)景當(dāng)中。

圖3 相鄰幀間光流計(jì)算示意圖

另一個(gè)需要考慮的情況是,當(dāng)行人目標(biāo)暫時(shí)保持靜止時(shí),其運(yùn)動(dòng)信息將會(huì)消失。因此,與外觀信息相比,運(yùn)動(dòng)信息是不穩(wěn)定的,針對(duì)這種情況,本文提出的非對(duì)稱(chēng)決策融合方法可以解決這類(lèi)問(wèn)題。

3.3 外觀特征與運(yùn)動(dòng)特征的決策融合

在訓(xùn)練階段,相鄰兩幀被定義為一個(gè)樣本,外觀圖像定義為示例對(duì)的第一幀,并以光流法計(jì)算得到運(yùn)動(dòng)圖像。對(duì)于外觀特征的分類(lèi)器訓(xùn)練時(shí),正樣本為外觀圖像上標(biāo)注直立的行人目標(biāo),負(fù)樣本為原圖上選擇隨機(jī)的背景圖像塊。對(duì)于運(yùn)動(dòng)特征的分類(lèi)器訓(xùn)練時(shí),正樣本被定義為在運(yùn)動(dòng)圖像幀間具有明顯移動(dòng)的直立行人目標(biāo),而負(fù)樣本被定義為運(yùn)動(dòng)圖像上沒(méi)有移動(dòng)行人目標(biāo)的隨機(jī)圖像塊。如圖4所示,圖(a)為滑動(dòng)窗口的外觀特征正樣本平均Sobel模板,圖(b)為滑動(dòng)窗口的運(yùn)動(dòng)特征正樣本平均Sobel模板,可見(jiàn)對(duì)這兩特征樣本來(lái)說(shuō),其平均Sobel模板都可以很好地描述行人的輪廓。根據(jù)所選擇的這兩類(lèi)特征的正負(fù)樣本集,對(duì)外觀特征分類(lèi)器和運(yùn)動(dòng)特征分類(lèi)器進(jìn)行訓(xùn)練,使之能有效分辨出正確的、用于有效目標(biāo)檢測(cè)的特征。

普遍使用的用于行人識(shí)別的分類(lèi)器包括SVM[5,9~10]和boosting分類(lèi)器[1],無(wú)論何種分類(lèi)器,其輸出的歸一化對(duì)決策融合方法都至關(guān)重要。所以本文使用通過(guò)Sigmoid 函數(shù)將兩個(gè)分類(lèi)器的輸出z變換為[0,1]之間的概率值,以便使分類(lèi)器輸出的融合,運(yùn)算公式如下:

圖4 行人目標(biāo)的平均模板圖

如上所述,最終在監(jiān)控場(chǎng)景圖像上的同一位置同一尺度的滑動(dòng)窗口將會(huì)得到兩個(gè)特征來(lái)進(jìn)行融合:目標(biāo)外觀特征和運(yùn)動(dòng)特征。本文提出了一種非對(duì)稱(chēng)融合方法來(lái)代替普通的融合方法,為了描述這種非對(duì)稱(chēng)融合方法,下文先給出了一些基本的定義。

在當(dāng)前幀圖像序列檢測(cè),使用Iatpp和分別表示外觀圖像和運(yùn)動(dòng)圖像;令sapp=(Χapp,foot,height) 和=(Χmotion,foot,height) 分 別 表示提取到的目標(biāo)外觀特征和運(yùn)動(dòng)特征。簡(jiǎn)化起見(jiàn),設(shè)i ∈{a pp,motion} 和j ∈{ pedes,bg },這里pedes表示行人和bg 表示背景。 pj(si)表示第i 個(gè)分類(lèi)器識(shí)別滑動(dòng)窗口的特征向量到第j 類(lèi)的概率值,對(duì)于本算法中的分類(lèi)器來(lái)說(shuō),pj(si)中的s 即為特征X ,故pj( si)=pj(Χi)。在特征向量對(duì)的歸一化之后,可得:

令r=( pped( sapp),pped( sapp),foot,height )表示滑動(dòng)窗口的最終行人檢測(cè)結(jié)果,該結(jié)果各項(xiàng)分別表示外觀特征與運(yùn)動(dòng)特征的置信度概率值,滑動(dòng)窗口的位置與尺度大小。那么我們可以使用前一幀的檢測(cè)結(jié)果來(lái)幫助增強(qiáng)當(dāng)前滑動(dòng)窗口的決策,具體算法如下式所示:

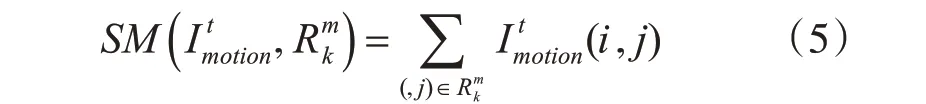

在式(5)中,Rm表示序列前一幀的行人檢測(cè)的結(jié)果,Rmk表示包含總共m 個(gè)行人目標(biāo)的檢測(cè)結(jié)果中的第k 個(gè)行人的識(shí)別結(jié)果;表示所在區(qū)域的運(yùn)動(dòng)圖像的累積運(yùn)動(dòng)幅值。

由于Rs表示行人識(shí)別結(jié)果,可以理解為諸多行人目標(biāo)識(shí)別序列的子集,每個(gè)子集表示某一特定行人目標(biāo)前一幀的識(shí)別序列與當(dāng)前幀目標(biāo)暫時(shí)保持靜止提取序列的集合。這樣,每個(gè)行人目標(biāo)的結(jié)果都對(duì)其一定范圍的鄰域具有增強(qiáng)作用(在式(8)中,s 表示半徑,本算法取值s=5),以此用來(lái)提高行人目標(biāo)靜止時(shí)的識(shí)別準(zhǔn)確率。式(9)表示,Rs中第k 個(gè)行人識(shí)別結(jié)果產(chǎn)生的增強(qiáng)因子與其運(yùn)動(dòng)特征置信度概率值conf_motionk成正比,與滑動(dòng)窗口的位置距離和窗口尺寸大小成反比。

如式(10)所示,當(dāng)行人暫時(shí)靜止時(shí),前一幀的運(yùn)動(dòng)信息可以增強(qiáng)當(dāng)前幀的外觀決策值。本文使用式(11)中的方法以降低運(yùn)動(dòng)信息的速度衰減,作為輔助來(lái)平穩(wěn)行人識(shí)別結(jié)果,其中α 表示運(yùn)動(dòng)信息的延遲系數(shù),α 越大,運(yùn)動(dòng)信息的衰減速度越慢。整個(gè)算法流程總結(jié)如下:

算法步驟

1.如式(4)所示,歸一化分類(lèi)器的輸出;

2.如式(10)和(11)所示,當(dāng)行人在當(dāng)前幀上保持靜止時(shí),增強(qiáng)幀間的外觀決策和動(dòng)作決策;

3.令qj(s)表示特征向量s屬于第j類(lèi)的概率值,則qj(s)的計(jì)算方法如下所示。

4. 令ω(s)表示特征向量s 歸屬于哪一類(lèi)的最終決策,則ω(s)的計(jì)算方法如下:

4 實(shí)驗(yàn)結(jié)果與分析

4.1 數(shù)據(jù)集與實(shí)驗(yàn)條件

本算法實(shí)驗(yàn)采用的圖像序列,其應(yīng)當(dāng)包括各種真實(shí)的行人識(shí)別情況:暫時(shí)保持靜止的行人序列,與背景對(duì)比度較低的行人序列,伴隨有陰影的行人序列等。本文采用的實(shí)驗(yàn)數(shù)據(jù)及均包含這些情況,基本考慮到了監(jiān)控中行人識(shí)別的各種問(wèn)題。我們將實(shí)驗(yàn)數(shù)據(jù)可分為訓(xùn)練數(shù)據(jù)和測(cè)試數(shù)據(jù)。訓(xùn)練數(shù)據(jù)主要包括大約661 個(gè)帶注釋的圖像正樣本,以及50 個(gè)不同場(chǎng)景、不包含行人的圖像負(fù)樣本。這些樣本均來(lái)自自己收集的監(jiān)控場(chǎng)景圖像以及TUD-BRUSSELS-MOTIONPAIRS 公共數(shù)據(jù)集。測(cè)試數(shù)據(jù)主要包括了各種戶外環(huán)境中收集的直立行走的行人目標(biāo),以及PETS 2006 公共數(shù)據(jù)集中的直立行走行人目標(biāo)子集。

4.2 非對(duì)稱(chēng)融合方法的行人識(shí)別結(jié)果

為了論證本文提出的非對(duì)稱(chēng)融合方法在實(shí)際監(jiān)控中的有效性,首先給出了在實(shí)際監(jiān)控中采集的3 個(gè)圖像序列的行人識(shí)別結(jié)果,如圖5 所示,序列1(第1 行)為行進(jìn)的伴隨影子的行人目標(biāo)識(shí)別情況,序列2(第2行)為與監(jiān)控場(chǎng)景背景對(duì)比度較低的行人目標(biāo)識(shí)別情況,序列3(第3 行)為行人目標(biāo)忽然停止的識(shí)別情況;其中(a)列表示外觀分類(lèi)器的行人識(shí)別結(jié)果,(b)列表示運(yùn)動(dòng)分類(lèi)器的行人識(shí)別結(jié)果,(c)列表示一般融合分類(lèi)器的行人識(shí)別結(jié)果,(d)列表示非對(duì)稱(chēng)融合分類(lèi)器的行人識(shí)別結(jié)果。

從圖中可以看出,當(dāng)目標(biāo)有陰影干擾時(shí),基于滑動(dòng)窗口的行人檢測(cè)算法基本都能識(shí)別出行人目標(biāo),且效果沒(méi)有太大的差異。第二行的實(shí)驗(yàn)結(jié)果表明,當(dāng)運(yùn)動(dòng)目標(biāo)與背景對(duì)比度較低的時(shí)候,外觀分類(lèi)器的識(shí)別效果銳減,基本不能識(shí)別出運(yùn)動(dòng)目標(biāo);但此種場(chǎng)景對(duì)運(yùn)動(dòng)分類(lèi)器的檢測(cè)并沒(méi)有太大的影響。而第三行行人目標(biāo)出現(xiàn)幀間內(nèi)停止行為時(shí),運(yùn)動(dòng)分類(lèi)器檢測(cè)效果很不理想,非對(duì)稱(chēng)融合特征分類(lèi)器的檢測(cè)效果明顯優(yōu)于普通的特征融合分類(lèi)器,能夠準(zhǔn)確識(shí)別出兩個(gè)目標(biāo)。綜合考慮多種情況下的行人識(shí)別結(jié)果可以得出,非對(duì)稱(chēng)融合方法的魯棒性較強(qiáng),具有處理更復(fù)雜行人識(shí)別的能力。

圖5 各場(chǎng)景下行人識(shí)別情況示意圖

如圖6 所示,圖(a)為外觀分類(lèi)器、運(yùn)動(dòng)分類(lèi)器、一般融合分類(lèi)器和非對(duì)稱(chēng)融合分類(lèi)器的行人識(shí)別結(jié)果檢測(cè)率曲線(The DetectionRate-FPPI curve)對(duì)比,圖(b)為本文提出的非對(duì)稱(chēng)融合分類(lèi)器與其他算法的人識(shí)別結(jié)果檢測(cè)率曲線對(duì)比。

從圖6(a)中可以看出,運(yùn)動(dòng)分類(lèi)器的識(shí)別目標(biāo)能力最弱,外觀分類(lèi)器的識(shí)別效果近似于普通的融合方法,本文提出的非對(duì)稱(chēng)融合方法相比一下具有最好的識(shí)別效果;又從圖6(b)中可以看出,本文提出的非對(duì)稱(chēng)融合方法檢測(cè)效果與Felzenszwalb[16]、J. Wu 等[5]提出的檢測(cè)方法相比,在實(shí)際監(jiān)控場(chǎng)景下具有更好的識(shí)別能力。

5 結(jié)語(yǔ)

本文提出了一種基于非對(duì)稱(chēng)多特征融合的行人識(shí)別方法,該方法有效地提高了行人識(shí)別的準(zhǔn)確度。本文算法中的基于光流的滑動(dòng)窗口運(yùn)動(dòng)特征可以推廣應(yīng)用到運(yùn)動(dòng)檢測(cè)平臺(tái)中。在實(shí)際檢測(cè)情況中,非對(duì)稱(chēng)融合問(wèn)題不僅存在于視頻行人監(jiān)控中,也同樣存在于運(yùn)動(dòng)檢測(cè)平臺(tái),故在接下來(lái)的工作,本文提出的非對(duì)稱(chēng)特征融合方法可以應(yīng)用于相關(guān)運(yùn)動(dòng)檢測(cè)平臺(tái)用以提高其性能。且由于非對(duì)稱(chēng)融合方法可以同時(shí)計(jì)算外觀特征和運(yùn)動(dòng)特征,適合并行計(jì)算,故當(dāng)有實(shí)時(shí)需求出現(xiàn)時(shí),可以使用GPU或多核CPU進(jìn)行本算法的加速。