基于多分類器融合的衛(wèi)星圖像艦船目標識別*

張 曉,王莉莉

(中國電子科技集團公司第三十研究所,四川 成都 610054)

0 引 言

隨著衛(wèi)星遙感技術的發(fā)展,基于衛(wèi)星遙感圖像的艦艇目標識別成為可能。艦艇目標的識別是世界各國的傳統(tǒng)任務,在國土安全、艦船緊急救援、非法移民等領域有著廣泛的應用。與傳統(tǒng)的圖像識別類似,艦艇目標的識別也主要分為遙感圖像特征提取和分類器構建兩部分。

在圖像識別領域中,圖像特征表達和分類器的性能能夠直接影響到分類結果的準確率。遙感圖像特征提取方法包括顏色特征、紋理特征和邊緣特征等。顏色直方圖特征[1]能夠反應圖像顏色的組成分布,即各種顏色出現的概率,但是由于顏色直方圖特征是全局顏色統(tǒng)計的結果,因此丟失了像素點的位置特征。LBP(Local Binary Patterns,LBP)方法[2-3]常用于紋理特征提取,融合LBP特征與方向梯度直方圖(Histogram of Oriented Gradient,HOG)特征構建分類器,能夠有效提升分類器的檢測效果[4]。Canny邊緣檢測算法[5]基于一個多階邊緣算子,不但給出了邊緣檢測的方法,也提出了邊緣檢測的計算理論。Sobel算子[6]利用梯度信息對圖像進行邊緣檢測,通過計算局部區(qū)域內每個像素的梯度和不同方向從明到暗的變化率,判斷該區(qū)域為邊緣的概率,完成對圖像的邊緣檢測。

現有的分類算法包括神經網絡、K最近鄰(KNN,K-NearestNeighbor)、支持向量機(Support Vector Machine,SVM)、AdaBoost(Adaptive Boosting,AdaBoost)等,都被廣泛應用到圖像識別中,并得到很好的識別效果。BP(Back Propagation)神經網絡[7-8]是一種誤差反向傳播算法(Error Back Propagation Algorithm,BP算法),BP算法具有思想直觀、易于理解、數學意義明確、步驟分明等優(yōu)點,因此BP神經網絡能夠得到廣泛的應用。SVM[9-10]根據結構風險最小化準則和分類間隔最大化準則尋找最優(yōu)超平面,提高分類器的泛化能力,能夠有效地解決非線性、維度高、易陷入局部極小值等問題。Freund等對Boosting迭代算法[11]進行改進,提出了AdaBoost算法[12-14],能夠輸出連續(xù)的實數值,具有更好的收斂性,在圖像識別領域得到了廣泛的應用。

在艦艇目標識別中由于缺乏足夠多的訓練樣本,導致單一的特征提取方法對圖像的表達能力較弱,單個分類器的識別準確率較低。為了提升艦艇目標識別準確率,本文通過使用一種迭代式的方法來應對分類模型缺乏足夠的訓練樣本的情況,采用特征融合方法對圖像進行表示,增強圖像的特征表達能力,并采用多分類器融合方法構建艦艇目標識別模型,提升分類器的分類性能。

1 基本流程

從Google的衛(wèi)星地圖上看,在地圖縮放至20級以前,大多數的艦艇都很小,肉眼無法識別。同時由于拍攝日期以及天氣因素導致Google地圖在清晰度、亮度分辨率以及對比度等方面具有很大的差異。這些差異大大的增加了識別的難度,因此需要結合遙感圖像的特點對圖像進行預處理和特征提取,然后構建多種分類器并進行融合,實現艦艇目標識別,基本流程如圖1所示。

圖1 艦艇目標識別基本流程

2 艦艇目標識別方法

本文以Google瓦片地圖作為輸入,提取圖像的顏色特征和輪廓特征,并對多種特征進行融合,完成遙感圖像的特征表達。然后構建SVM分類器、BP神經網絡分類器和AdaBoost分類器,并對多個分類器進行融合,通過加權投票判斷圖像是否包含艦艇目標。

2.1 特征提取

圖2是一個典型的艦艇的圖片。可以看出艦艇的背景基本是灰色的,停機坪都是白色的,停機坪中間為白色的圓圈且由直線貫穿,這些特征可以將艦艇與其他物體區(qū)別開來。因此本文提取顏色特征,并提取艦艇的輪廓特征(直線和圓的分布特征)來完成艦艇衛(wèi)星圖像表示。

2.1.1 顏色特征

顏色是遙感影像目標識別的重要特征,能夠將艦艇與建筑、海面、普通船只區(qū)分開來。在RGB(Red Green Blue,RGB)顏色空間中灰色與紅色、藍色與綠色相容,因此當目標的顏色是灰色時,與1/3紅色、1/3綠色、1/3藍色的圖片無法區(qū)分。這一現象在HSV(Hue Saturation Value,HSV)顏色空間是不存在的,因此本文選擇在HSV顏色空間提取顏色特征。

圖2 艦艇衛(wèi)星圖像

在HSV顏色空間中,H(Hue)代表色彩、S(Saturation)代表深淺(當S=0時,只有灰色)、V(Value)代表明暗,表示色彩的明亮程度。

本文首先將圖像按照H軸劃分5個區(qū)間、S軸劃分5個區(qū)間、V軸劃分5個區(qū)間,共劃分為125個子空間,然后計算圖像在每個子空間中的顏色一階矩特征、二階矩和直方圖特征,完成圖像的顏色特征提取。

2.1.2 輪廓特征

從圖2可以看出,艦艇的直升機停機位的白色圓圈與直線特征比較明顯,本文將白色圓圈和直線作為艦艇的輪廓特征。在實際的遙感圖像中每張圖片在亮度、對比度以及分辨率等方面均存在差異。為了實現特征的檢測需要對上百萬張遙感圖片進行參數調整,這不太可能實現。

為了解決以上問題,本文對每個圖像進行預處理。首先將遙感圖像轉化到HSV空間,采用濾波方法對圖像進行預處理,然后采用Canny算子對濾波后的圖像做邊緣計算,最后利用霍夫變換檢測圖像的輪廓特征,圖像預處理結果和輪廓特征檢測結果如圖3所示。

圖3 預處理和輪廓檢測結果

2.2 分類器

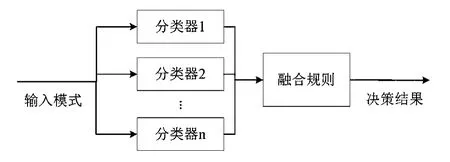

基于艦艇衛(wèi)星圖像的顏色特征和輪廓特征構建SVM分類器、BP神經網絡分類器和AdaBoost分類器,然后設計融合規(guī)則對各個單分類器的結果進行融合。多分類器融合方式包括級聯和并聯,為了避免單個分類器分類錯誤造成最終決策錯誤,本文選擇并聯模式對單分類器進行融合,多分類器融合體系結構如圖4所示。

圖4 多分類器并聯融合體系結構

2.2.1 軟間隔SVM分類器

給定一個n個樣本的訓練集S={(x1,y1),…,(xn,yn)}∈(X×Y)n,其中xi∈X=Rd表示訓練樣本,yi∈Y={1,-1},i=1,2,…,n。如果訓練集S是線性不可分的,那么通過核函數Φ將樣本映射到高維Hibert空間H中,使得訓練集在高維空間H中是線性可分的,然后在高維空間H中根據最大間隔原則尋找最優(yōu)超平面。

軟間隔支持向量機允許訓練樣本有錯分點,并基于最大化間隔和最小化錯分率的原則尋找最優(yōu)超平面。引入一個懲罰系數C>0和松弛變量ξ≥0,超平面滿足式(1):

假設求解軟間隔支持向量機間隔最大化問題得到的最佳超平面是w*x+b*=0,對應的分類決策函數為

其中f(x)稱為軟間隔支持向量機,令h=w*x+b*,h的正負符號表示樣本的類別,數值表示屬于某個類別的置信度。

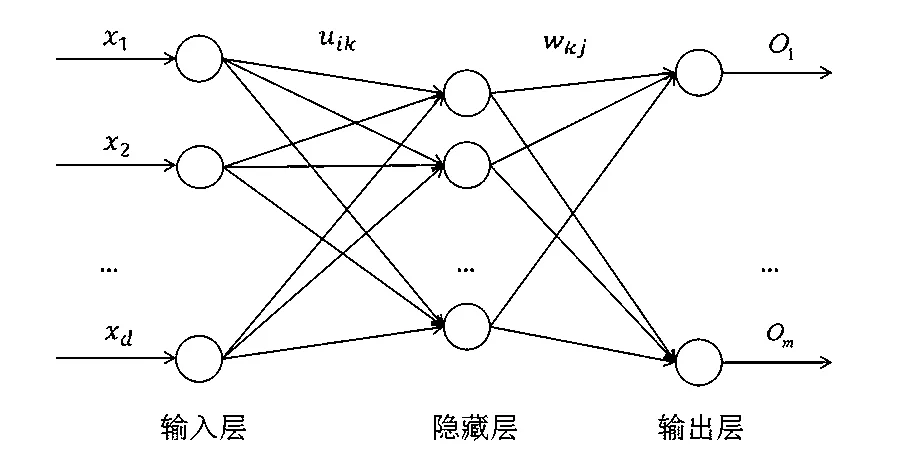

2.2.2 BP神經網絡分類器

BP神經網絡是一種誤差反向傳播、信號前向傳播的神經網絡,由輸入層、隱藏層和輸出層組成。信號在前向傳播中,從輸入層到隱藏層再到輸出層逐層處理,并將輸出層的記過與真實值的誤差進行反向傳播,并根據預測誤差調整神經網絡的權重和閾值,使神經網絡的輸出值不斷地逼近真實值。常見的三層BP神經網絡結構如圖5所示。

圖5 BP神經網絡基本結構

對于訓練集X中的樣本x=(x1,x2,…xd),d表示向量維度,x1,x2,…xd是BP神經網絡的輸入值,輸入層的節(jié)點個數一般設為訓練集X的維度,O1,O2,…Om表示輸出值,uik表示輸入層與隱藏層的權重,wkj表示隱藏層與輸出層之間的權重。

本文在訓練BP神經網絡分類器時,網絡的輸出層m=1,Oi∈R,i=1,2,…,n表示樣本xi的輸出值,當Oi>0時表示樣本xi為正類,否則為負類,|Oi|表示樣本歸屬于正類或負類的置信度。

2.2.3 Adaboost分類器

AdaBoost算法的核心思想是通過改變數據分布來構造多個弱分類器,并根據弱分類器對樣本的分類情況確定樣本的權重更新,如果弱分類器對樣本的分類正確,則對應的權重減少,如果分類錯誤,則權重增加。本文選擇Stump決策樹作為弱分類器。

AdaBoost算法流程如下:

輸入:訓練集T={(x1,y1),…,(xn,yn)},其中yi∈{1,-1},樣本權重w,弱分類器迭代次數T;

(2)DO FORt=1,2,…,T:

Step1:根據樣本權重wt訓練弱分類器:

END

2.2.4 多分類器融合規(guī)則

多分類器融合方法包括級聯方式和并聯方式,在級聯方式中一個分類器的分類結果會影響另外一個分類器的結果,為避免單個分類器識別錯誤造成艦艇目標的識別錯誤,本文采用并聯方式對多個單分類器進行融合。在并聯模式中,各個分類器的訓練是相互獨立的,其核心是尋找一種合適的融合規(guī)則確定最終的分類結果。本文采用加權投票法對各個單分類器的分類結果進行融合,并判定圖像是否包含艦艇目標。

針對艦艇衛(wèi)星遙感圖像提取特征后,分別采用SVM、BP神經網絡和AdaBoost算法構建3個單分類器。對于樣本x,3個單分類器的輸出結果分別為fsvm(x)、fbp(x)和fada(x),若輸出值為正則單分類器判定樣本x為正類,否則為負類。|fsvm(x)|、|fbp(x)|和fada(x)可分別作為各個單分類器針對樣本x的權重,融合后的分類器輸出為:

如果f(x)>0,則判定樣本x為正類,否則為負類。

3 實驗結果與分析

3.1 數據集

分類器的訓練需要足夠多的數據進行學習,由于艦艇訓練數據少,本文使用圖像擴充技術對艦艇圖像數據進行擴充。在google地圖上根據200個艦艇目標圖像,并經過5次平移、3次旋轉和3次縮放,最終將圖像數據集擴充到9 000幅圖像,隨機選擇其中的6 500幅圖像作為訓練集的正類樣本,2 500幅圖像作為測試集中的正類樣本。

實際上,在google地圖中存在一些與艦艇圖像很相似的圖像。本文在google地圖中隨機選點并挑選了40 000幅與艦艇圖像相似的衛(wèi)星圖像(普通船只、海平面、建筑等)和具有不同地形地貌特點的圖像作為負類樣本,其中30 000幅圖像作為訓練集負樣本,10 000幅圖像作為測試集負樣本。

本文使用圖像都是來自google地圖離線下載的瓦片圖像,并根據拼接原理對瓦片地圖進行拼接,使圖像能夠包含整個艦艇目標,拼接后圖像大小為640×640,數據集詳細情況如表1所示。

表1 數據集詳細信息

3.2 艦艇目標識別結果

3.2.1 評價準則

由于測試集中正負類樣本比例懸殊,采用準確率評價分類性能是不合適的,本文采用精確率Precision、召回率Recall和F-measure來評價分類性能。TP表示實際為正樣本中被識別為正樣本的比例,FN表示實際正樣本中被識別為負樣本的比例,FP表示實際負樣本中被識別為正樣本的比例,TN表示實際負樣本中被識別為負樣本的比例。精確率表示如下:

召回率表示如下:

F-measure表示如下:

3.2.2 仿真實驗結果與分析

在上述訓練集上分別采用SVM、BP神經網絡和AdaBoost算法訓練分類器,并將3種單分類器進行融合,在測試集上的識別結果如表2所示。

表2 多分類器融合與單分類器的識別結果

由表2可知,在3個單分類器中,SVM的Precision、Recall和F-measure均是最高的,BP神經網絡的Recall高于AdaBoost算法,但是Precsion低于AdaBoost算法,導致BP神經網絡的F-measure稍低于AdaBoost算法。對3個單分類器進行融合后,Precision可以達到66.32%,Recall可以達到82.53%,F-measure可以達到73.545,均高于其他3種單分類器,說明融合后的分類器性能得到了有效提升。

3.2.3 諾福克地區(qū)掃描結果

為了測試融合分類器對實際地區(qū)的識別效果,本文對諾福克地區(qū)進行整體掃描,使用的圖像來自Google地圖離線下載的瓦片圖像,與訓練集圖像的處理方式保持一致,根據拼接原理對瓦片地圖進行了拼接處理,圖像大小為640×640,共得到20萬幅圖像。

經過融合分類器的識別和人工確認后,共計識別出24個目標,其中有21個是艦艇目標,有3個非艦艇目標。由此說明融合分類器能夠識別出諾福克地區(qū)的大部分艦艇目標,具有一定的泛化能力。諾福克地區(qū)部分艦艇目標的分布如圖6所示,白色圖標代表艦艇目標。

圖6 諾福克地區(qū)部分掃描結果

4 結 語

本文使用SVM、BP神經網絡和AdaBoost算法構建單分類器,并采用加權投票法將多個單分類器進行融合,采用融合分類器對衛(wèi)星圖像艦艇目標進行識別檢測。實驗結果表明融合后的分類器分類性能最好,F-measure可以達到73.54%。在諾福克地區(qū)的整體掃描結果表明艦艇目標識別模型能識別出大部分艦艇目標,為國土安全提供可靠參考。