基于深度神經網絡的人體動作識別研究

戰青卓 王大東

摘 要: 本文介紹了一種三維建模人體模型的方法,通過分層次地識別人體各部位的行為,從底層行為組合成為高層的動作和活動,應用隱馬爾科夫模型完成人體行為的學習工作。同時,應用該模型,同樣可以完成人體行為及活動的檢索功能,通過輸入一些自然語言,完成相關視頻信息的獲取。

關鍵詞: 人體模型;遷移學習;隱馬爾科夫模型

Abstract:This paper introduces a 3-dimensional method of human body modeling which uses the hidden Markov model to explore the learning and working of human body behavior by identifying the behavior of various parts of human body from bottom behavior to top action as well as body's activity. Based on the above by inputting the natural language the corresponding video information could be obtained.

Key words: model of human body;transfer learning;HMM

引言

隨著互聯網及基礎通信行業的不斷發展,視頻影像逐漸成為社交媒體的主要方式之一,但是海量的視頻信息大部分未能得到有效利用。而且,隨著人口老齡化問題的突出與加劇,有關老年人照顧問題也對視頻分析領域提出了更多的需求。相對于國外來說,國內的人體動作識別起步較晚,但是近些年卻呈現良好進步態勢[1-2]。成效卓著的當數中國科技大學的王上飛團隊[3],通過使用自身采集的NVIE數據庫針對人體行為和自發表情的圖片去訓練網絡。而本文則主要研究了人體復雜行為理解方法,通過建立人體三維模型,分層次地應用隱馬爾科夫模型,組合低層次的行為識別結果信息,并應用遷移學習,融合已有的數據庫實現人體復雜行為理解。應用本文提出的算法,可以通過輸入特定行為或活動的自然語言描述,最終成功達到視頻檢索的功能目的。

1 人體復雜行為的表示方法

1.1 行為、行動的表示

行為和活動有多種不同情況,運動狀態可能是持續的(如行走、跑步),或具有可定位的特征(如抓、踢)。要知道人在某時的發生動作,需要由時間尺度來刻畫。在本次的研究中,即把短時的運動稱為行為,如向前走一步,如走路、跑步、跳躍、站立、揮舞。因而,可以辨識區分短時間尺度表示(行為),就像前進;中等時間的運動稱為行動,如走路、跑步、跳躍、站立、揮手,其時間范圍可以很短、但有些或許稍微長些,通常是多種行為的組合;研究中把長時間的運動稱為活動,活動是復雜的行動的組合。為了處理活動,需要對行動建立模型。復雜的組合活動由一組基本的行動模型組成,利用人體的運動學模型作為行動模型特征。

1.2 肢體活動模型

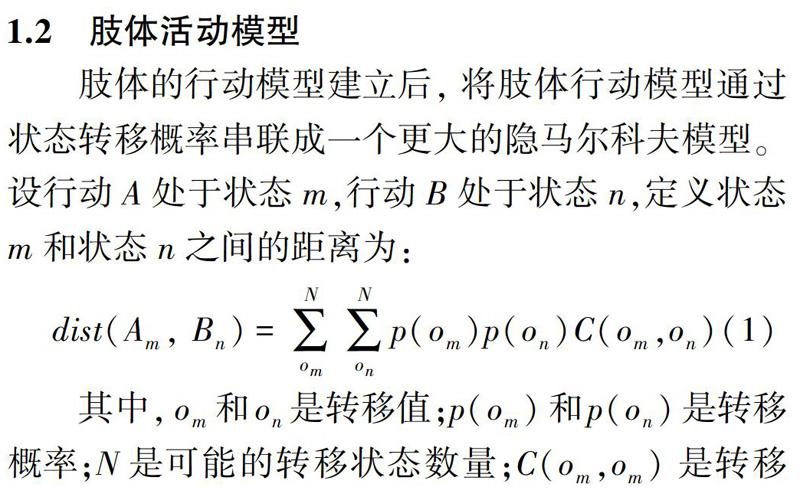

肢體的行動模型建立后,將肢體行動模型通過狀態轉移概率串聯成一個更大的隱馬爾科夫模型。設行動A處于狀態m,行動B處于狀態n,定義狀態m和狀態n之間的距離為:

其中,om和on是轉移值;p(om)和p(on)是轉移概率;N是可能的轉移狀態數量;C(om,om)是轉移值中心之間的歐幾里德距離,而且也是矢量量化的三維關節點的聚類中心。

狀態按肢體分組,將與一個特定肢體模型相對應的一組狀態稱為肢體活動模型。而身體各個部分的活動在隱馬爾科夫模型下的描述則如圖1所示。在連接這些狀態時,可將當前行動轉移到其它行動,若當前行動不發生轉移,對其可分配相同的概率。計算每個狀態的概率序列由一組確定行動的隱馬爾科夫模型運算產生。

1.3 位置跟蹤

跟蹤器會輸出人體的二維位置,但是不能提供研究需要的三維位置信息。研究人員也陸續展開了多種方法的探討與攻關,如通過連續多幀的圖像數據間的運動關系、雙目立體視覺法、動態規劃相機法等獲取三維信息。其中,動態規劃相機方法是通過動態規劃相機的移動位置,來設計創建多角度的人體圖像獲取,進而恢復出人體的三維姿態。該方法的不足是如果沒有捕捉到運動,則不能獲得理想的圖像匹配。本文在動態規劃相機法基礎上,提出如下設計改進:把身體分解成4個部分(2條胳膊,2條腿)。用局部匹配的方法匹配腿,但允許左右腿來自不同的運動捕捉片段 搜索20個攝像頭的觀看方向。每幀的匹配代價反映了相機在根坐標系下運行捕捉情況。以類似的方式選擇手臂和腿,要求相機靠近腿。在研發實踐中,這個方法能夠從較小的運動中獲得相當豐富的運動序列的捕捉集合。由此研究可得,行走、拾取、搬運的后驗概率可如圖2所示。

1.4 查詢活動

為了找到某一特定事件發生時的視頻記錄,通過視頻回看尋找視頻所表達的活動,通過輸入各個肢體的活動名稱,得到符合該活動描述的視頻圖像數據,實際上,并不需要精確得到活動發生的確切時間點,而是只要找到這個活動發生的可能的時間序列位置即可。研究中,通用的運動查詢方法就是正則化表達式的方法。對應的計算公式可表述如下:

將正則表達式替換為有限狀態機后,利用sum-product方法計算這個狀態機達到最終狀態的概率。

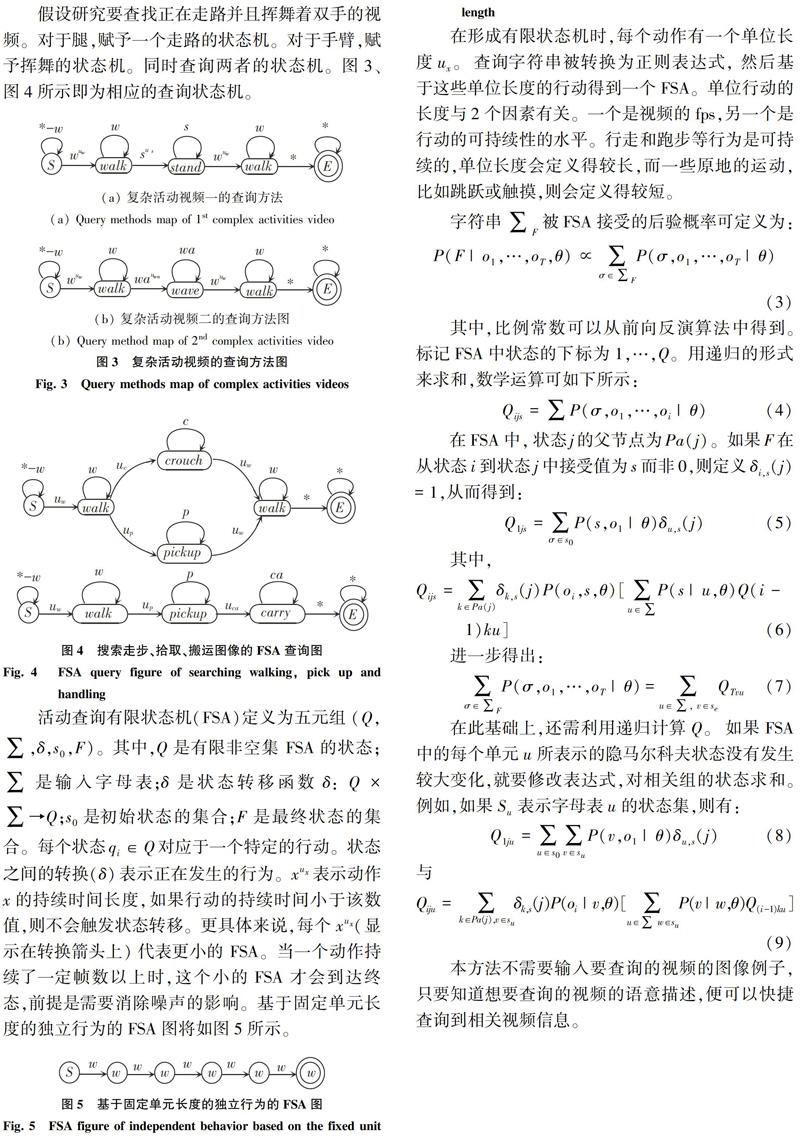

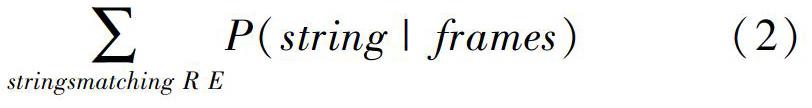

假設研究要查找正在走路并且揮舞著雙手的視頻。對于腿,賦予一個走路的狀態機。對于手臂,賦予揮舞的狀態機。同時查詢兩者的狀態機。圖3、圖4所示即為相應的查詢狀態機。

在形成有限狀態機時,每個動作有一個單位長度ux。查詢字符串被轉換為正則表達式 然后基于這些單位長度的行動得到一個FSA。單位行動的長度與2個因素有關。一個是視頻的fps,另一個是行動的可持續性的水平。行走和跑步等行為是可持續的,單位長度會定義得較長,而一些原地的運動,比如跳躍或觸摸,則會定義得較短。

本方法不需要輸入要查詢的視頻的圖像例子,只要知道想要查詢的視頻的語意描述,便可以快捷查詢到相關視頻信息。

至此,研究中還涉及到復雜的復合查詢編寫。例如,欲搜索順次標定有步行、站立、揮舞、步行、步行的視頻序列,將得到一個人走進視野,站立和揮舞,然后走出視野視頻圖像。圖4就展示給出了搜索走步、拾取、搬運。通過輸入不同的查詢信息實現不同復雜的行為檢索。手臂和腿分開查詢,因為拾取和蹲伏的動作在腿部的行動非常相似,為此就加設了一個“或”的查詢以獲得更廣泛的搜索。

2 實驗及分析

本文使用JAFFE和FER2013數據庫對識別率的精度進行了測試。

為了測試及驗證的便捷性,使用Matlab搭建了GUI交互的界面,使用電腦USB攝像頭捕捉的實時視頻截取圖片,并提送測試結果的識別。

為了直觀地驗證、查證研究建立的卷積神經網絡,編寫了neuralnetwork.m函數。此函數可以觀看建立的網絡的訓練、執行速度,梯度計算結果,以及有效性檢查等參數。設計運行結果如圖6所示。

為了測試系統的識別率,把2個數據庫分別留有的100張256*256像素待測試的圖片集聚成如圖7格式所示的.mat文件。即把256*256的圖片數據每一行首尾相接,組成1*65 536的向量,每一行代表一幅圖片。

在此基礎上,可使用如下的語句,計算網絡預測結果,并與正確的結果展開對比,得到識別率。Theta1 Theta2為卷積神經網絡的權值參數,采用這樣的自動測試流程可以大大提升測試的效率。研發可得設計代碼如下:

3 結束語

在當下的人體行為的識別研究中,仍然亟待建成一個規范、完善的數據庫,且使未來的識別研發方法能夠有效應用在不受控制的環境中。如沒有正面的面部,部分遮蓋的圖像,自發的表情等等)。類似這樣的問題,對目前的學術工程界也仍可堪稱現實挑戰[4-6]。本論文的研究主要立足于識別算法的普適性上,并且重點圍繞在受控制的背景環境中,使經過訓練的識別算法能夠具有全局適用性,即可應用于不同國籍、不同種族的人體行為識別中。

參考文獻

[1] 高文,金輝. 面部表情圖像的分析與識別[J]. 計算機學報,1997,20(9):782-789.

[2] 金輝,高文. 基于HMM的面部表情圖像序列的分析與識別[J]. 自動化學報,2002,28(4):646-650.

[3] WANG Shangfei LIU Zhilei LV Siliang. A natural visible and infrared facial expression database for expression recognition and emotion inference[J]. IEEE Transaction on Multimedia,2010,12(7):682-691.

[4] LIU Mengyi LI Shaoxin SHAN Shiguang et al. Au-inspired deep networks for facial expression feature learning[J]. Neuro computing 2015,159(2): 126-136.

[5] MEGUID M K A E LEVINE M D.Fully automated recognition of spontaneous facial expressions in videos using random forest classifiers[J]. IEEE Transactions on Affective Computing 2014,5(2):141-154.

[6] TURAN C LAM K M. Regionbased feature fusion for facialexpression recognition[C]//IEEE International Conference on Image Processing (ICIP). Paris France:IEEE 2014: 5966-5970.