應用于平掃CT圖像肺結節檢測的深度學習方法綜述

胡偉儉, 陳為, 馮浩哲, 張天平, 朱正茂, 潘巧明*

(1.麗水學院 工學院, 浙江 麗水 323000; 2.浙江大學 計算機學院 CAD&CG國家重點實驗室, 浙江 杭州 310058)

應用于平掃CT圖像肺結節檢測的深度學習方法綜述

胡偉儉1, 陳為2, 馮浩哲2, 張天平2, 朱正茂2, 潘巧明1*

(1.麗水學院 工學院, 浙江 麗水 323000; 2.浙江大學 計算機學院 CAD&CG國家重點實驗室, 浙江 杭州 310058)

肺癌是一種致死率很高的癌癥.通過肺部平掃CT影像檢測肺結節對肺癌早期診斷、治療意義重大.全面介紹了一種革命性的圖像識別技術——深度學習方法,在肺結節檢測中的應用.首先,橫向對比了不同卷積神經網絡的結構及其在圖像識別上的效果,其次著重分析了不同深度學習方法在訓練肺結節分類器上的應用,包括faster-RCNN、遷移學習、殘差學習以及遷移學習.還介紹了一些可用的肺部CT影像數據集供讀者參考.

深度學習;肺結節;卷積神經網絡;數據庫

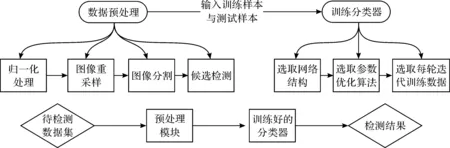

深度學習方法在圖像處理領域取得了巨大的成功[1-2],以深度學習為基礎的CAD(computer aided diagnosis)系統在醫學影像的識別與目標檢測方面達到了極高的準確率.肺結節檢測的經典流程見圖1,由數據預處理與訓練分類器兩部分組成,其中數據預處理過程主要由傳統的CV方法組成,深度學習方法則主要應用于訓練分類器過程,即訓練一個多層卷積神經網絡進行肺結節檢測.

文獻[3]詳細介紹了數據的預處理過程,在此不再贅述.肺結節檢測的深度學習應用尚處于初級階段,因此本文主要從(1)卷積神經網絡(CNN)結構選取與效果對比,(2)利用Fast-RCNN與Faster-RCNN進行候選檢測,(3)利用殘差學習神經網絡(ResNet)增加網絡深度,(4)利用遷移學習進行參數初始化,(5)利用網絡參數迭代方法與curriculum learning優化網絡訓練,這5個方面介紹可用于肺結節檢測的前沿的深度學習方法,并在最后介紹可用的數據庫.

圖1 肺結節檢測流程圖Fig.1 Flow diagram of lung nodule detection

1 卷積神經網絡結構選取與效果對比

1998年,LECUN等[4]首次提出卷積神經網絡(convolutional neural network, CNN)LeNet模型.2012年,CNN在ImageNet競賽中取得第一[1],至此CNN成為圖像處理與目標檢測的通用神經網絡,對于肺結節檢測亦是如此.

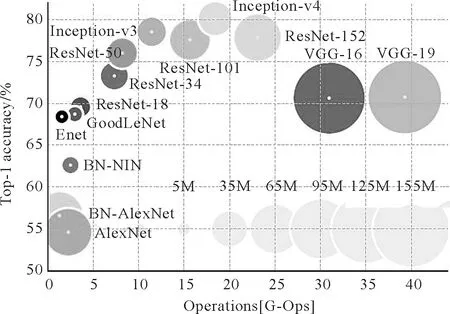

文獻[5]詳細介紹并對比了主流CNN網絡結構,包含AlexNet、BN AlexNet、Batch Normalised Network In Network(NIN)、ENet、GoogLeNet、VGG(-16,-19)、ResNet(-18,-34,-50,-101,152)、Inception-v3和nception-v4等.從準確率、圖片處理速度、參數數目和內存占用量四方面對網絡特點進行了總結,綜合對比如圖2所示.

圖2 各神經網絡綜合比較Fig.2 General comparison of CNN architectures

1.1 準確率

由文獻[5]給出的網絡結構和準確率對比圖可以看出,準確率最低的是AlexNet,最高的是Inception-v4.同時ResNet和Inception系列比其他網絡結構的準確率至少高出7%.

1.2 圖片處理速度

綜合來看VGG系列的處理速度最慢,平均0.2 s才能處理1張圖片,實時性差.而BN AlexNet在每批64張圖片的情況下處理1張圖最快可達0.006 s. Inception和ResNet處理單張圖片平均可達0.02~0.1 s.

同時,對比準確率與圖片處理速度,大部分的網絡都位于一條直線上,說明加快處理速度相應地要犧牲準確率. 但是VGG系列和AlexNet網絡結構位于直線下方,說明其準確率與處理速度綜合表現不如其他網絡.

1.3 參數數目

在神經網絡的參數數目方面,VGG和AlexNet網絡調用了大量參數,卻未能發揮參數數量的優勢,實現較高的準確率.而ENet、GoogleNet、NIN和ResNet網絡結構,則能在大量參數優勢的基礎上取得較高的準確率.

1.4 內存占用量

VGG內存占用量通常為800 MB,且隨著每輪參數迭代輸入數據的增加而增加,最高可接近2 000 MB,相比之下NIN和GoogleNet占用內存最少,通常為200 MB,最高為500 MB.其余網絡結構內存占用量均在300~1 000 MB.

總體而言,GoogleNet及其衍生的Inception系列具有消耗資源少、準確率中等的特點,ResNet系列和Inception系列具有消耗資源中等、準確率高的特點,這2類是目前綜合性能最好的網絡結構.而AlexNet和VGG雖然在準確率與計算資源上不如其他網絡,但是因為提出時間早、結構簡單,依然是現在應用廣泛的網絡結構.同時,這些網絡結構的性能在各項指標上都全面超過了早期的LeNet結構.

具體到肺結節檢測上,目前大部分研究都停留在LeNet結構或在LeNet基礎上的改進.文獻[6]使用了3D卷積神經網絡,在LeNet的基礎上增加了1~2層卷積層,分類準確率可以達到81.50%.文獻[7]對圖像進行加權處理,將3D的圖像降維成2D,又在網絡結構最末多加了1層全連接層,其AUC面積可達0.962.文獻[8]取中心點的三視圖,在加入了Dropout層的LeNet網絡結構中訓練,其應用于肺結節診斷問題的AUC面積可達0.94.文獻[9]在候選檢測出的立體區域選取9個角度的視圖并放入網絡中訓練,同時在網絡中加入Fusion層進行分組分類與整合,其AUC面積最高可達0.996.

總之,目前應用在肺結節檢測上的卷積神經網絡結構基本停留在對LeNet的改進上,導致使用LeNet結構的訓練器假陽率(FP)很高,因此需要嘗試用VGG、GoogleNet、Inception、ResNet等新的網絡結構.在最新的Kaggle Data Science Bowl 2017中,第2名獲獎者采用了C3D網絡進行訓練,ROC準確率達到了0.85,具體可見Github上的源代碼(https://github.com/juliandewit/kaggle_ndsb2017).

2 Fast-RCNN&Faster-RCNN:候選檢測

經典流程圖圖1中,采用了經典的RCNN目標檢測模型,即經處理的圖像需要先經候選檢測進行疑似區域選取,再送入神經網絡進行分類.其缺點是候選檢測未與神經網絡結合,訓練速度慢、消耗空間大.

Fast-RCNN[10]與Faster-RCNN[11]基于RCNN模型進行了改進,旨在將候選檢測納入神經網絡結構,其主要特點包括:

(1)Fast-RCNN

Fast-RCNN直接將圖像送入神經網絡,先對圖像做5次卷積再選取候選區域,可以有效避免重復計算圖像特征,從而提高訓練速度.

(2)Faster-RCNN

Faster-RCNN提出區域生成網絡(RPN),代替Fast-RCNN候選區域選取步驟,將檢測全過程納入深度網絡框架,大大提高了運行速度.

目前,尚未查詢到有關Faster-RCNN在肺結節檢測上應用的文獻,但文獻[12-13]分別運用Faster-RCNN結合殘差學習進行人臉檢測和行人檢測,取得了良好的效果.肺結節檢測同樣具有樣本特征豐富、正樣本稀疏、目標尺度小等特點,因此可以嘗試Faster-RCNN檢測.

3 殘差學習:增加網絡深度

多層卷積網絡的訓練過程中往往會遇到梯度消失和梯度爆炸的問題.文獻[14]提出采用Batch Normalization方法可有效解決梯度爆炸問題.文獻[15-16]提出了解決梯度消失問題的新的網絡結構:殘差學習網絡;文獻[17]提出了基于殘差學習的新型CNN結構:Inception-V4結構.已經在第1節中對這種結構的優缺點進行了比較,這里僅介紹殘差學習網絡的基本思想以及在肺結節檢測中的應用.殘差學習網絡基于多層網絡大部分目標函數都是恒等映射這一基本假設,將目標函數H(x)分解為

H(x)=F(x)+x,

(1)

式(1)中網絡僅對F(x)進行學習,避免了BP算法導致的梯度消失,因此,殘差學習可以將傳統10層左右的網絡加深到100~1 000層.

現有用于肺結節檢測的神經網絡層數都較少,也未見將殘差學習應用于肺結節檢測的相關文獻,這可能是限制準確率的重要原因.然而在與肺結節檢測相似的人臉識別領域,使用殘差學習已達到了3.57%的錯誤率[15],因此將殘差學習應用于肺結節檢測很有意義.

4 遷移學習:參數初始化

遷移學習,即將已訓練好的模型參數遷移到新模型中來幫助新模型訓練數據集[18].遷移學習方法可以替代隨機初始化參數方法,將訓練完成的參數分享給新模型,從而加快并優化新模型的學習.在訓練神經網絡的過程中,若數據集較神經網絡的復雜程度小,就很容易出現過擬合癥狀.現有的肺結節檢測數據庫一般只有幾千個樣本,利用遷移學習方法,可以很好地解決上述問題,從而進一步降低錯誤率.文獻[19]指出,應用遷移學習訓練的神經網絡在分類效果上普遍優于未應用遷移學習的.

目前,應用于肺結節檢測的遷移學習主流方法是:利用相關領域容易獲得的大數據集對神經網絡進行預訓練,然后用肺部CT影像數據集進行調整.文獻[20]分別使用6個數據集對網絡進行獨立遷移學習訓練,并比對了不同數據集的效果,指出使用遷移學習訓練的肺結節檢測神經網絡其準確率較未使用遷移學習提高了2%.

5 參數迭代方法與curriculum learning

5.1 參數迭代方法

神經網絡參數優化的本質是高維優化,針對特定問題的學習率的選取以及優化算法的選取會極大影響網絡參數的收斂性.文獻[21]指出,高維優化問題中根本沒有那么多局部極值,而高維非凸優化問題之所以困難,是因為存在大量的鞍點.因此,能否在有限步內跳出鞍點也是優化算法要重點考量的.

下文通過比較幾種主流優化算法,并結合肺結節圖像特征,給出適用于肺結節檢測的神經網絡參數迭代方法.文獻[22]對比了(a)梯度下降法,(b)隨機梯度下降法,(c)Mini-Batch梯度下降法,(d)動量法(Momentum),(e)Nestrov梯度加速法,(f)Adagard,(g)Adadelta,(h)RMSprop,(i)Adam 9種主流高維優化方法的優劣,從魯棒性、跳出鞍點的能力、收斂速度和學習率四方面對上述9種優化算法進行了總結:

5.1.1 魯棒性

在魯棒性方面,(a)~(c)的收斂性依賴于穩定的初值與學習率遞減函數,一旦這些條件被滿足,(a)~(c)將穩定收斂至局部最優點或鞍點.因為(d)~(i)每一步計算量更大,總體上不如(a)~(c)魯棒.同時,(e)可以視為(d)在收斂性上的改進,在使用(d),(e)算法時,(e)算法比(d)更為魯棒.

5.1.2 跳出鞍點的能力

在跳出鞍點的能力上,(f)~(i)都可以在有限幾步內跳出鞍點,(d)和(e)在迭代次數足夠多時也能跳出鞍點,但比(f)~(i)需時更長.(a)~(c) 3種算法幾乎都無法跳出鞍點.

5.1.3 收斂速度

(d)和(e)算法基于物理中動量的思想,在下坡方向加速收斂,抑制震蕩,總體上6種方法的收斂速度排序為(d)~(e)>(f)~(i)>(a)~(c).

5.1.4 學習率

(f)~(i)都為自適應學習率算法,即可以自動調整學習率,從而加大對罕見情況的學習力度,而(a)~(e)都需要設定學習率和設計學習率隨訓練時間遞減的函數.對于(f)~(i)算法,其中,(f)和(h)都有可能在多次迭代后學習率收斂到0,而(g)和(i)是對(f)和(h)的改進.

具體到肺結節檢測上,因為肺結節的形狀、顏色、面積都有不同,有必要針對這些不同的形狀、顏色和面積選取學習率,因此一般在具有自適應學習率特點的算法中選擇綜合表現最好的(i)Adam方法.同時,如果在迭代過程中參數出現了震蕩的情況,則應采用(c)梯度下降法緩慢逼近收斂點.此外,還有一些使用非線性方法的優化算法[23-24],因其計算量太大,一般不采用.

5.2 Curriculum learning

文獻[25]提出了一種優化網絡訓練過程的curriculum learning方法.借鑒人類學習的方式,認為若訓練集不是隨機選取,而是按照一定規則進行排序選取,則可以加速神經網絡的訓練.比如,面對不同的學習任務,人們往往會將更多的學習精力放在自己做錯的部分,而對已經掌握的部分不再重復學習.

具體到肺結節檢測上,實質性結節顏色明亮,形態特征明顯,容易區分,但毛玻璃結節灰度特征與周圍肺部顏色相似,會出現血毛玻璃結節類訓練集使用誤差逆傳播算法[26]對網絡參數進行更新過程中初始梯度很小的現象,導致網絡參數更新幅度很小.為解決這一問題,一般選取大量毛玻璃結節訓練集進行訓練,如果訓練集每次都隨機選取,那么神經網絡在大量易于識別的結節上被重復訓練,對于形態不規則(如表面凹凸不平或是有棘狀突起)的結節情況類似.因此,可以采用curriculum learning方法減少易于識別結節的冗余訓練,加強難于識別結節的訓練.

目前,暫未發現針對肺結節檢測的curriculum learning方法,但文獻[27]提出的針對視網膜成像出血檢測的訓練集選取方法,可類似應用于肺結節檢測,具體步驟如下:

(1)首先,對所有待訓練樣本賦予相同的選取概率,并隨機選取n個樣本進行訓練,用訓練好的參數對這n個訓練樣本進行預測,計算預測值與真值的偏差.

(2)更改這n個訓練樣本被選中的概率,降低偏差小的樣本被選中的概率,提高偏差大的樣本被選中的概率.

(3)依據選取概率重新選擇n個訓練樣本進行訓練,重復步驟(2),直至網絡參數收斂.

(4)該方法的效果依賴于神經網絡的初始參數,因此實際使用時通常先隨機選取訓練集對神經網絡進行若干輪訓練,直到網絡參數較穩定后再使用.

6 數據庫介紹

數據庫分為用于訓練網絡和用于測試兩類,按照神經網絡的訓練要求,兩者相互獨立.

6.1 用于訓練的數據庫

以下5個為用于訓練的數據庫,其數據量均超過1 000(LTRC-ILD數據庫為533),且對肺結節有準確的標注.

(1)LIDC-IDRI數據庫[28]

(2)The Nelson trial 數據庫[29]

(3)LTRC-ILD數據庫[30]

(4)Kaggle Data Science Bowl 2017訓練數據集 (https://www.kaggle.com/c/data-science-bowl-2017)

(5)2017阿里天池大賽訓練數據集

(https://tianchi.aliyun.com/competition/introduction.htm?spm=5176.100066.333.4.BWVodM&raceId=231601)

6.2 用于測試的數據庫

以下3個為可用于測試的數據庫,數據量相對較少,獨立于訓練數據庫.

(1)ANODE09數據庫[31]

(2)Kaggle Data Science Bowl 2017測試數據集 (https://www.kaggle.com/c/data-science-bowl-2017)

(3)2017阿里天池大賽測試數據集(https://tianchi.aliyun.com/competition/introduction.htm?spm=5176.100066.333.4.BWVodM&raceId=231601)

7 總 結

對應用于平掃CT圖像肺結節檢測的深度學習方法進行了綜述,介紹了現有研究成果以及可用于肺結節檢測的前沿方法,其中有些方法(如遷移學習法)已經應用于肺結節檢測,還有一些方法在解決與肺結節檢測相似的問題(如人臉識別)中取得了優秀成果. 肺結節檢測問題在20世紀已被提出,前人基于傳統機器學習與計算機視覺方法對其進行了研究和完善,隨著深度學習的興起,不斷涌現出新的網絡結構與學習方法. 如何將前人的成果與深度學習方法相結合、如何選取合適的神經網絡結構、如何應用前沿的深度學習方法來改善已有神經網絡的分類效果,這些將成為該研究領域未來需要攻克的難題.

[1] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks[C]// PEREIRA F , BURGES C J C, BOTTOU L, et al. Advances in Neural Information Processing Systems 25. Nevada: Curran Associates Inc, 2012:1097-1105.

[2] 劉玉杰,龐蕓萍,李宗民,等.融合抽象層級變換和卷積神經網絡的手繪圖像檢索方法[J].浙江大學學報:理學版,2016,43(6):657-663. LIU Y J , PANG Y P, LI Z M, et al. Sketch based image retrieval based on abstract-level transform and convolutional neural networks[J]. Journal of Zhejiang University: Science Edition,2016,43(6):657-663.

[3] ELBAZ A, BEACHE G M, GIMEL’FARB G, et al. Computer-aided diagnosis systems for lung cancer: Challenges and methodologies[J]. International Journal of Biomedical Imaging,2013,2013(1):942353.

[4] LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE,1998,86(11):2278-2324.

[5] CANZIANI A, PASZKE A, CULURCIELLO E. An analysis of deep neural network models for practical applications[J]. arXiv preprint arXiv:1605.07678,2016.

[6] ANIRUDH R, THIAGARAJAN J J, BREMER T, et al. Lung nodule detection using 3D convolutional neural networks trained on weakly labeled data[C]//SPIE Medical Imaging. Orlando: International Society for Optics and Photonics,2016:978532.Doi:10.1117/12.2214876.

[7] LEE H, LEE H, PARK M, et al. Contextual convolutional neural networks for lung nodule classification using Gaussian-weighted average image patches[C]// SPIE Medical Imaging. Orlando: International Society for Optics and Photonics,2017:1013423.Doi:10.1117/12.2253978.

[8] ROTH H R, LU L, LIU J, et al. Improving computer-aided detection using convolutional neural networks and random view aggregation[J]. IEEE Transactions on Medical Imaging,2016,35(5):1170-1181.

[9] SETIO A A A, CIOMPI F, LITJENS G, et al. Pulmonary nodule detection in CT images: False positive reduction using multi-view convolutional networks[J]. IEEE Transactions on Medical Imaging,2016,35(5):1160-1169.

[10] GIRSHICK R. Fast R-CNN[C]// IEEE International Conference on Computer Vision. Washington : IEEE Computer Society,2015:1440-1448.

[11] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence,2017,39(6):1137-1149.

[12] WAN S, CHEN Z, ZHANG T, et al. Bootstrapping face detection with hard negative examples[J]. arXiv preprint arXiv:1608.02236,2016.

[13] ZHANG L, LIN L, LIANG X, et al. Is Faster R-CNN doing well for pedestrian detection? [C]// European Conference on Computer Vision. New York: Springer International Publishing,2016:443-457.

[14] IOFFE S, SZEGEDY C. Batch normalization: Accelerating deep network training by reducing internal covariate shift[C] // Proceedings of the 32nd International Conference on Machine Learning. Lille: Computer Science,2015,37:448-456.

[15] HE K, ZHANG X, REN S, et al. Deep residual learning for image recognition[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Washington: IEEE,2015:770-778.

[16] HE K, ZHANG X, REN S, et al. Identity mappings in deep residual networks[C]//European Conference on Computer Vision. New York: Springer International Publishing,2016:630-645.

[17] SZEGEDY C, IOFFE S, VANHOUCKE V, et al. Inception-v4, inception-resnet and the impact of residual connections on learning[J]. arXiv preprint arXiv:1602.07261,2016.

[18] PAN S J, YANG Q. A survey on transfer learning[J]. IEEE Educational Activities Department,2010,22(10):1345-1359.

[19] HOOCHANG S, ROTH H R, GAO M, et al. Deep convolutional neural networks for computer-aided detection: CNN architectures, dataset characteristics and transfer learning[J]. IEEE Transactions on Medical Imaging,2016,35(5):1285-1298.

[20] CHRISTODOULIDIS S, ANTHIMOPOULOS M, EBNER L, et al. Multi-source transfer learning with convolutional neural networks for lung pattern analysis[J]. IEEE Journal of Biomedical & Health Informatics,2017,21(1):76-84.

[21] DAUPHIN Y N, PASCANU R, GULCEHRE C, et al. Identifying and attacking the saddle point problem in high-dimensional non-convex optimization[J]. Mathematics,2014,111:2475-2485.

[22] RUDER S. An overview of gradient descent optimization algorithms[J]. arXiv preprint arXiv:1609.04747,2016.

[23] CHEN W, WANG Z, ZHOU J. Large-scale L-BFGS using MapReduce[J]. Advances in Neural Information Processing Systems,2014(2):1332-1340.

[24] 梁昔明,錢積新.大規模界約束優化的子空間截斷牛頓法[J].浙江大學學報:理學版,2002,29(5):494-499.

LIANG X M ,QIAN J X . Subspace truncated-Newton algorithm for large-scale bound constrained optimization[J]. Journal of Zhejiang University: Science Edition,2002,29(5):494-499.

[25] BENGIO Y, LOURADOUR J, COLLOBERT R, et al. Curriculum learning[C]//Proceedings of the 26th International Conference on Machine Learning. Montreal: The International Machine Learning Society,2009.

[26] HECHT-NIELSEN R. Theory of the backpropagation neural network[C]// International Joint Conference on Neural Networks. Washington: IEEE,1989(1):593-605.

[27] GRINSVEN M J J P V, GINNEKEN B V, HOYNG C B, et al. Fast convolutional neural network training using selective data sampling: Application to hemorrhage detection in color fundus images[J]. IEEE Transactions on Medical Imaging,2016,35(5):1273-1284.

[28] ARMATO S G, MCLENNAN G, BIDAUT L, et al. The lung image database consortium (LIDC) and image database resource initiative (IDRI): A completed reference database of lung nodules on CT scans[J]. Medical Physics,2011,38(2):915-931.

[29] XU D M, GIETEMA H, DE K H, et al. Nodule management protocol of the Nelson randomised lung cancer screening trial[J]. Lung Cancer,2006,54(2):177-184.

[30] BARTHOLMAI B ,KARWOSKI R, ZAVALETTA V, et al. The lung tissue research consortium: An extensive open database containing histological, clinical, and radiological data to study chronic lung disease[R/OL]. The Insight Journal-2006 MICCAI Open Science Workshop. [2006-08-17].http://hdl.handle.net/1926/221.

[31] VAN G B, VAN A V D V S, DUINDAM T, et al. Comparing and combining algorithms for computer-aided detection of pulmonary nodules in computed tomography scans: The anode 09 study[J]. Medical Image Analysis,2010,14(6):707-722.

A survey of depth learning methods for detecting lung nodules by CT images.

HU Weijian1, CHEN Wei2, FENG Haozhe2, ZHANG Tianping2, ZHU Zhengmao2, PAN Qiaoming1

(1.EngineeringCollege,LishuiUniversity,Lishui323000,ZhejiangProvince,China; 2.StateKeyLabofCAD&CG,CollegeofComputerScience,ZhejiangUniversity,Hangzhou310058,China)

Lung cancer is one of the most aggressive cancers and detecting lung nodule by CT images at the early stage is of vital importance to treating lung cancer. This paper overviews the application of a revolutionary image recognition method, deep learning, in the detection of lung nodule. First, we contrast different convolutional neural network (CNN) architectures and their performance in image recognition. Then, we mainly focus on various deep learning methods including faster-RCNN, transfer learning, residual network and curriculum learning to train the classifier. We also introduce some available databases of lung CT images in the last section of our paper.

deep learning; lung nodule; CNN; database

2017-05-23.

浙江省自然科學基金資助項目(LY13F020019).

胡偉儉(1980-),ORCID:http://orcid.org/0000-0003-1299-878X,男,碩士,講師,主要從事人機交互研究,E-mail:13754252004@163.com.

*通信作者,ORCID: http:// orcid.org/0000-0002-2506-8293,E-mail:lsxypqm@163.com.

10.3785/j.issn.1008-9497.2017.04.001

TP 301

A

1008-9497(2017)04-379-06

Journal of Zhejiang University(Science Edition), 2017,44(4):379-384