面向用戶偏好發現的隱變量模型構建與推理

高 艷,岳 昆,武 浩,付曉東,劉惟一

(1.云南大學 信息學院,昆明 650504; 2.昆明理工大學 信息工程與自動化學院,昆明 650500)

(*通信作者電子郵箱kyue@ynu.edu.cn)

面向用戶偏好發現的隱變量模型構建與推理

高 艷1,岳 昆1*,武 浩1,付曉東2,劉惟一1

(1.云南大學 信息學院,昆明 650504; 2.昆明理工大學 信息工程與自動化學院,昆明 650500)

(*通信作者電子郵箱kyue@ynu.edu.cn)

電子商務應用中產生了大量用戶評分數據,而這些數據中富含了用戶觀點和偏好信息,為了能夠從這些數據中準確地推斷出用戶偏好,提出一種面向評分數據中用戶偏好發現的隱變量模型(即含隱變量的貝葉斯網)構建和推理的方法。首先,針對評分數據的稀疏性,使用帶偏置的矩陣分解(BMF)模型對其進行填補;其次,用隱變量表示用戶偏好,給出了基于互信息(MI)、最大半團和期望最大化(EM)算法的隱變量模型構建方法;最后,給出了基于Gibbs采樣的隱變量模型概率推理和用戶偏好發現方法。實驗結果表明,與協同過濾的方法相比,該方法能有效地描述評分數據中相關屬性之間的依賴關系及其不確定性,從而能夠更準確地推斷出用戶偏好。

用戶偏好;評分數據;貝葉斯網;隱變量模型;概率推理;帶偏置的矩陣分解

0 引言

電子商務和推薦網站等Web 2.0應用產生了大量的用戶對商品的評分數據,而這些評分數據中則包含了可直接觀測到的用戶和商品本身的屬性,以及用戶對商品的評分等,蘊含了用戶對某種商品類型的偏好。近年來,從評分數據中提取用戶偏好已經成為數據挖掘、推薦系統和個性化搜索研究的熱點。相對商品類型和用戶評分等可直接觀測到值的變量而言,用戶偏好是隱變量(Latent Variable)。從實際應用看,商品本身的屬性、評分和用戶偏好之間存在相互依賴關系,且具有不確定性。如何描述上述具有不確定性的依賴關系,是解決實際應用中針對觀測屬性來提取用戶偏好的關鍵,進而為商品個性化推薦、用戶劃分和虛假評價檢測等應用提供依據。對此,研究描述各觀測屬性(也稱顯變量)和用戶偏好之間依賴關系及其不確定性的知識模型構建,以及基于該模型進行知識推理來發現用戶偏好的方法,是本文研究的主要任務和基本思想。

近年來,用戶偏好發現已有許多研究成果。例如,文獻[1]提出基于用戶認知行為的上下文感知的偏好獲取方法;文獻[2]提出一種偏好-主題模型,引入用戶偏好維度來提取用戶偏好。然而,上述工作并未考慮用戶偏好與用戶行為或相關屬性間的內在聯系,使得發現的用戶偏好準確度不高。

通常情況,用戶評分數據往往比較稀疏。例如,Amazon網站一般存在95%的數據缺失[3],進而無法計算各商品屬性之間的依賴關系。Salakhutdinov等[4]提出了概率矩陣分解 (Probabilistic Matrix Factorization, PMF)模型,該模型以概率的形式描述評分矩陣和隱含特征矩陣。隨后Salakhutdinov等[5]將PMF擴展為貝葉斯概率矩陣分解(Bayesian PMF, BPMF)模型,并用馬爾可夫鏈蒙特卡羅(Markov Chain Monte Carlo, MCMC)方法進行訓練,該模型的預測準確率較高,但BPMF模型是一種線性模型,并不能表示隱含特征之間的非線性關系。Koren[6]提出了帶偏置的矩陣分解(Biased Matrix Factorization, BMF)模型,該模型對于稀疏性、數據擴展等問題都有良好的性能。評價中有很多因素取決于用戶或商品本身的屬性,本文將獨立于用戶或商品的因素視為偏置部分,將用戶對商品的喜好視為個性化部分,利用矩陣分解中偏置部分對提高評分預測的準確率遠遠高于個性化部分這一結論,基于BMF模型來填補缺失的評分值,對評分數據進行預處理。

作為一種重要的概率圖模型,貝葉斯網(Bayesian Network, BN)[7-8]是不確定性知識表示和推理的有效框架,被廣泛應用于數據分析和醫療診斷等領域[9- 10],它以有向無環圖(Directed Acyclic Graph, DAG)表示隨機變量或屬性間的依賴關系,每個節點對應一個條件概率表(Conditional Probability Table, CPT),定量地描述變量間的依賴關系。近年來,基于BN的用戶偏好發現成為了一類有代表性的方法,例如,文獻[11]提出一種非參數BN模型和從日志數據中提取某個用戶的搜索意圖的方法,文獻[12]提出基于BN從Web服務的行為來動態提取用戶偏好的方法。但是,上述方法中,BN的構建僅涉及觀測到的數據,不能有效發現隱含關系,進而降低了用戶偏好發現的準確性。

隱變量是描述不能直接觀測其取值的變量,含有隱變量的BN簡稱隱變量模型(Latent Variable Model)[7]。Elidan等[13]指出,隱變量模型可以簡化模型結構,使顯變量之間的依賴關系更清晰,能夠發現和表示數據中的隱含信息。如前所述,評分數據中蘊含的用戶偏好并不能直接觀測得到,自然地,本文用隱變量來表示用戶偏好,以隱變量模型作為研究用戶偏好發現的基礎。因此,引入隱變量、并用隱變量直接表示用戶偏好,可加強模型對用戶行為模式的表達能力。文獻[14]提出基于深度學習的隱馬爾可夫模型和條件隨機場來發現主題偏好的方法,文獻[15]基于隱評論主題模型從評級推薦系統中用戶反饋的短語信息中提取用戶偏好。但以上研究未考慮數據中相關屬性之間任意形式依賴關系的表示和相應的模型構建。

根據構建好的隱變量模型,可得到表示用戶偏好的隱變量與其他顯變量之間的依賴關系,因此考慮利用隱變量模型的概率推理機制,計算給定證據變量情形下隱變量(用戶偏好)取值的概率,作為發現用戶偏好的依據。由于BN的精確推理是NP困難的[16],即使評分數據中的屬性不多,但其可能取值較多而使其計算復雜度仍然較高,不能有效地進行概率推理和用戶偏好發現。Gibbs采樣[17-18]能夠支持高效的條件概率和后驗概率的計算,且只要采樣次數足夠多,總能快速地收斂到一個穩定的正確值,因此本文給出基于Gibbs采樣的隱變量模型近似推理算法和相應用戶偏好發現方法。

具體而言,本文的研究主要包括以下三方面:

1)基于評分數據中的隱變量模型構建。本文首先對缺失評分值進行填補,然后基于BN給出商品屬性貝葉斯網(Commodity BN, CBN),最后將描述用戶偏好的隱變量插入CBN中,得到含隱變量的商品屬性貝葉斯網(CBN with a Latent variable, CBNL)。

2)面向用戶偏好發現的CBNL概率推理。本文基于Gibbs采樣給出了CBNL模型的近似概率推理算法,該算法通過對給定的證據值計算隱變量可能取值的不確定性,來高效地計算發現用戶偏好。

3)實驗測試。基于MovieLens[19]上的數據集,實現并測試了本文提出的方法。實驗結果表明,本文基于隱變量模型來發現用戶偏好的方法具有一定的可行性。

1 問題陳述

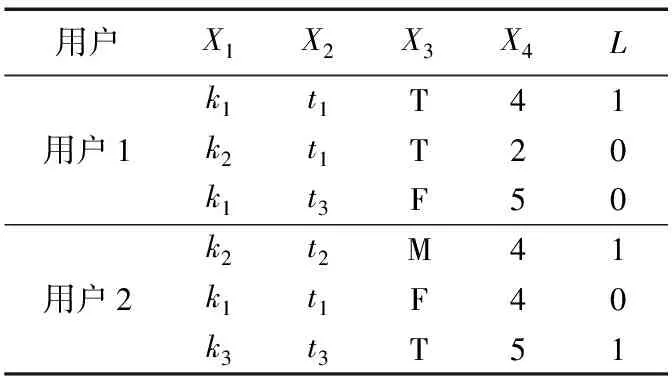

用隱變量L表示用戶對商品類型的偏好。假設L的取值為1和0,在每一個評分數據實例中,分別表示用戶對相應商品類型有無偏好。例如,表1給出了電影評分數據片段,其中:X1表示電影類型(取值為k1、k2和k3),X2表示發行年代(取值為t1、t2和t3),X3表示評價(T、M和F分別代表好評、中評和差評),X4表示評分(取值為1,2,…,5)。假設對于第一個數據實例,L取值為1,說明用戶1對發行年代為t1、評價為好評T、評分較高的電影類型k1有偏好。

表1 電影評分數據片段

下面首先給出一些相關定義和概念。

BN是一個DAGG=(V,E),隨機變量集V構成G中的節點,每個節點對應一個隨機變量,節點狀態對應隨機變量取值,E中的有向邊表示節點之間的依賴關系。如果存在從節點X指向節點Y(即X→Y)的有向邊,稱X是Y的一個父節點,變量X在G中的父節點集用Pa(X)表示。每個節點都有一個CPT,用以量化父節點集對該節點的影響。

基于BN的基本概念,下面給出商品屬性貝葉斯網(CBN)的定義。

定義1CBN模型為一個DAGG=(V,E,θ),其中:V={X1,X2,…,Xn}為G中的節點集合,每個節點對應評分數據中的一個屬性;E為G中節點間有向邊的集合;θ為G中節點CPT的集合。有向邊Xi→Xj(1≤i,j≤n,i≠j)表示Xj依賴于Xi。若Xi的父節點集合為Pa(Xi),則節點Xi的CPT為P(Xi|Pa(Xi))。給定Xi的父節點集Pa(Xi),Xi與其所有非后代節點條件獨立。

將描述用戶偏好的隱變量加入CBN中,可得到用戶偏好與商品屬性間依賴關系的隱變量模型,下面給出含隱變量的商品屬性貝葉斯網(CBNL)的定義。

定義2CBNL為一個DAGGL=(V,L,E,θ)。其中:V∪L為GL中的節點集合,L為GL中表示用戶偏好的隱變量,E為GL中節點間有向邊的集合,θ為GL中CPT的集合。

CBNL的構建包括DAG構建和各節點CPT計算,下面分別介紹這兩方面的工作。

2 評分數據中的隱變量模型構建

2.1 缺失評分值填補

BMF模型以概率的形式描述評分矩陣和隱含特征矩陣,并考慮用戶和商品的偏置部分。例如,不同用戶對商品的評分都有自己的標準,有的用戶對商品的整體評分偏高,有的用戶對商品的整體評分偏低。評分數據集D中的評分值往往非常稀疏,因此在D中抽取出“用戶-商品”評分矩陣M,基于BMF模型來填補矩陣M中的缺失值,通過降維的思想來抽象出商品的T個隱含特征。

利用BMF模型填補矩陣M中的缺失值時,將矩陣M分解為用戶隱含特征矩陣U和商品隱含特征矩陣V,則用戶ui對商品vj的缺失評分可由式(1)表示:

(1)

其中:μ為M中所有評分記錄的全局評分平均值,用戶偏置bi是獨立于商品特征的因素,商品偏置bj是獨立于用戶興趣的因素。

采用平方誤差作為損失函數,利用式(2)使已知評分與填補評分之間的誤差最小,即計算出的評分盡可能與實際評分相吻合。

(2)

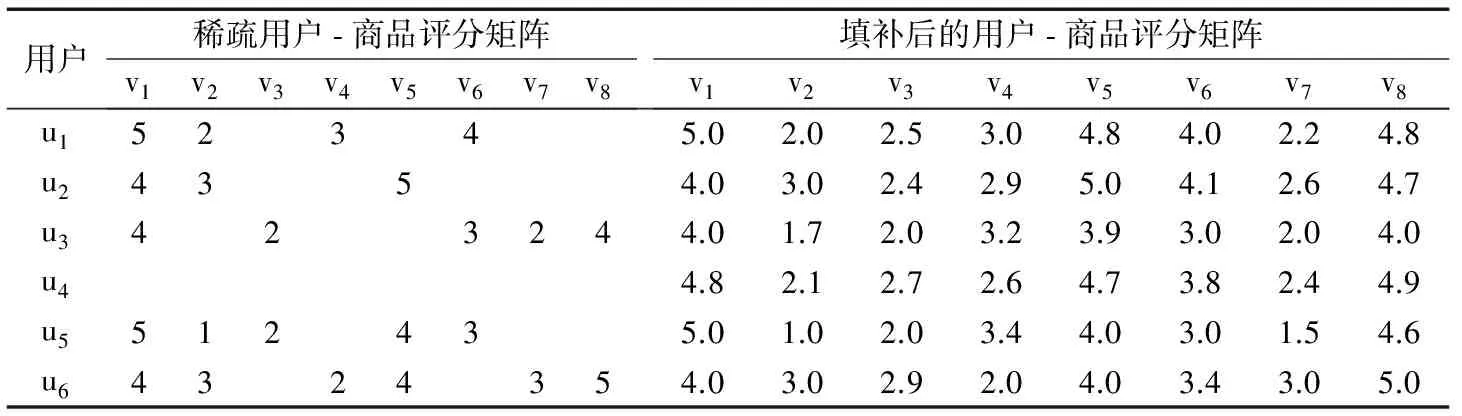

表2為基于BMF模型進行評分值填補前、后的用戶-商品評分矩陣。特別強調,即使用戶u4沒有對任何商品給出評分,通過BMF仍能得到比較合理的評分。

表2 基于BMF模型得到的填補評分矩陣

基于上述方法,可以填補矩陣M中的所有缺失評分值,得到完整的評分矩陣M,根據統計算出每個用戶對某種商品類型的平均評分,從而得到完整的商品評分數據集,為CBN構建進行數據預處理。

2.2 CBNL模型結構構建

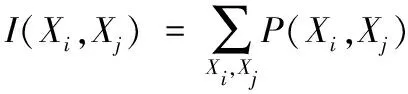

本文提出的CBN構建方法,通過計算兩個商品屬性之間的互信息[20](式(3))和條件互信息,來判斷兩個屬性之間的依賴關系。

(3)

根據式(4)所示的條件互信息計算公式[20]可以判斷兩個商品屬性之間的條件獨立性。

I(Xi,Xj|C)=

(4)

其中:C表示節點Xi和Xj的最小割集,最小割集指Xi和Xj的所有鄰接路徑上的鄰居節點,鄰接路徑是兩個節點間所有邊構成的路徑。與Xi相鄰的節點存入集合N1中,與Xj相鄰的節點存入N2中,若|N1|<|N2|,則N1中元素為最小割集,否則N2中元素為最小割集。

基于上述方法來判斷兩個屬性之間是否有邊,見算法1。

算法1CBN結構構建。

輸入 商品評分數據集D,商品相關屬性X={X1,X2,…,Xn},節點順序ρ和閾值ω;

輸出CBN的DAG結構:G=(X,E)。

1)

確定網絡初始結構。G←由節點X1,X2,…,Xn組成的無邊圖,H←?,E←?

/*H為節點對列表,E為有向邊集合*/Forρ中任意兩個不同變量DoIfI(Xi,Xj)>ωThenH←H∪(Xi,Xj)

EndFor

按I(Xi,Xj)由大到小的順序重排H中的節點對

ForH中不存在開放路徑的節點對(Xi,Xj)Do

/*開放路徑是不存在碰撞節點的路徑,

碰撞節點指大于1條邊指向它的節點*/ 根據ρ連接Xi和Xj,將(Xi,Xj)添加到E中H←H{Xi,Xj}

EndFor

H1←H

2)

缺邊檢測。

IfH1=?Thengoto3)

ElseFor對每個節點對(Xi,Xj)∈H1DoZ←min{cut(Xi, Xj)}IfI(Xi,Xj|Z)>ωThen根據ρ連接Xi與Xj,將(Xi,Xj)添加到E中

EndFor

EndIf

3)

冗余邊檢測。

For對每條有向邊(Xi,Xj)∈EDoIfXi與Xj間還有其他路徑Then暫時刪除(Xi,Xj),Z←min{cut(Xi,Xj)}IfI(Xi,Xj|Z)>ωThen將(Xi,Xj)添加到E中

Else永久刪除(Xi,Xj)

EndIf

EndIf

EndFor

ReturnG

算法1對于包含m個數據實例、n個節點的DAG,式(3)執行O(n2)次,每次計算時間為O(m);而互信息大于ω(ω為給定的互信息閾值,為了盡可能多地表達節點之間的依賴關系,ω一般取值為[0.01,0.05])的節點對才計算條件互信息,式(4)的執行次數遠小于O(n2)。因此,算法1可在O(mn2)時間內構建CBN。

在構建好的CBN結構G中,基于最大半團插入表示用戶偏好的隱變量,得到CBNL結構。下面首先給出判斷半團和最大半團的定義。

定義3[12]假設Q是BN中的節點集合,若對于任一節點Y∈Q,有|Δ(Y;Q)|>2-1|Q|,其中Δ(Y;Q)表示Y在Q中的鄰居節點(Y的父節點或孩子節點)組成的集合,|Q|為Q中節點數,則Q是一個半團。

定義4 若在半團T中引入與T相鄰的所有節點都不滿足半團定義,那么T是一個最大半團。

為了構建CBNL結構,首先搜索G中所有包含3個屬性的子團(即3-clique);然后對每個子團進行擴展,找到G中所有的最大半團C={C1,C2,…,Cm};其次向每個最大半團中插入表示用戶偏好的隱變量,得到m個候選模型結構;最后對每一個模型結構分析與隱變量相關的依賴關系,據此判斷該隱變量是否能夠表示用戶偏好。任選一個模型結構作為最終的CBNL結構GL,見算法2。

算法2CBNL結構構建。

輸入CBN模型結構G;

輸出CBNL模型結構GL。

從G中找出所有的3-clique結構{C1,C2,…,Cn}Fori←1tonDoFor對任意與Ci直接相連的節點XjDoIf{Ci∪Xj}滿足半團定義ThenCi←Ci∪Xj

EndIf

EndFor

EndFor

去除重復的最大半團,得到{C1,C2,…,Cm}

Fori=1tomDo刪除Ci中的所有邊,若|Pa(Xj)|≥1,則將L作為Xj的父節點,否則Xj作為L的父節點

EndFor

在m個候選結構δ1,δ2,…,δm中選擇一個作為GL

ReturnGL

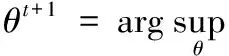

例如,對于表1中的評分數據集D及相關屬性,由算法1可得到如圖1(a)所示的CBN結構;再由算法2可以找到2個3-clique,C1={X1,X3,X4},C2={X2,X3,X4},分別對其擴展得到相同的最大半團結構C={X1,X2,X3,X4},在C中插入表示用戶偏好的隱變量L,可得到如圖1(b)所示的CBNL結構。

圖1 CBNL結構構建

2.3 條件概率參數計算

期望最大化(ExpectationMaximization,EM)算法[21]主要用于在含有隱變量的概率模型中計算參數的最大似然估計(MaximumLikelihoodEstimation)或極大后驗概率估計。因此,基于2.2節中得到的CBNL結構,使用EM算法來估算該結構中各節點的CPT。EM算法從隨機產生的初始值θ0開始迭代,假設已迭代了t-1次,那么第t次迭代由如下步驟完成。

E步:基于θt-1對隱變量取值進行修補,利用式(5)計算期望對數似然函數。

(5)

其中:m是評分數據集D中的實例數,l是隱變量L的取值。

M步:利用式(6)計算使Q(θ|θt)達到最大時θ的取值。

(6)

E步和M步不斷交替進行,直到各節點的CPT收斂到穩定值。

例如,針對圖1(b)所示的CBNL結構,鑒于描述的方便,假定商品評分數據中的每個屬性可能取值數為2,基于EM算法得到各節點的CPT,最終的CBNL如圖2所示。

圖2 最終的CBNL

3 面向偏好發現的CBNL概率推理

為了進行基于CBNL的用戶偏好發現,對CBNL進行概率推理時,把隱變量作為目標變量,把CBNL中與隱變量有直接依賴關系的屬性作為證據變量(即已知變量)。經過Gibbs采樣算法多次迭代計算得到隱變量的最大后驗概率值,將計算出的概率值與給定的偏好閾值進行比較,從而發現用戶對商品類型是否有偏好。

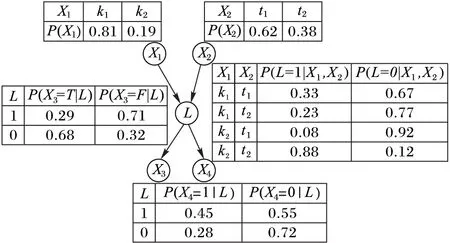

Gibbs采樣算法從滿足條件分布中迭代地進行抽樣,當迭代次數足夠大時,就可以得到來自聯合后驗分布的樣本。為了簡化計算而又不失一般性,對于隱變量的計算僅考慮其馬爾可夫覆蓋(X的馬爾可夫覆蓋包括X的直接孩子節點、X的直接父節點、以及X的直接孩子的其他父節點的集合,記為MB(X))中的節點對它的影響。見算法3。

算法3 基于Gibbs采樣的CBNL概率推理。

輸入GL=(V,L,E,θ),證據變量集合Φ,Φ的取值e,非證據變量L,L的取值l,遍歷次數s;

輸出P(L=1|e)。

1)

初始化。 隨機地為L賦值,v0←e∪l,N[l]←0

/*N[l]為L取1的個數*/

2)

產生樣本序列。Fork←1tosDoFor每一個樣本v(k)中的LDoB←P(L=0|vMB(L))+P(L=1|vMB(L))

v(k)←(v(k-1)(-l),l)

/*v(k-1)(-l)表示在第(k-1)個樣本中去除L值后的樣本*/

EndFor

EndFor

3)

計算P(L=1|e)。

/*l(k)1為第k次采樣中L=1*/N[l]←N[l]+1

EndIf

EndFor

P(L=1|e)←N[l]/s

利用算法3,基于給定的閾值λ,若P(L=1|e)≥λ,則認為用戶對這樣的商品類型有偏好。文獻[16, 22]指出,只要采樣次數足夠多,Gibbs采樣算法總能收斂到一個穩定的正確值,后面將通過實驗進一步測試算法3的收斂性和正確性。

針對圖2中的CBNL,計算P(L=1|X1=k1,X2=t1,X3=T,X4=1)。隨機地為L賦值得到D0=[X1=k1,X2=t1,L=0,X3=T,X4=1]。第一次對L采樣,有P(L=1|X1,X2,X3,X4)=0.25,則P(L=0|X1,X2,X3,X4)=0.75,若r1=0.4,得到D1=[X1=k1,X2=t1,L=0,X3=T,X4=1]。若采樣300次,其中L=1有250次,則P(L=1|X1=k1,X2=t1,X3=T,X4=1)=0.833,表明用戶對發行年代為t1、好評、高分的電影類型t1有偏好。

4 實驗結果與分析

本文使用MovieLens[19]上用戶評分數據作為測試數據集,包含6 040個用戶對3 900部電影的1 000 209條評分數據,將電影類型、發行年代、評價(從標簽中抽取出來)和評分4個屬性作為CBNL的節點。實驗環境:IntelPentiumDual-Core2.0GHz處理器,2GB內存,Windows7(32位)操作系統,使用MatlabR2012b作為開發平臺。

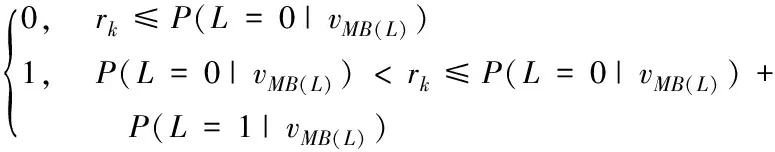

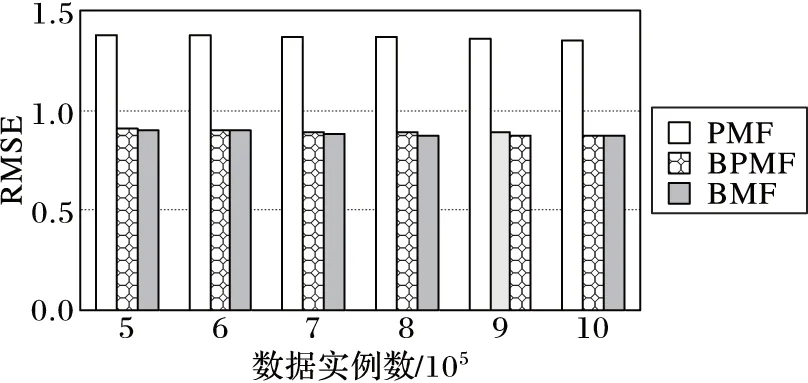

首先,測試基于BMF模型進行評分值填補結果的準確性,并在不同的數據量情形下與PMF[4]、BPMF[5]模型進行比較。用平均絕對誤差(MeanAbsoluteError,MAE)和均方根誤差(RootMeanSquaredError,RMSE)作為衡量填補結果準確性的依據,MAE和RMSE值越小,說明填補的數據與真實數據之間的誤差越小。如圖3、圖4所示,在不同數據量情形下,BMF模型填補數據時的MAE和RMSE值均最小,這說明BMF模型在數據填補時更為準確。

圖3 MAE值

圖4 RMSE值

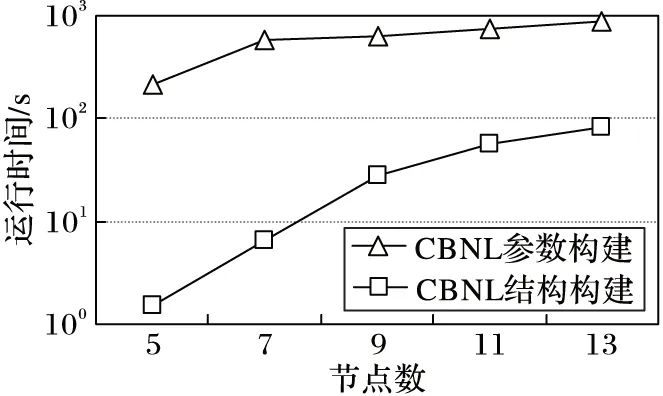

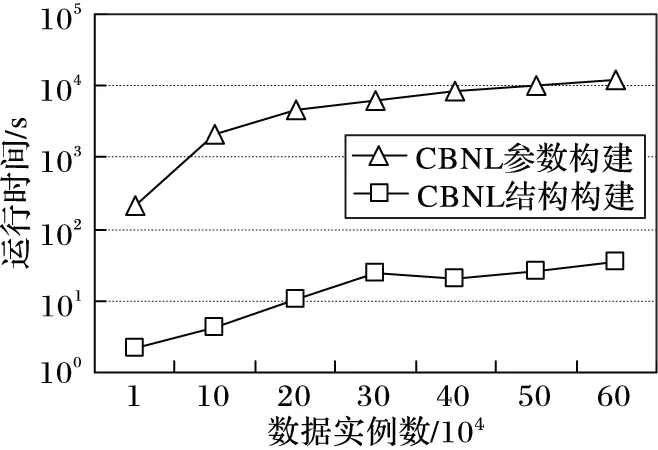

然后,測試CBNL構建算法的執行效率。在數據實例為2×104情形下,測試節點數分別為5、7、9、11、13時構建CBNL的時間開銷,結果如圖5所示,表明構建CBNL的時間開銷主要取決于參數計算;還測試了數據實例數分別為1×104、10×104、20×104,…,60×104時構建CBNL的時間開銷,結果如圖6所示,也表明CBNL構建的時間主要取決于參數計算,且隨著數據實例數的增加基本呈線性趨勢增加。

圖5 不同節點數的CBNL構建效率

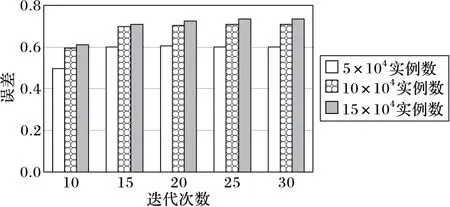

進一步,測試了參數計算的準確性。從測試數據集中選取包括5×104、10×104、15×104個數據實例的片段,把其中一個已知屬性值當作未知的,用EM算法迭代計算MLE值,然后用得到的MLE值與原MLE值進行對比,將其比值作為誤差來衡量參數計算的準確性,結果如圖7所示。可以看出,隨著迭代次數的增加,EM算法收斂到一個穩定的值,且數據量越大,計算出的MLE值與真實值越接近。

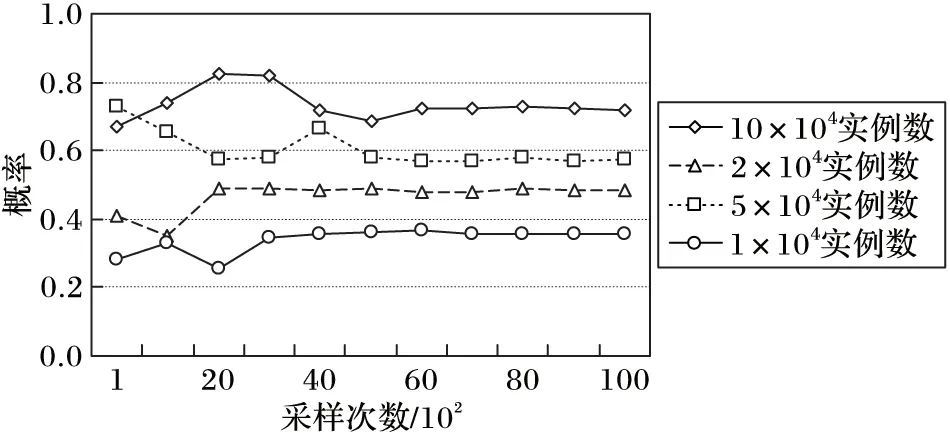

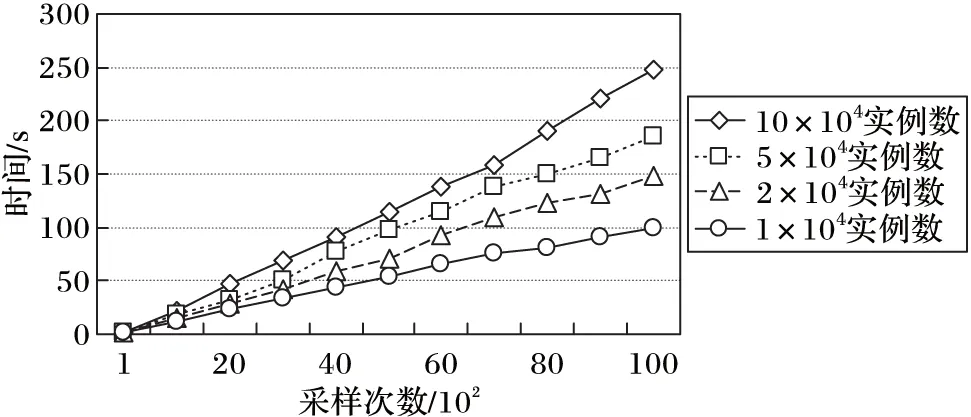

其次,測試了基于CBNL推理發現用戶偏好的效率,圖8和圖9分別給出了在不同數據量的情形下,隨著采樣次數增加,算法3返回結果的收斂性和執行的時間開銷。從圖8可以看出,隨著采樣次數的增加,不同數據量情形下的推理結果均能快速地收斂到一個穩定的值;從圖9可以看出,在不同數據量的情形下,算法3的執行時間均能隨著采樣次數呈線性增長。

圖6 不同實例數的CBNL構建效率

圖7 CBNL參數計算的準確性

圖8 CBNL近似推理結果收斂性

圖9 CBNL推理算法效率

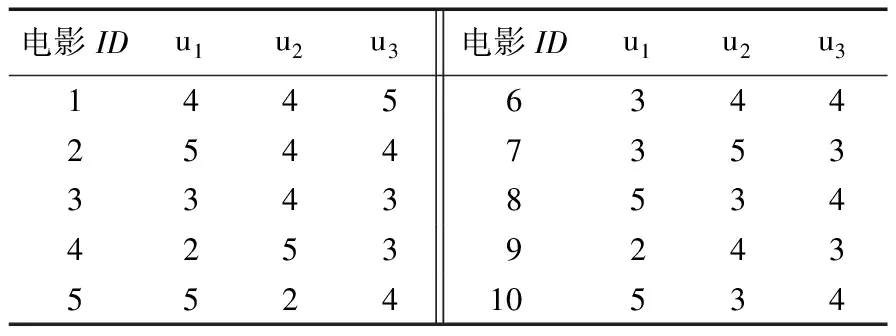

最后,測試了基于CBNL推理發現用戶偏好的準確性。假設評分數據中的評分反映了真實的用戶偏好,針對4或5分的評價,通過多次實驗確定偏好閾值為0.67。隨機選取3名用戶(記為u1、u2和u3),同時選取20部他們都評價過的電影作為測試數據,其中10部電影的評價作為訓練數據,剩下10部電影的評價作為對比數據。表3給出了3名用戶對10部電影的評分。

表3 用戶對電影的評分信息

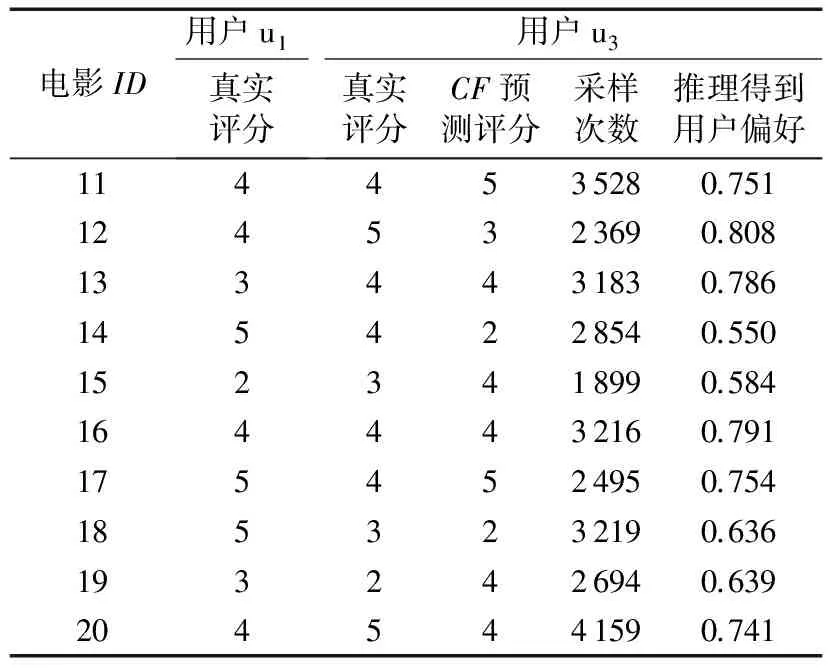

將基于協同過濾(CollaborativeFiltering,CF)的方法[23]和本文方法進行對比,該CF方法預測評分時定義了一個推薦值來適當地提高未知商品的評分。本文方法選定u1為目標用戶,基于余弦相似度得到u1和u3最相似,將后10部電影按u1的喜好推薦給u3。其中表4給出他們對后10部電影的評分信息,u1的評分是真實的用戶評分,通過CF預測得到u3的評分與u3真實的評分相比,正確率為60%,通過本文方法發現用戶偏好的正確率為70%。可以看出,基于本文方法發現用戶偏好的結果比CF預測得到的評分正確率高,這從一定程度上說明了本文方法的正確性和有效性。

表4 用戶對電影的預測評分信息

5 結語

本文基于隱變量模型和概率推理,提出了從商品評分數據中發現用戶偏好的方法,解決了現有方法不能描述評分數據中相關屬性間任意形式的依賴關系問題,可支持實際中商品推薦和用戶定向等應用。

作為基于概率圖模型進行偏好發現的初步試探性研究,本文構建隱變量模型時只引入一個二值隱變量,且未考慮評分數據大規模和動態性。引入多個隱變量、考慮與實際更吻和的情形,從海量用戶評分數據中來發現用戶偏好,滿足海量數據處理需求和針對實際情形下用戶偏好發現的可行性,是將來要開展的工作。

)

[1] 高全力,高嶺,楊建峰,等.上下文感知推薦系統中基于用戶認知行為的偏好獲取方法[J].計算機學報, 2015,38(9):1767-1776.(GAOQL,GAOL,YANGJF,etal.Apreferenceelicitationmethodbasedonuser’scognitivebehaviorforcontext-awarerecommendersystem[J].ChineseJournalofComputers, 2015, 38(9): 1767-1776.)

[2]LIUL,ZHUF,ZHANGL,etal.Aprobabilisticgraphicalmodelfortopicandpreferencediscoveryonsocialmedia[J].Neurocomputing, 2012, 95: 78-88.

[3] 項亮.推薦系統實踐[M].北京:人民郵電出版社,2012:196-212.(XIANGL.PracticeofRecommendationSystem[M].Beijing:Posts&TelecomPress, 2012: 196-212.)

[4]SALAKHUTDINOVR,MNIHA.Probabilisticmatrixfactorization[C]//NIPS2008:Proceedingsofthe2008ConferenceonNeuralInformationProcessingSystems,Cambridge,MA:MITPress, 2008: 1257-1264.

[5]SALAKHUTDINOVR,MNIHA.BayesianprobabilisticmatrixfactorizationusingMarkovchainMonteCarlo[C]//ICML’08:Proceedingsofthe25thInternationalConferenceonMachineLearning.NewYork:ACM, 2008: 880-887.

[6]KORENY.Factorizationmeetstheneighborhood:amultifacetedcollaborativefilteringmodel[C]//KDD’08:Proceedingsofthe14thACMSIGKDDInternationalConferenceonKnowledgeDiscoveryandDataMining.NewYork:ACM, 2008: 426-434.

[7] 張連文,郭海鵬.貝葉斯網引論[M].北京:科學出版社,2006:31-36,194.(ZHANGLW,GUOHP.IntroductiontoBayesianNetworks[M].Beijing:SciencePress, 2006: 31-36, 194.)

[8]HECKERMAND.AtutorialonlearningwithBayesiannetworks[M]//InnovationsinBayesianNetworks:TheoryandApplications,Volume156oftheSeriesStudiesinComputationalIntelligence.Berlin:Springer-Verlag, 2008: 33-82.

[9]DAYEJ,YEUYK,AHNJ,etal.Inferenceofdisease-specificgeneinteractionnetworkusingaBayesiannetworklearnedbygeneticalgorithm[C]//SAC’15:Proceedingsofthe30thAnnualACMSymposiumonAppliedComputing.NewYork:ACM, 2015: 47-53.

[10]ZHANGJ,CORMODEG,CECILIAM,etal.PrivBayes:privatedatareleaseviaBayesiannetworks[C]//SIGMOD’14:Proceedingsofthe2014ACMSIGMODInternationalConferenceonManagementofData.NewYork:ACM, 2014: 1423-1434.

[11]WANGH,ZHAICX,LIANGF,etal.UsermodelinginsearchlogsviaanonparametricBayesianapproach[C]//WSDM’14:Proceedingsofthe7thACMInternationalConferenceonWebSearchandDataMining.NewYork:ACM, 2014: 203-212.

[12]BIANJ,LONGB,LIL,etal.ExploitinguserpreferenceforonlinelearninginWebcontentoptimizationsystems[J].ACMTransactionsonIntelligentSystemsandTechnology—SpecialIssueonLinkingSocialGranularityandFunctions, 2014, 5(2):ArticleNo.33.

[13]ELIDANG,LOTNERN,FRIEDMANN,etal.Discoveringhiddenvariables:astructure-basedapproach[C]//NIPS2000:Proceedingsofthe2000ConferenceonNeuralInformationProcessingSystems.Cambridge,MA:MITPress, 2000: 479-485.

[14] 吳蕾,張文生,王玨.基于深度學習框架的隱藏主題變量圖模型[J].計算機研究與發展,2015,52(1):191-199.(WUL,ZHANGWH,WANGJ.Hiddentopicvariablegraphicalmodelbasedonlearningframework[J].JournalofComputerResearchandDevelopment, 2015, 52(1): 191-199.)

[15]GUANL,ALAMMH,RYUW-J,etal.Aphrase-basedmodeltodiscoverhiddenfactorsandhiddentopicsinrecommendersystems[C]//BigComp2016:ProceedingsoftheInternationalConferenceonBigDataandSmartComputing.Washington,DC:IEEEComputerSociety, 2016: 337-340.

[16] 張宏毅,王立威,陳瑜希.概率圖模型研究進展綜述 [J].軟件學報,2013,24(11):2476-2497.(ZHANGHY,WANGLW,CHENYX.Researchprogressofprobabilisticgraphicalmodels:asurvey[J].JournalofSoftware, 2013, 24(11): 2476-2497.)

[17]HRYCEJT.GibbssamplinginBayesiannetworks[J].ArtificialIntelligence, 1990, 46(3): 351-363.

[18] 岳昆,王朝祿,朱運磊,等.基于概率圖模型的互聯網廣告點擊率發現[J].華東師范大學學報(自然科學版),2013(3):15-25.(YUEK,WANGCL,ZHUYL,etal.Click-throughratepredictionofonlineadvertisementsbasedonprobabilisticgraphicalmodel[J].JournalofEastChinaNormalUniversity(NaturalScience), 2013(3): 15-25.)

[19]MovieLens[EB/OL].[2016- 03- 18].http://grouplens.org/datasets/movielens/latest/.

[20]CHENGJ,BELLDA,LIUW.LearningBayesiannetworksfromdata:anefficientapproachbasedoninformationtheory[J].ArtificialIntelligence, 2002, 137(1/2): 43-90

[21]DEMPSTERAP,LAIRDNM,RUBINDB.MaximumlikelihoodfromincompletedataviatheEMalgorithm[J].JournaloftheRoyalStatisticalSociety,SeriesB(Methodological), 2007, 39(1): 1-38.

[22]PEARLJ.Evidentialreasoningusingstochasticsimulationofcausalmodels[J].ArtificialIntelligence, 1987, 32(2): 245-257.

[23]SHIHT-Y,HOUT-C,JIANGJ-D,etal.Dynamicallyintegratingitemexposurewithratingpredictionincollaborativefiltering[C]//SIGIR’16:Proceedingsofthe39thInternationalACMSIGIRConferenceonResearchandDevelopmentinInformationRetrieval.NewYork:ACM, 2016: 813-816.

ThisworkispartiallysupportedbytheNationalNaturalScienceFoundationofChina(61472345, 61562090, 61462056),theAppliedBasicResearchProjectofYunnanProvince(2014FA023, 2014FA028),theProgramofYunnanProvincialFoundationforLeadersofDisciplinesinScienceandTechnology(2012HB004),theProgramforExcellentYoungTalentsinYunnanUniversity(XT412003),theProgramforInnovativeResearchTeaminYunnanUniversity(XT412011).

GAO Yan, born in 1991, M.S.candidate.Her research interests include knowledge discovery, social media data analysis.

YUE Kun, born in 1979, Ph.D., professor.His research interests include massive data analysis and services.

WU Hao, born in 1979, Ph.D., associate professor.His research interests include information retrieval, recommendation system, service computing.

FU Xiaodong, born in 1975, Ph.D., professor.His research interests include service computing, intelligent decision.

LIU Weiyi, born in 1950, professor.His research interests include artificial intelligence, data and knowledge engineering.

Construction and inference of latent variable model oriented to user preference discovery

GAO Yan1, YUE Kun1*, WU Hao1, FU Xiaodong2, LIU Weiyi1

(1.SchoolofInformationScienceandEngineering,YunnanUniversity,KunmingYunnan650504,China;2.FacultyofInformationEngineeringandAutomation,KunmingUniversityofScienceandTechnology,KunmingYunnan650500,China)

Large amount of user rating data, involving plentiful users’ opinion and preference, is produced in e-commerce applications.An construction and inference method for latent variable model (i.e., Bayesian Network with a latent variable) oriented to user preference discovery from rating data was proposed to accurately infer user preference.First, the unobserved values in the rating data were filled by Biased Matrix Factorization (BMF) model to address the sparseness problem of rating data.Second, latent variable was used to represent user preference, and the construction of latent variable model based on Mutual Information (MI), maximal semi-clique and Expectation Maximization (EM) was given.Finally, an Gibbs sampling based algorithm for probabilistic inference of the latent variable model and the user preference discovery was given.The experimental results demonstrate that, compared with collaborative filtering, the latent variable model is more efficient for describing the dependence relationships and the corresponding uncertainties of related attributes among rating data, which can more accurately infer the user preference.

user preference; rating data; Bayesian network; latent variable model; probabilistic inference; biased matrix factorization

2016- 08- 12;

2016- 09- 06。 基金項目:國家自然科學基金資助項目(61472345, 61562090, 61462056);云南省應用基礎研究計劃項目(2014FA023, 2014FA028);云南省中青年學術和技術帶頭人才后備人才培育計劃項目(2012HB004);云南大學青年英才培育計劃項目(XT412003);云南大學創新團隊培育計劃項目(XT412011)。

高艷(1991—),女,云南曲靖人,碩士研究生,CCF會員,主要研究方向:知識發現、社會媒體數據分析; 岳昆(1979—),男,云南曲靖人,教授,博士生導師,博士,CCF會員,主要研究方向:海量數據分析與服務; 武浩(1979—),男,河南平頂山人,副教授,博士,主要研究方向:信息檢索、推薦系統、服務計算; 付曉東(1975—),男,云南鎮雄人,教授,博士,CCF會員,主要研究方向:服務計算、智能決策;劉惟一(1950—),男,云南昆明人,教授,博士生導師,CCF會員,主要研究方向:人工智能、數據與知識工程。

1001- 9081(2017)02- 0360- 07

10.11772/j.issn.1001- 9081.2017.02.0360

TP311.13; TP181

A