基于塊合成的視頻圖像去模糊算法的改進

強鈺琦,閻若梅,郁文賢

(上海交通大學 先進感知技術中心,上海 200240)

?

基于塊合成的視頻圖像去模糊算法的改進

強鈺琦,閻若梅,郁文賢

(上海交通大學 先進感知技術中心,上海 200240)

提出了一種對基于圖像塊合成的視頻圖像去模糊算法的改進。該算法通過建立圖像模糊模型,并引入“幸運度”來代表圖像的清晰程度,在當前幀的時間窗內使用基于圖像塊合成的方法來達到圖像去模糊的目的,文中對圖像塊的選擇用K-means聚類算法進行改進。通過對實驗結果的分析,證明了改進方法的有效性。

模糊模型;K-means;幸運度

運動平臺拍攝得到的視頻通常會出現不同程度不同形式的模糊,引起模糊的原因有很多,其中相機抖動是很重要的因素。盡管專業的攝像機在拍攝時常常會使用固定平臺,但在手持相機拍攝或是使用無人機這樣的運動平臺拍攝時,相機的抖動不可避免。而拍攝視頻時相機的抖動所產生的影響主要表現在兩個方面:首先,在觀看視頻時畫面的抖動給觀測帶來困難;其次,在相機抖動劇烈時視頻會產生嚴重的模糊。

盡管由Liu[1]和Grundman[2]提出的視頻穩定系統能夠成功地使視頻內容減小抖動從而產生穩定的畫面,由于相機抖動而產生的模糊未加改善,因此,在穩定的視頻中,圖像去模糊就成為了至關重要的課題。

對視頻圖像去模糊的最直接方法是找出模糊的幀,然后使用單幅圖像去模糊算法或是多圖像去模糊算法來實現視頻圖像的去模糊。單幅圖像去模糊研究算法近些年發展迅速,Krishnan[3]使用基于MAP的方法對圖像進行盲去卷積,文章主要解決單一模糊核的圖像去模糊問題,Harmeling[4]則對圖像進行分塊并逐個求解模糊核從而解決了整幅圖像上模糊核不一致的問題;Hirsch[5]直接用3D模糊核代替整幅圖像上隨空間變化的2D模糊核。

在多圖像去模糊中,Zhang H[6]先將圖像進行配準,再對圖像去卷積以得到清晰圖像,但對于運動物體所產生的模糊效果不佳;Zhang H[7]提出了一種自適應耦合的算法,創造性地使用罰函數將清晰的圖像、模糊核以及噪聲進行耦合,運用多圖像盲去卷積的算法恢復出高質量的圖像,但其在視頻圖像中的使用還有待研究;Park[8]因有相機陀螺儀提供的參數,并可因此求出模糊核,使用非盲去卷積能夠得到很好的效果;Li Y[9]提出了從運動模糊視頻中創建清晰全景圖的系統,這個系統在相鄰幀之間使用單應性來建立運動模型,從而得到隨空間變化的模糊核。

然而,在實際應用中,現存的方法很難達到理想的效果,主要有以下原因:首先,由于相機和物體的不規則運動,視頻圖像中的模糊核是隨時間和空間不斷變化的,現有的去模糊方法誠然可以有效處理因相機運動而產生的模糊,卻無法在物體運動時獲得可靠而準確的模糊核;其次,即便模糊核估計比較理想,去卷積過程對于異常值也是十分敏感的,噪聲或飽和像素常常會引起嚴重的振鈴效應[10];此外,前文所述的多圖像去模糊算法中雖然大部分會要求將輸入圖像配準后再處理,但由于物體運動以及景深差異常常很難對圖像進行精確的配準;最后,視頻圖像去模糊要求時間相關,直接對單幅圖像進行去模糊處理會很容易破壞圖像在時間上的相關性。

基于上述原因,本文提出了一種高效的基于圖像塊合成的視頻去模糊方法,可以避免因使用模糊核和去卷積方法而產生的不必要的影響。這種方法基于這樣一個前提:由于手的不規則運動而引起的相機抖動所拍攝的視頻中必然存在一些幀因手的運動速度小而清晰,另外一些幀因手運動速度過大而模糊。通過適當的配準和運動補償,清晰幀可以直接被用于恢復模糊幀。在建立圖像模糊模型時會估測模糊核,但僅用于匹配塊搜索時對于清晰像素的模糊模擬,而不是為了去卷積以得到最終的結果。本文使用模糊核來對清晰圖像塊進行卷積以與模糊圖像塊進行準確的比對,這是十分關鍵的一步,因為直接使用像素差將清晰圖像塊與模糊圖像塊進行比對常常會得不到最合適的待用圖像塊。

1 圖像模糊模型

1.1圖像模糊模型的建立

(1)

(2)

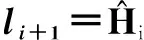

圖1 近似模糊模型示意圖

(3)

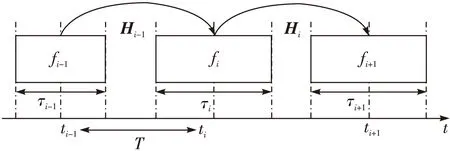

式中:T是[ti,ti+1]中的采樣率,在此設為20,τi是樣本的數量,在此代表占空比;bi為第i幀的模糊函數。這個模糊模型類似于[11]在全景圖生成中用到的多圖像去模糊方法,它也使用單應性作為底層運動模型。然而,本文只是把這種模式看作是一種近似以應對比全景更復雜的視頻,而這在以前的方法中是被視為精確模型的。要明確處理建模誤差,本文的方法是使用額外的局部搜索步驟用于對準不同幀的圖像區域。

1.2“幸運度”測量

在1.1節運動模型的基礎上,引入用于視頻幀的像素中的“幸運度”測量,描述了相鄰的幀之間的像素的絕對位移。對于幀fi的一個像素x,其“幸運度”被定義為

(4)

在實際的視頻拍攝中,由于運動所產生的模糊在圖像序列上會有相當大程度的不同,本文主要研究由于運動而產生的圖像模糊,“幸運度”將當前圖像與前一幀和后一幀進行比對,它的值很大時近似地認為運動很小,此時的圖像很清晰,反之,當它的值很小時,近似地認為此時運動幅度很大,這時的圖像是模糊的。

1.3模糊函數估計

在用式(3)的模糊函數bi進行去模糊之前,有兩個參數必須估算:單對應矩陣Hi和占空比τi。為了估計單對應矩陣Hi,首先使用標準的KLT方法進行特征跟蹤[12],并使用追蹤的特征點來計算初始單應性。

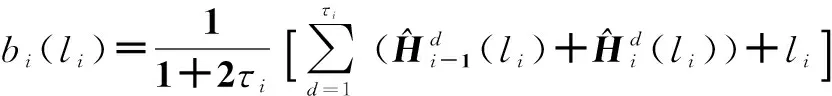

在去模糊的方法中,不僅需要估計相鄰幀之間的單應性矩陣,也需要估計局部時間窗Wi=[i-M,i+M]中的任意兩幀的單應性矩陣,此處M被設置為5。從第i幀到第j幀的單應性矩陣被表示為Hij,其中j∈Wi。顯然圖3中Hi,i+1=Hi。非相鄰幀之間的單應性矩陣的初始化和細化的方法與Hi相同。

請注意,與以前的方法不同,當進行視頻去模糊時不再對單應性矩陣做進一步更新。這是因為筆者只將單應性作為近似運動模型。在單應性矩陣估計中出現的小誤差會通過在去模糊過程的匹配塊搜索來補償。

(5)

2 基于圖像塊合成的圖像去模糊

一旦獲得了fi的模糊函數bi,就可以使用能夠處理單應性表示的非均勻模糊去卷積方法來計算清晰幀li[13]。然而,這種直接的方法在實踐中產生的結果不太令人滿意。此文改用臨近幀的“幸運”的圖像塊來恢復li,從而避免去卷積過程中的波紋效應。

2.1圖像塊去模糊

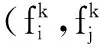

用fi,x表示幀fi上中心在像素x的n×n的圖像塊,在實現中,n=11。通過對位于時間窗Wi的臨近幀fj的清晰塊進行加權平均,實現了對于fi,x的去模糊。即

(6)

(7)

先前去模糊方法的數據擬合項計算的是輸入模糊圖像與使用估計核生成的潛像的差值,權值ω(i,x,j,y)與它類似。在本文方法中,取自于fi的臨近幀fj的fj,y用估計的模糊函數進行模糊處理后與輸入模糊圖像塊fi,x進行比較,從而確定它對于要確定的塊li,x的貢獻。模糊塊bj,y與fi,x越匹配,權值ω(i,x,j,y)就會越高。因此,當扭曲圖像塊fj,y與li,x很接近時,它在式(6)的加權平均中就有更大的貢獻。

(8)

2.2K-means聚類算法

本文使用K-means算法來優化搜索匹配塊的效率和準確度,K-means算法是很典型的基于距離的聚類算法,采用距離作為相似性的評價指標,即認為兩個對象的距離越近,其相似度就越大。該算法認為簇是由距離靠近的對象組成的,因此把得到緊湊且獨立的簇作為最終目標。初始類聚類中心點的選取對聚類結果具有較大的影響,因為在該算法第一步中是隨機地選取任意k個對象作為初始聚類的中心,初始地代表一個簇。該算法在每次迭代中對數據集中剩余的每個對象,根據其與各個簇中心的距離將每個對象重新賦給最近的簇。當考察完所有數據對象后,一次迭代運算完成,新的聚類中心μj被計算出來。如果在一次迭代前后,μj的值沒有發生變化,說明算法已經收斂。

算法過程描述如下:

1)隨機選取k個聚類質心點為μ1,μ2,…,μk∈Rn。

2)重復下面過程直到收斂

{

對于每一個樣例i,計算其應該屬于的類

(9)

對于每一個類,重新計算該類的質心

(10)

}

2.3幀去模糊

要從幀fi中恢復清晰的幀li,可以簡單地根據式(6)在fi的每一個像素處采用塊去模糊的方法并存儲去模糊的塊的中心像素。然而,由于li的像素并未強調空間相干性,這種方法在li的物體結構中可能產生對不準的現象。相反,采用基于塊拼貼的紋理合成的方法[14]來消除li中去模糊塊由于重疊產生的影響。

li(x)表示li在x處的像素值。可以通過下式來確定li(x)

(11)

式中:li,x′是通過式(6)得到的,li,x′是li,x′在x處的像素值;Ωx是位于n×n的空間窗中像素中心在x的像素x′的集合;Z是歸一化因子,Z=∑x′∈ΩxZx′,其中Zx′=∑(j,y)∈Ωi,x′ω(i,x′,j,y)。fj,y(x)是扭曲圖像塊fj,y位于x處的像素值。如果對于fi中的每一個像素計算一個去模糊塊,那么對于fi除了沿圖像邊界區域的任何一個像素x的Ωx都會有n2個像素。因此,像素x將會被n2個在x處使用式(9)的加權平均得到的去模糊塊所覆蓋。為了加速幀去模糊的進程,只對像素稀疏規則網格進行塊去模糊。這種稀疏采樣也有助于避免因對多個塊進行平均引起的過度平滑去模糊的結果。

由于對于匹配塊的局部搜索,去模糊方法可以成功地處理輕微移動的物體,相比之下,在對大幅度運動的物體進行去模糊處理過程中,物體幾乎不受影響。當塊fi,x屬于fi的一個移動物體時,這個物體的移動將會產生與模糊函數bi不同的模糊,并在移動較大時主導fi,x的真實模糊函數。在這種情況下,由于模糊函數的差異,局部塊搜索將無法在另一幀fj中搜索到用式(8)定義的滿足小擬合誤差的匹配圖像塊。另一方面,由于fi,x已經因為物體運動嚴重模糊,bi(fi,x)是fi,x輕微平滑后的結果,因此fi,x與bi(fi,x)的擬合誤差相對較小。因此fi,x是它自己的最佳匹配塊,由式(6)得到的清晰圖像塊li,x將與fi,x十分接近。

3 實驗結果及分析

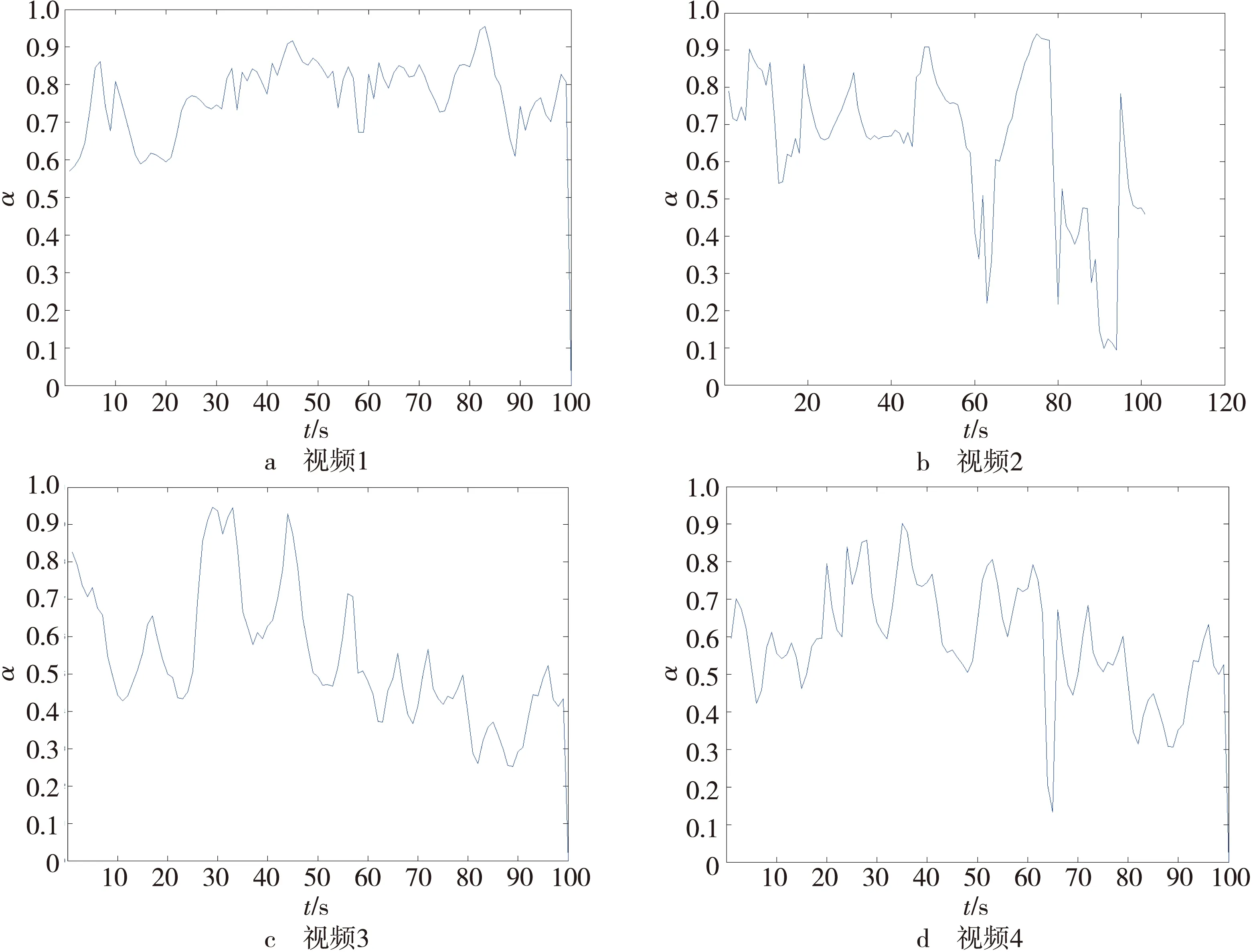

本文的方法建立在有清晰圖像存在的假設之上,圖2中示出幾組實拍視頻圖像的“幸運度”曲線,“幸運度”大于0.85時可以認為這幅圖像是清晰的。盡管整組圖像的清晰度波動較大,但從圖上仍可看出有相當一部分清晰圖像存在,此外,同一幅圖像不同區域的模糊程度也不盡相同,被判定為模糊的圖像上也有清晰區域存在,因此可用于去模糊的清晰區域事實上具有相當的數量。

圖2 實拍視頻圖像的“幸運度”曲線

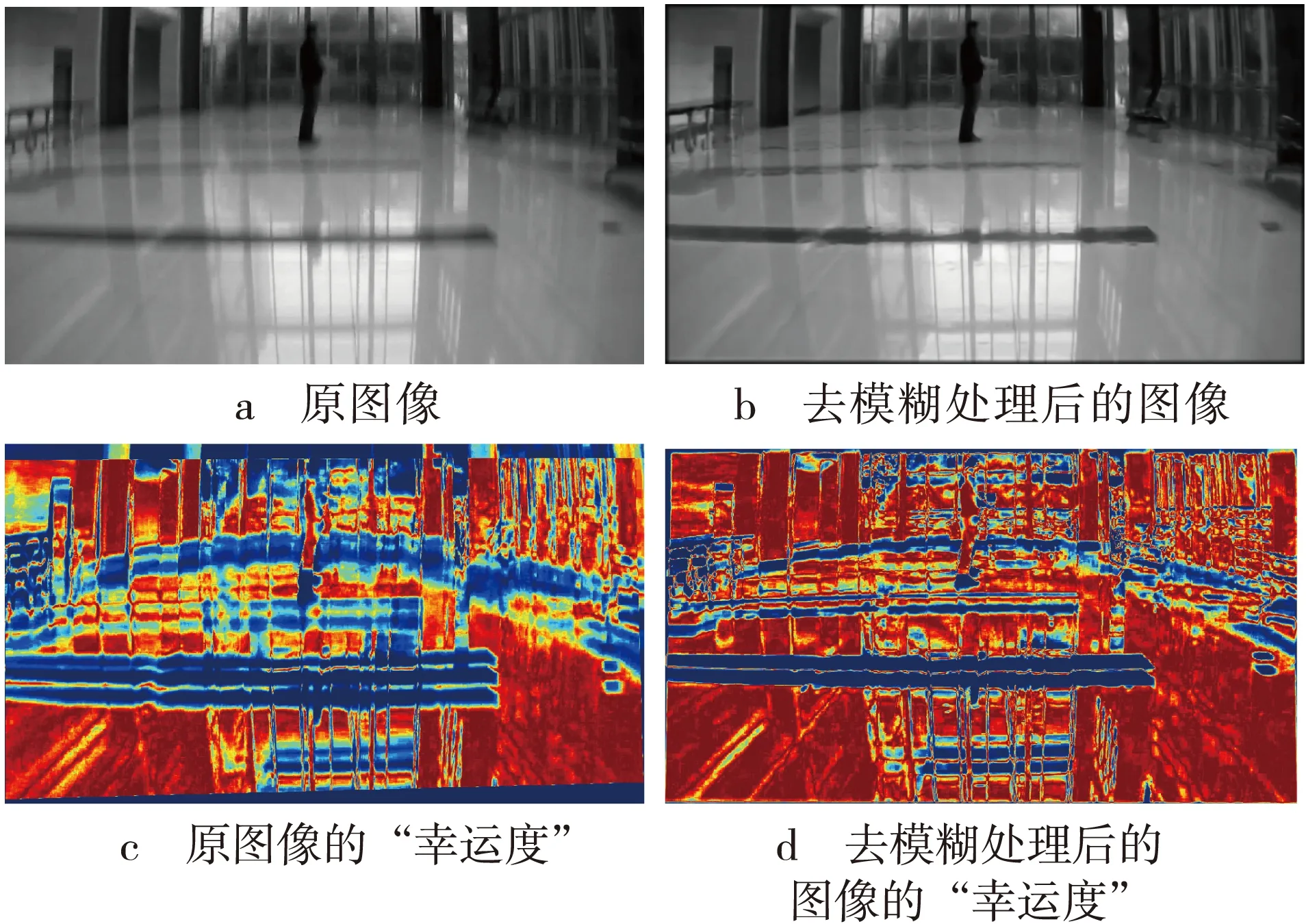

圖3示出具有代表性的一個去模糊的結果,圖3a為原圖像,圖3b為去模糊處理后的結果,圖3c示出原圖像的“幸運度”,圖3d為去模糊處理后圖像的“幸運度”,“幸運度”越大,代表該像素點的清晰度越高。對比這4個圖,可以看出,去模糊處理后具有很好的結果。

圖3 實驗結果示圖

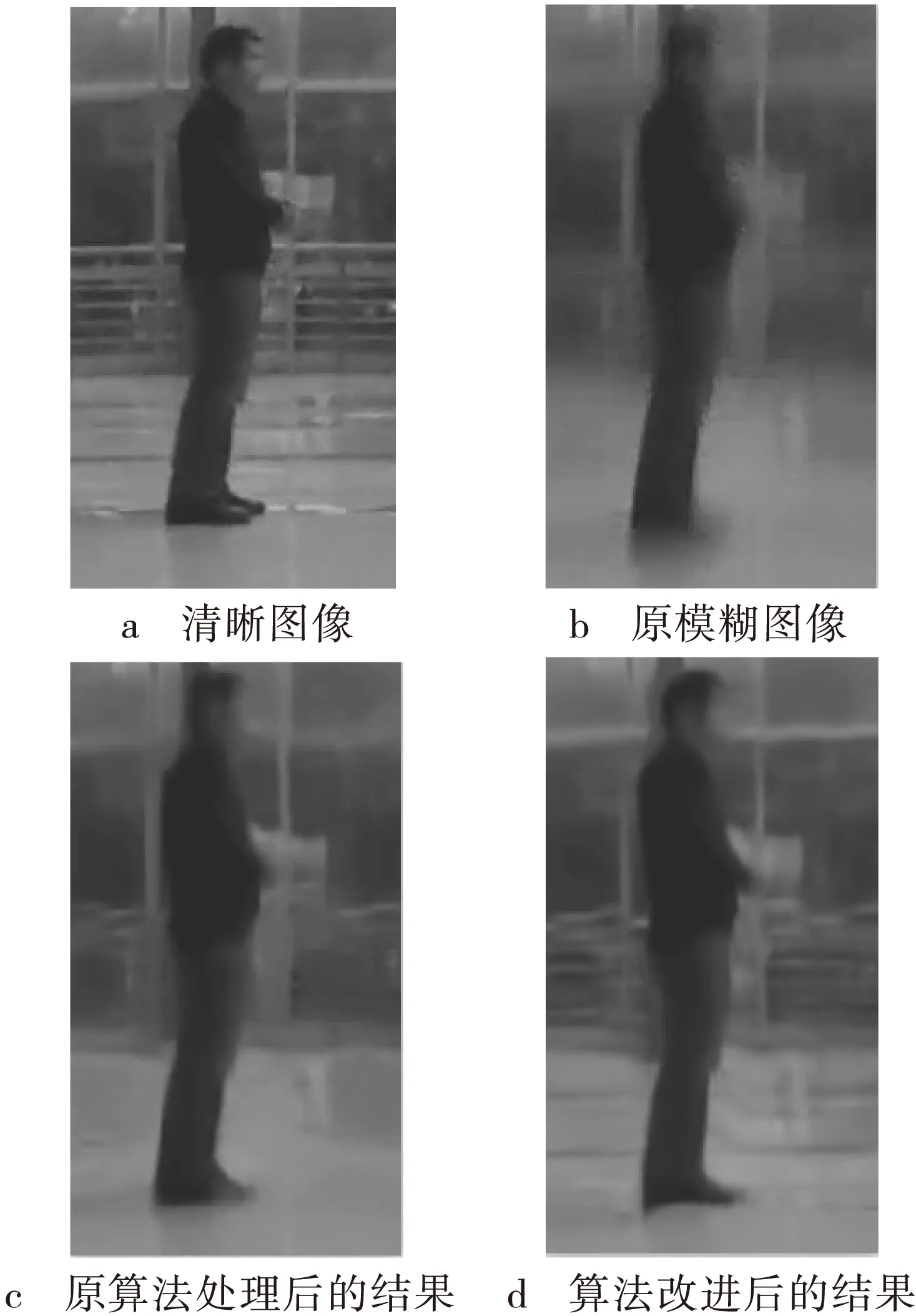

本文引入K-means聚類算法改進后的結果如圖4所示。能夠明顯看出改進后的圖像效果更好,分析幾幅圖像的MSE,MSE為圖像的均方根誤差,用來衡量數據的變化程度,在此處將源圖像、去模糊后的圖像分別與清晰的圖像計算MSE,MSE越小,代表兩幅圖片越接近,可在一定程度上反映去模糊算法的好壞性,如表1所示。從表1可以看出,算法改進后,圖像的清晰度改善了很多,證明了這種改進對于算法是有一定效果的。

4 結論

圖4 改進后的效果圖

近些年,圖像去模糊領域的發展已日臻完善,尤其是單幅圖像基于模糊核的去模糊的算法已被反復研究,受多圖像去模糊和紋理合成方法的啟發,本文提出了一種基于圖像塊合成的運動平臺視頻圖像去模糊方法[14],避免了因模糊核的求解不準而引起的振鈴現象等不良后果。實驗證明這種方法不但能夠有效去除圖像的模糊,更重要的是在去模糊的過程中因為引入了圖像在時間窗上的關系,從而有效加強幀與幀之間的時間相關性,這對于視頻去模糊是極為有意義的,因此這種方法無論是對于理論還是實踐都有重要的參考和研究價值。然而由于此方法能夠運用的一大前提是視頻中有清晰幀的存在,因此在例如視頻中的物體運動

表1MSE的結果

參考圖像結果圖像源圖像去模糊后的圖像改進算法后的去模糊圖像清晰圖像21.491120.103715.8987

較快之類的某些特定的情況下無法得到較好的結果,還需要進一步的研究和嘗試。

[1]LIUF,GLEICHERM,WANGJ,etal.Subspacevideostabilization[J].ACMtransactionsongraphics,2011(30):1-4.

[2]GRUNDMANNM,KWATRAV.AutodirectedvideostabilizationwithrobustL1optimalcamerapaths[C]//Proc.CVPR. [S.l.]:IEEE,2011:225-232.

[3]KRISHNAND,TAYT,FERGUSR.Blinddeconvolutionusinganormalizedsparsitymeasure[C]//Proc.CVPR. [S.l.]:IEEE,2011:233-240.

[4]HARMELINGS,HIRSCHM.Space-variantsingle-imageblinddeconvolutionforremovingcamerashake[J].Advancesinneuralinformationprocessingsystems, 2010(23):829-837.

[5]HIRSCHM,SCHULERCJ,HARMELINGS,etal.Fastremovalofnon-uniformcamerashake[C]// 2011IEEEInternationalConferenceonComputerVision(ICCV). [S.l.]:IEEE,2011:463-470.

[6]ZHANGHC,CARINL.Multi-shotimaging:jointalignment,deblurringandresolution-enhancement[C]//Proc.CVPR. [S.l.]:IEEE,2014:374.

[7]ZHANGH,WIPFD,ZHANGY.Multi-imageblinddeblurringusingacoupledadaptivesparseprior[C]//Proc.IEEEComputerSocietyConferenceonComputerVisionandPatternRecognition. [S.l.]:IEEE,2013:1051-1058.

[8]PARKSH,LEVOYM.Gyro-basedmulti-imagedeconvolutionforremovinghandshakeblur[C]// 2014IEEEConferenceonComputerVisionandPatternRecognition(CVPR). [S.l.]:IEEE,2014:3366-3373.

[9]LIY,KANGSB,JOSHIN,etal.Generatingsharppanoramasfrommotion-blurredvideos[C]//Proc.IEEEComputerSocietyConferenceonComputerVisionandPatternRecognition. [S.l.]:IEEE,2010:2424 - 2431.

[10]CHOS,WANGJ,LEES.Handlingoutliersinnon-blindimagedeconvolution[C]//Proc.ICCV2011. [S.l.]:IEEE,2011:495-502.

[11]LIY,KANGSB,JOSHIN,etal.Generatingsharppanoramasfrommotionblurredvideos[C]//Proc.CVPR. [S.l.]:IEEE,2010:2424-2431.

[12]SHIJ,TOMASIC.Goodfeaturestotrack[C]//Proc.CVPR. [S.l.]:IEEE,1994:593-600.

[13]TAIYW,TANP,BROWNMS.Richardsonlucydeblurringforscenesunderaprojectivemotionpath[J].IEEEtransactionsonpatternanalysismachineintelligence,2011,33(8):1603-1618.

[14]CHOS,WANGJ,LEES.Videodeblurringforhand-heldcamerasusingpatch-basedsynthesis[J].ACMtransactionsonGraphics(TOG), 2012, 31(4): 64.

強鈺琦(1991— ),女,碩士生,主研圖像解譯與評估;

閻若梅(1987— ),女,碩士生導師,主要研究方向為機器學習、圖像處理等;

郁文賢(1964— ),博士生導師,主研雷達目標識別技術與導航。

責任編輯:閆雯雯

Algorithm improvement of video deblurring using patch-based synthesis

QIANG Yuqi, YAN Ruomei, YU Wenxian

(CenterforAdvancedSensingTechnology,ShanghaiJiaoTongUniversity,Shanghai200240,China)

An algorithm improvement of video deblurring for motion platform using patch-based synthesis is presented. This algorithm establishes a blur model, using patch-based synthesis from nearby frames to obtain a sharp frame. And “luckiness” is introduced to represent a picture’s sharpness. The improvement focuses on the patch selection using K-means clustering algorithm. Experimental results show that the improvement can effectively achieve goals.

blur model; K-means; luckiness

TN949.27

ADOI:10.16280/j.videoe.2016.07.028

2015-09-06

文獻引用格式:強鈺琦,閻若梅,郁文賢. 基于塊合成的視頻圖像去模糊算法的改進[J].電視技術,2016,40(7):128-133.

QIANG Y Q, YAN R M, YU W X. Algorithm improvement of video deblurring using patch-based synthesis [J]. Video engineering,2016,40(7):128-133.