基于綜合特征的單樣本人臉特征提取

高 濤,薛國偉,倪 策,馮興樂

(長安大學(xué) 信息工程學(xué)院,陜西 西安 710072)

基于綜合特征的單樣本人臉特征提取

高濤,薛國偉,倪策,馮興樂

(長安大學(xué)信息工程學(xué)院,陜西西安710072)

摘要:為了有效地提取單訓(xùn)練人臉樣本的特征,提出了一種新的人臉局部特征描述方法,改進(jìn)了局部二進(jìn)制模式的方向性描述單一的問題,并且加入了像素間變化趨勢幅度的描述,稱之為局部綜合模式(Local Comprehensive Patterns, LCP)。首先對人臉樣本圖像進(jìn)行分塊,然后每個(gè)的分塊子圖像進(jìn)行改進(jìn)LCP算子運(yùn)算;其次考慮到每個(gè)子塊的特征對整幅人臉圖像的貢獻(xiàn)度不一致,提出了貢獻(xiàn)度圖譜(Contribution Map, CM);最后根據(jù)貢獻(xiàn)度圖譜對每個(gè)子塊的改進(jìn)LCP描述進(jìn)行自適應(yīng)加權(quán)融合形成最終的人臉描述特征,最后在ORL和Yale B庫上進(jìn)行了有效性的測試,與現(xiàn)有的多種算法進(jìn)行比對,所提出的算法對于非限定環(huán)境下人臉的識別有良好的效果。

關(guān)鍵詞:人臉識別;局部二進(jìn)制模式;局部綜合模式;自適應(yīng)加權(quán)局部模式

人臉特征提取方法已經(jīng)取得非常好的成果,綜合起來可以分為局部和全局描述方法。全局特征提取方法包括主分量法[1]、獨(dú)立分量法[2]、線性判別分析[3]等,本類方法容易受光照和表情變化等影響,尤其對單樣本人臉的描述效果更差,針對以上問題,局部特征提取方法開始收到關(guān)注,其中具有代表性的有SIFT[4]、LBP[5-11]、LDP[12]和Gabor[13]等。OjalaT在2001年提出局部二進(jìn)模式LBP[5]后,LBP已廣泛應(yīng)用于紋理分類[6]、人臉圖像分析[7-10]和醫(yī)學(xué)圖像等領(lǐng)域[12]。為了解決LBP算子不能描述較大尺度的特征以及對噪聲敏感等問題,Ojala給出了LBP改進(jìn)算法均勻模式LBP[6],X.Tan進(jìn)一步提出了一種LBP的擴(kuò)展模型LTP[11],該模型對于每個(gè)像素的描述不局限于二進(jìn)制,而是引入了三進(jìn)制。以上的局部算法并沒有考慮到計(jì)算多進(jìn)制模式的方向性,Zhang于2010年提出了具有方向性的二進(jìn)制模式LDP[12],取得了比以往的LBP改進(jìn)算法更優(yōu)良的描述性能,但是該算法僅僅考慮到了0°、45°、90°和135°四個(gè)方向,沒有進(jìn)行全方向的描述,并且沒有考慮每個(gè)方向的變化幅度。基于以上的分析,本文給出一種新的單樣本人臉特征提取方法,該方法是對LBP算法的改進(jìn),能夠更加細(xì)節(jié)的描述人臉的紋理信息,并且考慮到了每個(gè)分塊的重要程度。

1基于自適應(yīng)加權(quán)擴(kuò)展LCP的單樣本

人臉描述

1.1圖像分塊

設(shè)樣本圖像為M,維數(shù)為M×N,考慮到眼睛、鼻子、嘴巴等等對人臉識別起到重要作用的部位是橫向分布的,采用橫向分塊。設(shè)塊數(shù)為q,則

(1)

設(shè)Q=M/q,Xi1(i=1,2,…,q)的維數(shù)是Q×N。

1.2LCP模式描述

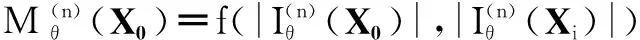

LCP模式包括方向?qū)?shù)模式(DirectionsDerivativePatterns,DDP)和方向變化幅度模式DMP,下面分別給出具體定義。

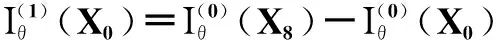

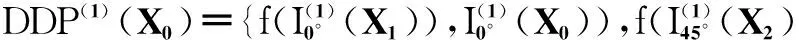

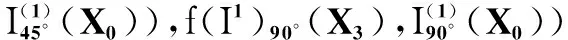

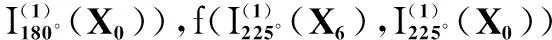

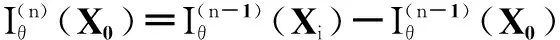

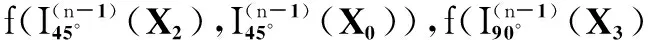

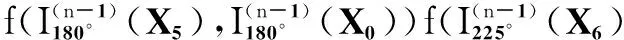

定義1:n次方向?qū)?shù)模式(norderDDP)DDP(n)(X0):表征中心像素點(diǎn)和具各個(gè)方向相鄰像素n次方向?qū)?shù)模式,DDP(1)(X0)表示像素點(diǎn)X0的1次DDP。

如圖2所示,設(shè)樣本圖像為X,X0是樣本圖像局部子塊的中心像素,Xa(a=1,2,3,…,8)表示中心像素點(diǎn)X0的鄰域像素。

(2)

θ=0°,45°,…,315°

(3)

DDP(1)(X0)則表示為

(4)

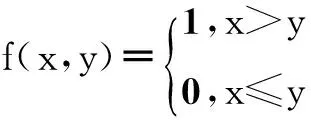

f(x,y)的定義為

(5)

顯而易見,DDP(0)(X0)是基礎(chǔ)的LBP算子。

i=1,2,…,8,θ=0°,45°,…,315°

(6)

(7)

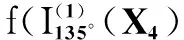

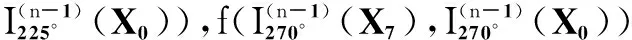

定義3:n次方向變化幅度模式(DMP)DDP(n)(X0):表征中心像素點(diǎn)和它各個(gè)方向相鄰像素n次變化幅度的趨勢。

θ=0°,45°,…,315°

(8)

式中:|·|表示絕對值計(jì)算符號。

DDP(1)(X0)定義為

(9)

i=1,2,…,8

(10)

于是就得到了DDP(n)(X0)的表示

(11)

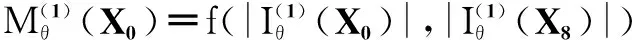

定義5:n次局部綜合模式(LCP)LCP(n)(X0):n次方向?qū)?shù)模式和n次方向變化幅度模式的融合,具體的表示如下

LCP(n)(X0)={DDP(n)(X0),DMP(n)(X0)}

(12)

1次LCP運(yùn)算示例如圖1所示。

圖1 1次LCP運(yùn)算示例

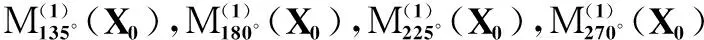

1.3基于局部紋理貢獻(xiàn)度的自適應(yīng)加權(quán)

對于一個(gè)維數(shù)為M×N,灰度級別為m的數(shù)字圖像f(x,y),圖像的熵定義為

(13)

如果將圖像分塊,每個(gè)字塊圖像的信息熵不僅可以表示該字塊的信息量還可以表示該字塊細(xì)節(jié)紋理的豐富程度。基于L.Nanni[14]圖像信息熵模式,局部信息熵定義為

LH(i,j)=H(F(i,j)w)

(14)

H(·)為圖像熵;w是滑動(dòng)窗口尺寸;F(i,j)是以(i,j)為中心的塊,F(xiàn)(i,j)w定義為

F(i,j)w={f(x,y)|x∈[i-w/2,i+w/2-1],

y∈[i-w/2,i+w/2-1]}

(15)

定義6:局部紋理貢獻(xiàn)度CM:表征子塊圖像對整幅的圖像的紋理貢獻(xiàn)程度。

分塊后子圖像的紋理貢獻(xiàn)度可定義為

(16)

(x+(i-1)×q,y)是第i個(gè)子塊中(x,y)的值,q是總的分塊數(shù)目。

2試驗(yàn)結(jié)果和分析

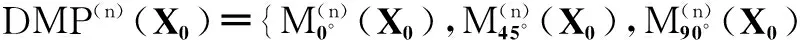

主要將算法應(yīng)用于ORL、YALEB庫,ORL主要測試表情變化和部分遮擋,YALEB庫測試對于光照的不變性。試驗(yàn)中主要對比的算法如表1所示。

表1比較的算法及縮寫 %

AbbreviationFullNameLBPBasicLBPfeatureLBP1LBP(8,1)featureLBP2LBP(16,2)featureLTPLTPfeatureLDP2the2orderLDPsfeatureLDP3the3orderLDPsfeatureLCP1the1orderLCPsfeatureLCP2the2orderLCPsfeatureAWLCP1theadaptivelyweighted1orderLCPsfeatureAWLCP2theadaptivelyweighted2orderLCPsfeatures

2.1ORL庫上試驗(yàn)

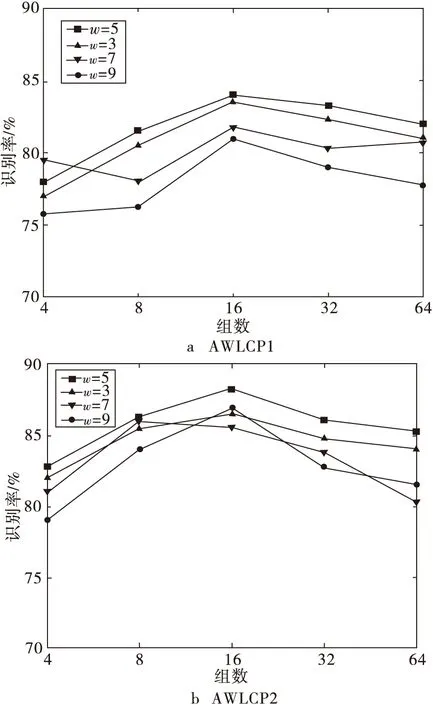

ORL人臉庫包括40個(gè)人,每個(gè)人10幅人臉,具有不同的表情、有無眼鏡等變化。從每人的10幅圖像中取1幅作為訓(xùn)練樣本測試的結(jié)果如表2和圖2所示。顯而易見,AWELB方法的識別率要高于其他幾種方法,基本的LBP方法的識別率最低,主要原因在于基本的LBP算子不能很好地描述較大尺度的特征并且對表情的變化非常敏感;LBP1、LBP2和LTP識別率比LDP和LCP低,主要原因可以歸結(jié)為LDP和LCP算子考慮到了局部特征的方向性,能夠多方位地描述局部特征;AWLCP的識別率高于兩種LDP方法,主要因?yàn)橐环矫鍸CP比LDP的方向描述更加全面,并且考慮到了方向幅度變化的趨勢,另一方面每個(gè)子塊給出了重要程度的描述。分塊試驗(yàn)中16塊時(shí)識別率最高,因?yàn)榉謮K過多或者過少,都會陷于細(xì)節(jié)或者失去細(xì)節(jié)。圖2所示為1次AWLCP和2次AWLCP模式隨分塊變化的示意圖。

表2 ORL庫表情變化狀況下識別率 %

圖2 ORL庫表情變化下AWLCP識別率隨分塊變化圖

2.2Yale B庫上試驗(yàn)

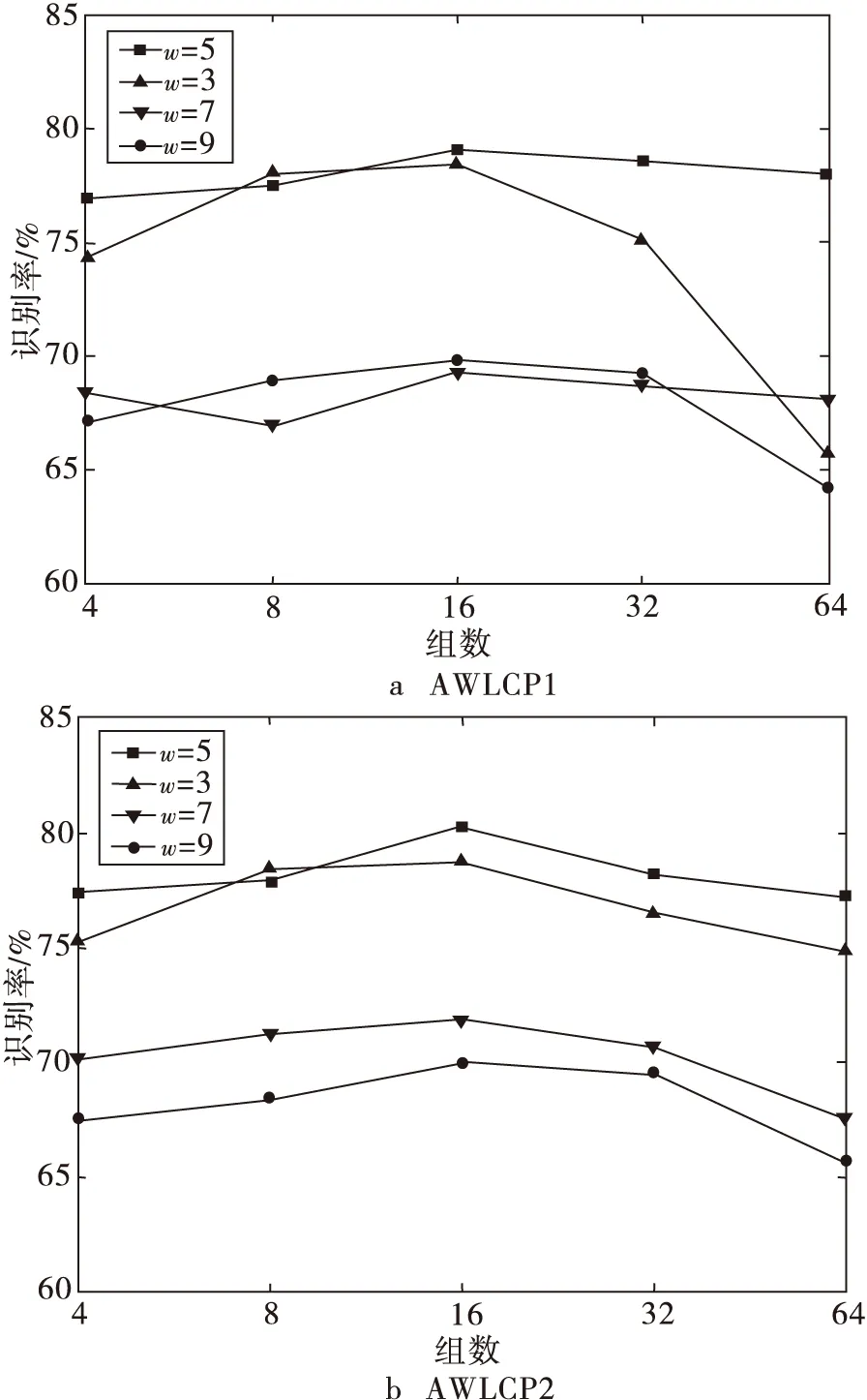

測試為YaleB庫的部分?jǐn)?shù)據(jù),共10個(gè)人,每人100張照片,每人隨機(jī)取1幅圖像作為訓(xùn)練,試驗(yàn)的結(jié)果如表3和圖3所示。通過表3,AWLCP方法的識別率要高于其他幾種方法,主要原因和上述ORL庫類似,總體識別率都比ORL庫要低,主要是復(fù)雜光照會對識別率有影響。圖3所示為1次AWLCP和2次AWLCP模式隨分塊變化的示意圖,當(dāng)塊數(shù)為16時(shí),識別率能達(dá)到最高。

表3 YALE B庫復(fù)雜光照狀況下識別率 %

圖3 YALE B庫復(fù)雜光照下AWELBP識別率隨分塊變化圖

3總結(jié)

針對目前缺乏訓(xùn)練樣本時(shí)大多數(shù)現(xiàn)有的算法無法達(dá)到很好效果的問題,提出了自適應(yīng)局部綜合特征加權(quán)的單樣本人臉特征提取方法,該算法在ORL和YaleB人臉庫上對部分遮擋、表情變化、光照變化等環(huán)境進(jìn)行測試,并且與LBP、LBP1、LBP2、LTP、LDP1和LDP2進(jìn)行比較,結(jié)果如下:

1)LCP在分塊為4、8、16、32和64的條件下,以O(shè)RL庫表情變化人臉為測試集,平均識別率比LBP、LTP和LDP分別提高21.39%、19.18%和8.95%;以O(shè)RL庫部分遮擋人臉為測試集,平均識別率比LBP、LTP和LDP分別提高10.2%、15.9%和5.18%。

2)LCP在分塊為4、8、16、32和64的條件下,以YALE庫表情變化人臉為測試集,平均識別率比LBP、LTP和LDP分別提高27.07%、21.82%和15.94%;以YALE庫部分遮擋人臉為測試集,平均識別率比LBP、LTP和LDP分別提高23.23%、14.91%和10%。

3)LCP在分塊為4、8、16、32和64的條件下,以YALEB庫復(fù)雜光照人臉為測試集,平均識別率比LBP、LTP和LDP分別提高24.48%、23.61%和0.98%。

結(jié)果表明該算法對于單樣本人臉的描述取得了良好的效果。

參考文獻(xiàn):

[1]KUSUMAGP,CHUAC-S.PCA-basedimagerecombinationformultimodal2D+3Dfacesrecognition[J].Imageandvisioncomputing, 2011, 29(5): 306-316.

[2]KUOS-C,LINC-J,LIAOJ-R. 3Dreconstructionandfacerecognitionusingkernel-basedICAandneuralnetworks[J].Expertsystemswithapplications, 2011, 38(5): 5406-5415.

[3]KOM,BARKANAA.AnewsolutiontoonesampleprobleminfacerecognitionusingFLDA[J].Appliedmathematicsandcomputation, 2011, 217: 10368-10376.

[4]GENGCong,JIANGXudong.Facerecognitionbasedonthemulti-scalelocalimagestructures[J].Patternrecognition, 2011, 44(11): 2565-2575.

[5]OJALAT,PIETIKAINENM,MAENPAAT.Lecturenotesincomputerscience[M].Heidelberg:Springer, 2001.

[6]OJALAT,PIETIKAINENM,MAENPAAT.Multiresolutiongray-scaleandrotationinvarianttextureclassificationwithlocalbinarypatterns[J].IEEEtransactionsonpatternanalysisandmachineintelligence, 2002, 24(7): 971-987.

[7]WANGWei,HUANGFeifei.FacedescriptionandrecognitionbyLBPpyramid[J].Journalofcomputeraideddesign&computergraphics, 2009, 21(1): 94-100.

[8]QIANXM,HUAXS,CHENP,etal.Aneffectivelocalbinarypatternstexturedescriptorwithpyramidrepresentationpatternrecognition[J].Patternrecognition,2011(44): 2502-2515.

[9]GAOZS.FacerecognitionusingfusionofCartesiandifferentialinvariantandLBP[J].Journalofoptoelectronics·laser, 2010, 21(1): 112-115.

[10]BONGJJ,KIMT,KIMD.Acompactlocalbinarypatternusingmaximizationofmutualinformationforfaceanalysis[J].Patternrecognition, 2011(44): 532-543.

[11]TANX,TRIGGSB.Enhancedlocaltexturefeaturesetsforfacerecognitionunderdifficultlightingconditions[J].IEEEtransactionsonimageprocess, 2010, 19(6): 1635-1650.

[12]ZHANGB,GAOY,ZHAOS,etal.Localderivativepatternversuslocalbinarypattern:facerecognitionwithhigher-orderlocalpatterndescriptor[J].IEEEtransactionsonimageprocess, 2010, 19(2): 533-544.

[13]KANANHR,F(xiàn)AEZK.Recognizingfacesusingadaptivelyweightedsub-gaborarrayfromasinglesampleimageperenrolledsubject[J].Imageandvisioncomputing, 2010(28): 438-448.

Singlesamplefacerecognitionusingadaptivelyweightedlocalcomprehensivepatterns

GAOTao,XUEGuowei,NICe,F(xiàn)ENGXingle

(School of Information Engineering, Chang’an University, Xi’an, 710072,China)

Abstract:It is urgent to deal with single sample problem in the real-world application. A novel method for face description with single sample by adaptively weighted local comprehensive patterns (AWLCP) is presented. It computes the relationship between the referenced pixel and its neighbors by encoding gray-level difference based on high orders direction derivatives patterns and the direction magnitude patterns, which can extract more detailed discriminating information. The proposed algorithm utilizes local comprehensive patterns to represent faces partitioned into sub-patterns. Especially, in order to perform matching in the sense of the richness of identity information and to handle the partial occlusion problem, the proposed algorithm employs an adaptively weighting map to weight the Sub-LCP (SELCP) extracted from local areas based on the contribution of each sub-pattern to the final similarity measurement. Simulated experiments and comparisons on a subset of Yale face databases, a subset of Yale B face databases and ORL face databases under ideal condition, different illumination condition, different facial expression and partial occlusion show that the proposed algorithm is an outstanding method for single sample face recognition.

Key words:face recognition; local binary patterns; local comprehensive patterns; adaptively weighted extended local comprehensive pattern

基金項(xiàng)目:國家自然科學(xué)基金項(xiàng)目(61302150);中國博士后科學(xué)基金項(xiàng)目(2014M562356);陜西省協(xié)同創(chuàng)新計(jì)劃項(xiàng)目(2014XT-03)

中圖分類號:TP391

文獻(xiàn)標(biāo)志碼:A

DOI:10.16280/j.videoe.2016.04.024

作者簡介:

高濤(1980— ),副教授,碩士生導(dǎo)師,本文通訊作者,主要研究方向?yàn)閳D像處理、傳感器測試、模式識別。

責(zé)任編輯:閆雯雯

收稿日期:2015-07-24

文獻(xiàn)引用格式:高濤,薛國偉,倪策,等.基于綜合特征的單樣本人臉特征提取[J].電視技術(shù),2016,40(4):115-120.

GAOT,XUEGW,NIC,etal.Singlesamplefacerecognitionusingadaptivelyweightedlocalcomprehensivepatterns[J].Videoengineering,2016,40(4):115-120.