基于 A-ELM 的移動視覺搜索方法

胡 海 洋,許 軍, 胡 華

(1.杭州電子科技大學計算機學院,浙江 杭州 310018;2.杭州電子科技大學復雜系統(tǒng)建模與仿真教育部重點實驗室,浙江 杭州 310018)

基于 A-ELM 的移動視覺搜索方法

胡 海 洋1,2,許 軍1,2, 胡 華1,2

(1.杭州電子科技大學計算機學院,浙江 杭州 310018;2.杭州電子科技大學復雜系統(tǒng)建模與仿真教育部重點實驗室,浙江 杭州 310018)

計算機智能技術在圖像領域已經(jīng)得 到 廣 泛 的 應 用 。 極 限 學 習 機(ELM)作 為 一 種 新 興 技 術 ,克 服 了 其 他傳統(tǒng)智能技術所面臨的一些問題, 吸引了越來越 多研究人員的關注。 首先對 ELM 算法的性 能進行了 分析驗證,并將其延伸到圖像分類搜索上。 在此基礎上,提 出了基本視覺搜索(BMVS)框架,將 ELM 運用到 此框架服務器端,并進一步優(yōu)化了 ELM 的分類性能。 最后實驗證明 ELM 在移動視覺搜索方面的可行性,并通過和支持向量機(SVM)的實驗對比驗證相關方法的高效性。

分類;極限學習機;移動視覺搜索

1 引言

隨著互聯(lián)網(wǎng)和多媒體技術的飛速發(fā)展,聲音、圖像、視頻等數(shù)字信息急速膨脹。圖像作為一種變現(xiàn)直觀的多媒體顯示信息,受到人們的重視和青睞。在現(xiàn)實社會應用中有大量的圖像產(chǎn)生,如何快速有效地在圖像庫中匹配檢索出需要用到的信息,一直是多媒體以及圖像檢索研究領域的熱點問題,多媒體圖像檢索不僅可以幫助普通用戶尋找到想要的多媒體內(nèi)容,還可以涉及移動視覺搜索等多個領域。

圖1 為 移 動 視 覺 搜 索示 例 ,通 過 移 動 端 的 拍 攝 ,可 以在很短的時間內(nèi)搜索到相同或相近的圖片,并返回相關信息。圖 1(a)為拍攝一本軟件測試書籍后通過檢索反饋此書籍的相關信息;圖 1(b)為拍攝一張海報,最終顯示出有關此海報的內(nèi)容。 與簡單匹配不同的是,移動視覺搜索是基于算法和數(shù)據(jù)的,需要搜索框架擁有大量的圖像庫,之后根據(jù)圖像處理方法得到圖像描述特征,在特征值的基礎上進行聚類分析或分類識別。它需要將圖像一步步進行解析、提取特征、檢索模型、識別等,最后根據(jù)檢索算法得出和原圖類似或相關的圖像。

移動視覺搜索是指將移動終端獲取的真實世界中的圖像或視頻作為查詢對象,通過移動互聯(lián)網(wǎng)去搜索視覺 對 象 的 關 聯(lián) 信 息 的 檢 索 方 式[1]。 移 動 視 覺 搜 索 是 基 于圖像模式識別的基礎,其中移動視覺搜索應用系統(tǒng)包括兩個基本的內(nèi)容:圖像匹配和圖像檢索。在眾多多媒體圖 像 檢 索 中 ,基 于 內(nèi) 容 的 圖 像 檢 索 技 術[2]成 為 了 近 年 來 圖像檢索的熱點,其中內(nèi)容有使用顏色特征、紋理特征、形狀特征等。傳統(tǒng)的一般使用前饋神經(jīng)網(wǎng)絡來訓練圖像特征數(shù)據(jù) , 其 中 單 隱 層 前 饋 神 經(jīng) 網(wǎng) 絡 (single-hidden layer feed forward network,SLFN)被 廣 泛 地 使 用 。但 是 在 之 前 的 理 論研究工作中,輸入權(quán)重和隱含層閾值總是需要調(diào)節(jié)的。且傳 統(tǒng) 的 SLFN 主 要 使 用 基 于 梯 度 下 降 方 法 (如 BP(back propagation)神 經(jīng) 網(wǎng) 絡[3])、 標 準 的 優(yōu) 化 約 束 方 法 (如SVM(support vector machine)[4])、 最 小 二 乘 法 (RBF(radial basis function)網(wǎng) 絡[5])等 方 法 來 訓 練 數(shù) 據(jù) ,需 要 多 次 迭 代 ,且容易陷入局部最優(yōu)解。

極 限 學 習 機 (extreme learning machine,ELM)[6-14]是 由Huang 等 人 最 初 提 出 適 用 于 SFLN 的 一 種 簡 單 的 學 習 算法;不同于傳統(tǒng) 的學習 算法(如 BP 學習 算法),ELM 不 僅能達到最小的訓練錯誤,同時致力于達到最小的標準權(quán)重 ;它 避 免 了 傳 統(tǒng) 的 SLFN(single-hidden layer feedforward)學習方法收斂速度慢以及容易陷入局部最優(yōu)解的可能。本文在深入了解 ELM 算 法的基礎 上 ,對 ELM 算法思 想 和 算法公式進行了仔細的研究分析,并且驗證分析了 ELM 的分類效果,然后設計 ELM 分類器使之進一步運用 到 圖 像搜索方面;同時在給出 ELM 基本概念的基礎上,提出 了 一個 基 本 移 動 視 覺 搜 索 (basic mobile visual searching,BMVS)框架來解決視覺搜索中對于網(wǎng)絡帶寬的依賴,該框架采用ELM 分類器進行訓練測試數(shù)據(jù)。通過這個框架上傳下載圖片相關信息時候,不用頻繁地依賴網(wǎng)絡,只需交互一次即可針對搜索的圖像進行處理。

圖1 移動視覺搜索示例

2 相關工作

[1]對 圖 像 檢 索 的 過 去 、 現(xiàn) 在 和 將 來 進 行 了 分析,對基于內(nèi)容的圖像檢索的主要研究就似乎進行了詳細和全面的論述,介紹了典型的基于內(nèi)容的圖像檢索系統(tǒng)。最后指出了現(xiàn)存的問題和今后的研究方向。參考文獻[6-14]提出了一個新的學習算法——ELM(極限學習機),該算法由新加坡南洋理工大學的黃廣斌教授提出,它是一種主要針對 SLFN(單隱層前饋神經(jīng)網(wǎng)絡)的監(jiān)督型學習算法。參考文 獻 [12]在 講 解 了 ELM 前 對 傳 統(tǒng) 的 神 經(jīng) 網(wǎng) 絡 算 法 進 行 了分 析 , 如 SVM、PSVM、LS-SVM 等 , 并 且 在 目 標 函 數(shù) 、穩(wěn) 定性、相似度匹配、學習速度、泛化性能等方面進行了實驗對比 分 析 。參 考 文 獻[13]重 點 對 單 隱 層 前 饋 神 經(jīng) 網(wǎng) 絡 的 通 用逼 近 性 能 進 行 了 分 析 ,并 且 在 此 基 礎 上 提 出 了 一 種 I-ELM的單隱含層神經(jīng)網(wǎng)絡的增量學習算法。之后重點介紹了黃廣斌在 ELM 的基礎上 進行的一些推廣,如將 ELM 推廣 到復數(shù)域,提出基于 ELM 的在線時序算法等。參考文獻[15]提出了一個新的多任務特征選擇提取算法。它是以批處理的方式選取每個相關的特征,取代原先要單獨評估每個特征。該算法基于一個假設:不同相關的任務擁有共同的結(jié)構(gòu),不同任務的多特征功能在連接架構(gòu)中能夠被同時學習,這使得該算法可以將多任務的共同理論作為補充信息來促進決策,同時提出了一個有效的迭代算法來促進優(yōu)化從 而 保 證 收 斂 性 。參 考 文 獻[16]提 出 了 一 種 新 的 模 式 識 別算 法 , 稱 為 遺 傳 主 成 分 分 析 (gentic principal component analysis,GPCA),它 是 結(jié) 合 了 遺 傳 算 法 和 主 成 分 分 析 ,初 始由特征值和特征向量來構(gòu)成特征空間。通過特征空間,使用歐式距離來對輸入圖片進行分類。最后通過在ORL(olivetti research laboratory,人 臉 數(shù) 據(jù) 庫 )中 進 行 實 驗 來證明提出的方法優(yōu)于之前的人臉識別方法。

基于以 上分析,傳統(tǒng)的方法如神經(jīng)網(wǎng) 絡 或者 SVM 等,都面臨一些挑戰(zhàn)問題,如學習速度慢、容易陷入局部最優(yōu)解和計算頑健性低等。而極限學習機作為一個新興的技術,克服了上述傳統(tǒng)技術所面臨的一些問題,在性能和可擴展性方面均能達到很好的效果。

3 極限學習機

極限學習機最初提出應用于單隱藏層前饋神經(jīng)網(wǎng)絡 ,然后延伸到了泛化 SLFN。給定 N 個不同的數(shù)據(jù)樣本,且L個隱層神經(jīng)元的單隱層神經(jīng)網(wǎng)絡可以零誤差逼近這 N個互異的數(shù)據(jù)樣本,則網(wǎng)絡模型為:

其 中 ,ai、bi分 別 為 輸 入 權(quán) 值 和 隱 含 層 閾 值 ,β為 第 i個隱 層 節(jié) 點 到 ELM 網(wǎng) 絡 輸 出 節(jié) 點 之 間 的 權(quán) 值 ,h(xi)=[G(a1,b1,xi),… ,G(aL,bL,xi)]T為 隱 藏 層 關 于 輸 入 xi的 輸 出 向 量 ,它 的 作用是將樣本 xi由 d 維輸入空間映射到 L 維的特征空間。

式 (1)可 簡 記 為 :H·β=T,其 中 H(a1,… ,aL,b1,… ,bL,xi,… ,為神經(jīng)網(wǎng)絡隱層輸出矩陣。矩陣中第 i行為輸入向量 xi在各個隱層節(jié)點的 輸 出 ,第 j列 為 第 j 個 隱 層 節(jié) 點 對 應 的 輸 入 向 量 x1,x2,… ,xL的輸出向量,。然而由于多數(shù)情況下,L<<N。從而使得訓練樣本的網(wǎng)絡輸出和實際輸出之間的誤差也隨之產(chǎn)生:Hβ=T+E,即-tj,j=1,…,N。

即網(wǎng)絡參數(shù)的訓練問題轉(zhuǎn)化成了最小化平方損失函數(shù)的問題,即尋找最小二乘解,使得:,利用廣義逆可得:

其中,H+=(HTH)-1HT。

4 基本移動視覺搜索框架

為了更好地分析和測試 ELM 在多分類情況下的泛化性,同時能更加符合移動視覺搜索的應用所需,本文在移動視覺領域常用三大框架模型的基礎上,構(gòu)建了自己的移動視覺搜索框架模型——BMVS 框架,其模型如圖 2 所示 。

在 圖 2 所 示 的 框 架 中,移 動端 采 集 圖 像 ,不需 要 對 圖像進行相關處理,只需收集整理圖像并使用網(wǎng)絡傳輸圖像到服務器端數(shù)據(jù)庫,服務器數(shù)據(jù)庫端會自動完成圖像的相關處理任務(圖片接收、特征提取、特征訓練測試、顯示結(jié)果),最后移動端接收識別結(jié)果即可。此外,移動端也可下載該分類器和配置信息,便能對相關圖像進行匹配和檢索。整個模型中,只需上傳下載過程中需要網(wǎng)絡鏈接,大大減少了對網(wǎng)絡帶寬等的需求。在這一過程中,ELM 分類器構(gòu)造識別包括兩個階段:離線階段,將圖像庫特征提取后,同類別標簽一 起輸入 ELM 分 類器中,構(gòu)造 一 個 ELM 分類器;在線階段,首先提取圖像的特征,然后送入 ELM 分類器中進行判別,輸出識別結(jié)果和信息、資源等。由于服務器端要對圖片完成特征訓練階段,所以使用 ELM 算法來訓練分類器。為了提高訓練準確度,本文對提取的特征經(jīng)過 相關預處理過程,包括 PCA 降維、歸一化、數(shù)據(jù)標準化等4個步驟。

圖2 基本移動視覺搜索框架

本文首先對接 收的圖像進行 RGB 提取,接著進行HSV 轉(zhuǎn)化,即對轉(zhuǎn)化的 3 種特征通道進行 HSV 特征量化(H 通道量化 16 級 ,S 通道和 V 通道量化成 4 級),再將HSV 分量轉(zhuǎn)換成一個一維數(shù)組,并對其進行特征直方圖提取 。在 此 基 礎 上 本 文 使 用 PCA 方 法[16]來 對 提 取 的 圖 像 特 征進行降維操作,其原理就是將原來的數(shù)據(jù)投影到一個新的空間,新的空間下數(shù)據(jù)是原樣本的一個最大線性無關組特征值所對應的空間數(shù)據(jù),本文所實現(xiàn)的相關算法偽碼如下。

步驟1 對于m個訓練樣本圖片進行上面的特征提取 轉(zhuǎn) 換 ,第 i 副 圖 像 的 特 征 數(shù) 據(jù) 為 :{xi1,xi2,xi3,… ,xin},n 為 每張圖片的特征維數(shù),可以構(gòu)建一個 A=m×n 的樣本矩陣。

步 驟 3 求 樣 本 矩 陣 與 平 均 值 的 差 值 :Di=xi-θ,i= {1,2,3,…,n}。

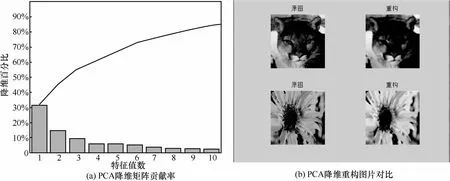

圖3 PCA 降維與重構(gòu)示例

步驟 4 計算樣本矩陣的協(xié)方差矩陣,它的維度與每個樣本的維度相等:

步驟 5 求協(xié)方差矩陣 B的特 征 值 和特征向 量 ,并 且根據(jù)特征值從大到小進行排列,得到給出成分的重要性級別,忽略重要性低的成分,最后根據(jù)得到的最大特征值的特 征 向 量 構(gòu) 成 一 個 轉(zhuǎn) 換 矩 陣 n·t(t<<n) ,之 后 用 原 來 樣 本數(shù) 據(jù) m·n×n·t得 到 原 樣 本 數(shù) 據(jù) 在 新 空 間 的 數(shù) 據(jù) ,即 降 維 后的矩陣數(shù)據(jù)。

如 圖 3 所示的 實 驗 測試中,對 特征圖像 進 行 PCA 降維 后 ,圖 3(a)是 計 算 特 征 值 的 貢 獻 率 ,一 般 會 選 前 85%~95%的特征值對應的特征向量,其對應的特征值數(shù)量為降 維 的 列 數(shù) 。圖 3(b)表 示 的 是測 試 圖 在 PCA 降 維 后 ,通過 重 構(gòu) 與 原 特 征 數(shù) 據(jù) 進 行 對 比 ,可 以 發(fā) 現(xiàn) PCA 重構(gòu)的 誤差較小。

由 于 ELM 算 法 中 使 用 的 sigmod 函 數(shù) 的 取 值 是 0~1,所以要 對 圖像提取 的 PCA 降維后 的 特 征數(shù)據(jù)進 行 歸一化處 理 。歸 一 化 映 射 函 數(shù) 如 下 :, 其 中 ,ymax、ymin為 參 數(shù) ,默 認 為 -1 和 1,xmin、xmax代 表 數(shù) 據(jù) 矩 陣 中 的最大值和最小值,x代表要歸一化的矩陣每一行中的每個數(shù)據(jù)。

根 據(jù)第 3 節(jié) ELM 算法思想 和 ELM 分類的 分 析 ,本 文設計 ELM 分類器 來 訓練圖像 特 征 集, 其中對 于 輸 入層和隱含層之間的連接權(quán)值w和隱含層閾值b進行隨機選取,同 時 選 擇 激 活 函 數(shù) 為 sigmoid 函 數(shù) ,相 關 程 序 分 類 器 訓 練的程序偽碼如下表所示。

步 驟 1 初 始 化 N=150 幅 圖 像 訓 練 樣 本 矩 陣 A={(xi,ti)xi?Rn,ti?Rm,i=1,… ,N}(即 對 圖 像 進 行 上 述 的 提 取 、降 維 、歸 一 化 操 作 ),其 中 T={t1,t2,… ,ti},i=1,… ,N 為 訓 練 樣 本 的 類別矩陣。

步驟2 隨機產(chǎn)生輸入層與隱含層間的連接權(quán)值I與隱含層神經(jīng)元的閾值 B,取 激 活 函 數(shù) TF 為 sig 函 數(shù) 。

步驟 3 根據(jù) 第 3.1 節(jié)相關計 算式計算隱含層輸出矩陣(計算式忽略維數(shù)相關轉(zhuǎn)變)。

步 驟 4 計 算 輸 出 權(quán) 值 矩 陣 :L=pinυ(H')·T'(H'、T'均為轉(zhuǎn)置矩陣)。

步驟 5 計算輸入矩陣的預測輸出類型矩陣:P=(H'·L)'。

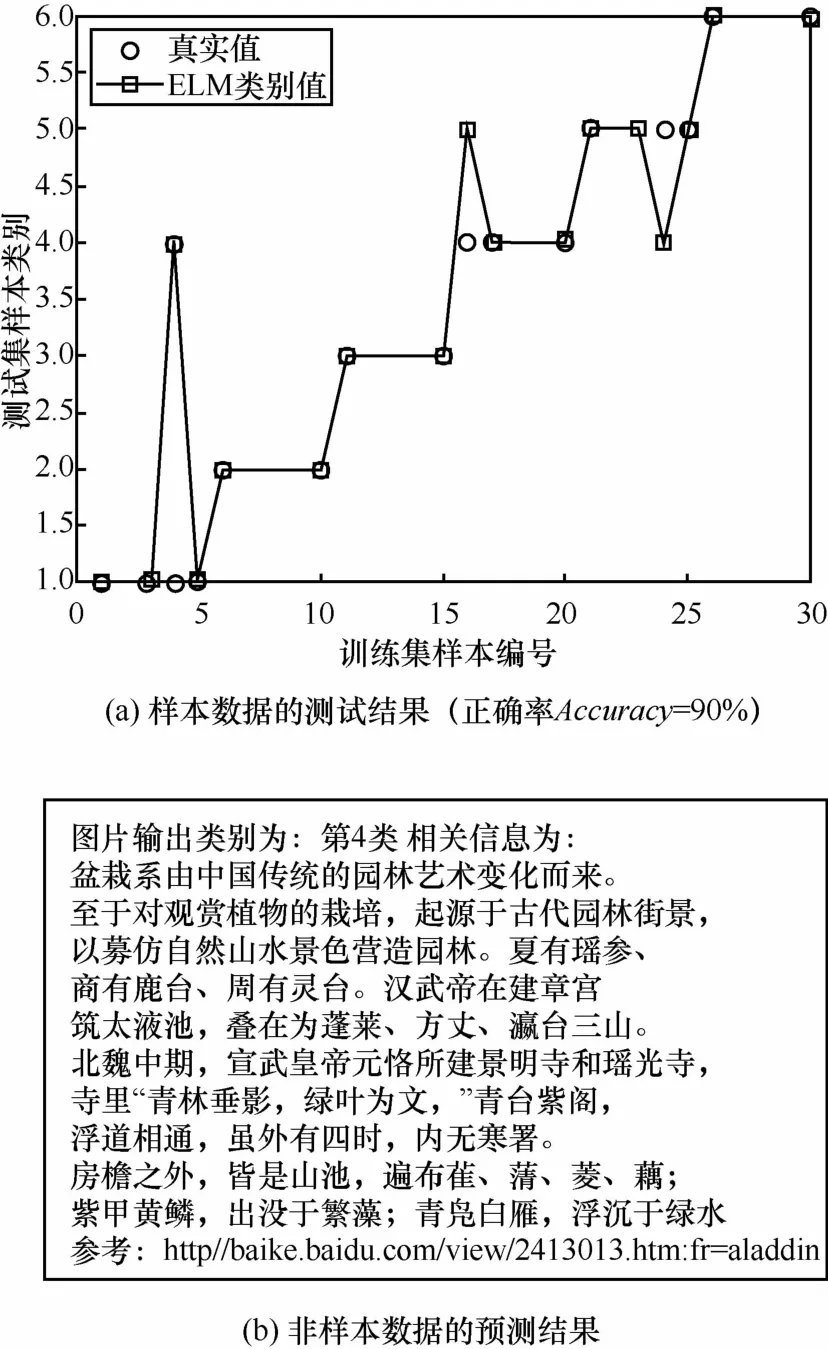

如圖4所示,本文對訓練樣本進行分類器的訓練并對預測結(jié)果與原類別矩陣進行對比。當神經(jīng)元的個數(shù)向訓練樣本逼近時,可以發(fā)現(xiàn) ELM 分類器訓練 精度會 越來越高。

圖4 ELM 分類器訓練結(jié)果(正確率 Accuracy=99.333 3%)

進一步 對訓練好的 ELM 分類 器進行泛化 性能研 究,需要取測試數(shù)據(jù)樣本來進行測試,其中測試數(shù)據(jù)的相關處理與訓練數(shù)據(jù)一致,測試分為兩部分:對樣本數(shù)據(jù)測試,取樣本數(shù)據(jù)中測試部分進行分類測試,由測試結(jié)果可以得知分類器的測試性能;對非樣本中數(shù)據(jù)的測試,隨機選取相關圖像特征取相關數(shù)據(jù)進行分類預測,考察分類器 的 泛 化 性 能 。相 關 實 驗 如 圖 5 所 示 ,其 中 圖 5(a)是 對 樣本數(shù)據(jù)的測試結(jié)果,可知訓練好 的 ELM 分類器 測試性 能良 好 ;圖 5(b)是 對 非 樣 本 數(shù) 據(jù) 中 的 隨 機 相 關 圖 像 數(shù) 據(jù) 進 行的分類預測結(jié)果,可知對于非樣本相關數(shù) 據(jù),本 ELM 分 類器能準確的預測出相關類別并輸出相關信息。

圖5 ELM 分類器預測效果

5 性能優(yōu)化方法 A-ELM

由 于 ELM 的一些 閾值 和 輸入權(quán)值 為 0 導致隱 含 層 節(jié)點無效。為了保持 ELM 的高效性,可以設置隱含層節(jié)點數(shù)目接近訓練樣本數(shù)目,此時樣本能達到最好的訓練效果,但此時 ELM 的泛化測試能力大大降低。

為了解決上述訓練樣本與測試樣本分類準確率均衡的 問 題 , 本 文 提 出 A-ELM (ascending-extreme learning machine)一種類似增量學習的方法來訓練優(yōu)化分類器的性能,從而解決隱含層節(jié)點需要手動隨機設置的問題,A-ELM 算法的基本模型如圖 6 所示。

由第 3節(jié)可知,對于含有 L 個隱含層的神 經(jīng)網(wǎng)絡的函數(shù) 為)。同 時 ,理 論 與 實 驗 表 明[9],含 有 L 個 隱含層節(jié)點的輸出函數(shù)為:

A-ELM 優(yōu)化方法的主要思想為:在圖中的 隱含層逐一添加隱含層神經(jīng)元節(jié)點數(shù)(最大為訓練樣本數(shù)量 N)。每次添 加 節(jié) 點 時 , 計 算 出 添 加 節(jié) 點 前 后 的 模 型 殘 差 En=f-fn[11](其中 f為任意連續(xù)的目標函數(shù),初始化為訓練樣本的目標 向 量 ),命 名 為 φ1,將 此 時 的 隱 含 層 節(jié) 點 數(shù) 和 模 型 參 數(shù)帶 入 測 試 樣本中,計算 比 較 出測試樣 本 的殘差 φ2,并對訓練 樣 本 和 測 試 樣 本 的 殘 差 和 求 二 范 數(shù) φsum,最 后 依 次 比 較求 出 φmin=min(φsum)即 可 求 出 此 分 類 器 均 衡 的 隱 含 層 節(jié) 點數(shù),從而進一步對未知樣本進行測試實驗。相關的算法偽碼如下。

初 始 化 對 于 給 定 的 訓 練 樣 本 集 合 ψ ={(xi,ti)|xi∈Rn,ti∈R,i=1,… ,N},t=[t1,t2,… ,tN]為 樣 本 目 標 向 量 ,隱 含 層 神 經(jīng)元 個 數(shù) L=0,樣 本 殘 差 E=t,最 小 殘 差 和min=0(N 為 訓 練 樣本個數(shù))。

步驟 1 當隱 含層 節(jié) 點數(shù) L小于最大 樣 本 數(shù)時候 ,逐一添加隱含層神經(jīng)元個數(shù):L=L+1。

步 驟 2 對 于 添 加 的 新 的 隱 含 層 節(jié) 點 j(j<L)隨 機 生 成輸 入 權(quán) 值 aj和 閾 值 bj。

步驟 3 計算新添加的隱含層 節(jié)點 的 輸出權(quán)重 βj為:,其中E添加節(jié)點前的殘差,為第 j個隱含層節(jié)點 與 N個訓練 樣本相關的隱含層輸出矩陣。

步 驟 4 計 算 添 加 新 的 隱 含 層 節(jié) 點 后 的 殘 差 :E1=EL=ffL,結(jié) 合 式 (3)有 :EL=f-fL=f-fL-1-βL·gL=EL-1-βL·gL(其 中 EL-1表示添加新節(jié)點之前的模型殘差,EL表示添加之后的新的殘差)。

步 驟 5 將 aj,bj等 模 型 相 關 信 息 帶 入 到 測 試 集 框架 中 , 重 復 步 驟 3、 步 驟 4 求 出 測 試 集 合 殘 差 E2,將與 φMin比 較 , 重 復 實 現(xiàn) 步 驟 1~ 步 驟 5 直 到 求 出 φmin=min(φsum)。

步驟6 對訓練樣本和測試樣本之外的模型樣本進行測試,進一步提高分類器的泛化性能。

圖6 A-ELM 算法模型

6 實驗部分

在本節(jié)中,通過實驗來驗證上述所有理論,采用“MATLAB2010b+VC++”編 程 ,具 體 實 驗 環(huán) 境 :Asus A43s 2.50 GHz CPU、4 GB 內(nèi) 存 、500 GB 硬 盤 。實 驗 主 要 程 序 采 用MATLAB2010 語言編寫。首先第 6.1 節(jié)中對 ELM 分類器訓練,通過對圖片集中種類的采集和處理來訓練分類器。

6.1 服務器端 ELM 分類器實驗

對 ELM 分 類器訓練,通過 對 圖片集中 種 類 的采集 和處理來訓練分類器。

圖7 中 實 驗 所 用 圖 像 是 從 101_ObjectCategories 圖 片集 中 隨機選取 6 種類圖片 集 ,每 種 30 樣 本 (其 中 ,每 種 選取 25 樣 本 進 行 訓 練 ,5 樣 本 進 行 測 試 ,共 計 6×25=150 個訓練樣本,6×5=30 個測 試樣本)進行 ELM 分類器的 訓 練 ,由于隨機產(chǎn)生輸入和隱含層連接權(quán)值 w和隱含層閾值 b,所以分類準確率會有一個波動范圍。所以本文采取多訓練求平均值的方式來衡量訓練的結(jié)果,由圖 6可知對于訓練分類器準確率達到 98%,此時測試準確率也能達到 90%可以證明對于此分類器的訓練測試效果較好。

圖7 服務器端訓練測試效果

6.2 對比實驗

通過使 用傳統(tǒng)的分類算法 SVM 來進行 比 較 ,從而 確定 ELM 分類器的優(yōu)勢。

如 圖 8 所 示 ,系 統(tǒng) 通 過 使 用 支 持 向 量 機 (SVM)來 處理圖片特征,最后返回訓練樣本的準確率。為了更好地體現(xiàn)對比性,本文對不同訓練樣本進行對比實驗如圖9所示。

圖8 SVM 訓練測試結(jié)果

圖9 SVM 和 ELM 對 比

由于隨機產(chǎn)生w和b對測試實驗結(jié)果有起伏的影響,本文對 5 次分類器測試實驗取平均值,見表 1。

表1 訓練平均值

通過圖 9 和表 1、表 2 可以發(fā)現(xiàn) ,當 樣 本 數(shù)量不多 時 ,ELM 和 SVM 的分類準確率和 分類時間差不多, 當數(shù)量增大時候,分類器的準確率就有了比較大的差距,訓練時間更是相差比較大。因此,在圖像特征檢索方面,ELM 比SVM 更有效率性和準確性。

表2 ELM 和 SVM 對比總結(jié)

6.3 ELM 的性能優(yōu)化實驗

本節(jié)對 ELM 方法進行性能 優(yōu) 化 實驗,使 用 優(yōu)化性能的 ELM 進行訓練測試,進一 步 提 高 ELM 的分 類 訓練測試能力和泛化性能。主要分為兩部分:A-ELM 的優(yōu)化結(jié)果及性能優(yōu)勢;對相關非樣本數(shù)據(jù)的預測。

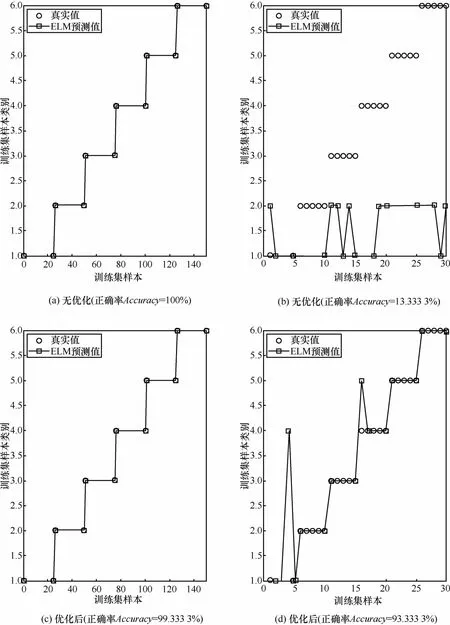

如圖 10 所示,當逐一增加 隱含層節(jié)點 L 時,訓練樣本殘差 φ1與 φ2測試樣本的殘差的范數(shù)和成下降趨勢,之后趨于一個最小點,此時即可求出無需人工設置的隱含層節(jié)點數(shù)。

如 圖 11 所 示 ,當 沒 有 采 取 優(yōu) 化 時 候 , 訓 練 樣 本 的神經(jīng)元個數(shù)是隨機生成,要想達到很好的效果,只能人工不斷手動設置隱含層節(jié)點來慢慢調(diào)節(jié),且如需達到最好的訓練效果,可設置神經(jīng)元個數(shù) L=訓練樣本數(shù)目 ,但 此 時 測 試 樣 本 的 ||φ2||非 常 大 (也 即 誤 差 非 常 大 ),如果想達到一個均合適的分類效果,需要不停手動設置 L。采取優(yōu)化后,無需手動設置,通過上述的方法,可以自動調(diào)節(jié)訓練樣本和測試樣本的誤差,從而確定一個合適的神經(jīng)元個數(shù),達到一個均衡的效果,以提高分類器的穩(wěn)定性。

圖10 A-ELM 優(yōu)化實驗

對相關非樣本數(shù)據(jù)的預測方面,為了檢驗調(diào)節(jié) L對分類器的泛化性能的影響,如圖 12 中(a)~(d)隨機下載 4 幅圖片進行測試,圖 13 為測試結(jié)果。

表3 中 給 出 了 A-ELM 和 未 優(yōu) 化 的 ELM 對 于 非 樣 本數(shù)據(jù)的測試,可以看到優(yōu)化后,預測準確度并沒有降低,但是由于需要重復調(diào)節(jié)神經(jīng)元個數(shù),花費時間增加。但是手動調(diào)節(jié)來說,A-ELM 有很大的優(yōu)勢。

6.4 移動計算設備的測試

本文對移動計算設備進行了視覺搜索測試,移動計算設備為擁有安卓系統(tǒng)的智能手機或者擁有安卓模擬器的電腦,并且只需要下載分類器和相關信息即可。實驗整體流程如下:首先在服務器端和移動端建立連接,設置好端口號和服務器端的 IP 地址,同時在移動端 上 安 裝一個安卓 App。打開此應用程序程序,移動計算設備拍攝圖像完成采集,上傳到服務器進行處理,上傳過程中使用序列化方式傳輸,將圖像組織成二進制流的方式進行圖像的接收和傳輸。與此同時,服務器端監(jiān)聽事先設置好的端口并接收圖像數(shù)據(jù)流,之后反序列化成圖像顯示送入服務器端的分類器中進行分類預測。根據(jù)本文所提出的模式框架,服務器端將預測的圖像進行相關處理并傳輸?shù)骄W(wǎng)絡中,移動端接收此圖像檢測進行顯示,同時能返回相關信息。實驗展示效果如圖 14所示。

7 結(jié)束語

圖11 性能優(yōu)化對比

圖12 測試圖片示例

本 文 在 闡 述 ELM 的 理 論 基 礎 上 對 ELM 進 行 了 進 一步的理論與實驗分析,并將之運用到移動視覺搜索方面;本文首先對 ELM 算法的性能進行了分析驗 證 ,在此基礎上,提出了基本視覺框架模型 BMVS,將 ELM 運用到此框架服務器端,并進一步給出了優(yōu) 化分 類 性能的 A-ELM 方法。最后通過實驗證明了 ELM 在移動視覺搜索 方面 的 可行性,并通過和支持向量機 SVM 的實驗對比 驗證相關 方法的高效性。

表3 ELM 優(yōu)化前后性能對比

圖13 針對圖 12 中圖片的測試結(jié)果

圖14 移動計算設備的測試

參考文獻:

[1] 段 凌 宇,黃 鐵 軍 ,高 文. 移 動 視 覺 搜 索 技 術 研 究 與 標 準 化 進展[J]. 信 息 通 信 技 術,2012(6):51-58. DUAN L Y,HUANG T J,GAO W.Technical research and standardization in mobile visual search [J].Information and Communications Technologies,2012(6):51-58

[2] 李 向 陽 ,莊 越 挺 ,潘 云 鶴. 基 于 內(nèi) 容 的 圖 像 檢 索 技 術 與 系 統(tǒng) [J].計算機研究與發(fā)展,2001(3),38(3):344-354. LI X Y,ZHUANG Y T,PAN Y H.The technique and systems ofcontent-based imageretrieval [J].JournalofComputer Research and Development.2001(3),38(3):344-354

[3] GURNEY K.An introduction to neural networks [M].London:UCL Press,1997:20-25.

[4] HSU C W,LIN C J.A comparison of methods for multiclass support vector machines [J].IEEE Transactions on Neural Networks,2002,13(2):415-425.

[5] HHUANG G B,SIEW C K.Extreme learning machine:RBF network case[C]/2004 8th Conference on Control,Automation,Robotics and Vision Conference,December 6-9,2004,Kumming,China.New Jersey:IEEE Press,2004(2):1029-1036.

[6] HUANG G B,CHEN L.Convex incremental extreme learning machine[J].Neuro Computing,2007(70):2056-2062.

[7] HUANG G B,BABRI H A.Upper bounds on the number of hidden neurons in feedforward networks with arbitrary bounded nonlinear activation functions [J].IEEE Transactions on Neural Networks,1998,9(1):224-229.

[8] FUNGG,MANGASARIAN O L.Proximalsupportvector machine classifiers [C]/The 7th ACM Sigkdd International Conference on Knowledge Discovery&Data Mining,August 26-29,2001,San Francisco,CA,USA.New York:ACM Press,2001:77-86.

[9] HUANG GB,WANG D H,LAN Y.Extremelearning machines:a survey [J].InternationalJournalofMachine Learning and Cybernetics,2011,2(2):107-122.

[10]HUANG G B,ZHU Q Y,SIEW C K.Extreme learning machine:a new learning scheme of feedforward neural networks[J].IEEE International Joint Conference.2004(2):985-990.

[11]HUANG G B,ZHU Q Y,SIEW C K.Extreme learning machine:theory and applications[J].Neuro Computing,2005 (70):489-501.

[12]HUANG G B,ZHOU H,DING X,et al.Extreme learning machine for regression and multi-class classification [J].IEEE Transactions on Pattern Anal Mach Intell,2012,42(2):513-529.

[13]HUANG G B,CHEN L,SIEW C K.Universal approximation using incremental constructive feedforward networks with random hidden nodes [J].IEEE Transactionson Neural Networks,2006,17(4):879-892.

[14]HUANG G B,SIEW C K.Extreme learning machine with randomly assigned RBF kernels [J].International Journal of Information Technology,2005,11(1):16-24.

[15]HALL M A,SMITH L A.Feature selection for machine learning:Comparing a correlation-based filter approach to the wrapper [C] // The 20th InternationalFlorida Artificial Intelligence Research Society Conference,May 1-5,1999,Orlando, Florida, USA. California: AAAI Press, 1999:235-239.

[16]PRICE A L,PATTERSON N J,PLENGE R M,et al.Principal components analysis corrects for stratification in genome-wide association studies [J].Nature Genetics, 2006, 38 (8 ):904-909.

[17]HOLTEN D,WIJK V J J,MARTENS J B.A perceptually based spectral model for isotropic textures [J].ACM Transactions on Applied Perception,2006,3(4):376-398.

Mobile visual searching method based on ascending extreme learning machine

HU Haiyang1,2,XU Jun1,2,HU Hua1,2

1.School of Computer Science and Technology,Hangzhou Dianzi University,Hangzhou 310018, China 2.Key Laboratory of Complex Systems Modeling and Simulation,Ministry of Education,Hangzhou Dianzi University,Hangzhou 310018,China

Computer intelligence technology had been widely used in the field of image searching.Extreme learning machine has emerged as a new technology which overcomes the problems in traditional intelligent field and it has attracted more and more researchers.The algorithm performance of ELM was analyzed firstly,extending the method to image classification field.A basic mobile visual searching (BMVS)framework was proposed which applies ELM to image searching and optimizes the performance of ELM.Finally,the experiment proves the effectiveness of the method proposed by using ELM for the mobile vision searching.Through the experiments of comparison with SVM-based methods,the efficiency of the method proposed was also confirmed.

classification,extreme learning machine,mobile visual searching

s:The National Natural Science Foundation of China (No.61572162,No.61272188),The Foundation of State Key Laboratory for Novel Software Technology of Nanjing University (No.KFKT2014B15),The Foundation of Key Research Base for Philosophy and Social Sciences of Zhejiang Province (Research Center of Information Technology&Economic and Social Development)(No.14JDXX04YB)

TP311

:A

10.11959/j.issn.1000-0801.2016088

胡 海 洋 (1977-), 男 , 博 士 , 杭 州 電 子 科 技 大學教授, 主要研究方向為分布式系統(tǒng)、數(shù)據(jù)庫技術、工作流技術。

許 軍 (1990-), 男 , 杭 州 電 子 科 技 大 學 碩士生,主要研究方向為數(shù)據(jù)庫技術、圖像檢索。

胡 華 (1964-), 男 , 博 士 , 杭 州 電 子 科 技 大 學教授,主要研究方向為分布式系統(tǒng)、數(shù)據(jù)庫技術。

2015-04-16;

2016-03-02

國 家 自 然 科 學 基 金 資 助 項 目 (No.61572162,No.61272188);南 京 大 學 計 算 機 軟 件 新 技 術 國 家 重 點 實 驗 室 開 放 基 金 資 助 項 目(No.KFKT2014B15);浙 江 省 哲 學 社 會 科 學 重 點 研 究 基 地 (信 息 化 與 經(jīng) 濟 社 會 發(fā) 展 研 究 中 心 )課 題 資 助 項 目 (No.14JDXX04YB)