基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架

穆云磊+++周春暉+++俞東進(jìn)

摘 要: 個(gè)性化推薦系統(tǒng)可以幫助用戶在海量的項(xiàng)目集合中找到他們喜愛的項(xiàng)目,其被廣泛地應(yīng)用于崗位推薦系統(tǒng)、電子商務(wù)網(wǎng)站以及社交網(wǎng)絡(luò)平臺(tái)中。文章提出了一個(gè)基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架,它利用文檔向量表示模型將非結(jié)構(gòu)化的評(píng)論文本用相同維度的向量表示,進(jìn)而構(gòu)造出刻畫用戶和產(chǎn)品的特征向量,最終融合多個(gè)回歸模型進(jìn)行評(píng)分預(yù)測(cè)。在基于真實(shí)的數(shù)據(jù)集上的實(shí)驗(yàn)表明,與基準(zhǔn)模型相比,其顯著改善了數(shù)據(jù)稀疏情況下評(píng)分預(yù)測(cè)的準(zhǔn)確性。

關(guān)鍵詞: 推薦系統(tǒng); 數(shù)據(jù)稀疏; 評(píng)論文本; 文檔向量; 回歸模型; 評(píng)分預(yù)測(cè)

中圖分類號(hào):TP391 文獻(xiàn)標(biāo)志碼:A 文章編號(hào):1006-8228(2016)05-24-06

Abstract: Recommender systems typically produce a list of recommendations to precisely predict the user's preference for the items. It is widely used in post recommendation systems, e-commerce websites and social network platforms. This paper proposes a rating prediction framework based on distributed representation of document and regression model. The framework takes advantage of distributed representation of document to map the unstructured review texts into the same vector space, and furthermore constructs the feature vector of users and items. The framework trains several regression models to predict ratings. The extensive experiments on real-world datasets demonstrate that it performs better than the benchmark and alleviates the cold-start problem to some extent.

Key words: recommender system; data sparsity; review text; distributed representation of document; rating prediction

0 引言

個(gè)性化推薦系統(tǒng)幫助用戶在網(wǎng)絡(luò)上發(fā)現(xiàn)各類產(chǎn)品,并做出決策。越來(lái)越多的網(wǎng)站,如Last.fm、Amazon、Taobao、YouTube、Yahoo等,開發(fā)了推薦系統(tǒng)并將其提供給它們的用戶。這些推薦系統(tǒng)可以幫助用戶從海量的產(chǎn)品集合中找到他們喜愛的歌曲、視頻、書籍以及各種商品[1]。近年來(lái),協(xié)同過(guò)濾(Collaborative Filtering)技術(shù)在個(gè)性化推薦系統(tǒng)中取得了巨大的成功。其主要包括兩類方法[2]:基于鄰域的方法(Neighborhood-based)和基于模型的方法(Model-

based)。然而,冷啟動(dòng)問(wèn)題[3]一直影響著協(xié)同過(guò)濾方法應(yīng)用的效果。這里冷啟動(dòng)問(wèn)題是指:當(dāng)一個(gè)新用戶或新產(chǎn)品加入系統(tǒng)時(shí),用于刻畫他們特征的信息非常稀少,導(dǎo)致為新用戶推薦產(chǎn)品或?qū)⑿庐a(chǎn)品推薦給用戶變得非常困難。

值得注意的是,用戶在給產(chǎn)品評(píng)分的同時(shí)還可能寫下一段評(píng)論。傳統(tǒng)的協(xié)同過(guò)濾方法僅僅將評(píng)分作為數(shù)據(jù)源,而忽略了蘊(yùn)含在評(píng)論中豐富的信息。事實(shí)上,我們可以利用這些蘊(yùn)含在評(píng)論中的信息來(lái)緩解傳統(tǒng)方法中存在的冷啟動(dòng)問(wèn)題。特別是,在評(píng)論中用戶不僅會(huì)討論這個(gè)產(chǎn)品的不同方面,還蘊(yùn)含著他們對(duì)這些方面的情感。例如,當(dāng)用戶評(píng)論筆記本電腦時(shí),他會(huì)對(duì)某款筆記本電腦的“外形”和“性能”等方面表達(dá)正面的情感,而對(duì)它的“續(xù)航”和“散熱”等方面表達(dá)負(fù)面的情感。

本文基于文檔向量和回歸模型,提出一個(gè)高效的評(píng)分預(yù)測(cè)框架。該框架利用文檔向量表示模型,構(gòu)造出比協(xié)同過(guò)濾更加精確的用戶和產(chǎn)品特征空間,并將多個(gè)回歸模型融合以生成有效的評(píng)分預(yù)測(cè)器。在數(shù)據(jù)稀疏的情況下,框架產(chǎn)生的評(píng)分預(yù)測(cè)器的效果顯著高于傳統(tǒng)的協(xié)同過(guò)濾方法。

1 方法概述

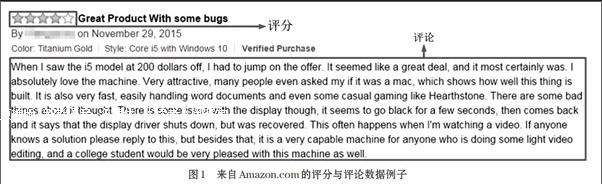

本文主要解決的問(wèn)題是如何在用戶評(píng)分?jǐn)?shù)據(jù)稀疏時(shí)利用評(píng)論文本提高評(píng)分預(yù)測(cè)的準(zhǔn)確度。區(qū)別于傳統(tǒng)方法中以評(píng)分作為單一數(shù)據(jù)源,本文同時(shí)使用評(píng)分和評(píng)論作為數(shù)據(jù)源,利用評(píng)論中的豐富信息緩解傳統(tǒng)協(xié)同過(guò)濾推薦方法中存在的冷啟動(dòng)的問(wèn)題。圖1展示了一個(gè)評(píng)分與評(píng)論數(shù)據(jù)的例子,它來(lái)自電子商務(wù)網(wǎng)站Amazon.com。在這個(gè)例子中,用戶給產(chǎn)品打了四顆星(評(píng)分)的同時(shí),寫了一段評(píng)論。我們的主要任務(wù)是利用用戶評(píng)分與評(píng)論的歷史數(shù)據(jù),構(gòu)造刻畫用戶和產(chǎn)品的特征,預(yù)測(cè)用戶對(duì)未產(chǎn)生過(guò)行為的產(chǎn)品的評(píng)分。

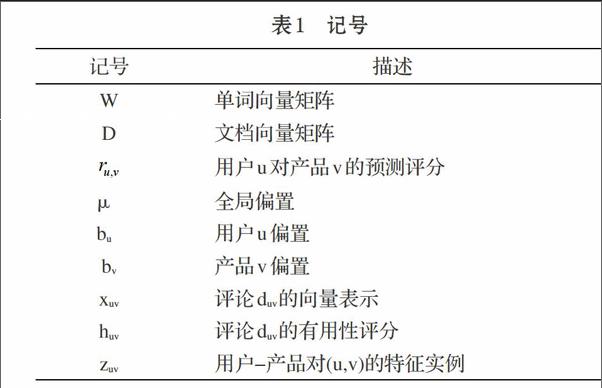

我們可將用戶集合表示為,產(chǎn)品集合表示為。表示可見評(píng)分集合,表示評(píng)論集合,評(píng)分和評(píng)論的全集記為。本文涉及的相關(guān)記號(hào)見表1。

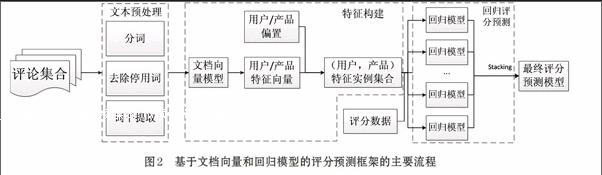

基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架的主要流程表述如下。首先,對(duì)原始的評(píng)論文本進(jìn)行預(yù)處理,預(yù)處理過(guò)程主要包括分詞、去除停用詞和詞干提取,然后,通過(guò)文檔向量表示模型(doc2vec)[4]構(gòu)建刻畫用戶與產(chǎn)品的特征向量,接著,利用這些向量和用戶和產(chǎn)品的偏置構(gòu)造用戶-產(chǎn)品對(duì)特征實(shí)例集合,最后,以評(píng)分作為標(biāo)簽,構(gòu)建多個(gè)回歸模型并融合為最終的評(píng)分預(yù)測(cè)模型。圖2展示了基于文檔向量和回歸模型評(píng)分預(yù)測(cè)框架的主要流程。

該評(píng)分預(yù)測(cè)框架的特點(diǎn)為:①使用無(wú)監(jiān)督的文檔向量模型將每個(gè)評(píng)論轉(zhuǎn)化到相同維度的向量空間中,并以此為基礎(chǔ)構(gòu)造分別刻畫用戶和產(chǎn)品的向量;②在①的基礎(chǔ)上組合用戶-產(chǎn)品對(duì)的特征實(shí)例并構(gòu)造數(shù)據(jù)集;③將評(píng)分預(yù)測(cè)轉(zhuǎn)化為機(jī)器學(xué)習(xí)中的回歸問(wèn)題,利用回歸模型提高評(píng)分預(yù)測(cè)精度。

2 文檔向量表示模型

文檔向量表示模型[4]能夠?yàn)橐粋€(gè)變長(zhǎng)的輸入序列構(gòu)造表示結(jié)構(gòu),其中變長(zhǎng)的輸入序列可以是任意長(zhǎng)度的文本:句子、段落或者文檔。它的優(yōu)點(diǎn)是無(wú)需面對(duì)不同的任務(wù)調(diào)節(jié)單詞的權(quán)重也無(wú)需依賴句法分析樹。

文檔向量的學(xué)習(xí)方法受到詞向量[5]學(xué)習(xí)方法的啟發(fā)。在詞向量學(xué)習(xí)方法中,詞向量被用來(lái)幫助預(yù)測(cè)句子中的下一個(gè)單詞,因此,盡管詞向量被隨機(jī)初始化,它們作為預(yù)測(cè)任務(wù)的間接結(jié)果,仍然能夠捕捉語(yǔ)義信息。在文檔向量模型中使用相似的想法,文檔向量也被用來(lái)做預(yù)測(cè)任務(wù),這里的預(yù)測(cè)任務(wù)是預(yù)測(cè)給定多個(gè)從文檔中采樣的上下文的下個(gè)單詞。

圖3為文檔向量學(xué)習(xí)框架。每個(gè)文檔被映射為一個(gè)惟一的向量,由矩陣D中的列表示,同時(shí)每個(gè)單詞也映射為一個(gè)惟一的向量,由矩陣W的列表示。文檔向量和詞向量被平均或連結(jié)以預(yù)測(cè)上下文中的下個(gè)單詞。

與詞向量學(xué)習(xí)方法相比,文檔向量學(xué)習(xí)框架增加了文檔標(biāo)記,用于將每個(gè)文檔向量映射到文檔矩陣D中。這里,文檔標(biāo)記可以被認(rèn)為是另一個(gè)單詞,它的作用是記憶現(xiàn)有上下文缺失的部分,或者是文檔的主題。

在文檔向量模型中,上下文是從文檔中通過(guò)滑動(dòng)窗口采樣的固定長(zhǎng)度文本。對(duì)于從同一個(gè)文檔中采樣的上下文,它們共享同一個(gè)文檔向量。而單詞向量矩陣W則是通用的。即,對(duì)于所有的文檔,表示“good”的向量是一樣的。

文檔向量和詞向量使用隨機(jī)梯度下降法(SGD)學(xué)習(xí)得到,其中梯度由反向傳播算法得到。在每一步梯度下降中,可以從隨機(jī)的一個(gè)文檔中采樣一段固定長(zhǎng)度的上下文,然后根據(jù)圖3中的網(wǎng)絡(luò)計(jì)算誤差梯度以及使用梯度更新模型的參數(shù)。

在預(yù)測(cè)階段,對(duì)于一個(gè)新的文檔,我們需要執(zhí)行一個(gè)推斷的步驟來(lái)計(jì)算其向量。這個(gè)步驟仍然是通過(guò)梯度下降實(shí)現(xiàn)。在此步驟中,模型的其余參數(shù)包括詞向量矩陣W和Softmax權(quán)重等,都是固定的。

在模型訓(xùn)練之后,文檔向量可以被用作描述文檔特征。在本文的評(píng)分預(yù)測(cè)框架中,文檔向量被用來(lái)將每一個(gè)評(píng)論映射到相同維度的向量空間中,并進(jìn)一步地用于刻畫用戶和產(chǎn)品特征向量的構(gòu)造。

3 特征實(shí)例

⑴ 用戶和產(chǎn)品特征向量構(gòu)造

通過(guò)將每個(gè)評(píng)論看作一個(gè)文檔,并賦予其標(biāo)記,使用文檔向量表示模型,我們將每個(gè)評(píng)論都映射到相同維度的向量空間中。形式化地,對(duì)于評(píng)論duv,其對(duì)應(yīng)的評(píng)論向量記為xuv,這里,。

對(duì)于用戶u,我們使用其所有評(píng)論的向量平均作為其特征向量:

⑴

其中,表示用戶u的評(píng)論集合。

值得注意的是,每一個(gè)評(píng)論都有一個(gè)有用性評(píng)分,直觀上,有用性越高的評(píng)論,對(duì)產(chǎn)品的描述更加準(zhǔn)確。有用性評(píng)分的形式一般為“有用/無(wú)用”,前者表示“認(rèn)同”當(dāng)前評(píng)論的用戶數(shù)量,后者表示“不認(rèn)同”當(dāng)前評(píng)論的用戶數(shù)量,為了將此形式的有用性評(píng)分轉(zhuǎn)化到實(shí)數(shù)上來(lái),定義:

⑵

其中,puv和nuv分別為對(duì)評(píng)論duv的“認(rèn)同”用戶數(shù)和“不認(rèn)同用”戶數(shù),a和b分別為控制轉(zhuǎn)換的參數(shù)。因此,對(duì)于產(chǎn)品v的特征向量,可以使用有用性評(píng)分對(duì)產(chǎn)品的所有評(píng)論向量加權(quán)平均得到:

⑶

⑵ 用戶和產(chǎn)品偏置

除了使用評(píng)分向量構(gòu)造的用戶和產(chǎn)品特征之外,我們還使用用戶和產(chǎn)品的偏置作為特征。

直觀上,不同的用戶和不同的產(chǎn)品評(píng)分尺度都有所不同。例如,某用戶是評(píng)分嚴(yán)格的用戶,那么他的評(píng)分一般會(huì)低于全局平均分,而某個(gè)產(chǎn)品質(zhì)量?jī)?yōu)于其他產(chǎn)品,那么它的評(píng)分則會(huì)高于平均評(píng)分。對(duì)于用戶u,其偏置可以定義為其評(píng)分與全局平均差的均值:

⑷

同理,對(duì)于產(chǎn)品v,其偏置可以定義為:

⑸

最終,使用連接的方式構(gòu)造特征實(shí)例,即對(duì)于用戶-產(chǎn)品對(duì)(u,v),其特征實(shí)例為[xu,bu,xv,bv]。

4 回歸模型

回歸模型是一類監(jiān)督學(xué)習(xí)模型,每個(gè)輸入實(shí)例通常由特征向量表示,記為x={x(1),x(2),…,x(i),…,x(n)},x(i)表示第i個(gè)特征。對(duì)于訓(xùn)練集的輸入實(shí)例X和輸出向量y,回歸模型通過(guò)擬合它們得到一個(gè)擬合函數(shù)f使得f(X)=y,使用此函數(shù)可以預(yù)測(cè)未知的實(shí)例集合(測(cè)試集)的輸出,即對(duì)于測(cè)試實(shí)例,求得。

本文主要使用三個(gè)流行的回歸模型進(jìn)行評(píng)分預(yù)測(cè),分別是k近鄰回歸模型、隨機(jī)森林回歸模型和梯度提升回歸樹模型。

⑴ k近鄰

k近鄰算法[6],簡(jiǎn)稱k-NN,是一種非參數(shù)學(xué)習(xí)算法。在k近鄰回歸中,輸入為包含特征空間中的k個(gè)最近訓(xùn)練實(shí)例,輸出為對(duì)象的屬性值,通過(guò)計(jì)算其k近鄰值的均值求得。k-NN是一種基于實(shí)例的學(xué)習(xí)算法,也被稱為惰性學(xué)習(xí),其決策函數(shù)僅僅為局部近似,而且只有在需要回歸時(shí)才進(jìn)行計(jì)算。

⑵ 隨機(jī)森林

隨機(jī)森林回歸器[7]是集成學(xué)習(xí)中最重要的算法之一,它是一個(gè)包含多個(gè)樹結(jié)構(gòu)的回歸器的集合,其中是相互獨(dú)立分布的隨機(jī)參數(shù)向量,回歸的結(jié)果通過(guò)平均所有樹的結(jié)果得到。

在隨機(jī)森林中,每一個(gè)子樹都是一個(gè)分類與回歸樹(CART)[8]。CART是一種應(yīng)用廣泛的決策樹學(xué)習(xí)方法,對(duì)于訓(xùn)練數(shù)據(jù)集X,Y,其通過(guò)遞歸將輸入空間的每個(gè)區(qū)域劃分為兩個(gè)子區(qū)域并決定每個(gè)子區(qū)域上的輸出值,構(gòu)建二叉樹。

⑶ 梯度提升回歸樹

梯度提升回歸樹(GBRT)[9],又被稱為多重累加回歸樹(MART)或樹網(wǎng)(Tree-Net),是一種高效的提升(Boosting)學(xué)習(xí)方法。在一般的提升樹模型中,損失函數(shù)通常采用平方誤差損失,每一步只需擬合當(dāng)前數(shù)據(jù)的殘差,但對(duì)于一般的損失函數(shù),如對(duì)數(shù)損失,其優(yōu)化變得非常困難。GBRT通過(guò)計(jì)算損失函數(shù)的負(fù)梯度近似殘差,以此擬合新的回歸樹。

5 評(píng)分預(yù)測(cè)框架構(gòu)建

我們?cè)诖颂接懰岢龅幕谖臋n向量和回歸模型的評(píng)分預(yù)測(cè)框的構(gòu)建過(guò)程。首先介紹框架的冷啟動(dòng)評(píng)分預(yù)測(cè)器,然后介紹評(píng)分預(yù)測(cè)框架構(gòu)建算法。

5.1 冷啟動(dòng)預(yù)測(cè)器

當(dāng)一個(gè)新用戶或者新產(chǎn)品加入系統(tǒng)時(shí),常用的方法是使用全局平均分來(lái)預(yù)測(cè)新用戶或新產(chǎn)品的評(píng)分,我們?cè)谌制骄值幕A(chǔ)上,加上用戶和產(chǎn)品的偏置來(lái)預(yù)測(cè)冷啟動(dòng)情況下的評(píng)分,具體預(yù)測(cè)方法為:

⑹

其中,bu和bv為用戶u和產(chǎn)品v的偏置,分別由式⑷和式⑸求得。

5.2 評(píng)分預(yù)測(cè)框架構(gòu)建算法

[算法1 基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架構(gòu)建算法\&輸入:評(píng)分和評(píng)論集合,

輸出:評(píng)分預(yù)測(cè)函數(shù)f(u,v)\&1. 使用文檔向量模型訓(xùn)練評(píng)論語(yǔ)料庫(kù),得到每個(gè)評(píng)論的向量表示。

2. 使用式⑴、⑶、⑷和⑸計(jì)算用戶和產(chǎn)品的特征向量xu,xv和偏置bu,bv,對(duì)于輸入的所有用戶-產(chǎn)品對(duì)(u,v)∈Γ,連結(jié)得到訓(xùn)練實(shí)例集合。

3. 使用2中的訓(xùn)練實(shí)例集合分別訓(xùn)練多個(gè)回歸模型:f1,…,fs。

4. 使用Stacking技術(shù)將3中多個(gè)模型的結(jié)果融合得到最終的評(píng)分預(yù)測(cè)模型:

其中α1,…,αs為每個(gè)模型的權(quán)重,。\&]

在該基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架中,首先利用文檔向量模型得到評(píng)論向量,并用評(píng)論向量構(gòu)建訓(xùn)練特征實(shí)例,然后利用訓(xùn)練特征實(shí)例訓(xùn)練一個(gè)評(píng)分回歸模型,最后使用融合方法得到最終的評(píng)分預(yù)測(cè)模型。

算法1展示了該評(píng)分預(yù)測(cè)框架構(gòu)建的詳細(xì)步驟。第一步使用文檔向量模型得到訓(xùn)練評(píng)論的向量表示。第二步將向量連結(jié)成特征實(shí)例。第三步訓(xùn)練多個(gè)回歸模型。第四步使用Stacking技術(shù)將多個(gè)回歸模型相融合。Stacking技術(shù)使用多個(gè)模型的輸出作為輸入,并使用交叉驗(yàn)證的方法獲得最優(yōu)的融合模型,其常用的融合方法是線性組合。

6 實(shí)驗(yàn)結(jié)果與分析

本文使用的數(shù)據(jù)集是McAuley等[10]收集的著名電商網(wǎng)站Amazon 的評(píng)分和評(píng)論數(shù)據(jù)集。數(shù)據(jù)集按照產(chǎn)品的類別被分為25個(gè)類別子數(shù)據(jù)集,數(shù)據(jù)集一共包含486萬(wàn)多用戶,78萬(wàn)多產(chǎn)品,822萬(wàn)多條評(píng)分和評(píng)論。為了對(duì)比基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架中單個(gè)回歸模型,以及融合模型的評(píng)分預(yù)測(cè)的表現(xiàn),本文將文檔向量模型中的向量大小固定為100,并輸出所有數(shù)據(jù)集的MSE值。

所有子數(shù)據(jù)集上評(píng)分預(yù)測(cè)的MSE結(jié)果見表2。每個(gè)子數(shù)據(jù)集上最優(yōu)的MSE結(jié)果已加粗顯示,括號(hào)中為標(biāo)準(zhǔn)差。從MSE結(jié)果表中可以看出,在所有的25個(gè)子數(shù)據(jù)集上,基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架的評(píng)分預(yù)測(cè)精度優(yōu)于全局平均預(yù)測(cè)器和標(biāo)準(zhǔn)的潛在因子模型。

相比于全局平均預(yù)測(cè)器(Offset)和標(biāo)準(zhǔn)潛在因子模型(LFM),基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架的MSE結(jié)果有顯著的提升。其三模型融合的評(píng)分預(yù)測(cè)效果在24個(gè)子模型上都是最優(yōu)的,平均MSE為1.391。考慮單個(gè)回歸模型情況,k近鄰回歸(KNR)表現(xiàn)最優(yōu),平均MSE為1.395。其次是梯度提升回歸樹(GBRT),平均MSE為1.416。效果最差的單回歸模型是隨機(jī)森林(RFR),平均MSE為1.439。它們的結(jié)果都遠(yuǎn)優(yōu)于全局平均預(yù)測(cè)器并且顯著優(yōu)于潛在因子模型。

相比于標(biāo)準(zhǔn)潛在因子模型的改進(jìn)模型(SVD++),基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架的評(píng)分預(yù)測(cè)效果也有明顯提升。其平均MSE結(jié)果從1.434提升到1.391,并在23個(gè)子數(shù)據(jù)集上優(yōu)于SVD++。

綜上所述,本文在真實(shí)的Amazon數(shù)據(jù)集上的實(shí)驗(yàn)表明,基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架的評(píng)分預(yù)測(cè)效果確實(shí)明顯優(yōu)于作為基準(zhǔn)的矩陣分解模型(LFM、SVD++)。

7 結(jié)束語(yǔ)

評(píng)論數(shù)據(jù)中蘊(yùn)含了豐富的信息,它是改善僅將評(píng)分作為單一數(shù)據(jù)源的傳統(tǒng)協(xié)同過(guò)濾推薦方法的關(guān)鍵因素之一。如何分析非結(jié)構(gòu)化的評(píng)論文本成為挖掘其中蘊(yùn)含的豐富信息的關(guān)鍵問(wèn)題。本文提出了一個(gè)基于文檔向量和回歸模型的評(píng)分預(yù)測(cè)框架,首先,介紹了特征構(gòu)建方法,包括如何使用文檔向量模型將評(píng)論映射到相同維度的向量空間中以及如何使用文檔向量構(gòu)建用戶和產(chǎn)品特征向量,然后,介紹了多個(gè)回歸模型,最后,介紹了整個(gè)框架的構(gòu)建算法。雖然本文給出的例子主要是如何解決電子商務(wù)網(wǎng)站中對(duì)產(chǎn)品的評(píng)分預(yù)測(cè)問(wèn)題,但上述算法也可用于諸如個(gè)性化崗位推薦等場(chǎng)景,其應(yīng)用前景十分廣闊。未來(lái)的研究可以從評(píng)分的角度考慮更多的用戶和產(chǎn)品特征,擴(kuò)充特征空間。

參考文獻(xiàn)(References):

[1] 劉建國(guó),周濤,汪秉宏.個(gè)性化推薦系統(tǒng)的研究進(jìn)展[J].自然科學(xué)進(jìn)展,2009.19(1):1-15

[2] 鄧愛林,朱揚(yáng)勇,施伯樂(lè).基于項(xiàng)目評(píng)分預(yù)測(cè)的協(xié)同過(guò)濾推薦算法[J].軟件學(xué)報(bào),2003.14(9):1621-1628

[3] Schein, A.I., Popescul, A., Ungar, L.H., Pennock, D.M.: Methods and metrics for cold-start recommendations[C]. Proc of the 25th Annual International ACM SIGIR Conference on Research and Development in Information Re-trieval, August 11-15, 2002, Tampere, Finland,2002:253-260

[4] Quoc V. Le and Tomas Mikolov. Distributed representa-

tions of sentences and documents[C]. Proceedings of the 31th International Conference on Machine Learning, ICML 2014. New York: ACM, 2014:1188-1196

[5] Tomas Mikolov, Ilya Sutskever, Kai Chen, Greg Corrado,

and Jeffrey Dean. Distributed Representations of Words and Phrases and their Compositionality[C]. Annual Conference on Neural Information Processing Systems. MA: MIT Press,2013:3111-3119

[6] Kilian Q. Weinberger, John Blitzer, and Lawrence K. Saul.

Distance metric learning for large margin nearest neighbor classification[C]. Proceedings of Advances in Neural Information Processing Systems. MA: MIT Press,2005:1473-1480

[7] Leo Breiman. Random forests[J]. Machine Learning,2001.45(1):5-32

[8] Leo Breiman, J. H. Friedman, R. A. Olshen, and C. J.Stone. Classification and Regression Trees[M]. Wadsworth,1984.

[9] J. H. Friedman. Greedy function approximation: A gradient boosting machine[J]. Annals of Statistics,2000.29:1189-1232

[10] Julian J. McAuley, Jure Leskovec. Hidden factors andhidden topics: understanding rating dimensions with review text[C]. Proceedings of the 7th ACM Conference on Recommender System. New York: ACM,2013:165-172