一種具有噪聲魯棒性的人臉表情識別算法研究

王 鎮,童 瑩,曹雪虹,,焦良葆

(1.南京郵電大學通信與信息工程學院,江蘇南京210003;2.南京工程學院通信工程學院,江蘇南京211167)

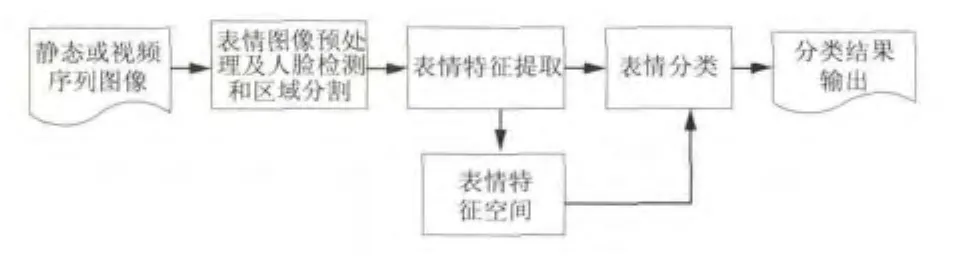

1 人臉表情識別

人臉面部表情是人類重要的形體語言之一,能夠比較準確地反映情感、精神、心理等狀態變化。近年來,利用計算機分析理解人臉表情完成相關工作,在人機交互中具有重要應用前景,人臉表情識別技術逐漸成為研究熱點。人臉表情識別系統如圖1所示,由表情圖像預處理、人臉檢測與區域分割、表情特征提取和分類4個部分組成[1]。對于一幅高質量圖像,特征提取和分類是人臉表情識別系統的兩個重要步驟。考慮到分類器識別效果好壞很大程度上取決于特征描述準確性的高低,因此表情特征提取是人臉表情識別系統的重要環節,是提高分類準確率的關鍵。

圖1 人臉表情識別系統流程圖

常見的靜態圖像人臉特征提取方法有主成分分析法(PrincipalComponentAnalysis,PCA)[2]、獨立分量分析法(IndependentComponentAnalysis,ICA)[3]、Gabor 小波變換[4]、局部二值模式(LocalBinaryPattern,LBP)[5]和尺度不變特征變換(ScaleInvariantFeatureTransform,SIFT)[6]等。PCA、ICA子空間方法受樣本數量、圖像空域變化影響較大;LBP 是一種有效的紋理描述子,但編碼方式對鄰域灰度值變化敏感;Gabor小波變換、SIFT算子運行時間長,特征維數巨大,不具有實時性,因此這些特征提取算法仍有局限性。針對這些不足,Dala N和Triggs B在2005年提出了梯度方向直方圖(Histograms of oriented gradients,HOG)[7]算法,它是一種形狀描述子,通過計算局部區域的梯度方向并統計個數,得到梯度方向直方圖,能夠很好地表征圖像的邊緣信息,具有方向不變性等特點。因此,相比LBP、Gabor、SIFT等算子,本文采用改進HOG算子可以有效提取人臉表情特征,且設置合理參數使特征維數大大降低,具有實時性。

但實際應用中,人臉表情圖像獲取容易受噪聲、光照、遮擋等因素影響,圖像質量參差不齊,因此在進行表情特征提取和識別之前,預處理工作又顯得尤為重要。本文僅考慮受噪聲污染嚴重的情況,首先對圖像進行濾波預處理。目前,圖像濾波方法有很多[8],經典算法有均值濾波、中值濾波、Wiener濾波等,它們在平滑噪聲的同時,也模糊了圖像的邊緣,不能很好重現原始圖像中的結構信息。近幾年,針對圖像濾波中保持重要特征的問題,基于非線性方程的濾波方法得到很大發展,尤其是Perona和Malilik提出的各向異性擴散濾波方法[9],其在圖像灰度平坦區域選擇大尺度平滑,在邊緣部分選擇小尺度平滑,從而實現了抑制噪聲的同時較好地保護圖像邊緣信息的目的,并得到廣泛應用。嚴哲等[10]將地震相干屬性值作為斷層信息保護因子引入到各向異性擴散濾波中,提出了一種基于各向異性擴散濾波的地震圖像增強處理方法;陳金林等[11]提出一種結合各向異性擴散和小波域的數字水印算法,保證水印不可見性的同時,具有較好的魯棒性;付麗娟等[12]將PM算法與中值濾波相結合,用經過中值濾波平滑后的梯度模值代替原始圖像的梯度模值,在提高信噪比的同時保留了圖像的細節信息,可以更好地滿足醫學圖像的使用要求。因此,本文將具有人眼視覺特性的各向異性擴散濾波方法應用到人臉表情識別中,對受噪聲污染嚴重的降質圖像進行濾波預處理。利用人眼在不同亮度背景下對亮度差的敏感性不同,結合梯度值修正擴散系數,區分處理面部斑點噪聲和肌肉皺褶形變所對應的弱邊緣、弱細節,盡可能保留原始圖像中的表情信息,為后續HOG表情特征的準確提取提供方便。

綜上所述,本文從預處理和特征提取兩個角度進行改進,提出一種在噪聲環境下有效識別人臉表情的方法。首先,設計一種具有人眼視覺特性的各向異性擴散濾波方法,利用人眼在不同亮度背景下對亮度差的敏感性不同修正擴散系數,使其在濾除噪聲的同時更好地保留了表情圖像的弱小細節信息;其次,采用HOG算子提取表情特征,并且改進梯度算子,設置合理參數,大大降低了特征向量維數,提高了算法的運行效率和識別率。在JAFFE數據庫上的實驗結果表明,本文算法是一種有效的,具有一定的噪聲魯棒性的人臉表情識別算法。

2 HOG算法原理及其改進

2.1 HOG算法基本原理

梯度方向直方圖(Histogram of Oriented Gradients,HOG),是一種在計算機視覺和圖像處理中用來進行物體檢測的特征描述子,它通過計算和統計圖像局部區域的梯度方向直方圖來構成特征。

采用HOG算子提取表情特征的具體步驟如下:

1)計算圖像每個像素點的梯度幅值和方向,捕獲表情輪廓信息,弱化光照的干擾。

2)將檢測窗口劃分成大小相同的單元格(cell)。

3)統計每個單元格(cell)的梯度方向直方圖。

4)將相鄰的單元格組合成無重疊的塊(block),統計整個塊的梯度方向直方圖特征,并對每個塊內的直方圖進行歸一化,減少背景顏色和噪聲的影響。

5)最后連接所有塊(block)的梯度方向直方圖,得到表示整個表情圖像的HOG特征。

2.2 HOG算法的改進

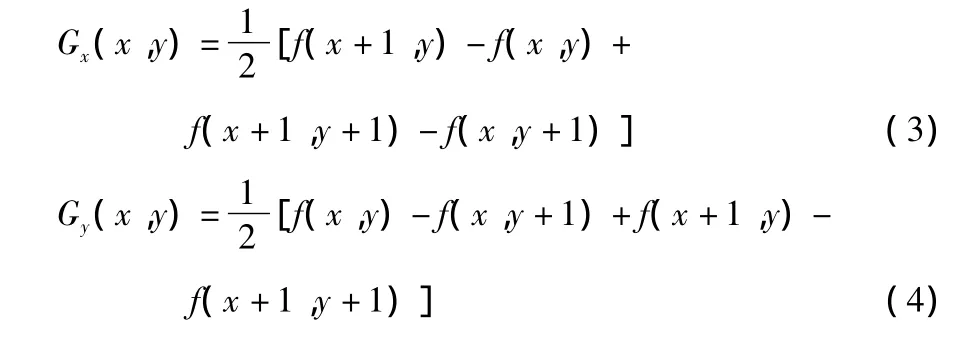

在文獻[7]中,筆者將每個 cell大小設置為8×8(pixels),block大小設為2×2(cells),在0o~180o內分了9個方向區間,用一維中心對稱模板[-1 0 1]來計算每個像素點的梯度幅值和方向,計算公式如下

因此,對于一幅大小為128×128的圖像,可劃分為8×8=64個無重疊block區域,得到特征向量維數等于64×4×9=2 304。考慮到過高的特征維數會對識別率以及運行時間產生影響,分析各個參數的表征效果,得到最佳參數,即cell大小為16×16(pixels),block大小為4×4(cells),0°~180°仍然分為9個方向區間,此時特征維數等于4×144=576,特征維度降低了75%,算法運行效率得到明顯的提升。

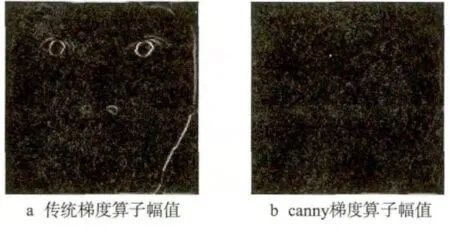

同時,本文采用canny模板代替一維中心對稱模板,梯度計算公式如式(3)~式(6)所示,得到梯度幅值圖像如圖2所示。可以看出,canny算子梯度幅值圖像比一維中心對稱算子梯度幅值圖像面部干擾噪聲小,邊緣清晰,因此其梯度方向直方圖中有效值與干擾值差異度大,特征空間距離分類效果更理想。

圖2 不同梯度算子幅值圖像

3 各向異性擴散濾波原理及改進

3.1 各向異性擴散濾波原理

平滑濾波是圖像處理中一個比較重要的環節,早期一些常見的濾波器,如高斯低通濾波器、維納濾波器等,在平滑噪聲的同時,也模糊了邊緣,丟失了圖像中的重要結構信息。針對這一不足,眾多學者提出了大量的圖像濾波算子,其中最著名的是Perona和Malik[9]提出的采用方向性分布系數代替高斯卷積的各向異性擴散濾波方法。

各向異性擴散方程(P-M方程)實質上是偏微分方程形式的熱傳導方程,其表達式如下

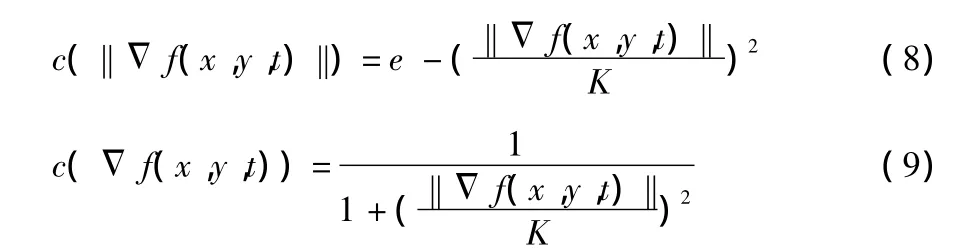

式中:f(x,y,t)為輸入圖像f(x,y)經過t次迭代后的結果;div(·)是散度算子;c(·)為擴散系數,Perona和Malik提出如下兩種形式的擴散系數方程

式中:Δf()是梯度算子;‖Δ f(x,y,t)‖表示 f(x,y,t)的梯度模值;K為梯度閾值。從上面兩個方程可以看出,擴散系數c(·)是一個以梯度模值為變量的單調遞減函數,在梯度值越大的區域,擴散系數越小,有利于保護圖像的邊緣信息;在梯度值越小的地方,擴散系數越大,有利于平滑圖像中的噪聲。

3.2 各向異性擴散濾波的改進

Δ

從式(8)~式(9)可以看出,擴散系數僅對梯度模值‖f(x,y,t)‖比較敏感,因此在人臉表情識別應用中,考慮表情變化會引起下巴、額頭、鼻梁等非顯性區域的肌肉紋理變化,這些變化產生的弱邊緣、弱細節也是表情識別的關鍵因素。但它們的梯度模值較小,擴散系數較大,傳統P-M方程對其有平滑作用,導致細節丟失,表情信息不完整。

鑒于此,本文提出了基于人眼視覺信息處理機制的各向異性擴散濾波方法,利于人眼在不同亮度背景下對目標的敏感性不同,修正擴散系數,使其能正確區分噪聲和弱小細節信息。

3.2.1 人眼視覺信息處理機制

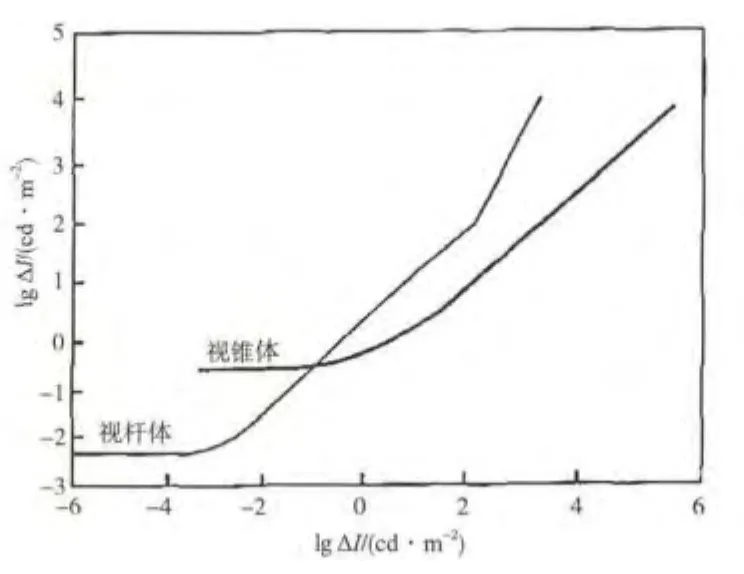

研究表明,人眼對物體的識別能力與物體亮度和背景亮度有關。假設某一物體所處的背景平均亮度為I,物體本身亮度可看作為I+ΔI,只有當亮度差ΔI大于某個閾值時,人眼才能從背景中將目標分辨出來,此時的ΔI稱為剛可分辨亮度差,ΔI與 I之間成一種非線性關系,稱為閾值亮度比(TVI)。人眼視網膜上有視桿體和視錐體兩種視覺細胞,其中視桿體在暗光環境下特別敏感,視錐體在亮光環境下比較敏感。圖3為視桿體和視錐體的閾值亮度比函數曲線[13]。從圖中可以看出,當背景很亮或者很暗時,ΔI需要較大值才能使物體可見。

圖3 TVI函數曲線

3.2.2 具有人眼視覺特性的各向異性擴散濾波

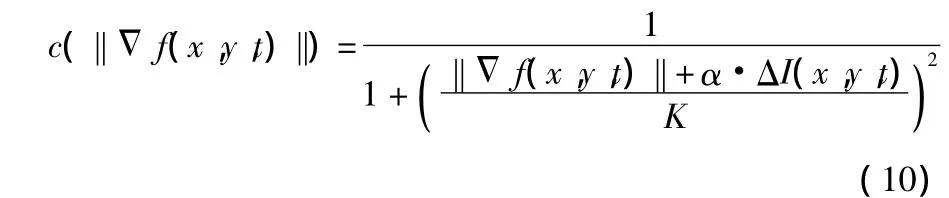

文中利用人眼在不同的亮度背景下對亮度差的敏感性不同修正擴散系數,提出新的擴散系數方程如下

式中:‖Δ f(x,y,t)‖為梯度模值;ΔI(x,y,t)為剛可分辨亮度差;α為可調系數;K為梯度閾值。其中ΔI(x,y,t)的具體求解步驟如下:

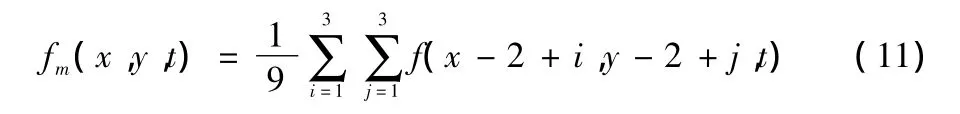

1)以像素點(x,y)為中心,求其3×3鄰域的均值fm(x,y,t)。

2)比較 f(x,y,t)和 fm(x,y,t)大小。若 f(x,y,t)> fm(x,y,t),則取3 ×3鄰域內所有灰度值小于 fm(x,y,t)的像素均值作為(x,y)處的背景值 Im(x,y,t);反之,則取所有灰度值大于 fm(x,y,t)的像素均值作為(x,y)處的背景值 Im(x,y,t)。

3)計算圖像的亮度差

由此可見,利用改進擴散方程可以有效區分邊緣、背景、弱小細節和噪聲。在邊緣變化明顯的目標區域,例如眼睛、嘴巴、眉毛等顯性特征區域,梯度模值 Δf(x,y,t)較大,亮度差ΔI(x,y,t)也較大,因此擴散系數小,平滑作用顯著降低,有利于保護邊緣信息;而在平坦背景區域,梯度模值較小,亮度變化也不大,因此平滑作用明顯,能夠有效濾除噪聲;并且,對于弱小細節區域,例如下巴、額頭、鼻梁等非顯性區域,雖然其梯度值較小,但亮度差較大,可對擴散系數進行修正,適當減弱平滑作用,實現了在濾除噪聲同時,也保留圖像中的弱小結構信息的目的,有利于后續表情圖像的特征提取。

圖4是采用傳統各向異性擴散方法和文中改進方法對表情圖像進行濾波的效果對比圖。從圖中可以看出,相比原始人臉表情圖像(見圖4a),傳統各向異性擴散方法(見圖4b)和文中改進方法(見圖4c)均能有效濾除噪聲,但對于弱小細節區域,傳統各向異性擴散方法處理效果不理想。例如在原始人臉表情圖像的下巴區域(見圖4d),有明顯的肌肉紋理變化且包含噪聲,傳統各向異性擴散方法雖然去除了噪聲但也弱化了邊緣(見圖4e),而本文方法在有效濾除噪聲同時,也較好的保護了細節信息,為準確提取表情特征提供方便(見圖4f)。

圖4 傳統各向異性擴散濾波與人眼視覺下的各向異性擴散濾波效果圖

4 實驗結果與分析

文中算法是在MATLAB環境下,對JAFFE數據庫進行實驗仿真。JAFFE數據庫是日本ATR媒體信息科學實驗室的Lyons博士提供的,包括10位日本女性在憤怒、厭惡、恐懼、高興、悲傷、驚訝6種情況下自發產生的表情圖像,共213幅圖像,圖像大小為256×256,文中選取其中每人每種表情3幅圖像,共180幅圖像進行實驗仿真。該數據庫完全開放,且表情標定標準,現為多數研究人員仿真使用。

在進行實驗仿真前,文中對數據庫中的圖像進行表情區域劃分和歸一化預處理,將所有圖像尺寸歸一化為128×128。JAFFE數據庫的部分歸一化預處理樣本表情圖像如圖5所示。

圖5 JAFFE數據庫的部分樣本表情圖像

本文采用文獻[14]中Leave-One-Sample-Out和Leave-One-Subject-Out兩種樣本選擇方式進行仿真實驗。Leave-One-Sample-Out(L-O-Sap-O)是一種熟悉人臉樣本選擇方式,選取1幅圖像作為測試樣本,剩余N-1幅圖像作為訓練樣本,交叉驗證N次,其中N為表情數據庫中所有樣本的數量。采用這種樣本選擇方式可以最大程度選擇所有數據作為測試樣本,以確保每幅圖像的表情特征都被考慮到,實驗結果更具有真實性。Leave-One-Subject-out(L-O-Sub-O)是一種不熟悉人臉樣本選擇方式,選取同一個人的所有表情作為測試樣本,剩余人的所有表情圖像作為訓練樣本,交叉驗證M次,其中M為表情數據庫中人的個數。這種樣本選擇方式可以用來評價分析人臉識別時不同表情變化對識別系統的影響。

本文采用中心最近鄰分類器進行表情識別,具體步驟參考文獻[15],文中不再詳述。實驗仿真包含以下3個方面內容:1)改進HOG算子的有效性驗證;2)基于人眼視覺信息處理機制的各向異性擴散濾波有效性驗證;3)本文算法對噪聲的魯棒性分析。

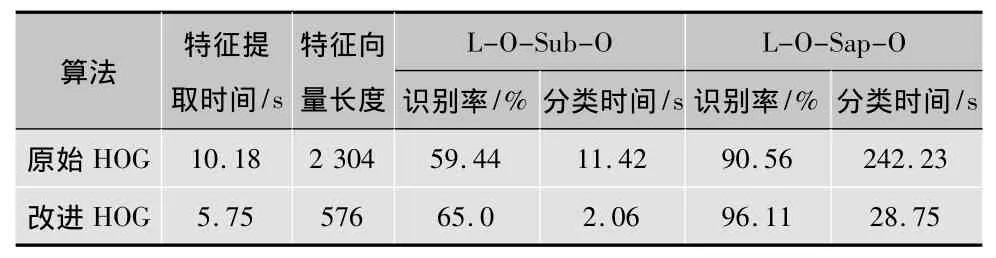

4.1 改進HOG算子有效性驗證

首先,與原始HOG算子[7]比較。設置原始HOG算子的cell大小為8×8(pixels),block大小為 2×2(cells),將 0°~180°劃分9個方向區間,用一維中心對稱模板[-1 0 1]來計算每個像素點的梯度幅值和方向;設置改進HOG算子的cell大小為16×16(pixels),block大小為 4×4(cells),0°~180°仍然分為9個方向區間,采用canny模板代替一維中心對稱模板計算每個像素點的梯度幅值和方向。在JAFFE數據庫上的仿真結果如表1所示。

表1 JAFFE數據庫的原始HOG算子與改進HOG算子識別效果比較

從表1可以看出,改進的HOG算子相比原始HOG算子在兩種分類模式下,其識別率均有明顯提高,L-O-Sub-O模式提高了5.56%,L-O-Sap-O模式提高了5.55%;從算法的運行時間看,改進HOG算法的特征提取時間和分類時間均遠遠小于原始HOG算法的運行時間。這是由于改進的HOG算法中,將每個cell的尺寸擴大了4倍,得到的特征向量長度會相應降低75%,更有利于特征提取和分類。由此可見,相比于原始HOG算子,改進的HOG算子大大降低了特征維數,減小了冗余信息的干擾,減少了算法運行時間,提高了分類準確性,具有較好的實時性。

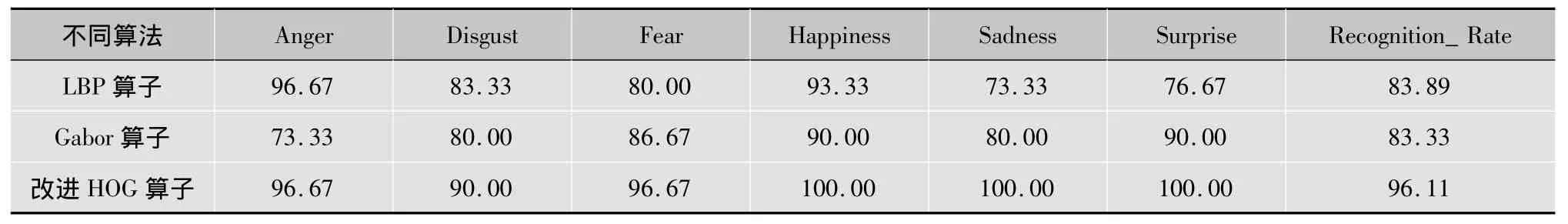

其次,與 LBP 算子[5]、Gabor小波變換[4]比較。這里采用LBP(8,1)算子分別對表情圖中8×8=64個子塊區域進行特征提取,采用文獻[4]中的方法對Gabor小波變換結果降維,得到Gabor特征。以JAFFE數據庫為例,采用L-O-Sap-O分類模式進行實驗仿真,各表情詳細識別結果如表2所示。

表2 改進HOG算子與LBP算子、Gabor小波變換的識別效果比較 %

從表2可以看出,在JAFFE數據庫下,改進HOG算子相比LBP算子和Gabor小波變換,識別率有近13%的提高。由此可見,文中改進的HOG算子是一種有效的形狀描述子,能更準確地描述人臉表情特征。

4.2 具有人眼視覺特性各向異性擴散濾波有效性驗證

在JAFFE數據庫中進行實驗仿真,首先采用原始各向異性擴散濾波和改進各向異性擴散濾波進行去噪預處理,再利用改進HOG算子提取表情特征,分類結果如表3所示。兩種濾波器的參數設置如下:原始各向異性擴散濾波的迭代次數為9次,梯度閾值K=5;改進各向異性擴散濾波的迭代次數為3次,梯度閾值K=10,常數系數α=0.8。

表3 JAFFE數據庫中原始各向異性擴散濾波與改進各向異性擴散濾波的識別率比較 %

從表中可以看出,因改進各向異性擴散濾波比原始各向異性擴散濾波更能有效區分噪聲和細節,使得表情信息盡可能完整,在此基礎上利用改進HOG算子提取表情特征和分類,兩種分類模式的識別率均有提高。由此可見,文中提出的具有人眼視覺特性的各向異性擴散濾波與改進HOG算子的組合是一種有效的表情識別算法。

4.3 本文算法的噪聲魯棒性能分析

為進一步研究本文算法對噪聲的魯棒性,對JAFFE數據庫中的人臉表情圖像分別加入方差為0.01的高斯白噪聲和噪聲密度為0.05的椒鹽噪聲,分別采用原始各向異性擴散濾波和改進的各向異性擴散濾波方法進行去噪預處理,用文中改進HOG算法進行表情特征提取和分類,實驗結果如表4所示。

從表4可以看出,因受高斯白噪聲和椒鹽噪聲的影響,圖像質量變差,改進HOG算子的識別率急劇下降,尤其是在L-O-Sap-O分類模式下,識別率下降近23%,這表明HOG算子對噪聲的魯棒性較差。若在特征提取之前,先采用原始各向異性擴散濾波或文中提出的改進各向異性擴散濾波對加入噪聲的圖像進行濾波預處理,識別率均有明顯提高。由此可見,當圖像質量較差時,預處理工作將顯得尤為重要,并且從識別率上可以看出,改進的各向異性擴散濾波比原始各向異性擴散濾波去噪效果更佳。

表4 不同噪聲下原始各項異性擴散濾波與改進的各向異性擴散濾波識別率比較 %

5 結論

本文針對人臉表情識別中預處理和特征提取兩個步驟進行改進,提出一種有效的、具有一定噪聲魯棒性的人臉表情識別算法。

首先,提出一種基于人眼視覺信息處理機制的各向異性擴散濾波方法,該方法利用人眼在不同的亮度背景下對亮度差的敏感性不同修正擴散系數。與原始各向異性擴散濾波方法相比,該算法在有效去除噪聲的同時,能更好地保留圖像的邊緣信息和紋理細節信息,保證了表情信息的完整性。

其次,采用能夠很好地表征圖像邊緣信息的HOG算子提取人臉表情特征,并修改梯度算子,合理設置參數,大大降低特征維數,有效消除冗余信息的干擾,提高識別效率,具有實時性。

在JAFFE數據庫上的實驗仿真結果表明,與傳統的LBP算子和Gabor算子相比,文中改進的HOG算子是一種有效的形狀描述子,能更準確地描述人臉表情特征。且對于加入了高斯白噪聲和椒鹽噪聲的表情圖像,相比于原始各向異性擴散濾波方法,文中提出的具有人眼視覺特性的各向異性擴散濾波有更好的濾波效果,抗噪聲性能更強。因此,對于降質圖像,本文提出算法可以有效區分噪聲和表情信息,且準確提取特征,是一種有效的人臉表情識別算法。

[1] SONG K T,CHIEN SC.Facial expression recognition based on mixture of basic expressions and intensities[C]//Proc.2012 IEEE International Conference on Systems,Man,and Cybernetics.[S.l.]:IEEE Press,2012:3123-3128.

[2] ZHAOLihong,YANGCaikun,PAN Feng,et al.Face recognition based on gabor with 2DPCA and PCA[C]//Proc.2012 24th Chines Control and Decision Conference.[S.l.]:IEEE Press,2012:2632-2635.

[3] BECKMANN C F,SMITH S M.Probabilistic independent component analysis for functional magnetic resonance imaging[J].IEEE Trans.Med.Imaging,2004(23):137-152

[4]阮錦新.多姿態人臉檢測與表情識別關鍵技術研究[D].廣州:華南理工大學,2010:64-83

[5] OJALA T,PIETIKAINENM,HARWOODD.A comparative study of texture measures with classification based on feature distributions[J].Pattern Recognition,1996,29(1):51-59

[6] GENG Cong,JIANG Xudong.Face recognition using SIFT features[C]//Proc.2009 16th IEEE International Conference on Image Processing.[S.l.]:IEEE Press,2009:3313-3316.

[7] DALA N,TRIGGS B.Histograms of oriented gradients for human detection[C]//Proc.IEEE Computer Society Conferenceon Computer Vision and Pattern Recognition(CVPR'05).San Diego,CA,USA:IEEE Press,2005:886-893.

[8]李麗萍.圖像去噪方法研究[D].武漢:長江大學,2012.

[9] PERONA P,MALIK J.Scale space and edge detection using anisotropic diffusion[J].IEEE Trans.Pattern Analysis and Machine Intelligence,1990,12(7):629-639.

[10]嚴哲,顧漢明,蔡成國.基于各向異性擴散濾波的地震圖像增強處理[J].石油地球物理學報,2013,48(3):390-394.

[11]陳金林,劉謝進.基于異性擴撒方法的數字圖像水印研究[J].計算機應用與軟件,2013,30(7):151-153.

[12]付麗娟,姚宇,付忠良.中值濾波與各向異性擴散相結合的醫學圖像濾波方法[J].計算機應用,2014,34(1):145-148.

[13] FERWERDA J A.Element of early vision for computer graphics[J].IEEE Computer Graphics and Applications,2001,21(5):22-33.

[14] MARIOSK,ANASTASIOST,IOANNISP.Salient feature and reliable classifier selection for facial expression classification[J].Pattern Recognition,2010(43):972-986.

[15]付曉峰.基于二元模式的人臉識別與表情識別研究[D].杭州:浙江大學,2008.

[16] DENIZ O,BUENO G,SALIDO J,et al.Face recognition using histograms of oriented gradients[J].Pattern Recognition Letters,2011(32):1598-1603.

[17] SONG Fengyi,TAN Xiaoyang,LIU Xue,et al.Eyes closeness detection from still images with multi-scale histograms of principal ori ented gradients[J].Pattern Recognition,2014,47(9):2825-2838.