基于YCbCr顏色空間背景建模與手勢陰影消除

(長春工業大學計算機科學與工程學院,吉林 長春 130012)

(長春工業大學計算機科學與工程學院,吉林 長春 130012)

為了提高動態手勢檢測的精確度,本文將基于YCbCr顏色空間的混合高斯背景建模應用于動態手勢識別中,并且提出手勢陰影消除的有效算法。首先,對待檢測視頻幀通過摳圖摳出手勢圖像,在YCb'Cr'顏色空間進行橢圓擬合,統計建立橢圓膚色模型,繼而在YCbCr顏色空間進行混合高斯背景建模檢測出動態手勢,點乘原圖像得到含有陰影的RGB手勢圖像,對檢測出的含有陰影的手勢圖像利用已建立的橢圓膚色模型進行陰影消除,最后將手勢圖像連成視頻序列。實驗結果表明,該算法在復雜背景下進行動態手勢的檢測率可達91.4%,高出傳統方法10%左右,能夠滿足動態手勢檢測基本要求,且具有較高的實用價值。

手勢檢測;混合高斯背景建模;橢圓擬合;陰影去除

1 引言

在信息迅速膨脹的今天,各種智能化產品登上人們生活的舞臺,推動了人工交互的迅速發展。手勢識別技術是人機交互的重要組成部分,近年來各種手勢識別的應用產品已投入到大眾需求中,例如:基于手勢識別的遠程電視控制系統和視頻游戲的用戶界面、啞語識別及交警手勢識別等。手勢識別是集人工智能、神經識別、圖像處理及智能分析等于一體,涉及計算機語言、計算機視覺、圖像處理等學科。手勢識別技術的迅速發展帶動了各個領域的共同發展,在處于信息交互頻繁的今天,手勢識別已經成為人機交互發展的主流。

手勢識別過程中首先要進行手勢檢測,檢測結果的好壞直接影響到后面識別的精確度。而在運動目標檢測中,運動物體受到風吹、光照等外界因素的干擾容易產生陰影及其他噪聲,對運動目標檢測的精確性造成較大影響[1-3]。目前運動目標檢測運用最廣泛的方法就是背景建模法,國內外對于手勢檢測的研究也取得了突破性進展,手勢分割技術也從最初的借助數據手套等工具向著由紋理、顏色等特征的方向發展[4-6]。如文獻[7]和文獻[8]中提出的背景建模在簡單背景下能夠較好地進行運動目標檢測,但是不能有效地抑制陰影,容易造成運動目標的誤檢測;文獻[1]和文獻[4]提出的復雜環境下的手勢檢測,能夠在較為復雜的背景中準確提取手勢,但僅局限于靜態手勢;文獻[9]和文獻[10]提出基于GMM的彩色運動目標檢測和聯合兩種顏色空間的運動目標陰影消除,這兩種方法實現了對運動目標的提取及陰影的部分消除,但是該方法對光照及外界環境的要求高,具有一定的局限性,實用性不高。文獻[11]和文獻[12]提出的方法能夠在復雜背景下進行運動目標檢測,但也不能有效地抑制陰影,具有一定的局限性。

本文提出的基于YCbCr顏色空間的混合高斯背景建模和基于YCb'Cr'顏色空間橢圓膚色模型相結合的動態手勢檢測不僅能夠在復雜背景下準確進行手勢檢測,還能夠有效消除手勢陰影,提高了手勢檢測的精確度,具有一定的實用價值。

2 YCb'Cr'顏色空間橢圓模型的建立

2.1 手勢圖像摳圖及YCb'Cr'顏色空間的轉化

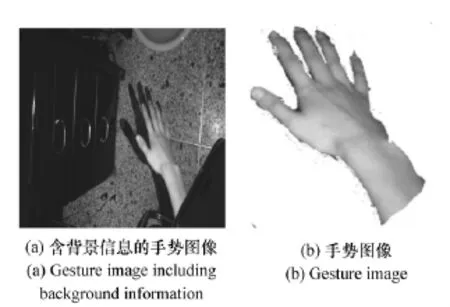

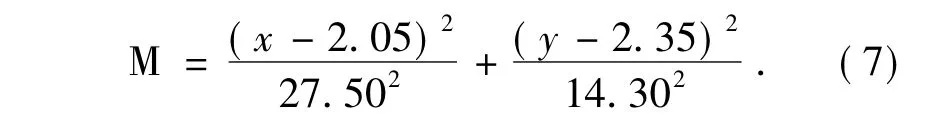

將待檢測手勢圖像拆分成70幀,利用Photoshop軟件手動將前20幀含背景信息的手勢圖像中摳出手勢圖像,并將摳出的手勢圖像非線性轉換到YCb'Cr'顏色空間,摳出的手勢圖像如圖1所示。

圖1 手勢原圖及手勢摳圖Fig.1 Hand gesture and cutout style of hand gestures

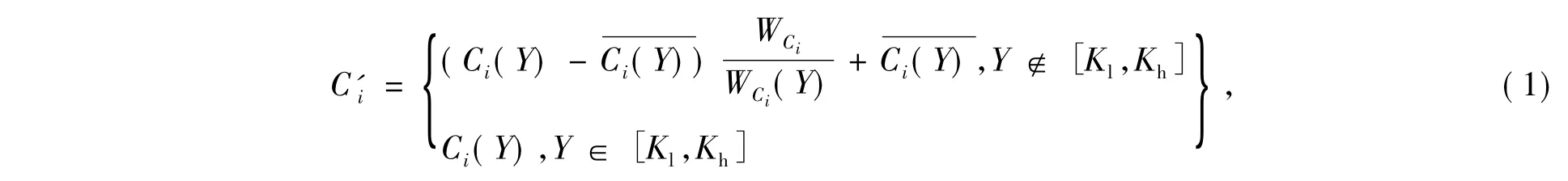

YCb'Cr'顏色空間是YCbCr非線性轉換形成的。研究發現在YCbCr顏色空間,膚色亮度和色度在高亮度和低亮度區域并非嚴格線性無關,這種依賴關系很大程度上影響了膚色的檢測效果[13]。YCb'Cr'顏色空間不僅解除了這種依賴關系,膚色在該顏色空間有著很好的聚類性,并且這種膚色聚類區域不隨著亮度的變化而變化。YCb'Cr'顏色空間轉換公式如下:

式中:WCi(Y)、的具體運算公式在文獻[1]中有具體的求解。WCi(Y)描述的是在Y-Ci坐標中膚色區域的寬度,Ci表示Cb和Cr,、Cb(Y)用4個邊界來限定聚類區域。這樣更加有利于模型更好地適應亮度過暗或過亮的區域,以此提高系統的魯棒性,提高對環境的適應能力。Kl、Kh表示非線性分段色彩變換的分段閾值。經過大量統計實驗數據得出[1]:Kl=125,Kh=148,WCb=46.97,WCr=38.76,WLCb=23,WLCr=20。

2.2 最小二乘法橢圓擬合及橢圓模型的建立

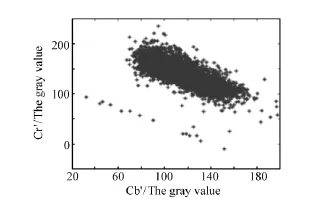

經研究發現,膚色在YCb'Cr'顏色空間聚類形狀類似橢圓[1],且具有較強的聚類性。把視頻序列的第7幀進行非線性轉換,并且將膚色點在Cb'-Cr'坐標系下的投影,投影結果如圖2所示,圖中橫坐標為Cb'像素值,縱坐標為Cr'像素值。

圖2 膚色在Cb'-Cr'坐標系下的投影Fig.2 Projection of oval color in color Cb'-Cr'coordinate system

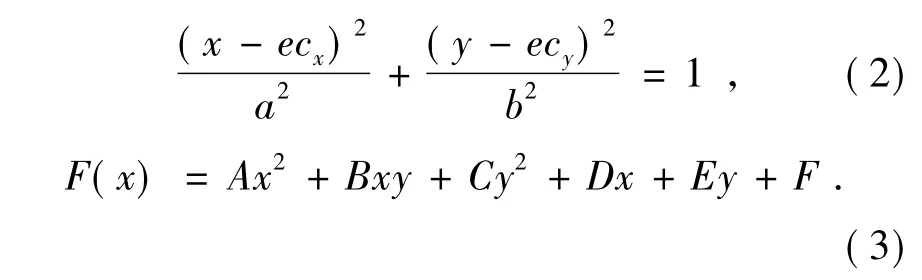

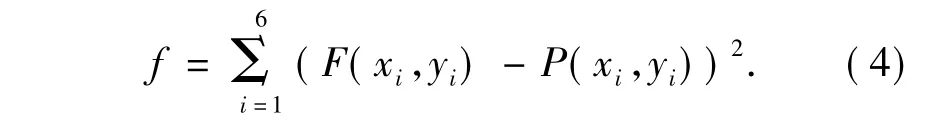

從投影圖可以看出,用橢圓模型來表述膚色在此顏色空間的分布比較精確,能夠找到一個能包含所有膚色點的最小橢圓是手勢提取的關鍵。本文選用最小二乘法進行橢圓擬合,最小二乘法通過最小化誤差的平方和來尋找最佳函數匹配,距離擬合和幾何曲線擬合是最小二乘法的兩種擬合方式[1]。本文采用距離擬合橢圓的兩種表達式如下:

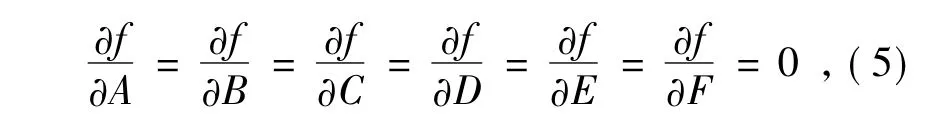

式(3)擬合過程運算較簡便,且式(3)中參數能與式(2)中的橢圓五參數進行轉換[14]。本文橢圓擬合過程如下:首先,為避免橢圓方程有零解,并將解的整數倍誤認為同一方程,需將式(3)加限制條件A+C=1[15],然后根據聚類圖形手動選取聚類圖形的6個具有代表性的邊緣像素點p(xi,yi),其中包括4個橢圓長軸短軸與橢圓交點,再另選2個橢圓邊緣曲率大的對稱像素點。繼而構造誤差平方和函數,如式(4):

由極值原理可知,可得以下線性方程:

繼而求解該線性方程式可求出參數A、B、C、D、E、F。

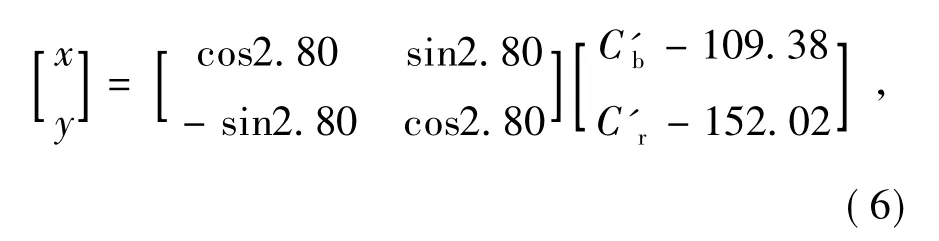

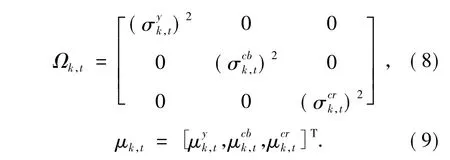

本文對視頻序列中前20幀摳出的手勢圖像進行最小二乘法橢圓擬合,然后求出參數并取其均值,最后進行公式轉化[14]后可得橢圓的五參數具體數值為:θ=2.80,exy=2.35,ecx=2.05,a=27.50,b=14.30。

此時擬合的橢圓方程已確定,繼而建立橢圓膚色模型,圖像中的像素點可用下式表示:

此時令

若M>1,該像素位于橢圓之外認定為背景像素,標記為0,若M<1,該像素位于橢圓內部認定為前景像素,即為膚色,標記為1。經過非線性轉換容易形成偽膚色,即亮度小于80的非膚色點視為膚色,故本文將Y<80的像素點認定為背景像素,即標記為0。

3 基于YCbCr顏色空間的混合高斯背景建模

3.1 模型簡介以及參數初始化

混合高斯模型中的背景像素的每一個像素可用N個不同的高斯分布表示,本文取N=3[11]。每一個高斯分布都有其對應的權值Wk。高斯模型還有2個重要的參數:均值μ與方差Ω。對于手勢視頻幀中的像素點(x,y)在t時刻的觀察值表示為Xt=()T。方差矩陣和均值矢量表示為:

參數初始化過程中將權值設置盡可能小,方差設置盡可能大,均值大小取第一幀圖像中的每一個像素點的像素值。本文取Wk,t=0.05;Ωk,t=15。

3.2 模型參數實時更新

讀取手勢視頻中第一幀,現有的高斯模型相匹配與幀中像素點進行匹配,若匹配,繼而判斷該像素與混合高斯模型中的某個高斯分布均值的距離是否小于標準差與偏差閾值的乘積(本文偏差閾值D=2.0)。若滿足,則該像素點與高斯模型中高斯分布相匹配,將該像素點歸入高斯模型中,并按照文獻[6]進行參數更新。在更新過程中,α反映的是背景的更新速度,其取值大小對模型的更新有較大的影響。經測試,本文α取值為0.03時效果最佳。若該像素與混合高斯模型中高斯分布不匹配,則按照下式減小權重Wk,即:Wk,t+1=(1-α)Wk,t。若像素點與已有的高斯模型不匹配,新的高斯模型將取代權重最小的高斯模型。經過參數不斷更新和訓練,得到混合高斯分布模型。

3.3 混合高斯背景模型的建立及手勢分割

選取權重大于某一閾值T的所有高斯分布建立混合高斯背景模型,經測試,本算法T=0.40時效果最佳。此時判斷混合高斯背景模型與當前幀的某一像素點Xt是否匹配,即:||<,其中,D為偏差閾值,σ 為標準差。若上

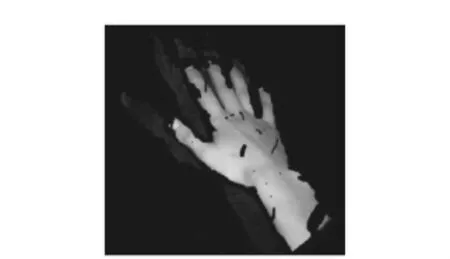

k,t式成立,該像素點標記為0,即為背景像素點;若不成立,該像素點即為1,即為前景像素點[6]。繼而進行一下形態學操作,形態開操作消除部分噪聲,連通域操作刪除面積較小的噪聲,運用合適結構元填充圖像空洞區域。最終得到運動手勢圖像。經過以上處理,混合高斯背景建模第17幀圖像動態手勢檢測結果如圖3所示。

經過混合高斯建模得到的手勢圖像含有明顯的陰影,從圖3可看出,手勢陰影已嚴重影響手勢檢測的精確度,本文對這些手勢圖像做了進一步處理。

圖3 視頻序列第17幀Fig.3 Video sequence frame 17

首先歸一化得到手勢圖像,然后用相應的原圖像點乘所得到的陰影手勢圖像,繼而得到僅含有手勢陰影的RGB手勢圖像,該圖像僅含有手勢陰影和帶有膚色信息的RGB手勢圖像,為后期手勢陰影的去除做鋪墊。處理得到的手勢圖像如圖4所示。

圖4 RGB手勢圖像Fig.4 RGB gesture image

4 橢圓膚色模型與陰影消除

4.1 橢圓膚色模型與陰影消除原理

手勢陰影是由于光源照射到背景的光線收到手勢的阻擋而形成的,故陰影會隨著手勢的運動而運動[8]。由于混合高斯背景模型是基于像素的操作,手勢陰影也被誤檢測為運動目標,為后續的研究帶來影響。受到光照等影響,經過混合高斯模型檢測出的動態手勢中經常會含有手勢陰影,而在YCb'Cr'顏色空間進行橢圓擬合建立的橢圓膚色模型可以有效地分割出膚色點與非膚色點,手勢陰影不屬于膚色點,這樣就可以有效地消除手勢陰影,而保留手勢圖像,從而精確地檢測出動態手勢。

本文將上述得到的RGB手勢圖像中每一個像素點與已得到的橢圓膚色模型相匹配,以此來區分圖像中的像素點與非像素點,繼而消除手勢陰影而保留手勢圖像,最終將得到的手勢圖像連成視頻序列,該算法完成了動態手勢的提取及其陰影的消除。本文將基于YCbCr顏色空間的混合高斯背景建模和基于YCb'Cr'顏色空間橢圓膚色模型相結合,總體算法的系統框圖如圖5所示。

圖5 算法系統框圖Fig.5 System block diagram of algorithm

4.2 實驗結果分析

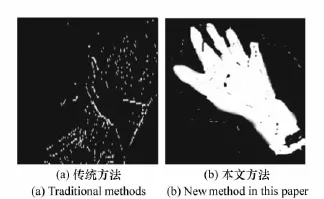

本算法選擇光照條件下的靜態復雜背景,拍攝的運動手勢視頻大約3.5s,本文還對該視頻運用傳統的混合高斯模型進行運動手勢檢測,以作對比。實驗環境為 Pentium(R)dual-core CPU 3.0GHZ,安裝內存為2.0 GB,操作系統為WINDOW7,使用MATLAB 2009b進行仿真實驗。經MATLAB仿真實驗后,仿真結果如圖6所示。

從仿真結果可以看出,經過基于YCbCr顏色空間的混合高斯背景建模檢測出的結果中含有較大的噪聲信息,并且陰影的存在已經嚴重影響到手勢的精確性。經本算法,手勢陰影被有效去除,并且能夠較精確地保留手勢圖像的有效信息。

將實驗使用的手勢視頻經過傳統混合高斯模型進行仿真實驗后,取視頻中的第27幀進行對比,對比結果如圖7所示。

圖6 仿真結果Fig.6 Simulation results

圖7 對比實驗結果Fig.7 Comparative results

經過對比實驗,本算法與傳統的混合高斯背景建模運動手勢檢測相比較,本算法可以較精確地檢測出運動手勢信息,而在該實驗的復雜背景和陰影的干擾下,傳統的檢測方法基本不能檢測出完整的手勢信息,存在大量的誤檢區域,并且噪聲特別嚴重。本實驗運動手勢視頻時長約3.5s,并拆分成70幀,然后使用不同的方法進行手勢檢測。檢測率DR定義如下:

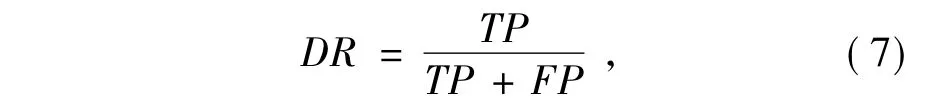

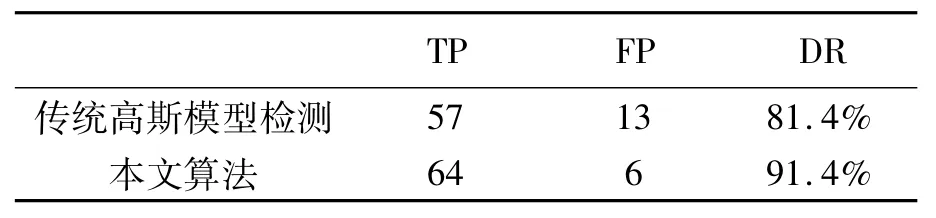

式中:TP為正檢幀數,FP為錯檢幀數。表1為檢測結果統計。

表1 檢測結果統計Tab.1 Statistics of test results

經過對以上實驗結果和數據進行分析,本實驗能夠對檢測出的手勢圖像進行陰影的消除,且能夠精確地檢測出運動手勢,有利于后續目標跟蹤和識別方面的研究。

5 結論

本文把基于YCbCr顏色空間的混合高斯背景建模運用到動態手勢檢測中,并且結合YCb'Cr'顏色空間的橢圓膚色模型,實現了復雜背景下動態手勢的精確檢測和手勢運動檢測中產生的陰影消除問題。本算法在復雜背景下的手勢檢測率可達91.4%,相比于傳統混合高斯模型,檢測率提高了10%,有效提高了動態手勢檢測的精確度,具有較高的實用價值。但由于混合高斯模型是基于像素的操作,加上本文的陰影消除方法也是建立在像素的操作上,運行速度較慢,實時性較差,所以進一步的研究將放在算法優化及實時性提高方面。

[1]WEN J T,GAO Y D,HAN S,et al..Gesture segmentation based on YCb'Cr'color space ellipse fitting skin color modeling[C].Control and Decision Conference(CCDC),Taiyuan,China,2012:1905-1908.

[2]YU X C,YANG CH,YU T C.Hand skin color segmentation using online training artificial neural network[C].Natural Computation(ICNC),Shenyang,China,2013:242-246.

[3]WEI W,JING P.Hand segmentation using skin color and background information[C].Machine Learning and Cybernetics(CMLC),Xi'an,China,2012:1484-1492.

[4]AVINASH B D,GHOSH D K,ARI S.Color hand gesture segmentation for images with complex background[C].International Conference on Circuits,Power and Computing Technologies(ICCPCT),Nagercoil,India,2013:1127-1131.

[5]YOU L ZH,CHENG H,JIA J CH.Face detection method based on multi-feature fusion in ycbcr color space[C].Image and Signal Processing(CISP),Chongqing,China,2012:1249-1252.

[6]JING L,GENG W.A shadow detection method based improved gaussian mixture model[C].Electronics Information and Emergency Communication(CEIEC),Beijing,China,2013:62-65.

[7]楊秀芳,戚銀城,李婷,等.基于YCb'Cr'膚色特征和Ostu算法的人眼定位優化方法[J].南京郵電大學學報(自然科學版),2014,34(1):99-102.

YANG X F,QI Y CH,LI T,et al..Eye location optimization method based on YCb'Cr'color features and Ostu algorithm[J].Nanjing University of Posts and Telecommunications(Natural Science),2014,34(1):99-102.(in Chinese)

[8]邱鵬瑞.基于YCbCr膚色模型改進算法及區域特征的人臉檢測研究[J].計算機與現代化,2012(4):179-182.

QIU P R.Face Detection YCbCr color model based on human and regional characteristics of the improved algorithm[J].Computer and Modernization,2012(4):179-182.(in Chinese)

[9]AI Y Y,JING J L,AI X W.Color moving object segmentation based on mixture gaussian models[C].Natural Computation(ICNC),Yantai,Shandong,China,2010:1208-1211.

[10]黃建強,曹騰飛,郭文靜,等.聯合兩種顏色空間的陰影檢測算法[J].計算機技術與發展,2014,24(7):95-98.

HUANG J Q,CAO T F,GUO W J,et al..shadow detection algorithm combined with two color spaces[J].Computer Technology and Development,2014,24(7):95-98.(in Chinese)

[11]張紅穎,胡正.CenSure特征和時空信息相結合的運動目標檢測[J].光學 精密工程,2013,21(9):2452-2462.

ZHANG H Y,HU ZH.Moving target detecte combinates CenSure characteristics and spatial temporal information[J]. Opt.Precision Eng.,2013,21(9):2452-2462.(in Chinese)

[12]王梅,屠大維,周許超.SIFT特征匹配和差分相乘融合的運動目標檢測[J].光學 精密工程,2011,19(4):892-899.

WANG M,TU D W,ZHOU X CH.Moving Object Detection combinates SIFT feature matching and differential multiplied integration[J].Opt.Precision Eng.,2011,19(4):892-899.(in Chinese)

[13]韓延祥,張志勝,郝飛,等.灰度序列圖像中基于紋理特征的移動陰影檢測[J].光學 精密工程,2013,21(11):2931-2942.

HAN Y X,ZHANG ZH SH,HAO F,et al..Grayscale image sequence moving shadow detection based on texture features[J].Opt.Precision Eng.,2013,21(11):2931-2942.(in Chinese)

[14]盧官明,郎蘇娟.基于YCbCr顏色空間的背景建模及運動目標檢測[J].南京郵電大學學報(自然科學版),2009,29(6):17-22.

LU G M,LANG S J.background modeling and moving target detection based on YCbCr color space[J].Nanjing University of Posts and Telecommunications(Natural Science),2009,29(6):17-22.(in Chinese)

[15]閆蓓,王斌,李媛.基于最小二乘法的橢圓擬合改進算法[J].北京航空航天大學學報,2008,34(3):295-298.

YAN B,WANG B,LI Y.Least squares fitting based on the elliptical improved algorithm[J].J.Beijing University of Aeronautics and Astronautics,2008,34(3):295-298.(in Chinese)

史東承(1959—),男,吉林長春人,教授,1982年于北京郵電學院獲得學士學位,1988年于東北電力學院獲得碩士學位,主要從事圖像處理與機器視覺方面的研究。E-mail:dcshi@foxmail.com

倪 康(1991—),男,山東棗莊人,碩士研究生,2013年于青島濱海學院獲得學士學位,主要從事圖像處理與機器視覺方面的研究。E-mail:9500467@qq.com

基于YCbCr顏色空間背景建模與手勢陰影消除

史東承*,倪 康

Background modeling based on YCbCr color space and gesture shadow elimination

SHI Dong-cheng*,NI Kang

(College of Computer Science and Engineering,Changchun University of Technology,Changchun 130012,China)

*Corresponding author,E-mail:dcshi@foxmail.com

To improve the accuracy of the dynamic gesture detection,Gaussian mixture background modeling based on YCbCr color space is applied to the dynamic gesture recognition,and the effective gesture shadow elimination algorithm is proposed.First of all,the gesture image is cut out from video frame to be detected,and space ellipse fitting is developed in YCb'Cr'color.Oval color model is established statistically,and then dynamic gesture in the YCbCr color space through Gaussian mixture background modeling is detected.Original image is dotted product to get the gesture RGB image containing shadows.The shadows contained in the detected gestures image were eliminated by using ellopse color model,and finally we take gesture images together into a video sequence.Experimental results show that in the algorithm of dynamic gesture detection rate is 91.4%under a complex background,about 10%higher than that by the traditional methods.So it can meet the basic requirements of dynamic gesture detection,and has a high practical value.

gesture detection;Gaussian mixture background modeling;ellipse fitting;shadow removal

2015-02-23;

2015-03-24

2095-1531(2015)04-0589-07

TP391.9 文獻標識碼:A doi:10.3788/CO.20150804.0589