通用型無參考圖像質(zhì)量評(píng)價(jià)算法綜述

張淑芳,張 聰,張 濤,雷志春

ZHANG Shufang,ZHANG Cong,ZHANG Tao,LEI Zhichun

天津大學(xué) 電子信息工程學(xué)院,天津300072

School of Electronic Information Engineering,Tianjin University,Tianjin 300072,China

1 引言

圖像質(zhì)量評(píng)價(jià)能有效評(píng)估圖像采集和處理過程所引起的失真或退化,具有很好的理論價(jià)值和應(yīng)用前景。目前研究較多地全參考(Full-Reference,F(xiàn)R)和部分參考(Reduced-Reference,RR)評(píng)價(jià)算法,由于要用到參考圖像的先驗(yàn)信息,因此在實(shí)際應(yīng)用中受到限制。無參考(No-Reference,NR)評(píng)價(jià)算法不依賴原始圖像信息,具有實(shí)際的應(yīng)用前景。

無參考圖像質(zhì)量評(píng)價(jià)算法按照其適用范圍可分為專用型方法和通用型方法兩種[1],如圖1 所示。專用型無參考評(píng)價(jià)算法針對(duì)特定失真類型圖像進(jìn)行評(píng)價(jià),如文獻(xiàn)[2-5]提出了針對(duì)圖像JPEG 壓縮編碼失真的評(píng)價(jià)算法,文獻(xiàn)[2-3]通過測量塊邊緣強(qiáng)度及其他特征對(duì)圖像進(jìn)行評(píng)價(jià),Zhou 等人提出了基于邊緣平均誤差和圖像活躍性的特征學(xué)習(xí)方法[4];文獻(xiàn)[6-10]是針對(duì)圖像JPEG2000壓縮編碼的算法,該類算法通常采用邊緣檢測和建立邊緣分布模型來衡量圖像的振鈴效應(yīng)和模糊程度;文獻(xiàn)[11-16]是針對(duì)圖像模糊的評(píng)價(jià)算法,Caviedes 等人通過計(jì)算輪廓上圖像塊DCT 的峰度(Kurtosis)平均值反映圖像模糊程度[11],F(xiàn)erzli等人利用恰可察覺模糊(Just Notice Blur,JNB)的方法來評(píng)價(jià)圖像質(zhì)量[12],桑慶賓等人通過構(gòu)造模糊副本來計(jì)算結(jié)構(gòu)相似性[14]。實(shí)際應(yīng)用中圖像失真類型具有多樣性和相互疊加性,因此,針對(duì)特定失真類型的無參考質(zhì)量評(píng)價(jià)算法的應(yīng)用受到嚴(yán)重限制。

圖1 無參考圖像質(zhì)量評(píng)價(jià)算法分類

當(dāng)前通用型無參考圖像質(zhì)量評(píng)價(jià)算法是本領(lǐng)域的研究熱點(diǎn),Moorthy 等人于2010 年提出了一種基于兩級(jí)框架的無參考圖像質(zhì)量評(píng)價(jià)模型(Blind Image Quality Index,BIQI)[17],在失真圖像的小波域提取統(tǒng)計(jì)特征和利用支持向量機(jī)(Support Vector Machine,SVM)進(jìn)行圖像失真類型分類的基礎(chǔ)上,融合專用型無參考質(zhì)量評(píng)價(jià)方法,計(jì)算圖像客觀質(zhì)量分?jǐn)?shù)。Moorthy 等人在BIQI模型的基礎(chǔ)上提出基于失真類型識(shí)別的圖像真實(shí)性和完整性評(píng)價(jià)模型(Distortion Identification-based Image Verity and INtegrity Evaluation,DIIVINE)[18],利用可控金字塔[19]在方向和尺度上進(jìn)行小波分解,提取歸一化小波系數(shù)[20]統(tǒng)計(jì)特征,然后利用支持向量機(jī)建立特征模型。

有別于兩級(jí)框架的無參考圖像質(zhì)量評(píng)價(jià)算法,以下幾種評(píng)價(jià)方法不需要對(duì)圖像進(jìn)行失真類型分類。Saad等人提出了BLIINDS(BLind Image Integrity Notator using DCT Statistics)算法[21],并提出了BLIINDS-II改進(jìn)算法[22],其通過在圖像DCT域提取DCT系數(shù)的統(tǒng)計(jì)特征建立支持向量回歸(Support Vector Regression,SVR)模型。Mitta等人提出了BRISQUE(Blind/Referenceless Image Spatia Quality Evaluator)算法[23],通過對(duì)圖像的空域歸一化[24系數(shù)提取統(tǒng)計(jì)特征建立回歸模型。在BRISQUE 方法的基礎(chǔ)上,Mittal 等人又提出了完全無參考算法NIQE(Natural Image Quality Evaluator)[25],該算法通過計(jì)算失真圖像與無失真圖像的多元高斯模型(Multivariate Gaussian Model,MVG)距離來衡量圖像質(zhì)量。Li 等人提出了基于廣義高斯模型的GRNN(General Regression Neural Network)算法[26],通過提取圖像的相位一致性模型熵、相位一致性模型均值、失真圖像的梯度均值以及失真圖像熵等特征,運(yùn)用廣義高斯模型進(jìn)行特征建模。賈惠珍等人[27]為了彌補(bǔ)文獻(xiàn)[23]統(tǒng)計(jì)特征的缺點(diǎn),通過引入文獻(xiàn)[26]中提出的相位一致性等視覺特性,有效提高了評(píng)價(jià)性能;李朝峰等人提出了利用灰度-梯度共生矩陣計(jì)算圖像相位一致性模型熵的圖像統(tǒng)計(jì)特征[28],以及結(jié)合NSS 和小波變換的無參考圖像質(zhì)量評(píng)價(jià)[29]。

本文將對(duì)幾種典型的通用型無參考圖像質(zhì)量評(píng)價(jià)算法進(jìn)行討論,首先介紹通用型算法特征提取和質(zhì)量評(píng)價(jià)的原理;然后在LIVE 數(shù)據(jù)庫[30]上對(duì)上述評(píng)價(jià)方法進(jìn)行仿真評(píng)估,并分析和比較了各種算法的評(píng)價(jià)性能和執(zhí)行速度;最后對(duì)無參考圖像質(zhì)量評(píng)價(jià)算法的進(jìn)一步研究方向做簡要概括。

2 評(píng)價(jià)方法介紹

2.1 基于小波域特征的評(píng)價(jià)方法

2.1.1 BIQI算法

Moorthy 等人提出了一種基于小波域的自然圖像統(tǒng)計(jì)特性算法(BIQI)[17],認(rèn)為失真會(huì)影響圖像小波域自然統(tǒng)計(jì)特性[31],并且這種影響是有規(guī)律且可量化的。BIQ算法提出兩級(jí)框架的模型,第一步利用支持向量機(jī)(SVM)識(shí)別圖像中存在每一種失真類型的可能性;第二步利用專用型無參考方法或者利用支持向量回歸(SVR)計(jì)算圖像在每一種單一失真類型下對(duì)應(yīng)的圖像質(zhì)量;最后利用第一步得到的失真類型可能性對(duì)第二步的結(jié)果進(jìn)行加權(quán)平均得到圖像質(zhì)量。

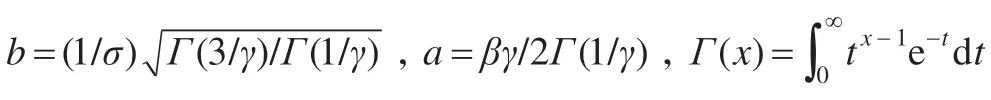

對(duì)于一幅輸入圖像,利用Daubechies 9/7 小波基,經(jīng)過3 級(jí)尺度和3 個(gè)方向的小波變換之后得到子帶系數(shù),然后用一種廣義高斯分布(Generalized Gaussian Distribution,GGD)進(jìn)行擬合:

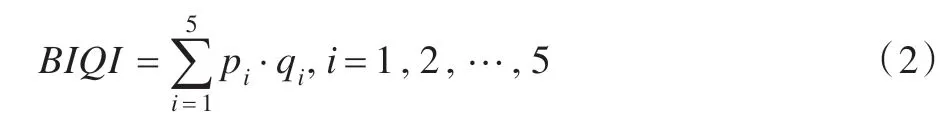

利用多分類支持向量機(jī)(Multiclass-SVM)對(duì)訓(xùn)練集中5 種失真圖像提取上述的特征向量進(jìn)行訓(xùn)練。SVM 預(yù)測出失真圖像中存在每一種失真類型的可能性pi{i=1,2,…,5}。針對(duì)5 種失真類型,利用特征向量fi,分別進(jìn)行SVR 訓(xùn)練得到特征向量與圖像主觀質(zhì)量之間的映射關(guān)系qi{i=1,2,…,5}。然后計(jì)算圖像的客觀評(píng)價(jià)質(zhì)量:

在進(jìn)行SVM 分類時(shí),采用的是徑向基函數(shù)方法(Radial Basis Function,RBF),以5 重交叉驗(yàn)證的方式確定SVM 參數(shù);采用v-SVM 進(jìn)行回歸訓(xùn)練,(C,γ,ν)參數(shù)采取與SVM 同樣的交叉驗(yàn)證方式進(jìn)行確定,其中ν取確定值0.5。

BIQI 算法測試圖像質(zhì)量時(shí),由于在多尺度多方向小波變換子帶上提取特征,并利用支持向量機(jī)進(jìn)行回歸預(yù)測,因此客觀評(píng)價(jià)分?jǐn)?shù)與主觀評(píng)價(jià)分?jǐn)?shù)之間的一致性較好。

2.1.2 DIIVINE 算法

Moorthy 等人在BIQI 算法基礎(chǔ)上進(jìn)行了改進(jìn),提出了基于失真類型識(shí)別的圖像真實(shí)性和完整性評(píng)價(jià)算法(DIIVINE)[18],不同于BIQI 只提取一些簡單的邊際描述的特征,該算法提取了與視覺一致性的統(tǒng)計(jì)特征。文獻(xiàn)[33]證明了圖像的尺度空間方向分解小波變換與大腦初級(jí)視覺皮層的空間分解相對(duì)應(yīng)。該算法對(duì)于分離歸一化[20]的小波系數(shù)進(jìn)行特征提取,并利用與BIQI相似的方法計(jì)算圖像質(zhì)量。

(1)小波系數(shù)歸一化

該過程分兩步進(jìn)行:第一步,利用可控金字塔[33]在兩級(jí)尺度、6 個(gè)方向執(zhí)行小波分解。小波分解系數(shù)用表示,θ∈{0°,30°,60°,90°,120°,150°},α∈{1,2}。第二步,執(zhí)行重要的視覺分離歸一化變換(Divisive Normalization Transform)過程[19]。定義一個(gè)歸一化鄰域向量Y,其包含了15 個(gè)系數(shù)(9 個(gè)來自子帶中間系數(shù)yc的3×3 鄰域,1 個(gè)自來小波母帶,5 個(gè)來自同一尺度上的相鄰子帶)。用高斯尺度混合(Gaussian Scale Mixture,GSM)模型[34]對(duì)Y建模。對(duì)于一個(gè)滿足GSM 模型的N維隨機(jī)向量Y,令Y≡z·U(≡表示概率分布相等),z是隨機(jī)變量,U是零均值高斯隨機(jī)向量(方差為CU),Y的概率密度可以表示為:

在已知向量Y的情況下,歸一化參數(shù)p可以表示為:,分離歸一化變換之后的系數(shù),得到了分離歸一化變換之后的子帶系數(shù)。分離歸一化過程使得自然圖像的子帶統(tǒng)計(jì)特性分布特征更接近于高斯分布。

(2)小波系數(shù)統(tǒng)計(jì)特征

小波系數(shù)統(tǒng)計(jì)特征包括:子帶分布特征、方向相關(guān)性、尺度間相關(guān)性、空間自相關(guān)性和空間互相關(guān)性。

子帶分布特征:12 個(gè)子帶上的子帶系數(shù)用公式(1)進(jìn)行表示,由于μ=0,采用快速匹配法[35]估計(jì)分布參數(shù)(σ2,γ)作為子帶分布特征。

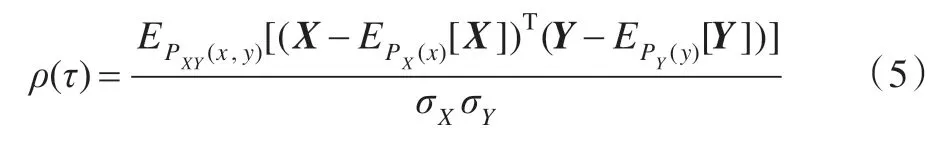

尺度相關(guān)性特征:每一個(gè)帶通(BP)子帶用窗函數(shù)方法[10]比較其高通殘余帶。采用標(biāo)準(zhǔn)差σ=1.5 的15×15 高斯窗函數(shù)對(duì)BP 和HP 帶進(jìn)行濾波。結(jié)構(gòu)相關(guān)性計(jì)算公式為:

σxy表示BP與HP窗口區(qū)域內(nèi)協(xié)方差,分別是BP與HP 窗口區(qū)域方差,C2為一個(gè)常數(shù),對(duì)子帶內(nèi)所有的局部區(qū)域相關(guān)性求平均值pˉ,將其作為尺度相關(guān)性特征。

空間互相關(guān)性特征:將θ∈{0°,30°,60°,90°,120°,150°6 個(gè)方向的子帶,分為組。采用與計(jì)算尺度相關(guān)性特征的窗函數(shù)方法[10],計(jì)算每組子帶中的區(qū)域相關(guān)性,并取最低的5%的區(qū)域相關(guān)性數(shù)值,作為空間互相關(guān)性特征。

(3)計(jì)算圖像質(zhì)量

對(duì)提取的歸一化小波系數(shù)統(tǒng)計(jì)特征,分別利用多分類支持向量機(jī)(SVM)和支持向量回歸(SVR)進(jìn)行失真類型分類和回歸預(yù)測客觀圖像質(zhì)量,具體方法與BIQI相似。

與BIQI 算法相比,DIIVINE 算法由于提取了全面、復(fù)雜的圖像小波域統(tǒng)計(jì)特征,因此DIIVINE 算法與主觀圖像質(zhì)量評(píng)價(jià)方法取得了更好的一致性。但是該算法需要進(jìn)行小波變換,并且提取特征數(shù)量較多,機(jī)器學(xué)習(xí)的難度也比較大。

2.2 基于DCT 域特征的評(píng)價(jià)方法

2.2.1 BLIINDS 算法

由于自然圖像具有高度結(jié)構(gòu)化特性[24],人類視覺特性(Human Visual System,HVS)傾向于從視覺圖像中提取結(jié)構(gòu)信息,并且對(duì)圖像的對(duì)比度高度敏感。Saad 等人提出了一種基于DCT 域統(tǒng)計(jì)特性的圖像完整性評(píng)價(jià)方法(BLIINDS)[21]。BLIINDS 提取DCT 系數(shù)的統(tǒng)計(jì)特征,利用機(jī)器學(xué)習(xí)的方法來評(píng)價(jià)圖像質(zhì)量。

(1)DCT 域的特征提取

DCT 域的特征包括對(duì)比度特征、結(jié)構(gòu)特征以及各向異性。

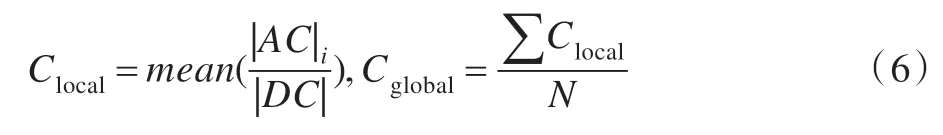

對(duì)比度特征:對(duì)比度是圖像的一個(gè)基本視覺屬性,將圖像分為B×B的圖像塊進(jìn)行二維DCT 變換,局部DCT 對(duì)比度定義為交流AC系數(shù)與直流DC系數(shù)幅值的平均。整幅圖像的全局對(duì)比度為圖像塊局部對(duì)比度的均值,計(jì)算公式為:

結(jié)構(gòu)特征:DCT 域AC系數(shù)直方圖統(tǒng)計(jì)特性,首先需要計(jì)算峰度(kurtosis),峰度是用來反映頻數(shù)分布曲線頂端尖峭或扁平程度的指標(biāo),其計(jì)算公式為:k(x)=E(x-μ)4/σ4,μ表示x的均值,σ表示標(biāo)準(zhǔn)差。對(duì)最小的10%局部峰度kb計(jì)算均值,將其作為結(jié)構(gòu)特征。

各項(xiàng)異性特征:按照{(diào)0°,45°,90°,135°}4 個(gè)方向?qū)D像分為互不重疊的B×1 圖像塊,計(jì)算圖像塊的一維DCT 變換,用Pθ[n,k]代表圖像塊的DCT 變換AC系數(shù),1 <k≤B代表該圖像塊DCT 系數(shù)序號(hào),n代表該圖像塊在圖像中的空間序號(hào),θ表示方向。將圖像塊的DCT 變換系數(shù)進(jìn)行歸一化,利用歸一化系數(shù)計(jì)算出圖像塊的雷尼(Renyi)熵:

圖像θ方向的平均雷尼熵用E(Rθ)表示,4個(gè)方向上平均雷尼熵方差為var(E[Rθ]),最大平均雷尼熵為max(E[Rθ])。提取var(E[Rθ])與max(E[Rθ])作為圖像各向異性特征。

(2)圖像質(zhì)量計(jì)算

向量Xi={fi|i∈1,2,…,8}表示第i幅圖像上提取的特征向量,DMOSi表示第i幅圖像主觀質(zhì)量分?jǐn)?shù)。算法用多元高斯分布(Multivariate Gaussian Distribution,MGD)模型或者多元拉普拉斯分布(Multivariate Lapla cian Distribution,MLD)模型對(duì)圖像特征進(jìn)行擬合,因?yàn)檫@兩種模型僅僅需要估計(jì)均值和方差兩個(gè)參數(shù)。通過在LIVE 數(shù)據(jù)中選取部分圖像作為訓(xùn)練樣本提取圖像特征X,訓(xùn)練得到概率模型P(X,DMOS)。對(duì)于輸入圖像,提取特征向量Xi,計(jì)算maxP(DMOSi/Xi)即為圖像質(zhì)量。

BLIINDS 算法的模型訓(xùn)練不需要知道訓(xùn)練樣本的失真類型,并且特征訓(xùn)練過程簡單,算法復(fù)雜度低于基于兩級(jí)框架的算法。

2.2.2 BLIINDS-II算法

BLIINDS-II算法[22]在BLIINDS 算法的基礎(chǔ)上,對(duì)特征選取和特征擬合形式進(jìn)行了一些改變,使得客觀評(píng)價(jià)結(jié)果更符合主觀評(píng)價(jià)。BLIINDS-II 在圖像的DCT 域提取的特征包括:廣義高斯分布(Generalized Gaussian Distribution,GGD)形狀參數(shù)特征、頻率變化系數(shù)、能量子帶比例和方向特征等。

GGD 模型形狀參數(shù)特征:與BLIINDS 算法一樣,將圖像分為B×B的圖像塊進(jìn)行二維DCT 變換,用公式(1)廣義高斯模型擬合DCT 的交流系數(shù),(μ,σ2,γ)分別是該模型的參數(shù)。并將整幅圖像中最小的10%個(gè)γ值求平均作為特征f1,對(duì)全部圖像塊的γ值求平均作為高斯形狀參數(shù)特征。

頻率變化系數(shù)特征:對(duì)圖像中所有的塊計(jì)算頻率變化系數(shù)ζ=σ/μ,對(duì)最大的10%圖像塊和全部圖像塊求均值,記為Em[ζ]和E[ζ],將其作為頻率變化系數(shù)特征。

能量子帶比例特征:圖像失真通常會(huì)使圖像局部的光譜特征(Spectral Signatures)發(fā)生改變。局部DCT的能量子帶比例能夠反映圖像失真。如圖2(b)將DCT的AC系數(shù)分為3 個(gè)頻率子帶,令Ωn(n=1,2,3)代表從低到高的頻率信息子帶。定義子帶n的平均能量為:,為廣義高斯分布(1)的方差擬合參數(shù),然后計(jì)算能量子帶比例:

圖2 DCT 系數(shù)的子帶分區(qū)

同樣,對(duì)最大的10%圖像塊求均值和全部圖像塊求均值,記為Em[Rn]和E[Rn],作為頻率變化系數(shù)特征。

方向特征:按照圖2(a)的方式將圖像塊DCT 域的AC系數(shù)分為3 個(gè)方向信息子帶。對(duì)每一個(gè)子帶采用廣義高斯模型進(jìn)行擬合,得到模型參數(shù)ζn(n=1,2,3),然后計(jì)算每一個(gè)子帶內(nèi)ζn的方差var(ζ)。分別對(duì)最大的10%圖像塊求均值以及全部圖像塊求均值,記為Em[var(ζn)]和E[var(ζn)],將其作為方向特征。

BLIINDS-II 最后圖像質(zhì)量計(jì)算方法與BLIINDS 相同,BLIINDS-II 的貢獻(xiàn)在于選取了DCT 域更加符合人眼視覺效應(yīng)的特征,因此在圖像質(zhì)量評(píng)價(jià)性能上得到了很大提高。

2.3 基于空域特征的評(píng)價(jià)方法

由于空域的失真是影響圖像視覺質(zhì)量的直接原因,有效的空域特征提取可取得與主觀評(píng)價(jià)較好的一致性。并且相比于變換域(小波域、DCT 域等)特征提取,空域特征提取算法具有復(fù)雜度低和執(zhí)行速度快的優(yōu)點(diǎn),適合應(yīng)用到實(shí)時(shí)系統(tǒng)。

2.3.1 BRISQUE 算法

Ruderman等[24]發(fā)現(xiàn)自然圖像歸一化的亮度值趨向于單元正態(tài)高斯特性,他認(rèn)為圖像中的失真會(huì)改變歸一化系數(shù)的統(tǒng)計(jì)特征,通過測量這種統(tǒng)計(jì)特征的改變,可以預(yù)測失真類型并以此評(píng)價(jià)圖像視覺質(zhì)量。在此理論的基礎(chǔ)上,Mittal 等人提出了基于空域統(tǒng)計(jì)特征的BRISQUE算法[23]。

(1)圖像像素歸一化

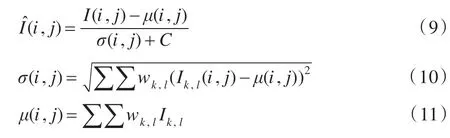

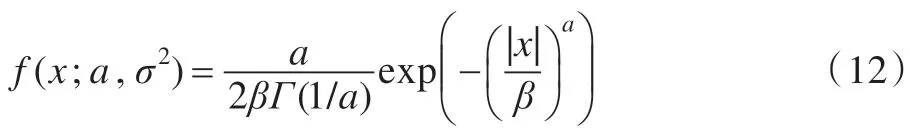

對(duì)于一幅圖像,通過分離歸一化[33](Divisive Normalization)的方法計(jì)算歸一化亮度。假定亮度圖像I(i,j),分離歸一化計(jì)算公式為:

i∈1,2,…,M,j∈1,2,…,N是空域的系數(shù),M、N分別是圖像的高度和寬度,C是常數(shù)。其中,圓形對(duì)稱的高斯權(quán)重函數(shù)w={wk,l|k=-3…3,l=-3,…3}。稱歸一化后的亮度值為MSCN(Mean Subtracted Contrast Normalized)系數(shù)。與I(i,j)相比,減少了相鄰像素之間的相關(guān)性。

(2)空域特征提取

失真的存在會(huì)破壞相鄰MSCN 系數(shù)之間存在的規(guī)律性。歸一化系數(shù)的特征包括廣義高斯分布特征和相鄰系數(shù)相關(guān)性。

廣義高斯分布特征:模型公式可表示為:

相鄰系數(shù)相關(guān)性:從水平、垂直、主對(duì)角線和次對(duì)角線4 個(gè)方向得到相關(guān)性圖像[34],采用非對(duì)稱廣義高斯分布(Asymmetric Generalized Gaussian Distribution,AGGD)[21進(jìn)行擬合,每個(gè)方向的估計(jì)參數(shù)(η,v,σl,σr)利用快速匹配法[36]進(jìn)行估計(jì)。4 個(gè)方向估計(jì)的16 個(gè)參數(shù)作為相鄰系數(shù)相關(guān)性特征。

然而由于自然圖像統(tǒng)計(jì)特性的多尺度性,作者通過實(shí)驗(yàn)發(fā)現(xiàn)在2個(gè)尺度下分別提取2個(gè)廣義分布特征和16個(gè)相鄰系數(shù)相關(guān)性特征較合理,故一共提取(2+16)×2=36個(gè)特征。

(3)圖像質(zhì)量計(jì)算

利用支持向量回歸得到回歸模型,訓(xùn)練出圖像特征與主觀圖像質(zhì)量分?jǐn)?shù)之間的映射關(guān)系。對(duì)于待測圖像,提取其特征向量代入到訓(xùn)練好的SVR 回歸模型來計(jì)算圖像質(zhì)量。

2.3.2 NIQE 算法

NIQE 算法提取了與BRISQUE 類似的圖像特征,但算法的主要貢獻(xiàn)在于訓(xùn)練回歸模型時(shí),不再需要圖像的主觀評(píng)價(jià)分?jǐn)?shù),而是在原始圖像庫[37]上提取圖像特征,然后利用多元高斯(MVG)模型進(jìn)行建模。另一個(gè)貢獻(xiàn)是,NIQE 算法基于人眼對(duì)圖像中對(duì)比度較高區(qū)域更敏感的特征,提出在圖像中選取顯著區(qū)域建立特征模型的方法。

(1)顯著區(qū)域圖像子塊圖像特征選取

利用公式(10)中的局部方差σ(i,j)可以衡量圖像局部銳度。將圖像分為P×P尺寸的圖像塊,計(jì)算圖像塊b局部的平均方差:

δ表示局部圖像塊的平均方差,選取δ>T的圖像塊作為特征顯著圖像塊,T通常取最大局部平均方差的0.6~0.9 倍。

在提取的圖像顯著塊上,對(duì)歸一化系數(shù)利用廣義高斯分布模型(GGD)進(jìn)行擬合,采用快速匹配法[35]估計(jì)歸一化后的廣義高斯分布參數(shù)(a,σ2)。然后再采用非對(duì)稱高斯模型(AGGD)對(duì)4 個(gè)相鄰系數(shù)乘積進(jìn)行擬合,采用快速匹配法[36]得到16 個(gè)相鄰系數(shù)參數(shù)。同樣由于圖像視覺特性是多尺度的,故本文在兩個(gè)尺度下提取圖像統(tǒng)計(jì)特征,一共具有(2+16)×2=36 個(gè)特征。

(2)圖像質(zhì)量計(jì)算

對(duì)提取的36 個(gè)特征,通過擬合多元高斯(MVG)模型計(jì)算模型參數(shù)v和Σ,v和Σ分別代表MVG 模型的均值和方差矩陣。MVG 模型公式為:

其中(x1,x2,…,xk)是提取的圖像特征,v和Σ可利用最大似然估計(jì)方法[38]進(jìn)行計(jì)算得到。

然后提取失真圖像統(tǒng)計(jì)特征,進(jìn)行MVG 模型擬合得到(v′,Σ′),計(jì)算失真圖像與自然圖像擬合參數(shù)之間的距離來衡量圖像質(zhì)量:

上式v1,v2,Σ1,Σ2分別代表自然圖像與失真圖像的MVG 模型均值和方差矩陣。

NIQE 算法的模型訓(xùn)練不依賴于任何主觀評(píng)價(jià)分?jǐn)?shù),且圖像質(zhì)量計(jì)算的算法復(fù)雜度較低,因此可以應(yīng)用到實(shí)時(shí)系統(tǒng)。

2.4 基于圖像熵特征評(píng)價(jià)方法

圖像熵可反映圖像的邊緣和紋理等細(xì)節(jié),文獻(xiàn)[39]利用圖像熵識(shí)別圖像的各向異性,文獻(xiàn)[40]計(jì)算圖像熵用于評(píng)價(jià)圖像質(zhì)量。利用相位一致性作為圖像特征可很好地表示圖像質(zhì)量。圖像中大量的視覺信息都存在于頻域相位中,而非頻域幅度[41-42]。梯度也是構(gòu)成圖像邊緣或者輪廓的重要因素,梯度的變化反映圖像細(xì)節(jié)、紋理的變化。Li 等人[26]利用相位一致性和圖像梯度等圖像特征,提出了一種基于廣義神經(jīng)網(wǎng)絡(luò)的無參考圖像質(zhì)量評(píng)價(jià)算法(GRNN)。

(1)相位一致性計(jì)算

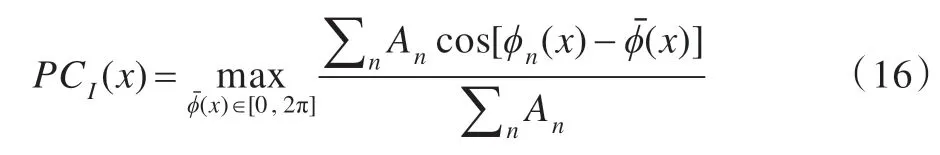

相位一致性的潛在規(guī)律是,圖像中的重要視覺特征存在于其傅里葉分量(諧波分量)具有一致性的像素里[43]。相位一致性函數(shù)為信號(hào)I在x處的傅里葉系數(shù)展開[44]:

其中An表示I的第n次諧波分布的幅度,?(x)表示x處諧波分量的局部相位,是x處的平均相位。公式(16)取得最大值對(duì)應(yīng)的,記為PCI(x)。利用文獻(xiàn)[43]或者文獻(xiàn)[44]中的方法計(jì)算相位一致性。

(2)圖像質(zhì)量計(jì)算

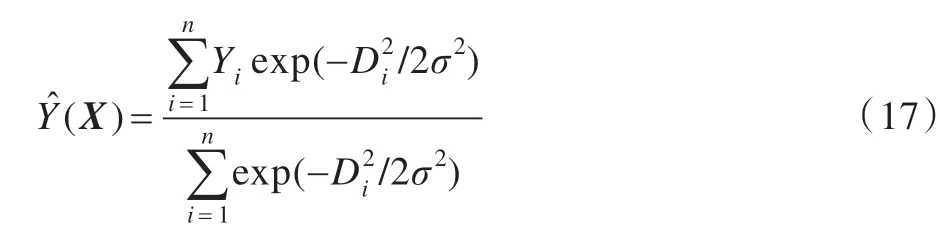

首先計(jì)算圖像的相位一致性圖像,然后計(jì)算相位一致性圖像均值、相位一致性圖像熵、失真圖像熵和失真圖像梯度等4 個(gè)特征。GRNN 算法利用廣義回歸神經(jīng)網(wǎng)絡(luò)對(duì)特征參數(shù)進(jìn)行擬合[45]。對(duì)于輸入向量X,圖像質(zhì)量預(yù)測值,廣義回歸神經(jīng)網(wǎng)絡(luò)模型公式為:

GRNN 算法是一種非機(jī)器學(xué)習(xí)的無參考圖像質(zhì)量評(píng)價(jià)算法,采用與人類視覺相關(guān)的圖像一致性進(jìn)行特征提取,并且該算法的計(jì)算復(fù)雜較低。

3 實(shí)驗(yàn)結(jié)果與分析

3.1 測試圖像庫的選取

用于圖像質(zhì)量評(píng)價(jià)算法性能測試的標(biāo)準(zhǔn)圖像庫主要有LIVE圖像質(zhì)量評(píng)價(jià)數(shù)據(jù)庫[46]、TID2008[47]和TID2013[48等。TID2008 以及TID2013 數(shù)據(jù)庫包含的圖像多,且將圖像失真類型分的更細(xì),適合于全參考圖像質(zhì)量算法的性能評(píng)價(jià)。目前無參考質(zhì)量評(píng)價(jià)算法主要將圖像失真類型分為5 類,即JPEG、JP2K、白噪聲(WN)、高斯模糊(Blur)和快衰落(FF)。LIVE 數(shù)據(jù)庫中包含29 幅未失真圖像以及與其對(duì)應(yīng)的5 類失真圖像,并且每一類失真圖像有5 級(jí)失真程度,有利于評(píng)價(jià)無參考質(zhì)量評(píng)價(jià)算法的性能。因此,本文選用LIVE 標(biāo)準(zhǔn)圖像庫進(jìn)行算法性能評(píng)估。

3.2 評(píng)價(jià)指標(biāo)

客觀圖像質(zhì)量評(píng)價(jià)算法的性能評(píng)價(jià)主要測量客觀評(píng)價(jià)數(shù)據(jù)與主觀評(píng)價(jià)數(shù)據(jù)的一致性。視頻質(zhì)量專家組(Video Quality Experts Group,VQEG)[49]提出了4 種評(píng)價(jià)指標(biāo):斯皮爾曼等級(jí)次序相關(guān)系數(shù)(Spearman Rank Order Correlation Coefficient,SROCC)、肯德爾等級(jí)次序相關(guān)系數(shù)(Kendall Rank Order Correlation Coefficient,KROCC)、皮爾森線性相關(guān)系數(shù)(Pearson Linear Correla tion Coefficient,PLCC)和均方根誤差RMSE。SROCC公式為:

其中di表示第i圖像在主觀評(píng)價(jià)分?jǐn)?shù)中的排序與客觀評(píng)價(jià)分?jǐn)?shù)中排序的差值。KROCC公式為:

式中,nc表示主觀數(shù)據(jù)與客觀數(shù)據(jù)一致的數(shù)據(jù)對(duì)的數(shù)目,nd表示不一致的數(shù)據(jù)對(duì)的數(shù)目。例如,對(duì)于任意的一對(duì)觀測數(shù)據(jù)(xi,yi)和(xj,yj),如果同時(shí)滿足xi>yi和xj>yj,或者滿足xi<yi和xj<yj,則稱該“數(shù)據(jù)對(duì)”是一致的。

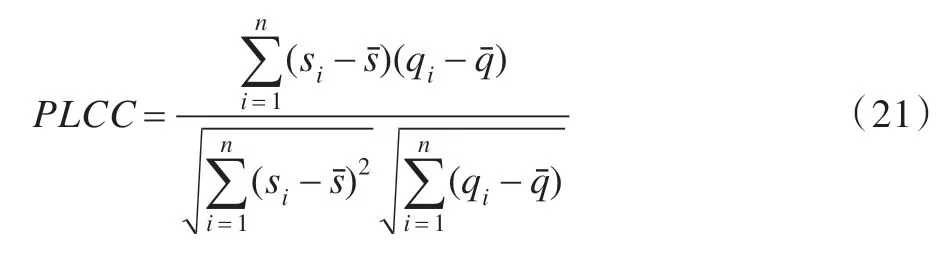

對(duì)于PLCC的計(jì)算,首先要對(duì)主觀數(shù)據(jù)與客觀數(shù)據(jù)進(jìn)行非線性擬合,文獻(xiàn)[50]給出了一種Logistic 函數(shù)對(duì)數(shù)據(jù)進(jìn)行擬合:

其中,βi是需要擬合的參數(shù),本文借助于1stopt 優(yōu)化軟件進(jìn)行參數(shù)擬合。PLCC計(jì)算公式為:

4 種評(píng)價(jià)指標(biāo)中,SROCC與KROCC兩個(gè)的評(píng)價(jià)都是計(jì)算數(shù)據(jù)對(duì)的一致性,故具有相似的結(jié)果;PLCC與RMSE在計(jì)算客觀與主觀數(shù)據(jù)一致性過程中,需要使用擬合算法得到擬合曲線,擬合曲線的優(yōu)劣直接導(dǎo)致影響主客觀數(shù)據(jù)的評(píng)價(jià)結(jié)果。本文選取SROCC指標(biāo)作為圖像質(zhì)量評(píng)價(jià)算法性能的指標(biāo),同時(shí)繪制擬合曲線定性地評(píng)價(jià)無參考評(píng)價(jià)算法的性能。

3.3 實(shí)驗(yàn)結(jié)果及分析

為了更直觀體現(xiàn)無參考圖像質(zhì)量評(píng)價(jià)算法的性能,本文在LIVE 數(shù)據(jù)庫[46]上對(duì)PSNR 和SS-SSIM 兩種經(jīng)典的全參考圖像質(zhì)量評(píng)價(jià)算法,以及本文介紹的無參考圖像質(zhì)量評(píng)價(jià)算法進(jìn)行了性能測試。

本文所有程序采用Matlab 源代碼,支持向量機(jī)采用Libsvm 工 具 包,運(yùn) 行 環(huán) 境 為Intel?CoreTMi3,主 頻 為3.40 GHz 的 處 理 器。其 中,BIQI 與DIIVINE 兩 種 算 法是基于兩級(jí)框架算法,在進(jìn)行SVM 分類時(shí),采用的是徑向基函數(shù)方法(Radial Basis Function,RBF),以5 重交叉驗(yàn)證的方式確定SVM 參數(shù);采用v-SVM 進(jìn)行回歸訓(xùn)練,(c,γ,ν)參數(shù)采取與SVM 同樣的交叉驗(yàn)證方式進(jìn)行確定,其中ν取確定值0.5(實(shí)驗(yàn)表明,ν值對(duì)算法性能影響較小)。BRISQUE 算法訓(xùn)練回歸模型同樣采用的是徑向基函數(shù),(c,γ,ν)3 個(gè)參數(shù)中,γ設(shè)為0.05,(c,ν參數(shù)為libsvm 工具箱的默認(rèn)值。對(duì)于GRNN 算法,采用MATLAB 工具箱中的newgrnn 函數(shù),參數(shù)T設(shè)為經(jīng)驗(yàn)值0.03。

同時(shí),本文還引入了兩種廣泛使用的全參考圖像質(zhì)量評(píng)價(jià)算法與文中的無參考算法進(jìn)行對(duì)比,分別是峰值信噪比(Peak Signal to Noise Ratio,PSNR,PSNR)與結(jié)構(gòu)相似度(Structural Similarity Index,SSIM)[10],文獻(xiàn)[10中的SSIM算法沒有考慮圖像多尺度特性,一般稱之為單尺度圖像結(jié)構(gòu)相似度(Single Scale SSIM,SS-SSIM)。

峰值信噪比PSNR計(jì)算公式為,

式中的M表示圖像像素的比特?cái)?shù)(一般圖像均為8 bit),x與y分別表示參考圖像與失真圖像,m與n表示圖像的高度與寬度。SS-SSIM 算法的計(jì)算公式為,

式中的μx與μy表示圖像的均值,σx與σy表示圖像的方差,C1=K1L,C2=K2L,L表示圖像動(dòng)態(tài)范圍(L=255),本文取K1=0.01,K2=0.03。

表1 為兩種經(jīng)典全參考圖像質(zhì)量評(píng)價(jià)算法(PSNR SSIM)與本文介紹的無參考圖像質(zhì)量評(píng)價(jià)算法的SROCC性能指標(biāo)對(duì)比和對(duì)于不同失真類型的平均運(yùn)行時(shí)間對(duì)比,加粗的數(shù)字表示各種失真情況下評(píng)價(jià)算法最優(yōu)的SROCC值。

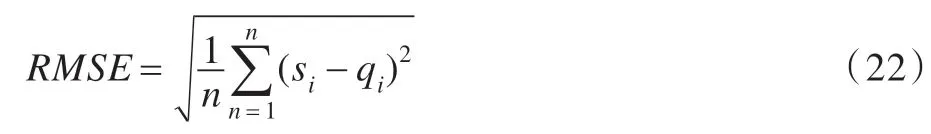

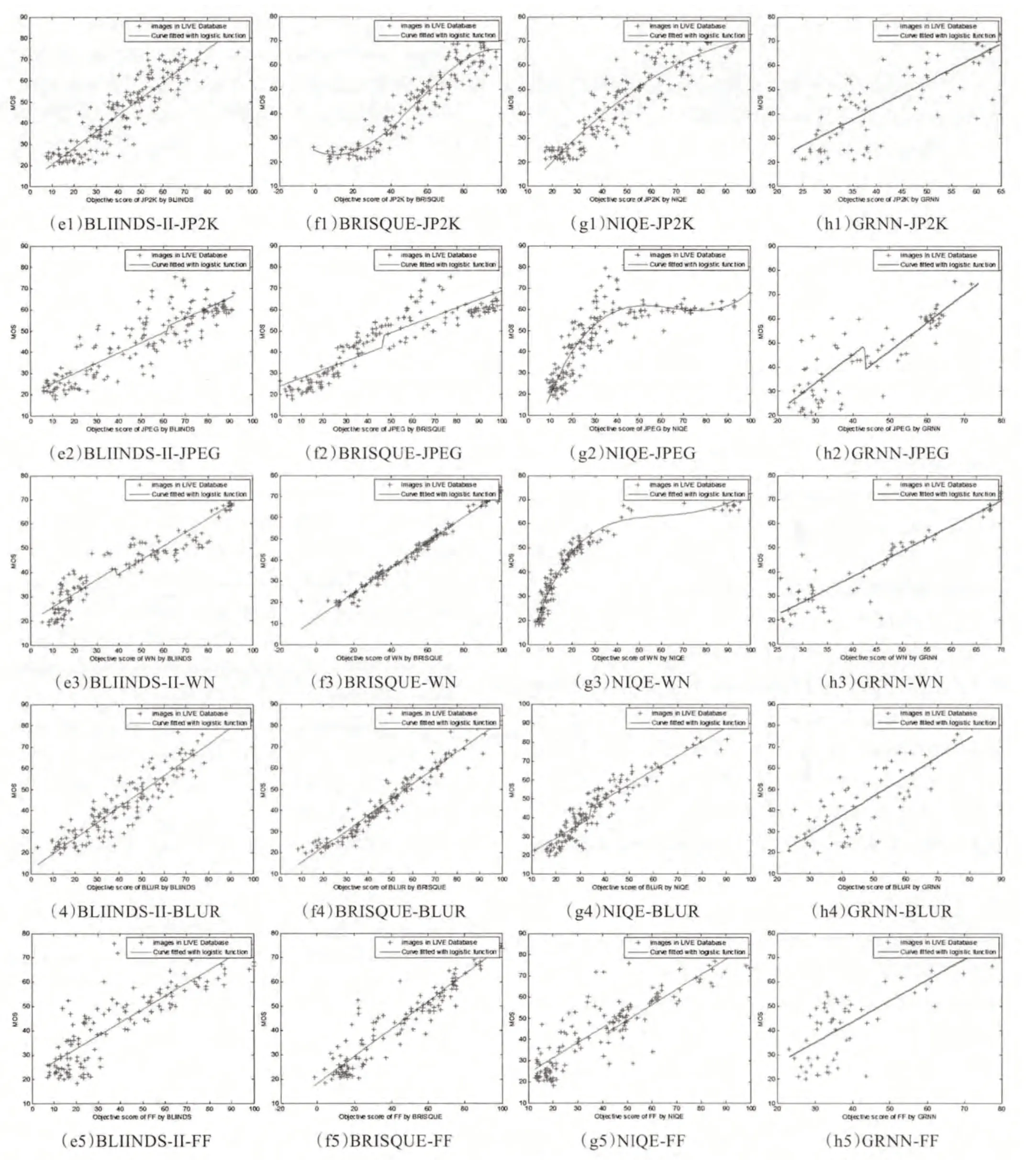

為了更直觀地評(píng)價(jià)幾種無參考評(píng)價(jià)算法的性能,本文在LIVE 數(shù)據(jù)庫上,將表1 所示的幾種評(píng)價(jià)算法針對(duì)5種失真的客觀評(píng)價(jià)結(jié)果與數(shù)據(jù)庫中的主觀數(shù)據(jù)——平均主觀評(píng)分(Mean Opinion Scores,MOS)進(jìn)行了一致性比較,如圖3 所示。圖(a)~(h)表示各種算法針對(duì)5 種失真的一致性圖,圖中的每一個(gè)離散點(diǎn)的橫坐標(biāo)表示測試圖像客觀質(zhì)量,縱坐標(biāo)表示主觀質(zhì)量。利用公式(20)的logistic 函數(shù)對(duì)圖中所有的離散點(diǎn)進(jìn)行非線性擬合,圖中紅色的曲線是用擬合結(jié)果繪制的曲線。

表1 SROCC 和程序平均運(yùn)行時(shí)間對(duì)比結(jié)果

實(shí)驗(yàn)結(jié)果分析如下:

(1)SROCC 性能分析

由表1 可以看出,BRISQUE 與DIIVINE 兩種算法的SROCC性能最好,分別為0.942 4和0.925 7;BLIINDS-II和NIQE 算法的SROCC性能較好,SROCC性能最差的是GRNN 和BIQI 算法,分別為0.847 1 和0.819 5,其SROCC低于全參考質(zhì)量評(píng)價(jià)算法SS-SSIM。

如圖3所示,從離散點(diǎn)與擬合曲線的聚合程度可以看出,BIQI算法對(duì)白噪聲的評(píng)價(jià)性能最優(yōu),但對(duì)其他4種失真類型評(píng)價(jià)性能較差;DIIVINE 算法對(duì)白噪聲與模糊評(píng)價(jià)性能最優(yōu),對(duì)快衰落失真評(píng)價(jià)性能最差;BLIINDS-I算法對(duì)JPEG 與JPEG2000 評(píng)價(jià)性能較優(yōu);BRISQUE 算法對(duì)JPEG2000、白噪聲、模糊等3 種失真類型評(píng)價(jià)性能最優(yōu);NIQE 算法對(duì)白噪聲的評(píng)價(jià)性能較優(yōu),總體性能與PSNR相當(dāng);GRNN算法對(duì)于所有失真類型評(píng)價(jià)性能均較差。綜合圖3分析可知,BRISQUE、DIIVINE、BLIINDS-I 3 種算法性能最優(yōu),BIQI 與GRNN 算法性能較差,得到了與表1 一致的結(jié)論。

圖3 圖像客觀評(píng)價(jià)與主觀評(píng)價(jià)的一致性比較

DIIVINE 與BIQI 兩種算法都是基于兩級(jí)框架的小波域特征算法,但DIIVINE 對(duì)歸一化小波系數(shù)提取了更加符合人眼視覺的特征,因此DIIVINE 的性能優(yōu)于BIQI算法。DIIVINE 與BIQI 兩種算法在執(zhí)行圖像特征模型訓(xùn)練時(shí)需要已知失真類型,已知條件相對(duì)比較苛刻。

BLIINDS 系列算法是基于分塊DCT 域特征的評(píng)價(jià)算法,針對(duì)JPEG 和JPEG2000 這類的編碼失真取得了很好的評(píng)價(jià)效果。

BRISQUE 和NIQE 兩種算法是基于空域特征提取的算法,BRISQUE 算法對(duì)5 種失真類型的評(píng)價(jià)都取得比較好的效果;NIQE 算法的SROCC性能要差一些,但它是一種“完全無參考”的算法,其訓(xùn)練過程不依賴于任何主觀質(zhì)量數(shù)據(jù),克服了實(shí)際應(yīng)用中缺乏主觀評(píng)價(jià)數(shù)據(jù)的限制。

GRNN 算法嚴(yán)重依賴于主觀訓(xùn)練數(shù)據(jù),另外由于提取的特征較少,計(jì)算結(jié)果與主觀質(zhì)量一致性較差。

(2)時(shí)間效率分析

從表1可以看出,BRISQUE的平均運(yùn)行時(shí)間最短,僅為0.152 3 s,與全參考算法中SS-SSIM 的平均運(yùn)行時(shí)間0.101 5 s 接近,但算法性能明顯優(yōu)于SS-SSIM;平均運(yùn)行時(shí)間較長的是NIQE、BIQI和GRNN算法,分別為0.404 8 s、0.507 5 s 和1.433 8 s;平均運(yùn)行時(shí)間最長的是DIIVINE和BLIINDS-II算法,分別為12.212 5 s和47.002 9 s。

DIIVINE 算法由于對(duì)圖像進(jìn)行了運(yùn)算復(fù)雜度較高的小波變換,并且特征計(jì)算較復(fù)雜,因此其運(yùn)行速度比較慢;BLIINDS-II 算法需要進(jìn)行分塊DCT 變換,也大大影響了其運(yùn)行速度。

BRISQUE 和NIQE 兩種算法是基于空域特征提取的算法,其相對(duì)于變換域算法的一個(gè)顯著優(yōu)勢就是算法執(zhí)行速度快。BRISQUE 的平均運(yùn)行時(shí)間分別為DIIVINE 和BLIINDS-II的1.2%和0.3%。

(3)綜合性能分析

從SROCC性能和平均運(yùn)行時(shí)間兩方面綜合分析本文所述的幾種無參考圖像質(zhì)量評(píng)價(jià)算法,綜合性能最優(yōu)的是BRISQUE 算法,其次是NIQE 算法。DIIVINE 和BLIINDS-II 算法雖然其SROCC 指標(biāo)較好,但其算法運(yùn)行時(shí)間很長,在實(shí)際應(yīng)用中具有很大的局限性。在實(shí)際應(yīng)用中,由于其NIQE 在對(duì)圖像進(jìn)行評(píng)價(jià)時(shí)不需要參考數(shù)據(jù)庫中已有的主觀評(píng)價(jià)數(shù)據(jù),因此具有很好的前景。

4 今后研究方向

本文介紹的幾種無參考圖像質(zhì)量評(píng)價(jià)算法雖然已經(jīng)具有很好的效果,但很多算法在評(píng)價(jià)時(shí)嚴(yán)重依賴于數(shù)據(jù)庫中的主觀評(píng)價(jià)數(shù)據(jù),并且在評(píng)價(jià)精度和算法復(fù)雜度方面還存在一些不足,今后可從以下幾個(gè)方面展開研究:

(1)突破算法對(duì)于圖像失真類型的限制。因?yàn)閳D像失真類型種類繁多,而且往往并不是相互獨(dú)立的,一幅視覺質(zhì)量較差的圖像,往往是由于多種圖像失真共同作用的結(jié)果。因此,對(duì)于需要已知訓(xùn)練圖像失真類型的一些算法顯然是不切實(shí)際的。

(2)研究與人眼的視覺效應(yīng)相關(guān)的圖像統(tǒng)計(jì)特征。利用HVS 特性,研究者已經(jīng)取得了很大的成功,然而想要更好地模擬人眼的視覺效應(yīng),這需要神經(jīng)學(xué)、生物學(xué)和心理學(xué)等多學(xué)科之間的共同發(fā)展。

(3)增加圖像的彩色信息。色彩信息也是一種重要的視覺信息,全參考圖像質(zhì)量評(píng)價(jià)算法已經(jīng)成功地將彩色信息運(yùn)用到算法中,如FSIM(Feature Similarity Index for Image Quality Assessment)算法[51],而目前幾乎所有的無參考圖像質(zhì)量評(píng)價(jià)算法都是在灰度圖像上進(jìn)行的。

(4)提高算法的運(yùn)行速度。無參考圖像質(zhì)量評(píng)價(jià)算法主要注重于網(wǎng)絡(luò)多媒體的應(yīng)用,因此需要提高圖像質(zhì)量評(píng)價(jià)算法的實(shí)時(shí)性。

5 結(jié)束語

本文對(duì)當(dāng)前經(jīng)典的幾種通用型無參考算法進(jìn)行了綜述,并在LIVE 數(shù)據(jù)庫上進(jìn)行了性能測試。無參考質(zhì)量評(píng)價(jià)算法在數(shù)字多媒體領(lǐng)域具有廣闊的應(yīng)用前景,通用型無參考算法將會(huì)是圖像質(zhì)量評(píng)價(jià)領(lǐng)域的研究熱點(diǎn),本文的通用型無參考評(píng)價(jià)算法綜述對(duì)深入理解無參考圖像質(zhì)量評(píng)價(jià)算法有著重要的意義。

[1] 高新波,路文.視覺信息質(zhì)量評(píng)價(jià)方法[M].西安:西安電子科技大學(xué)出版社,2010:105-108.

[2] Feng X J,Allebach J P.Measurement of ringing artifact in JPEG images[C]//Proc of SPIE,2006.

[3] Meesters L,Martens J B.A single-ended blockiness mea sure for JPEG-coded images[J].Signal Processing,2002,82(3):369-387.

[4] Wang Z,Sheikh H R,Bovik A C.No-reference perceptua quality assessment of JPEG compressed images[C]//Pro ceedings of IEEE International Conference on Image Pro cessing,2002:477-480.

[5] Shan S.No-reference visually significant blocking artifac metric for natural scene images[J].Signal Processing,2009,89(8):1647-1652.

[6] Tong H,Li M,Zhang H J,et al.Noreference quality assess ment for JPEG2000 compressed images[C]//Proceeding of International Conference on Image Processing,2004,5:3539-3542.

[7] Marziliano P,Dufaux F,Winkler S,et al.Perceptual blu and ringing metrics:Application to JPEG2000[J].Signa Processing:Image Communication,2004,19(2):163-172.

[8] Sazzad Z M P,Kawayoke Y,Horita Y.No reference image quality assessment for JPEG2000 based on spatial fea tures[J].Signal Processing:Image Communication,2008,23(4):257-268.

[9] Sheikh H R,Bovik A C,Cormack L.No-reference quality assessment using natural scene statistics:JPEG2000[J]IEEE Transactions on Image Processing,2005,14(11):1918-1927.

[10] Wang Z,Bovik A C,Sheikh H R,et al.Image quality assess ment:from error visibility to structural similarity[J].IEEE Transactions on Image Processing,2004,13(4):600-612

[11] Caviedes J,Oberti F.A new sharpness metric based on local kurtosis,edge and energy information[J].Signal Processing Image Communication,2004,19(2):147-161.

[12] Ferzli R,Karam L J.A no-reference objective image sharpness metric based on the notion of Just Noticeable Blur(JNB)[J].IEEE Transactions on Image Processing,2009,18(4):717-728.

[13] Zhu X,Peyman M.A no-reference sharpness metric sensitive to blur and noise[J].Quality of Multimedia Experience,2009(1):64-69.

[14] 桑慶兵,蘇媛媛,李朝鋒,等.基于梯度結(jié)構(gòu)相似度的無參考模糊圖像質(zhì)量評(píng)價(jià)[J].光電子·激光,2013,24(3):573-577.

[15] 邵宇,孫富春,劉瑩.基于局部結(jié)構(gòu)張量的無參考型圖像質(zhì)量評(píng)價(jià)方法[J].電子與信息學(xué)報(bào),2012,34(8):1779-1785.

[16] 范媛媛,沈湘衡,桑英軍.基于對(duì)比度敏感度的無參考圖像清晰度評(píng)價(jià)[J].光學(xué)精密工程,2011,19(10):2485-2493.

[17] Moorthy A K,Bovik A C.A two-step framework for constructing blind image quality indices[J].Signal Processing Letters,2010,17(5):513-516.

[18] Moorthy A K,Bovik A C.Blind image quality assessment:from natural scene statistics to perceptual quality[J].IEEE Transactions on Image Processing,2011,20(12):3350-3364.

[19] Unser M,Chenouard N,Van D,et al.Steerable pyramids and tight wavelet frames in[J].IEEE Transactions on Image Processing,2011,20(10):2705-2721.

[20] Wainwright M J,Schwartz O,Simoncelli E P.Natural image statistics and divisive normalization:Modeling nonlinearities and adaptation in cortical neurons[M].Massachusetts,USA:MIT Press,2002:203-222.

[21] Saad M A,Bovik A C,Charrier C.A DCT statistics-based blind image quality index[J].Signal Processing Letters,2010,17(6):583-586.

[22] Saad M A,Bovik A C,Charrier C.DCT statistics modelbased blind image quality assessment[C]//Proceedings of the 18th IEEE International Conference on Image Processing(ICIP),2011:3093-3096.

[23] Mittal A,Moorthy A K,Bovik A C.No-reference image quality assessment in the spatial domain[J].IEEE Transactions on Image Processing,2012,21(12):4695-4708.

[24] Ruderman D L.The statistics of natural images[J].Network:Computation in Neural Systems,1994,5(4):517-548.

[25] Mittal A,Soundararajan R,Bovik A C.Making a“completely blind”image quality analyzer[J].Signal Processing Letters,2013,20(3):209-212.

[26] Li C F,Bovik A C,Wu X J.Blind image quality assessment using a general regression neural network[J].IEEE Transactions on Neural Networks,2011,22(5):793-799.

[27] 賈惠珍,孫權(quán)森,王同罕.結(jié)合感知特征和自然場景統(tǒng)計(jì)的無參考圖像質(zhì)量評(píng)價(jià)[J].中國圖象圖形學(xué)報(bào),2014,19(6):859-867.

[28] 李朝鋒,唐國鳳,吳小俊,等.學(xué)習(xí)相位一致特征的無參考圖像質(zhì)量評(píng)價(jià)[J].電子與信息學(xué)報(bào),2013,35(2):484-488.

[29] 金波,李朝鋒,吳小俊.結(jié)合NSS 和小波變換的無參考圖像質(zhì)量評(píng)價(jià)[J].中國圖象圖形學(xué)報(bào),2012,17(1):33-39.

[30] Sheikh H R,Sabir M F,Bovik A C.A statistical evalua tion of recent full reference image quality assessmen algorithms[J].IEEE Transactions on Image Processing,2006,15(11):3440-3451.

[31] Srivastava A,Lee A B,Simoncelli E P,et al.On advance in statistical modeling of natural images[J].Journal o Mathematical Imaging and Vision,2003,18(1):17-33.

[32] Sharifi K,Leon-Garcia A.Estimation of shape paramete for generalized Gaussian distributions in subband decom positions of video[J].IEEE Transactions on Circuits and Systems for Video Technology,1995,5(1):52-56.

[33] Simoncelli E P,F(xiàn)reeman W T,Adelson E H,et al.Shift able multiscale transforms[J].IEEE Transactions on Infor mation Theory,1992,38(2):587-607.

[34] Wainwright M J,Simoncelli E P.Scale mixtures of Gauss ians and the statistics of natural images[J].Adv Neura Information Processing Systems,2000,12:855-861.

[35] Sharifi K,Leon-Garcia A.Estimation of shape paramete for generalized Gaussian distributions in subband decom positions of video[J].IEEE Transactions on Circuits and Systems for Video Technology,1995,5(1):52-56.

[36] Lasmar N E,Stitou Y,Berthoumieu Y.Multiscale skewed heavy tailed model for texture analysis[C]//Proceeding of the 16th IEEE International Conference on Image Processing(ICIP),2009:2281-2284.

[37] Martin D,F(xiàn)owlkes C,Tal D,et al.A database of human segmented natural images and its applications to evalu ating segmentations algorithms and measuring ecologica statistics[C]//Proc of International Conference on Com puter Vision,2001,2:416-423.

[38] Bishop C M.Pattern recognition and machine learning[M]New York:Springer,2006:93-94.

[39] Kirsanova E N,Sadovsky M G.Entropy approach in the analysis of anisotropy of digital images[J].Open System and Information Dynamics,2002,9(3):239-250.

[40] Gabarda S,Cristóbal G.Blind image quality assessmen through anisotropy[J].JOSA A,2007,24(12):B42-B51.

[41] Huang T,Burnett J,Deczky A.The importance of phase in image processing filters[J].IEEE Transactions on Acous tics,Speech and Signal Processing,1975,23(6):529-542.

[42] Oppenheim A V,Lim J S.The importance of phase in signals[J].Proceedings of the IEEE,1981,69(5):529-541.

[43] Morrone M C,Owens R A.Feature detection from loca energy[J].Pattern Recognition Letters,1987,6(5):303-313 x]m,]:

[44] Venkatesh S,Owens R.An energy feature detection scheme[C]//Proceedings of IEEE International Conference on Image Processing,5-8 September,1989.

[45] Specht D F.A general regression neural network[J].IEEE Transactions on Neural Networks,1991,2(6):568-576.

[46] Sheikh H R,Wang Z.Live image quality assessment database[EB/OL].(2005)[2010-06-14].http://live.ece.utexas.edu/research/Quality/.

[47] Ponomarenko N,Lukin V,Zelensky A,et al.TID2008-A database for evaluation of full reference visual quality assessment metrics[J].Advances of Modern Radio Electronics,2009,10(5):30-45.

[48] Ponomarenko N,Jin L,Ieremeiev O,et al.Image database TID2013:Peculiarities,results and perspectives[J].Signa Processing Image Communication,2015,30:57-77.

[49] Rohaly A M,Libert J,Corriveau P,et al.Final report from the video quality experts group on the validation o objective models of video quality assessment[J].ITU-T Standards Contribution COM,2000(1):9-80.

[50] Sheikh H R,Sabir M F,Bovik A C.A statistical evalua tion of recent full reference image quality assessmen algorithms[J].IEEE Transactions on Image Processing,2006,15(11):3440-3451.

[51] Zhang L,Zhang D,Mou X Q.FSIM:A feature similarity index for image quality assessment[J].IEEE Transaction on Image Processing,2011,20(8):2378-2386.