基于聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的交通標(biāo)志識(shí)別

宣森炎, 龔小謹(jǐn), 劉濟(jì)林

(浙江大學(xué) 信息科學(xué)與電子工程學(xué)系,浙江 杭州 310027)

基于聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的交通標(biāo)志識(shí)別

宣森炎, 龔小謹(jǐn), 劉濟(jì)林

(浙江大學(xué) 信息科學(xué)與電子工程學(xué)系,浙江 杭州 310027)

提出了一種聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的深層網(wǎng)絡(luò)結(jié)構(gòu),在卷積神經(jīng)網(wǎng)絡(luò)中引入了遞歸神經(jīng)網(wǎng)絡(luò)能學(xué)到的組合特征:原始圖片先通過一級(jí)由k均值聚類學(xué)得濾波器的卷積神經(jīng)網(wǎng)絡(luò),得到的結(jié)果再同時(shí)通過一級(jí)卷積和一級(jí)遞歸神經(jīng)網(wǎng)絡(luò),最后得到的特征向量由Softmax分類器進(jìn)行分類。實(shí)驗(yàn)結(jié)果表明:在第二級(jí)卷積和遞歸神經(jīng)網(wǎng)絡(luò)權(quán)重隨機(jī)的情況下,該網(wǎng)絡(luò)的識(shí)別率已經(jīng)能夠達(dá)到98.28 %,跟其他網(wǎng)絡(luò)結(jié)構(gòu)相比,大大減少了訓(xùn)練時(shí)間,而且無(wú)需復(fù)雜的工程技巧。

卷積神經(jīng)網(wǎng)絡(luò); 遞歸神經(jīng)網(wǎng)絡(luò); k均值聚類

0 引 言

交通標(biāo)志識(shí)別是駕駛員輔助系統(tǒng)和無(wú)人自主車的重要組成部分,一般對(duì)識(shí)別率有很高的要求,因?yàn)檎`識(shí)別可能會(huì)造成不可預(yù)知的后果。光照變化、移動(dòng)模糊、標(biāo)志褪色、天氣等原因給交通標(biāo)志圖像帶來(lái)了極大的變化,增加了識(shí)別的難度。

最近,深度學(xué)習(xí)作為一種能夠自動(dòng)學(xué)習(xí)圖像中深層次特征的機(jī)器學(xué)習(xí)算法得到了廣泛的關(guān)注。卷積神經(jīng)網(wǎng)絡(luò)作為深度學(xué)習(xí)的一種,在很多的物體識(shí)別任務(wù)上都取得了極好的成績(jī)。德國(guó)交通標(biāo)志識(shí)別基準(zhǔn)[1](German traffic sign recognition benchmark,GTSRB)是一個(gè)在2011年國(guó)際神經(jīng)網(wǎng)絡(luò)聯(lián)合會(huì)議(2011 International Joint Conference on Neural Networks)上引入的交通標(biāo)志識(shí)別挑戰(zhàn)賽,包括一個(gè)被廣泛認(rèn)可的交通標(biāo)志數(shù)據(jù)集。卷積神經(jīng)網(wǎng)絡(luò)在比賽中取得了最好的效果,最高的2個(gè)識(shí)別率均由卷積神經(jīng)網(wǎng)絡(luò)取得。Ciresan Dan等人[2]提出了多縱卷積神經(jīng)網(wǎng)絡(luò),利用對(duì)訓(xùn)練圖片進(jìn)行不同的預(yù)處理,訓(xùn)練得到不同的卷積神經(jīng)網(wǎng)絡(luò),測(cè)試時(shí)對(duì)各個(gè)網(wǎng)絡(luò)的結(jié)果取平均。Sermanet P等人[3]提出了一個(gè)多尺度的卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),最后輸出的特征向量是不同層特征向量的疊加。這2種方法都取得了很高的識(shí)別率,但是需要長(zhǎng)時(shí)間的訓(xùn)練、很多的計(jì)算資源和工程技巧,Ciresan Dan等人的網(wǎng)絡(luò)需要用4塊GPU訓(xùn)練37 h。

文獻(xiàn)[4]中提到,卷積神經(jīng)網(wǎng)絡(luò)之所以能夠取得很好的效果,主要是因?yàn)槠渚W(wǎng)絡(luò)結(jié)構(gòu)本身能夠提取圖像的多層次特征,最費(fèi)時(shí)的全局變量?jī)?yōu)化其實(shí)對(duì)效果的提升有限,因此,設(shè)計(jì)網(wǎng)絡(luò)結(jié)構(gòu)顯得尤為重要。

本文提出了一種聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的網(wǎng)絡(luò)結(jié)構(gòu),遞歸神經(jīng)網(wǎng)絡(luò)[5]能學(xué)到圖像低層特征的組合特征,在彩色—深度圖像識(shí)別上能夠取得很好的識(shí)別率。在本結(jié)構(gòu)中,原始圖片先通過一級(jí)卷積神經(jīng)網(wǎng)絡(luò),得到的特征圖再同時(shí)輸入一級(jí)卷積和一級(jí)接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò)進(jìn)行處

理,將兩者得到的特征向量連接后由Softmax分類器進(jìn)行分類。在第二級(jí)卷積和遞歸神經(jīng)網(wǎng)絡(luò)權(quán)重隨機(jī)的情況下,該網(wǎng)絡(luò)的識(shí)別率已經(jīng)很高,而且避免了復(fù)雜的全局變量?jī)?yōu)化,即便在CPU上也只需要4.8 h的訓(xùn)練時(shí)間。

1 網(wǎng)絡(luò)總體結(jié)構(gòu)

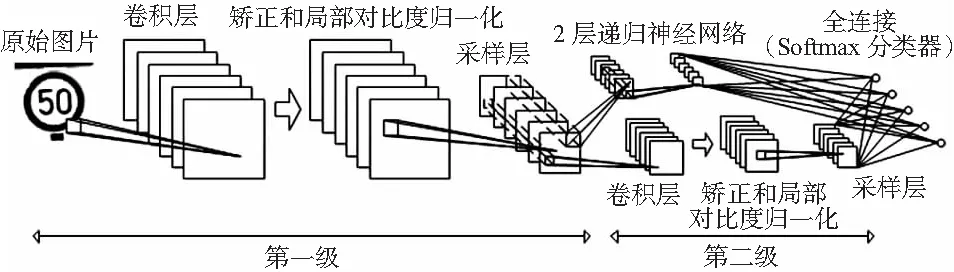

聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的網(wǎng)絡(luò)結(jié)構(gòu)如圖1所示。卷積層、矯正和局部對(duì)比度歸一化、采樣層組成一級(jí)卷積神經(jīng)網(wǎng)絡(luò),原始的輸入圖片先通過第一級(jí)卷積神經(jīng)網(wǎng)絡(luò),得到的“特征圖”再同時(shí)通過第二級(jí)卷積神經(jīng)網(wǎng)絡(luò)和2層遞歸神經(jīng)網(wǎng)絡(luò)。遞歸神經(jīng)網(wǎng)絡(luò)可以看成是卷積和采樣的結(jié)合。

圖1 聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)Fig 1 Joint convolutional and recursive neural network structure

1.1 卷積層

1.2 矯正和局部對(duì)比度歸一化

卷積層得到的特征圖先進(jìn)行矯正,即均取絕對(duì)值,然后再對(duì)局部區(qū)域內(nèi)的值進(jìn)行對(duì)比度歸一化。局部區(qū)域既包括同一張?zhí)卣鲌D上的相鄰像素,也包括不同特征圖上同一位置的相鄰像素。具體地,設(shè)局部區(qū)域大小為l×l,特征圖的個(gè)數(shù)為k,則對(duì)任一像素,取其跨特征圖的l×l×k領(lǐng)域,計(jì)算該領(lǐng)域內(nèi)像素的均值和方差,然后該像素值減去均值,差再除以方差即完成歸一化。

1.3 采樣層

比如執(zhí)教賈平凹的《月跡》時(shí),首先讓學(xué)生充分感知課文,反復(fù)練讀達(dá)到“文通字順”;然后讓學(xué)生選擇自己喜歡的描寫月光的句子,讀一讀,并引導(dǎo)學(xué)生交流喜歡的原因,從而幫助學(xué)生再現(xiàn)畫面,體會(huì)意境;最后讓學(xué)生配上柔柔的樂曲,圖文結(jié)合,美美地賞讀,在賞讀中進(jìn)一步感悟語(yǔ)言,形成語(yǔ)感,在美讀中那皎潔的月光也仿佛灑向了孩子那稚嫩的心靈。

1.4 遞歸神經(jīng)網(wǎng)絡(luò)

圖2 遞歸神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)Fig 2 Recursive neural network structure

1.5 Softmax分類器

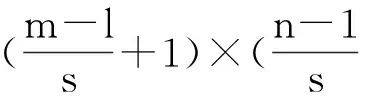

第二級(jí)卷積和遞歸神經(jīng)網(wǎng)絡(luò)得到的特征向量連接后輸入Softmax分類器進(jìn)行分類,Softmax分類器是邏輯回歸分類器在多類分類問題的擴(kuò)展。設(shè)目標(biāo)總共有n類,特征向量的維度為d維,則每一類均有一個(gè)維度為d的參數(shù)向量θj,給出一個(gè)特征向量xi,則該特征向量屬于第k類的概率為

(1)

Softmax通過最大化每個(gè)訓(xùn)練樣本屬于其本類的概率來(lái)訓(xùn)練參數(shù),一般采用Quasi-Newton法,如L-BFGS進(jìn)行優(yōu)化。

2 濾波器訓(xùn)練方法

(2)

V左乘Xpca,則得到ZCA白化的結(jié)果

Xzca=VXpca.

(3)

濾波器在對(duì)圖片進(jìn)行卷積時(shí),移動(dòng)卷積核,對(duì)應(yīng)的圖片塊也要先進(jìn)行均值和方差歸一化,以及白化,然后再進(jìn)行卷積。

3 實(shí)驗(yàn)結(jié)果與分析

實(shí)驗(yàn)采用的CPU為IntelXeonE5—2609(2.4GHz),內(nèi)存為32G。GTSRB包含39 209張訓(xùn)練圖片和12 630張測(cè)試圖片,共43類。GTSRB中的圖片大小變化很大,最小的為25×25,最大的可以達(dá)到266×232,在處理之前,所有的圖片均歸一化到67×67。

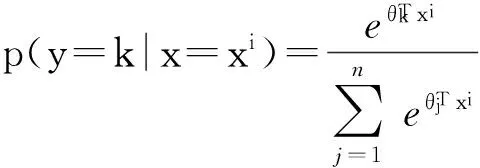

第一級(jí)卷積神經(jīng)網(wǎng)絡(luò)的濾波器大小設(shè)為1,訓(xùn)練濾波器時(shí)隨機(jī)從訓(xùn)練圖片中取了300 000個(gè)8×8的塊。濾波器的個(gè)數(shù)設(shè)為132,由k均值聚類得到的濾波器如圖3所示,(a)為132個(gè)從灰度圖像中學(xué)得的濾波器,(b)為從彩色圖像中學(xué)得的濾波器。可以看到,k均值聚類能學(xué)到一些清晰的邊緣和顏色檢測(cè)器。

圖3 k均值聚類學(xué)到的濾波器Fig 3 Filters learned from k-means clustering

第一級(jí)卷積神經(jīng)網(wǎng)絡(luò)的卷積步長(zhǎng)設(shè)為1,則對(duì)每張輸入圖片卷積之后得到132張尺度為60×60的特征圖。在采樣層,采樣的范圍設(shè)為8×8,采樣的步長(zhǎng)為2,則采樣之后每張?zhí)卣鲌D的大小為27×27。第二級(jí)的濾波器權(quán)重均隨機(jī)設(shè)置。對(duì)單尺度的遞歸神經(jīng)網(wǎng)絡(luò),將接受域的大小設(shè)為3×3,則3層遞歸神經(jīng)網(wǎng)絡(luò)分別將特征圖的尺寸降為9×9,3×3,1×1,共有132張?zhí)卣鲌D,則每個(gè)遞歸神經(jīng)網(wǎng)絡(luò)輸出的特征向量維度為132×1。多尺度遞歸神經(jīng)網(wǎng)絡(luò)在單尺度的基礎(chǔ)上,同時(shí)輸出最后2層的特征向量用于分類,則每個(gè)遞歸神經(jīng)網(wǎng)絡(luò)輸出的特征向量維度為132×10。接收域重疊的遞歸神經(jīng)網(wǎng)絡(luò)接受域大小仍設(shè)為3×3,但步長(zhǎng)設(shè)為2,因此,2層遞歸神經(jīng)網(wǎng)絡(luò)分別將特征圖的尺度減到13×13,6×6,第二層的特征向量直接輸出用于分類,因此,輸出特征向量維度為132×36。當(dāng)?shù)诙?jí)只采用遞歸神經(jīng)網(wǎng)絡(luò),且有多個(gè)遞歸神經(jīng)網(wǎng)絡(luò)結(jié)合時(shí),3種不同的網(wǎng)絡(luò)結(jié)構(gòu)的分類準(zhǔn)確率隨著遞歸神經(jīng)網(wǎng)絡(luò)數(shù)量的變化如圖4所示。可以看到,當(dāng)遞歸神經(jīng)網(wǎng)絡(luò)數(shù)量增加時(shí),識(shí)別準(zhǔn)確率變高,但準(zhǔn)確率會(huì)在一定時(shí)候達(dá)到飽和。多尺度遞歸神經(jīng)網(wǎng)絡(luò)在采用很少的數(shù)量時(shí)已經(jīng)能夠達(dá)到很高的識(shí)別率,且飽和識(shí)別率要高于單尺度遞歸神經(jīng)網(wǎng)絡(luò),這說明為提高識(shí)別準(zhǔn)確率,增加單個(gè)遞歸神經(jīng)網(wǎng)絡(luò)的特征輸出比僅僅增加遞歸神經(jīng)網(wǎng)絡(luò)數(shù)量的效果更好。接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò)對(duì)特征圖的特征提取更加密集,而且在更早的層輸出特征,特征的數(shù)量更多,因此,在僅采用3個(gè)遞歸神經(jīng)網(wǎng)絡(luò)時(shí),就已經(jīng)達(dá)到了比單尺度和多尺度的飽和識(shí)別率更好的表現(xiàn)。但是接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò)每個(gè)輸出的特征維度很高,采用很多個(gè)時(shí)會(huì)帶來(lái)內(nèi)存的問題,因此,僅測(cè)試了數(shù)量從1~8的情況。

圖4 3種不同遞歸神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)分類準(zhǔn)確率Fig 4 Classification accuracy of 3 different recursive neural network structures

實(shí)驗(yàn)也測(cè)試了第二級(jí)只采用卷積神經(jīng)網(wǎng)絡(luò)時(shí)的識(shí)別率。第二級(jí)卷積神經(jīng)網(wǎng)絡(luò)的濾波器接受域設(shè)置為4×4,卷積步長(zhǎng)為1,因此,卷積之后特征圖尺寸為24×24,采樣范圍設(shè)置為4×4,步長(zhǎng)為2,采樣之后特征圖的尺寸為11×11,這些特征值直接輸出用于分類,這時(shí)識(shí)別率達(dá)到97.79 %。

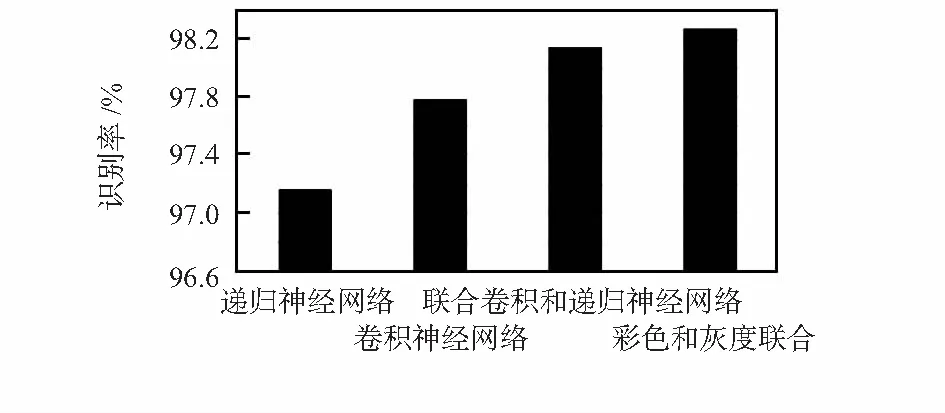

聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的效果也得到了測(cè)試。圖4顯示,提高多尺度或接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò)數(shù)量時(shí),識(shí)別率會(huì)很快達(dá)到飽和,為簡(jiǎn)單起見,這里僅采用了一個(gè)接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò)。圖5顯示了聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的效果提升,從左到右依次為:第二級(jí)為一個(gè)接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò);第二級(jí)為一個(gè)卷積神經(jīng)網(wǎng)絡(luò);第二級(jí)聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò);用灰度圖和彩色圖分別訓(xùn)練一個(gè)聯(lián)合網(wǎng)絡(luò),再將結(jié)果取平均。可以看到,單獨(dú)的遞歸神經(jīng)網(wǎng)絡(luò)識(shí)別率為97.17 %,卷積神經(jīng)網(wǎng)絡(luò)識(shí)別率為97.79 %,但是將兩者聯(lián)合后,識(shí)別率提高到了98.15 %。聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)在卷積神經(jīng)網(wǎng)絡(luò)中引入了遞歸神經(jīng)網(wǎng)絡(luò)能得到的圖像低層特征的組合特征,因此對(duì)識(shí)別有很大的幫助。彩色圖和灰度圖是原始圖片的2種模態(tài),用它們分別訓(xùn)練一個(gè)聯(lián)合網(wǎng)絡(luò),再將結(jié)果取平均,這樣的一個(gè)組合分類器又能將結(jié)果提升至98.28 %。表1列出了不同方法在GTSRB上的表現(xiàn),可以看到,聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的識(shí)別率已經(jīng)很接近人類表現(xiàn),雖然還達(dá)不到多縱卷積神經(jīng)網(wǎng)絡(luò)和多尺度卷積神經(jīng)網(wǎng)絡(luò)的表現(xiàn),但是只需要簡(jiǎn)單地通過k均值聚類訓(xùn)練第一級(jí)濾波器,以及得到特征后向量后訓(xùn)練Softmax分類器,用灰度圖和彩色圖訓(xùn)練2個(gè)聯(lián)合網(wǎng)絡(luò)總耗時(shí)4.8h。

圖5 聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的效果提升Fig 5 Effect improvement of joint convolutional and recursive neural networks

方法識(shí)別率(%)多縱卷積神經(jīng)網(wǎng)絡(luò)[2]99.46多尺度卷積神經(jīng)網(wǎng)絡(luò)[3]98.84人類表現(xiàn)98.31聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)98.28隨機(jī)森林[7]96.14

一些錯(cuò)識(shí)別的圖片如圖6所示。有些標(biāo)志具有本身非常相似的其他標(biāo)志,如限速標(biāo)志都是一個(gè)紅色的圓圈加圈內(nèi)一個(gè)數(shù)字,當(dāng)圖像具有移動(dòng)模糊,或者亮度極暗/亮的情況下,就容易錯(cuò)分,一般情況下,這種圖片人眼一時(shí)也難以區(qū)分。

圖6 錯(cuò)識(shí)別的圖片F(xiàn)ig 6 Wrongly recognized images

4 結(jié) 論

本文提出了一種聯(lián)合卷積和遞歸神經(jīng)網(wǎng)絡(luò)的網(wǎng)絡(luò)結(jié)構(gòu),引入了遞歸神經(jīng)網(wǎng)絡(luò)能學(xué)到的圖像低層特征的組合特征,在大部分網(wǎng)絡(luò)參數(shù)隨機(jī)的情況下,該網(wǎng)絡(luò)已經(jīng)能夠取得逼近人類表現(xiàn)的效果。無(wú)需復(fù)雜、需要很多工程技巧的全局變量訓(xùn)練,大大縮短了訓(xùn)練時(shí)間。本文還提出了一種多尺度的遞歸神經(jīng)網(wǎng)絡(luò)和一種接受域重疊的遞歸神經(jīng)網(wǎng)絡(luò),在較少的網(wǎng)絡(luò)數(shù)量時(shí)即取得很好的識(shí)別率。

[1] Stallkamp J,SchlipsingM,Salmen J,et al.Manvs.computer:Benchmarking machine learning algorithms for traffic sign recognition[J].Neural Networks,2012,32(8):323-332.

[2] Ciresan Dan,Meier Ueli,Masci Jonathan,et al.Multi-column deep neural network for traffic sign classification[J].Neural Networks,2012,32(8):333-338.

[3] Sermanet P,Lecun Y.Traffic sign recognition with multi-scale convolutional networks[C]∥Proceedings of International Joint Conference on Neural Networks,IJCNN 2011,2011:2809-2813.

[4] Saxe A,Koh P W,Chen Z,et al.On random weights and unsupervised feature learning[C]∥International Conference on Machine Learning,2011:1089-1096.

[5] Socher Richard,Huval Brody,Bhat Bharath,et al.Convolutional-recursive deep learning for 3D object classification[C]∥Advances in Neural Information Processing Systems,2012.

[6] Coates Adam,Ng Andrew Y . Learning feature representations with K-means[J]. Neural Networks:Tricks of the Trade,2nd ed,Lecture Notes in Computer Science,2012,7700:561-580.

[7] Zaklouta F, Stanciulescu B. Real-time traffic sign recognition using spatially weighted HOG trees[C]∥15th International Conference on Advanced Robotics(ICAR),2011.

Traffic sign recognition based on joint convolutional and recursive neural networks

XUAN Sen-yan, GONG Xiao-jin, LIU Ji-lin

(Department of Information Science and Electronic Engineering,Zhejiang University,Hangzhou 310027,China)

Propose a joint convolutional and recursive neural network structure,bring the combinational feature that recursive neural networks can learn into convolutional neural networks,that is,the raw image is first passed through a convolutional neural network stage with filters trained by k-means clustering,the result is then passed through a convolutional and a recursive neural network stage simultaneously,at last,the obtained feature vector is classified by softmax classifier.Experimental result shows that even with weights randomly set for the second convolutional and recursive neural network,the network reaches a recognition rate of 98.28 %,compared to other network structures,it greatly reduces training time and requires no complex engineering tricks.

convolutional neural networks; recursive neural networks; k-means clustering

10.13873/J.1000—9787(2014)08—0030—04

2014—01—10

TP 391.4

A

1000—9787(2014)08—0030—04

宣森炎(1988-),男,浙江諸暨人,碩士研究生,主要研究方向?yàn)閳D像處理。